基于CART-AMV改进的随机森林算法

文献发布时间:2023-06-19 09:30:39

技术领域

本发明涉及随机森林算法、CART算法、AMV算法、数据集的分类及其应用领域,尤其是用来实现工业互联网入侵检测的基于CART-AMV改进的随机森林算法。

背景技术

随机森林算法的出现,改进了集成学习中用来处理数据集分类问题的Bagging算法,可以有效地在随机森林内部对于分类时产生的一般化后的误差产生无偏差的估计,生成的随机森林泛化能力强,同时对于不平衡的数据集而言,它可以平衡误差,这是随机森林算法的优点。其缺陷是在生成决策树时的算法复杂度高,只能解决分类问题,而无法解决回归类问题,生成的决策树不具有剪枝过程,对于噪声比较大的数据集,容易陷入过拟合,对于决策树的数量较多的随机森林,计算强度高,计算时间长。

发明内容

本发明是为了解决随机森林算法算法复杂度高,分类精度低的问题。对于要求生成决策树数量较大的随机森林,随机森林算法在构建决策树时,其对信息增益的计算需要大量的对数运算,导致了算法复杂度高;对于噪声比较大的数据集,由于随机森林算法简单多数投票法的局限性,容易陷入过拟合,降低分类精度。

实现本发明目的的具体技术方案是:

首先使用CART算法通过对训练数据集的特征标签的基尼系数的计算,来构建二叉决策树,而不是随机森林算法的多叉决策树;这样相当于将随机森林算法基于信息增益构建决策树(如C4.5算法,ID3算法)使用的对数运算改进为了二次运算,从而降低了算法的复杂度。接着对生成的二叉决策树进行剪枝处理,通过增加剪枝的过程,剔除了影响较小的特征标签,进一步降低算法的复杂度,降低决策树数量较多的随机森林的计算强度和计算时间。最后使用AMV算法将剪枝后的二叉决策树组合成随机森林;AMV算法即AbsoluteMajority Vote,绝对多数投票算法,算法按照少数服从多数的原则进行投票,且要求得多数投票者的票数不少于随机森林中决策树数量的二分之一。若得多数投票者的票数不满足以上条件,则重新生成随机森林中的二叉决策树。这样可以避免对噪声比较大的数据集分类时,出现过拟合的情况。

附图说明

通过参考以下结合附图的说明及权利要求书的内容,并且随着本发明专利的更全面理解,本发明专利的其它目的及结果将更加明白及易于理解。在附图中:

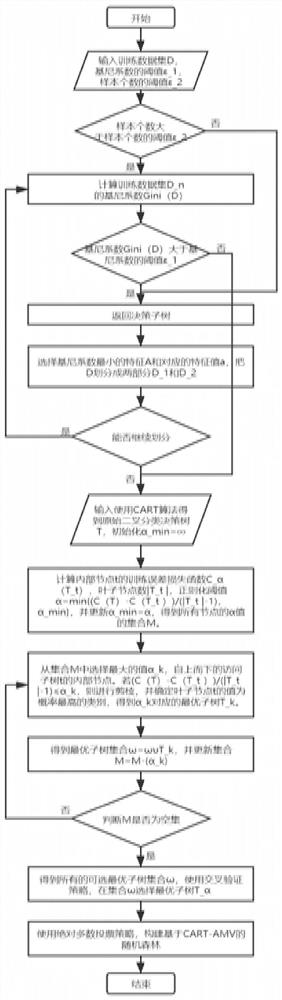

图1为基于CART-AMV算法改进的随机森林算法流程图;

图2为不同算法对Sati_mage数据集数据集处理的检测精度对比图;

图3为不同算法对Optical_digits数据集数据集数据集处理的检测精度对比图

具体实施方式

(1)输入训练数据集D,设定基尼系数的阈值ε

(2)对于当前节点的训练数据集D,如果样本个数小于样本个数的阈值ε

(3)计算训练数据集D的基尼系数Gini(D),如果基尼系数Gini(D)小于基尼系数的阈值ε

(4)在计算出来的各个特征标签的各个特征值对于训练数据集D计算出的基尼系数中,选择基尼系数最小的特征标签A和对应的特征值a。根据这个最优特征标签和最优特征值,把数据集划分成两部分D

(5)对左右节点的子节点递归调用(1)至(4),生成最终的二叉分类决策树。其中,如果在对生成的决策树做预测的时候,测试数据集里的样本A落到了某个叶子节点,而节点里有多个训练样本,则对于A的类别预测采用的是这个叶子节点里概率最大的类别。

(6)输入使用CART算法得到原始二叉分类决策树T,初始化α

(7)从叶子结点开始自下而上计算内部节点t的训练误差损失函数C

(8)从集合M中选择最大的值α

(9)得到最优子树集合ω=ωυT

(10)如果集合M为非空集,则返回(8);若集合M为空集,则得到所有的可选最优子树集合ω。

(11)使用交叉验证策略,在集合ω选择最优子树T

(12)将得到的全部最优二叉分类决策树按照绝对多数投票法(即最多票数者票数应超过投票数的二分之一)组合生成随机森林。

(13)将改进的算法应用于工业互联网入侵检测中,并通过在网络入侵检测数据集上的实验,进一步验证了本发明的可用性。

- 基于CART-AMV改进的随机森林算法

- 基于改进随机森林算法的电缆局放故障识别方法、系统