信息处理方法、装置、电子设备和存储介质

文献发布时间:2023-06-19 12:19:35

技术领域

本申请涉及基于智能识别的个性化推荐领域,尤其涉及一种信息处理方法、装置、电子设备和存储介质。

背景技术

在互联网领域,不同用户使用app(application,应用软件)会有不同的需求,对不同的用户提供不同的服务,相比于提供统一的服务和功能,转化率上会有非常明显的提升。那么,通过一种手段或者方式来识别、区分app的用户进而为不同用户提供不同服务就变得十分重要。

传统的识别、区分app用户的方式一般有两种:

一种是,通过分析用户使用app一段时间后的行为,结合已知的数据对用户进行聚类分析;

另一种是,通过让用户在注册时填写简单问卷进行用户区分。

然而,上述两种方式都存在一定的局限性,如识别精准度低等。因此,本领域期望使用一种新的方法来区分不同的app用户,以更好的为不同用户提供不同服务提供帮助。

发明内容

有鉴于此,本申请提供一种信息处理方法、装置、电子设备和存储介质,以克服传统方式存在的局限性,至少提升对不同app用户的信息识别精准度。

具体技术方案如下:

一种信息处理方法,其特征在于,包括:

获取用户使用应用程序时的面部特征信息;

获取用户使用应用程序时的声音特征信息;

根据获得的所述用户的面部特征信息和声音特征信息,识别所述用户所属的类别信息,和/或所述用户对所述应用程序的使用场景信息。

可选的,所述获取用户使用应用程序时的面部特征信息,包括:

利用图像采集装置至少实时采集用户使用所述应用程序时的面部图像;

从采集的面部图像中提取以下信息中的至少部分,作为所述用户的面部特征信息:用户双眼间距、双眼大小、鼻梁长度、嘴巴长度、嘴唇厚度、皮肤褶皱度。

可选的,所述获取用户使用应用程序时的声音特征信息,包括:

利用音频采集装置实时采集用户使用所述应用程序时的声音信息;

从采集的声音信息中提取以下信息中的至少部分,作为所述用户的声音特征信息:Mel频率倒谱系数MFCC、音色、频率、响度。

可选的,所述根据获得的所述用户的面部特征信息和声音特征信息,识别所述用户所属的类别信息,和/或所述用户对所述应用程序的使用场景信息,包括:

将所述面部特征信息和所述声音特征信息,实时输入预先基于深度学习模型构建的分类模型;

所述分类模型根据输入的所述面部特征信息和所述声音特征信息,识别所述用户的性别和年龄段,和/或识别所述用户对所述应用程序的使用场景为单人使用场景还是多人使用场景。

可选的,在获取用户使用应用程序时的面部特征信息,以及获取用户使用应用程序时的声音特征信息之前,还包括:

对采集的图像信息和/或声音信息进行数据清洗;

其中,对采集的图像信息和/或声音信息进行的数据清洗包括以下处理中的至少一种:

剔除缺失值、特殊值、范围检查、演绎修正、插值、最小值调整。

可选的,上述方法,还包括:

根据实时识别出的用户所属的类别信息和/或用户对所述应用程序的使用场景信息,动态确定或动态调整所述应用程序向所述用户提供的服务。

可选的,在动态确定或动态调整所述应用程序向所述用户提供的服务之后,还包括:

获取所述用户对所述应用程序提供的当前服务的反馈信息;

在所述反馈信息表示所述用户对所述当前服务的感受为负向感受的情况下,对所述应用程序向所述用户提供的服务进行动态调整;

其中,所述反馈信息包括:用户面部表情信息和/或声音语气信息。

一种信息处理装置,包括:

第一获取模块,用于获取用户使用应用程序时的面部特征信息;

第二获取模块,用于获取用户使用应用程序时的声音特征信息;

识别模块,用于根据获得的所述用户的面部特征信息和声音特征信息,识别所述用户所属的类别信息,和所述用户对所述应用程序的使用场景信息。

可选的,:

所述第一获取模块,具体用于:

利用图像采集装置至少实时采集用户使用所述应用程序时的面部图像;

从采集的面部图像中提取以下信息中的至少部分,作为所述用户的面部特征信息:用户双眼间距、双眼大小、鼻梁长度、嘴巴长度、嘴唇厚度、皮肤褶皱度;

所述第二获取模块,具体用于:

利用音频采集装置实时采集用户使用所述应用程序时的声音信息;

从采集的声音信息中提取以下信息中的至少部分,作为所述用户的声音特征信息:Mel频率倒谱系数MFCC、音色、频率、响度;

所述识别模块,具体用于:

将所述面部特征信息和所述声音特征信息,实时输入预先基于深度学习模型构建的分类模型;

所述分类模型根据输入的所述面部特征信息和所述声音特征信息,识别所述用户的性别和年龄段,和/或识别所述用户对所述应用程序的使用场景为单人使用场景还是多人使用场景。

可选的,上述装置,还包括:

服务确定与调整模块,用于根据实时识别出的用户所属的类别信息和/或用户对所述应用程序的使用场景信息,动态确定或动态调整所述应用程序向所述用户提供的服务。

反馈模块,用于获取所述用户对所述应用程序提供的当前服务的反馈信息;并在所述反馈信息表示所述用户对所述当前服务的感受为负向感受的情况下,触发所述服务确定与调整模块对所述应用程序向所述用户提供的服务进行动态调整。

从上述技术方案可以看出,本申请公开的信息处理方法、装置、电子设备和存储介质,通过获取用户使用应用程序时的面部特征信息和声音特征信息,来识别用户所属的类别信息,和/或用户对所述应用程序的使用场景信息。与传统的基于聚类的方式,或基于用户填写问卷的方式进行用户信息识别相比,由于本申请通过实时采集用户使用应用程序时的面部特征信息和声音特征信息,来进行用户相关信息识别、实现对使用app的用户的区分,从而,能更准确地识别当前使用app的用户的真实情况,提升了对不同app用户的信息识别精准度,能更好的为不同用户提供不同服务提供帮助。

附图说明

为了更清楚地说明本申请实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本申请的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

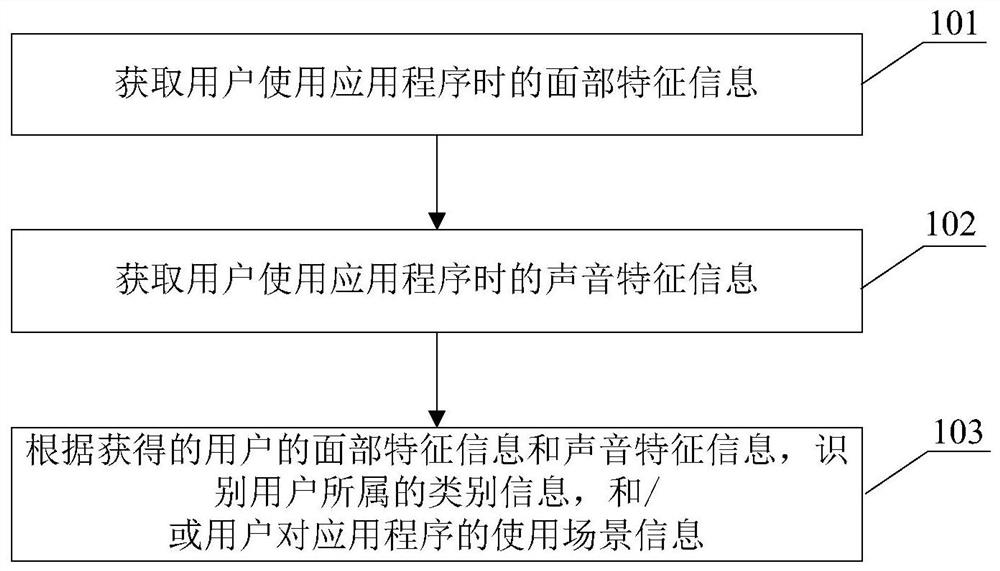

图1为本申请实施例公开的信息处理方法的一种流程示意图;

图2为本申请实施例公开的识别app用户的处理逻辑图;

图3为本申请实施例公开的信息处理方法的另一种流程示意图;

图4为本申请实施例公开的信息处理方法的又一种流程示意图;

图5为本申请实施例公开的信息处理方法的再一种流程示意图;

图6为本申请实施例公开的信息处理装置的一种结构示意图;

图7为本申请实施例公开的信息处理装置的另一种结构示意图;

图8为本申请实施例公开的信息处理装置的又一种结构示意图。

具体实施方式

下面将结合本申请实施例中的附图,对本申请实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本申请一部分实施例,而不是全部的实施例。基于本申请中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本申请保护的范围。

申请人经研究发现,传统基于用户行为进行用户聚类的用户信息识别方式,或基于用户填写信息的识别方式,至少存在以下缺陷中的相应缺陷:

1)在教育场景下,用户不是一成不变的,可能一开始用户是一年级,但是随着年龄的增长,需要对用户年龄做修正。上述两种方式不便于用户信息的实时识别与调整,进而导致用户信息的滞后性与服务推荐、提供的不匹配;另外在用户互相推荐的场景下,基于当前用户行为或者信息的分类结果对于其他用户是不适用的,会出现不精准的问题;

2)依赖用户反馈的方案,在交互上需要针对不同场景设计不同的问题,比较基础的问题对于用户分类所能获取到的特征不够准确,但是设计太多问题,用户填写问卷也会出现一定的烦躁情绪,或者出现不认真填写的问题,这类case对于系统来说都会产生额外的噪音;

3)教育场景下,会出现家长陪同小孩一起学习的场景,在这种情况下,家长对于小孩用户填写的信息,或者用户行为可能会有一定的影响,这部分影响会对导致用户分类不精准。

为解决上述问题,本申请公开一种信息处理方法、装置、电子设备和存储介质,以实时、准确的识别当前使用app用户的真实情况,更好的为不同用户提供不同服务提供帮助。

参见图1示出的信息处理方法的流程示意图,本申请公开的信息处理方法包括以下处理:

步骤101、获取用户使用应用程序时的面部特征信息。

其中,用户的面部特征信息,包括但不限于用户的以下特征信息中的至少部分信息:用户双眼间距、双眼大小、鼻梁长度、嘴巴长度、嘴唇厚度、皮肤褶皱度。

在用户使用app时,具体可利用图像采集装置至少实时采集用户使用应用程序时的面部图像,并从采集的面部图像中提取上述的至少一种面部特征作为用户的面部特征信息。

所采集并参与面部特征分析的用户面部图像可以是一幅或多幅。

上述的至少实时采集用户使用应用程序时的面部图像,可以是指:实时采集用户使用应用程序时的面部图像,或实时采集用户使用应用程序时的包括面部的全身或半身图像,对此不加限制。

实施中,可借助用户使用app时app所处设备上的图像采集装置,如所使用手机,平板,台式机的前置摄像头,来采集用户使用app时的面部图像。

步骤102、获取用户使用应用程序时的声音特征信息。

用户的声音特征信息,包括但不限于用户的以下特征信息中的至少部分信息:音频特征MFCC(Mel Frequency Cepstrum Coefficient,Mel频率倒谱系数)、音色、频率、响度。

在用户使用app时,具体可利用音频采集装置实时采集用户使用应用程序时的声音信息,并从采集的声音信息中提取上述的至少一种声音特征作为用户的声音特征信息。其中,用户使用应用程序时的声音信息,具体可以是指用户与app进行语音交互时的声音信息,和/或使用app的用户与其他用户之间进行语音交流时的声音信息。

实施中,可借助用户使用app时app所处设备上的声音采集装置,或外接的声音采集装置,如所使用手机,平板,台式机的录音话筒或外接mic等,来采集用户使用app时的声音信息。

需要说明是,步骤101、步骤102的先后执行顺序不限,可以是两个步骤并行、同时执行,或先执行任一步骤,后执行另一步骤。

步骤103、根据获得的用户的面部特征信息和声音特征信息,识别用户所属的类别信息,和/或用户对应用程序的使用场景信息。

本实施例中,用户所属的类别信息包括用户在性别方面的分类信息,以及在年龄段方面的分类信息。

其中,年龄段的类别可以有多种不同的划分方式,比如,采用具体的年龄数值区间划分与表征不同年龄段,或采用“幼龄”、“少年”、“青年”、“中年”、“老年”划分与表征的不同年龄段等。

用户对应用程序的使用场景信息,包括单人使用场景和多人使用场景。

本申请实施例中,多人使用场景是指多人同时使用同一设备上的同一app的场景,如,教育场景下,家长陪同小孩一起使用app学习的场景等。

在基于信息采集及分析处理,提取得到用户使用app时的面部特征信息和声音特征后,如图2所示,本实施例采用预先构建的分类模型对其进行处理,即,将用户的面部特征信息和声音特征输入分类模型,使分类模型根据输入的面部特征信息和声音特征信息,识别用户的性别和年龄段,和/或识别用户对应用程序的使用场景为单人使用场景还是多人使用场景,相应得到分类模型输出的用户的性别和年龄段,和/或用户对应用程序的单人使用场景还是多人使用场景的场景识别结果。

可选的,分类模型基于深度学习模型构建得到,所采用的深度学习模型可以是但不限于CNN(Convolutional Neural Networks,卷积神经网络)。

综上,本申请实施例公开的信息处理方法,通过获取用户使用应用程序时的面部特征信息和声音特征信息,来识别用户所属的类别信息,和/或用户对所述应用程序的使用场景信息。与传统的基于聚类的方式,或基于用户填写问卷的方式进行用户信息识别相比,由于本申请通过实时采集用户使用应用程序时的面部特征信息和声音特征信息,来进行用户相关信息识别、实现对使用app的用户的区分,从而,能更准确地识别当前使用app的用户的真实情况,提升了对不同app用户的信息识别精准度,能更好的为不同用户提供不同服务提供帮助。

可选的,在一实施方式中,参见图3提供的信息处理方法的流程示意图,本申请实施例公开的信息处理方法,在步骤101、步骤102之前,还可以包括:

步骤101’、对采集的图像信息和/或声音信息进行数据清洗。

由于摄像头获取到的图像数据通常会存在噪声图像和无关图像,为避免对用户信息识别产生干扰,可通过开源的人脸识别模型对采集的图像信息进行识别,并在此基础上根据识别结果对采集的图像信息进行清洗处理。

其中,对采集的图像信息进行的数据清洗包括以下处理中的至少一种:

剔除缺失值、特殊值、范围检查、演绎修正、插值、最小值调整。

同理,对采集的声音信息进行的数据清洗同样可包括以上各种清理处理中的至少一种。

通过对采集的图像信息和/或声音信息进行数据清洗,有助于快速、准确地提取用户真实的面部特征和/或声音特征,进而为用户信息的准确识别提供了进一步的帮助。

可选的,在一实施方式中,参见图4提供的信息处理方法的流程示意图,本申请实施例公开的信息处理方法,在步骤103之后,还可以包括:

步骤104、根据实时识别出的用户所属的类别信息和/或用户对应用程序的使用场景信息,动态确定或动态调整应用程序向用户提供的服务。

在实时识别出使用app的当前用户所属类别(如,用户所属年龄段、用户性别等),和/或用户使用app时的场景信息(如,单人使用或多人使用)的基础上,应用程序根据识别出的用户信息,为用户提供相匹配的服务。

例如,针对幼龄用户,可以将app内容动态调整为低龄内容,针对女性用户,可以将app风格调整为粉色少女风,针对幼龄用户的单人使用场景,在学习软件界面仅提供相对易懂/满足课程需求的基本难度的习题,或同时提供该类习题的解答信息,针对包括幼龄用户及非幼龄用户的多人使用场景(如,家长陪同小孩学习的场景),可适当增添一些难度稍高的拓展题型,或同时增添其解答信息等等。

通过根据识别出的用户信息(用户所属的类别信息和/或用户对应用程序的使用场景信息),有针对地确定或动态调整应用程序为用户提供的服务,能够更高程度地满足用户需求,并有助于转化率的明显提升。

可选的,在一实施方式中,参见图5提供的信息处理方法的流程示意图,本申请实施例公开的信息处理方法,在步骤104之后,还可以包括:

步骤105、获取用户对应用程序提供的当前服务的反馈信息。

步骤106、在反馈信息表示用户对当前服务的感受为负向感受的情况下,对应用程序向用户提供的服务进行动态调整。

在根据识别出的用户信息(如用户类别,使用场景),在软件程序有针对性地为用户提供相匹配的服务时,可以通过用户实时的面部表情、声音的语气等信息辅助判断当前提供服务的好坏及效果。由此,步骤105中获取的反馈信息可以包括但不限于用户的面部表情信息和/或声音语气信息。

实施中,同样可借助手机、平板等设备提供的或外接的相关采集装置,如设备的前置摄像头、录音话筒等来分别采集用户使用app所提供服务时的面部图像及声音信息,并分析用户面部图像中体现的用户面部表情,如,表情凝重、面露不悦,或面露微笑、面露喜悦、大笑等,以及分析声音信息所表现的用户语气,如和缓、急躁、愤怒的语气等。

其中,如果反馈信息表示用户对当前服务的感受为负向感受,如,用户表情凝重、面露不悦,或用户表现出急躁、愤怒的语气等,则可动态调整应用程序向用户提供的服务;反之,如果反馈信息表示用户对当前服务的感受为正向感受,如面露微笑、面露喜悦等,则不调整。

其中,针对用户的反馈信息,具体可基于预定策略进行应用程序所提供服务的动态调整。该预定策略可以是但不限于,按照预先制定的针对同一类别(性别、年龄段方面的类别)和/或同一使用场景的多个备选服务方案,按评分从高到低依次调整为对应的匹配于当前用户类别和/使用场景或某一备选服务方案,直至用户反馈信息表明用户感受变为正向为止。

本实施例通过根据用户反馈信息,动态调整应用程序为用户提供的服务,能进一步提升用户对应用程序提供的服务的满意度,相应可进一步提升转化率。

对应于上述的方法,本申请实施例还公开一种信息处理装置,如图6所示,该装置包括:

第一获取模块601,用于获取用户使用应用程序时的面部特征信息;

第二获取模块602,用于获取用户使用应用程序时的声音特征信息;

识别模块603,用于根据获得的所述用户的面部特征信息和声音特征信息,识别所述用户所属的类别信息,和所述用户对所述应用程序的使用场景信息。

在本申请实施例的一可选实施方式中,第一获取模块601,具体用于:

利用图像采集装置至少实时采集用户使用应用程序时的面部图像;

从采集的面部图像中提取以下信息中的至少部分,作为用户的面部特征信息:用户双眼间距、双眼大小、鼻梁长度、嘴巴长度、嘴唇厚度、皮肤褶皱度;

第二获取模块602,具体用于:

利用音频采集装置实时采集用户使用应用程序时的声音信息;

从采集的声音信息中提取以下信息中的至少部分,作为用户的声音特征信息:Mel频率倒谱系数MFCC、音色、频率、响度;

识别模块603,具体用于:

将上述面部特征信息和上述声音特征信息,实时输入预先基于深度学习模型构建的分类模型;

上述分类模型根据输入的面部特征信息和声音特征信息,识别用户的性别和年龄段,和/或识别用户对应用程序的使用场景为单人使用场景还是多人使用场景。

在本申请实施例的一可选实施方式中,参见图7,本申请公开的信息处理装置,还包括:

服务确定与调整模块604,用于根据实时识别出的用户所属的类别信息和/或用户对应用程序的使用场景信息,动态确定或动态调整应用程序向用户提供的服务。

反馈模块605,用于获取用户对应用程序提供的当前服务的反馈信息;并在反馈信息表示用户对当前服务的感受为负向感受的情况下,触发服务确定与调整模块604对应用程序向用户提供的服务进行动态调整。

在本申请实施例的一可选实施方式中,参见图8,本申请公开的信息处理装置,还包括:

数据清洗模块606,用于:对采集的图像信息和/或声音信息进行数据清洗;

其中,数据清洗模块606对采集的图像信息和/或声音信息进行的数据清洗包括以下处理中的至少一种:

剔除缺失值、特殊值、范围检查、演绎修正、插值、最小值调整。

对于本申请实施例公开的信息处理装置而言,由于其与上文方法实施例公开的信息处理方法相对应,所以描述的比较简单,相关相似之处请参见上文相应方法实施例的说明即可,此处不再详述。

综上所述,本申请公开的技术方案,相比于传统技术,至少具备以下技术优势:

1)通过摄像头,话筒等采集装置实时采集用户使用app时的信息,能更实时,准确的识别、区分用户;

2)相比于传统基于用户历史行为,或基于用户填写问卷的形式,本申请方案中,用户在使用上基本是无感知的,交互上更人性化,且可以通过用户面部表情,声音的语气辅助app智能判断当前提供服务的好坏及效果,并及时作出调整。

本说明书中各个实施例采用递进的方式描述,每个实施例重点说明的都是与其他实施例的不同之处,各个实施例之间相同相似部分互相参见即可。对于实施例公开的装置而言,由于其与实施例公开的方法相对应,所以描述的比较简单,相关之处参见方法部分说明即可。

专业人员还可以进一步意识到,结合本文中所公开的实施例描述的各示例的单元及算法步骤,能够以电子硬件、计算机软件或者二者的结合来实现,为了清楚地说明硬件和软件的可互换性,在上述说明中已经按照功能一般性地描述了各示例的组成及步骤。这些功能究竟以硬件还是软件方式来执行,取决于技术方案的特定应用和设计约束条件。专业技术人员可以对每个特定的应用来使用不同方法来实现所描述的功能,但是这种实现不应认为超出本申请的范围。

结合本文中所公开的实施例描述的方法或算法的步骤可以直接用硬件、处理器执行的软件模块,或者二者的结合来实施。软件模块可以置于随机存储器(RAM)、内存、只读存储器(ROM)、电可编程ROM、电可擦除可编程ROM、寄存器、硬盘、可移动磁盘、CD-ROM、或技术领域内所公知的任意其它形式的存储介质中。

对所公开的实施例的上述说明,使本领域专业技术人员能够实现或使用本申请。对这些实施例的多种修改对本领域的专业技术人员来说将是显而易见的,本文中所定义的一般原理可以在不脱离本申请的精神或范围的情况下,在其它实施例中实现。因此,本申请将不会被限制于本文所示的这些实施例,而是要符合与本文所公开的原理和新颖特点相一致的最宽的范围。

- 信息处理方法、信息处理装置、电子设备和存储介质

- 信息处理方法、信息处理装置、电子设备和可读存储介质