基于文本和图片的双模态胃部疾病分类方法及装置

文献发布时间:2023-06-19 10:57:17

【技术领域】

本申请涉及一种基于文本和图片的双模态胃部疾病分类方法及装置,属于医学文本和图像双模态智能处理技术领域。

【背景技术】

胃癌是一种起源于胃黏膜上皮的恶性肿瘤,在我国的各类恶性肿瘤中发病率处于首位。由于胃镜技术在胃癌诊断方面效果显著,已被推荐为胃癌的主要诊断方法。

具体来说胃镜检查,可以直接探及胃内的病变组织区域作出相应的诊断,在胃镜下可以做组织活检对早期的胃癌癌前疾病或者是癌前病变的诊断及鉴别良性恶性溃疡都有重要作用。

但是由于人为因素例如医生的经验水平不一致,或者疏忽等特殊特殊情况会直接影响最后的胃癌诊断情况,同时人眼观察胃镜图片也会耗费大量的时间。

【发明内容】

本申请提供了一种基于文本和图片的双模态胃部疾病分类方法及装置,可以解决人工诊断胃部疾病的效率较低的问题。本申请提供如下技术方案:

第一方面,提供一种基于文本和图片的双模态胃部疾病分类方法,所述方法包括:

将病历报告输入预先训练的文本提取网络,得到所述病历报告的文本特征向量;

将胃镜图片输入预先训练的图片提取网络,得到所述胃镜图片的图片特征向量,所述胃镜图片和所述病历报告对应同一对象;

将所述文本特征向量和所述图片特征向量进行特征融合,并将融合后的特征向量输入预先训练的分类器中,得到胃部疾病的分类结果。

可选地,所述将病历报告输入预先训练的文本提取网络,得到所述病历报告的文本特征向量,包括:

从所述病历报告中提取主诉文本;

将所述主诉文本经过BERT预训练模型进行编码,得到所述文本特征向量并存储。

可选地,所述方法还包括:

使用BERT预训练模型,将所述主诉文本输入transformer模型中进行编码,得到所述文本特征向量后,进行逻辑回归softmax分类,得到文本单模态的分类结果。

可选地,所述将胃镜图片输入预先训练的图片提取网络,得到所述胃镜图片的图片特征向量,包括:

将所述胃镜图片输入预训练模型VGG19中,经过所述VGG19的表示得到最后一层的输出特征向量,得到所述图片特征向量并存储。

可选地,所述方法还包括:

在得到所述图片特征向量后,再通过softmax进行分类,得到图片单模态的分类结果。

可选地,所述将所述文本特征向量和所述图片特征向量进行特征融合,包括:

将所述文本特征向量和所述图片特征向量进行拼接,得到融合后的特征向量。

可选地,所述将所述文本特征向量和所述图片特征向量进行特征融合,包括:

将所述文本特征向量和所述图片特征向量输入预先训练的张量融合网络TFN,得到融合后的特征向量。

可选地,所述分类器包括长短期记忆人工神经网络LSTM网络和softmax分类函数。

可选地,所述胃部疾病的分类结果包括每种分类的概率,对于概率大于预设阈值的分类为最终的胃部疾病的诊断结果。

第二方面,提供一种基于文本和图片的双模态胃部疾病分类装置,所述装置包括:

文本提取模块,用于将病历报告输入预先训练的文本提取网络,得到所述病历报告的文本特征向量;

图片提取模块,用于将胃镜图片输入预先训练的图片提取网络,得到所述胃镜图片的图片特征向量;

双模态分类模块,用于将所述文本特征向量和所述图片特征向量进行特征融合,并将融合后的特征向量输入预先训练的分类器中,得到胃部疾病的分类结果。

本申请的有益效果至少包括:通过将病历报告输入预先训练的文本提取网络,得到病历报告的文本特征向量;将胃镜图片输入预先训练的图片提取网络,得到胃镜图片的图片特征向量;将文本特征向量和图片特征向量进行特征融合,并将融合后的特征向量输入预先训练的分类器中,得到胃部疾病的分类结果;可以解决人工诊断胃部疾病的效率较低的问题;实现自动地对胃部疾病进行分类,提高胃部疾病诊断效果。另外,通过结合文本特征向量和图片特征向量进行胃部疾病分类,相较于单独使用文本或者图片来说,具有更高的分类准确性。

上述说明仅是本申请技术方案的概述,为了能够更清楚了解本申请的技术手段,并可依照说明书的内容予以实施,以下以本申请的较佳实施例并配合附图详细说明如后。

【附图说明】

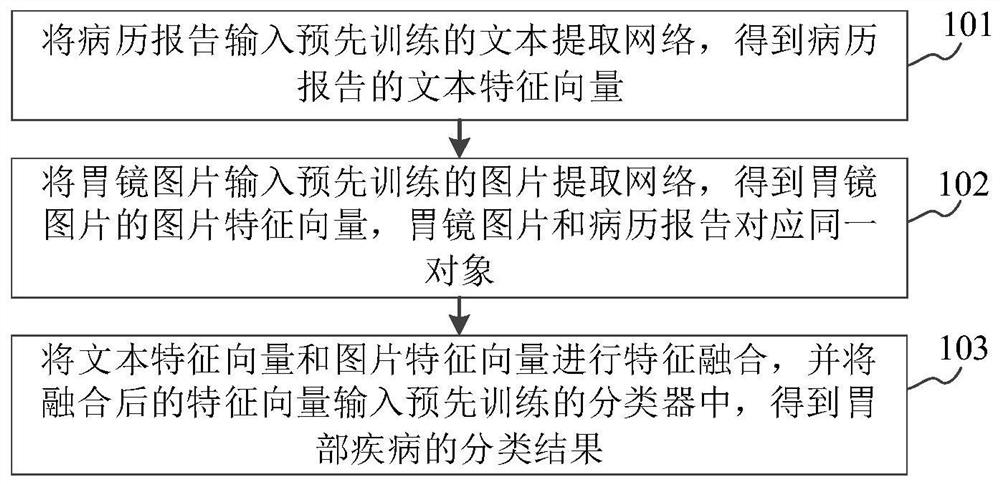

图1是本申请一个实施例提供的基于文本和图片的双模态胃部疾病分类方法的流程图;

图2是本申请一个实施例提供的BERT模型的结构示意图;

图3是本申请一个实施例提供的VGG19模型的结构示意图;

图4是本申请一个实施例提供的双模态胃部疾病分类过程的示意图;

图5是本申请一个实施例提供的基于文本和图片的双模态胃部疾病分类装置的框图。

【具体实施方式】

下面结合附图和实施例,对本申请的具体实施方式作进一步详细描述。以下实施例用于说明本申请,但不用来限制本申请的范围。

首先,对本申请涉及的若干名词进行介绍。

双向迁移的解码器(Bidirectional Encoder Representations fromTransformers,BERT):是一种大规模无监督预训练语言模型,作为Word2vec的替代者,它在自然语言处理(Natural Language Processing,NLP)领域刷新了精度,是近年来来自残差网络的最具突破性的一项技术。BERT的本质是通过海量的语料的基础上运行自监督学习方法为单词学习一个好的特征表示,他为其他任务提供了一个可供迁移的模型。其优点在于集成了生成式的预训练(Generative Pre-Training,GPT)的Transformer特征提取结构和从语言模型中获取词向量(embedding from language model,ELMo)双向结构,在生成深层的双向语言表征的同时实现了并行计算,最后该模型在预训练后,只需要添加一个额外的输出层进行微调,就可以应用于各种下游任务并且取得非常好的性能。

由于深度学习对数据集的大小有一定的要求,若原始的数据集比较小,机器无法学习到单词对应的好的特征表示。而BERT利用了大规模的语料,可以为任意字词训练出一个好的特征表示,具有很强的特征提取能力,能够一定程度上提升模型的性能。

BERT是一种多层Transformer结构,其最大的特点是抛弃了传统的循环神经网络(Recurrent Neural Network,RNN)和卷积神经网络(Convolutional Neural Networks,CNN),通过注意力(Attention)机制将任意位置的两个单词的距离转换成1,有效地解决了NLP中棘手的长期依赖问题。BERT是一个多任务模型,由两个自监督任务组成,分别是掩码语言模型(Masked Language Model,MLM)和下一句预测(Next Sentence Prediction,NSP)。在经过大量语料上预训练完BERT之后,便可以使用预训练好的模型应用到NLP的各个任务中了。

VGG19:是Visual Geometry Group团队提出的,主要工作是证明了增加网络的深度能够在一定程度上影响网络最终的性能。VGG有两种结构,分别是VGG 16和VGG 19,两者并没有本质上的区别,只是网络的深度不一样。在VGG中,使用了3个3*3卷积核来代替AlexNet中的7*7卷积核,使用了2个3*3卷积核来代替5*5卷积核,这样做的主要目的是在保证具有相同感受野的条件下,提升了网络的深度,在一定程度上能够提升神经网络的性能。VGG 19结构非常简洁,整个网络都使用了同样大小的卷积核尺寸(3*3)和最大池化尺寸(2*2)。几个小滤波器(3*3)卷积层的组合比一个大滤波器(5*5或7*7)卷积层好,验证了通过不断加深网络结构可以提升性能。

张量融合网络(Tensor Fusion Network,TFN):是用于多模态特征融合的模型,采用了端到端的学习方式。模型可以通过模态内部和模态间的两种方式解决多模态情感分析问题,有效地解决了视频中伴随手势和声音的不同而导致说出的话语不稳定的问题。

每一种信息的来源或者形式都可以称为一种模态,例如人的视觉、听觉和嗅觉;信息的媒介,有语音、视频、文字等。现实世界是由多个模态组成的,研究多模态是非常符合现实社会需求的。多模态的学习主要包含5个方面:多模态表示学习、模态转化、模态对齐、多模态融合以及协同学习。

本发明提供了一种基于文本和图片的双模态胃部疾病分类的方法,它能够融合文本和图片两种不同模态的数据用于帮助进行胃癌的诊断,医生往往在判断病人是否患有胃癌疾病时是通过胃镜检查的图片进行判断的,同时也可以结合上病人的病理报告辅助的进行判断。因此,本发明中融合两种模态进行胃癌疾病的诊断,融合了文本和图片的方法性能高于单独使用文本或者图片方法的性能。

可选地,本申请以各个实施例的执行主体为具有图像处理能力的电子设备为例进行说明,该电子设备可以为终端或服务器,该终端可以为计算机、笔记本电脑、平板电脑、医疗诊断设备等,本实施例不对终端的类型和电子设备的类型作限定。

图1是本申请一个实施例提供的基于文本和图片的双模态胃部疾病分类方法的流程图。该方法至少包括以下几个步骤:

步骤101,将病历报告输入预先训练的文本提取网络,得到病历报告的文本特征向量。

将病历报告输入预先训练的文本提取网络,得到病历报告的文本特征向量,包括:从病历报告中提取主诉文本;将主诉文本经过BERT预训练模型进行编码,得到文本特征向量并存储。

在一个示例中,通过使用BERT模型进行编码,主要是使用一个12层的Transformer,中间包含了多头注意力机制和Masked注意力机制等结构,得到一个768维的特征向量。同时,为了便于之后进行融合,还需要对文本进行重复操作,得到一个(50,768)的二维向量表示病人的文本特征向量。其中,BERT模型的模型结构参考图2所示。根据图2可知,BERT模型包括:文本输入层text inputs、与text inputs相连的嵌入层embeding、位置编码层positional encoding、与embeding和positional encoding相连的拼接层、与拼接层相连的多头注意力层multi-head attention和前馈神经网络feed forward。其中,多头注意力层包括注意力层和Add&Norm层,前馈神经网络可以分为Linear层和Add&Norm层。Add代表一个残差结构。Norm代表的是归一化层。

可选地,使用BERT预训练模型,将主诉文本输入transformer模型中进行编码,得到文本特征向量后,进行逻辑回归softmax分类,得到文本单模态的分类结果。文本BERT模型分类即是使用BERT来对病人的主诉文本进行分类,分类方法与使用BERT抽取文本特征类似,唯一不同的就是进行微调,做分类任务。得到预训练模型特征之后,利用softmax分类器进行二分类,得到在文本单模态情况下胃癌和胃溃疡二类分类的结果。

步骤102,将胃镜图片输入预先训练的图片提取网络,得到胃镜图片的图片特征向量,胃镜图片和病历报告对应同一对象。

其中,对象为人,比如:待进行胃部诊断的病人。

将胃镜图片输入预先训练的图片提取网络,得到胃镜图片的图片特征向量,包括:将胃镜图片输入预训练模型VGG19中,经过VGG19的表示得到最后一层的输出特征向量,得到图片特征向量并存储。

在一个示例中,胃镜图片的数量为多张,对每张胃镜图片使用VGG19的ImageNet预训练模型进行编码表示特征,每张图片经过VGG19提取特征后保存最后一层的1000维特征向量。在输入模型钱对多张胃镜图片进行筛选,在筛选图片时,超过50张图片的病人直接截取前50张图片的特征,不足50张图片的重复前面的向量,构成(50,1000)的二维向量表示该病人的图片特征。VGG19的模型结构参考图3所示。VGG19包括:图片输入层image inputs、位于image inputs之后的卷积层conv3-64、最大池化层maxpool、卷积层conv3-128、最大池化层maxpool、卷积层conv3-256、最大池化层maxpool、2个堆叠的卷积层conv3-512和最大池化层maxpool的组合、以及位于最后的全连接层fully connect。

可选地,在得到图片特征向量后,再通过softmax进行分类,得到图片单模态的分类结果。

图片VGG19模型分类即是使用VGG19来对病人的胃镜图片进行分类,方法与使用VGG19抽取图片特征相似,唯一不同的就是在得到图片特征向量之后不保存,直接加一层softmax分类层进行胃癌和胃溃疡二类疾病的分类,得到实验的结果。

步骤103,将文本特征向量和图片特征向量进行特征融合,并将融合后的特征向量输入预先训练的分类器中,得到胃部疾病的分类结果。

将文本特征向量和图片特征向量进行特征融合,包括:将文本特征向量和图片特征向量进行拼接,得到融合后的特征向量。或者,将文本特征向量和图片特征向量输入预先训练的TFN,得到融合后的特征向量。

分类器包括长短期记忆人工神经网络LSTM网络和softmax分类函数。

参考图4所示的训练过程。分类器的训练过程包括:输入文本text inputs经过BERT预训练模型得到文本特征向量V

胃部疾病的分类结果包括每种分类的概率,对于概率大于预设阈值的分类为最终的胃部疾病的诊断结果。

在标签级的损失函数计算前,对于每一个病人将输出概率分布P转换成概率标量p用来表示是否是胃癌的概率,若P中的p

其中CE是Cross Entropy损失函数,y

本实施例中,训练前,分别使用BERT和VGG19提取文本和图片特征;训练时,使用TFN张量融合方法融合文本和图片特征,最为模型的输入特征。设初始的学习率为0.001。使用自适应矩估计(Adaptive Moment Estimation,Adam)优化器来优化网络的参数,使用标签级损失函数作为模型的损失函数,其中标签级损失函数使用交叉熵损失函数(CrossEntropy Loss)。批的大小设为32。为了防止过拟合,使用Dropout随机忽略全连接层的部分神经元。训练的时候将LSTM网络基于训练样本进行训练,让网络学习分类任务,使用优化器最小化分类的标签级的损失函数,让网络最终收敛。

在训练得到分类器后,还可以对训练后的分类器进行测试。测试过程如下:输入待分类病人的文本和图片特征V

参考表1和表2,表1为使用文本分类、图片分类、文本和图片拼接分类,文本和图片张量融合分类四种方法之间的准确率比较;表2是使用Resnet对病人的胃镜图片进行分类后,再进行特征提取等工作后四种方法之间的准确率比较。由于在观察图片的时候,发现每位病人的胃镜图片中还有部分是不属于胃部的,这对于网络判断胃部疾病(胃癌或胃溃疡)是噪声干扰,而经过Resnet胃部分类初步筛选后,得到的大部分都是病人胃部的图片了,特征更加明显,从而我们方法的性能也会随之而提高,因此,可以得到表2所示的数据。对比表1和表2可知,融合了文本和图片特征的方法能够有效地提升准确率,证实了使用基于文本和图片的双模态特征融合的方法能够帮助提升分类性能,进一步帮助进行胃部疾病的分析。

表1:

表2:

综上所述,本实施例提供的基于文本和图片的双模态胃部疾病分类方法,通过将病历报告输入预先训练的文本提取网络,得到病历报告的文本特征向量;将胃镜图片输入预先训练的图片提取网络,得到胃镜图片的图片特征向量;将文本特征向量和图片特征向量进行特征融合,并将融合后的特征向量输入预先训练的分类器中,得到胃部疾病的分类结果;可以解决人工诊断胃部疾病的效率较低的问题;实现自动地对胃部疾病进行分类,提高胃部疾病诊断效果。另外,通过结合文本特征向量和图片特征向量进行胃部疾病分类,相较于单独使用文本或者图片来说,具有更高的分类准确性。

图5是本申请一个实施例提供的基于文本和图片的双模态胃部疾病分类装置的框图。该装置至少包括以下几个模块:文本提取模块510、图片提取模块520和双模态分类模块530。

文本提取模块510,用于将病历报告输入预先训练的文本提取网络,得到所述病历报告的文本特征向量;

图片提取模块520,用于将胃镜图片输入预先训练的图片提取网络,得到所述胃镜图片的图片特征向量;

双模态分类模块530,用于将所述文本特征向量和所述图片特征向量进行特征融合,并将融合后的特征向量输入预先训练的分类器中,得到胃部疾病的分类结果。

相关细节参考上述方法实施例。

需要说明的是:上述实施例中提供的基于文本和图片的双模态胃部疾病分类装置在进行基于文本和图片的双模态胃部疾病分类时,仅以上述各功能模块的划分进行举例说明,实际应用中,可以根据需要而将上述功能分配由不同的功能模块完成,即将基于文本和图片的双模态胃部疾病分类装置的内部结构划分成不同的功能模块,以完成以上描述的全部或者部分功能。另外,上述实施例提供的基于文本和图片的双模态胃部疾病分类装置与基于文本和图片的双模态胃部疾病分类方法实施例属于同一构思,其具体实现过程详见方法实施例,这里不再赘述。

可选地,本申请还提供有一种计算机可读存储介质,所述计算机可读存储介质中存储有程序,所述程序由处理器加载并执行以实现上述方法实施例的基于文本和图片的双模态胃部疾病分类方法。

可选地,本申请还提供有一种计算机产品,该计算机产品包括计算机可读存储介质,所述计算机可读存储介质中存储有程序,所述程序由处理器加载并执行以实现上述方法实施例的基于文本和图片的双模态胃部疾病分类方法。

以上所述实施例的各技术特征可以进行任意的组合,为使描述简洁,未对上述实施例中的各个技术特征所有可能的组合都进行描述,然而,只要这些技术特征的组合不存在矛盾,都应当认为是本说明书记载的范围。

以上所述实施例仅表达了本申请的几种实施方式,其描述较为具体和详细,但并不能因此而理解为对发明专利范围的限制。应当指出的是,对于本领域的普通技术人员来说,在不脱离本申请构思的前提下,还可以做出若干变形和改进,这些都属于本申请的保护范围。因此,本申请专利的保护范围应以所附权利要求为准。

- 基于文本和图片的双模态胃部疾病分类方法及装置

- 基于元自步学习的视频/图片-文本跨模态匹配训练方法