显示控制方法、装置、电子设备及介质

文献发布时间:2023-06-19 11:22:42

技术领域

本申请属于显示技术领域,具体涉及一种显示控制方法、装置、电子设备及介质。

背景技术

随着通信技术的发展,穿戴式设备也应运而生。其中,增强现实(AugmentedReality,AR)眼镜也是一种穿戴式设备。通常,在用户佩戴AR眼镜之后,用户通过AR眼镜,可以看到AR眼镜中的虚拟对象(例如,文字信息或图像信息)与现实环境叠加后形成的界面。如果用户对看到的界面不满意,那么用户可以通过对AR眼镜上的功能按钮的输入,触发AR眼镜对该界面中的虚拟对象进行操作,以得到新的界面。

然而,在实际使用AR眼镜的过程中,当用户对AR眼镜显示的界面有其它操作需求时,由于AR眼镜操作功能比较单一而不能满足用户需求,因此用户可能需要通过其它的设备(例如遥控器)控制AR眼镜,以实现对AR眼镜显示的界面的操作,从而使得对AR眼镜显示的界面的操作非常不方便。

发明内容

本申请实施例的目的是提供一种显示控制方法、装置、电子设备及介质,能够解决对AR眼镜显示的界面的操作非常不方便的问题。

为了解决上述技术问题,本申请是这样实现的:

第一方面,本申请实施例提供了一种显示控制方法,该方法包括:在穿戴式设备的虚拟屏幕中显示M个界面,该M个界面为T个目标设备向穿戴式设备发送的界面;接收用户的第一输入,该第一输入为第一悬浮手势的输入;在该第一悬浮手势与第一预设手势匹配的情况下,响应于该第一输入,对该M个界面中的第一界面执行目标处理,该目标处理用于调整该第一界面在虚拟屏幕中的显示参数。其中,M、T均为正整数。

第二方面,本申请实施例提供了一种显示控制装置,该显示控制装置包括:显示模块、接收模块和处理模块。显示模块,用于在穿戴式设备的虚拟屏幕中显示M个界面,该M个界面为T个目标设备向穿戴式设备发送的界面。接收模块,用于接收用户的第一输入,该第一输入为第一悬浮手势的输入。处理模块,用于在该第一悬浮手势与第一预设手势匹配的情况下,响应于该第一输入,对该M个界面中的第一界面执行目标处理,该目标处理用于调整该第一界面在虚拟屏幕中的显示参数。其中,M、T均为正整数。

第三方面,本申请实施例提供了一种电子设备,该电子设备包括处理器、存储器及存储在存储器上并可在处理器上运行的程序或指令,程序或指令被处理器执行时实现如上述第一方面中的方法的步骤。

第四方面,本申请实施例提供了一种可读存储介质,该可读存储介质上存储程序或指令,程序或指令被处理器执行时实现如上述第一方面中的方法的步骤。

第五方面,本申请实施例提供了一种芯片,该芯片包括处理器和通信接口,通信接口和处理器耦合,处理器用于运行程序或指令,实现如上述第一方面中的方法。

在本申请实施例中,可以在穿戴式设备的虚拟屏幕中显示M个界面,该M个界面为T个目标设备向穿戴式设备发送的界面;接收用户的第一输入,该第一输入为第一悬浮手势的输入;在该第一悬浮手势与第一预设手势匹配的情况下,响应于该第一输入,对该M个界面中的第一界面执行目标处理,该目标处理用于调整该第一界面在虚拟屏幕中的显示参数。其中,M、T均为正整数。通过该方案,在用户佩戴穿戴式设备的情况下,由于在穿戴式设备的虚拟屏幕中可以显示T个目标设备向穿戴式设备发送的M个界面,因此当用户对AR眼镜显示的界面有操作需求时,用户可以直接使用与第一预设手势匹配的手势输入,触发对该M个界面的第一界面执行目标处理,从而用户无需通过遥控器或其它设备控制AR眼镜,以实现对AR眼镜显示的界面的操作。如此,使得对AR眼镜显示的界面的操作更为便捷。

附图说明

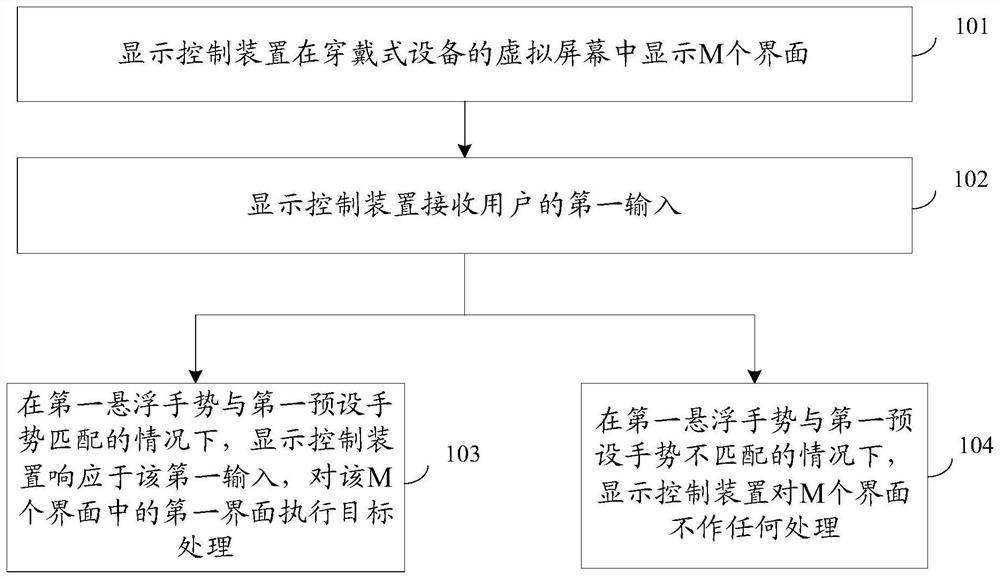

图1为本申请实施例提供的一种显示控制方法的示意图;

图2为本申请实施例提供的一种手势输入的界面示意图之一;

图3为本申请实施例提供的一种界面显示控制的界面示意图之一;

图4为本申请实施例提供的一种手势输入的界面示意图之二;

图5为本申请实施例提供的一种手势输入的界面示意图之三;

图6为本申请实施例提供的一种界面显示控制的界面示意图之二;

图7为本申请实施例提供的一种界面显示控制的界面示意图之三;

图8为本申请实施例提供的一种手势输入的界面示意图之四;

图9为本申请实施例提供的一种界面显示控制的界面示意图之四;

图10为本申请实施例提供的显示控制装置的结构示意图;

图11为本申请实施例提供的电子设备的结构示意图;

图12为本申请实施例提供的电子设备的硬件示意图。

具体实施方式

下面将结合本申请实施例中的附图,对本申请实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例是本申请一部分实施例,而不是全部的实施例。基于本申请中的实施例,本领域普通技术人员在没有作出创造性劳动前提下所获得的所有其他实施例,都属于本申请保护的范围。

本申请的说明书和权利要求书中的术语“第一”、“第二”等是用于区别类似的对象,而不用于描述特定的顺序或先后次序。应该理解这样使用的数据在适当情况下可以互换,以便本申请的实施例能够以除了在这里图示或描述的那些以外的顺序实施。此外,说明书以及权利要求中“和/或”表示所连接对象的至少其中之一,字符“/”,一般表示前后关联对象是一种“或”的关系。

在本申请实施例中,“示例性地”或者“例如”等词用于表示作例子、例证或说明。本申请实施例中被描述为“示例性地”或者“例如”的任何实施例或设计方案不应被解释为比其它实施例或设计方案更具优势。确切而言,使用“示例性地”或者“例如”等词旨在以具体方式呈现相关概念。

在本申请实施例的描述中,除非另有说明,“多个”的含义是指两个或者两个以上,例如,多个设备是指两个或者两个以上的设备等。

本申请实施例提供一种显示控制方法、装置、电子设备及介质,可以在穿戴式设备的虚拟屏幕中显示M个界面,该M个界面为目标设备向穿戴式设备发送的界面,M为正整数;并在检测到用户的手势与第一预设手势匹配的情况下,对该M个界面中的第一界面执行目标操作。其中,该目标操作包括以下至少一项:抓取、放大、缩小、移动、排版。通过该方案,在用户佩戴穿戴式设备的情况下,由于在穿戴式设备的虚拟屏幕中可以显示目标设备向穿戴式设备发送的M个界面,因此当用户对AR眼镜显示的界面有操作需求时,用户可以直接使用与第一预设手势匹配的手势,触发对该M个界面的第一界面执行目标操作,从而用户无需通过其它的设备控制AR眼镜,以实现对AR眼镜显示的界面的操作。即使得对AR眼镜显示的界面的操作更为便捷。

下面结合附图,通过具体的实施例及其应用场景对本申请实施例提供的显示控制方法、装置、电子设备及介质进行详细地说明。

如图1所示,本申请实施例提供一种显示控制方法,该方法包括下述步骤101至步骤104。

步骤101、显示控制装置在穿戴式设备的虚拟屏幕中显示M个界面。

其中,上述M个界面为T个目标设备向穿戴式设备发送的界面,M、T均为正整数。

可选地,本申请实施例中,穿戴式设备可以为采用AR技术的设备,或为采用其他可能的智能技术的设备。例如,穿戴式设备为AR眼镜或AR头盔。

可选地,上述M个界面可以包括以下至少一项:图片、网页、应用程序的界面。当然,M个界面还可以为其他可能类型的界面。具体可以根据实际情况确定,本申请实施例对此不作限定。

可选地,上述M个界面中各个界面的界面内容可以相同或不同。当然,最优选的方式为,M个界面中各个界面的界面内容各不相同。另外,M个界面中各个界面的显示形式可以相同或不同。具体可以根据实际情况确定,本申请实施例对此不作限定。

可选地,根据T取值的不同,决定了T个目标设备的数量也相应不同。具体地,当M大于1时,可以包括如下两种可能的情况:

(1)在T=1的情况下,M个界面可以为一个目标设备发送的不同界面。

进一步地,M个界面可以为一个目标设备同时发送的不同界面;或为一个目标设备不同时刻发送的不同界面。

(2)在T>1的情况下,M个界面可以为T个目标设备分别发送的界面。

可以理解的是,根据上述实施例,可以实现将一个目标设备的不同界面投射在穿戴式设备的虚拟屏幕上同时显示,或将多个设备的多个界面投射在穿戴式设备的虚拟屏幕上同时显示。如此,为穿戴式设备的虚拟屏幕上显示的界面提供不同的来源方式。

需要说明的是,由于M个界面为显示在穿戴式设备的虚拟屏幕上的界面,因此该M个界面为虚拟界面。另外,M个界面中各个界面之间可以相互独立存在,不会互相排斥和相互影响。

步骤102、显示控制装置接收用户的第一输入。

其中,上述第一输入为第一悬浮手势的输入。

可选的,由于第一输入为第一悬浮手势的输入,因此用户可以对虚拟屏幕中显示的界面进行隔空手势操作。例如,第一输入为缩放手势的输入、滑动手势的输入、拖拽手势的输入、抓握手势的输入或其他手势的输入。

示例性地,以第一输入为缩放手势的输入的为例。如图2中的(a)所示,用户可以通过双手拖拽手势,拖拽虚拟屏幕上的一个界面的边框,进行横纵向的放大或缩小。

示例性地,以第一输入为抓取手势的输入的为例。如图2中的(b)所示,用户可以通过抓握手势,移动虚拟屏幕上的一个界面的边框。

可选地,在上述步骤102之后,本申请实施例提供的显示控制方法还可以包括:检测第一悬浮手势与第一预设手势是否匹配。之后,若是,则执行下述步骤103;若否,则执行下述步骤104。

步骤103、在第一悬浮手势与第一预设手势匹配的情况下,显示控制装置响应于该第一输入,对该M个界面中的第一界面执行目标处理。

其中,上述目标处理用于调整第一界面在虚拟屏幕中的显示参数。

可选地,上述目标处理可以包括以下至少一项:放大、缩小、移动、排版。相应地,显示参数可以包括显示尺寸、显示位置或排版格式等。

示例性地,当目标处理为放大时,可以放大第一界面在虚拟屏幕中的显示尺寸;当目标处理为缩小时,可以缩小第一界面在虚拟屏幕中的显示尺寸;当目标处理为移动时,可以移动第一界面在虚拟屏幕中的显示位置;当目标处理为排版时,可以调整第一界面在虚拟屏幕中的排版格式。

可选地,上述第一预设手势可以为穿戴式设备出厂设置,或为用户预先自定义设置。具体可以根据实际情况确定,本申请实施例对此不作限定。例如,第一预设手势为单手拖拽手势,或为双手拖拽手势。

例如,用户可以通过双手拖拽手势拖拽界面的边框,触发横向的放大虚拟屏幕上显示的界面,或纵向缩小虚拟屏幕上显示的界面。再例如,用户可以通过抓握和移动手势,触发对一个界面进行移动。

进一步地,穿戴式设备可以预先设置有多个手势,该多个手势包括第一预设手势,一种手势对应一种处理方式。如此,可以通过用户的不同手势,触发穿戴式设备对虚拟界面执行不同的处理。

步骤104、在第一悬浮手势与第一预设手势不匹配的情况下,显示控制装置对M个界面不作任何处理。

需要说明的是,上述实施例中对于目标处理的描述仅为本申请实施例提供的几种示例性说明。当然,目标处理也可以包括其他类型的处理。具体可以根据实际情况确定,本申请实施例对此不作限定。

示例性地,以显示控制装置为AR眼镜、第一预设手势为缩放手势为例。用户佩戴AR眼镜,如图3中的(a)所示,用户可以通过该AR眼镜看到虚拟屏幕01显示的3张界面。如果用户想要将这3张界面中的界面02放大,那么如图3中的(a)所示,用户可以沿箭头指向对着该界面02做隔空缩放手势(即第一输入)。在AR眼镜的摄像头检测到该缩放手势与第一预设手势匹配的情况下,对该界面02放大,从而如图3中的(b)所示,AR眼镜在虚拟屏幕上显示由该界面02放大后的界面03。

需要说明的是,由于虚拟屏幕上显示多个界面,因此户可以分别单独操作每个界面。进一步地,在用户操作该多个界面中任意一个界面的过程中,其他的界面不会受到影响。

示例性地,以第一预设手势为手指拖拽手势为例。如图4所示,假设虚拟屏幕中显示A界面和B界面。当用户通过与第一预设手势匹配的拖拽手势,触发放大A界面时,如果该A界面的尺寸较大,且可能接触到B界面,那么可以将该B界面向右侧移动,从而可以防止被放大后的A界面受到影响。

本申请实施例提供一种显示控制方法,在用户佩戴穿戴式设备的情况下,由于在穿戴式设备的虚拟屏幕中可以显示T个目标设备向穿戴式设备发送的M个界面,因此当用户对AR眼镜显示的界面有操作需求时,用户可以直接使用与第一预设手势匹配的手势输入,触发对该M个界面的第一界面执行目标处理,从而用户无需通过遥控器或其它设备控制AR眼镜,以实现对AR眼镜显示的界面的操作。如此,使得对AR眼镜显示的界面的操作更为便捷。

可选地,T个目标设备与穿戴式设备已建立连接。在上述步骤101之前,本申请实施例提供的显示控制方法还可以包括步骤105至步骤107。

步骤105、接收用户的第二输入。

其中,上述第二输入为第二悬浮手势的输入。

可选的,第二输入为与第一输入的悬浮手势不同的输入。例如,第二输入可以为缩放手势输入、滑动手势输入或拖拽手势输入等。

示例性地,用户可以对穿戴式设备做双指滑动手势的输入。

可选地,在上述步骤105之后,本申请实施例提供的显示控制方法还可以包括:检测第二悬浮手势与第二预设手势是否匹配。之后,若是,则执行下述步骤106;若否,则不作任何处理。

具体地,在T个目标设备处于穿戴式设备的摄像头的视场范围内的情况下,显示控制装置检测第二悬浮手势与第二预设手势是否匹配。

可选地,上述实施例中“T个目标设备处于穿戴式设备的摄像头的视场范围内”是指:在用户佩戴穿戴式设备的情况下,用户可以转动头部,以带动穿戴式设备的摄像头进行检测。当穿戴式设备的摄像头采集到T个目标设备的图像时,可以确定T个目标设备处于穿戴式设备的摄像头的视场范围内。

步骤106、在第二悬浮手势与第二预设手势匹配的情况下,显示控制装置响应于该第二输入,向T个目标设备中每个目标设备发送请求消息。

其中,上述请求消息用于请求获取每个目标设备当前显示的第二界面。

可选地,上述第二预设手势可以为穿戴式设备出厂设置,或为用户预先自定义设置。当然,该第二预设手势为穿戴式设备预先设置的多个手势中的手势。具体可以根据实际情况确定,本申请实施例对此不作限定。例如,第二预设手势为滑动手势。

可选地,上述步骤106之后,步骤107之前,本申请实施例提供的显示控制方法还可以包括:每个目标设备接收请求消息,并向穿戴式设备发送第二界面。其中,该请求消息用于请求获取每个目标设备当前显示的第二界面。

步骤107、显示控制装置接收每个目标设备发送的第二界面。具体可以根据实际情况确定,本申请实施例对此不作限定。

可选地,每个目标设备发送的第二界面可以相同或不同。

可选地,上述步骤107之后,本申请实施例提供的显示控制方法还可以包括:显示控制装置在虚拟屏幕上显示至少一个目标界面。

需要说明的是,上述每个目标界面的内容与第二界面的内容相同,即一个目标界面为M个界面中的界面。可以理解的是,虚拟屏幕上显示的一个目标界面可以与目标设备显示的第二界面相同或不同。具体可以根据实际情况确定,本申请实施例对此不作限定。

可选地,通常情况下,由于目标设备全屏显示界面,因此如图5中的(a)所示,用户可以先通过双指在目标设备的屏幕上做缩放操作,触发目标设备将该界面缩放,如图5中的(b)所示,手机显示缩放后的界面;然后,如图5中的(c)所示,用户可以通过对穿戴设备的虚拟屏幕隔空做双指向四周滑动的手势,触发向目标设备发送请求获取目标设备当前显示的界面的请求消息;之后,目标设备可以向穿戴式设备发送当前显示的一个界面,从而穿戴式设备可以获取该一个界面,进而穿戴式设备可以显示该一个界面,即目标设备当前显示的一个界面可以直接映射到穿戴式设备的虚拟屏幕上。

需要说明的是,在通过用户的手势,触发将每个目标设备当前显示的界面,映射在穿戴式设备上之后,由于穿戴式设备可以保存该界面,因此即便用户将某个目标设备移出穿戴式设备的摄像头的视场范围内,也不会对穿戴式设备的虚拟屏幕上显示的界面产生影响。

可以理解的是,在执行步骤105至步骤107上后,由于穿戴式设备在虚拟屏幕上显示至少一个目标界面,因此当用户佩戴穿戴式设备转动头部时,该至少一个目标界面可以随着用户视角移动,但穿戴式设备相对虚拟屏幕(或至少一个目标界面)的位置保持不变。

示例性地,以显示控制装置为AR眼镜、目标设备为手机、第二预设手势为双指滑动手势为例。如图6中的(a)所示,手机04(即目标设备)的屏幕上显示界面05。在手机和AR眼镜已建立连接的情况下,如果用户想要通过AR眼镜查看该界面05,那么如图6中的(b)所示,用户可以对AR眼镜做隔空双指滑动手势(即第二输入)。在AR眼镜的摄像头检测到该双指滑动手势与第二预设手势匹配的情况下,AR眼镜可以向手机04发送用于请求获取手机04当前显示的界面05(即第二界面)的请求消息。之后,手机04可以接收该请求消息,并向AR眼镜发送该界面05。如此,AR眼镜可以接收该界面05,并如图6中的(c)所示,AR眼镜在虚拟屏幕01上显示与该界面05的内容相同的界面06。

本申请实施例提供的显示控制方法,在目标设备与穿戴式设备已连接的情况下,用户可以通过与第二预设手势匹配的悬浮手势输入,可以向目标设备发送用于请求获取目标设备当前显示的第二界面的请求消息,因此穿戴式设备可以接收目标设备发送的该第二界面。即提供了一种目标设备与穿戴式设备之间的交互方式,以将目标设备的界面映射到穿戴式设备上显示。

可选地,上述步骤101之后,本申请实施例提供的显示控制方法还可以包括步骤108和步骤109。

步骤108、显示控制装置接收用户对第一对象和M个界面中的第三界面的第三输入。

其中,上述第一对象为M个界面中第三界面中的对象,或为穿戴式设备的粘贴板中的对象。第三输入为第三悬浮触控输入。

可选地,本申请实施例中,上述第一对象可以包括以下至少一项:图标、文本、图片、链接、表格等或其他可能的对象。

可选地,上述第三输入可以为用户对第一对象和第三界面的悬浮手势输入、隔空触控输入或其他可能的输入。具体可以根据实际情况确定,本申请实施例对此不作限定。

示例性地,在第一对象为M个界面中第三界面中的对象的情况下,第三输入可以为包括对虚拟屏幕中的一个界面中的第一对象隔空选择输入、且隔空移动该第一对象至第三界面的输入。

示例性地,在第一对象为穿戴式设备的粘贴板中的对象的情况下,第三输入可以为隔空将粘贴板图标滑动至第三界面的输入。

步骤109、显示控制装置响应于该第三输入,将该第一对象添加至该第三界面。

一种可能的实现方式:

可选地,第一对象为M个界面中第五界面中的对象。第一输入包括第一子输入和第二子输入。即第一子输入为用户将第四界面中的第一对象移动至穿戴式设备的粘贴板中的输入;第二子输入为将粘贴板图标移动至第三界面的输入。相应地,上述步骤109可以通过下述步骤109A和步骤109B实现。

步骤109A、显示控制装置响应于第一子输入,将第一对象保存至穿戴式设备的粘贴板中。

步骤109B、显示控制装置响应于第二子输入,将该粘贴板中的该第一对象添加至第三界面。

示例性地,以显示控制装置为AR眼镜为例。用户佩戴AR眼镜,如图7中的(a)所示,用户可以通过该AR眼镜看到虚拟屏幕01显示的3张界面。如果用户想要将这3张界面中的界面07的对象08粘贴到其他界面,那么用户的手指可以对着该界面07中的该对象08做隔空画圈手势,并隔空滑动该对象08至粘贴图标09(即第一子输入)。在接收该第一子输入之后,响应于该第一子输入,AR眼镜选中该对象08,将该对象08保存在该粘贴图标09指示的穿戴式设备的粘贴板中。接着,用户可以隔空将该粘贴图标09拖动至界面10中(即第二子输入)。在穿戴式设备接收到该第二子输入之后,响应于该第二子输入,如图7中的(b)所示,AR眼镜在虚拟屏幕上显示添加对象08之后的界面10。

可以理解的是,在第一输入包括第一子输入和第二子输入的情况下,对于M个界面,用户可以先根据实际需要,触发复制该M个界面的一个界面中的部分对象至穿戴式设备的粘贴板中,然后再触发将该部分对象添加至该M个界面的另一个界面中。即提供了一种拷贝一个界面中的部分对象到另一个界面中的实现方式。

另一种可能的实现方式:

可选地,第二对象为M个界面的一个界面中的部分对象;第一输入包括第三子输入和第四子输入。在无法识别该第二对象的情况下,用户可以先通过第三子输入,触发对该第二对象进行截图;然后,用户可以再通过第四子输入,触发将该第二对象粘贴至该M个界面的另一个界面中。具体地,上述步骤109可以通过下述步骤109C和步骤109D实现。

步骤109C、显示控制装置响应于第三子输入,对M个界面的一个界面中的第二对象截图,并保存该第二对象至穿戴式设备的粘贴板中。

步骤109D、显示控制装置响应于第四子输入,将该粘贴板中的该第二对象添加至该M个界面的另一个界面中。

可以理解的是,对于M个界面的一个界面中无法识别的对象,可以通过对该对象截图的方式,并触发将截图后得到的对象添加至该M个界面的另一个界面中,从而避免出现无法直接复制界面中某个对象的问题。即提供了另一种拷贝一个界面中的部分对象到另一个界面中的实现方式。

本申请实施例提供的显示控制方法,在穿戴式设备的虚拟屏幕中显示M个界面之后,用户可以通过输入(例如悬浮手势输入),触发将该M个界面中的一个界面的部分对象或将穿戴式设备的粘贴板中的对象,添加至该M个界面的另一个界面中。如此,用户可以通过在多个界面之间的操作,以实现多个界面之间的相互通信。

可选地,如果用户想要在其他设备查看穿戴式设备的虚拟屏幕上显示的一个界面上,那么用户可以通过输入,触发将该一个界面投射到其他设备。示例性地,上述步骤101之后,本申请实施例提供的显示控制方法还可以包括步骤110至步骤112。

步骤110、显示控制装置在虚拟屏幕中,显示至少一个设备标识。

其中,上述至少一个设备标识中每个设备标识指示一个设备,该一个设备为处于穿戴式设备的摄像头的视场范围内、且与穿戴式设备已建立连接的设备。本申请中的标识用于指示信息的文字、符号、图像等,可以以控件或者其他容器作为显示信息的载体,包括但不限于文字标识、符号标识、图像标识。

可选地,上述至少一个设备标识对应至少一个设备,该至少一个设备可以包括T个目标设备中的设备。

步骤111、显示控制装置接收用户的第四输入。

其中,上述第四输入为对M个界面中的第五界面和至少一个设备标识中的第一设备标识的悬浮触控输入。

可选地,上述第四输入可以为用户对第五界面的隔空手势输入、隔空触控输入或其他可能的输入。具体可以根据实际情况确定,本申请实施例对此不作限定。

例如,以第四输入为隔空手势输入为例。该第四输入可以包括隔空抓取第五界面的手势输入和滑动手势输入。

再例如,以第四输入为隔空触控输入为例。该第四输入可以包括隔空点击第五界面的输入和隔空拖动第五界面的输入。

可以理解的是,在第四输入为用户对第六界面的隔空手势输入的情况下,当穿戴式设备的摄像头检测到该隔空手势输入时,可以根据摄像头采集到的景深信息确定该第四输入的空间位置,进而确定该隔空手势输入为对第五界面的输入。

步骤112、显示控制装置响应于该第四输入,向第一设备标识指示的第一设备发送第五界面。

可选地,第四输入可以包括从M个界面中抓取第五界面的一个子输入,和将第五界面移动至第一设备标识的另一个子输入。上述步骤112具体可以包括:显示控制装置响应于该一个子输入,从M个界面中选中与该第二输入的空间位置对应的第六界面;并响应于该另一个子输入,将该第五界面发送至第一设备标识指示的第一设备。

例如,如图8中的(a)所示,用户先可以通过双指缩放手势的输入,以触发抓取选中穿戴式设备的虚拟屏幕中显示的某个界面,此时该界面会跟随用户的手指移动;如图8中的(b)所示,用户可以通过双指向外滑动手势的输入,以触发将该界面映射到与穿戴式设备连接、且处于穿戴式设备的视场范围内的另一个设备上。

可选地,本申请实施例,第一设备可以为T个目标设备中的设备,或为除T个目标设备之外与穿戴式设备已建立连接的其他设备。具体可以根据实际情况确定,本申请实施例对此不作限定。

示例性地,以第一设备为T个目标设备中的设备为例。在T个目标设备为一个设备的情况下,第一设备为该一个设备;在T个目标设备为多个设备的情况下,第一设备为该多个设备中的设备。

可选地,上述步骤112之后,本申请实施例提供的显示控制方法还可以包括:第一设备接收第五界面,并将当前显示的界面更新为该第五界面。

示例性地,以显示控制装置为AR眼镜为例。用户佩戴AR眼镜,如图9中的(a)所示,用户可以通过该AR眼镜看到虚拟屏幕01显示的3张界面。如果用户想要将这3张界面中的界面03投放到其他设备上,那么用户可以戴着AR眼镜转动头部,从而在AR眼镜备检测到处于穿戴式设备的摄像头的视场范围内、且与穿戴式设备已建立连接的其他设备的情况下,如图9中的(a)所示,AR眼镜在虚拟屏幕01上显示设备标识11、设备标识12和设备标识13。然后,用户可以对着该界面03做隔空收缩手指手势,并沿箭头指向将该界面03隔空移动至设备标识11(即第四输入)。在接收到该第四输入之后,AR眼镜响应于该第四输入,从该3张界面中选中与该第四输入的空间位置对应的界面03(即第五界面),并向该设备标识11指示的设备11发送该界面03。最后,在设备11接收到该界面03之后,设备11从如图9中的(b)所示的界面14更新为如图9中的(c)所示的界面15,即该界面15中的内容与该界面03的内容一致。

本申请实施例提供的显示控制方法,在穿戴式设备的虚拟屏幕中显示M个界面之后,用户可以通过输入,触发向处于穿戴式设备的摄像头的视场范围内、且与穿戴式设备已建立连接的任意一个设备发送该M个界面中的一个界面,从而任意一个设备可以显示该一个界面。如此,实现了一种多个设备之间的交互方式,将界面在多个设备之间切换显示。

需要说明的是,本申请实施例提供的显示控制方法,执行主体可以为显示控制装置,或者该显示控制装置中的用于执行显示控制方法的控制模块。本申请实施例中以显示控制装置执行显示控制方法为例,说明本申请实施例提供的显示控制装置。

如图10所示,本申请实施例提供一种显示控制装置200,该显示控制装置可以包括显示模块201、接收模块202和处理模块203。显示模块201,可以用于在穿戴式设备的虚拟屏幕中显示M个界面,该M个界面为T个目标设备向该穿戴式设备发送的界面。接收模块202,可以用于接收用户的第一输入,该第一输入为第一悬浮手势的输入。处理模块203,可以用于在该第一悬浮手势与第一预设手势匹配的情况下,响应于接收模块202接收的该第一输入,对该M个界面中的第一界面执行目标处理,该目标处理用于调整该第一界面在虚拟屏幕中的显示参数。其中,M、T均为正整数。

可选地,T个目标设备与穿戴式设备已建立连接。显示控制装置还可以包括发送模块204和收发模块205。接收模块202,还可以用于接收用户的的第二输入,该第二输入为第二悬浮手势的输入。发送模块204,可以用于在该第二悬浮手势与第二预设手势匹配的情况下,响应于接收模块202接收的该第二输入,向T个目标设备中每个目标设备发送请求消息,该请求消息用于请求获取每个目标设备当前显示的第二界面。收发模块205,还可以用于接收每个目标设备发送的第二界面。

可选地,接收模块202,还可以用于在显示模块201在穿戴式设备的虚拟屏幕中显示M个界面之后,接收用户对第一对象和该M个界面中的第三界面的第三输入,该第一对象为该M个界面中第四界面中的对象,或为穿戴式设备的粘贴板中的对象,该第三输入为第三悬浮触控输入。处理模块202,还可以用于响应于接收模块202接收的该第三输入,将该第一对象添加至该第三界面。

可选地,第一对象为M个界面中第四界面中的对象;第一输入可以包括第一子输入和第二子输入。处理模块203,可以具体用于响应于接收模块202接收的该第一子输入,将该第一对象保存至穿戴式设备的粘贴板中;并响应于接收模块202接收的该第二子输入,将该粘贴板中的该第一对象添加至该第三界面。

可选地,显示模块201,还可以用于在穿戴式设备的虚拟屏幕中显示M个界面之后,在虚拟屏幕中,显示至少一个设备标识,该至少一个设备标识中每个设备标识指示一个设备,该一个设备为处于穿戴式设备的摄像头的视场范围内、且与穿戴式设备已建立连接的设备。接收模块202,还可以用于接收用户的第四输入,该第四输入为对所述M个界面中的第五界面和所述至少一个设备标识中的第一设备标识的悬浮触控输入。处理模块202,还可以用于响应于接收模块202接收的该第四输入,向该第一设备标识指示的第一设备发送第五界面。

可选地,M大于1。在T=1的情况下,M个界面可以为一个目标设备发送的不同界面;或者,在T>1的情况下,该M个界面可以为T个设备分别发送的界面。

本申请实施例提供一种显示控制装置,在用户佩戴穿戴式设备的情况下,由于在穿戴式设备的虚拟屏幕中可以显示T个目标设备向穿戴式设备发送的M个界面,因此当用户对AR眼镜显示的界面有操作需求时,用户可以直接使用与第一预设手势匹配的手势输入,触发该显示控制装置对该M个界面的第一界面执行目标处理,从而用户无需通过遥控器或其它设备控制AR眼镜,以实现对AR眼镜显示的界面的操作。如此,使得对AR眼镜显示的界面的操作更为便捷。

本申请实施例中的显示控制装置可以是装置,也可以是终端中的部件、集成电路、或芯片。该装置可以是移动电子设备,也可以为非移动电子设备。示例性地,移动电子设备可以为手机、平板电脑、笔记本电脑、掌上电脑、车载电子设备、可穿戴设备、超级移动个人计算机(ultra-mobile personal computer,UMPC)、上网本或者个人数字助理(personaldigital assistant,PDA)等,非移动电子设备可以为服务器、网络附属存储器(networkattached storage,NAS)、个人计算机(personal computer,PC)、电视机(television,TV)、柜员机或者自助机等,本申请实施例不作具体限定。

本申请实施例中的显示控制装置可以为具有操作系统的装置。该操作系统可以为安卓(Android)操作系统,可以为ios操作系统,还可以为其他可能的操作系统,本申请实施例不作具体限定。

本申请实施例提供的显示控制装置能够实现图1至图9的方法实施例实现的各个过程,为避免重复,这里不再赘述。

可选地,如图11所示,本申请实施例还提供一种电子设备300,包括处理器301,存储器302,存储在存储器302上并可在处理器301上运行的程序或指令,该程序或指令被处理器301执行时实现上述显示控制方法实施例的各个过程,且能达到相同的技术效果,为避免重复,这里不再赘述。

需要注意的是,本申请实施例中的电子设备包括上述的移动电子设备和非移动电子设备。

图12为实现本申请实施例的一种电子设备的硬件结构示意图。

该电子设备400包括但不限于:射频单元401、网络模块402、音频输出单元403、输入单元404、传感器405、显示单元406、用户输入单元407、接口单元408、存储器409、以及处理器410等部件。

本领域技术人员可以理解,电子设备400还可以包括给各个部件供电的电源(比如电池),电源可以通过电源管理系统与处理器410逻辑相连,从而通过电源管理系统实现管理充电、放电、以及功耗管理等功能。图12中示出的电子设备结构并不构成对电子设备的限定,电子设备可以包括比图示更多或更少的部件,或者组合某些部件,或者不同的部件布置,在此不再赘述。

其中,显示单元406,可以用于在穿戴式设备的虚拟屏幕中显示M个界面,该M个界面为T个目标设备向该穿戴式设备发送的界面。用户输入单元407,可以用于接收用户的第一输入,该第一输入为第一悬浮手势的输入。处理器410,可以用于在该第一悬浮手势与第一预设手势匹配的情况下,响应于用户输入单元407接收的该第一输入,对该M个界面中的第一界面执行目标处理,该目标处理用于调整该第一界面在虚拟屏幕中的显示参数。其中,M、T均为正整数。

可选地,T个目标设备与穿戴式设备已建立连接。用户输入单元407,还用于接收用户的的第二输入,该第二输入为第二悬浮手势的输入。射频单元401,可以用于在该第二悬浮手势与第二预设手势匹配的情况下,响应于用户输入单元407接收的该第二输入,向T个目标设备中每个目标设备发送请求消息,该请求消息用于请求获取每个目标设备当前显示的第二界面;并接收每个目标设备发送的该第二界面。

可选地,用户输入单元407,还可以用于在显示单元406在穿戴式设备的虚拟屏幕中显示M个界面之后,接收用户对第一对象和该M个界面中的第三界面的第三输入,该第一对象为该M个界面中第四界面中的对象,或为穿戴式设备的粘贴板中的对象,该第三输入为第三悬浮触控输入。处理器410,可以用于响应于用户输入单元407接收的该第三输入,将该第一对象添加至该第三界面。

可选地,第一对象为M个界面中第四界面中的对象;第一输入包括第一子输入和第二子输入。处理器410,具体可以用于响应于用户输入单元407接收的该第一子输入,将该第一对象保存至穿戴式设备的粘贴板中;并响应于用户输入单元407接收的该第二子输入,将该粘贴板中的该第一对象添加至该第三界面。

可选地,显示单元406,用于在穿戴式设备的虚拟屏幕中显示M个界面之后,在虚拟屏幕中,显示至少一个设备标识,该至少一个设备标识中每个设备标识指示一个设备,该一个设备为处于穿戴式设备的摄像头的视场范围内、且与穿戴式设备已建立连接的设备。用户输入单元407,可以用于接收用户的第四输入,该第四输入为对所述M个界面中的第五界面和所述至少一个设备标识中的第一设备标识的悬浮触控输入。射频单元401,可以用于响应于用户输入单元407接收的该第四输入,向该第一设备标识指示的第一设备发送第五界面。

本申请实施例提供一种电子设备,在用户佩戴穿戴式设备的情况下,由于在穿戴式设备的虚拟屏幕中可以显示T个目标设备向穿戴式设备发送的M个界面,因此当用户对AR眼镜显示的界面有操作需求时,用户可以直接使用与第一预设手势匹配的手势输入,触发电子设备对该M个界面的第一界面执行目标处理,从而用户无需通过遥控器或其它设备控制AR眼镜,以实现对AR眼镜显示的界面的操作。如此,使得对AR眼镜显示的界面的操作更为便捷。

应理解的是,本申请实施例中,输入单元404可以包括图形处理器(graphicsprocessing unit,GPU)4041和麦克风4042,图形处理器4041对在视频捕获模式或图像捕获模式中由图像捕获装置(如摄像头)获得的静态图片或视频的图像数据进行处理。显示单元406可包括显示面板4061,可以采用液晶显示器、有机发光二极管等形式来配置显示面板4061。用户输入单元407包括触控面板4071以及其他输入设备4072。触控面板4071,也称为触摸屏。触控面板4071可包括触摸检测装置和触摸控制器两个部分。其他输入设备4072可以包括但不限于物理键盘、功能键(比如音量控制按键、开关按键等)、轨迹球、鼠标、操作杆,在此不再赘述。存储器409可用于存储软件程序以及各种数据,包括但不限于应用程序和操作系统。处理器410可集成应用处理器和调制解调处理器,其中,应用处理器主要处理操作系统、用户界面和应用程序等,调制解调处理器主要处理无线通信。可以理解的是,上述调制解调处理器也可以不集成到处理器410中。

本申请实施例还提供一种可读存储介质,该可读存储介质上存储有程序或指令,该程序或指令被处理器执行时实现上述显示控制方法实施例的各个过程,且能达到相同的技术效果,为避免重复,这里不再赘述。

其中,处理器为上述实施例中电子设备中的处理器。可读存储介质,包括计算机可读存储介质,如计算机只读存储器(read-only memory,ROM)、随机存取存储器(randomaccess memory,RAM)、磁碟或者光盘等。

本申请实施例另提供了一种芯片,该芯片包括处理器和通信接口,通信接口和处理器耦合,处理器用于运行程序或指令,实现上述显示控制方法实施例的各个过程,且能达到相同的技术效果,为避免重复,这里不再赘述。

应理解,本申请实施例提到的芯片还可以称为系统级芯片、系统芯片、芯片系统或片上系统芯片等。

需要说明的是,在本文中,术语“包括”、“包含”或者其任何其他变体意在涵盖非排他性的包含,从而使得包括一系列要素的过程、方法、物品或者装置不仅包括那些要素,而且还包括没有明确列出的其他要素,或者是还包括为这种过程、方法、物品或者装置所固有的要素。在没有更多限制的情况下,由语句“包括一个……”限定的要素,并不排除在包括该要素的过程、方法、物品或者装置中还存在另外的相同要素。此外,需要指出的是,本申请实施方式中的方法和装置的范围不限按示出或讨论的顺序来执行功能,还可包括根据所涉及的功能按基本同时的方式或按相反的顺序来执行功能,例如,可以按不同于所描述的次序来执行所描述的方法,并且还可以添加、省去、或组合各种步骤。另外,参照某些示例所描述的特征可在其他示例中被组合。

通过以上的实施方式的描述,本领域的技术人员可以清楚地了解到上述实施例方法可借助软件加必需的通用硬件平台的方式来实现,当然也可以通过硬件,但很多情况下前者是更佳的实施方式。基于这样的理解,本申请的技术方案本质上或者说对现有技术做出贡献的部分可以以软件产品的形式体现出来,该计算机软件产品存储在一个存储介质(如ROM/RAM、磁碟、光盘)中,包括若干指令用以使得一台终端(可以是手机,计算机,服务器,空调器,或者网络设备等)执行本申请各个实施例中的方法。

上面结合附图对本申请的实施例进行了描述,但是本申请并不局限于上述的具体实施方式,上述的具体实施方式仅仅是示意性的,而不是限制性的,本领域的普通技术人员在本申请的启示下,在不脱离本申请宗旨和权利要求所保护的范围情况下,还可做出很多形式,均属于本申请的保护之内。

- 液晶显示装置、电子设备、显示控制方法、显示控制程序以及非临时性记录介质

- 电子设备显示屏的控制方法及装置、电子设备和存储介质