一种基于改进YOLOv5的夜晚场景下的行人检测方法

文献发布时间:2023-06-19 18:29:06

技术领域

本发明技术主要涉及一种夜晚场景下的行人检测方法,尤其是涉及一种基于改进YOLOv5的夜晚场景下的行人检测方法,属于目标检测技术领域。

背景技术

目标检测作为计算机视觉的一项基本任务被广泛应用于工业、农业、军事、医疗等领域,它可以找出图像中感兴趣的目标并确定目标的位置和类别,其中行人检测技术更是各个领域研究的重点内容,行人检测作为无人驾驶领域的关键部分,可以辅助驾驶员在汽车行驶过程中准确快速的避让行人,从而有效的提升交通的安全性。据不完全统计,全球60%的交通事故发生在晚上,占交通事故死亡总数的50%,所以研究夜晚场景下的行人检测技术无论是对无人驾驶领域还是其它领域都有着广泛的研究意义。由于夜晚场景下图片对比度差异大,色彩信息少,很容易出现漏检误检等情况,这都导致当前视觉检测算法并不能很好地检测出结果。

目前基于深度学习算法改进的多模态检测算法取得了较好的检测效果,例如红外设备与雷达等设备与目标检测算法的结合,但这些多模态方式无论是在前期数据集的拍摄和标注上或者硬件设备上都带来了极大的成本,无法适用于常规目标检测场景。

发明内容

本发明的目的在于提供一种基于改进YOLOv5的夜晚场景下行人检测技术方法,该技术应用了深度学习中的高性能通用的目标检测模型YOLOv5,并针对夜晚低能见度中行人检测漏检率高,检测精度低等问题进行优化改进。

本发明的技术解决方案是这样实现的:

一种基于改进YOLOv5的夜晚场景下的行人检测方法,包括如下步骤:

步骤一、在图像输入网络前,将图像缩放至640×640像素大小;

步骤二、随后将图像输入特征提取网络,特征提取网络采用结构重参数化结构,包括第一下采样层,第一重参数化层,第一卷积归一化层,第二重参数化层,第二卷积归一化层,第三重参数化层,第三卷积归一化层,第四重参数化层,第四卷积归一化层,第一空间金字塔池化层;

步骤三、步骤二中由第二卷积归一化层,第三卷积归一化层和第一空间金字塔池化层得到的特征图分别记为:特征图F1,特征图F2,特征图F3;

步骤四、步骤二中卷积归一化层中包含CBAM注意力模块,CBAM注意力模块通过空间与通道两个维度提取信息特征,且重参数化层可以通过重参数化的方式融合归一化层与卷积层;

步骤五、该步骤为FPN网络结构,可使多个尺度的特征图进行融合;将特征图F3经过卷积归一化层得到的特征图记为特征图P1,将特征图F3经过转置卷积的上采样方式得到的特征图与特征图F2融合,得到特征图P2;将特征图P1经过转置卷积上采样方式得到的特征图与特征图F1进行融合,得到特征图P3;

步骤六、在步骤五中FPN的结构上增加PAN结构,进一步融合更多尺度的特征;将特征图P3经过卷积归一层与特征图P2融合得到特征图N1;将特征图N1经过卷积归一化层得到的特征图与特征图P3融合得到特征图N2;

步骤七、将特征图P3,特征图N1,特征图N2分别输入检测头,通过极大值抑制方式筛选出最终的检测结果。

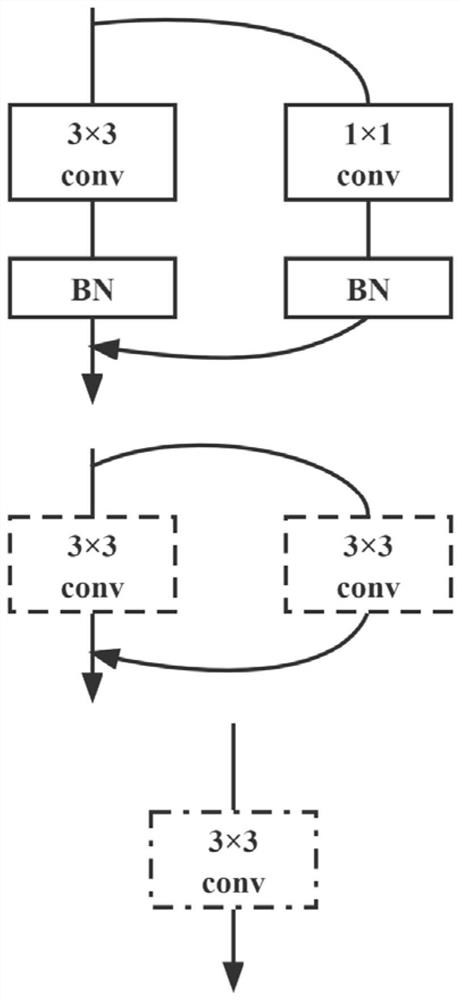

所述步骤二中的结构重参数化结构为3×3卷积外添加1×1的残差分支,可以在模型训练完成后通过结构重参数化的方式融合卷积层与归一化层。

所述步骤四中的CBAM注意力模块通过融合通道信息和空间信息来提取信息特征,可以从两个维度上加强低能见度目标的表征信息。

所述步骤五中的转置卷积上采样方式为卷积核大小为4×4步长为2的转置卷积。

所述步骤七中的检测头为轻量化的解耦头,包含4个1×1卷积与2个3×3卷积。

与现有技术相比较,本发明的优点是显而易见的,主要表现在:

1、在夜晚低能见度场景下行人检测任务上,能够达到更高的识别精度;

2、对夜晚有遮挡的行人检测,能够表现出更好的的检测效果。

附图说明

本发明共有附图4幅。

图1为本发明的结构重参数化模块重参数化过程示意图;

图2为本发明在原始结构中加入CBAM注意力机制后模块结构图;

图3为本发明的重参数化主干网络结构图;

图4为本发明的轻量化解耦头结构示意图。

具体实施方式

如图1、2、3、4所示的一种基于改进YOLOv5的夜晚场景下的行人检测方法,包括如下步骤:

步骤一、在图像输入网络前,将图像缩放至640×640像素大小;

步骤二、随后将图像输入特征提取网络,特征提取网络采用结构重参数化结构,包括第一下采样层,第一重参数化层,第一卷积归一化层,第二重参数化层,第二卷积归一化层,第三重参数化层,第三卷积归一化层,第四重参数化层,第四卷积归一化层,第一空间金字塔池化层;

步骤三、步骤二中由第二卷积归一化层,第三卷积归一化层和第一空间金字塔池化层得到的特征图分别记为:特征图F1,特征图F2,特征图F3;

步骤四、步骤二中卷积归一化层中包含CBAM注意力模块,CBAM注意力模块通过空间与通道两个维度提取信息特征,且重参数化层可以通过重参数化的方式融合归一化层与卷积层;

步骤五、该步骤为FPN网络结构,可使多个尺度的特征图进行融合;将特征图F3经过卷积归一化层得到的特征图记为特征图P1,将特征图F3经过转置卷积的上采样方式得到的特征图与特征图F2融合,得到特征图P2;将特征图P1经过转置卷积上采样方式得到的特征图与特征图F1进行融合,得到特征图P3;

步骤六、在步骤五中FPN的结构上增加PAN结构,进一步融合更多尺度的特征;将特征图P3经过卷积归一层与特征图P2融合得到特征图N1;将特征图N1经过卷积归一化层得到的特征图与特征图P3融合得到特征图N2;

步骤七、将特征图P3,特征图N1,特征图N2分别输入检测头,通过极大值抑制方式筛选出最终的检测结果;

所述步骤二中的结构重参数化结构为3×3卷积外添加1×1的残差分支,可以在模型训练完成后通过结构重参数化的方式融合卷积层与归一化层;所述步骤四中的CBAM注意力模块通过融合通道信息和空间信息来提取信息特征,可以从两个维度上加强低能见度目标的表征信息;所述步骤五中的转置卷积上采样方式为卷积核大小为4×4步长为2的转置卷积;所述步骤七中的检测头为轻量化的解耦头,包含4个1×1卷积与2个3×3卷积。

- 一种基于改进YOLOV5的面向复杂场景的安全帽检测方法

- 一种动态场景下基于在线学习的实时行人检测方法