Alpha噪声下基于Transformer多头注意力机制网络的频谱感知方法

文献发布时间:2023-06-19 18:32:25

技术领域

本发明涉及计算机技术领域,主要涉及深度学习和频谱感知领域。

背景技术

随着通信技术的迅速发展,无线电业务种类越来越多,人们对网络传输要求越来越高,有效解决频谱资源缺失问题成为了人们的热点话题。而认知无线电(CognitiveRadio,CR),其概念是指无线终端对周围的无线环境进行感知、分析等。通过获取的信息能够及时调整自己的传输参数,合理利用已授权的频段资源完成无限传输。在此过程中,它要求未授权的次级用户在不干扰授权用户的情况下进行频谱感知,并对空闲的频段资源进行数据传输。然而,近年来,由于授权用户信号的数量剧增、种类繁多、传输数据的信道不统一等问题,给认知无线电中的频谱感知技术带来了很大的挑战。

而在我们现实生活中,通信信道不仅包含来自于或器件系统内部的内部噪声,比如:谱泄露,还包含来自外部的是外部噪声,比如:人为的脉冲噪声。对于Alpha稳定分布噪声而言,它是一个能够在非高斯环境下真实描述脉冲的数学模型。并且它不具有Alpha以及Alpha阶以上的阶次,即它的阶次在0-2之间。在此情况下,传统的频谱感知算法检测性能明显下降。所以,本发明提出了Alpha噪声下基于Transformer多头注意力机制网络的频谱感知方法。

发明内容

发明目的:在复杂多变的非高斯环境中,有效提高次级用户对变化中的主用户信号状态的识别度,成为研究频谱感知的重要问题。而本文提出的在Alpha噪声下,基于Transformer多头注意力机制网络实现的框架模型能够有效提高检测性能。

技术方案:本文发明设计Alpha噪声下基于Transformer多头注意力机制网络的频谱感知方法,用于提高在复杂的噪声环境下,次级用户对主用户的检测性能,主要包括以下步骤:

S10:实验以Alpha作为频谱感知算法的背景噪声进行建模,以不同信噪比的数字调制信号作为接收样本。将这些接收到的样本分为五组,并且按照4∶1的比例划分,并将它们分别用作训练数据和测试数据;

S20:对训练集中的训练数据进行分数低阶矩处理并将这些大小为3X26X26的训练数据做好相应的数据-标签序列,得到标签集;

S30:将加过标签的数据送入谱卷积层进行部分特征提取;

S40:搭建Transformer内部网络,包括位置编码层、多头注意力机制层、前馈网络层。初始化Transformer网络的结构参数主要包括编码器数、编码器单元数目、优化函数、学习率等等;

S50:将加过标签的训练数据进行分块处理,并进行位置编码,将其送入Transformer模型的编码器层进行训练学习、特征提取;

S60:将编码器出来的结果送入上采样层,再经平均池化层整合数据特征,并通过全连接层得到训练时网络的分类结果;

S70:在用加过标签的训练集训练网络的过程中,我们需根据训练的损失函数来计算损失值,并将损失值绘制成损失曲线,然后根据损失曲线的趋势来执行S40,不断调整Transformer里面的参数,得到更好的网络分类效果;

S80:将测试集中的测试数据送入已学会分类的Transformer模型中,并用网络学习得到的数据与原标签数据以阈值为界进行比较,从而对主用户的状态进行判断。

优选地,所述步骤S20包括:对训练集中的训练数据进行分数低阶矩处理,如表达式(1)所示:

其中Z

优选地,所述步骤S30包括:谱卷积层有三层卷积操作,卷积是为了改变信号数据的形状,对局部区域的特征进行粗提取。

优选地,所述S40包含以下内容:

S4001:在位置编码层:我们将分好块的数据送入Transformer网络,随后对它们进行位置编码。对不同维度上的数据,使用周期函数来控制每段信号的相对位置,表达式如(2)所示:

PE为一个二维矩阵,pos表示某段信号数据在脉冲中所处的位置,e表示信号数据特征所处的位置,d

S4002:在多头注意力机制层:使用到的Transformer有六个编码器,并且它是由多头注意力机制和前馈神经网络组成。多头注意力机制的表达式如下:

多头注意力机制由E个缩放点积注意力机制组成,在(3)的第一个式子中,参数Q(query),K(key),V(value)共同决定数据内部特征,Q表示查询信号矩阵,K表示被查询的信号和其他信号之间的关联信息的矩阵,V表示被查询信号的矩阵。在(3)的第二个式子中,h

S4003:前馈网络层包含两层全连接层,并且所用激活函数为GELU。

优选地,所述S80中,输出的测试结果若小于阈值,则说明在频段中不能检测出主用户的信号;若输出的测试结果大于阈值,则说明在检测的频段中存在主用户的信号,次级用户不能接入。

区别于现有的处理方法,本发明的有益效果是:

1、本发明采用分数低阶矩对采集的观测数据进行预处理,搭建Transformer网络模型,将做过标签的训练数据送入网络中,通过不断地调整网络地参数大小从而达到训练网络的目的。随后将测试数据送入已学会分类的网络进行测试,最后通过全连接层将测试结果与阈值进行比较,准确判断主用户的状态。

2、通过使用分数低阶矩调整特征指数的大小来控制非高斯噪声脉冲性幅值,减少非高斯环境下噪声的影响能力,从而提高次级用户的检测效率。

3、使用谱卷积层可以对局部特征信号进行粗提取。

4、使用Transformer的多头注意力机制可以加快数据并行运算的速度,并且提高对数据特征的提取精确度。

附图说明

下面结合附图对本发明的具体实施方式作更详细的描述。

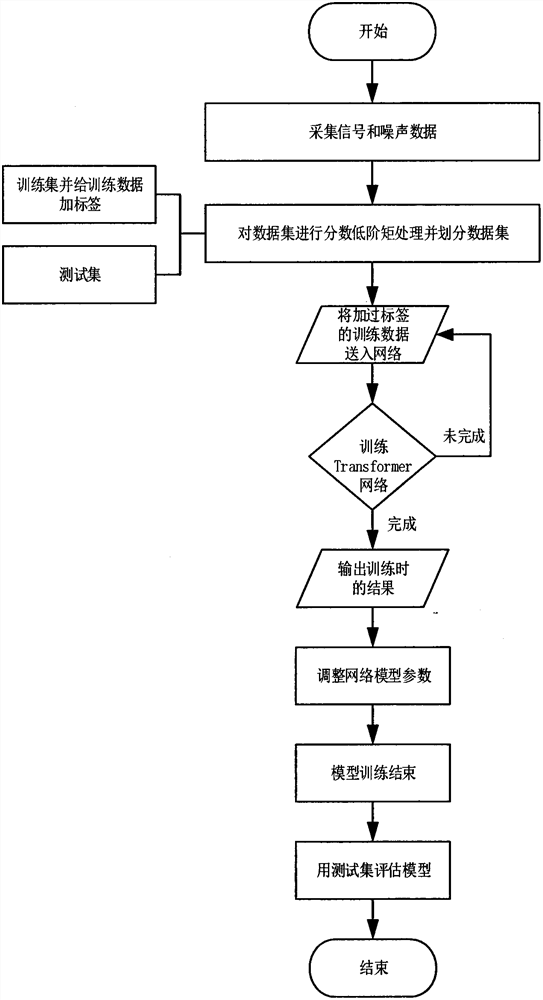

图1为本发明的方法流程图;

图2为本发明的Transformer网络特征提取图;

图3为本发明的自注意力机制的运算流程图;

图4为本发明的多头注意力机制运算流程图;

图5为本发明中不同激活函数下的ROC曲线图;

图6为本发明中不同信噪比下的ROC曲线图。

具体实施方式

下面结合附图详细说明本发明具体实施方式。

本发明提出的Alpha噪声下基于Transformer多头注意力机制网络的频谱感知方法,具体包括以下步骤:

步骤10:采集数字调制信号样本和Alpha噪声样本。并以五重交叉验证的方式将其分为训练集和测试集,随后进入步骤20;

步骤20:对训练集中的训练数据进行分数低阶矩处理并将这些大小为3X26X26的训练数据做好相应的数据-标签序列,得到标签集,随后进入步骤30;

步骤30:将加过标签的数据送入谱卷积层进行部分特征提取,进入步骤40;

步骤40:搭建Transformer内部网络,包括位置编码层、多头注意力机制层、前馈网络层。初始化Transformer网络的结构参数主要包括编码器数、编码器单元数目、优化函数,学习率等等,进入步骤50;

步骤50:将加过标签的训练数据进行分块处理,并进行位置编码,将其送入Transformer模型的编码器层进行训练学习、特征提取,进入步骤60;

步骤60:将编码器出来的结果送入上采样层,再经平均池化层整合数据特征,并通过全连接层得到训练时网络的分类结果,进入步骤70;

步骤70:用加过标签的训练集训练网络的过程中,我们需根据训练的损失函数来计算损失值,并将损失值绘制成损失曲线,然后根据损失曲线的趋势来执行步骤40,不断调整Transformer里面的参数,得到更好的网络分类效果,进入步骤80;

步骤80:将测试集中的测试数据送入已学会分类的Transformer模型中,将网络学习得到的数据与原标签数据以阈值为界进行比较,从而对主用户的状态进行判断。

所述步骤40包含以下内容:

步骤4001:在位置编码层:我们将分好块的数据送入Transformer网络,随后对它们进行位置编码。对不同维度上的数据,使用周期函数来控制每段信号的相对位置,表达式如(4)所示:

PE为一个二维矩阵,pos表示某段信号数据在脉冲中所处的位置,e表示信号数据特征所处的位置,d

步骤4002:在多头注意力机制层:使用到的Transformer有六个编码器,并且它是由多头注意力机制和前馈神经网络组成。多头注意力机制的表达式如下:

多头注意力机制由E个缩放点积注意力机制组成,在(5)的第一个式子中,参数Q(query),K(key),V(value)共同决定数据内部特征,Q表示查询信号矩阵,K表示被查询的信号和其他信号之间的关联信息的矩阵,V表示被查询信号的矩阵。在(5)的第二个式子中,h

步骤4003:前馈网络层包含两层全连接层,并且所用激活函数为GELU。

优选地,所述步骤80中,输出的测试结果若小于阈值,则说明在频段中不能检测出主用户的信号;若输出的测试结果大于阈值,则说明在检测的频段中存在主用户的信号,次级用户不能接入。

实施例1

下面结合附图对本发明作进一步的描述。以下实例用于清楚说明本发明的技术方案,而不能以此来限制本发明的保护发明。

如图2至图4所示,是网络提取信号特征的详细描述。图2展示了Transformer网络提取信号特征的过程。我们把经过分数低阶矩处理的观测数据作为模型的输入数据,此时的数据大小为3X26X26;随后利用三个谱卷积层来改变输入数据的形状,即大小为1024x4X4;并将改变形状后的数据进行分块处理;然后将分好块的大小为16x1024的数据送入Transformer网络进行特征提取。此时,我们除了将分块后的数据送入网络以外,还需要对这些分块的数据进行位置编码,这样有助于我们知道信号数据之间的相关信息;紧接着,这些数据需要经过六个编码器模块,每个模块中有一个注意力机制层和前向传播层,这两层可以提高批量处理数据的速度。随后,我们将经过编码器的数据送入上采样层,进行数据形状的缩放。并将缩放后的数据送入平均池化层和全连接层,得到网络输出的结果。

图3则为自注意力机制的运算流程。

图4为多头注意力机制的运算流程,它最大的特点就是能够并行运算,批量处理数据。多头注意力机制的具体公式,如下:

Q表示查询信号矩阵,K表示被查询的信号和其他信号之间的关联信息的矩阵,V表示被查询信号的矩阵,

实施例2

下面结合附图对本发明作进一步的描述。以下实例用于清楚说明本发明的技术方案,而不能以此来限制本发明的保护发明。

在Transformer模型的选择上,损失函数采用交叉熵损失函数(Cross EntropyLoss)。优化器使用Adam函数,此时学习率通常设为0.001,随着梯度下降速率的趋势,我们可以适当调整学习率的大小,以确保网络能够正常收敛。对于一些参数的数值设置,具体见表1:

表1 参数设置

在本发明的实验中,采用ROC曲线来衡量网络进行频谱感知的效果,横坐标为虚警概率,纵坐标为检测概率。当ROC曲线下的面积值在0.5和1.0之间,说明检测效果良好。当ROC曲线越靠近左上角,说明检测的准确性就越高。此外,我们将进行分数低阶矩处理并标过标签的数据送入Transformer网络进行训练,在其他条件的相同情况下,通过调整网络参数比较提出的Transformer与传统ED算法的检测效果。

本发明引入非线性函数作为隐藏层的激活函数,来增强网络的表达能力,提高复杂函数的建模精度,减轻过拟合现象。在本发明的实验中,采用的激活函数分别为ReLU、Sigmoid和Tanh。

从图5可以看出,其他条件相同的情况下,以ReLU为激活函数的模型,检测概率最高,模型的性能最好,其次是Sigmoid函数,最后是Tanh函数。因此,我们选择ReLU作为隐藏层的激活函数。

实施例3

下面结合附图对本发明作进一步的描述。以下实例用于清楚说明本发明的技术方案,而不能以此来限制本发明的保护发明。

在非高斯条件并且无衰落信道条件下,在不同的信噪比的条件下,我们比较了传统的能量检测算法和改进的Transformer网络的ROC曲线图。

从图6可以看出,在无信道衰落的条件下,Alpha噪声模型在不同的信噪比下进行分数低阶矩处理后的Transformer模型的ROC性能图。由图可知,在低信噪比的情况下,噪声分量明显高于信号分量,经过分数低阶矩处理过的数据有明显的特征。当信噪比为0dB,虚警概率为0.1时,我们所提出的Transformer神经网络的检测概率最高,接近1。而当信噪比为-20dB,其他条件都相同的条件下,在虚警概率为0.1时,检测效果也较好。

- 噪声不确定情况下基于核空间优化的合作频谱感知方法

- Laplace噪声下基于Transformer-DNN混合网络的多用户频谱感知方法

- 一种alpha稳定噪声衰落信道下多天线频谱感知方法及系统