一种基于时空对抗的3维信号处理方法

文献发布时间:2023-06-19 09:32:16

技术领域

本发明涉及视频超分辨领域,具体涉及一种基于时空对抗网络的视频超分辨方法。

背景技术

视频的空间分辨率取决于图像传感器的空间密度、运动和系统噪声等。视频的时间分辨率取决于相机的帧率和曝光时间。当时间分辨率较低时,视频会出现运动模糊和运动混叠。近年来,随着深度学习在计算机视觉上的应用和发展,基于CNN的视频目标检测和动作识别都取得了显著进展。然而,大多数的用于目标检测和动作识别的神经网络是用高分辨率视频训练的,因此将训练过的神经网络直接应用于低分辨率视频的效果并不理想,性能显著下降。在航拍和遥感视频中,目标往往较小,检测难度较大,在低分辨率下尤甚。对此,一个可行的解决方案是在检测和识别前对视频执行超分辨。

在对视频超分辨重建的早期研究中,常把它视为图像超分辨重建的简单延伸,这样就使得相邻帧间的时间冗余没有得到充分利用。以前的多帧/视频超分辨方法主要是基于重构和利用帧间一致性。其中大部分基于贝叶斯框架,采用光流技术进行亚像素精度运动估计。这些方法可以在存在小的全局运动时保证高保真度。然而,当运动较为剧烈时,它们往往失效。

近年来,将深度学习的表示能力与帧间时间一致性相结合,以提高视觉质量和保真度的研究也取得了一定的成果。为了把握时间一致性,现有的方法大多采用滑动帧窗口,使用多个低分辨率帧作为输入来生成一个高分辨率帧。为了同时处理时空信息,现有的方法通常采用时间融合技术,如运动补偿、双向递归卷积网络(BRCN),LSTM等。三维卷积(C3D)在视频学习中表现出了优异的性能。部分研究者利用C3D对BRCN进行了改进,使得模型能够以自然的方式灵活地获取对不同时间上下文的访问,但网络仍然是浅层的。对于损失函数,在视频超分辨率中,现有的方法仍然主要使用平均平方误差等标准损失,而不是对抗性损失Photorealisticvideosuperresolution(PVSR),提出使用对抗性损失,然而,但该方法主要针对纯空间判别器。

发明内容

本发明的目的在于提供一种基于时空对抗的3维信号处理方法(基于时空对抗网络的视频超分辨方法),以解决在超频超分辨中对于多样和模糊的运动下视觉效果显著下降的问题,同时充分利用视频中的时间信息,保证超分辨后的视频的时空一致性。

为实现上述目的,本发明的技术方案是设计一种基于时空对抗的3维信号处理方法(基于时空对抗网络的视频超分辨方法),构建时空对抗网络,所述时空对抗网络包括循环生成器G、光流估计网络F和时空判别器D

所述循环生成器G用于递归地从低分辨率输入生成高分辨率视频帧;光流估计网络F学习帧与帧之间的运动补偿;时空判别器是本方法的核心部分,它可以考虑空间和时间方面,并在不过度平滑图像内容的情况下惩罚结果中不真实的时间不连续性;

所述循环生成器,为基于一个与光流估计网络F耦合的循环卷积网络;循环生成器从低分辨率(LR)帧x

所述时空判别器,其接收两组输入:真值和生成帧;这两组数据具有相同的结构,包含:三个相邻的HR帧,三个对应的上采样的LR帧,以及三个warpedHR帧;经过损失函数训练可以为循环生成器提供有关空间细节的真实性和时间变化的梯度信息;通过同时考虑空间和时间输入,时空判别器D

优选的,所述的基于时空对抗的3维信号处理方法,包括如下步骤:

1)前一帧x

2)v

3)大尺寸的v

4)w(g

5)x

6)循环生成器有两种输入:真实帧和生成帧;这两组数据具有相同的结构,包含:三个相邻的HR帧、三个对应双三次插值的LR帧和三个warp的HR帧;

7)通过判别器惩罚生成器。

优选的,运用PP损失函数训练,时空对抗损失PP-Loss,在保留适当的高频细节的同时,PP损失成功地消除了漂移的伪影;此外,这种损失构造有效地增加了训练数据集的大小,因此代表了一种有用的数据扩充形式。

优选的,加入PCD对齐模块和TSA融合模块;PCD模块是加入带有金字塔结构、级联结构和可变形卷积的对齐模块;其中,帧的对齐是特征层上使用可变形卷积逐步细化实现的;在多样的运动和模糊状态下有效地融合不同帧,加入时空注意力融合模块;其中,时空注意力融合模块TSA,注意力机制同时应用于时间和空间,以强调为了后续恢复的重要特征。

本发明提供一种基于时空对抗的3维信号处理方法,解决在超频超分辨中对于多样和模糊的运动下视觉效果显著下降的问题,同时充分利用视频中的时间信息,保证超分辨后的视频的时空一致性。

与现有技术相比,本发明具有以下有益的技术效果:

本发明提出了一个时空判别器,不同于基于深度神经网络的视频超分辨方法中采用的简单的均方差损失,本发明方案提出了时空对抗损失,同时考虑时间与空间上的不一致性;本发明方案采用了GAN网络,通过生成器与判别器的对抗性训练来学习视频的时空信息。

进一步地,考虑如何在大的运动下对齐多个帧,以及如何在多样的运动和模糊状态下有效地融合不同帧的问题,本发明方案在生成器中加入了PCD对齐模块和TSA融合模块,可以更好地估计光流信息以及融合生成时空一致性更高的超分辨帧。

附图说明

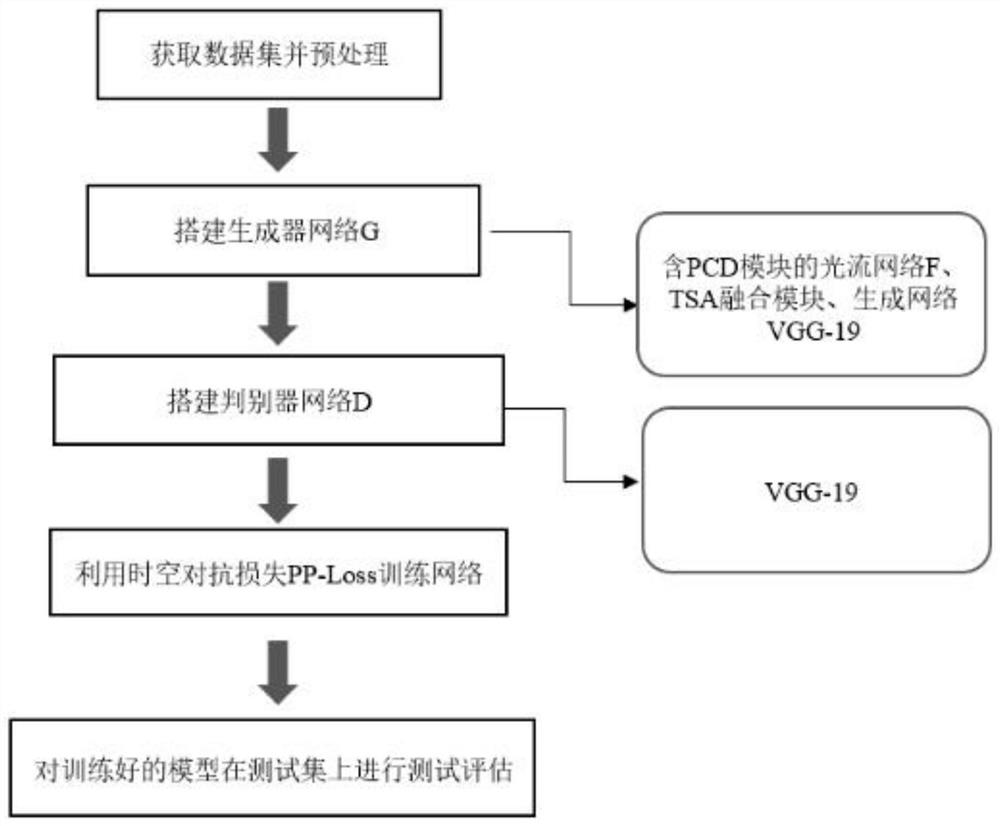

图1是本发明的总流程图;

图2是本发明的网络框架图;

图3是PCD模块框架图。

具体实施方式

下面结合附图和实施例,对本发明的具体实施方式作进一步描述。以下实施例仅用于更加清楚地说明本发明的技术方案,而不能以此来限制本发明的保护范围。

如图1至图3所示,本发明具体实施的技术方案如下:

1.生成器:基于一个与光流估计网络F耦合的循环卷积网络;生成器从低分辨率(LR)帧x

2.判别器,其接收两组输入:真值和生成帧;这两组数据具有相同的结构,包含:三个相邻的HR帧,三个对应的上采样的LR帧,以及三个warpedHR帧。

3.本发明中的生成网络和对抗网络采用VGG-19网络框架。

4.本发明中的光流估计网络F加入PCD模块,如图3所示的PCD对齐模块利用可变形卷积对每一帧的特征进行对齐;在图1中,t为参考帧,(t+i)为相邻帧,如黑色虚线所示,通过对(l-1)层的特征进行降采样,得到(t+i)帧的第l层的特征;灰色虚线代表了通过对(l+1)层的偏移量和对齐特征进行上采样,能预测第l层的偏移量和对齐特征;图中灰色背景部分,是指在金字塔结构后,级联了带有可变形卷积的对齐部分进一步细化对齐特征。

5.TSA模块,由t帧及其相邻帧的对齐特征通过简单的卷积滤波器得到映射(embeddings),将其做点积运算,利用sigmod函数限制输出在[0,1],这样就得到了映射空间中的帧相似度,时间注意力的目的就是计算映射空间中的帧相似性,直观地说,在映射空间中应该更多地关注与参考帧相似的相邻帧;然后将时间注意力映射以像素级的方式与原始对齐特征相乘,采用一个额外的融合卷积层来聚合这些特征,根据融合特征计算出空间注意力掩膜,在此之后,融合的特征被掩膜调制(通过点乘和加法)。

6.本发明的详细执行流程如下:

6.1)前一帧x

6.2)v

6.3)大尺寸的v

6.4)w(g

6.5)x

6.6)生成器有两种输入:真实帧和生成帧;这两组数据具有相同的结构,包含:三个相邻的HR帧、三个对应双三次插值的LR帧和三个warp的HR帧;

6.7)运用PP损失函数训练,为生成器提供有关空间细节的真实性和时间变化的梯度信息;通过同时考虑空间时间输入,判别器D

7.对训练好的网络模型进行测试评估。评估标准为PSNR。

以上所述仅是本发明的优选实施方式,应当指出,对于本技术领域的普通技术人员来说,在不脱离本发明技术原理的前提下,还可以做出若干改进和润饰,这些改进和润饰也应视为本发明的保护范围。

- 一种基于时空对抗的3维信号处理方法

- 一种基于时空图卷积-生成对抗网络的交通速度预测方法