基于视觉的鸡雏公母智能鉴别方法及系统

文献发布时间:2023-06-19 12:02:28

技术领域

本发明涉及一种基于视觉的鸡雏公母智能鉴别方法及系统。

背景技术

养殖场都实行公母分饲,主要原因在于:养殖场分蛋鸡和肉鸡,在蛋鸡养殖场当然只能养母鸡;而商品肉鸡虽然公母都要,但如果混合饲养的话,由于公鸡发育快,而且会抢食,这会影响到母鸡的生长,因此要保证经济效益也最好分开饲养。所以,及早进行雏鸡性别鉴定,就可以淘汰公鸡或分离雌雄小鸡,也就节约了饲料、禽舍、劳动力等各种饲养费用。

目前主要采用快慢羽鉴别法和翻肛鉴别法进行雏鸡的公母分辨。

快慢羽鉴别法就是雏鸡翼羽生长速度,根据某些品种的鸡的遗传性,将雏鸡翅膀展开可看到两排羽毛,靠近翅膀尖端的为主翼羽,靠近翅膀根部覆盖在主翼羽上端的羽毛称为覆主翼羽,主翼羽长于覆主翼羽称为快羽(母鸡),反之为慢羽(公鸡)。该方法主要缺点:刚出生的小鸡羽毛未完全发育,快慢羽方法准确率低;快慢羽方法只针对特定种类的鸡有用,方法不具备普适性。

翻肛鉴别是目前行业通用做法。其原理是通过观察肛门内部公母鸡特征差异,区分公母。公母鸡肛门主要差异表现为:

翻肛鉴别目前存在的问题:

由于公母特征差别非常小,导致鉴别师培训困难,往往需要三个月时间才能基本学会,一年后鉴别准确率才能达到95%以上;公母特征点形状非常小,且需要在强光下才能看见,长时间观察对人眼伤害大;人工分类准确度不高,一般在95%左右;人工分类速度不快,一般为每小时1000-1200只,很难满足企业的生产需求;人工易疲劳,工作到后面准确率和速度会明显下降。

发明内容

本发明提供的一种基于视觉的鸡雏公母智能鉴别方法及系统,通过视觉成像技术,拍摄鸡雏肛门,再通过鉴别模型,判别鸡雏公母,取代了人眼判别的功能,解放人眼;以克服现有技术的缺陷。

本发明提供一种基于视觉的鸡雏公母智能鉴别方法,包括以下步骤:

步骤A、采集若干个鸡雏肛门处的图像,构成鸡雏公母图像数据集。

步骤B、建立鸡雏公母鉴别模型。

步骤B-1、建立基础鉴别网络模型。

建立位置标签:鸡雏公母图像数据集中每个图像标注鸡雏肝门位置标签。

建立性别标签:鸡雏公母图像数据集中每个图像标注鸡雏公母性别标签。

特征提取:采用CNN多层神经网络提取鸡雏公母图像数据集中每个图像的鸡雏公母的高维特征图。

定位网络:根据鸡雏公母的高维特征图和位置标签,采用回归网络输出肛门的位置信息。

鉴别网络:根据鸡雏公母的高维特征图、位置信息和性别标签,作为CNN多层神经网络分类模型的输入,建立基础鉴别网络模型。

步骤B-2、基础鉴别网络模型进行多任务模型学习,获得针对N鸡种的N个鸡雏公母鉴别模型。

步骤C、采集待测鸡雏肛门处的图像并输入相应鸡种的鸡雏公母鉴别模型,鸡雏公母鉴别模型输出公母的判断结果。

进一步,本发明提供一种基于视觉的鸡雏公母智能鉴别方法,还可以具有这样的特征:位置信息为输出坐标(X、Y)以及半径。

进一步,本发明提供一种基于视觉的鸡雏公母智能鉴别方法,还可以具有这样的特征:步骤B-2包括以下步骤:

步骤B-2-1、将多个品种的鸡雏肛门数据合并为一整个数据集。

步骤B-2-2、在基础鉴别网络模型中使用特征提取网络加定位网络在整个数据集上面进行学习,保存模型。

步骤B-2-3、基于B-2-2保存的模型,固定定位网络参数,在整个数据集上训练特征提取网络和分类网络,保存模型。

步骤B-2-4、循环执行步骤B-2-2和步骤B-2-3设定的次数,保存模型。

步骤B-2-5、基于B-2-4保存的模型采用多任务损失函数,在所有数据集上训练整个模型。

步骤B-2-6、将图像数据按照鸡的品种区分,针对每个品种,基于步骤B-2-5的模型,采用迁移学习,在对应的品种的数据集上继续训练,获得最终的针对N个鸡种鸡雏公母鉴别模型。

进一步,本发明提供一种基于视觉的鸡雏公母智能鉴别方法,还可以具有这样的特征:定位网络采用的损失函数是Smooth L1损失,公式如下:

其中,x为预测值,y为位置标签值,N为一次训练的图片数。

进一步,本发明提供一种基于视觉的鸡雏公母智能鉴别方法,还可以具有这样的特征:鉴别网络采用的损失函数是交叉熵损失,公式如下:

其中N为一次训练的图片数,C为类别,p为真实概率分布,q为预测概率分布。

进一步,本发明提供一种基于视觉的鸡雏公母智能鉴别方法,还可以具有这样的特征:步骤B-2中,多任务模型学习的综合损失函数如下:

Loss=α*Loss

其中,α和β是权重。

另外,发明提供一种基于视觉的鸡雏公母智能鉴别系统,包括光学成像模块和鸡雏公母鉴别模块;光学成像模块:采集若干个鸡雏肛门处的图像,构成鸡雏公母图像数据集;鸡雏公母鉴别模块:根据鸡雏公母图像数据集中每个图像标注鸡雏肝门位置标签;根据鸡雏公母图像数据集中每个图像标注鸡雏公母性别标签;采用CNN多层神经网络提取鸡雏公母图像数据集中每个图像的鸡雏公母的高维特征图;根据鸡雏公母的高维特征图和位置标签,采用回归网络输出肛门的位置信息;根据鸡雏公母的高维特征图、位置信息和性别标签,作为CNN多层神经网络分类模型的输入,建立基础鉴别网络模型;鸡雏公母鉴别模块:还根据基础鉴别网络模型进行多任务模型学习,获得针对N鸡种的N个鸡雏公母鉴别模型;光学成像模块采集待测鸡雏肛门处的图像并输入鸡雏公母鉴别模块中,鸡雏公母鉴别模块根据相应鸡种的鸡雏公母鉴别模型,判断输出公母结果。

进一步,发明提供一种基于视觉的鸡雏公母智能鉴别系统,还可以具有这样的特征:光学成像模块包括相机、镜头、光源和支架;相机、镜头、光源固定在支架上;支架的位置可调节。

本发明提供一种基于视觉的鸡雏公母智能鉴别方法及系统,提升了鸡雏公母鉴别的准确率,提升到98%左右;解决了由于人眼长时间工作导致准确率降低的问题,模型计算不会疲劳;与配套设备组合,鉴别速度比人工更快,能够达到每小时1400只,效率更高。

附图说明

图1是实施例中的光学成像模块的机构示意图。

图2是实施例中的鸡雏肛门位置的图像。

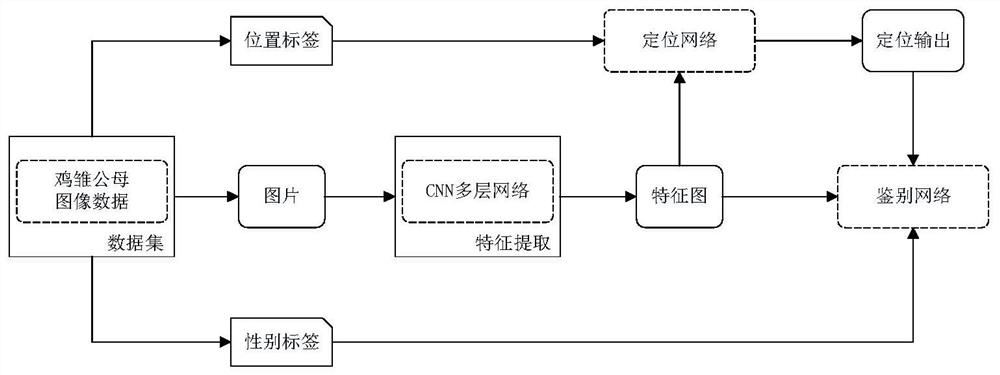

图3是实施例中基础鉴别网络模型的架构图。

图4是实施例中基于视觉的鸡雏公母智能鉴别的工作流程图。

具体实施方式

下面结合附图和具体实施例对本发明做进一步的描述。

实施例

本实施例中,基于视觉的鸡雏公母智能鉴别系统,包括光学成像模块和鸡雏公母鉴别模块。光学成像模块获取采集若干个鸡雏肛门处的图像,构成鸡雏公母图像数据集。鸡雏公母鉴别模块根据鸡雏公母图像数据集基础鉴别网络模型,再根据基础鉴别网络模型进行多任务模型学习,获得针对N鸡种的N个鸡雏公母鉴别模型。光学成像模块采集待测鸡雏肛门处的图像并输入鸡雏公母鉴别模块中,鸡雏公母鉴别模块根据相应鸡种的鸡雏公母鉴别模型,判断输出公母结果。

如图1所示,本实施例中光学成像模块包括相机2、镜头3、光源4触发开关5和支架构成。支架包括固定座1a和旋转板1b;旋转板1b与固定座1a可旋转连接,通过紧固件调节位置以及固定位置。相机2、镜头3、光源4触发开关5按顺序自上而下固定在旋转板1b上。成像点位6位于光源4的正下方。

相机2采用高清工业相机;镜头3采用远心镜头,利用远心镜头的视差纠正特性,使得鸡雏肛门这种不在一个平面上的物体得以成像清晰;光源4采用高角度环型光源,使得光源更加集中与鸡雏肛门处,成像效果更加饱满,如图2所示。

基于视觉的鸡雏公母智能鉴别系统的鉴别方法包括以下步骤:

步骤A、光学成像模块采集若干个鸡雏肛门处的图像,构成鸡雏公母图像数据集。

步骤B、鸡雏公母鉴别模块建立鸡雏公母鉴别模型,分为建立基础鉴别网络模型、多任务模型学习和损失函数三大步骤,具体如下:

步骤B-1、建立基础鉴别网络模型,如图3所示:

建立位置标签:鸡雏公母图像数据集中每个图像标注鸡雏肝门位置标签。

建立性别标签:鸡雏公母图像数据集中每个图像标注鸡雏公母性别标签。

特征提取:采用CNN多层神经网络提取鸡雏公母图像数据集中每个图像的鸡雏公母的高维特征图;该特征用于后续的定位及鉴别网络。

定位网络:根据鸡雏公母的高维特征图和位置标签,采用回归网络输出肛门的位置信息;该位置信息用于后续的鉴别网络。本实施例中位置信息为输出坐标(X、Y)以及半径构成一个圆形的选定区域。

鉴别网络:根据鸡雏公母的高维特征图、位置信息和性别标签,作为CNN多层神经网络分类模型的输入,建立基础鉴别网络模型。

步骤B-2、基础鉴别网络模型进行多任务模型学习,获得针对N鸡种的N个鸡雏公母鉴别模型。

由基础鉴别网络模型结构可以看出,采用的模型属于多任务输出模型,该模型采用的学习策略叫多任务学习(MTL:Multi-task learning)。此外,由于不同品种的鸡雏肛门特征有细微差异,针对这种情况,对不同的鸡种采用迁移学习的方法生成对应的模型,从而提高各个品种的识别率。步骤B-2的多任务模型学习包括以下步骤:

步骤B-2-1、将多个品种的鸡雏肛门数据合并为一整个数据集。

步骤B-2-2、在基础鉴别网络模型中使用特征提取网络加定位网络在整个数据集上面进行学习,保存模型。

步骤B-2-3、基于B-2-2保存的模型,固定定位网络参数,在整个数据集上训练特征提取网络和分类网络,保存模型。

步骤B-2-4、循环执行步骤B-2-2和步骤B-2-3复训练模型3次数,保存模型。

步骤B-2-5、基于B-2-4保存的模型采用多任务损失函数,在所有数据集上训练整个模型。

步骤B-2-6、将图像数据按照鸡的品种区分,针对每个品种,基于步骤B-2-5的模型,采用迁移学习,在对应的品种的数据集上继续训练,获得最终的针对N个鸡种鸡雏公母鉴别模型。

本实施例中,定位网络采用的损失函数是Smooth L1损失,公式如下:

其中,x为预测值,y为位置标签值,N为一次训练的图片数。

本实施例中,鉴别网络采用的损失函数是交叉熵损失,公式如下:

其中N为一次训练的图片数,C为类别,p为真实概率分布,q为预测概率分布。

本实施例中,多任务模型学习的综合损失函数如下:

Loss=α*Loss

其中,α和β是权重。

步骤C、如图4所示,鸡雏公母的公母的鉴别流程为:

触发开关5触发采集信号,相机采集待测鸡雏肛门处的图像,并将采集到的图像进行图像欲处理,如增强处理等。处理后的图像输入相应鸡种的鸡雏公母鉴别模型中,鸡雏公母鉴别模型输出公母的判断该鸡雏的公母并输出结果。

以上所描述的实施例仅仅是本发明一部分实施例,而非全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其它实施例,都属于本发明保护的范围。

- 基于视觉的鸡雏公母智能鉴别方法及系统

- 一种基于无人机的智能视觉分析系统、智能视觉分析系统及方法