基于孪生网络的多模板视觉目标跟踪方法

文献发布时间:2023-06-19 10:08:35

技术领域

本发明属于机器视觉领域,具体涉及一种基于孪生网络的视觉目标跟踪方法。

背景技术

随着经济技术的发展和人们生活水平的提高,摄像设备已经随处可见,同时机器视觉技术也已经广泛应用于人们的生产和生活当中,给人们的生产和生活带来了无尽的便利。

视觉目标跟踪是机器视觉领域的基础技术,旨在提取视频中感兴趣目标的位置和尺度信息。近期,基于孪生网络的跟踪方法在该领域取得巨大的进步。此类方法的核心思想是把目标跟踪任务转化为相似度匹配任务:以视频初始帧中的目标作为模板,以视频后续帧作为搜索帧,分别用全卷积神经网络提取特征,最后对模板特征和搜索特征进行互相关计算,得到响应图,从响应图的峰值信息中便可以得出目标的位置信息。

然而,现有的孪生网络跟踪方法,仅以第一帧的目标作为模板,难以应对目标在复杂场景下的外观变化,从而丢失目标的位置,造成视觉目标跟踪的失败。

发明内容

本发明的目的在于提供一种可靠性高、有效性好且易于实施的基于孪生网络的视觉目标跟踪方法。

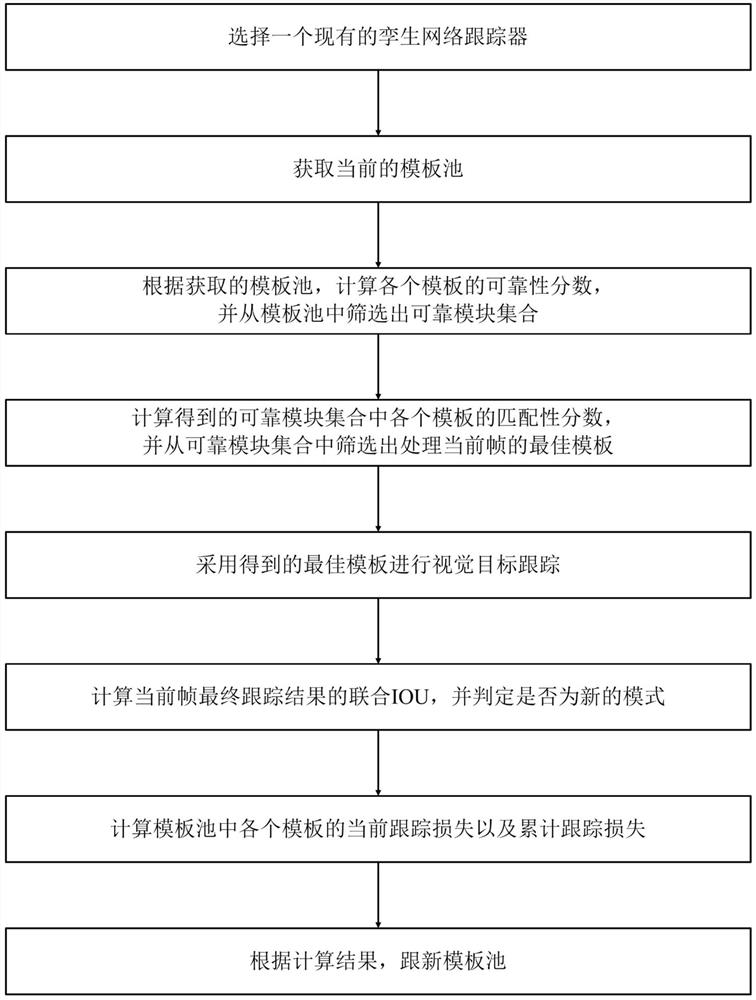

本发明提供的这种基于孪生网络的视觉目标跟踪方法,包括如下步骤:

S1.选择一个现有的孪生网络跟踪器;

S2.获取当前的模板池;

S3.根据步骤S2获取的模板池,计算各个模板的可靠性分数,并从模板池中筛选出可靠模板集合;

S4.计算步骤S3得到的可靠模块集合中各个模板的匹配性分数,并从可靠模块集合中筛选出处理当前帧的最佳模板;

S5.采用步骤S4得到的最佳模板进行视觉目标跟踪。

所述的基于孪生网络的视觉目标跟踪方法,还包括如下步骤:

S6.计算当前帧最终跟踪结果的联合IOU,并判定是否为新的模式;

S7.计算模板池中各个模板的当前跟踪损失以及累计跟踪损失;

S8.根据步骤S6的计算结果和步骤S7的计算结果,跟新模板池。

步骤S1所述的现有的孪生网络跟踪器,具体包括Siamese-FC、Siamese-RPN、SiamMask和Siamfc++。

步骤S2所述的模板池,具体为模板池为一个集合S,其中每一项都包含若干与模板相关的信息;集合S表示为S={(z

步骤S3所述的计算各个模板的可靠性分数,并从模板池中筛选出可靠模块集合,具体为采用如下步骤得到各个模板的可靠性分数并得到可靠模板集合:

A.采用孪生网络的基准网络提取模板图像的深度特征

B.采用如下算式计算模板池S中各个模板的可靠性分数s

s

式中f

C.采用如下规则选取模板,从而得到可靠模板集合G

式中s

步骤S4所述的计算步骤S3得到的可靠模块集合中各个模板的匹配性分数,并从可靠模块集合中筛选出处理当前帧的最佳模板,具体为采用如下步骤计算匹配性分数并获取最佳模板:

a.计算可靠模板集合中各个模板的分类分数m

b.选取步骤a中匹配性分数最大的模板,即id=argmax

步骤S6所述的计算当前帧最终跟踪结果的联合IOU,并判定是否为新的模式,具体为采用如下步骤计算联合IOU并判定新的模式:

(1)采用如下算式计算模板图像z

式中,I

(2)采用如下算式计算联合IOU:

式中I

(3)采用如下规则判断新的模式:

若I

若I

步骤S7所述的计算模板池中各个模板的当前跟踪损失以及累计跟踪损失,具体为采用如下步骤计算当前跟踪损失和累计跟踪损失:

1)采用如下算式计算模板池中的模板在当前帧的跟踪损失:

式中

2)采用如下算式计算累计跟踪损失:

式中

步骤S8所述的根据步骤S6的计算结果和步骤S7的计算结果,跟新模板池,具体为用模板z

本发明提供的这种基于孪生网络的视觉目标跟踪方法,不需要重新训练网络,只需要进行额外的模板选择和模板更新计算即可实现视觉目标跟踪,因此本发明方法不仅能够实现更好的跟踪性能,而且易于实施,可靠性高,有效性好。

附图说明

图1为本发明方法的方法流程示意图。

具体实施方式

如图1所示为本发明方法的方法流程示意图:本发明提供的这种基于孪生网络的视觉目标跟踪方法,包括如下步骤:

S1.选择一个现有的孪生网络跟踪器;比如Siamese-FC、Siamese-RPN、SiamMask、Siamfc++等;任意选择一个现有跟踪器即可;

S2.获取当前的模板池;模板池中的模板表示目标的不同外观;

具体为模板池为一个集合S,其中每一项都包含若干与模板相关的信息;集合S表示为S={(z

从视频的初始帧开始运行算法,当模板集S中的模板数目小于K时,直接把当前帧的跟踪结果作为新模板放入集合S中;当模板集S中的模板数目大于K时,进行更新模板集合的操作;

S3.根据步骤S2获取的模板池,计算各个模板的可靠性分数,并从模板池中筛选出可靠模块集合;具体为采用如下步骤得到各个模板的可靠性分数并得到可靠模板集合:

A.采用孪生网络的基准网络提取模板图像的深度特征

B.采用如下算式计算模板池S中各个模板的可靠性分数s

s

式中f

C.采用如下规则选取模板,从而得到可靠模板集合G

式中s

S4.计算步骤S3得到的可靠模块集合中各个模板的匹配性分数,并从可靠模块集合中筛选出处理当前帧的最佳模板;具体为采用如下步骤计算匹配性分数并获取最佳模板:

a.计算可靠模板集合中各个模板的分类分数m

b.选取步骤a中匹配性分数最大的模板,即id=argmax

S5.采用步骤S4得到的最佳模板进行视觉目标跟踪;

S6.计算当前帧最终跟踪结果的联合IOU,并判定是否为新的模式;具体为采用如下步骤计算联合IOU并判定新的模式:

(1)采用如下算式计算模板图像z

式中,I

(2)采用如下算式计算联合IOU:

式中I

(3)采用如下规则判断新的模式:

若I

若I

S7.计算模板池中各个模板的当前跟踪损失以及累计跟踪损失;具体为采用如下步骤计算当前跟踪损失和累计跟踪损失:

1)采用如下算式计算模板池中的模板在当前帧的跟踪损失:

式中

2)采用如下算式计算累计跟踪损失:

式中

S8.根据步骤S6的计算结果和步骤S7的计算结果,跟新模板池;具体为用模板z

以下,结合实验结果,说明本发明性能的优越性:

实验结果

本发明在步骤S1中选取Siamese-FC、Siamese-RPN和SiamMask作为基本孪生网络跟踪器,在OTB数据集上进行实验;实验结果表明了本发明能有效的改进孪生网络跟踪器的性能。本发明在OTB数据集上的实验结果如表1所示,使用的硬件平台如表2所示,软件平台如表3所示,Precision和AUC为OTB数据集设定的两项指标(越大越好),X-MT为配置了本发明所述内容的跟踪器。

表1实验结果示意表

表2硬件平台示意表

表3软件平台示意表

通过上述实验可以看到,本发明方法具有更优秀的性能。

- 基于孪生网络的多模板视觉目标跟踪方法

- 一种基于困难样本挖掘的孪生网络单目标视觉跟踪方法