一种基于深度学习的智能船舶安全监控方法及系统

文献发布时间:2023-06-19 18:29:06

技术领域

本发明涉及船舶安全监控技术领域,特别涉及一种基于深度学习的智能船舶安全监控方法及系统。

背景技术

长久以来,安全是船舶在海上航行过程中的第一要务。保障船舶安全是每名船员的责任和义务,确保船员的行为和人身安全也是保障船舶安全的重要环节。当前的安全管理工作主要以人为监管的方式进行,通过浏览监控设备的数据,对未造成事故的安全隐患进行排查和预警,对已发生的安全事故进行查证和追责。随着时代发展,这种传统方式的弊端逐渐显现,不仅工作效率不高,而且要耗费大量的人力物力,难以满足现代化智能船舶安全管理。如何保证船员的行为安全性,以及智能船舶安全管理的统一化是目前航运领域高度重视和亟待解决的问题。

目前,随着人工智能技术的不断发展和普及,越来越多的船公司和科研机构致力于将人工智能技术融入到船舶安全监测系统中。中国专利公开号CN113657201A公开了一种船员行为监测分析方法、装置、设备及存储介质,用于及时对船员的行为进行监测,识别船员的行为并及时报警。中国专利公开号CN113486843A公开了一种基于改进YOLOv3的多场景船员不安全行为检测发放,可以实现对不同场景下船员的6种不安全行为进行检测。中国专利公开号CN114419607A公开了一种船舶驾驶舱内非规范行为检测方法和系统,有利于船舶驾驶舱内非规范行为的实时预警和制止。关于上述几项专利所公开的船舶安全监测相关的系统和方法,对于检测船舶安全具有一定帮助,但仍然存在以下3个问题:

监测范围不够全面。中国专利公开号CN113486843A公开的技术仅仅针对船员的6种不安全行为进行检测;中国专利公开号CN114419607A公开的技术用于检测船舶驾驶舱内的非规范行为。现有船舶安全检测相关的技术发明局限在仅对船员的行为进行检测,而实际船舶安全监测范围不仅仅包括船员违规行为或者不安全行为,还应考虑船员人身安全、船上环境安全等。

监测流程不够完备。智慧船舶安全监测系统设计的目的之一便是让监测流程自动化,从发现事件到证据搜查,再到事件处置,除了事件处置必须依靠人力,前面的过程均可利用人工智能技术让机器自动实现。现有技术仅将发现事件的过程自动化,而忽视了证据搜查。目前,结合目标跟踪技术和行人检索技术便能够实现证据搜查的自动化。

监测效率有待提升。中国专利公开号CN113657201A公开的技术利用船员行为的图像分类模型识别船员的行为;中国专利公开号CN113486843A公开的技术改进了目标检测模型YOLOv3网络来检测船员行为。目前基于视频的行为识别技术越来越成熟,而现有技术发明的监测方法仍停留在使用图像分类和目标检测来对人的行为进行识别的阶段,不仅没有提升监测效率,也降低了整个过程的自动化水平。

为了推动船舶智能化的发展,实现船舶安全管理和人工智能技术的高效融合,构建一个完整的、全面的、高效的智能船舶安全监控系统是目前航运领域高度重视和亟待解决的问题。

发明内容

针对现有技术的缺陷,本发明提出了一种基于深度学习的智能船舶安全监控方法及系统,着重解决现有智能船舶安全监控系统中的监测范围不全面、监测流程不完备以及监测效率不高这三个问题。

为了达到上述目的,本发明提出了一种基于深度学习的智能船舶安全监控方法,包括:

(1)构建深度学习模型及所需训练数据集,所述深度学习模型包括目标检测模型、行为识别模型及行人检索模型,使用所述训练数据集完成模型训练;

(2)获取船舶上监控设备采集的数据,包括图像数据及视频数据;

(3)将采集的所述图像数据输入所述目标检测模型,识别所述图像数据中的目标,若检测结果存在直接状态目标,则执行步骤5;若检测结果存在行为状态目标,则执行步骤4;

(4)将采集的所述视频数据输入所述行为识别模型,识别所述视频数据中船员的行为;

(5)若发生事件为紧急事件,则直接产生警报;若发生事件为一般事件,则执行步骤6;

(6)对涉事船员目标进行跟踪,跟踪过程中利用人脸检测模型采集船员人脸数据,获取到清晰的涉事船员人脸图像后,停止跟踪;

(7)建立人脸识别网络,对比收集的涉事船员人脸图像和船员人脸数据库中的图像,确认船员身份,并同上述步骤采集的数据作为证据保存,告警提示。

进一步的,所述目标检测模型使用的是YOLOv5模型;所述行为识别模型使用的是SlowFast模型;所述行人重识别模型使用的CAL模型。

进一步的,所述直接状态目标包括安全帽、火源和倒地人员中至少一项,该类目标在某一时刻存在,即可判定为事件发生。

进一步的,所述行为状态目标包括香烟、手机或打斗状态人员中至少一项,该类目标在某一时刻存在,需要通过所述行为识别模型做进一步的检测。

进一步的,所述紧急事件包括发现火源和重要岗位缺勤中至少一项。

进一步的,所述一般事件包括工程作业时未佩戴安全帽和重要岗位抽烟中至少一项。

进一步的,所述步骤6中对涉事船员目标进行跟踪具体为:

(6.1)单摄像头跟踪:同一摄像头场景下的船员目标跟踪可以利用单目标跟踪算法进行,采集船员的图像序列,若在船员目标离开摄像头视野范围前仍未采集到清晰的船员人脸图像,则进行跨摄像头跟踪;

(6.2)跨摄像头跟踪:首先确定附近区域的摄像头点位,通过所述目标检测模型检测出现船员的场景,并利用单目标跟踪算法进行跟踪,采集连续的船员图像序列,将采集的图像序列与前一摄像头的序列通过所述行人重识别模型进行匹配,得分最高的序列定为涉事船员的序列;

(6.3)利用所述人脸检测模型采集船员人脸数据,获取到清晰的涉事船员人脸图像后,停止跟踪。

进一步的,所述单目标跟踪算法使用KCF单目标跟踪算法,所述人脸检测模型使用的是LFFD模型。

进一步的,所述步骤7中的人脸识别网络使用的是FaceNet。

本发明还提供了一种基于深度学习的智能船舶安全监控系统,包括:

监控数据采样模块:用于获取船舶上监控设备采集的数据,包括图像数据及视频数据;

船上目标检测模块:用于搭载目标检测模型,将采集的所述图像数据输入所述目标检测模型,识别所述图像数据中的目标;

船员行为识别模块:用于搭载行为识别模型,将采集的所述视频数据输入所述行为识别模型,识别所述视频数据中船员的行为;

船员目标跟踪模块:用于对涉事船员目标进行跟踪,跟踪过程中利用人脸检测模型采集船员人脸数据,获取到清晰的涉事船员人脸图像后,停止跟踪;

船员身份匹配模块:用于搭载人脸识别网络,对比收集的涉事船员人脸图像和船员人脸数据库中的图像,确认船员身份,并同上述步骤采集的数据作为证据保存,告警提示。

本发明的有益效果:

1、全面的监测范围:本发明能够用于监测船上发生的多种事件,此外,即使因为涉事船员从甲板进入船舱而脱离原摄像头视野范围,本方法也能通过跨摄像头跟踪技术实现对涉事船员的全面跟踪。

2、完备的自动化流程:本发明首先通过目标检测算法和行为识别算法对不安全事件进行检测;再利用目标跟踪算法对涉事船员目标进行跟踪,必要时可配合目标检测和行人重识别算法实现跨摄像头跟踪;跟踪过程中,依靠人脸检测算法捕捉涉事船员人脸图像;最后通过人脸特征提取网络完成船员身份确认。从发现事件到证据搜查,整个过程全部交由计算机实现。

3、高效的监测能力:本发明抛开了以往使用图像分类或目标检测来对船员行为进行识别,而是使用基于视频的行为识别模型直接识别船员行为。利用目标检测和行为识别算法实现安全监测这一主要功能,并配合目标跟踪和人脸匹配算法实现对目标船员检索。系统所搭载的模型使用的是在各自领域上效果比较突出的代表模型。

基于上述优势和特点,本发明可在船舶安全监控领域广泛应用。本发明将促进智慧船舶领域的发展,尤其是船舶安全管理方面,能够及时发现安全隐患,有效地减少船舶安全事故总量,确保船舶和船员安全得到保证,推动航运业安全生产稳定发展。

附图说明

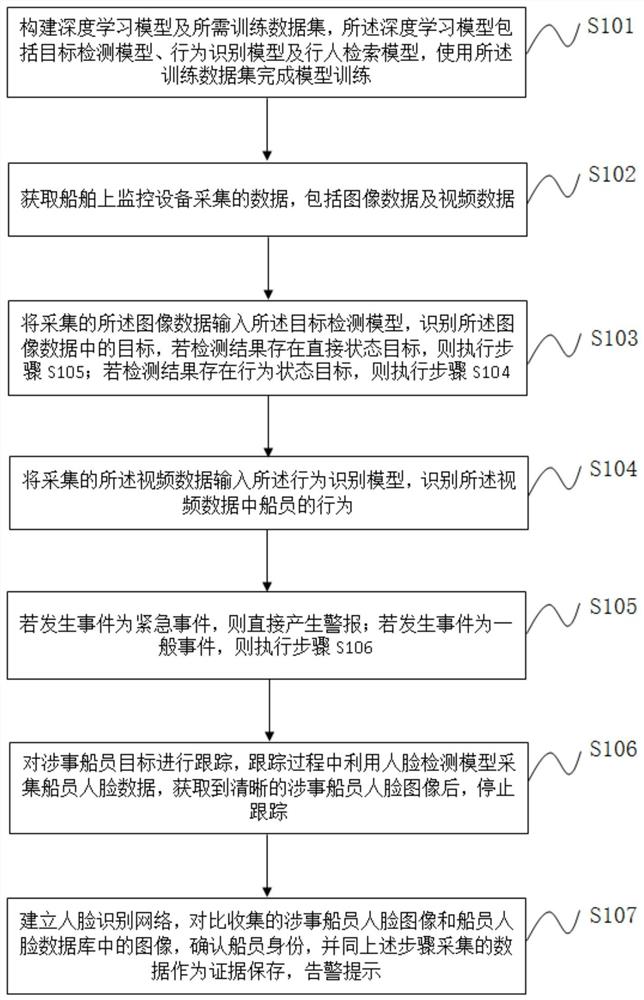

图1是本发明实施例基于深度学习的智能船舶安全监控方法的流程示意图。

图2是本发明实施例基于深度学习的智能船舶安全监控系统的架构示意图。

图3是本发明实施例基于深度学习的智能船舶安全监控方法监测过程的流程示意图。

图4是本发明实施例使用的YOLOv5模型架构示意图。

图5是本发明实施例使用的SlowFast模型架构示意图。

图6是本发明实施例使用的LFFD模型架构示意图。

图7是本发明实施例使用的CAL模型训练结构示意图。

图8是本发明实施例使用的FaceNet网络框架示意图。

具体实施方式

为了清楚地阐明本发明的技术方案和特点,下面结合附图及具体实施方式,对本发明进行更详细的介绍。

如图1和图2所示,本实施例中提供了一种基于深度学习的智能船舶安全监控方法及系统,该方法包括如下步骤:

S101、构建深度学习模型及所需训练数据集,所述深度学习模型包括目标检测模型、行为识别模型及行人检索模型,使用所述训练数据集完成模型训练;

数据集构建:需要收集船载监控摄像头的图像数据以及视频数据,分别构建不同模型所对应的数据集。

模型训练:利用所述数据集构建模块得到的数据集,分别训练基于摄像头图像的目标检测模型M1、基于视频的行为识别模型M2以及基于视频的行人重识别模型M3。

其中,模型M1和M2使用的数据集是由船载监控摄像头记录的数据处理构建的,摄像头分辨率为1920*1080,采集的视频片段时长平均为5秒,假定5秒钟能够确认一个动作的发生;M3使用的是公开的行人重识别数据集训练的。

目标检测模型使用的是YOLOv5模型,如图4所示。YOLOv5模型是YOLO(You OnlyLook Once)系列模型的代表之一,从YOLOv1到YOLOv5,该模型在许多方面都做出了巨大的改进,在YOLOv5中比较值得一提的几种改进技术:

一是模型Backbone采用的Focus结构,对图片进行切片操作,效果类似于下采样,该结构的作用在于保证特征不丢失的同时,减少模型的参数量和计算量。

二是CSP(Cross Stage Partial)结构,这一结构在YOLOv4中只应用于Backbone,而YOLOv5则将该结构拓展为两种形态分别应用于Backbone和Neck中,极大地降低了模型的计算和内存成本,同时保证其准确性。

三是在模型输入端使用了一种自适应图片缩放方法,原始的缩放方法会导致大量信息冗余问题的存在,从而影响模型的推理速度,自适应的图片缩放方法,会给缩放之后的图片添加最少量的黑边,避免信息冗余,从而提升模型的推理速度。

行为识别模型使用了SlowFast模型。如图5所示,SlowFast模型是一种用于视频识别的双分支结构模型,当中的Slow分支负责捕获空间语义信息,该分支以较低的帧速率和较慢的刷新速率运行,而Fast分支负责捕捉快速变化的运动,该分支以快速的刷新速率和高时间分辨率运行,两个分支通过横向连接融合。

Slow分支可以是任何一种卷积模型,其关键概念在于输入帧的大时间跨度s,表示每s帧数只处理其中一帧,s值通常为16。假设Slow分支采样后有t帧,则原始剪辑长度为s*t帧。

Fast分支与Slow分支平行,该分支具有三个特性。一是高帧率,解释为Fast分支采样更快,以s/n的步长采样,其中n为两个分支的帧速率比,Fast分支采样密度是Slow分支的n倍,n值通常为8。二是高时间分辨率特征,表现为在Fast分支中,不使用时间降采样层。三是低通道容量,Fast分支通过减少通道容量而变得非常轻量,是Slow分支通道数的m倍,m值通常为1/8,这也表示Fast分支的计算效率更高。

Slow分支和Fast分支之间通过横向连接进行融合,横向连接是一种融合不同层次空间分辨率和语义的常用技术。

行人重识别模型使用的是CAL模型,CAL模型是一种用于换装行人重识别的模型,对识别穿着相同的不同行人而言,也具有很好的精度。由于船员的服装基本统一,传统的行人重识别模型受到服装外观等因素的影响较大,故不能适用于船员的重识别。CAL模型的主要特点在于基于服装的对抗性损失函数(Clothes-based Adversarial Loss,CAL),通过惩罚模型对服装的预测能力,从原始RGB图像中挖掘与服装无关的特征。如图7所示,除了身份分类器之外,CAL模型中还有一个额外的服装分类器。在学习过程中,基于服装的对抗性损失会强迫骨干网络去挖掘与服装无关的特征。

S102、获取船舶上监控设备采集的数据,包括图像数据及视频数据;

具体实施时,所述获取的数据为视频数据,图片数据通过截取视频数据得到,不同数据类型的数据将输入到对应模型中进行检测。采样的图像数据分辨率大小为1920*1080,视频片段时长平均为20秒。

S103、将采集的所述图像数据输入所述目标检测模型,识别所述图像数据中的目标,若检测结果存在直接状态目标,则执行步骤S105;若检测结果存在行为状态目标,则执行步骤S104;

具体实施时,所述目标检测模型为基于图像的目标检测模型,通过对图片数据进行识别,检测出图像当中的目标位置和种类,根据检测的目标不同,执行不同流程。

所述目标检测模型识别的目标分为两类,分别为:

直接状态目标T1。该类目标在某一时刻的存在状态,即可判定为事件发生,所述直接状态目标至少包括安全帽、火源和倒地人员。

行为状态目标T2。该类目标在某一时刻的存在状态,不足以确认事件发生,需要通过行为识别模型做进一步的检测,所述行为状态目标至少包括香烟、手机和打斗状态人员。

两种目标分类的依据为,目标在某一时刻的存在状态,是否能够判定事件发生。在系统监测的事件中,船员违规行为多数需要依靠对视频进行行为分析来判定,比如船员在岗位上睡觉的行为,如果只是通过目标检测模型对某一时刻的图像进行识别,那船员在眨眼时的闭眼状态,会被模型误认为是船员在睡觉,所以需要行为识别模型来对视频做进一步分析。而船上环境安全的相关事件,比如发现火源,当目标检测模型识别到图像中存在火源时,则可以直接判定存在危险事件。

S104、将采集的所述视频数据输入所述行为识别模型,识别所述视频数据中船员的行为;

具体实施时,所述行为识别模型为基于视频分析的行为识别模型,主要用于识别船员的不规范行为,至少包括吸烟、玩手机和打架斗殴。行为识别模型会接收采样的视频数据,再结合目标检测模型生成的目标信息,进一步对视频中的行为事件进行检测识别。

S105、若发生事件为紧急事件,则直接产生警报;若发生事件为一般事件,则执行步骤S106;

具体实施时,系统监测的事件分为两类,分别为:

紧急事件E1。该类事件可能引发较为严重的事故,需要及时提醒管理人员并解决,证据探查工作可以在解决事件之后进行,所述紧急事件至少包括发现火源和重要岗位缺勤。

一般事件E2。该类事件存在一定的安全隐患,需要及时提醒管理人员并记录事件发生过程,所述一般事件多为船员违规行为,至少包括工程作业时未佩戴安全帽和重要岗位抽烟。

不同类型的事件,处置流程也会不同,比如发现火源,发生此类事件,需要及时告警,派遣相关人员及时处置;而出现工程作业时未佩戴安全帽的情形,可以先探查证据,保留视频数据的同时,利用人脸识别技术将涉事船员的信息与身份库中的信息做匹配,探明涉事船员的身份。

S106、对涉事船员目标进行跟踪,跟踪过程中利用人脸检测模型采集船员人脸数据,获取到清晰的涉事船员人脸图像后,停止跟踪;

具体实施时,对涉事船员目标进行跟踪包括:

单摄像头跟踪。同一摄像头场景下的船员目标跟踪可以利用单目标跟踪算法进行,采集船员的图像序列,若在船员目标离开摄像头视野范围前仍未采集到清晰的船员人脸图像,则进行跨摄像头跟踪。

跨摄像头跟踪。首先确定附近区域的摄像头点位,通过目标检测模型检测出现船员的场景,并利用单目标跟踪算法进行跟踪,采集连续的船员图像序列,将采集的图像序列与前一摄像头的序列通过行人重识别模型进行匹配,得分最高的序列定为涉事船员的序列,继续跟踪,直到采集到清晰的船员人脸图像。

单目标跟踪算法使用的是KCF单目标跟踪算法,其基本思想是:寻找一个滤波模板,让下一帧图像与选择的滤波模板做卷积,响应最大的区域则是预测目标。基于核化相关滤波器(Kernelized Correlation Filters,KCF)的跟踪算法是本模块采取的方法,其利用循环矩阵对角化等性质使得目标跟踪高速且准确。

人脸检测模型使用的是LFFD模型,LFFD模型是一种适用于人脸、行人、车辆等目标的新型单目标检测模型,模型使用感受野(Receptive Field)替代了Anchors,也是一种Anchor-free的方法。其主要优势在于:一是通过添加更多卷积层,可以覆盖更大尺度的目标,而增加的延迟有限;二是检测小目标能力突出;三是网络结构常见,可以部署到主流端侧设备,对于本系统有着很好的适配性。LFFD模型的网络结构如图6所示,模型主要由tinypart、small part、medium part和large part四个部分组成,在基础模型结构上分别抽取8路特征图对从小到大的人脸进行检测,检测模块分为二分类和边界回归。

S107、建立人脸识别网络,对比收集的涉事船员人脸图像和船员人脸数据库中的图像,确认船员身份,并同上述步骤采集的数据作为证据保存,告警提示。

具体实施时,建立人脸识别网络,通过匹配涉事船员人脸图像和船员人脸数据库中的人脸图像特征,确认船员身份,保存以往所获数据作为证据,同时告警提示。人脸识别网络使用的是FaceNet。FaceNet是一个可以用于人脸验证、人脸识别和人脸聚类的通用识别网络,其通过深度卷积神经网络学习将图像映射到欧几里得空间,空间距离直接和人脸图像相似度相关:同一个人的不同图像在空间距离很小,不同人的图像在空间中有较大的距离。在确定得到图像的特征映射关系之后,人脸识别即是一种K-NN分类问题。FaceNet的整体框架如图8所示,其中主体模型采用一个深度网络Inception ResNet-v2。

根据另一方面的实施例,还提供了一种基于深度学习的智能船舶安全监控系统,包括:

监控数据采样模块:用于获取船舶上监控设备采集的数据,包括图像数据及视频数据;

船上目标检测模块:用于搭载目标检测模型,将采集的所述图像数据输入所述目标检测模型,识别所述图像数据中的目标;

船员行为识别模块:用于搭载行为识别模型,将采集的所述视频数据输入所述行为识别模型,识别所述视频数据中船员的行为;

船员目标跟踪模块:用于对涉事船员目标进行跟踪,跟踪过程中利用人脸检测模型采集船员人脸数据,获取到清晰的涉事船员人脸图像后,停止跟踪;

船员身份匹配模块:用于搭载人脸识别网络,对比收集的涉事船员人脸图像和船员人脸数据库中的图像,确认船员身份,并同上述步骤采集的数据作为证据保存,告警提示。

最后应当说明的是:以上所述仅为本发明较佳的具体实施方式,但本发明的保护范围并不局限于此,任何根据本发明的技术方案及其发明构思加以替换、修改或改进等,均应涵盖在本发明的保护范围之内。

- 一种基于深度学习的智能雨棚系统及其控制方法

- 一种基于智能视频分析技术的加油站卸油过程安全监控方法

- 一种人工智能地深度学习实现系统及方法

- 一种基于YOLOv3深度学习网络的图像智能标注方法

- 一种基于云数据中心的船舶安全监控方法及船舶安全监控系统

- 一种基于深度学习的智能安防系统及用于智能安防系统的深度学习方法