一种基于生成对抗网络的交互式孔探数据扩展方法

文献发布时间:2023-06-19 11:35:49

技术领域

本发明涉及数据扩展领域,尤其涉及一种基于生成对抗网络的交互式孔探数据扩展方法。

背景技术

数据扩展(Data Augmentation)是在深度神经网络训练阶段无需增加计算成本即可增强模型性能的最实用方法之一。数据扩展可分为两类:一类是使用传统的数据变换方法,例如文献[1]介绍的随机裁剪算法一定程度上可以使网络对待检测目标的尺度信息更加不敏感,由此提升网络对小物体的识别效果;文献[2]介绍的随机擦除算法可以达到类似随机裁剪的目的;几何转换算法包括平移,缩放,仿射变换,透视变换等经典的数据扩展算法,是最受欢迎的数据扩展方法之一;文献[3]介绍的色彩空间变换算法则可以通过色彩抖动等形式模拟不同的光照,色温环境,提高模型对图像色彩的鲁棒性;文献[4]介绍的神经风格转换算法则可以改变图像的风格,纹理等特征。合理使用这些方法可以达到快速扩充数据集并在一定程度上增强模型鲁棒性的目的。

但对于目标检测任务来说,这些方法只是对图像的表现形式进行了改变,并没有增加样本空间中待检测目标的比例,不能解决数据集内待检测目标不均匀分布的问题。因此需要采用另一类数据扩展方法:数据重采样方法。数据重采样方法是指在模型训练前或模型训练时,对样本多的类别采样频率减少,对样本少的类别采样频率增大,从而使各类类别样本数目维持在较为平衡的水平。文献[5]通过双向重采样技术提高了人脸检测模型的精度。目前数据重采样方法则主要集中于新实例的合成。例如文献[6]提出的图像混合方法,通过插值对离散样本空间进行连续化,提高了邻域内的平滑性;文献[7]提出的特征空间扩展方法通过将数据变换应用到特征层面,从而获得了更为合理的合成数据;文献[8]、文献[9]则通过使用GAN(生成对抗网络)生成图像的方法生成了一些较为真实的样本用于深度学习任务中。这些方法可以生成新的扩展图像,但新生成的扩展图像没有像素级的标签,只能人工再次标注,或仅用于图像的分类任务。

在目标检测任务中像素级的标签信息十分重要。文献[10]提出了一种用场景图像及带标签的目标实例进行随机合成的方法,但实验发现,如果忽略场景的上下文信息,不考虑目标实例是否能够出现在场景中的特定位置,只是对目标实例与图像随机组合,并不能达到提高检测精度的目的,甚至可能会降低模型的性能。

参考文献

[1]Liu W,Anguelov D,Erhan D,et al.SSD:Single shot multibox detector[C]//European conference on computer vision.Springer,Cham,2016:21-37.

[2]Zhong Z,Zheng L,Kang G,et al.Random Erasing Data Augmentation[C]//AAAI.2020:13001-13008.

[3]Shorten C,Khoshgoftaar T M.A survey on image data augmentation fordeep learning[J].Journal of Big Data,2019,6(1):60.

[4]Jing Y,Yang Y,Feng Z,et al.Neural style transfer:A review[J].IEEEtransactions on visualization and computer graphics,2019.

[5]李文辉,姜园媛,王莹等.一种基于重采样双向2DLDA融合的人脸识别算法[J].电子学报,2011,39(11):2526-2533.

[6]Zhang H,Cisse M,Dauphin Y N,et al.mixup:Beyond Empirical RiskMinimization[C]//International Conference on Learning Representations.2018.

[7]DeVries T,Taylor G W.Dataset augmentation in feature space[J].arXiv preprint arXiv:1702.05538,2017.

[8]Antoniou A,Storkey A,Edwards H.Data augmentation generativeadversarial networks[J].arXiv preprint arXiv:1711.04340,2017.

[9]Wang Y X,Girshick R,Hebert M,et al.Low-shot learning fromimaginary data[C]//Proceedings of the IEEE conference on computer vision andpattern recognition.2018:7278-7286.

[10]Dvornik N,Mairal J,Schmid C.Modeling visual context is key toaugmenting object detection datasets[C]//Proceedings of the EuropeanConference on Computer Vision(ECCV).2018:364-380.

[11]Steiner B,Devito Z,Chintala S,et al.PyTorch:An Imperative Style,High-Performance Deep Learning Library[C].neural information processingsystems,2019:8026-8037.

[12]Deng J,Dong W,Socher R,et al.ImageNet:A large-scale hierarchicalimage database[C].computer vision and pattern recognition,2009:248-255.

[13]Krizhevsky A,Sutskever I,Hinton G E,et al.ImageNet Classificationwith Deep Convolutional Neural Networks[C].neural information processingsystems,2012:1097-1105.

[14]Radford A,Metz L,Chintala S,et al.Unsupervised RepresentationLearning with Deep Convolutional Generative Adversarial Networks[C].international conference on learning representations,2016.

[15]Canny J.A Computational Approach to Edge Detection[J].IEEETransactions on Pattern Analysis and Machine Intelligence,1986,8(6):679-698.

[16]Perez P,Gangnet M,Blake A,et al.Poisson image editing[C].international conference on computer graphics and interactive techniques,2003,22(3):313-318.

[17]Land E H,Mccann J J.Lightness and Retinex Theory[J].Journal ofthe Optical Society of America,1971,61(1):1-11.

发明内容

本发明提供了一种基于生成对抗网络的交互式孔探数据扩展方法,提供了生成对抗网络及P网络的构建及训练,并采用交互式界面由使用者选择生成缺陷的类型,形状及位置;使用经过训练的P网络模型将形状信息编码成隐向量;通过生成对抗网络生成器解码,生成指定形状的缺陷;采用手动调整阈值的方式对生成图像中的缺陷进行分割;使用泊松融合算法对融合边缘进行修正,详见下文描述:

一种基于生成对抗网络的交互式孔探数据扩展方法,所述方法包括:

将缺陷图像按缺陷类型分类,保存在相应文件夹中,构建航空发动机孔探图像数据集,基于深度卷积构建生成对抗网络模型结构;

训练生成对抗网络模型,获取一或多个生成不同缺陷的发动机孔探缺陷图像生成器;

构建P网络,输入训练样本中的形状信息,编码成发动机孔探缺陷图像生成器识别的隐向量,使用AlexNet模型第四卷积层的特征对P网络进行训练;

基于隐向量、发动机孔探缺陷图像生成器、获取指定形状的生成图像,通过训练后的P网络进行测试;

构建交互式基本框架并使用自适应阈值分割缺陷,使用泊松融合算法修正融合区域边缘痕迹。

其中,所述缺陷类型分为裂缝、烧蚀、磨损、及涂层丢失四类,分别为每类缺陷单独训练生成模型。

进一步地,所述P网络包括5个卷积层,第一卷积层用于将64*64*3的图片卷积为32*32*128的张量;第二卷积层用于将32*32*128的张量卷积为16*16*256的张量,第三卷积层用于将16*16*256的张量卷积为8*8*512的张量,第四卷积层用于将8*8*512的张量卷积为4*4*1024的张量;最后一卷积层用于将4*4*1024的张量卷积为100维的向量。

其中,所述输入训练样本中的形状信息,编码成发动机孔探缺陷图像生成器识别的隐向量,使用AlexNet模型第四卷积层的特征对P网络进行训练具体为:

提取训练样本的形状信息,并按训练样本及对应的形状信息构建图像对;将形状信息输入P

隐向量经发动机孔探缺陷图像生成器解码后生成缺陷图像;加载基于Imagenet数据集训练的AlexNet模型,对生成的缺陷图像提取conv4层的特征;对形状信息对应的训练样本提取conv4层特征;

计算两个conv4层特征的最小均方值误差作为P

进一步地,所述目标函数具体为:

其中,C为AlexNet的conv4层特征,G

其中,所述使用训练好的P网络进行测试具体为:

将指定的输入形状I

D

其中,D

进一步地,所述构建交互式基本框架并使用自适应阈值分割缺陷具体为:

选择对应的缺陷生成器,实时获取用户输入的笔画,并将其提取为输入形状;通过P

再将D

实时更改Canny中的低阈值τ,通过设置高阈值调整不同缺陷图像分割的结果。

其中,所述方法还包括:基于Pyqt5框架构建交互界面。

本发明提供的技术方案的有益效果是:

1、本发明构建生成对抗网络,使用孔探图像数据集作为训练样本,学习航空发动机缺陷图像的分布,得到可以生成指定类型缺陷且效果逼真的发动机孔探缺陷图像生成器;

2、本发明构建P网络模型,用于将输入图像的形状信息编码成隐向量;使用发动机孔探缺陷图像生成器对隐向量进行解码,可以生成与输入图像形状相近的缺陷;

3、本发明对P网络模型编码得到的隐向量进行微小的噪声扰动,可以得到多张形状相似但细节不同的缺陷图像;

4、本发明采用自适应阈值的方式对生成缺陷进行分割,并采用泊松融合算法修正融合区域边缘,生成的新发动机图像无融合痕迹,缺陷生成位置符合缺陷发生机理,且可以自动生成标注信息,生成的发动机数据集经专业人员检测表现优异;

5、本发明设计出交互式数据扩展模块,并结合了生成对抗网络、P网络和泊松融合算法各自的优势,使得生成的图像更符合项目开发的需要。

附图说明

图1为本发明提出的P网络模型的训练流程示意图;

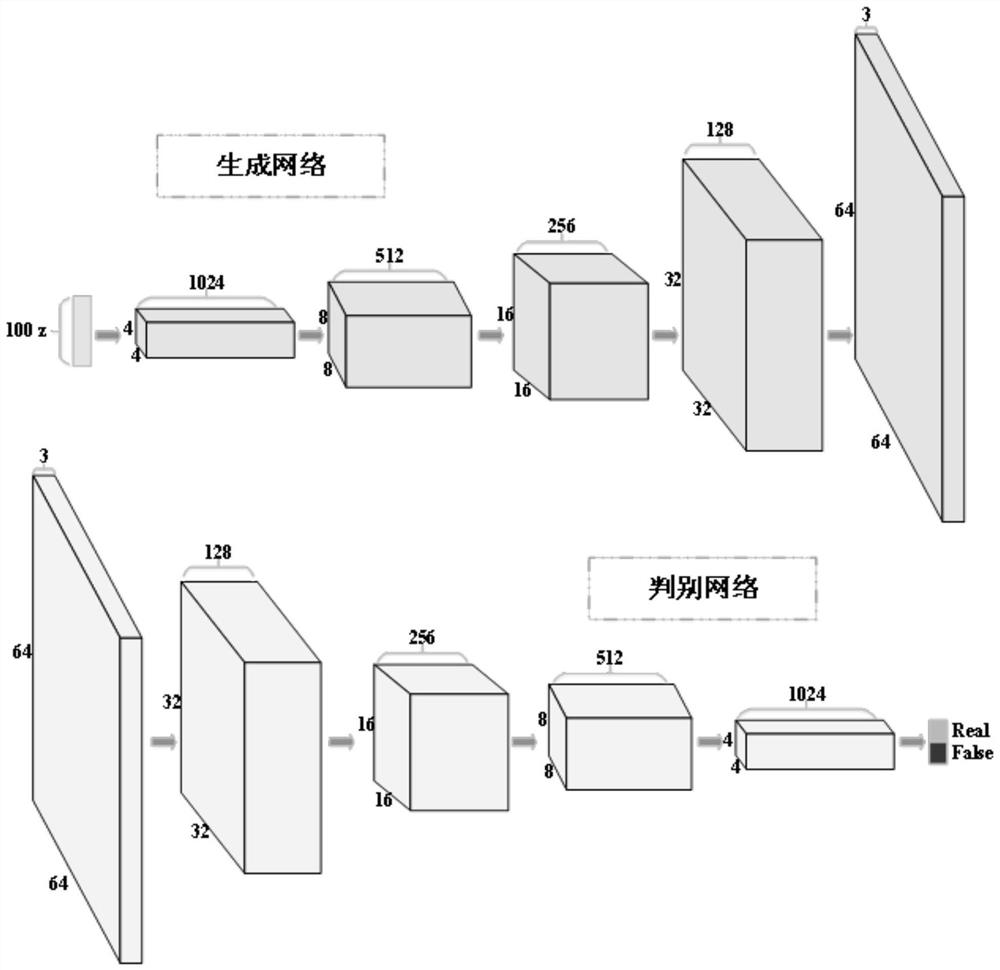

图2为本发明使用的生成对抗网络结构示意图;

图3为本发明提出的P网络模型结构图;

图4为本发明提出的交互式数据扩展模块的流程示意图;

图5为本发明设计的交互式界面示意图;

图6为本发明提出的实时调整分割阈值得到的不同阈值下的分割结果及其扩展图像示意图;

图7为本发明提出方法生成的航空发动机孔探图像对比图。

具体实施方式

为使本发明的目的、技术方案和优点更加清楚,下面对本发明实施方式作进一步地详细描述。

本方法针对航空发动机孔探图像中的缺陷检测问题提出了基于生成对抗网络的交互式孔探数据扩展方法,可以在航空发动机孔探图像背景上生成待检测的目标,并使其更加接近真实的图像。

实施例1

一种基于生成对抗网络的交互式孔探数据扩展方法,参见图1、图4,该方法包括以下步骤:

一、构建航空发动机孔探图像训练集,并训练生成对抗网络

该步骤具体为:读取带有标注信息的发动机孔探图像,将缺陷信息从发动机孔探图像中截取出来并分别保存为只含有缺陷信息的缺陷图像和含有背景信息的缺陷图像(即2种缺陷类型),并将这两类缺陷图像再次按缺陷类型分类,保存在不同文件夹下,以此构建航空发动机孔探图像训练集。

本发明实施例中将航空发动机缺陷分为裂缝、烧蚀、磨损、及涂层丢失四类,分别为每类缺陷单独训练生成模型。其中,在训练裂缝生成模型时,考虑到裂缝缺陷长宽比较大的特征,将其以较短边为基准,对较长边进行裁剪,将狭长的裂缝图像裁剪为多张正方形图像,经过人工筛选后保留了550张裂缝缺陷图像作为训练集。其余缺陷长宽较为接近,则直接采用缩放的形式保证长宽尺寸的一致,经筛选后共保留了烧蚀图像902张,磨损图像206张,涂层丢失图像1712张。本发明实施例以上述数值为例进行说明,具体实现时,本发明实施例对此不做限制。

本发明实施例中的生成对抗网络训练流程参见图1中的训练GAN部分,生成对抗网络模型结构采用参考文献[14]中所提出的深度卷积生成对抗网络模型DCGAN,其模型结构包括生成网络和判别网络两部分。生成网络包括5个反卷积层,第一个反卷积层用于将100维的隐向量反卷积为4*4*1024的张量,第二个反卷积层用于将4*4*1024的张量反卷积为8*8*512的张量,第三个反卷积层用于将8*8*512的张量反卷积为16*16*256的张量,第四个反卷积层用于将16*16*256的张量反卷积为32*32*128的张量,最后一个反卷积层用于将32*32*128的张量反卷积为64*64*3的图片。生成网络可以将100维的隐向量经过反卷积层生成为64*64*3的图片。

其中,判别网络结构与生成网络结构相反,其模型结构包括5个卷积层,第一个卷积层用于将64*64*3的图片卷积为32*32*128的张量;第二个卷积层用于将32*32*128的张量卷积为16*16*256的张量,第三个卷积层用于将16*16*256的张量卷积为8*8*512的张量,第四个卷积层用于将8*8*512的张量卷积为4*4*1024的张量;最后一个卷积层用于将4*4*1024的张量卷积为2维的向量。判别网络可以将大小为64*64*3的输入图片经过卷积层压缩为2维的向量,并使用2维向量中的第一维表示输入图片为真实图片的概率,第二维表示输入图片为虚假图片(生成网络生成图片)的概率。DCGAN的网络结构如图2所示。

本发明实施例使用Pytorch框架

二、构建并训练P网络

本发明实施例中P网络的训练流程参见图1。其中P网络部分的结构包括5个卷积层,第一个卷积层用于将64*64*3的图片卷积为32*32*128的张量;第二个卷积层用于将32*32*128的张量卷积为16*16*256的张量,第三个卷积层用于将16*16*256的张量卷积为8*8*512的张量,第四个卷积层用于将8*8*512的张量卷积为4*4*1024的张量;最后一个卷积层用于将4*4*1024的张量卷积为100维的向量。P网络结构如图3所示。在训练P网络之前应先完成生成对抗网络的训练,得到一个或多个可以生成不同缺陷且效果逼真的发动机孔探缺陷图像生成器G

发动机孔探缺陷图像生成器G

形式化表示如下:

式中,

其中,隐向量z

其目标函数如下:

其中,C为AlexNet的conv4层特征。分别使用4个不同的缺陷生成器训练4个不同的P

三、使用训练好的P网络进行测试

本发明实施例中的P网络测试流程部分参见图4,将指定的输入形状I

其过程可形式化为:D

其中,D

四、构建交互式基本框架并使用自适应阈值分割缺陷

本发明实施例中交互式流程参见图4,交互界面参见图5,交互式程序运行前,应先保证缺陷图像生成器G

在交互式界面添加事件函数,实时获取使用者想要生成的缺陷类型,选择对应的缺陷生成器G

对于生成的缺陷图像可以使用Canny 1986年提出的Canny边缘检测算法

最后,点击保存按钮将保存当前主界面图像并自动为新样本生成配套的标注信息文件。

五、使用泊松融合算法修正融合区域边缘痕迹

泊松融合算法是Perez等人(2003)

泊松融合算法使背景图像I

该过程可形式化为:

其中,I

六、网络训练和测试

基于Pytorch深度学习网络框架,使用第一步中生成对抗网络模型及数据集进行训练,可以得到生成效果逼真的发动机孔探缺陷图像生成器;使用第二步中所介绍的P网络模型及数据集进行训练得到P网络模型。P网络模型与发动机孔探缺陷图像生成器结合可以生成指定形状的缺陷图像。

基于Pyqt5框架(该框架为python开发环境中的开源库,用于搭建可视化界面,为本领域的公知)构建交互界面,交互界面如图5所示,包括:主界面交互区、小窗口区、缺陷类型选择区、分割阈值调整区、及功能区;

通过主界面交互区显示背景图像,获取用户输入的笔画信息;小窗口区用于展示除主界面之外的其他生成缺陷扩展结果;缺陷类型选择区用于选择用户想要生成的缺陷类型;分割阈值调整区用于手动调整分割阈值,对生成缺陷进行分割,得到像素级的标注信息;功能区通过点击“上一张”、“下一张”按钮选择不同的背景图像,通过点击“更新”按钮实现将用户在主界面区输入的笔画转换成相应的缺陷信息,通过点击“保存”按钮将主界面扩展图像保存至指定文件夹下,并同时生成扩展图像的标注信息。

用户通过交互界面选择想要生成的缺陷;用鼠标在想要生成缺陷的位置处勾勒想要生成缺陷的形状;将笔画形状输入P网络编码为隐向量;将隐向量输入发动机孔探缺陷图像生成器中进行解码,生成指定形状的缺陷;通过分割阈值调整区调整分割阈值得到更为精确的缺陷分割结果,不同阈值的分割结果对比如图6所示;将生成的缺陷图像与背景图像融合,并利用泊松融合算法对分割得到的缺陷边界进行修正,减小融合痕迹,得到带有新缺陷的发动机孔探图像。本发明实施例得到的生成图像如图7所示。

综上所述,本发明实施例用基于生成对抗网络的交互式数据扩展方法,通过构建并训练P网络对输入的形状信息进行编码,得到隐向量;再通过发动机孔探缺陷图像生成器解码,生成指定形状的缺陷图像;并使用调整分割阈值的方法对缺陷图像进行分割,使用泊松融合技术解决图像融合边缘痕迹明显的问题,满足了实际应用中的多种需要。

实施例2

下面结合图6、图7对实施例1中的方案进行可行性验证,详见下文描述:

根据图1、图2、图3所示网络结构及训练流程搭建并训练本发明实施例中的生成对抗网络模型和P网络模型;根据图4,图5所示流程及界面搭建交互式框架,实时获取使用者选择的缺陷类型,缺陷位置及缺陷形状信息;通过P网络模型对形状信息进行编码,再经过生成模型解码生成指定形状的缺陷图像;使用手动调整分割阈值的方式调整缺陷图像的分割结果;并将生成的缺陷图像融合到背景图像中,对融合缺陷图像的边缘区域进行泊松修正,消除融合痕迹。

图5的交互界面中,主界面为背景图像,用户可以在主界面进行笔画的绘制;右侧五个小窗中第一个小窗表示未扩展的原始图像,剩余四个小窗表示与主界面笔画形状相似,但细节不同的多张扩展缺陷图像;下方依次为缺陷类型选择区,用于选择想要生成的缺陷类型;分割阈值调整区,取值为0~255,用于调整生成缺陷的分割阈值;保存按钮,用于保存主界面的扩展后图像,并自动生成扩展图像的标注信息;更新按钮,用于将用户绘制的笔画更新为指定类型的缺陷;上一张按钮、下一张按钮,选择当前文件夹下的其他孔探图像。

从图6中,可以看出本发明实施例可以通过手动调整分割阈值,在生成的缺陷图像上得到不同的分割结果,通过人工微调可以得到较为精确的分割结果,为自动生成标注信息提供参考。

从图7中,可以看出本发明实施例得到的数据扩展结果无明显融合痕迹,样本可用性高。图7中,第一列为原始图像,第二列和第四列为本发明实例生成的图像,第三列和第五列为本实例自动生成的标注信息。从图7的实验对比结果可以看出,相对于现有的对整张图像进行数据扩展的方法,本发明实施例提出的方法可在固定背景上增加检测信息,生成新的训练样本,且新的训练样本的融合区域边界更加平滑自然。

本发明实施例对各器件的型号除做特殊说明的以外,其他器件的型号不做限制,只要能完成上述功能的器件均可。

本领域技术人员可以理解附图只是一个优选实施例的示意图,上述本发明实施例序号仅仅为了描述,不代表实施例的优劣。

以上所述仅为本发明的较佳实施例,并不用以限制本发明,凡在本发明的精神和原则之内,所作的任何修改、等同替换、改进等,均应包含在本发明的保护范围之内。

- 一种基于生成对抗网络的交互式孔探数据扩展方法

- 基于泊松图像融合及图像风格化的交互式数据扩展方法