图像采集方式检测方法、装置、计算机设备和存储介质

文献发布时间:2023-06-19 10:29:05

技术领域

本申请涉及图像处理技术领域,特别是涉及一种图像采集方式检测方法、装置、计算机设备和存储介质。

背景技术

随着图像处理技术的发展,以及互联网金融的日渐推广应用,越来越多的用户通过互联网进行消费、投资理财或借贷等。其中,在互联网金融领域,比如用户进行借贷时,需要用户进行注册、额度申请以及授信审批等,在不同环节用户均需要上传照片,资金提供方比如银行等金融机构,需要对用户上传的照片进行识别,以确认是否为用户本人所为。

传统上多采用将用户在注册时上传的照片,和后续进行额度申请或授信审批等上传的照片进行比对,确定后续上传的照片和注册时上传的照片是否为同一人,来对额度申请以及授信审批进行审核。

然而,由于某些中介代办等在诱导用户注册、额度申请或授信审批时,中介人员往往会替用户拍摄照片,即得到他拍照片,而上传他拍照片的用户存在不知情或被欺骗的情况,对于所进行的金融业务往往具有较大逾期风险,需进行风险管控。而传统上仅采用注册时上传的照片和后续上传的照片进行比对的方式,由于存在他人代拍的情况,无法准确确定出是否为与用户本人进行的操作,相应的风险管控效率有待提升。

发明内容

基于此,有必要针对上述技术问题,提供一种能够提升金融业务的风险管控效率的图像采集方式检测方法、装置、计算机设备和存储介质。

一种图像采集方式检测方法,所述方法包括:

获取待检测图像;

对所述待检测图像进行特征提取,得到与所述待检测图像对应的多维特征;

根据训练好的分类器模型,对所述多维特征进行识别,确定所述待检测图像的图像采集方式。

在其中一个实施例中,所述多维特征包括人脸占比;所述对所述待检测图像进行特征提取,得到与所述待检测图像对应的多维特征,包括:

对所述待检测图像进行人像背景分割,提取对应的人像轮廓特征和人脸轮廓特征;

计算所述人脸轮廓特征和所述待检测图像的第一面积占比,以及所述人像轮廓特征和所述待检测图像的第二面积占比,得到与所述待检测图像对应的人脸占比;所述人脸占比用于确定用户与图像采集设备的距离。

在其中一个实施例中,所述多维特征还包括面部关键点开合角;所述对所述待检测图像进行特征提取,得到与所述待检测图像对应的多维特征,包括:

从所述人脸轮廓特征提取对应的面部关键点;

获取根据所述面部关键点连接得到左/右眼角向量和嘴角向量;

根据所述左/右眼角向量、嘴角向量,分别计算得到对应的眼角开合角、嘴角开合角。

在其中一个实施例中,所述多维特征还包括人脸朝向;所述对所述待检测图像进行特征提取,得到与所述待检测图像对应的多维特征,包括:

从所述面部关键点中提取左/右眼角关键点、左/右嘴角关键点以及鼻尖关键点;

获取所述左/右眼角关键点、左/右嘴角关键点以及鼻尖关键点的像素位置;

根据矩阵运算得到的平移矩阵、旋转矩阵、以及所述左/右眼角关键点、左/右嘴角关键点以及鼻尖关键点的像素位置,计算得到人体头部对应的俯仰角、航向角以及翻滚角;

根据所述人体头部对应的俯仰角、航向角以及翻滚角,确定待检测图像对应的人脸朝向。

在其中一个实施例中,所述多维特征还包括人体上肢关键点夹角;所述对所述待检测图像进行特征提取,得到与所述待检测图像对应的多维特征,包括:

从所述人像轮廓特征提取人体上肢关键点;

获取根据所述人体上肢关键点连接得到的头部向量、肩部向量、上臂向量以及下臂向量;

根据所述头部向量、肩部向量、上臂向量以及下臂向量,分别计算得到头部与肩部的第一夹角、肩部与上臂的第二夹角以及上臂与下臂的第三夹角;

根据所述第一夹角、第二夹角和第三夹角,得到与所述待检测图像对应的人体上肢关键点夹角。

在其中一个实施例中,所述图像采集方式包括自拍和他拍;所述根据训练好的分类器模型,对所述多维特征进行识别,确定所述待检测图像的图像采集方式,包括:

根据训练好的分类器模型,对所述人脸占比、面部关键点开合角、人脸朝向以及人体上肢关键点夹角进行识别,确定所述人脸占比、面部关键点开合角、人脸朝向以及人体上肢关键点夹角携带的采集方式标签;

根据所识别到的采集方式标签,确定所述待检测图像的图像采集方式。

在其中一个实施例中,生成训练好的分类器模型,包括:

获取不同图像采集方式下的历史图像,以及相应图像采集方式下的历史图像携带的预设采集方式标签;所述预设采集方式标签包括自拍标签和他拍标签;

提取不同图像采集方式下的所述历史图像对应的多维特征;

根据所述多维特征和对应所述预设采集方式标签,生成训练样本集;

根据所述训练样本集对原始决策树模型进行训练,生成训练好的分类器模型。

一种图像采集方式检测装置,所述装置包括:

待检测图像获取模块,用于获取待检测图像;

多维特征获取模块,用于对所述待检测图像进行特征提取,得到与所述待检测图像对应的多维特征;

图像采集方式确定模块,用于根据训练好的分类器模型,对所述多维特征进行识别,确定所述待检测图像的图像采集方式。

一种计算机设备,包括存储器和处理器,所述存储器存储有计算机程序,所述处理器执行所述计算机程序时实现以下步骤:

获取待检测图像;

对所述待检测图像进行特征提取,得到与所述待检测图像对应的多维特征;

根据训练好的分类器模型,对所述多维特征进行识别,确定所述待检测图像的图像采集方式。

一种计算机可读存储介质,其上存储有计算机程序,所述计算机程序被处理器执行时实现以下步骤:

获取待检测图像;

对所述待检测图像进行特征提取,得到与所述待检测图像对应的多维特征;

根据训练好的分类器模型,对所述多维特征进行识别,确定所述待检测图像的图像采集方式。

上述图像采集方式检测方法、装置、计算机设备和存储介质中,通过获取待检测图像,并对所述待检测图像进行特征提取,得到与所述待检测图像对应的多维特征,进而根据训练好的分类器模型,对所述多维特征进行识别,确定所述待检测图像的图像采集方式。上述方法中通过对待检测图像的图像采集方式进行识别,可确定出具体的图像采集方式,进而准确确定出是否为与用户本人进行的操作,避免出现大量他拍照片的高风险用户,识别潜在业务逾期风险,进一步提升金融业务的风险管控效率。

附图说明

图1为一个实施例中图像采集方式检测方法的应用环境图;

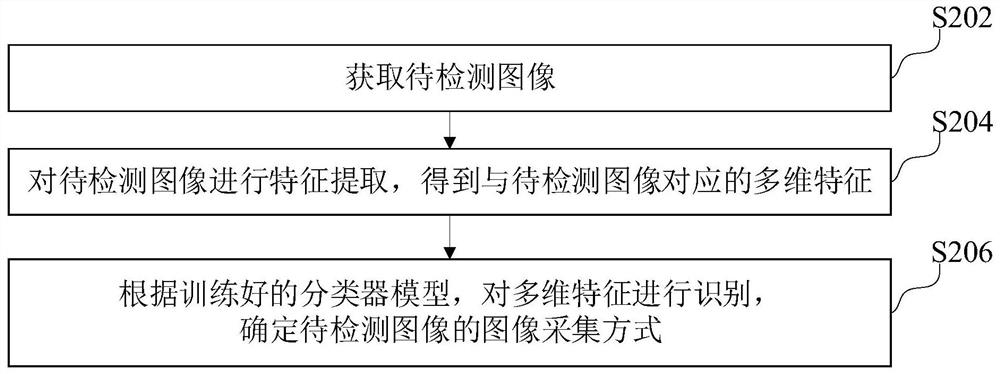

图2为一个实施例中图像采集方式检测方法的流程示意图;

图3为一个实施例中人像背景分割示意图;

图4为一个实施例中人脸轮廓特征提取示意图;

图5为一个实施例中面部关键点提取示意图;

图6为一个实施例中得到与待检测图像对应的多维特征的流程示意图;

图7为一个实施例中坐标关系对应示意图;

图8为一个实施例中人脸3D关键点与2D关键点对应关系示意图;

图9为一个实施例中人体头部姿态角示意图;

图10为另一个实施例中得到与待检测图像对应的多维特征的流程示意图;

图11为一个实施例中人体骨骼关键点示意图;

图12为一个实施例中人体上肢关键点检测示意图;

图13为一个实施例中生成训练好的分类器模型的流程示意图;

图14为另一个实施例中图像采集方式检测方法的流程示意图;

图15为一个实施例中图像采集方式检测装置的结构框图;

图16为一个实施例中计算机设备的内部结构图。

具体实施方式

为了使本申请的目的、技术方案及优点更加清楚明白,以下结合附图及实施例,对本申请进行进一步详细说明。应当理解,此处描述的具体实施例仅仅用以解释本申请,并不用于限定本申请。

本申请提供的图像采集方式检测方法,可以应用于如图1所示的应用环境中。其中,终端102与服务器104通过网络进行通信。服务器102通过获取用户通过终端102上传的待检测图像,并对待检测图像进行特征提取,得到与待检测图像对应的多维特征,进而根据训练好的分类器模型,对多维特征进行识别,确定待检测图像的图像采集方式。其中,终端102可以但不限于是各种个人计算机、笔记本电脑、智能手机、平板电脑和便携式可穿戴设备,服务器104可以用独立的服务器或者是多个服务器组成的服务器集群来实现。

在一个实施例中,如图2所示,提供了一种图像采集方式检测方法,以该方法应用于图1中的服务器为例进行说明,包括以下步骤:

步骤S202,获取待检测图像。

具体地,待检测图像可以由用户从所在终端设备上传至服务器。其中,接收到用户上传的待检测图像后,还需判断是否包括人像,即还需判断是否为其他环境图像或者其他物体图像,如果是非人像图片则需剔除,并生成提示信息,以提示用户重新上传。

步骤S204,对待检测图像进行特征提取,得到与待检测图像对应的多维特征。

其中,与待检测图像对应的多维特征包括人脸占比、面部关键点开合角、人脸朝向以及人体上肢关键点夹角。

具体地,通过对待检测图像进行人像背景分割,提取对应的人像轮廓特征和人脸轮廓特征,计算人脸轮廓特征和待检测图像的第一面积占比,以及人像轮廓特征和待检测图像的第二面积占比,得到与待检测图像对应的人脸占比。

进一步地,如图3所示,通过采用语义分割算法对待检测图像进行人像背景分割,将人像轮廓和背景分离,并计算得到人像轮廓内像素点面积为S

其中,人脸占比用于确定用户与图像采集设备的距离,当待检测图像中第一面积占比越大或第二面积占比越大时,则表示该用户与摄图像采集设备的距离越近,一般来说,他拍照片拍摄距离要远于自拍照片。

在一个实施例中,对待检测图像进行特征提取,得到与待检测图像对应的多维特征,包括:

从人脸轮廓特征提取对应的面部关键点,并获取根据面部关键点连接得到左/右眼角向量和嘴角向量,进而根据左/右眼角向量、嘴角向量,分别计算得到对应的眼角开合角、嘴角开合角,得到面部关键点开合角。

其中,通过从人脸轮廓特征提取68个面部关键点,所提取的关键点顺序如图5所示,参照图5可知,根据提取的面部关键点,可连接得到左/右眼角向量和嘴角向量,进而根据左/右眼角向量、嘴角向量,分别计算得到对应的眼角开合角、嘴角开合角,得到面部关键点开合角。

进一步地,参照图5,以左眼角为例,左眼角的关键点位置是45(x0,y0),与45点临近的上下两点分别是44(x1,y1)、46(x2,y2),44-45构成向量V1(x1-x0,y1-y0),46-45构成向量V2(x2-x0,y2-y0),通过以下公式(1)和公式(2)计算得到左眼角开合角θ:

θ=arccosθ; (2)

其中,针对右眼角开合角,以及左/右嘴角开合角计算过程,和上述左眼角开合角的计算过程类似,仅调整涉及到的关键点的像素为止即可。

在一个实施例中,对待检测图像进行特征提取,得到与待检测图像对应的多维特征,还包括:

从面部关键点中提取左/右眼角关键点、左/右嘴角关键点以及鼻尖关键点;获取左/右眼角关键点、左/右嘴角关键点以及鼻尖关键点的像素位置;根据矩阵运算得到的平移矩阵、旋转矩阵、以及左/右眼角关键点、左/右嘴角关键点以及鼻尖关键点的像素位置,计算得到人体头部对应的俯仰角、航向角以及翻滚角;根据人体头部对应的俯仰角、航向角以及翻滚角,确定待检测图像对应的人脸朝向。

在一个实施例中,对待检测图像进行特征提取,得到与待检测图像对应的多维特征,还包括:

从人像轮廓特征提取人体上肢关键点获取根据人体上肢关键点连接得到的头部向量、肩部向量、上臂向量以及下臂向量;根据头部向量、肩部向量、上臂向量以及下臂向量,分别计算得到头部与肩部的第一夹角、肩部与上臂的第二夹角以及上臂与下臂的第三夹角;根据第一夹角、第二夹角和第三夹角,得到与待检测图像对应的人体上肢关键点夹角。

步骤S206,根据训练好的分类器模型,对多维特征进行识别,确定待检测图像的图像采集方式。

具体地,根据训练好的分类器模型,对人脸占比、面部关键点开合角、人脸朝向以及人体上肢关键点夹角进行识别,确定人脸占比、面部关键点开合角、人脸朝向以及人体上肢关键点夹角携带的采集方式标签;根据所识别到的采集方式标签,确定待检测图像的图像采集方式。

其中,图像采集方式包括自拍和他拍,根据训练好的分类器模型,可对所提取的多维特征,即人脸占比、面部关键点开合角、人脸朝向以及人体上肢关键点夹角等,进行识别,确定所识别的各多维特征携带的采集方式标签,其中,采集方式标签包括自拍标签和他拍标签。进而根据所识别到的自拍标签或他拍标签,确定待检测图像的图像采集方式是自拍或者他拍。

进一步地,在获取用户上传的待检测图像的同时,获取用户所在设备终端的地理位置信息,地理位置信息确定用户所在地理区域,并在识别到同一地理区域的多个用户所上传的待检测图像的图像采集方式均为他拍时,对该地理区域的各用户进行重点风险管控。

上述图像采集方式检测方法中,通过获取待检测图像,并对待检测图像进行特征提取,得到与待检测图像对应的多维特征,进而根据训练好的分类器模型,对多维特征进行识别,确定待检测图像的图像采集方式。上述方法中通过对待检测图像的图像采集方式进行识别,可确定出具体的图像采集方式,进而准确确定出是否为与用户本人进行的操作,避免出现大量他拍照片的高风险用户,识别潜在业务逾期风险,进一步提升金融业务的风险管控效率。

在一个实施例中,如图6所示,得到与待检测图像对应的多维特征的步骤,即对待检测图像进行特征提取,得到与待检测图像对应的多维特征的步骤,具体包括:

步骤S602,从面部关键点中提取左/右眼角关键点、左/右嘴角关键点以及鼻尖关键点。

步骤S604,获取左/右眼角关键点、左/右嘴角关键点以及鼻尖关键点的像素位置。

具体地,通过从所提取的68个面部关键点中,提取出左/右眼角关键点、左/右嘴角关键点以及鼻尖关键点,并获取左/右眼角关键点、左/右嘴角关键点以及鼻尖关键点的像素位置,进而将所提取的5个关键点确定为人脸2D关键点。

步骤S606,根据矩阵运算得到的平移矩阵、旋转矩阵、以及左/右眼角关键点、左/右嘴角关键点以及鼻尖关键点的像素位置,计算得到人体头部对应的俯仰角、航向角以及翻滚角。

其中,平移矩阵表示物体相对于相机的空间位置关系矩阵,用T表示,旋转矩阵:物体相对于相机的空间姿态关系矩阵,用R表示。其中,世界坐标系(UVW)、相机坐标系(XYZ)、图像中心坐标系(uv)以及像素坐标系(xy)之间的对应关系如图7所示,o是图像采集设备即相机的中心,Image Plane表示图像平面。

具体地,参照图8可知,图8中的图8a为3D人脸模型示意图,图8a中的3D关键点位于图7中的世界坐标系,而图8b为2D人脸关键点示意图,图8b中的人脸2D关键点位于图7中的像素坐标系,进而通过匹配3D人脸模型,得到人脸2D关键点和匹配出的3D人脸模型内的对应关键点的转换关系。

其中,参照图7可知,针对相机坐标系(XYZ)和图像中心坐标系(uv),X轴和Y轴与成像平面坐标系的x轴和y轴平行,Z轴为相机的光轴,与图像平面垂直,光轴和图像平面的交点为图像主点o,由点o和X、Y、Z轴组成的直角坐标系即为相机坐标系(XYZ),点P(X,Y,Z)由通过投影中心的光线投影到图像平面上,相应的图像点为p(x,y,f),其中,f表示焦距,进而根据以下公式(3)描述相机坐标系(XYZ)和图像中心坐标系(uv)的对应关系:

进一步地,像素坐标系(xy)和图像中心坐标系(uv)均在成像平面上,但各自的原点和度量单位不一致,由于(u,v)只代表像素的列数与行数,而像素在图像中的位置并没有用物理单位表示出来,需要建立以物理单位表示的图像坐标系(xy),将相机光轴与图像平面的交点定义为该坐标系的原点,且x轴与u轴平行,y轴与v轴平行。假设(u0,v0)代表在图像中心坐标系(uv)下的坐标,x与y分别表示每个像素在横轴x和纵轴y上的物理尺寸,则图像中的每个像素在图像中心坐标系(uv)中的坐标和在像素坐标系(xy)中的坐标之间都存在如下公式(4)所示的关系:

其中,根据公式(3)和公式(4),推得到点P在相机坐标系(XYZ)和像素坐标系(xy)的对应关系如以下公式(5)所示:

由于平移矩阵表示物体相对于相机的空间位置关系矩阵,用T表示,旋转矩阵:物体相对于相机的空间姿态关系矩阵,用R表示,则当相机完美时,世界坐标系(UVW)到相机坐标系(XYZ)用如下公式(6)进行表述:

进而根据公式(5)和公式(6)推导得到像素坐标系(xy)和世界坐标系(UVW)的对应关系,如以下公式(7)所示:

进一步采用DLT(Direct Linear Transform)算法结合最小二乘法,对上述公式(7)进行迭代求解,得到最小二乘的目标函数J可为以下公式(8)所示:

其中,带^的变量为预测值,其余为测量值,x

综上,当获知关键点在世界坐标系(UVW)中的位置、像素坐标(xy)中的位置,以及相机参数,则可以计算得到旋转矩阵和平移矩阵。对于世界坐标系(UVW)中点的坐标,通过对不同人拟合出对应的3D人脸模型,即可从2D关键点得到3D关键点的坐标,对于像素坐标位置,即为所提取的待检测图像中关键点位置,相机参数同样可预先获取。

在一个实施例中,根据矩阵运算得到的平移矩阵、旋转矩阵、以及左/右眼角关键点、左/右嘴角关键点以及鼻尖关键点的像素位置,采用以下公式(9)、(10)计算得到欧拉角:

其中,

进一步地,根据旋转欧拉角以及各个角对应的旋转矩阵,可计算得到如公式(10)所示的各人体头部姿态角的大小,包括俯仰角Pitch、航向角Yaw以及翻滚角Roll,分别对应上述公式(10)中的β,φ以及γ。

步骤S608,根据人体头部对应的俯仰角、航向角以及翻滚角,确定待检测图像对应的人脸朝向。

具体地,根据所计算得到的人体头部对应的俯仰角、航向角以及翻滚角,确定待检测图像对应的人体头部姿态,参照图9可知,人体头部姿态包括与俯仰角对应的低头抬头、与航向角对应的转头、以及与翻滚角对应的偏头,进而根据所确定的人体头部姿态进一步确定人脸朝向。

本实施例中,通过从面部关键点中提取左/右眼角关键点、左/右嘴角关键点以及鼻尖关键点,并获取左/右眼角关键点、左/右嘴角关键点以及鼻尖关键点的像素位置。进而根据矩阵运算得到的平移矩阵、旋转矩阵、以及左/右眼角关键点、左/右嘴角关键点以及鼻尖关键点的像素位置,计算得到人体头部对应的俯仰角、航向角以及翻滚角,并根据人体头部对应的俯仰角、航向角以及翻滚角,确定待检测图像对应的人脸朝向,能够达到精确计算得出人脸朝向,根据人脸朝向,可初步确定出用户所上传的待检测图像属于他拍还是自拍,一定程度上可以提升图像采集方式的判定准确性。

在一个实施例中,如图10所示,得到与待检测图像对应的多维特征的步骤,即对待检测图像进行特征提取,得到与待检测图像对应的多维特征的步骤,具体包括以下步骤:

步骤S1002,从人像轮廓特征提取人体上肢关键点。

具体地,人体骨骼关键点分布示意图如图11所示,通过从人像轮廓特征对应的人体骨骼关键点中提取人体上肢关键点,具体包括0至7这8个关键点,并对所获取的各关键点进行连接,得到对应的头部向量、肩部向量、上臂向量以及下臂向量。

步骤S1004,获取根据人体上肢关键点连接得到的头部向量、肩部向量、上臂向量以及下臂向量。

具体地,通过连接关键点0和关键点1可得到头部向量,连接关键点1和关键点2可得到第一肩部向量,连接关键点1和关键点5可得到第二肩部向量,连接关键点2和关键点3可得到第一上臂向量,连接关键点3和关键点4可得到第一下臂向量,连接关键点5和关键点6可得到第二上臂向量,连接关键点6和关键点7可得到第二下臂向量。

步骤S1006,根据头部向量、肩部向量、上臂向量以及下臂向量,分别计算得到头部与肩部的第一夹角、肩部与上臂的第二夹角以及上臂与下臂的第三夹角。

具体地,参照图12可知,针对所获取的待检测图像,根据人体上肢关键点连接得到的头部向量、肩部向量、上臂向量以及下臂向量,计算得到头部与肩部的第一夹角、肩部与上臂的第二夹角以及上臂与下臂的第三夹角。

其中,根据上肢关键点连接得到的各向量,具体包括:根据头部向量和第一肩部向量,以及头部向量和第二肩部向量,可计算得到头部与肩部的第一夹角,根据第一肩部向量、第一上臂向量,以及第二肩部向量、第二上臂向量,可计算得到肩部与上臂的第二夹角,同样地,根据第一上臂向量、第一下臂向量,以及第二上臂向量、第二下臂向量,可计算得到上臂与下臂的第三夹角。

进一步地,在本实施例中,参照图12可知,根据头部向量和第二肩部向量计算得到的第一夹角大小为100.94°,根据第一肩部向量和第一上臂向量计算得到的第二夹角为107.02°,根据第二肩部向量和第二上臂向量计算得到的第二夹角为91.19°,根据第一上臂向量和第一下臂向量计算得到的第三夹角为66.99°,根据第二上臂向量和第二下臂向量计算得到的第三夹角为28.71°。

步骤S1008,根据第一夹角、第二夹角和第三夹角,得到与待检测图像对应的人体上肢关键点夹角。

具体地,将根据头部向量和第二肩部向量计算得到的第一夹角大小,根据第一肩部向量、第一上臂向量,以及第二肩部向量、第二上臂向量计算得到的第二夹角,根据第一上臂向量、第一下臂向量,以及第二上臂向量、第二下臂向量计算得到的第三夹角,确定为与待检测图像对应的人体上肢关键点夹角。

本实施例中,通过从人像轮廓特征提取人体上肢关键点,获取根据人体上肢关键点连接得到的头部向量、肩部向量、上臂向量以及下臂向量。进而根据头部向量、肩部向量、上臂向量以及下臂向量,分别计算得到头部与肩部的第一夹角、肩部与上臂的第二夹角以及上臂与下臂的第三夹角,得到与待检测图像对应的人体上肢关键点夹角。实现了根据人体上肢关键点,准备计算得到与待检测图像对应的人体上肢关键点夹角,根据计算得到的人体上肢关键点夹角可初步确定用户上传的待检测图像是属于他拍还是自拍,一定程度上可以提升图像采集方式的判定准确性。

在一个实施例中,如图13所示,生成训练好的分类器模型的步骤,具体包括以下步骤:

步骤S1302,获取不同图像采集方式下的历史图像,以及相应图像采集方式下的历史图像携带的预设采集方式标签。

具体地,预设采集方式标签包括自拍标签和他拍标签,通过获取自拍的图像采集方式下的历史图像,以及他拍的图像采集方式下的历史图像,并获取自拍的图像采集方式下的历史图像携带的自拍标签,以及获取他拍的图像采集方式下的历史图像携带的他拍标签。

步骤S1304,提取不同图像采集方式下的历史图像对应的多维特征。

具体地,提取自拍的图像采集方式下的历史图像、以及他拍的图像采集方式下的历史图像对应的多维特征,均可包括人脸占比、面部关键点开合角、人脸朝向以及人体上肢关键点夹角。

进一步地,每张照片经过特征提取会产生16维特征X,即人照比,人身比,面部左/右眼内眼角角度,面部左/右眼外眼角角度,左/右嘴角角度,头部俯仰角、航向角以及翻滚角,头部与肩部夹角,肩部与左/右上臂夹角,两侧的上臂与下臂夹角,将所提取的16维特征分别命名为X(f1,f2,f3,……,f15,f16)。

步骤S1306,根据多维特征和对应预设采集方式标签,生成训练样本集。

具体地,将所提取到的多维特征X(f1,f2,f3,……,f15,f16),以及预设的自拍或他拍的标签Y(0/1),构成训练样本(X,Y),则n张照片可构成训练样本集((X0,Y0),(X1,Y1),…,(Xn,Yn))。

其中,样本示例如下表所示:

步骤S1308,根据训练样本集对原始决策树模型进行训练,生成训练好的分类器模型。

具体地,根据训练样本集对原始决策树模型进行训练,包括对原始决策树模型内的各模型参数进行调整和修改,得到训练好的分类器模块,用于对待检测图像进行分类,将携带不同预设采集方式标签的待检测图像进行分类,得到预设采集方式标签为自拍标签的自拍图像,以及预设采集方式标签为他拍标签的他拍图像。

在一个实施例中,生成训练好的分类器模型,还可采用以下方式:

初始化每个样本的预测值,并获取预先定义的损失函数;

计算预先定义的损失函数对于每个样本预测值的导数,生成对应的导数信息;

根据导数信息建立新的决策树,并利用新的决策树预测样本值,并累计到原来的样本预测值,直至所累积到的决策树预测样本值达到预设阈值,停止建立新的决策树,将最新的决策树确定为分类器模型。

本实施例中,通过获取不同图像采集方式下的历史图像,以及相应图像采集方式下的历史图像携带的预设采集方式标签,并提取不同图像采集方式下的历史图像对应的多维特征。根据多维特征和对应预设采集方式标签,生成训练样本集,进而根据训练样本集对原始决策树模型进行训练,生成训练好的分类器模型。实现了根据训练样本集对原始决策树模型进行训练,得到可用于对他拍照片和自拍照片进行分类的分类器模型,而无需工作人员手动分类,节省了大量人力成本和时间成本,进一步提高了自拍照片和他拍照片的分类效率。

在一个实施例中,如图14所示,提供了一种图像采集方式检测方法,具体包括以下步骤:

1)获取待检测图像。

2)对待检测图像进行特征提取,得到与待检测图像对应的多维特征。

3)提取到的多维特征包括:人脸占比、面部关键点开合角、人脸朝向以及人体上肢关键点夹角。

4)根据历史图像对应的多维特征和预设采集方式标签,生成训练样本集。

5)根据训练样本集对原始决策树模型进行训练,生成训练好的分类器模型。

6)根据训练好的分类器模型,对待检测图像的多维特征进行识别,确定待检测图像的图像采集方式为自拍或者他拍。

上述图像采集方式检测方法中,通过获取待检测图像,并对待检测图像进行特征提取,得到与待检测图像对应的多维特征,进而根据训练好的分类器模型,对多维特征进行识别,确定待检测图像的图像采集方式。上述方法中通过对待检测图像的图像采集方式进行识别,可确定出具体的图像采集方式,进而准确确定出是否为与用户本人进行的操作,避免出现大量他拍照片的高风险用户,识别潜在业务逾期风险,进一步提升金融业务的风险管控效率。

应该理解的是,虽然上述实施例涉及的各流程图中的各个步骤按照箭头的指示依次显示,但是这些步骤并不是必然按照箭头指示的顺序依次执行。除非本文中有明确的说明,这些步骤的执行并没有严格的顺序限制,这些步骤可以以其它的顺序执行。而且,上述实施例涉及的各流程图中的至少一部分步骤可以包括多个步骤或者多个阶段,这些步骤或者阶段并不必然是在同一时刻执行完成,而是可以在不同的时刻执行,这些步骤或者阶段的执行顺序也不必然是依次进行,而是可以与其它步骤或者其它步骤中的步骤或者阶段的至少一部分轮流或者交替地执行。

在一个实施例中,如图15所示,提供了一种图像采集方式检测装置,包括:待检测图像获取模块1502、多维特征获取模块1504以及图像采集方式确定模块1506,其中:

待检测图像获取模块1502,用于获取待检测图像。

多维特征获取模块1504,用于对待检测图像进行特征提取,得到与待检测图像对应的多维特征。

图像采集方式确定模块1506,用于根据训练好的分类器模型,对多维特征进行识别,确定待检测图像的图像采集方式。

上述图像采集方式检测装置中,通过获取待检测图像,并对待检测图像进行特征提取,得到与待检测图像对应的多维特征,进而根据训练好的分类器模型,对多维特征进行识别,确定待检测图像的图像采集方式。上述方法中通过对待检测图像的图像采集方式进行识别,可确定出具体的图像采集方式,进而准确确定出是否为与用户本人进行的操作,避免出现大量他拍照片的高风险用户,识别潜在业务逾期风险,进一步提升金融业务的风险管控效率。

在一个实施例中,多维特征获取模块还用于:

对待检测图像进行人像背景分割,提取对应的人像轮廓特征和人脸轮廓特征;计算人脸轮廓特征和待检测图像的第一面积占比,以及人像轮廓特征和待检测图像的第二面积占比,得到与待检测图像对应的人脸占比;人脸占比用于确定用户与图像采集设备的距离。

在一个实施例中,多维特征获取模块还用于:

从人脸轮廓特征提取对应的面部关键点;获取根据面部关键点连接得到左/右眼角向量和嘴角向量;根据左/右眼角向量、嘴角向量,分别计算得到对应的眼角开合角、嘴角开合角。

在一个实施例中,多维特征获取模块还用于:

从面部关键点中提取左/右眼角关键点、左/右嘴角关键点以及鼻尖关键点;获取左/右眼角关键点、左/右嘴角关键点以及鼻尖关键点的像素位置;根据矩阵运算得到的平移矩阵、旋转矩阵、以及左/右眼角关键点、左/右嘴角关键点以及鼻尖关键点的像素位置,计算得到人体头部对应的俯仰角、航向角以及翻滚角;根据人体头部对应的俯仰角、航向角以及翻滚角,确定待检测图像对应的人脸朝向。

上述多维特征获取模块,实现了精确计算得出人脸朝向,根据人脸朝向,可初步确定出用户所上传的待检测图像属于他拍还是自拍,一定程度上可以提升图像采集方式的判定准确性。

在一个实施例中,多维特征获取模块还用于:

从人像轮廓特征提取人体上肢关键点;获取根据人体上肢关键点连接得到的头部向量、肩部向量、上臂向量以及下臂向量;根据头部向量、肩部向量、上臂向量以及下臂向量,分别计算得到头部与肩部的第一夹角、肩部与上臂的第二夹角以及上臂与下臂的第三夹角;根据第一夹角、第二夹角和第三夹角,得到与待检测图像对应的人体上肢关键点夹角。

上述多维特征获取模块,实现了根据人体上肢关键点,准备计算得到与待检测图像对应的人体上肢关键点夹角,根据计算得到的人体上肢关键点夹角可初步确定用户上传的待检测图像是属于他拍还是自拍,一定程度上可以提升图像采集方式的判定准确性。

在一个实施例中,图像采集方式确定模块还用于:

根据训练好的分类器模型,对人脸占比、面部关键点开合角、人脸朝向以及人体上肢关键点夹角进行识别,确定人脸占比、面部关键点开合角、人脸朝向以及人体上肢关键点夹角携带的采集方式标签;根据所识别到的采集方式标签,确定待检测图像的图像采集方式。

在一个实施例中,提供了一种图像采集方式检测装置,还包括分类器模型生成模块,用于:

获取不同图像采集方式下的历史图像,以及相应图像采集方式下的历史图像携带的预设采集方式标签;预设采集方式标签包括自拍标签和他拍标签;提取不同图像采集方式下的历史图像对应的多维特征;根据多维特征和对应预设采集方式标签,生成训练样本集;根据训练样本集对原始决策树模型进行训练,生成训练好的分类器模型。

上述图像采集方式检测装置,实现了根据训练样本集对原始决策树模型进行训练,得到可用于对他拍照片和自拍照片进行分类的分类器模型,而无需工作人员手动分类,节省了大量人力成本和时间成本,进一步提高了自拍照片和他拍照片的分类效率。

关于图像采集方式检测装置的具体限定可以参见上文中对于图像采集方式检测方法的限定,在此不再赘述。上述图像采集方式检测装置中的各个模块可全部或部分通过软件、硬件及其组合来实现。上述各模块可以硬件形式内嵌于或独立于计算机设备中的处理器中,也可以以软件形式存储于计算机设备中的存储器中,以便于处理器调用执行以上各个模块对应的操作。

在一个实施例中,提供了一种计算机设备,该计算机设备可以是服务器,其内部结构图可以如图16所示。该计算机设备包括通过系统总线连接的处理器、存储器和网络接口。其中,该计算机设备的处理器用于提供计算和控制能力。该计算机设备的存储器包括非易失性存储介质、内存储器。该非易失性存储介质存储有操作系统、计算机程序和数据库。该内存储器为非易失性存储介质中的操作系统和计算机程序的运行提供环境。该计算机设备的数据库用于存储待检测图像以及与待检测图像对应的多维特征。该计算机设备的网络接口用于与外部的终端通过网络连接通信。该计算机程序被处理器执行时以实现一种图像采集方式检测方法。

本领域技术人员可以理解,图16中示出的结构,仅仅是与本申请方案相关的部分结构的框图,并不构成对本申请方案所应用于其上的计算机设备的限定,具体的计算机设备可以包括比图中所示更多或更少的部件,或者组合某些部件,或者具有不同的部件布置。

在一个实施例中,还提供了一种计算机设备,包括存储器和处理器,存储器中存储有计算机程序,该处理器执行计算机程序时实现上述各方法实施例中的步骤。

在一个实施例中,提供了一种计算机可读存储介质,其上存储有计算机程序,该计算机程序被处理器执行时实现上述各方法实施例中的步骤。

本领域普通技术人员可以理解实现上述实施例方法中的全部或部分流程,是可以通过计算机程序来指令相关的硬件来完成,的计算机程序可存储于一非易失性计算机可读取存储介质中,该计算机程序在执行时,可包括如上述各方法的实施例的流程。其中,本申请所提供的各实施例中所使用的对存储器、存储、数据库或其它介质的任何引用,均可包括非易失性和易失性存储器中的至少一种。非易失性存储器可包括只读存储器(Read-OnlyMemory,ROM)、磁带、软盘、闪存或光存储器等。易失性存储器可包括随机存取存储器(Random Access Memory,RAM)或外部高速缓冲存储器。作为说明而非局限,RAM可以是多种形式,比如静态随机存取存储器(Static Random Access Memory,SRAM)或动态随机存取存储器(Dynamic Random Access Memory,DRAM)等。

以上实施例的各技术特征可以进行任意的组合,为使描述简洁,未对上述实施例中的各个技术特征所有可能的组合都进行描述,然而,只要这些技术特征的组合不存在矛盾,都应当认为是本说明书记载的范围。

以上实施例仅表达了本申请的几种实施方式,其描述较为具体和详细,但并不能因此而理解为对发明专利范围的限制。应当指出的是,对于本领域的普通技术人员来说,在不脱离本申请构思的前提下,还可以做出若干变形和改进,这些都属于本申请的保护范围。因此,本申请专利的保护范围应以所附权利要求为准。

- 图像采集方式检测方法、装置、计算机设备和存储介质

- 一种多孔荧光微阵列图像的荧光强度检测方法、装置、计算机设备及计算机可读存储介质