一种基于多角度深度信息融合的奶牛体况评分方法及系统

文献发布时间:2023-06-19 09:55:50

技术领域

本发明涉及奶牛体况评分技术领域,更具体的,涉及一种基于多角度深度信息融合的奶牛体况评分方法及系统。

背景技术

良好的奶牛体况是奶牛高产与健康的标志。奶牛体况评分(Cow Body ConditionScoring,BCS)将奶牛的体况量化,通常情况下是采用5分制,级差为0.25。体况评分越高,奶牛越胖,反之越瘦。当奶牛的分数高于4.0或低于2.5时,表明该奶牛有严重的健康问题。因此,奶牛的体况分数能为牛群饲养的管理提供参考,具有重要的意义。

在深度摄像头技术的成熟及普及之前,奶牛的体况评分主要是以人工观察法进行评估,专家通过观察奶牛骨盆以及腰部的特定位置为奶牛打分。该方法具有主观性,且效率低。随着深度摄像头技术的成熟及普及,越来越多的学者通过采集奶牛的深度图像进行建模,但目前基于深度图像的建模方法通常仅考虑单一的角度进行评分,准确性比较低。

现有技术中,如2019年3月22日公开的中国专利,基于深度学习与远程视频的奶牛体况智能评分系统,公开号为CN109508907A,采用深度学习算法Faster R-CNN对接收到的奶牛3D图像进行处理得到奶牛评分数据,但每次处理仅基于单个角度的3D图像,不够准确。

发明内容

本发明为克服目前基于深度图像的建模方法通常仅考虑单一的角度进行评分的技术缺陷,提供一种基于多角度深度信息融合的奶牛体况评分方法及系统。

为解决上述技术问题,本发明的技术方案如下:

一种基于多角度深度信息融合的奶牛体况评分方法,包括以下步骤:

S1:从多个角度获取奶牛的RGB-D视频;

S2:从RGB-D视频中提取关键帧组;

S3:构建基于多角度深度信息融合的奶牛体况评分网络,并对奶牛体况评分网络进行训练,得到训练好的奶牛体况评分网络;

S4:将奶牛的关键帧组输入训练好的奶牛体况评分网络中进行体况评分,得到评分结果。

上述方案中,通过从多个角度获取的奶牛的RGB-D视频中提取关键帧组,然后构建基于多角度深度信息融合的奶牛体况评分网络对关键帧组进行处理得到奶牛体况的评分结果,突破单一角度评分的局限,使评分结果更准去,更具有说服力。

优选的,步骤S2包括以下步骤:

S2.1:在RGB-D视频中设置感兴趣区域;

S2.2:对RGB-D视频进行奶牛臀部的目标检测;

S2.3:将检测到的奶牛臀部与对应的奶牛的耳标信息相关联,同时创建追踪器在RGB-D视频的每帧画面中对检测到的奶牛臀部进行滤波追踪;

S2.4:判断当前帧的追踪器所追踪的帧数是否达到预设的帧数阈值;

若达到,则在当前帧进行目标检测,得到检测结果;

若未达到,则追踪器继续下一帧的滤波追踪,并返回步骤S2.4;

S2.5:判断追踪器在当前帧画面中是否处于感兴趣区域内;

若处于,则将当前帧作为关键帧,并从各个角度获取的RGB-D视频中提取相应的关键帧形成一个关键帧组,即每个关键帧组有四个关键帧;

若不处于,则认为所检测的奶牛已离开,执行步骤S2.9;

S2.6:判断关键帧组的数量是否达到预设的组数阈值;

若达到,则执行步骤S2.9;

若未达到,则执行步骤S2.7;

S2.7:计算检测结果的矩形框与追踪器在当前帧的矩形框的IoU;交并比(Intersection over Union,IoU);

S2.8:判断IoU是否达到预设的IoU阈值;

若达到,则以检测结果的矩形框更新追踪器的矩形框,追踪器继续下一帧的滤波追踪,并返回步骤2.4;

若未达到,则认为所检测的奶牛已离开,执行步骤S2.9;

S2.9:储存得到的关键帧组。

优选的,在步骤S2.1中,采用轻量级网络MobilenetV3对SSD算法的特征提取网络进行改进,得到改进的SSD算法,然后通过改进的SSD算法对奶牛的RGB-D视频进行奶牛臀部的目标检测。

优选的,在通过改进的SSD算法对奶牛的RGB-D视频进行奶牛臀部的目标检测之前,还包括对改进的SSD算法进行网络的调参以及训练,得到训练好的SSD算法。

优选的,在步骤S2.3中,采用KCF算法创建追踪器。核相关滤波算法(KernelCorrelation Filter,KCF)。

优选的,在步骤S1中,分别从奶牛臀部的左侧、右侧、正侧和上侧对奶牛臀部进行拍摄得到奶牛的RGB-D视频。

优选的,在步骤S3中,所述奶牛体况评分网络包括四个输入层、四个浅层特征提取网络、四个深层特征提取网络、一个全连接层和一个输出层;其中,四个输入层分别与四个浅层特征提取网络对应连接,四个浅层特征提取网络分别与四个深层特征提取网络对应连接,四个深层特征提取网络均通过全连接层与输出层连接。

优选的,所述奶牛体况评分网络采用并联输入的结构,且对于每一个输入均包括R、G、B、D四个通道。

优选的,所述奶牛体况评分网络还包括注意力模块,四个所述深层特征提取网络均与所述注意力模块连接,所述注意力模块通过全连接层与输出层连接;所述注意力模块用于将深层特征提取网络提取得到的特征图进行组合,得到总的特征图。

一种基于多角度深度信息融合的奶牛体况评分系统,应用于实现一种基于多角度深度信息融合的奶牛体况评分方法,包括栏位、3D摄像头、耳标识读器、视频处理模块、奶牛体况评分模块和数据存储模块;

所述栏位每次仅容一头奶牛经过;

所述3D摄像头有四个,分别安装在所述栏位上,用于拍摄奶牛的RGB-D视频;四个所述3D摄像头的输出端分别与所述视频处理模块的输入端连接;

所述耳标识读器安装于所述栏位上,用于识别读取奶牛的耳标信息;所述耳标识读器的输出端与所述视频处理模块的输入端连接;

所述视频处理模块用于对奶牛的RGB-D视频进行处理,包括采用改进的SSD算法进行目标检测、采用KCF算法进行滤波追踪以及提取关键帧,形成关键帧组;同时还将检测目标与奶牛的耳标信息相关联;所述视频处理模块的输出端分别与所述奶牛体况评分模块、数据存储模块的输入端连接;

所述奶牛体况评分模块采用奶牛体况评分网络对奶牛进行体况评分,得到评分结果;所述奶牛体况评分模块与所述数据存储模块相互连接;

所述数据存储模块用于储存关键帧组和评分结果。

与现有技术相比,本发明技术方案的有益效果是:

本发明提供了一种基于多角度深度信息融合的奶牛体况评分方法及系统,通过从多个角度获取的奶牛的RGB-D视频中提取关键帧组,然后构建基于多角度深度信息融合的奶牛体况评分网络对关键帧组进行处理得到奶牛体况的评分结果,突破单一角度评分的局限,使评分结果更准去,更具有说服力。

附图说明

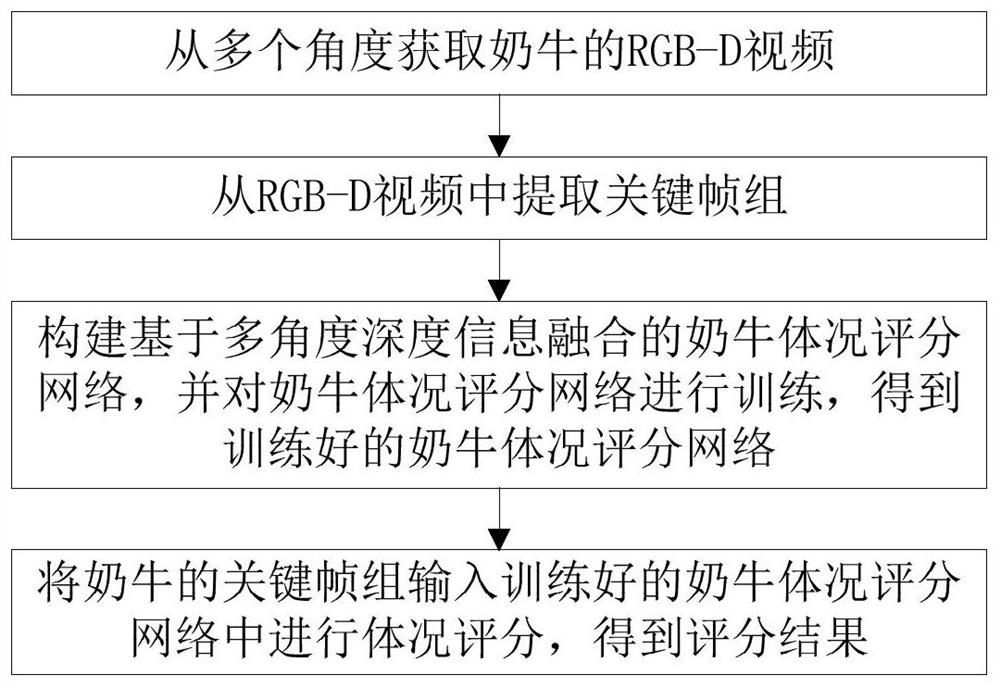

图1为本发明的技术方案实施步骤流程图;

图2为本发明中步骤S2的步骤流程图;

图3为本发明中奶牛体况评分网络的应用示意图;

图4为本发明中所述奶牛体况评分系统的模块示意图;

其中:1、3D摄像头;2、耳标识读器;3、视频处理模块;4、奶牛体况评分模块;5、数据存储模块。

具体实施方式

附图仅用于示例性说明,不能理解为对本专利的限制;

为了更好说明本实施例,附图某些部件会有省略、放大或缩小,并不代表实际产品的尺寸;

对于本领域技术人员来说,附图中某些公知结构及其说明可能省略是可以理解的。

下面结合附图和实施例对本发明的技术方案做进一步的说明。

实施例1

如图1所示,一种基于多角度深度信息融合的奶牛体况评分方法,包括以下步骤:

S1:从多个角度获取奶牛的RGB-D视频;

S2:从RGB-D视频中提取关键帧组;

S3:构建基于多角度深度信息融合的奶牛体况评分网络,并对奶牛体况评分网络进行训练,得到训练好的奶牛体况评分网络;

S4:将奶牛的关键帧组输入训练好的奶牛体况评分网络中进行体况评分,得到评分结果。

在具体实施过程中,通过从多个角度获取的奶牛的RGB-D视频中提取关键帧组,然后构建基于多角度深度信息融合的奶牛体况评分网络对关键帧组进行处理得到奶牛体况的评分结果,突破单一角度评分的局限,使评分结果更准去,更具有说服力。

更具体的,如图2所示,步骤S2包括以下步骤:

S2.1:在RGB-D视频中设置感兴趣区域;

S2.2:对RGB-D视频进行奶牛臀部的目标检测;

S2.3:将检测到的奶牛臀部与对应的奶牛的耳标信息相关联,同时创建追踪器在RGB-D视频的每帧画面中对检测到的奶牛臀部进行滤波追踪;

S2.4:判断当前帧的追踪器所追踪的帧数是否达到预设的帧数阈值;

若达到,则在当前帧进行目标检测,得到检测结果;

若未达到,则追踪器继续下一帧的滤波追踪,并返回步骤S2.4;

S2.5:判断追踪器在当前帧画面中是否处于感兴趣区域内;

若处于,则将当前帧作为关键帧,并从各个角度获取的RGB-D视频中提取相应的关键帧形成一个关键帧组,即每个关键帧组有四个关键帧;

若不处于,则认为所检测的奶牛已离开,执行步骤S2.9;

S2.6:判断关键帧组的数量是否达到预设的组数阈值;

若达到,则执行步骤S2.9;

若未达到,则执行步骤S2.7;

S2.7:计算检测结果的矩形框与追踪器在当前帧的矩形框的IoU;交并比(Intersection over Union,IoU);

S2.8:判断IoU是否达到预设的IoU阈值;

若达到,则以检测结果的矩形框更新追踪器的矩形框,追踪器继续下一帧的滤波追踪,并返回步骤2.4;

若未达到,则认为所检测的奶牛已离开,执行步骤S2.9;

S2.9:储存得到的关键帧组。

在具体实施过程中,每个关键帧组均包括奶牛臀部的左、右、正、上侧RGB-D视频中提取得到的关键帧。预设的帧数阈值与设备实际的性能相关,一般为5~20帧,设备性能越差阈值越大。通过对RGB-D视频进行目标检测、滤波追踪和关键帧提取,从而减少冗余视频数据,提高了运行效率。

更具体的,在步骤S2.1中,采用轻量级网络MobilenetV3对SSD算法的特征提取网络进行改进,得到改进的SSD算法,然后通过改进的SSD算法对奶牛的RGB-D视频进行奶牛臀部的目标检测。

在具体实施过程中,轻量级网络MobilenetV3采用了深度可分离卷积、逆残差结构以及轻量级注意力模块,使网络减少了参数,且保持了复杂网络的精度。

更具体的,在通过改进的SSD算法对奶牛的RGB-D视频进行奶牛臀部的目标检测之前,还包括对改进的SSD算法进行网络的调参以及训练,得到训练好的SSD算法。

更具体的,在步骤S2.3中,采用KCF算法创建追踪器。核相关滤波算法(KernelCorrelation Filter,KCF)。

更具体的,在步骤S1中,分别从奶牛臀部的左侧、右侧、正侧和上侧对奶牛臀部进行拍摄得到奶牛的RGB-D视频。

在具体实施过程中,从奶牛臀部的左、右侧对奶牛臀部进行拍摄分别得到奶牛臀部的左、右侧RGB-D视频,并可从中观测到奶牛的短肋、腰角、髋关节、侧臀;从奶牛臀部的正侧和上侧对奶牛臀部进行拍摄分别得到奶牛臀部的正、上侧RGB-D视频,并可从中观测到奶牛的短肋宽度、荐骨韧带、尾基韧带、髋骨宽度、腰角宽度以及臀部宽度。

更具体的,在步骤S3中,所述奶牛体况评分网络包括四个输入层、四个浅层特征提取网络、四个深层特征提取网络、一个全连接层和一个输出层;其中,四个输入层分别与四个浅层特征提取网络对应连接,四个浅层特征提取网络分别与四个深层特征提取网络对应连接,四个深层特征提取网络均通过全连接层与输出层连接。

在具体实施过程中,如图3所示,奶牛体况评分网络从左往右的输入顺序依次为从奶牛臀部的左侧RGB-D视频中提取的关键帧、从奶牛臀部的右侧RGB-D视频中提取的关键帧、从奶牛臀部的正侧RGB-D视频中提取的关键帧、从奶牛臀部的上侧RGB-D视频中提取的关键帧。在奶牛体况评分网络中,对于提取奶牛臀部的左侧与右侧浅层特征的浅层特征提取网络Cov1_1与Cov2_1不共享参数;对于提取奶牛臀部的左侧与右侧深层特征的深层特征提取网络,由于两者所表达的信息是相同的,都是反映奶牛侧的体况,为了减少不必要的参数更新,因此两者采用共享卷积参数Cov1_2;对于提取奶牛臀部的正侧浅层特征的浅层特征提取网络Cov3_1、提取奶牛臀部的正侧深层特征的深层特征提取网络Cov3_2、提取奶牛臀部的上侧浅层特征的浅层特征提取网络Cov4_1、提取奶牛臀部的上侧深层特征的深层特征提取网络Cov4_2,由于所表达的体况信息是不一样,因此Cov3_1、Cov3_2、Cov4_1、Cov4_2均不共享参数。在提取完奶牛臀部的左侧、右侧、正侧和上侧的深层特征后,得到四个相应的特征图,将四个特征图组合在一起成为一个总的特征图后,进行一次卷积,将总的特征图经过卷积后得到的张量展开为一个向量输入到全连接层中,然后经过输出层,得到奶牛的体况评分。奶牛体况评分网络设计为分类网络,因此输出层为softmax层,最后损失函数采用的是交叉熵损失进行反向传播。

更具体的,所述奶牛体况评分网络采用并联输入的结构,且对于每一个输入均包括R、G、B、D四个通道。

更具体的,所述奶牛体况评分网络还包括注意力模块,四个所述深层特征提取网络均与所述注意力模块连接,所述注意力模块通过全连接层与输出层连接;所述注意力模块用于将深层特征提取网络提取得到的特征图进行组合,得到总的特征图。

在具体实施过程中,将四个特征图组合在一起成为一个总的特征图之前,需要通过注意力模块分别对四个特征图进行卷积,得到四个注意力系数,将四个注意力系数分别与与之对应的特征图相乘,然后将相乘完后的特征图组合成一个四维的向量,得到总的特征图。

如图4所示,一种基于多角度深度信息融合的奶牛体况评分系统,应用于实现一种基于多角度深度信息融合的奶牛体况评分方法,包括栏位、3D摄像头1、耳标识读器2、视频处理模块3、奶牛体况评分模块4和数据存储模块5;

所述栏位每次仅容一头奶牛经过;

所述3D摄像头1有四个,分别安装在所述栏位上,用于拍摄奶牛的RGB-D视频;四个所述3D摄像头1的输出端分别与所述视频处理模块3的输入端连接;

所述耳标识读器2安装于所述栏位上,用于识别读取奶牛的耳标信息;所述耳标识读器2的输出端与所述视频处理模块3的输入端连接;

所述视频处理模块3用于对奶牛的RGB-D视频进行处理,包括采用改进的SSD算法进行目标检测、采用KCF算法进行滤波追踪以及提取关键帧,形成关键帧组;同时还将检测目标与奶牛的耳标信息相关联;所述视频处理模块3的输出端分别与所述奶牛体况评分模块4、数据存储模块5的输入端连接;

所述奶牛体况评分模块4采用奶牛体况评分网络对奶牛进行体况评分,得到评分结果;所述奶牛体况评分模块4与所述数据存储模块5相互连接;

所述数据存储模块5用于储存关键帧组和评分结果。

在具体实施过程中,四个3D摄像头1的拍摄角度分别拍摄奶牛臀部的左侧、右侧、正侧以及上侧,根据3D摄像头1的FOV角度不同,会产生不同的安装距离,一般选择距离奶牛1.5m~2m。安装摄像头的标准是要所有角度的3D摄像头1的画面中都能观察到奶牛完整臀部,且原则上要适应所有体型的奶牛。

显然,本发明的上述实施例仅仅是为清楚地说明本发明所作的举例,而并非是对本发明的实施方式的限定。对于所属领域的普通技术人员来说,在上述说明的基础上还可以做出其它不同形式的变化或变动。这里无需也无法对所有的实施方式予以穷举。凡在本发明的精神和原则之内所作的任何修改、等同替换和改进等,均应包含在本发明权利要求的保护范围之内。

- 一种基于多角度深度信息融合的奶牛体况评分方法及系统

- 基于深度学习与远程视频的奶牛体况智能评分系统