控制系统以及控制方法

文献发布时间:2023-06-19 10:08:35

技术领域

本发明涉及控制系统以及控制方法。

背景技术

以往,提出了通过解析用于演奏乐曲的声音,估计乐曲内当前演奏的位置(以下称为“演奏位置”)的乐谱对准技术(例如专利文献1)。

现有技术文献

专利文献

专利文献1:(日本)特开2015-79183号公报

发明内容

发明所要解决的课题

另外,在演奏者和自动演奏乐器等进行合奏的合奏系统中,例如,进行以下处理:基于演奏者所进行的演奏的乐谱上的位置的估计结果,预想自动演奏乐器发出下一声音的事件的定时。但是,在实际上人和人的合奏中,在配合乐曲的开始或延长符号(fermata)的恢复、乐曲最后的声音的发出等时,有时通过目光接触等暗号动作来配合定时。

本发明是鉴于这种状况而完成的,其目的在于,提供能够基于面部的运动而估计使事件发生的定时的控制系统以及控制方法。

用于解决课题的手段

为了解决上述课题,本发明的一方式是控制系统,其具备:取得部,取得包含被随时间撮影的用户的图像信息;判定部,基于从所述图像信息中检测出的所述用户的面部的运动和视线的方向,判定是否进行了预备动作;估计部,在判定为进行了所述预备动作的情况下,估计使事件发生的定时;以及输出部,输出由所述估计部估计的估计结果。

为了解决上述课题,本发明的一方式是控制系统,其具备:取得部,取得图像信息;判定部,基于所述图像信息,检测所述图像信息所示的摄影图像中的面部部分的运动和视线的方向,并使用所述检测出的结果,判定是否进行了与表示使事件发生的定时的暗号动作相关联的预备动作;估计部,在由所述判定部判定为进行了所述预备动作的情况下,基于所述图像信息,根据所述暗号动作而估计使事件发生的定时;以及输出部,输出由所述估计部估计的估计结果。

此外,本发明的一方式是一种控制方法,取得部取得图像信息;判定部基于所述图像信息,检测所述图像信息所示的摄影图像中的面部部分的运动和视线的方向,并使用所述检测出的结果,判定是否进行了与表示使事件发生的定时的暗号动作相关联的预备动作;估计部在由所述判定部判定为进行了所述预备动作的情况下,基于所述图像信息,根据所述暗号动作而估计使事件发生的定时;输出部输出由所述估计部估计的估计结果。

发明效果

根据本发明,能够基于面部的运动而估计使事件发生的定时。

附图说明

图1是本发明的实施方式所涉及的自动演奏系统的框图。

图2是暗号动作以及演奏位置的说明图。

图3是图像合成部所进行的图像合成的说明图。

图4是演奏对象曲目的演奏位置和自动演奏的指示位置的关系的说明图。

图5是暗号动作的位置和演奏对象曲目的演奏的起点的关系的说明图。

图6是演奏图像的说明图。

图7是演奏图像的说明图。

图8是控制装置的动作的流程图。

图9是第2实施方式中的解析处理部的框图。

图10是第2实施方式中的解析处理部的动作的说明图。

图11是第2实施方式中的解析处理部的动作的流程图。

图12是自动演奏系统的框图。

图13是演奏者的发声定时和伴奏部分的发声定时的仿真结果。

图14是自动演奏系统的评价结果。

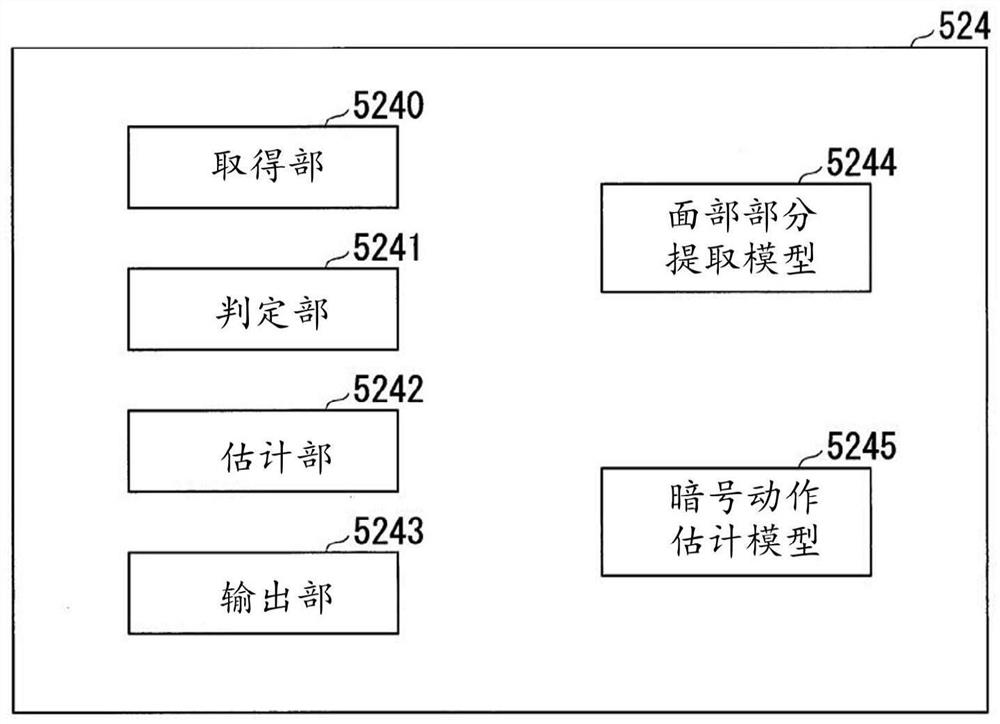

图15是第3实施方式中的检测处理部524的框图。

图16是第3实施方式中的检测处理部524的动作的流程图。

标号说明

100…自动演奏系统,12…控制装置,22…录制装置,222…摄影装置,52…暗号检测部,522…图像合成部,524…检测处理部,5240…取得部,5241…判定部,5242…估计部,5243…输出部,5244…面部部分提取模型,5245…暗号动作估计模型

具体实施方式

<第1实施方式>

图1是本发明的第1实施方式所涉及的自动演奏系统100的框图。自动演奏系统100被设置于多个演奏者P演奏乐器的音乐厅等空间中,是与多个演奏者P进行的乐曲(以下称为“演奏对象曲目”)的演奏并行地执行演奏对象曲目的自动演奏的计算机系统。另外,演奏者P典型而言是乐器的演奏者,但演奏对象曲目的歌唱者也可以是演奏者P。即,本申请中的“演奏”不仅包含乐器的演奏还包含歌唱。此外,实际上不负责乐器的演奏的人(例如,音乐会时的指挥或者录音时的音响监督等)也可以包含在演奏者P中。

如图1所例示,本实施方式的自动演奏系统100具备控制装置12、存储装置14、录制装置22、自动演奏装置24、以及显示装置26。控制装置12和存储装置14例如由个人计算机等信息处理装置实现。

控制装置12例如是CPU(中央处理单元(Central Processing Unit))等处理电路,统筹地控制自动演奏系统100的各元素。存储装置14例如由磁记录介质或者半导体记录介质等公知的记录介质、或者多种记录介质的组合构成,存储控制装置12执行的程序和控制装置12使用的各种数据。另外,也可以准备与自动演奏系统100分开的存储装置14(例如云存储),控制装置12经由移动通信网络或者互联网等通信网络而执行对于存储装置14的写入以及读取。即,存储装置14也可以从自动演奏系统100中省略。

本实施方式的存储装置14存储乐曲数据M。乐曲数据M指定自动演奏的演奏对象曲目的演奏内容。例如优选遵从MIDI(乐器数字接口(Musical Instrument DigitalInterface))标准的形式的文件(SMF:Standard MIDI File,标准MIDI文件)来作为乐曲数据M。具体而言,乐曲数据M是表示演奏内容的指示数据和表示该指示数据的发生时点的时间数据被排列而成的时序数据。指示数据指定音高(音符编号)和强度(力度(velocity))而指示发声以及消声等各种事件。时间数据例如指定紧挨着前后的指示数据的间隔(时间差)。

图1的自动演奏装置24基于控制装置12的控制而执行演奏对象曲目的自动演奏。具体而言,构成演奏对象曲目的多个演奏部分中,与多个演奏者P的演奏部分(例如弦乐器)不同的演奏部分由自动演奏装置24来自动演奏。本实施方式的自动演奏装置24是具备驱动机构242和发声机构244的键盘乐器(即自动演奏钢琴)。发声机构244与自然乐器的钢琴同样地,是与键盘的各键的位移联动而使弦(即发声体)发声的击弦机构。具体而言,发声机构244按每个键而具备由能够击打弦的琴槌和将键的位移传递给琴槌的多个传递部件(例如联动器(whippen)、顶杆(jack)以及震奏杆(repetition lever))构成的动作机构。驱动机构242通过驱动发声机构244而执行演奏对象曲目的自动演奏。具体而言,驱动机构242包含使各键位移的多个驱动体(例如螺线管等促动器)和驱动各驱动体的驱动电路而构成。驱动机构242根据来自控制装置12的指示而驱动发声机构244,从而实现演奏对象曲目的自动演奏。另外,也可以在自动演奏装置24上搭载控制装置12或者存储装置14。

录制装置22录制多个演奏者P对演奏对象曲目进行演奏的情形。如图1所例示,本实施方式的录制装置22具备多个摄影装置222和多个收音装置224。摄影装置222按每个演奏者P来设置,通过演奏者P的摄影而生成图像信号V0。图像信号V0是表示演奏者P的动态图像的信号。收音装置224按每个演奏者P来设置,对由演奏者P的演奏(例如乐器的演奏或者歌唱)而发出的声音(例如乐器声或者歌唱声)进行收音而生成音响信号A0。音响信号A0是表示声音的波形的信号。如从以上的说明所理解的,对不同的演奏者P进行摄影的多个图像信号V0和对不同的演奏者P演奏的声音进行收音的多个音响信号A0被录制。另外,也可以利用从电子弦乐器等电子乐器输出的音响信号A0。因此,也可以省略收音装置224。

控制装置12通过执行存储装置14中存储的程序,实现用于实现演奏对象曲目的自动演奏的多个功能(暗号检测部52、演奏解析部54、演奏控制部56以及显示控制部58)。另外,也可以是由多个装置的集合(即系统)来实现控制装置12的功能的结构,或者由专用的电子电路来实现控制装置12的功能的一部分或者全部。此外,位于离开设置了录制装置22、自动演奏装置24、显示装置26的音乐厅等空间的位置的服务器装置也可以实现控制装置12的一部分或者全部的功能。

各演奏者P执行成为演奏对象曲目的演奏的暗号的动作(以下称为“暗号动作”)。暗号动作是指示时间轴上的1个时点的动作(姿势(gesture))。例如,演奏者P抬起自己的乐器的动作,或者演奏者P使自己的身体运动的动作是暗号动作的优选例。例如如图2所例示,主导演奏对象曲目的演奏的特定的演奏者P在相对于应开始演奏对象曲目的演奏的起点提前了规定的期间(以下称为“准备期间”)B的时点Q执行暗号动作。准备期间B例如是演奏对象曲目的1拍相应量的时长的期间。因此,准备期间B的时长根据演奏对象曲目的演奏速度(节拍)而变动。例如演奏速度越快准备期间B是越短的时间。演奏者P基于对演奏对象曲目设想的演奏速度而在从演奏对象曲目的起点起提前了相当于1拍相应量的准备期间B的时点执行暗号动作,由此在该起点的到来时开始演奏对象曲目的演奏。暗号动作除了成为其他演奏者P的演奏的契机之外,还被用作自动演奏装置24的自动演奏的契机。另外,准备期间B的时长是任意的,例如可以设为多拍相应量的时长。

图1的暗号检测部52检测演奏者P的暗号动作。具体而言,暗号检测部52通过解析各摄影装置222对演奏者P进行了摄影的图像而检测暗号动作。如图1所例示,本实施方式的暗号检测部52具备图像合成部522和检测处理部524。图像合成部522通过合成多个摄影装置222生成的多个图像信号V0而生成图像信号V。如图3所例示,图像信号V是表示对各图像信号V0表示的多个动态图像(#1,#2,#3,……)进行排列的图像的信号。即,表示多个演奏者P的动态图像的图像信号V从图像合成部522被供给至检测处理部524。

检测处理部524通过解析由图像合成部522生成的图像信号V而检测多个演奏者P中的其中一个演奏者的暗号动作。在检测处理部524的暗号动作的检测中,可以使用包含将演奏者P执行暗号动作时所移动的元素(例如身体或者乐器)从图像中提取的图像识别处理、和检测该元素的移动的活动体检测处理的公知的图像解析技术。此外,也可以将神经网络或者多叉树等识别模型利用于暗号动作的检测。例如,将从摄影了多个演奏者P的演奏的图像信号中提取出的特征量作为给予的学习数据来利用,事先执行识别模型的机器学习(例如深度学习)。检测处理部524通过将在实际上执行自动演奏的场面中从图像信号V提取出的特征量应用于机器学习后的识别模型中,检测暗号动作。

图1的演奏解析部54与各演奏者P的演奏并行地依次估计演奏对象曲目中多个演奏者P当前正演奏的位置(以下称为“演奏位置”)T。具体而言,演奏解析部54通过解析多个收音装置224中的每一个所收音的声音而估计演奏位置T。如图1所例示,本实施方式的演奏解析部54具备音响混合部542和解析处理部544。音响混合部542通过混合多个收音装置224生成的多个音响信号A0而生成音响信号A。即,音响信号A是表示不同的音响信号A0表示的多种声音的混合音的信号。

解析处理部544通过解析音响混合部542生成的音响信号A而估计演奏位置T。例如,解析处理部544通过将音响信号A表示的声音和乐曲数据M表示的演奏对象曲目的演奏内容相互对照而确定演奏位置T。此外,本实施方式的解析处理部544通过音响信号A的解析来估计演奏对象曲目的演奏速度(节拍)R。例如,解析处理部544根据演奏位置T的时间变化(即,时间轴方向上的演奏位置T的变化)来确定演奏速度R。另外,在解析处理部544的演奏位置T以及演奏速度R的估计中,可以任意采用公知的音响解析技术(乐谱对准)。例如,可以将专利文献1所公开的解析技术用于演奏位置T以及演奏速度R的估计。此外,也可以将神经网络或者多叉树等识别模型用于演奏位置T以及演奏速度R的估计。例如,将从对多个演奏者P的演奏进行了收音的音响信号A中提取出的特征量用作给予的学习数据,在自动演奏前执行生成识别模型的机器学习(例如深度学习)。解析处理部544通过将在实际上执行自动演奏的场面中从音响信号A中提取出的特征量应用于通过机器学习而生成的识别模型,从而估计演奏位置T以及演奏速度R。

暗号检测部52的暗号动作的检测和演奏解析部54的演奏位置T以及演奏速度R的估计与多个演奏者P的演奏对象曲目的演奏并行且实时地被执行。例如,暗号动作的检测和演奏位置T以及演奏速度R的估计在规定的周期中被反复进行。但是,不管暗号动作的检测的周期和演奏位置T以及演奏速度R的估计的周期的异同。

图1的演奏控制部56使自动演奏装置24执行演奏对象曲目的自动演奏,以使暗号检测部52检测的暗号动作和演奏解析部54估计的演奏位置T的进行同步。具体而言,演奏控制部56将暗号检测部52的暗号动作的检测作为契机而对自动演奏装置24指示自动演奏的开始,并且在演奏对象曲目中与演奏位置T对应的时点对自动演奏装置24指示乐曲数据M指定的演奏内容。即,演奏控制部56是将演奏对象曲目的乐曲数据M所包含的各指示数据对自动演奏装置24依次供给的音序器(sequencer)。自动演奏装置24根据来自演奏控制部56的指示而执行演奏对象曲目的自动演奏。随着多个演奏者P的演奏的进行,演奏位置T向演奏对象曲目内的后方移动,故自动演奏装置24的演奏对象曲目的自动演奏也与演奏位置T的移动一并进行。如由以上的说明所理解的那样,在将演奏对象曲目的各个声音的强度或者乐句(phrase)表现等音乐表现维持为由乐曲数据M指定的内容的状态下,演奏控制部56向自动演奏装置24指示自动演奏以使演奏的节拍和各音的定时与多个演奏者P的演奏同步。因此,例如若使用表示特定的演奏者(例如已经去世的过去的演奏者)的演奏的乐曲数据M,则在通过自动演奏而忠实地再现该演奏者特有的音乐表现的同时,能够形成该演奏者和现实存在的多个演奏者P恰好相互间呼吸合拍地协调地进行合奏这样的氛围。

另外,从演奏控制部56通过指示数据的输出而对自动演奏装置24指示自动演奏起直到自动演奏装置24实际上发声(例如发声机构244的琴槌进行击弦)为止需要数百毫秒左右的时间。即,自动演奏装置24的实际的发声相对于来自演奏控制部56的指示不可避免地有延迟。因此,结果上,在演奏控制部56对自动演奏装置24指示演奏对象曲目中演奏解析部54估计的演奏位置T自身的演奏的结构中,自动演奏装置24的发声相对于多个演奏者P的演奏有延迟。

因此,如图2所例示,本实施方式的演奏控制部56对自动演奏装置24指示演奏对象曲目中相对于演奏解析部54估计的演奏位置T靠后(未来)的时点TA的演奏。即,演奏控制部56预读取演奏对象曲目的乐曲数据M内的指示数据,以使延迟后的发声与多个演奏者P的演奏同步(例如演奏对象曲目的特定的音符在自动演奏装置24和各演奏者P之间大致同时地被演奏)。

图4是演奏位置T的时间上的变化的说明图。单位时间内的演奏位置T的变动量(图4的直线的坡度)相当于演奏速度R。在图4中,为了简洁,例示了演奏速度R被维持为恒定的情况。

如图4所例示,演奏控制部56对自动演奏装置24指示演奏对象曲目中相对于演奏位置T靠后调整量α的时点TA的演奏。调整量α根据从演奏控制部56的自动演奏的指示起直到自动演奏装置24实际上发声为止的延迟量D、和演奏解析部54估计的演奏速度R而可变地被设定。具体而言,演奏控制部56将基于演奏速度R而在延迟量D的时间内演奏对象曲目的演奏进行的区间长度设定为调整量α。因此,演奏速度R越快(图4的直线的坡度陡峭)则调整量α成为越大的数值。另外,在图4中设想了遍及演奏对象曲目的整个区间而演奏速度R被维持为恒定的情况,但实际上演奏速度R可以是变动的。因此,调整量α可以与演奏速度R联动而随时间变动。

延迟量D在事先被设定为与自动演奏装置24的测量结果相应的规定值(例如从数十到数百毫秒左右)。另外,在实际的自动演奏装置24中,延迟量D可以根据所演奏的音高或者强度而不同。因此,延迟量D(进一步,依存于延迟量D的调整量α)也可以根据成为自动演奏的对象的音符的音高或者强度而可变地设定。

此外,演奏控制部56以暗号检测部52检测的暗号动作为契机向自动演奏装置24指示演奏对象曲目的自动演奏的开始。图5是暗号动作和自动演奏的关系的说明图。如图5所例示,演奏控制部56在从检测到暗号动作的时点Q起经过了时长δ的时点QA开始对于自动演奏装置24的自动演奏的指示。时长δ是从相当于准备期间B的时长τ中减去了自动演奏的延迟量D的时长。准备期间B的时长τ根据演奏对象曲目的演奏速度R而变动。具体而言,演奏速度R越快(图5的直线的坡度陡峭)则准备期间B的时长τ变得越短。但是,在暗号动作的时点QA,还没开始演奏对象曲目的演奏,所以没有估计演奏速度R。因此,演奏控制部56根据对演奏对象曲目设想的标准的演奏速度(标准节拍)R0而计算准备期间B的时长τ。演奏速度R0例如在乐曲数据M中被指定。但是,也可以将多个演奏者P对于演奏对象曲目公认的速度(例如在演奏练习时设想的速度)设定为演奏速度R0。

如以上所述,演奏控制部56在从暗号动作的时点QA起经过了时长δ(δ=τ-D)的时点QA开始自动演奏的指示。因此,在从暗号动作的时点Q起经过了准备期间B的时点QB(即,多个演奏者P开始演奏的时点),开始自动演奏装置24的发声。即,与多个演奏者P的演奏对象曲目的演奏的开始大致同时地开始自动演奏装置24的自动演奏。本实施方式的演奏控制部56的自动演奏的控制如以上的例示所述。

图1的显示控制部58使视觉上表现了自动演奏装置24的自动演奏的进行的图像(以下称为“演奏图像”)G在显示装置26上显示。具体而言,显示控制部58通过生成表示演奏图像G的图像数据而输出至显示装置26,从而使演奏图像G在显示装置26上显示。显示装置26显示从显示控制部58指示的演奏图像G。例如液晶显示面板或者投影机是显示装置26的优选例。多个演奏者P能够与演奏对象曲目的演奏并行地随时对显示装置26显示的演奏图像G进行视觉确认。

本实施方式的显示控制部58将与自动演奏装置24的自动演奏联动地动态变化的动态图像作为演奏图像G而在显示装置26上显示。图6以及图7是演奏图像G的显示例。如图6以及图7所例示,演奏图像G是存在底面72的假想空间70中配置了显示体(对象)74的立体的图像。如图6所例示,显示体74是在假想空间70内漂浮且以规定的速度下降的大致球状的立体。在假想空间70的底面72上显示显示体74的影子75,随着显示体74的下降在底面72上该影子75接近显示体74。如图7所例示,在开始自动演奏装置24的发声的时点显示体74上升到假想空间70内的规定的高度为止,并且在该发声正持续时显示体74的形状不规则地变形。然后,若自动演奏的发声停止(消声),则显示体74的不规则的变形停止而恢复到图6的初始的形状(球状),显示体74迁移至以规定的速度下降的状态。显示体74的以上的动作(上升以及变形)按每次自动演奏的发声而被反复进行。例如,在演奏对象曲目的演奏的开始前显示体74下降,在演奏对象曲目的起点的音符通过自动演奏而发声的时点显示体74的移动的方向从下降转换为上升。因此,对显示装置26所显示的演奏图像G进行视觉确认的演奏者P能够通过显示体74的从下降到上升的转换而掌握自动演奏装置24的发声的定时。

本实施方式的显示控制部58控制显示装置26以使其显示以上例示的演奏图像G。另外,从显示控制部58对显示装置26指示图像的显示或者变更起,直到在显示装置26的显示图像上反映该指示为止的延迟与自动演奏装置24的自动演奏的延迟量D相比足够地小。因此,显示控制部58使显示装置26显示演奏对象曲目中与演奏解析部54估计的演奏位置T本身的演奏内容对应的演奏图像G。因此,如前所述,演奏图像G与自动演奏装置24的实际的发声(从演奏控制部56的指示起延迟了延迟量D后的时点)同步地动态变化。即,在自动演奏装置24实际上开始演奏对象曲目的各音符的发声的时点,演奏图像G的显示体74的移动从下降转换为上升。因此,各演奏者P能够视觉确认自动演奏装置24对演奏对象曲目的各音符进行发声的时点。

图8是例示自动演奏系统100的控制装置12的动作的流程图。例如,以按规定的周期产生的中断信号为契机,与多个演奏者P的演奏对象曲目的演奏并行地开始图8的处理。若开始图8的处理,则控制装置12(暗号检测部52)通过解析从多个摄影装置222供给的多个图像信号V0,判定有没有来自任意的演奏者P的暗号动作(SA1)。此外,控制装置12(演奏解析部54)通过解析从多个收音装置224供给的多个音响信号A0而估计演奏位置T和演奏速度R(SA2)。另外,暗号动作的检测(SA1)和演奏位置T以及演奏速度R的估计(SA2)的顺序可以反过来。

控制装置12(演奏控制部56)对自动演奏装置24指示与演奏位置T以及演奏速度R对应的自动演奏(SA3)。具体而言,使自动演奏装置24执行演奏对象曲目的自动演奏以使暗号检测部52检测的暗号动作和演奏解析部54估计的演奏位置T的进行同步。此外,控制装置12(显示控制部58)使显示装置26显示用于表现自动演奏的进行的演奏图像G(SA4)。

在以上例示的实施方式中,执行自动演奏装置24的自动演奏以使演奏者P的暗号动作和演奏位置T的进行同步,另一方面,在显示装置26上显示用于表示自动演奏装置24的自动演奏的进行的演奏图像G。因此,演奏者P能够视觉确认自动演奏装置24的自动演奏的进行而使其反映在自身的演奏上。即,实现多个演奏者P的演奏和自动演奏装置24的自动演奏相互配合作用的自然的合奏。在本实施方式中,特别地,存在如下优点:由于在显示装置26上显示根据自动演奏的演奏内容而动态地变化的演奏图像G,演奏者P能够通过视觉并直观地掌握自动演奏的进行。

此外,在本实施方式中,在时间上相对于演奏解析部54估计的演奏位置T靠后的时点TA的演奏内容被指示给自动演奏装置24。因此,即使在自动演奏装置24的实际的发声相对于演奏控制部56的演奏的指示延迟的情况下,也能够使演奏者P的演奏和自动演奏高精度地同步。此外,相对于演奏位置T靠后了与演奏解析部54估计的演奏速度R对应的可变的调整量α的时点TA的演奏被指示给自动演奏装置24。因此,即使在例如演奏速度R变动的情况下,也能够使演奏者的演奏和自动演奏高精度地同步。

<第2实施方式>

说明本发明的第2实施方式。另外,在以下例示的各方式中对于作用或者功能与第1实施方式相同的元素,沿用在第1实施方式的说明中使用的标号而适当地省略各自的详细说明。

图9是例示了第2实施方式中的解析处理部544的结构的框图。如图9所例示,第2实施方式的解析处理部544具备似然计算部82和位置估计部84。图10是似然计算部82的动作的说明图。

似然计算部82与多个演奏者P的演奏对象曲目的演奏并行地,计算演奏对象曲目内的多个时点t的每一个时点的观测似然L。即,计算遍及演奏对象曲目内的多个时点t的观测似然L的分布(以下称为“观测似然分布”)。按在时间轴上划分的每个单位区间(帧)来对音响信号A计算观测似然分布。音响信号A的关于1个单位区间而被计算出的观测似然分布中任意的1个时点t的观测似然L,是该单位区间的音响信号A表示的声音在演奏对象曲目内的该时点t被发声的准确度的指标。观测似然L也说成是多个演奏者P对演奏对象曲目内的各时点t进行演奏的准确度的指标。即,关于任意的1个单位区间而计算出的观测似然L高的时点t与该单位区间的音响信号A表示的声音的发声位置相符的可能性高。另外,紧挨着前后的单位区间在时间轴上也可以相互重叠。

如图9所例示,第2实施方式的似然计算部82具备第1运算部821、第2运算部822、以及第3运算部823。第1运算部821计算第1似然L1(A),第2运算部822计算第2似然L2(C)。第3运算部823通过将第1运算部821计算出的第1似然L1(A)和第2运算部822计算出的第2似然L2(C)相乘而计算观测似然L的分布。即,观测似然L由第1似然L1(A)和第2似然L2(C)的积来表现(L=L1(A)L2(C))。

第1运算部821通过将各单位区间的音响信号A和演奏对象曲目的乐曲数据M相互对照,对于演奏对象曲目内的多个时点t的每一个计算第1似然L1(A)。即,如图10所例示,按每个单位区间计算遍及演奏对象曲目内的多个时点t的第1似然L1(A)的分布。第1似然L1(A)是通过音响信号A的解析而被计算的似然。通过音响信号A的1个单位区间的解析而对任意的1个时点t计算出的第1似然L1(A),是该单位区间的音响信号A表示的声音在演奏对象曲目内的该时点t被发声的准确度的指标。在时间轴上的多个时点t中与音响信号A的1个单位区间的演奏位置相符的可能性高的时点t,存在第1似然L1(A)的峰值。关于根据音响信号A而计算第1似然L1(A)的方法,例如可以优选地利用(日本)特开2014-178395号公报的技术。

图9的第2运算部822计算与有没有检测到暗号动作的检测对应的第2似然L2(C)。具体而言,第2似然L2(C)根据表示有没有暗号动作的变量C而被计算。变量C从暗号检测部52而被通知给似然计算部82。在暗号检测部52检测到暗号动作的情况下,变量C被设定为1,在暗号检测部52没有检测到暗号动作的情况下,变量C被设定为0。另外,变量C的数值不限于0以及1这2个值。例如,也可以将没检测到暗号动作时的变量C设定为规定的正数(但是,是小于检测到暗号动作时的变量C的数值的数值)。

如图10所例示,在演奏对象曲目的时间轴上指定多个基准点a。基准点a例如是乐曲的开始时点,或者是在由延长符号等指示的长时间的休止符后重新开始演奏的时点。例如,演奏对象曲目内的多个基准点a的各自的时刻由乐曲数据M来指定。

如图10所例示,第2似然L2(C)在没有检测到暗号动作的单位区间(C=0)中被维持为1。另一方面,在检测到暗号动作的单位区间(C=1)中,第2似然L2(C)在从各基准点a起遍及在时间轴上前方侧的规定长度的期间(以下称为“参考期间”)ρ中被设定为0(第2值的例示),在各参考期间ρ以外的期间中被设定为1(第1值的例示)。参考期间ρ例如被设定为演奏对象曲目的1拍相应量到2拍相应量左右的时长。如前所述,观测似然L通过第1似然L1(A)和第2似然L2(C)的积而被计算。因此,在检测到暗号动作的情况下,对演奏对象曲目指定的多个基准点a的每一个基准点的前方的参考期间ρ中的观测似然L降低至0。另一方面,在没有检测到暗号动作的情况下,第2似然L2(C)被维持为1,因此第1似然L1(A)作为观测似然L而被计算。

图9的位置估计部84根据似然计算部82计算出的观测似然L而估计演奏位置T。具体而言,位置估计部84根据观测似然L而计算演奏位置T的后验分布,并根据该后验分布来估计演奏位置T。演奏位置T的后验分布是在观测到单位区间内的音响信号A这一条件下,该单位区间的发声的时点是演奏对象曲目内的位置t的后验概率的概率分布。在利用了观测似然L的后验分布的计算中,例如如(日本)特开2015-79183号公报所公开的那样,利用使用了隐秘半马尔可夫模型(HSMM)的贝叶斯估计等公知的统计处理。

如前所述,在与暗号动作对应的基准点a的前方的参考期间ρ中观测似然L被设定为0,因此后验分布在该基准点a以后的区间中成为有效。因此,与暗号动作对应的基准点a以后的时点被估计为演奏位置T。此外,位置估计部84根据演奏位置T的时间变化而确定演奏速度R。解析处理部544以外的结构以及动作与第1实施方式相同。

图11是例示了解析处理部544估计演奏位置T以及演奏速度R的处理(图8的步骤SA2)的内容的流程图。与多个演奏者P的演奏对象曲目的演奏并行地,按时间轴上的每个单位区间来执行图11的处理。

第1运算部821通过解析单位区间内的音响信号A,对于演奏对象曲目内的多个时点t的每一个计算第1似然L1(A)(SA21)。此外,第2运算部822计算与有没有检测到暗号动作对应的第2似然L2(C)(SA22)。另外,第1运算部821的第1似然L1(A)的计算(SA21)和第2运算部822的第2似然L2(C)的计算(SA22)的顺序可以反过来。第3运算部823通过将第1运算部821计算出的第1似然L1(A)和第2运算部822计算出的第2似然L2(C)相乘,计算观测似然L的分布(SA23)。

位置估计部84根据似然计算部82计算出的观测似然分布而估计演奏位置T(SA24)。此外,位置估计部84根据演奏位置T的时间变化来计算演奏速度R(SA25)。

如以上所述,在第2实施方式中,除了音响信号A的解析结果之外暗号动作的检测结果也在演奏位置T的估计中被考虑,因此例如与仅考虑音响信号A的解析结果的结构相比能够高精度地估计演奏位置T。例如在乐曲的开始时点或者在休止符之后重新开始演奏的时点也高精度地估计演奏位置T。此外,在第2实施方式中,在检测到暗号动作的情况下,与对演奏对象曲目指定的多个基准点a中检测到该暗号动作的基准点a对应的参考期间ρ内的观测似然L下降。即,参考期间ρ以外的暗号动作的检测时点没有被反映在演奏时点T的估计中。因此,具有能够抑制误检测了暗号动作的情况下的演奏时点T的误估计的优点。

<变形例>

以上例示的各方式可以进行多种变形。具体的变形的方式在以下例示。从以下的例示中任意选择的2个以上的方式可以在相互不矛盾的范围内适当组合。

(1)在前述的实施方式中,以暗号检测部52检测到暗号动作为契机开始演奏对象曲目的自动演奏,但也可以将暗号动作用于演奏对象曲目的中途的时点下的自动演奏的控制。例如,在演奏对象曲目内遍及长时间的休止符结束后重新开始演奏的时点,与前述各方式同样地,以暗号动作为契机重新开始演奏对象曲目的自动演奏。例如,与参照图5说明的动作同样地,特定的演奏者P在相对于演奏对象曲目内在休止符后重新开始演奏的时点提前了准备期间B的时点Q执行暗号动作。然后,在从该时点Q起经过了与延迟量D和演奏速度R对应的时长δ的时点,演奏控制部56重新开始对于自动演奏装置24的自动演奏的指示。另外,在演奏对象曲目的中途的时点已经估计了演奏速度R,因此在时长δ的设定中,应用演奏解析部54所估计的演奏速度R。

另外,演奏对象曲目中会执行暗号动作的期间可以根据演奏对象曲目的演奏内容在事先掌握。因此,暗号检测部52也可以以演奏对象曲目中存在执行暗号动作的可能性的特定的期间(以下称为“监视期间”)为对象而监视有没有暗号动作。例如,对于对演奏对象曲目设想的多个监视期间的每一个指定起点和终点的区间指定数据被储存于存储装置14中。也可以将区间指定数据内含于乐曲数据M中。暗号检测部52在演奏对象曲目中由区间指定数据指定的各监视期间内存在演奏位置T的情况下执行暗号动作的监视,在演奏位置T位于监视期间外侧的情况下停止暗号动作的监视。根据以上的结构,演奏对象曲目中限定于监视期间而检测暗号动作,因此相比于遍及演奏对象曲目的整个区间而监视有没有暗号动作的结构,具有减轻暗号检测部52的处理负荷的优点。此外,也能够降低对于演奏对象曲目中实际上不可能执行暗号动作的期间误检测暗号动作的可能性。

(2)在前述的实施方式中,通过解析图像信号V表示的图像的整体(图3)而检测暗号动作,但暗号检测部52也可以将图像信号V表示的图像中特定的区域(以下称为“监视区域”)作为对象,监视有没有暗号动作。例如,暗号检测部52将图像信号V表示的图像中包含预定了暗号动作的特定的演奏者P的范围选择为监视区域,并将该监视区域作为对象而检测暗号动作。对于监视区域以外的范围,被从暗号检测部52的监视对象中排除。根据以上的结构,限定于监视区域而检测暗号动作,因此与遍及图像信号V表示的图像的整体而监视有没有暗号动作的结构相比,具有减轻暗号检测部52的处理负荷的优点。此外,能够降低实际上不执行暗号动作的演奏者P的动作被误判定为暗号动作的可能性。

另外,如前述的变形例(1)所例示,若设想演奏对象曲目的演奏中遍及多次而执行暗号动作的情况,则执行暗号动作的演奏者P可能按每次暗号动作而被变更。例如,演奏者P1执行演奏对象曲目的开始前的暗号动作,另一方面,演奏者P2执行演奏对象曲目的中途的暗号动作。因此,也优选在图像信号V表示的图像内随时间变更监视区域的位置(或者尺寸)的结构。执行暗号动作的演奏者P在演奏前被决定,因此例如按时序指定监视区域的位置的区域指定数据被事先储存在存储装置14中。暗号检测部52对于图像信号V表示的图像中由区域指定数据指定的各监视区域监视暗号动作,对于监视区域以外的区域从暗号动作的监视对象中排除。根据以上的结构,即使在执行暗号动作的演奏者P随着乐曲的进行而被变更的情况下,也能够适当地检测暗号动作。

(3)在前述的实施方式中,利用多个摄影装置222来对多个演奏者P进行摄影,但也可以通过1个摄影装置222来对多个演奏者P(例如多个演奏者P所在的舞台整体)进行摄影。同样地,也可以由1个收音装置224来对多个演奏者P演奏的声音进行收音。此外,也可以采用暗号检测部52对于多个图像信号V0的每一个监视有没有暗号动作的结构(因此,可省略图像合成部522)。

(4)在前述的实施方式中,通过摄影装置222摄影的图像信号V的解析而检测暗号动作,但暗号检测部52检测暗号动作的方法不限于以上的例示。例如,暗号检测部52也可以通过解析演奏者P的身体上穿戴的检测器(例如加速度传感器等各种传感器)的检测信号而检测演奏者P的暗号动作。但是,根据通过摄影装置222摄影的图像的解析而检测暗号动作的前述的实施方式的结构,与在演奏者P的身体上穿戴检测器的情况相比,具有能够降低对于演奏者P的演奏动作的影响并检测暗号动作的优点。

(5)在前述的实施方式中,通过混合了表示不同的乐器的声音的多个音响信号A0的音响信号A的解析来估计演奏位置T以及演奏速度R,但也可以通过各音响信号A0的解析来估计演奏位置T以及演奏速度R。例如,演奏解析部54对于多个音响信号A0的每一个通过与前述的实施方式同样的方法来估计暂定的演奏位置T以及演奏速度R,并根据与各音响信号A0有关的估计结果来决定确定的演奏位置T以及演奏速度R。例如计算根据各音响信号A0而估计的演奏位置T以及演奏速度R的代表值(例如平均值)来作为确定的演奏位置T以及演奏速度R。如根据以上的说明所理解的,可以省略演奏解析部54的音响混合部542。

(6)如前述的实施方式所例示,自动演奏系统100通过控制装置12和程序的协作而实现。本发明的优选的方式所涉及的程序作为如下元素使计算机发挥功能:检测对演奏对象曲目进行演奏的演奏者P的暗号动作的暗号检测部52、对表示所演奏的声音的音响信号A与该演奏并行地进行解析从而依次估计演奏对象曲目内的演奏位置T的演奏解析部54、使自动演奏装置24执行演奏对象曲目的自动演奏以使暗号检测部52检测的暗号动作和演奏解析部54估计的演奏位置T的进行同步的演奏控制部56、以及使表示自动演奏的进行的演奏图像G在显示装置26上显示的显示控制部58。即,本发明的优选的方式所涉及的程序是使计算机执行本发明的优选的方式所涉及的乐曲数据处理方法的程序。以上例示的程序可以以储存于计算机可读取的记录介质的方式被提供而安装于计算机。记录介质例如是非暂时性(non-transitory)的记录介质,CD-ROM等光学式记录介质(光盘)是优选例,但也可以包含半导体记录介质或者磁记录介质等公知的任意形式的记录介质。此外,也可以通过经由通信网络的分发方式而将程序分发给计算机。

(7)本发明的优选的方式也可以被确定为前述的实施方式所涉及的自动演奏系统100的动作方法(自动演奏方法)。例如,就本发明的优选的方式所涉及的自动演奏方法而言,计算机系统(单体的计算机或者由多个计算机构成的系统)检测对演奏对象曲目进行演奏的演奏者P的暗号动作(SA1),并通过对表示所演奏的声音的音响信号A与该演奏并行地进行解析,依次估计演奏对象曲目内的演奏位置T(SA2),使自动演奏装置24执行演奏对象曲目的自动演奏以使暗号动作和演奏位置T的进行同步(SA3),并使显示装置26显示表示自动演奏的进行的演奏图像G(SA4)。

(8)根据以上所例示的方式,例如掌握以下的结构。

[方式A1]

就本发明的优选的方式(方式A1)所涉及的演奏解析方法而言,检测演奏乐曲的演奏者的暗号动作,通过表示演奏所述乐曲的声音的音响信号的解析,计算作为所述乐曲内的各时点与演奏位置相符的准确度的指标的观测似然的分布,根据所述观测似然的分布而估计所述演奏位置,在所述观测似然的分布的计算中,在检测到所述暗号动作的情况下,使对于所述乐曲在时间轴上所指定的基准点的前方的期间中的观测似然下降。在以上的方式中,除了音响信号的解析结果之外,暗号动作的检测结果也在演奏位置的估计中被考虑,因此与例如仅考虑音响信号的解析结果的结构相比,能够高精度地估计演奏位置。

[方式A2]

在方式A1的优选例(方式A2)中,在所述观测似然的分布的计算中,根据所述音响信号而计算作为所述乐曲内的各时点与演奏位置相符的准确度的指标的第1似然,在没有检测到所述暗号动作的状态下设定为第1值,并在检测到所述暗号动作的情况下,计算在所述基准点的前方的期间中被设定为小于所述第1值的第2值的第2似然,通过将所述第1似然和所述第2似然相乘而计算所述观测似然。在以上的方式中,具有如下优点,通过将根据音响信号而计算出的第1似然和与暗号动作的检测结果对应的第2似然相乘,能够简便地计算观测似然。

[方式A3]

在方式A2的优选例(方式A3)中,所述第1值是1,所述第2值是0。根据以上的方式,在检测到暗号动作的情况和没检测到的情况下能够明确地区分观测似然。

[方式A4]

就本发明的优选的方式(方式A4)所涉及的自动演奏方法而言,检测演奏乐曲的演奏者的暗号动作,通过表示演奏所述乐曲的声音的音响信号的解析而估计所述乐曲内的演奏位置,使自动演奏装置执行所述乐曲的自动演奏以使与所述演奏位置的进行同步,在所述演奏位置的估计中,通过所述音响信号的解析,计算作为所述乐曲内的各时点与演奏位置相符的准确度的指标的观测似然的分布,根据所述观测似然的分布来估计所述演奏位置,在所述观测似然的分布的计算中,在检测到所述暗号动作的情况下,使对于所述乐曲在时间轴上所指定的基准点的前方的期间中的观测似然下降。在以上的方式中,除了音响信号的解析结果之外,暗号动作的检测结果也在演奏位置的估计中被考虑,因此与例如仅考虑音响信号的解析结果的结构相比,能够高精度地估计演奏位置。

[方式A5]

在方式A4的优选例(方式A5)中,在所述观测似然的分布的计算中,根据所述音响信号而计算作为所述乐曲内的各时点与演奏位置相符的准确度的指标的第1似然,在没有检测到所述暗号动作的状态下设定为第1值,并在检测到所述暗号动作的情况下,计算在所述基准点的前方的期间中被设定为小于所述第1值的第2值的第2似然,通过将所述第1似然和所述第2似然相乘而计算所述观测似然。在以上的方式中,具有如下优点,通过将根据音响信号而计算出的第1似然和与暗号动作的检测结果对应的第2似然相乘,能够简便地计算观测似然。

[方式A6]

在方式A4或者方式A5的优选例(方式A6)中,按照表示所述乐曲的演奏内容的乐曲数据而使所述自动演奏装置执行自动演奏,所述多个基准点由所述乐曲数据来指定。在以上的方式中,通过对自动演奏装置指示自动演奏的乐曲数据来指定各基准点,与在乐曲数据之外另外指定多个基准点的结构相比,具有简化结构以及处理的优点。

[方式A7]

在方式A4到方式A6的任一优选例(方式A7)中,使显示装置显示表示所述自动演奏的进行的图像。根据以上的方式,演奏者能够视觉确认自动演奏装置的自动演奏的进行而使其反映在自身的演奏上。即,实现演奏者的演奏和自动演奏装置的自动演奏相互作用配合的自然的演奏。

[方式A8]

本发明的优选的方式(方式A8)所涉及的自动演奏系统具备:暗号检测部,检测演奏乐曲的演奏者的暗号动作;解析处理部,根据表示演奏所述乐曲的声音的音响信号的解析而估计所述乐曲内的演奏位置;以及演奏控制部,使自动演奏装置执行乐曲的自动演奏以使所述暗号检测部检测的暗号动作和所述演奏解析部估计的演奏位置的进行同步,所述解析处理部包含:似然计算部,通过所述音响信号的解析,计算作为所述乐曲内的各时点与演奏位置相符的准确度的指标的观测似然的分布;以及位置估计部,根据所述观测似然的分布而估计所述演奏位置,在检测到所述暗号动作的情况下,所述似然计算部使对于所述乐曲在时间轴上所指定的基准点的前方的期间中的观测似然下降。在以上的方式中,除了音响信号的解析结果之外,暗号动作的检测结果也在演奏位置的估计中被考虑,因此与例如仅考虑音响信号的解析结果的结构相比,能够高精度地估计演奏位置

(9)关于在前述的方式中例示的自动演奏系统,例如掌握以下的结构。

[方式B1]

本发明的优选的方式(方式B1)所涉及的自动演奏系统具备:暗号检测部,检测演奏乐曲的演奏者的暗号动作;演奏解析部,通过对表示所演奏的声音的音响信号与该演奏并行地解析而依次估计乐曲内的演奏位置;以及演奏控制部,使自动演奏装置执行乐曲的自动演奏以使暗号检测部检测的暗号动作和演奏解析部估计的演奏位置的进行同步;以及显示控制部,使显示装置显示表示自动演奏的进行的图像。在以上的结构中,执行自动演奏装置的自动演奏以使演奏者的暗号动作和演奏位置的进行同步,另一方面,表示自动演奏装置的自动演奏的进行的图像在显示装置上被显示。因此,演奏者能够视觉确认自动演奏装置的自动演奏的进行而使其反映在自身的演奏上。即,实现演奏者的演奏和自动演奏装置的自动演奏相互作用配合的自然的演奏。

[方式B2]

在方式B1的优选例(方式B2)中,演奏控制部对自动演奏装置指示乐曲中相对于演奏解析部估计出的演奏位置靠后的时点的演奏。在以上的方式中,在时间上相对于演奏解析部估计出的演奏位置靠后的时点的演奏内容被指示给自动演奏装置。因此,即使在自动演奏装置的实际的发声相对于演奏控制部的演奏的指示延迟的情况下,也能够使演奏者的演奏和自动演奏高精度地同步。

[方式B3]

在方式B2的优选例(方式B3)中,演奏解析部根据音响信号的解析而估计演奏速度,演奏控制部对自动演奏装置指示乐曲中相对于演奏解析部估计出的演奏位置靠后了与演奏速度对应的调整量的时点的演奏。在以上的方式中,相对于演奏位置靠后了与演奏解析部估计出的演奏速度相应的可变的调整量的时点的演奏被指示给自动演奏装置。因此,即使在例如演奏速度变动的情况下,也能够使演奏者的演奏和自动演奏高精度地同步。

[方式B4]

在方式B1到方式B3的任一个优选例(方式B4)中,暗号检测部通过摄影装置摄影了演奏者的图像的解析而检测暗号动作。在以上的方式中,根据通过摄影装置摄影的图像的解析而检测暗号动作,与例如在演奏者的身体上穿戴检测器而检测暗号动作的情况相比,具有能够降低对于演奏者的演奏的影响并检测暗号动作的优点。

[方式B5]

在方式B1到方式B4的任一个优选例(方式B5)中,显示控制部使显示装置显示根据自动演奏的演奏内容而动态地变化的图像。在以上的方式中,根据自动演奏的演奏内容而动态地变化的图像在显示装置上被显示,因此具有演奏者能够在视觉上且直观地掌握自动演奏的进行的优点。

[方式B6]

就本发明的优选的方式(方式B6)所涉及的自动演奏方法而言,计算机系统检测演奏乐曲的演奏者的暗号动作,通过对表示所演奏的声音的音响信号与该演奏并行地解析而依次估计乐曲内的演奏位置,使自动演奏装置执行乐曲的自动演奏以使暗号动作和演奏位置的进行同步,并使显示装置显示表示自动演奏的进行的图像。

<详细的说明>

本发明的优选的方式可以表现如下。

1.前提

自动演奏系统是指机械对人类的演奏进行配合而生成伴奏的系统。这里,说明给出了像古典音乐那样,自动演奏系统和人类分别应弹奏的乐谱表现的自动演奏系统。这样的自动演奏系统具有音乐演奏的练习辅助或者配合演奏者而驱动电子乐器这样的音乐扩展表现等广泛的应用。另外,在以下,将合奏引擎演奏的部分称为“伴奏部分”。为了进行在音乐上整合的合奏,有必要适当地控制伴奏部分的演奏定时。在适当的定时控制中,有以下所述的4个要求。

[要求1]原则上,自动演奏系统需要弹奏人类演奏者弹奏的地方。因此,自动演奏系统需要把播放的乐曲的位置与人类演奏者配合。特别是在古典音乐中,由于演奏速度(节拍)的抑扬在音乐表现上较为重要,所以有必要追随演奏者的节拍变化。另外,为了进行精度更高的追随,优选通过分析演奏者的练习(彩排),获得演奏者的习惯。

[要求2]自动演奏系统生成在音乐上整合的演奏。也就是说,需要在保持伴奏部分的音乐性的范围内追随人类的演奏。

[要求3]根据乐曲的背景(context),可以改变伴奏部分配合演奏者的程度(主从关系)。乐曲中,有时即使多少损害了音乐性也应该配合人,或者有时即使破坏了追随性也应该保持伴奏部分的音乐性。因此,要求1和要求2中分别叙述的“追随性”和“音乐性”的平衡根据乐曲的背景而改变。例如,有节奏(rhythm)不清晰的部分追随具有更清晰的节奏的部分的倾向。

[要求4]根据演奏者的指示,可以立即改变主从关系。在彩排中人们之间常常通过对话来调整追随性和自动演奏系统的音乐性的权衡(trade off)。另外,在进行这样的调整的情况下,通过重弹调整过的部分来确认调整结果。因此,在彩排中需要能够设定追随性举动的自动演奏系统。

为了同时满足这些要求,在追随演奏者演奏的位置的基础上,需要生成伴奏部分以不出现音乐性的破绽。为了实现这些,自动演奏系统需要三个要素:(1)预测演奏者位置的模型,(2)用于生成音乐的伴奏部分的定时生成模型,(3)基于主从关系,校正演奏定时的模型。另外,这些要素需要能够独立操作或学习。但是,以往很难独立处理这些要素。因此,在以下的说明中,考虑了(1)演奏者的演奏定时生成过程,(2)表现了自动演奏系统能够在音乐上演奏的范围的演奏定时生成过程,(3)用于自动演奏系统在保持主从关系的同时配合演奏者的、结合自动演奏系统和演奏者的演奏定时的过程,将这三个要素独立地模型化,进行统合。通过独立表现,可以独立学习或操作各个要素。在使用系统时,一边推断演奏者的定时生成过程,一边推断自动演奏系统能够演奏的定时的范围,并播放伴奏部分,以使协调合奏和演奏者的定时。由此,自动演奏系统可以配合人类并演奏在音乐上没有破绽的合奏。

2.关联技术

在以往的自动演奏系统中,通过使用乐谱追随来估计演奏者的演奏定时。在此基础上,为了协调合奏引擎和人类,大致可以使用两种方法。第一,提出了通过大量彩排而对对于演奏者和合奏引擎的演奏定时的关系性进行回归,获得乐曲中的平均举动或者时刻变化的举动。在这样的方法中,由于对合奏的结果本身进行回归,故结果上能够同时获得伴奏部分的音乐性和伴奏部分的追随性。另一方面,认为由于难以切分地表现演奏者的定时预测、合奏引擎的生成过程和配合程度,所以在彩排中独立操作追随性或音乐性是很困难的。另外,为了获得音乐的追随性,由于需要另外解析人类之间的合奏数据,所以内容准备上需要花费成本。第二,存在通过使用由少量参数记述的动态系统,对节拍轨迹设置限制的方法。在这个方法中,在设置了节拍连续性这样的事先信息的基础上,通过彩排而学习演奏者的节拍轨迹等。另外,伴奏部分还可以能够学习伴奏部分的发声定时。由于它们使用很少的参数来记述节拍轨迹,所以在彩排中能够容易地手动改写伴奏部分或人类的“习惯”。但是,难以独立地操作追随性,追随性根据演奏者和合奏引擎各自独立演奏时的发声定时的偏差而间接地得到。为了提高彩排中的爆发力,认为交替进行自动演奏系统的学习以及自动演奏系统和演奏者的对话是有效的。因此,为了独立地操作追随性,提出了调整合奏播放逻辑本身的方法。在本方法中,基于这样的想法,考虑能够独立且以对话的方式控制“配合方法”“伴奏部分的演奏定时”“演奏者的演奏定时”这样的数理模型。

3.系统概述

自动演奏系统的结构如图12所示。在本方法中,为了追随演奏者的位置,基于音响信号和照相机影像进行乐谱追随。另外,以从乐谱追随的后验分布中得到的统计信息为基础,基于演奏者正演奏的位置的生成过程,预测演奏者的位置。为了决定伴奏部分的发音定时,通过将预测演奏者的定时的模型和伴奏部分可取的定时的生成过程结合,生成伴奏部分的定时。

4.乐谱追踪

为了估计演奏者当前正弹奏的乐曲中的位置,使用乐谱追随。在本系统的乐谱追随方法中,考虑同时表现乐谱位置和演奏的节拍的离散的状态空间模型。将观测声音模型化作为状态空间上的隐秘马尔可夫过程(hidden Markov model;HMM),用delayed-decision(延迟决策)型的forward-backward(向前-向后)算法依次估计状态空间的后验分布。delayed-decision(延迟决策)型的forward-backward(向前-向后)算法是指依次执行forward(向前)算法,通过运行当前时刻被视为数据的末端的backward(向后)算法,计算出对于与当前时刻相比几帧前的状态的后验分布。在后验分布的MAP值在乐谱上通过被视为开启(onset)的位置的时点,输出后验分布的拉普拉斯近似。

关于状态空间的构造进行论述。首先,将乐曲分成R个区间,并将各个区间设为一个状态。在第r个区间中,将通过该区间所需要的帧数n、和对于每个n而当前的经过帧0≤1<n作为状态变量来持有。即,n相当于某区间的节拍,r和l的组合相当于乐谱上的位置。将这样的状态空间上的迁移表现为如下的马尔可夫过程。

【数1】

(1)从(r,n,l)到自身:p

(2)从(r,n,l (3)从(r,n,n-1)到(r+1,n’,()): 这种模型同时具备explicit-duration HMM(显式期间HMM)和left-to-right HMM(从左到右HMM)双方的优点。即,通过n的选择,能够大致决定区间内的持续长度,并且通过自我迁移概率p吸收区间内的微小的节拍变动。区间的长度或自我迁移概率是通过解析乐曲数据而求得的。具体来说,活用节拍指令或者延长符号等注释信息。 接下来,定义这样的模型的观测似然。各个状态(r,n,l)对应某个乐曲中的位置~s(r,n,l)。此外,对于乐曲中的任意位置s,除了被观测到的定Q变换(CQT)和ΔCQT的平均值/~c 【数2】

这里,vMF(x|μ,κ)是指von Mises-Fisher分布,具体而言,将其标准化为x∈S 【数3】

在决定~c或Δ~c时,使用乐谱表现的钢琴卷帘(piano roll)和根据各个音而设想的CQT的模型。首先,对于乐谱上存在的音高和乐器名的对,分配特定的索引i。另外,对于第i个音,分配平均观测CQTω 【数4】

从无声的状态开始乐曲时,视觉信息变得更加重要。因此,在本系统中,如前所述,活用从被配置于演奏者之前的照相机中检测出的暗号动作(cue)。在本方法中,与自上而下控制自动演奏系统的方法不同,通过在观测似然中直接反映有没有暗号动作,统一地处理音响信号和暗号动作。因此,首先从乐谱信息中提取需要暗号动作的地方{^q 5.演奏定时结合模型 合奏引擎以由乐谱追随通知的信息(t 5.1演奏者的演奏定时生成过程 为了表现演奏者的演奏定时,假定演奏者在t 【数5】

噪声ε 接下来,考虑将乐谱追踪系统所报告的、用户的演奏定时的历史/μ 【数6】

这里,/W 【数7】

不是像以往那样使用最近的μ 5.2伴奏部分的演奏定时生成过程 如上所述,能够通过使用演奏者的定时模型,从乐谱追随所报告的位置的历史中推断演奏者的内部状态[x 在伴奏部分的演奏定时,考虑以从所给出的节拍轨迹起一定的范围内的节拍轨迹而被演奏的过程。所给出的节拍轨迹是指,考虑使用演奏表情附加系统或者人类的演奏数据。在自动演奏系统收到第n个开启事件时,弹奏乐曲上的哪个位置的预测值^x 【数8】

这里,~v 5.3演奏者和伴奏部分的演奏定时结合过程 至此,分别将演奏者的发声定时和伴奏部分的发声定时独立进行了模型化。在此,基于它们的生成过程,叙述在聆听演奏者的同时,伴奏部分“配合”的过程。因此,考虑描述如下举动:伴奏部分与人配合时,将伴奏部分当前要弹奏的位置的预测值和演奏者的当前位置的预测值的误差慢慢地校正。以下,将这种描述校正误差的程度的变量称为“结合系数”。结合系数受伴奏部分和演奏者的主从关系的影响。例如,在演奏者的节奏比伴奏部分清晰的情况下,伴奏部分大多与演奏者紧密配合。另外,在彩排中,从演奏者指示了主从关系的情况下,需要按照指示来改变配合方法。即,结合系数根据乐曲的背景或与演奏者的对话而变化。因此,在给出了收到t 【数9】

在该模型中,追随程度根据γ β=0.9时的本模型的仿真如图13所示。可知通过这样改变γ,能够在伴奏部分的节拍轨迹(正弦波)和演奏者的节拍轨迹(阶跃(step)函数)之间进行补充。另外,可知通过β的影响,生成的节拍轨迹比演奏者的节拍轨迹更接近设为伴奏部分的目标的节拍轨迹。即,认为具有如下效果:在演奏者比~v 5.4结合系数γ的计算方法 通过几个因素来设定结合系数γ 【数10】

这里,设ε>0为足够小的值。与在人与人的合奏中难以发生完全单方面的主从关系(γ 另外,在彩排中等,演奏者或者操作人员能够根据需要改写γ 5.5在线推断 自动演奏系统的运用时,在收到(t 【数11】

这里τ 6.评价实验 为了评价本系统,首先评价演奏者的位置估计精度。关于合奏的定时生成,通过进行对演奏者的聆听而评价设为要将合奏的节拍拉回规定值的项即β、或者将伴奏部分多大程度与演奏者配合的指标即γ的有效性。 6.1乐谱追随的评价 为了进行乐谱追随精度的评价,评价对于Bergmuller(布格缪勒)的练习曲的追随精度。作为评价数据,使用录制了由钢琴家演奏Bergmuller的练习曲(Op.100)中的14首(1号、4号-10号、14号、15号、19号、20号、22号、23号)的数据,评价谱面追随精度。另外,在该实验中没有使用照相机的输入。评价尺度上参照MIREX,评价Total precision(整体精度)。Total precision(整体精度)是指,表示在将对准的误差收敛于某一阈值τ的情况作为正确解答时,对于语料库(corpus)整体的精度。 首先,为了验证与delayed-decision(延迟决策)型的推断有关的有效性,评价对于delayed-decision forward backward(延迟决策向前向后)算法中的延迟帧量的totalprecision(整体精度)(τ=300ms)。结果如图14所示。可知通过活用数帧前的结果的后验分布而提高精度。此外,可知若延迟量超过2帧则精度慢慢下降。此外,在延迟量2帧的情况下,在τ=100ms时total precision(整体精度)=82%,在τ=50ms时为64%。 6.2演奏定时结合模型的验证 演奏定时结合模型的验证是通过对演奏者的聆听来进行的。作为本模型的特征,存在合奏引擎要拉回设想节拍的β和结合系数γ,对这两者的有效性进行验证。首先,为了消除结合系数的影响,准备了将式(4)设为v 接下来,在β=0.1的条件下使用相同的曲目而由其他5名钢琴家和也参加了β=0的实验的1名钢琴家来进行实验。用β=0时相同的提问内容进行了聆听,但没有听到节拍发散的问题。此外,在β=0的条件下也协助了实验的钢琴家还发表了追随性得到改善的意见。但是,听到了当演奏者对于某首曲子设想的节拍和系统想要拉回的节拍有很大的分歧时,系统会产生延迟/加速的意见。这种倾向在演奏未知乐曲时,即演奏者不知道“常识性的”节拍时出现。这表明,通过系统试图引入一定节拍的效果,将节拍的发散防患于未然,另一方面,当与伴奏部分和节拍相关的解释极端不同时,伴奏部分会给人一种煽动性的印象。另外,关于追随性,也表明了根据乐曲的背景来改变比较好。理由在于,根据乐曲的特性,“最好是拉回”、“希望更好地配合”等关于配合方法的程度的意见基本一致。 最后,在专业的弦乐四重奏中使用了固定为γ=0的系统和根据演奏的背景而调整了γ的系统,有后者的举动更好的意见,这表明了其有效性。但是,在这个验证中,因为实验对象知道后者的系统是改善后的系统,所以有必要适当地使用AB法等进行追加验证。另外,由于存在若干根据彩排中的对话而变更γ的局面,表明了在彩排中变更结合系数是有用的。 7.事先的学习处理 为了获得演奏者的“习惯”,基于通过乐谱追随而计算出的时刻t的MAP状态^s 【数12】

这里出现的超参数根据乐器声音数据库或乐谱表现的钢琴卷帘适当地算出。后验分布用变分贝叶斯法近似地估计。具体来说,用q(h)q(w)的形式对后验分布p(h,ω|c)进行近似,并在导入辅助变量的同时使后验分布和q(h)q(w)之间的KL距离最小化。从这样估计的后验分布中,保存相当于乐器声音的音色的参数ω的MAP估计,在以后的系统运用中使用。另外,也能够使用相当于钢琴卷帘的强度的h。 接着,估计演奏者演奏各个乐曲上的区间的长度(即节拍轨迹)。若估计节拍轨迹则能够复原演奏者特有的节拍表现,因此演奏者的位置预测被改善。另一方面,在彩排的次数少的情况下,存在由于估计误差等,节拍轨迹的估计出错,位置预测的精度反而恶化的可能性。因此,在变更节拍轨迹时,考虑首先使其具有与节拍轨迹相关的事先信息,只改变演奏者的节拍轨迹一直脱离事先信息的部分的节拍。首先,计算演奏者的节拍有多偏离。若彩排的次数少则偏离程度的估计值本身也变得不稳定,故演奏者的节拍轨迹的分布本身也具有事先分布。设演奏者在乐曲中的位置s中的节拍的平均μ 【数13】

若求取将这样得到的后验分布看作是根据乐曲中的位置s可以取得的节拍分布N(μ 【数14】

基于这样计算出的节拍,更新在式(3)或者式(4)中使用的ε的平均值。 <第3实施方式> 说明本发明的第3实施方式。在本实施方式中,自动演奏系统100识别演奏者P的暗号动作而进行演奏。另外,关于在以下例示的各方式中作用或者功能与第1实施方式相同的元素,沿用在第1实施方式的说明中使用的标号并适当地省略各自详细的说明。 就本实施方式中的暗号动作而言,特别地,以通过演奏者P的面部的运动进行的动作为前提。本实施方式中的暗号动作通过动作来表现使事件发生的定时。这里的事件是演奏中的各种举动,例如,是表示发声的开始、结束、节拍的周期等的定时。本实施方式中的暗号动作例如是将视线投向递送暗号的对方的方向、点头、随声附和、抬头以轻轻吸气等动作。 图15是表示第3实施方式的检测处理部524的结构的例子的框图。检测处理部524例如包括取得部5240、判定部5241、估计部5242、输出部5243、面部部分提取模型5244、以及暗号动作估计模型5245。 取得部5240取得图像信息。图像信息是摄影了演奏者P的演奏的情形的图像的信息,例如是包含由图像合成部522生成的图像信号V的信息。 在本实施方式中,图像信息是包含深度信息的信息。深度信息是表示图像中的每个像素的从规定的位置(例如,摄影位置)到被摄体为止的距离的信息。此时,录制装置22中的多个摄影装置222中至少包含一个深度照相机。深度照相机是测量到被摄体为止的距离的测距传感器,例如照射红外线等光线,并基于接收到所照射的光线由被摄体反射的反射光为止所需的时间,测量到被摄体为止的距离。或者,多个摄影装置222中也可以包含立体照相机。立体照相机通过从多个不同的方向对被摄体进行摄影而计算到被摄体为止的纵深值(深度信息)。 取得部5240以规定的时间间隔反复取得图像信息。另外,这里的规定的时间间隔是任意,可以是周期的,也可以随机的,也可以是将它们混合的。取得部5240将取得的图像信息输出至判定部5241。 判定部5241基于从取得部5240取得的图像信息,从图像信息所示的图像(以下,称为摄影图像)中提取包含人的眼睛的面部部分(以下,称为面部部分)。 具体地,判定部5241首先从摄影图像中分离背景。判定部5241例如使用像素的深度信息,将到被摄体为止的距离大于规定的阈值的像素判定为背景,通过提取到被摄体为止的距离小于规定的阈值的区域,从摄影图像中分离背景。此时,即使是到被摄体为止的距离小于规定的阈值的区域,判定部5241也可以将该区域的面积小于规定的阈值的区域也判定为背景。 接下来,判定部5241使用分离了背景的图像和面部部分提取模型5244来提取面部部分。面部部分提取模型5244是通过使学习模型学习教师数据而创建的学习完毕模型。学习模型例如是CNN(卷积神经网络(Convolutional Neural Network))。教师数据是将摄影了包含人的眼睛的面部部分的学习用图像和判定了所述学习用图像中的人的面部部分的判定结果进行关联的数据(数据集合)。通过学习教师数据,面部部分提取模型5244成为如下的模型:从输入的图像中估计该图像中的人的面部部分,并输出估计结果。判定部5241基于将从取得部5240取得的图像信息输入面部部分提取模型5244而得到的输出,提取面部部分。 接下来,判定部5241基于从摄影图像中提取的面部部分的图像(以下,称为提取图像),检测该面部部分的运动。判定部5241例如通过以时序为顺序比较提取图像,检测面部部分的运动。判定部5241例如对提取图像中的特征点进行提取,并基于提取出的特征点的位置坐标中的时序上的变化,检测面部部分的运动。这里的特征点是表示面部部分的特征性的部位的点,例如眼角、眉梢等。如果提取图像中包含眼睛以外的部分,则也可以将嘴角等作为特征点而提取。 判定部5241基于提取图像,检测视线的方向。判定部5241对提取图像中的眼睛的区域进行提取。提取眼睛的区域的方法可以是任意的,例如可以使用与面部部分提取模型5244相同的学习完毕模型,也可以使用其他的图像处理的方法。例如,判定部5241基于面部的朝向而判定视线的方向。通常,这是由于认为演奏者P将面部朝向进行暗号的对方的方向而看着对方进行暗号。判定部5241基于左右眼睛或眉毛等相对于面部的上下方向的中心线左右对称的部分的深度信息,判定面部中的左右方向的朝向。判定部5241例如在视为左右眼睛各自的距离之差小于规定的阈值,左右眼睛到深度照相机大致等距离的情况下,判定为面部正面面向深度照相机,视线的方向在其正面的方向。对于上下方向的朝向能够采用同样的方法进行判定。 判定部5241使用检测的结果来判定是否进行了与表示事件的定时的暗号动作关联的预备动作。预备动作是暗号动作中的一部分动作,或者是与暗号动作有联系的动作,是在暗号动作中表示的发声的开始等定时之前进行的预备的动作。例如在通过点头进行暗号动作的情况下,预备动作是在抬起面部的动作(以下,也称为cue-up)之前进行的、低下面部的动作(以下,也称为cue-down)。或者,在通过抬头以轻轻吸气而进行暗号动作的情况下,预备动作是在抬起面部前进行的吐气的动作。 判定部5241例如在面部部分的运动是沿着表示点头的上下的方向(“第1方向”的一例),且视线的方向是进行暗号的对方的方向(“第2方向”的一例)的情况下,判定为进行了预备动作。判定部5241将预备动作的判定结果输出至估计部5242。 估计部5242基于判定部5241的判定结果,根据表示了预备动作的图像,估计事件发生的定时。估计部5242例如使用表示包含预备动作的一系列的动作的流程的图像组、和暗号动作估计模型5245,估计事件发生的定时。暗号动作估计模型5245是通过使学习模型学习教师数据而创建的学习完毕模型。学习模型例如是LSTM(长短期记忆(Long Short-Term Memory))。教师数据是将摄影了包含人的眼睛的面部部分的时序的学习用图像和判定了所述学习用图像中的暗号动作的判定结果进行关联的数据(数据集合)。这里的暗号动作中可以包含用于判定暗号动作的各种动作,例如包含暗号动作(cue-up)、预备动作(cue-down)、视线看着或不看特定的方向等动作。通过学习教师数据,暗号动作估计模型5245成为如下的模型:从所输入的时序图像组中,估计该一系列的图像中的下一个图像所示的动作,并输出估计结果。判定部5241基于将表示包含预备动作的一系列的动作的流程的图像组输入面部部分提取模型5244而得到的输出,估计使事件发生的定时。 输出部5243输出表示由估计部5242估计的使事件发生的定时的信息。 面部部分提取模型5244是将把摄影了包含人的眼睛的面部部分的学习用图像和判定了学习用图像中的人的面部部分的判定结果进行了关联的数据集合作为教师数据并进行学习,以输出所输入的图像中的人的面部部分的模型。 暗号动作估计模型5245是将把摄影了包含人的眼睛的面部部分的学习用图像和判定了学习用图像中的暗号动作的判定结果进行了关联的数据集合作为教师数据并进行学习,以输出在所输入的图像中是否进行了所述暗号动作的模型。 图16是表示检测处理部524进行的处理的流程的流程图。 取得部5240取得图像信息。取得部5240将取得的图像信息输出至判定部5241(步骤S10)。 判定部5241基于图像信息,提取对图像中的面部部分进行了摄影的区域(步骤S11),并基于提取的图像,检测面部部分的运动以及视线的方向。判定部5241基于检测结果,判定面部部分的运动是否是规定的方向(步骤S12)。此外,判定部5241判定视线的方向是否是特定的方向(在图16中是照相机方向)(步骤S13)。判定部5241基于面部部分的运动以及视线的方向,判定是否是进行了与暗号动作关联的预备动作的图像,并将判定结果输出至估计部5242。 估计部5242基于由判定部5241判定为进行了预备动作的图像的图像信息,估计使事件发生的定时(步骤S14)。估计部5242例如使用包含预备动作的一系列的时序图像组、和暗号动作估计模型5245,通过估计接下来进行的动作,估计使事件发生的定时。估计部5242将估计结果输出至输出部5243。 输出部5243输出由估计部5242估计的估计结果。输出部5243例如输出与所估计的使事件发生的定时对应的演奏开始信号(步骤S15)。 如以上说明的那样,第3实施方式的自动演奏系统100(控制系统)具备取得部5240、判定部5241、估计部5242、以及输出部5243。取得部5240取得图像信息。判定部5241基于图像信息,在图像信息所示的摄影图像中摄影了包含人的眼睛的面部部分的情况下,检测该面部部分的运动和该人的视线的方向,并使用所述检测出的结果,判定是否进行了与表示使事件发生的定时的暗号动作相关联的预备动作。估计部5242在由判定部5241判定为进行了预备动作的情况下,基于图像信息,估计使事件发生的定时。输出部5243输出由估计部5242估计的估计结果。 由此,第3实施方式的自动演奏系统100能够基于面部的运动而估计使事件发生的定时。即,在乐曲的演奏中发声的开始定时、延长符号的恢复定时、乐曲的最后的声音的发声以及停止的定时配合等设想了基于目光接触的暗号的局面中,演奏者P能够基于面部的运动以及视线方向所表示的暗号动作,控制自动演奏系统100的演奏。 在第3实施方式中,使用对包含眼睛的面部部分进行了摄影的图像来进行估计。因此,在摄影了管乐器等的演奏者P的图像中,即使在演奏者P的面部的一部分被乐器等遮住(发生遮挡(occlusion))的情况下,也能够使用在演奏的过程中难以发生遮挡的眼睛的周边部分来识别暗号动作,并估计使事件发生的定时。因此,即使在演奏中进行各种动作的情况下,也能够可靠地进行估计。 在第3实施方式中,使用面部部分的运动和视线的方向双方来进行估计。因此,能够区分演奏者P过于集中于演奏而使面部或身体运动的动作、和暗号动作,故与仅通过面部部分的运动来进行估计的情况相比能够提高估计的精度。 此外,在第3实施方式的自动演奏系统100中,估计部5242使用暗号动作估计模型5245,估计使事件发生的定时。由此,能够不进行复杂的图像处理,而通过使得图像输入至模型这样简单的方法来进行估计。因此,与进行复杂的图像处理的情况相比能够期待处理负担的减轻或处理时间的缩短。此外,通过使暗号动作估计模型5245学习的教师数据,能够对于发声的开始、节拍的周期等各种事件估计其定时,能够应对任意的事件。 此外,在第3实施方式的自动演奏系统100中,判定部5241基于图像信息,在所述面部部分的运动为沿着点头那样的上下方向(特定的第1方向),且视线的方向为进行暗号的对方的方向(特定的第2方向)的情况下,判定为进行了预备动作。由此,能够基于暗号动作中的特征性的、特定的方向上的运动、以及视线的方向来进行判定,能够提高精度。 此外,在第3实施方式的自动演奏系统100中,判定部5241使用面部部分提取模型5244,检测所述面部部分的运动。由此,能够实现与上述效果相同的效果。 此外,在第3实施方式的自动演奏系统100中,上述图像信息按图像中的每个像素而包含表示与被摄体的距离的深度信息,判定部5241基于深度信息,分离摄影图像中的背景而提取图像中的面部部分。面部所示的眼睛的区域是相对狭窄的区域,因此从图像中提取的眼睛的区域中的像素数比其他区域少。此外,眼睛的形状或颜色比其他部位复杂。因此,即使在能够正确地提取眼睛的区域的情况下,与其他区域相比也易于混入噪声。因此,即使要通过对提取了眼睛的区域的图像进行图像处理而检测面部的朝向,也难以高精度地进行提取。相对于此,在本实施方式中使用深度信息。就深度信息而言,即使在眼睛的周边,与颜色信息等相比也没有复杂地变化。因此,基于眼睛的周边的深度信息(depth信息),能够高精度地检测面部的朝向。此外,从摄影装置222到演奏者P为止的大致的距离能够在事先掌握。因此,如果使用深度信息,能够不进行轮廓提取等复杂的图像处理,而容易地分离背景而提取演奏者P。通过将背景的像素从解析的对象中排除,不仅能够实现处理的高速化,还期待减少误检测。 另外,在上述中,以基于图像信息而检测视线的方向的情况为例进行了说明,但不限于此。例如,也可以使用眼球追踪等,基于对眼球照射的红外线的反射光而检测出的角膜和瞳孔的相对位置关系,检测视线的方向。 此外,也可以使用第3实施方式的自动演奏系统100,使合奏用的代理(agent)进行反应。例如,若演奏者P注视搭载了照相机的机器人,则也可以使机器人进行看着演奏者P的动作。进一步,若演奏者P进行暗号动作(例如,cue-up)或预备动作(例如,cue-down),则配合着该动作而机器人也进行附和。由此,能够进行自动演奏系统100对于演奏者P同步的演出。 对本发明的一些实施方式进行了说明,但是这些实施方式是作为例子提出的,并不意图限定发明的范围。这些实施方式能够以其他各种方式实施,在不脱离发明主旨的范围内,可以进行各种省略、置换、变更。这些实施方式和其变形,与包含在发明的范围和主旨中一样地,被包含在权利要求中记载的发明和其均等的范围内。

- 车辆用控制装置、车辆用控制系统、车辆用控制方法及车辆用控制系统的控制方法

- 机器人控制系统、机械控制系统、机器人控制方法、机械控制方法和记录介质