一种基于联邦学习的防窃取攻击医疗诊断模型保护方法

文献发布时间:2023-06-19 11:26:00

技术领域

本发明涉及医疗诊断保护技术领域,尤其涉及一种基于联邦学习的防窃取攻击医疗诊断模型保护方法。

背景技术

智能医疗领域中,通常会运用电子健康数据,提取患者特征,识别患者人群,简单来说就是用临床数据训练一个疾病诊断模型。这些临床数据通常是涉及病患隐私的敏感数据,因此医疗机构之间的数据往往无法互通。然而大部分医院(或数据中心)数据量都是有限的,持有的数据不足以训练一个好的模型。只有大型医疗AI云服务商可以提供好的模型服务,例如模型训练和识别等,这些服务通常以接口形式对外开放,用户可以调用其完成医疗影像识别、疾病诊断预测等操作;模型窃取攻击是指攻击者通过查询,分析系统的输入输出和其他外部信息,推测系统模型的参数及训练数据信息,对于攻击者来说,模型是一个黑盒,攻击者可以挑选输入值,来观察模型的预测结果;

攻击者可以通过多次调用医疗AI云服务的接口,把AI模型“窃取”出来,这会带来两个问题:一是知识产权的窃取。样本收集和模型训练需要耗费很大资源,训练出来的模型是重要的知识产权;二是攻击者可以通过窃取的模型构造对抗样本,因此,可以在模型训练阶段采取特殊的保护方法降低模型被窃取的风险。

为了利用各医院或数据机构收集的敏感医疗数据训练效果更好的医疗诊断模型,并防止模型被窃取,我们提出一种基于联邦学习的防窃取攻击医疗诊断模型保护方法。

发明内容

本发明的目的是为了解决现有技术中存在的缺陷,而提出的一种基于联邦学习的防窃取攻击医疗诊断模型保护方法。

为了实现上述目的,本发明采用了如下技术方案:

一种基于联邦学习的防窃取攻击医疗诊断模型保护方法,该医疗诊断模型保护方法具体步骤如下:

S1、假设有N个医疗机构各收集N个敏感医疗数据集,各机构基于这些数据集独立训练不同的本地模型,得到N个teacher;

S2、在各医疗机构本地部署训练好的teacher,记录每一个teacher的预测结果,用于最终结果投票;

S3、引入拉普拉斯噪声,将票数的统计情况打乱,实现差分隐私保护;

S4、在联邦全局服务器聚合所有teacher的预测结果并进行投票,选取票数最高的作为最终结果,得到aggregated teacher;

S5、在联邦全局服务器用aggregated teacher对无标签的脱敏公共数据集进行标注,得到有标签脱敏公共数据集;

S6、在联邦全局服务器用步骤S5得到的有标签脱敏公共数据集训练新的深度神经网络模型student;

S7、将训练好的student提供给用户使用。

作为本发明进一步的方案:步骤S3中实现差分隐私保护的具体过程为:

SS1、在联邦全局邦服务器统计N个医疗机构本地训练的teacher模型的投票情况,形成聚合结果;

SS2、如果大部分teacher模型都同意某个预测结果,则不依赖于具体的分散数据集,即隐私成本很小;如果两类预测结果有相近的票数,则这种不一致或许会泄露隐私信息,因此在投票形成aggregated teacher前,增加差分隐私;

SS3、把联邦全局服务器聚合的aggregated teacher视为差分隐私模块,用户提供输入数据(也就是待预测样本),aggregated teacher能返回保护隐私的标签。

作为本发明进一步的方案:步骤SS2中所述差分隐私步骤具体为:引入拉普拉斯噪声,把票数的统计情况打乱,保护隐私。

作为本发明进一步的方案:步骤S6训练新的深度神经网络模型student的主要因素为:

(1)步骤S4中的aggregated teacher的差分隐私保护有限,如果攻击者多次调用aggregated teacher差分隐私模块,则可能会通过输出结果获得某些隐私信息;

(2)步骤S6中的深度神经网络模型student是脱敏的模型,可在用户设备上直接运行,能避免攻击者直接多次调用aggregated teacher差分隐私模块,降低泄露风险。

作为本发明进一步的方案:步骤S6中的深度神经网络模型student是基于未标记的脱敏公共数据集训练的,且在训练深度神经网络模型student前,需先用aggregatedteacher对该脱敏公共数据集完成标注。

相比于现有技术,本发明的有益效果在于:

1、引入联邦学习框架,充分利用各医疗机构本地有限的数据集训练本地teacher模型。在联邦全局服务器聚合成aggregated teacher模型,可以在获取各医疗机构本地数据知识的同时,确保各机构的数据隐私不被泄露;

2、在联邦全局服务器投票形成aggregated teacher前,通过添加了额外的差分隐私步骤:引入拉普拉斯噪声,把票数的统计情况打乱,这时通过把aggregated teacher视为一个差分隐私的模块,用户提供输入数据(也就是待预测样本),aggregated teacher就能返回保护隐私的标签;

3、在训练student前,通过先用aggregated teacher对脱敏的公共数据集完成标注,传递已习得的知识,并将训练好的student模型提供给用户使用,能够避免用户直接多次调用aggregated teacher,进一步降低了模型被窃取的风险。

附图说明

附图用来提供对本发明的进一步理解,并且构成说明书的一部分,与本发明的实施例一起用于解释本发明,并不构成对本发明的限制。

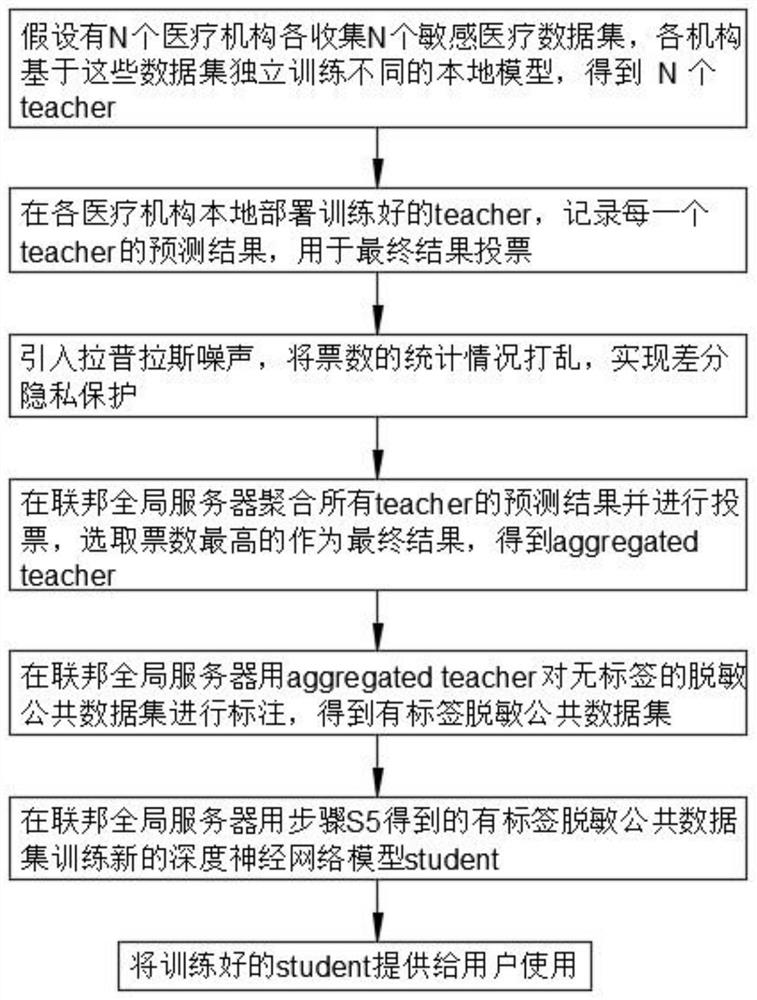

图1为本发明提出的一种基于联邦学习的防窃取攻击医疗诊断模型保护方法的流程框图。

具体实施方式

下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例。

在本发明的描述中,需要理解的是,术语“上”、“下”、“前”、“后”、“左”、“右”、“顶”、“底”、“内”、“外”等指示的方位或位置关系为基于附图所示的方位或位置关系,仅是为了便于描述本发明和简化描述,而不是指示或暗示所指的装置或元件必须具有特定的方位、以特定的方位构造和操作,因此不能理解为对本发明的限制。

参照图1,一种基于联邦学习的防窃取攻击医疗诊断模型保护方法,该医疗诊断模型保护方法具体步骤如下:

S1、假设有N个医疗机构各收集N个敏感医疗数据集,各机构基于这些数据集独立训练不同的本地模型,得到N个teacher;

S2、在各医疗机构本地部署训练好的teacher,记录每一个teacher的预测结果,用于最终结果投票;

S3、引入拉普拉斯噪声,将票数的统计情况打乱,实现差分隐私保护;

S4、在联邦全局服务器聚合所有teacher的预测结果并进行投票,选取票数最高的作为最终结果,得到aggregated teacher;

S5、在联邦全局服务器用aggregated teacher对无标签的脱敏公共数据集进行标注,得到有标签脱敏公共数据集;

S6、在联邦全局服务器用步骤S5得到的有标签脱敏公共数据集训练新的深度神经网络模型student;

S7、将训练好的student提供给用户使用。

步骤S3中实现差分隐私保护的具体过程为:

SS1、在联邦全局服务器统计N个医疗机构本地训练的teacher模型的投票情况,形成聚合结果;

SS2、如果大部分teacher模型都同意某个预测结果,则不依赖于具体的分散数据集,即隐私成本很小;如果两类预测结果有相近的票数,则这种不一致或许会泄露隐私信息,因此在投票形成aggregated teacher前,增加差分隐私步骤:引入拉普拉斯噪声,把票数的统计情况打乱,保护隐私;

SS3、把联邦全局服务器聚合的aggregated teacher视为差分隐私模块,用户提供输入数据(也就是待预测样本),aggregated teacher能返回保护隐私的标签。

步骤S6训练新的深度神经网络模型student的主要因素为:

(1)步骤S4中的aggregated teacher的差分隐私保护有限,如果攻击者多次调用aggregated teacher差分隐私模块,则可能会通过输出结果获得某些隐私信息;

(2)步骤S6中的深度神经网络模型student是脱敏的模型,可在用户设备上直接运行,能避免攻击者直接多次调用aggregated teacher差分隐私模块,降低泄露风险。

步骤S6中的深度神经网络模型student是基于未标记的脱敏公共数据集训练的,且在训练深度神经网络模型student前,需先用aggregated teacher对该脱敏公共数据集完成标注。

本发明的工作原理及使用流程:首先N个医疗机构各收集N个敏感医疗数据集,各机构基于这些数据集独立训练不同的本地模型,得到N个teacher,在各医疗机构本地部署训练好的teacher,记录每一个teacher的预测结果,用于最终结果投票,并通过引入拉普拉斯噪声,将票数的统计情况打乱,实现差分隐私保护,其次在联邦全局服务器聚合所有teacher的预测结果并进行投票,选取票数最高的作为最终结果,得到aggregatedteacher,并在联邦全局服务器用aggregated teacher对无标签的脱敏公共数据集进行标注,得到有标签脱敏公共数据集,并将有标签脱敏公共数据集训练新的深度神经网络模型student,最后将训练好的student提供给用户使用,通过在训练student前,先用aggregated teacher对这个公共数据集完成标注,传递已习得的知识,并将训练好的student模型提供给用户使用,能够避免用户直接多次调用aggregated teacher,进一步降低了泄露的风险。

以上所述,仅为本发明较佳的具体实施方式,但本发明的保护范围并不局限于此,任何熟悉本技术领域的技术人员在本发明揭露的技术范围内,根据本发明的技术方案及其发明构思加以等同替换或改变,都应涵盖在本发明的保护范围之内。

- 一种基于联邦学习的防窃取攻击医疗诊断模型保护方法

- 利用联邦学习基于区块链的医疗数据共享隐私保护方法