一种集成并显示机场地面对象综合信息的场监系统

文献发布时间:2023-06-19 09:29:07

技术领域

本发明涉及应用于机场的场面监视系统,尤其涉及一种集成并显示机场地面对象综合信息的场监系统。

背景技术

场面监视系统通常简称为场监系统,在场监系统中涉及的对象唯一标识通常指的是小车的车牌号、人的员工号、飞机的航班号。传统的场面监视系统,管制人员只能肉眼观察场监视频中航空器、车辆、保障人员的位置,无法直观获得其他信息进行综合判断。同时因恶劣环境、场地遮挡、人眼疲劳等因素的影响,致使机场地面对象在工作运行时的安全得不到有效保障,这在很大程度上降低了机场航班起降的效率。

目前将飞行计划、雷达定位数据、ADS-B设备数据、全景场监视频等信息进行融合显示还存在诸多问题。比如,由于ADS-B定位信息是间隔发出的,通常不能十分准确地将航班信息叠加到场监视频中对应的航空器上,而且会出现挂牌跳跃的问题。同时ADS-B设备可能被飞机驾驶员手动关闭,这就导致了无法持续挂牌的问题。

本专利所应用的重要技术包括:相机标定法、深度学习目标检测技术、多目标跟踪SORT算法。相机标定法,即为张正友教授于1998年在论文《A Flexible New Technique froCamera Calibration》中提出的基于单平面棋盘格的相机标定方法。深度学习中的目标检测模型有很多,如:R-CNN、Faster R-CNN、Yolo系列、SSD等,本专利对采用哪种模型不做限制。SORT算法中的多目标跟踪思路,最早来自于2016年的一篇论文《SIMPLE ONLINE ANDREALTIME TRACKING》。

发明内容

本发明旨在构建一种集成并显示机场地面对象综合信息的场监系统,该系统能够集成场监视频和各种外部数据,并通过视频显示综合信息,为管制员直观掌握场面动态提供便利。

为达到上述目的,本发明提供的技术方案如下:一种集成并显示机场地面对象综合信息的场监系统,其实现方法包括以下步骤:

S1:建立各场监摄像机图像空间与机场地理空间的映射模型;

S2:对场监视频进行目标检测和轨迹跟踪,获得机场地面对象连续轨迹点和全局轨迹号;

S3:计算解析综合信息,提取有效数据;

S4:将有效数据与机场地面对象关联匹配,并通过场监屏实时显示对象综合信息。

上述步骤S1建立各摄像机图像空间与机场地理空间的映射模型,其过程主要包含以下步骤:

S1.1:获取各个摄像机内参矩阵和畸变系数;

S1.2:获取各个摄像机位置与实际机场地面坐标的外参转换矩阵;

S1.3:根据内参矩阵、畸变系数、外参转换矩阵,建立机场地面坐标—摄像机图像坐标的转换矩阵;

S1.4:根据机场地面坐标—摄像机图像坐标的转换矩阵,建立摄像机图像空间—机场地理空间的映射模型。

上述步骤S2对场监视频进行目标检测和轨迹跟踪,获得机场地面对象连续轨迹点和全局轨迹号,其过程主要包含以下步骤:

S2.1:获取机场地面视频监控数据,包括摄相机历史监控视频和实时监控视频,将上述视频流转成图像帧;

S2.2:建立目标检测深度网络模型;

S2.3:制作训练数据,训练目标检测深度网络模型得到目标检测识别引擎;

S2.4:将实时监控视频的图像帧传入目标检测识别引擎,目标检测识别引擎输出该图像中包含的所有对象在对应摄像机中的坐标框、类别、置信度;

S2.5:对检测到的所有对象进行多目标轨迹跟踪,获得连续轨迹点和全局轨迹号,具体操作如下:

S2.5.1:各摄像机分别进行单相机内的多目标跟踪,获得机场对象的相机内轨迹号和识别信息;

S2.5.2:对跨摄像机运动的多个对象,根据其相机内轨迹号和识别信息,进行跨相机轨迹跟踪融合,获得机场地面对象连续轨迹点信息和全局轨迹号;

S2.5.3:对跟踪丢失又出现的对象,人工干预进行轨迹重连接。

上述步骤S3计算解析综合信息,提取有效数据,其过程主要包含以下步骤:

S3.1:根据上述步骤S2中获得的机场地面对象连续轨迹点,计算机场地面对象的实时速度、实时方向等信息;

S3.2:调用外部系统数据,从外部系统提取机场地面对象的唯一标识、位置、时间等有效信息;

S3.3:将管制指令的音频数据通过语音识别引擎转换为文字指令,提取出唯一标识(航班号),获得唯一标识、管制文字指令的对应数据。

上述步骤S4有效数据与机场地面对象关联匹配,并通过场监屏实时显示对象综合信息,其过程主要包含以下步骤:

S4.1:机场地面对象全局轨迹号与唯一标识进行配对;

首先,将步骤S2获得的“机场地面对象全局轨迹号”与“全局轨迹号—唯一标识的缓存池”进行配对,判断“机场地面对象全局轨迹号”是否在“全局轨迹号—唯一标识的缓存池”中,如果是,则继承全局轨迹号对应的唯一标识;

如果否,将步骤S2获得的“机场地面对象全局轨迹号”与步骤S3.2生成的有效数据根据时间、位置坐标等进行匹配,匹配成功,机场地面对象获得唯一标识;匹配失败,人工干预,赋予唯一标识;

最后,机场地面对象全局轨迹号与唯一标识配对后,存入“全局轨迹号——唯一标识的缓存池”中;

S4.2:机场地面对象全局轨迹号与唯一标识配对后,将两者各自对应的有效数据进行整合,获得机场地面对象的唯一标识、速度、方向、位置坐标、指令文字等综合信息;

S4.3:将获得的机场地面对象综合信息绘制到该对象所在的图像帧,再将图像帧转为视频流,输出到场监屏进行显示。

本发明具有以下有益效果:

由于传统的场面监视系统与其它外部系统(飞行计划、雷达定位数据、ADS-B设备数据)之间的互相独立,管制人员无法只通过视频就直观地了解场面动态情况。同时因各类数据的不同特点以及存在或多或少的问题(如:ADS-B定位数据是间隔发出的且可能会被飞机驾驶员手动关闭),通常不能在场监视频中很好地显示综合信息。本发明通过多目标轨迹跟踪技术,实现了对机场地面对象的连续监控,可以充分利用场面对象的历史匹配信息,避免了外部信息更新慢造成的显示跳跃问题以及外部系统关闭造成的信息丢失问题。本系统建立的视频场监系统,能够集成场监视频和各种外部数据,可以准确、实时、平滑、持续地显示机场地面对象及其对应的综合信息,丰富了传统场监视频的有效信息量,方便了管制人员对场面情况的了解判断,为管制员直观掌握场面动态提供便利。

附图说明

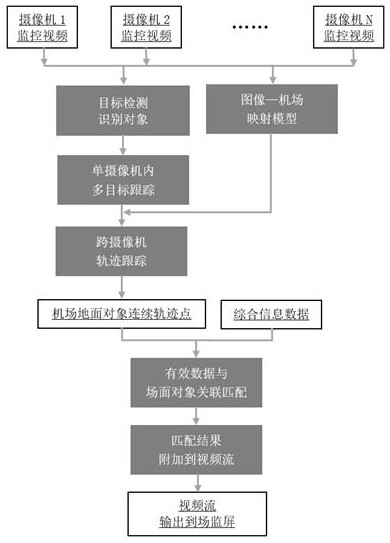

图1是本发明一种集成并显示机场地面对象综合信息的视频场监系统流程示意图;

图2是建立摄像机图像空间与机场地理空间映射模型的流程示意图;

图3是对各摄像机监控视频进行目标检测处理的流程示意图;

图4是对检测到的所有场面对象进行轨迹跟踪的流程示意图;

图5是有效数据与机场地面对象关联后由场监屏进行实时显示的流程示意图;

附图中简称说明:

摄像机图像空间与机场地理空间的映射模型,简称:图像—机场映射模型;

机场地面坐标—摄像机图像坐标的转换矩阵,简称:简称:机场—图像转换矩阵。

具体实施方式

下面将结合本实施例中的附图对本发明实施例作清楚完整的说明。所述的实施例仅仅是本发明的一部分实施例,而不是全部的实施例,基于本发明中的实施例,本领域普通技术人员在没有作出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

如图1所示,一种集成并显示机场地面对象综合信息的场监系统,其实现方法包括以下步骤:

S1:建立各场监摄像机图像空间与机场地理空间的映射模型;

其流程如图2所示,具体方式为:

S1.1:获取各个摄像机内参矩阵和畸变系数:将一张棋盘格打印下来固定到平板上制成标定板,使用场监相机从不同位置、不同角度,拍摄标定板的多张照片(一般不少于3张,以10-20张为宜),提取标定板内角点的世界坐标以及对应像素坐标,使用OpenCV求得相机内参矩阵和畸变系数并存入MySQL数据库。

S1.2:获取各个摄像机位置与实际机场地面坐标的外参转换矩阵:选取机场地面上至少四处标定点,获得三维的实际位置坐标(Z轴置0),以及它们对应的二维像素坐标,再从MySQL数据库中提取摄像机内部参数、畸变系数,最后通过对n点透视问题的PnP算法求得外参转换矩阵。

S1.3:根据内参矩阵、畸变系数、外参转换矩阵,建立机场地面坐标—摄像机图像坐标的转换矩阵:内参矩阵和外参转换矩阵都是通过OpenCV求得的,是向量的形式,所以首先需将旋转向量转化为旋转矩阵,再通过内参矩阵与外参转换矩阵相乘,即可得到机场地面坐标—摄像机图像坐标的转换矩阵。

S1.4:根据机场地面坐标—摄像机图像坐标的转换矩阵,建立摄像机图像空间—机场地理空间的映射模型:机场地面坐标—摄像机图像坐标转换矩阵的逆矩阵即为待求的矩阵,但因为它是一个3行4列矩阵,不是方阵故无法直接求逆。本专利的应用场景是机场地面,其特点是三维坐标的Z轴为0,所以可以删除机场地面坐标—摄像机图像坐标转换矩阵的第3列(该列元素全为0)得到一个3阶方阵,最后求逆得到摄像机图像空间—机场地理空间的映射模型。

:对场监视频进行目标检测和轨迹跟踪,获得机场地面对象连续轨迹点和全局轨迹号;

目标检测的流程如图3所示,主要步骤为S2.1~S2.4;

轨迹跟踪的流程如图4所示,主要步骤为S2.5;

S2.1:获取机场地面视频监控数据,包括摄相机历史监控视频和实时监控视频,将上述视频流转成图像帧:监控视频无法直接应用于目标检测模型,必须先转换成图片的形式缓存到Redis,并且需要满足至少1秒25帧的速度。

S2.2:建立目标检测深度网络模型:本专利使用的是YOLOV3神经网络模型,实际运用时只需是目标检测模型即可,对模型结构不作要求。YOLOV3的具体实现代码可参考开源库GitHub,它主要包括Convolutional卷积结构和Residual残差结构。输入图像经过卷积层生成特征图,特征图再与输入叠加生成新的特征图,新特征图作为一个残差结构的输出。YOLOV3的主体网络就是由许多这种残差模块组成,其极大地减小了梯度爆炸的风险,加强了网络的学习能力。

S2.3:制作训练数据,训练目标检测深度网络模型得到目标检测识别引擎:获取机场地面历史监控视频,将视频流转成图像帧保存到本地。人工筛选图像,只保留部分有效图像,其余图像舍弃,使筛选后图像中各对象出现的位置基本能覆盖机场地面范围。将筛选保留的图像输入开源的目标检测标定应用中,由专业的标定人员进行标定,得到该图像所包含对象信息的xml文件,将图像和对应的xml文件制作成YOLOV3需要的格式,即为最终的训练数据。下载预训练模型,并修改相关配置参数,包括:对象类别数、batchsize大小、数据集路径、预训练模型路径等等,具体参数大小可根据实际情况确定。最后用准备好的训练数据对目标检测深度网络模型进行训练,得到训练好的检测识别引擎。

S2.4:将实时监控视频的图像帧传入目标检测识别引擎,目标检测识别引擎输出该图像中包含的所有对象在对应摄像机中的坐标框、类别、置信度:从Redis缓存中获取待检测的图像帧,将其输入机场地面对象检测识别引擎,该引擎会输出该图像中包含的所有对象的坐标框、类别、置信度。

S2.5:对检测到的所有场面对象进行多目标轨迹跟踪,获得连续轨迹点和全局轨迹号,其操作方法如流程如图4所示,

S2.5.1:各摄像机分别进行单相机内的多目标跟踪,获得机场对象的相机内轨迹号和识别信息;

对各摄像机分别进行单相机内的多目标跟踪,采用在线跟踪SORT算法,对每台摄像机都分配一个SORT实例。对目标检测出的所有对象,先根据置信度进行筛选,分别计算筛选对象的坐标框与轨迹池中轨迹点坐标框的IOU值(初始时轨迹池为空,当某个轨迹点连续3帧都稳定存在时,则将其加入轨迹池);再通过匈牙利和KM算法进行级联匹配:对于匹配到的对象继承旧轨迹号并进行KM更新优化,对于未匹配到的对象赋予新轨迹号,对于轨迹池中连续多帧未更新的轨迹进行删除;最后将获得轨迹号的对象,一方面加入轨迹池,一方面输出机场对象的相机内轨迹号和识别信息,用于跨摄像机轨迹跟踪融合。

S2.5.2:对跨摄像机运动的多个对象,根据其相机内轨迹号和识别信息,进行跨相机轨迹跟踪融合,获得机场地面对象连续轨迹点信息和全局轨迹号;

对于某一识别对象,判断其相机内轨迹号是否在摄像机—相机内轨迹号—全局轨迹号的缓存池A中,若在,则该对象当前帧与上一帧之间没有跨摄像机,只需继承旧的全局轨迹号;若不在,则有3种可能性:(1)该对象当前轨迹点与上一轨迹点之间跨摄像机(2)该对象是第一次出现在机场地面(3)单相机内的多目标跟踪存在跟踪丢失的情况。为此需先根据摄像机图像空间—机场地理空间映射模型获得对象地面坐标,再通过坐标、时间、方向等信息,联合判断其是否属于全局轨迹号—轨迹点信息的缓存池B中某条轨迹,若属于则继承旧的全局轨迹号,若不属于则赋予新的全局轨迹号。最后用对象信息更新缓存池A、B,并输出机场地面对象连续轨迹点信息和全局轨迹号。

S2.5.3:对跟踪丢失又出现的对象,人工干预进行轨迹重连接。

:计算解析综合信息,提取有效数据;

综合信息主要来源于以下3个方面:

S3.1:根据上述步骤S2中获得的机场地面对象连续轨迹点,计算机场地面对象的实时速度、实时方向等信息;

由步骤S2中获得的机场地面对象连续轨迹点已经包含位置信息、时间信息,通过同一对象当前位置与历史位置信息,可以计算出当前对象轨迹点的方向角度和位移距离;再通过位移距离和时间信息,又可以计算出当前对象轨迹点的速度信息。

S3.2:调用外部系统数据,从外部系统提取机场地面对象的唯一标识、位置、时间等有效信息;外部系统包括飞行计划、雷达定位数据、ADS-B设备数据等,因原始数据格式存在差异,具体解析方式不作表述,最终获得的是对象唯一标识(小车的车牌号、人的员工号、飞机的航班号)、位置坐标、时间的对应数据。

S3.3:将管制指令的音频数据通过语音识别引擎转换为文字指令,提取出唯一标识(航班号),获得唯一标识、管制文字指令的对应数据。

:有效数据与机场地面对象关联匹配,并通过场监屏实时显示对象综合信息;

其流程如图5所示,具体步骤为:

S4.1:机场地面对象全局轨迹号与唯一标识进行配对:

首先,将步骤S2获得的“机场地面对象全局轨迹号”与“全局轨迹号—唯一标识的缓存池”进行配对,判断“机场地面对象全局轨迹号”是否在“全局轨迹号—唯一标识的缓存池”中,如果是,则继承全局轨迹号对应的唯一标识;

如果否,将步骤S2获得的“机场地面对象全局轨迹号”与步骤S3.2生成的有效数据根据时间、位置坐标等进行匹配,匹配成功,机场地面对象获得唯一标识;匹配失败,人工干预,赋予唯一标识;

最后,机场地面对象全局轨迹号与唯一标识配对后,存入“全局轨迹号——唯一标识的缓存池”中。

S4.2: “机场地面对象连续轨迹点和全局轨迹号”与唯一标识配对后,将两者各自对应的有效数据进行整合,获得机场地面对象的唯一标识、速度、方向、位置坐标、指令文字等综合信息;

需要注意的是,机场地面对象连续轨迹点和全局轨迹号对应的有效数据更新快,唯一标识对应的有效数据更新慢,所以整合操作时,若没有最新的唯一标识对应的有效数据,则使用唯一标识对应的最近历史数据。

S4.3:将获得的机场地面对象综合信息绘制到该对象所在的图像帧,再将图像帧转为视频流,输出到场监屏进行显示。

本发明实施例的方法,实现了对机场地面对象的实时跟踪,并且能够准确、实时、平滑、持续地显示对象的综合信息,极大地方便了管制人员掌握场面动态情况,为航班安全、高效、有序的起降提供了保障。

以上显示了本方案优选的实施方式。应当指出,本行业的技术人员应该了解本方案不受上述实施例的限制,任何本技术领域的技术人员在本发明披露的技术范围内,根据本发明的技术方案和发明构思加以等同或近似替换或改变,也应视为本发明的保护范围。

- 一种集成并显示机场地面对象综合信息的场监系统

- 一种针对机场地面对象的跨摄像头轨迹跟踪系统