一种用于互联网服务的实体链接方法、装置及存储介质

文献发布时间:2023-06-19 10:08:35

技术领域

本发明涉及机器学习中的神经网络技术领域和互联网服务技术领域,具体涉及一种用于互联网服务的实体链接方法、装置、存储介质。

背景技术

当时代进入信息时代,互联网上每时每刻都有海量数据生成,信息爆炸在带来海量信息的同时,也对快速准确地获取目标信息提出了挑战。当前互联网上存在着以wiki为代表的大量知识库,如BDpedia、YAGO、百度百科等等,相较于互联网上零散的数据,这些知识库中的知识是经过对海量数据的抽取、整理产生的有结构的信息,这种表达成更接近人类认知世界的形式,可以帮助更好地组织、管理和理解互联网中的海量信息。为了将网络大数据环境下的碎片化的数据与知识库中结构化的数据联系起来,采用实体链接任务将文本中的识别到的实体提及(即命名实体、待链接实体),链接到知识库中的一个具体真实实体。

实体链接可以丰富文本的语义信息,因此可以应用于很多现实的互联网服务场景中,例如对用户的浏览文本提取实体进行链接,可以为用户进行更精准的兴趣推荐;对用户的提问文本进行实体链接,可以帮助搜索引擎更好的理解用户的搜索意图,从知识库中更快的为用户检索推荐结果,提供更高的搜索服务质量;对用户浏览的文本进行链接,可以提升用户阅读体验等等。

实体链接的基本思想是首先根据给定的实体提及项,从知识库中选出一组候选实体对象,然后通过相似度计算对候选实体项进行排序,选择正确的实体对象进行链接。传统的实体链接方法主要是基于概率的方法进行计算,如通过字符串相似度、语义相似度、上下文相似度、流行度和主题模型等进行计算得分,这些方法相对简单,但是因为只考虑局部文本的语义,所以准确率相对不高。针对这种情况,研究者采用基于图的方法来挖掘结构等全局信息,这类方法大多以实体提及和候选实体为节点,图的边分为两类:一类是实体指称和其对应的候选实体之间的边,权重多为实体指称和候选实体之间的局部文本相似度;另一类是候选实体之间的边,权重多为候选实体之间的语义相关度,然后利用密集子图、图遍历等方法选择对应提及对应实体,但是基于图的方法计算复杂度偏高,对语义的利用率不高,而且一般这类方法只返回最优解,不能返回其他答案的参考排序,在实际应用中,效果相对一般。

已有的实体链接方法大多是单纯基于wikipedia知识库展开研究的,这些方法对文本信息的利用率极高,外部知识库一般多考虑wordnet、yago之类的类型信息,对结构信息的利用主要通过对wikipedia文档中实体的共现情况进行,因此对结构信息和关系信息的利用效果较差。

发明内容

针对上述问题,本发明提供了一种用于互联网服务的实体链接方法、装置、存储介质,可以综合利用知识库中实体的上下文文本信息与实体之间的关系结构信息,提供更准确地实体链接结果,方便在互联网服务中为用户进行内容推送。

其技术方案是这样的:一种用于互联网服务的实体链接方法,包括以下步骤:

步骤1:提取用户在互联网服务使用中浏览或输入的内容,进行数据预处理,获取所有待链接实体和待链接实体的上下文,在wikipedia知识库中确定待链接实体的候选实体集;

步骤2:分别基于wikipedia知识库和wikidata知识库构造训练集,训练得到于wikipedia知识库和wikidata知识库中实体的向量表示,从中获取候选实体的向量表示;

步骤3:通过词嵌入获得待链接实体的上下文中词的向量表示;

步骤4:构建并训练实体链接模型,分别将候选实体、待链接实体上下文中词的向量表示输入实体链接模型,确定候选实体集合中各候选实体与待链接实体的相似度得分;

步骤5:将候选实体集合中得分最高的候选实体视为链接实体返回,与待链接实体相链接,并返回得分最高的前N个候选实体作为参考选项。

进一步的,在步骤1中,提取用户在互联网服务使用中浏览或输入的内容整理为文档D,进行数据预处理,获取其中所有待链接实体,构成待链接实体集合

取链接实体

进一步的,在步骤2中,具体包括以下步骤:

步骤201:对wikipedia知识库进行清洗,获得包含文本和实体的数据集,构建wikipedia训练集;

对wikidata知识库进行清洗,获得包含知识图谱三元组的数据集,构建wikidata训练集;

步骤202:对于wikipedia训练集,利用负采样的方法,训练得到wikipedia知识库的基于文本的实体向量表示集合e_text;

对于wikidata训练集,采用知识图谱嵌入方法,构建嵌入模型,通过wikidata训练集训练嵌入模型,得到wikidata知识库的基于结构的实体向量表示集合e_triple;

步骤203:分别从基于文本的实体向量表示集合e_text和基于结构的实体向量表示集合e_triple中获取候选实体集中候选实体的向量表示。

进一步的,在步骤2中,wikipedia训练集和wikidata训练集中的实体分别采用wikipedia中的实体id表示,通过实体id,从基于文本的实体向量表示集合e_text和基于结构的实体向量表示集合e_triple获取候选实体集中候选实体的向量表示。

进一步的,在步骤202中,对于wikipedia训练集,利用负采样的方法,训练得到wikipedia知识库的基于文本的实体向量表示集合e_text,具体包括:

通过统计wikipedia训练集中实体e和文本中周围固定距离内词w的共现频数#(w,e)、词w的频数#(w),计算词-实体的积极分布

通过积极分布

通过最小化训练集的最大边缘目标函数J来获得实体e的最佳嵌入

进一步的,在步骤3中,采用GloVe模型学习词向量,从GloVe词嵌入中获取待链接实体

进一步的,根据深度神经网络构建并训练实体链接模型,所述实体链接模型包括:

局部相似度得分计算层,用于计算待链接实体

其中,

全局一致性得分计算层,用于计算待链接实体

其中C为可训练的对角矩阵参数,

循环置信传播推理层,所述循环置信传播推理层采用循环置信传播的方法同时对输入的候选实体的局部得分和全局得分进行推理,得到训练文档D的整体最优链接得分,表示为:

全连接输出层, 用于串联候选实体的基于文本的局部得分

进一步的,在步骤4中,分别将从基于文本的实体向量表示集合e_text中获得候选实体的向量表示、从基于结构的实体向量表示集合e_triple中获得候选实体的向量表示,与待链接实体的上下文中词的向量表示一起输入局部相似度得分计算层,得到候选实体的基于文本的局部得分

分别将从基于文本的实体向量表示集合e_text中获得候选实体的向量表示、从基于结构的实体向量表示集合e_triple中获得候选实体的向量表示输入全局一致性得分计算层,得到候选实体的基于文本的全局得分

将得到基于文本的局部得分

将候选实体的基于文本的局部得分

在步骤5中,将每个候选实体的最终得分进行排序,将待链接实体的候选实体集合中最终得分最高的候选实体,视为链接实体,返回实体id,并返回得分最高的前N个候选实体作为参考选项。

进一步的,还包括步骤6,为用户推送链接实体相关的内容,用于推荐或问答。

本发明同时利用wikipedia知识库和wikidata知识库训练实体向量,wikipedia知识库包含了实体和其上下文文本以及相关的文本语义信息,wikidata知识库是由实体、关系(属性)构造的三元组数据集集合,主要包含的实体的结构信息和关系信息等,结合wikidata和wikipedia进行实体链接,可以综合利用到文本信息和结构信息,更好的计算提及和候选实体之间的相似度,将文本语义信息和结构关系信息嵌入到实体向量中,经过迭代训练,充分利用提及的上下文和知识库的语义和结构信息,不依赖人工指定特定的特征,基于语义和结构信息学习到局部和全局等各种特征,通过设计基于深度神经网络模型构建实体链接模型,局部相似度得分计算层在句子单位级别,考虑单独提及的每个实体的单独上下文,以减少决策空间的大小,全局一致性得分计算层在文档级别,消除文档中所有实体的歧义,而且假设文档中所有实体与文档的整体主题是一致,循环置信传播推理层计算文档级别的实体链接效果,将局部得分和全局得分结合起来,得分最高时,表示实体链接效果最好,采用循环置信传播层对整个得分进行训练,来获取整体的最优结果,最后通过全连接输出层,串联候选实体的基于文本的局部得分、基于结构的局部得分、整体最优链接得分以及候选实体的先验概率,通过MLP得到候选实体的最终得分,将候选实体集合中得分最高的候选实体视为链接实体返回,与待链接实体相链接,并返回得分最高的前N个候选实体作为参考选项,这样在互联网服务中,给予用户更多的参考选项,选择空间更大,也可以提高内容推荐的准确度。

附图说明

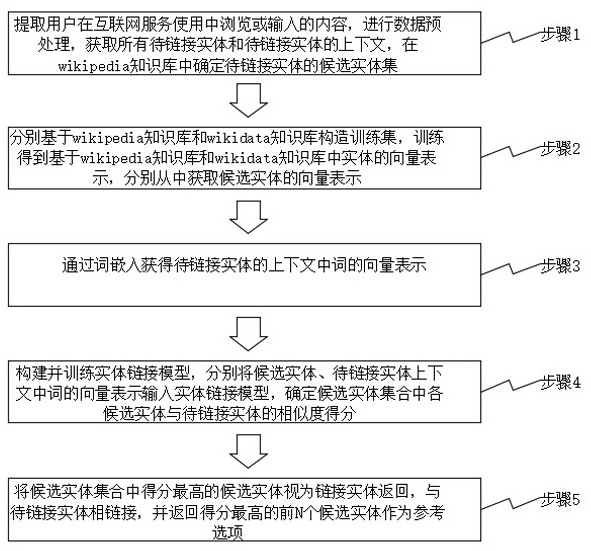

图1为本发明的一种用于互联网服务的实体链接方法的主要步骤示意图;

图2为本发明的实体链接模型执行的流程示意图;

图3为本发明的另一种用于互联网服务的实体链接方法的主要步骤示意图;

图4为一个实施例中计算机设备的内部结构图。

具体实施方式

当前主流的实体链接方法无法同时满足同时深度利用文本语义信息和结构关系信息,且大量研究表明,文本语义信息和结构关系信息对于独立标识一个实体,提高实体的表示和区分能力有很大的积极作用。

见图1,针对上述问题,在本发明的实施例中,提供了一种用于互联网服务的实体链接方法,至少包括以下步骤:

步骤1:提取用户在互联网服务使用中浏览或输入的内容,进行数据预处理,获取所有待链接实体和待链接实体的上下文,在wikipedia知识库中确定待链接实体的候选实体集;

步骤2:分别基于wikipedia知识库和wikidata知识库构造训练集,训练得到于wikipedia知识库和wikidata知识库中实体的向量表示,从中获取候选实体的向量表示;

步骤3:通过词嵌入获得待链接实体的上下文中词的向量表示;

步骤4:构建并训练实体链接模型,分别将候选实体、待链接实体上下文中词的向量表示输入实体链接模型,确定候选实体集合中各候选实体与待链接实体的相似度得分;

步骤5:将候选实体集合中得分最高的候选实体视为链接实体,与待链接实体相链接。

具体的,在步骤1中,提取用户在互联网服务使用中浏览或输入的内容整理为文档D,进行数据预处理,获取其中所有待链接实体,构成待链接实体集合

取链接实体

具体的,在步骤2中,包括以下步骤:

步骤201:wikipedia知识库包含了实体和其上下文文本以及相关的文本语义信息,对wikipedia知识库进行清洗,获得包含文本和实体的数据集,构建wikipedia训练集;

wikidata知识库是由实体、关系(属性)构造的三元组数据集集合,对wikidata知识库进行清洗,获得包含知识图谱三元组的数据集,构建wikidata训练集;

步骤202:对于wikipedia训练集,利用负采样的方法,训练得到wikipedia知识库的基于文本的实体向量表示集合e_text;

具体包括:通过统计wikipedia训练集中实体e和文本中周围固定距离内词w的共现频数#(w,e)、词w的频数#(w),计算词-实体的积极分布

通过积极分布

通过最小化训练集的最大边缘目标函数J来获得实体e的最佳嵌入

在获得wikipedia训练集中实体向量的表示时,将实体的语义压缩进嵌入表示,并极大地减少了对手工设计特征或共现统计数据的需求。实体嵌入从共同出现词语的词嵌入中提取,充分考虑了实体与上下文语义的结合;并针对每个实体独立训练,这不仅可以通过只对感兴趣实体进行训练,获得潜在的显著加速和内存节省,而且可以轻松地将实体以增量方式添加,得到更好的扩展,特别是在鲜少出现实体上。同时与使用统计的方法相比,将实体与词语的共现信息融入向量,应用更加简单、容错率更高且实践效果也要更优。

对于wikidata训练集,采用知识图谱嵌入方法,构建嵌入模型,通过wikidata训练集训练嵌入模型,得到wikidata知识库的基于结构的实体向量表示集合e_triple;

步骤203:分别从基于文本的实体向量表示集合e_text和基于结构的实体向量表示集合e_triple中获取候选实体的向量表示,wikipedia训练集和wikidata训练集中的实体分别采用wikipedia中的实体id表示,通过实体id,从基于文本的实体向量表示集合e_text和基于结构的实体向量表示集合e_triple中获取候选实体的向量表示。

在步骤3中,通过词嵌入获得待链接实体的上下文中词的向量表示,具体的,在这里采用GloVe模型学习词向量,从GloVe词嵌入中获取待链接实体

见图2,在步骤4中,根据深度神经网络构建并训练实体链接模型,实体链接模型包括局部相似度得分计算层、全局一致性得分计算层、循环置信传播推理层、全连接输出层;

分别将从基于文本的实体向量表示集合e_text中获得候选实体的向量表示、从基于结构的实体向量表示集合e_triple中获得候选实体的向量表示,与待链接实体的上下文中词的向量表示一起输入局部相似度得分计算层,得到候选实体的基于文本的局部得分

局部相似度得分计算层,用于计算待链接实体

其中,

全局一致性得分计算层,用于计算待链接实体

其中C为可训练的对角矩阵,

分别将从基于文本的实体向量表示集合e_text中获得的候选实体的向量表示、从基于结构的实体向量表示集合e_triple中获得的候选实体的向量表示输入全局一致性得分计算层,得到候选实体的基于文本的全局得分

循环置信传播推理层,循环置信传播推理层采用循环置信传播的方法同时对输入的候选实体的局部得分和全局得分进行训练和预测,得到训练文档D的整体最优链接得分,表示为:

将得到基于文本的局部得分

全连接输出层, 用于串联候选实体的基于文本的局部得分

将候选实体的基于文本的局部得分

在步骤5中,将每个候选实体的最终得分进行排序,将待链接实体的候选实体集合中最终得分最高的候选实体,视为链接实体,与待链接实体相链接,并返回得分最高的前N个候选实体作为参考选项,返回实体id。

在本实施例中,实体链接任务的目标是将网络大数据环境下的碎片化的数据与知识库中结构化的数据联系起来,通过将互联网上零散的数据中进行处理,对识别到的实体提及(即命名实体)等信息,链接到知识库中的一个具体真实实体,从而可以利用到知识库中经过对海量数据的抽取、整理产生的有结构知识信息,从而丰富互联网的服务。例如对用户的浏览文本提取实体进行链接,可以为用户进行更精准的兴趣推荐;对用户的提问文本进行实体链接,可以帮助搜索引擎更好的理解用户的搜索意图,从知识库中更快的为用户检索推荐结果,提供更高的搜索服务质量;对用户浏览的文本进行链接,可以提升用户阅读体验等等。

传统的实体链接方法主要是基于概率的方法和基于图的方法,基于概率的方法主要通过字符串相似度、语义相似度、上下文相似度、流行度和主题模型等进行计算得分,这类方法相对简单,但是因为只考虑局部文本的语义,所以准确率相对不高;基于图的方法大多以实体提取和候选实体为节点,然后利用密集子图、图遍历等方法选择对应提及对应实体,计算复杂度偏高,计算资源要求高,而且一般这类方法只返回最优解,不能返回其他答案的参考排序,在实际应用中,效果相对一般。

考虑到神经网络可以学习文本的基本特征及其组合,而不需要依赖人工设计的一些领域知识特征的特点,本发明的实体链接模型基于深度神经网络模型构建,结合了上述两种方法的优势,同时学习局部和全局信息,用于实体链接,局部相似度得分计算层在句子单位级别,考虑单独提及的每个实体的单独上下文,以减少决策空间的大小,全局一致性得分计算层在文档级别,消除文档中所有实体的歧义,而且假设文档中所有实体与文档的整体主题是一致,循环置信传播推理层计算文档级别的实体链接效果,将局部得分和全局得分结合起来,得分最高时,表示实体链接效果最好,因为全局得分是全连接的成对条件随机场,直接训练是NP难得,因此采用循环置信传播层对整个得分进行训练,来获取整体的最优结果,最后通过全连接输出层,串联候选实体的基于文本的局部得分、基于结构的局部得分、整体最优链接得分以及候选实体的先验概率,通过MLP得到候选实体的最终得分,

将候选实体集合中得分最高的候选实体视为链接实体返回,与待链接实体相链接,并返回得分最高的前N个候选实体作为参考选项,N为大于等于1的自然数,这样在互联网服务中,给予用户更多的参考选项,选择空间更大,也可以提高内容推荐的准确度。

现有的基于神经网络的实体链接方法主要是基于wikipedia知识库实现的,这些方法对文本信息的利用率极高,但是对结构信息的利用主要通过实体共同出现情况的统计展开的,因此对结构信息和关系信息的利用效果较差,同时因为wikipedia是文档型知识库,因此这类方法对主要由三元组构成的结构型知识库的迁移性较差。而本发明同时利用wikipedia知识库和wikidata知识库训练实体向量,在利用已有方法的文本优势基础上,通过在wikidata上利用图谱嵌入学习实体向量,学习关系结构信息,并融入到实体链接模型中,提升模型的效果。本发明不仅可以综合利用文本信息和结构信息,提升实体链接的效果,而且可以迁移到各类知识库,普遍性强。

本发明步骤2采用的实体嵌入训练方法都是单独集成的方法,因此本发明中的实体嵌入不仅可以用于进行其他的任务;在知识库更新时,可以方便的对实体嵌入进行二次训练;同时两个实体向量的训练可以同时进行,节约时间。步骤三中采用的词嵌入可以直接利用已有的嵌入方法,如word2vec、glove都可以,减少了发明的计算量。步骤四中全连接层可以方便的进行扩充,融入其他的一些特征,如候选实体和实体提及的字符串相似性特征、类型匹配特征等。

见图3,在本发明的另一个实施例中,出了上述实施例中步骤1-5,还包括步骤6,为用户推送链接实体相关的内容,包括音视频、网页内容、商品购物链接等,用于推荐或问答等互联网服务。

本发明同时利用wikipedia知识库和wikidata知识库训练实体向量,wikipedia知识库包含了实体和其上下文文本以及相关的文本语义信息,wikidata知识库是由实体、关系(属性)构造的三元组数据集集合,主要包含的实体的结构信息和关系信息等,结合wikidata和wikipedia进行实体链接,可以综合利用到文本信息和结构信息,更好的计算提及和候选实体之间的相似度,将文本语义信息和结构关系信息嵌入到实体向量中,经过迭代训练,充分利用提及的上下文和知识库的语义和结构信息,不依赖人工指定特定的特征,基于语义和结构信息学习到局部和全局等各种特征,最后利用这些学到的特征信息,利用全连接网络,学习到候选实体的最终得分,得到实体链接的结果。

在本发明的实施例中,还提供了一种计算机装置,包括存储器和处理器,存储器存储有计算机程序,处理器执行计算机程序时实现如上述的用于互联网服务的实体链接方法。

该计算机装置可以是终端,其内部结构图可以如图4所示。该计算机装置包括通过总线连接的处理器、存储器、网络接口、显示屏和输入装置。其中,该计算机装置的处理器用于提供计算和控制能力。该计算机装置的存储器包括非易失性存储介质、内存储器。该非易失性存储介质存储有操作系统和计算机程序。该内存储器为非易失性存储介质中的操作系统和计算机程序的运行提供环境。该计算机装置的网络接口用于与外部的终端通过网络连接通信。该计算机程序被处理器执行时以实现用于互联网服务的实体链接方法。该计算机装置的显示屏可以是液晶显示屏或者电子墨水显示屏,该计算机装置的输入装置可以是显示屏上覆盖的触摸层,也可以是计算机装置外壳上设置的按键、轨迹球或触控板,还可以是外接的键盘、触控板或鼠标等。

存储器可以是,但不限于,随机存取存储器(Random Access Memory,简称:RAM),只读存储器(Read Only Memory,简称:ROM),可编程只读存储器(Programmable Read-OnlyMemory,简称:PROM),可擦除只读存储器(Erasable Programmable Read-OnlyMemory,简称:EPROM),电可擦除只读存储器(Electric Erasable Programmable Read-Only Memory,简称:EEPROM)等。其中,存储器用于存储程序,处理器在接收到执行指令后,执行程序。

处理器可以是一种集成电路芯片,具有信号的处理能力。上述的处理器可以是通用处理器,包括中央处理器(Central Processing Unit,简称:CPU)、网络处理器(NetworkProcessor,简称:NP)等。该处理器还可以是其他通用处理器、数字信号处理器(DigitalSignal Processor,DSP)、专用集成电路(Application Specific Integrated Circuit,ASIC)、现场可编程门阵列(Field-Programmable Gate Array,FPGA)或者其他可编程逻辑器件、分立门或者晶体管逻辑器件、分立硬件组件等。通用处理器可以是微处理器或者该处理器也可以是任何常规的处理器等。可以实现或者执行本申请实施例中的公开的各方法、步骤及逻辑框图。通用处理器可以是微处理器或者该处理器也可以是任何常规的处理器等。

本领域技术人员可以理解,图4中示出的结构,仅仅是与本申请方案相关的部分结构的框图,并不构成对本申请方案所应用于其上的计算机装置的限定,具体的计算机装置可以包括比图中所示更多或更少的部件,或者组合某些部件,或者具有不同的部件布置。

在本发明的实施例中,还提供了一种计算机可读存储介质,其上存储有程序,程序被处理器执行时实现如上述的用于互联网服务的实体链接方法。

本领域内的技术人员应明白,本发明实施例的实施例可提供为方法、计算机装置、或计算机程序产品。因此,本发明实施例可采用完全硬件实施例、完全软件实施例、或结合软件和硬件方面的实施例的形式。而且,本发明实施例可采用在一个或多个其中包含有计算机可用程序代码的计算机可用存储介质(包括但不限于磁盘存储器、CD-ROM、光学存储器等)上实施的计算机程序产品的形式。

本发明实施例是参照根据本发明实施例的方法、计算机装置、或计算机程序产品的流程图和/或框图来描述的。可提供这些计算机程序指令到通用计算机、专用计算机、嵌入式处理机或其他可编程数据处理终端设备的处理器以产生一个机器,使得通过计算机或其他可编程数据处理终端设备的处理器执行的指令产生用于实现在流程图和/或中指定的功能的装置。

这些计算机程序指令也可存储在能引导计算机或其他可编程数据处理终端设备以特定方式工作的计算机可读存储器中,使得存储在该计算机可读存储器中的指令产生包括指令装置的制造品,该指令装置实现在流程图中指定的功能。

以上对本发明所提供的在用于互联网服务的实体链接方法、计算机装置、计算机可读存储介质的应用进行了详细介绍,本文中应用了具体个例对本发明的原理及实施方式进行了阐述,以上实施例的说明只是用于帮助理解本发明的方法及其核心思想;同时,对于本领域的一般技术人员,依据本发明的思想,在具体实施方式及应用范围上均会有改变之处,综上所述,本说明书内容不应理解为对本发明的限制。

- 一种用于互联网服务的实体链接方法、装置及存储介质

- 一种命名实体的链接方法、装置、设备及可读存储介质