一种快速场景下的基于事件相机的双目视觉SLAM系统及方法

文献发布时间:2024-01-17 01:28:27

技术领域

本申请涉及视觉空间定位技术领域,具体涉及一种快速场景下的基于事件相机的双目视觉SLAM系统及方法。

背景技术

视觉SLAM作为自动驾驶技术的重要组成部分,已成为热点和趋势。传统视觉SLAM系统在快速场景无法依靠运动模糊图像生成鲁棒的建图、定位结果。因此,解决快速场景下的运动模糊对视觉SLAM的推广十分重要。近年来,计算机视觉领域已经展开了许多视觉SLAM在不同场景下的工作,并取得了大量的成果,但受制于运动模糊,视觉SLAM仍然难以在快速场景下鲁棒地工作。

事件相机作为一种仿生学的动态视觉传感器,其成像延迟低、亮度敏感等特性,不受运动模糊影响,在快速环境下具备天然优势。与传统相机以固定帧成像不同,事件相机记录光度变化信息,以微秒级别异步地生成事件,因此事件相机不受运动模糊的影响。凭借独特的成像方式,事件相机可以拓宽视觉SLAM在快速运动场景下的运用。然而,现有基于事件相机的视觉SLAM算法难以在快速场景下产生令人满意的效果,基于事件相机的视觉SLAM仍需要研究。

专利文件CN114943762A公布了一种基于事件相机的双目视觉里程计方法,将数据集中的事件流转换成Time-Surface表示,并利用改进的SGM方法计算深度帧;将深度帧转化为体素网格,并使用TSDF值对体素元素进行可视化处理,形成点云;使用3D-2D方法计算各个时间戳下的相机位姿,以实现定位与建图。该专利具有如下缺点:

在快速场景下,深度信息计算需要保证鲁棒性与实时性,其使用的建图方法,需要计算深度的事件数量过多、计算方法复杂度高,导致计算所耗费的时间长,因此难以保证快速场景下的实时性。

专利文件CN115830066A公布了一种应用于动态室内场景的视觉SLAM鲁棒性提升方法,采用语义分割神经网络提取场景中运动物体区域,生成相应的蒙版进行精细化处理,并提取语义蒙版外轮廓;遍历当前图像帧中所有特征点,计算外轮廓的欧氏距离以及对应的深度数据;将特征点集合分为三类,即先验静止特征点集合、先验动态特征点集合、先验未知特征点集合;对特征点进行运动一致性检测并划分静止区域,实现对动态场景的定位与建图。该专利具有如下缺点:

语义分割神经网络难以提取场景中速度过快的运动物体的特征点,且在快速场景下仍然难以克服运动模糊的影响,导致建图与定位精度不足。

发明内容

本申请实施例的目的是提供一种快速场景下的基于事件相机的双目视觉SLAM系统及方法,其使用IRLS算法对融合时间曲面(TS)建立半稠密地图的过程加速,并使用微小位姿迭代方法快速估计相机位姿,最终生成点云地图与全局位姿变换情况,可以解决传统视觉SLAM在快速场景下特征点难以提取,定位与建图精度下降的问题,从而可以解决背景技术中涉及的至少一个技术问题。

为了解决上述技术问题,本申请是这样实现的:

本申请实施例提供了一种快速场景下的基于事件相机的双目视觉SLAM系统,包括:

事件流信息处理模块,其用于将事件流传递到基于事件密度的滤波器中滤波,并将滤波后事件流按照时间戳进行封装,相同时间戳的事件使用SAE框架可视化为时间曲面;

3D点云地图生成模块,其用于计算相邻时间曲面上事件深度,融合时间曲面上事件的深度信息,生成局部点云地图与全局点云地图;

位姿估计模块,其用于进行信息匹配和微小位姿的迭代计算。

可选的,所述事件流信息处理模块包括:

事件流滤波模块,其用于事件流输入到基于事件密度的滤波算法当中进行滤波处理,以新事件坐标为中心建立一个L×L的像素单元;若该像素单元在时间域(t,t

事件流信息封装模块,其用于将事件流内的事件e(x,y,t,p)按照时间戳进行分类封装,同一时间戳的事件存储在一个信息单元中,其中,x和y为像素坐标、t为时间戳、p为事件极性;

时间曲面生成模块,其利用eHarris*角点检测方法建立SAE框架,将同一时间戳的事件在像素平面上可视化显示,生成时间曲面。

可选的,所述事件流滤波模块中的L取4,Δ=3ms,事件阈值取2

可选的,所述3D点云地图生成模块包括:

事件深度计算模块,其用于根据相邻时间戳的时间曲面,使用优化的GTS深度计算方法计算时间戳t下时间曲面内事件深度信息,得到的深度信息集合记作ρ

其中,ρ

融合事件深度模块,其用于设变量k=0,同一事件的左右相机时间残差满足t分布,假设时间曲面内同一像素的相邻时间戳(t,t

其中,μ

若这两个事件满足上述公式,则事件深度信息可以融合;反之无法融合事件深度,生成可靠的点云地图需融合k≤15的全部的ρ

点云地图生成模块,其用于根据深度帧,生成局部点云,并依据位姿计算模块得到的位姿变换库,对不同时间戳的局部点云进行拼接,生成全局点云地图。

可选的,在事件深度计算模块中,r为25。

本申请实施例提供了一种基于所述的系统的快速场景下的基于事件相机的双目视觉SLAM方法,包括:

步骤S1:采用开源数据集作为事件流的输入;

步骤S2:对输入的事件流采用基于事件密度的滤波算法进行滤波处理;

步骤S3:对滤波处理后的事件流按照时间戳进行封装,随后使用SAE框架生成时间曲面;

步骤S4:利用相邻时间戳的时间曲面计算事件深度信息,并融合多个时间曲面上事件的深度信息;

步骤S5:使用Luacas-Kanade方法将当前时间戳时间曲面内事件与上一时间戳具有深度的事件在2D像素平面上对齐,并迭代求解出像素平面对齐所要求的相机位姿。

可选的,在步骤S3中,所述使用SAE框架生成时间曲面,包括:

使用SAE结构对事件像素平面进行角点检测,追踪的事件形成时间曲面可视化显示,其中,所述时间曲面包含事件坐标、时间戳以及事件极性信息。

可选的,步骤S4具体包括:

步骤S41:另变量k=1,通过相邻时间戳,t

步骤S42:计算k≤15的(t

步骤S43:通过多个深度帧的深度信息,实时还原环境,并使用3D点云地图可视化。

可选的,步骤S5具体包括:

步骤S51:通过步骤S41所得到的t

步骤S52:使用Luacas-Kanade方法迭代求解相机位姿,计算位姿增量。

本申请的有益效果如下:

1、融合相邻时间戳TS内事件深度增加建图的稠密程度,降低建图过程中的深度不确定性,提高了建图的精度;

2、在融合TS建图的过程中,使用IRLS算法降低计算复杂度,从而增加了3D点云地图的生成速度,在快速场景下更适用;

3、使用Luacas-Kanade方法最小化位姿估计过程的误差,使定位更加精确;降低了计算复杂度,使位姿更新频率达到100Hz,实现实时跟踪。

附图说明

图1是本申请实施例提供的快速场景下的基于事件相机的双目视觉SLAM系统的框架图;

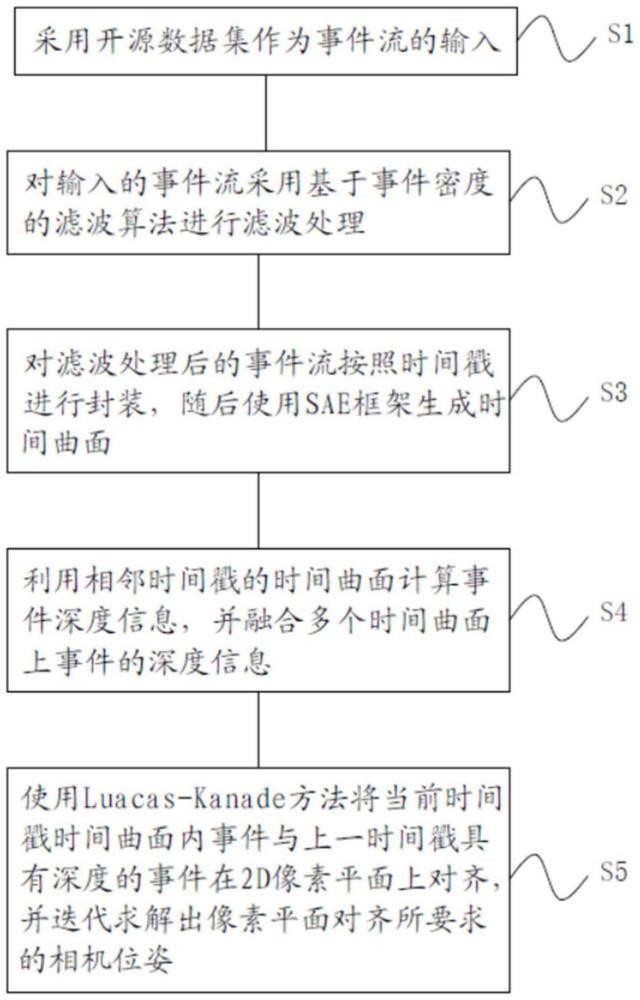

图2是本申请实施例提供的快速场景下的基于事件相机的双目视觉SLAM方法的流程图。

具体实施方式

下面将结合本申请实施例中的附图,对本申请实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例是本申请一部分实施例,而不是全部的实施例。基于本申请中的实施例,本领域普通技术人员在没有作出创造性劳动前提下所获得的所有其他实施例,都属于本申请保护的范围。

本申请的说明书和权利要求书中的术语“第一”、“第二”等是用于区别类似的对象,而不用于描述特定的顺序或先后次序。应该理解这样使用的数据在适当情况下可以互换,以便本申请的实施例能够以除了在这里图示或描述的那些以外的顺序实施,且“第一”、“第二”等所区分的对象通常为一类,并不限定对象的个数,例如第一对象可以是一个,也可以是多个。此外,说明书以及权利要求中“和/或”表示所连接对象的至少其中之一,字符“/”,一般表示前后关联对象是一种“或”的关系。

下面结合附图,通过具体的实施例及其应用场景对本申请实施例提供的快速场景下的基于事件相机的双目视觉SLAM方法进行详细地说明。

请参见图1所示,本申请实施例提供的一种快速场景下的基于事件相机的双目视觉SLAM系统,包括事件流信息处理模块1、3D点云地图生成模块2以及位姿估计模块3。

所述事件流信息处理模块1用于将事件流传递到基于事件密度的滤波器中滤波,并将滤波后事件流按照时间戳进行封装,相同时间戳的事件使用SAE框架可视化为时间曲面。

具体的,所述事件流信息处理模块1包括事件流滤波模块11、事件流信息封装模块12以及时间曲面生成模块13。

所述事件流滤波模块11用于事件流输入到基于事件密度的滤波算法当中进行滤波处理,以新事件坐标为中心建立一个L×L的像素单元;若该像素单元在时间域(t,t

所述事件流信息封装模块12用于将事件流内的事件e(x,y,t,p)按照时间戳进行分类封装,同一时间戳的事件存储在一个信息单元中,其中,x和y为像素坐标、t为时间戳、p为事件极性;

所述时间曲面生成模块13利用eHarris*角点检测方法建立SAE框架,将同一时间戳的事件在像素平面上可视化显示,生成时间曲面。

所述3D点云地图生成模块2用于计算相邻时间曲面上事件深度,融合时间曲面上事件的深度信息,生成局部点云地图与全局点云地图。

具体的,所述3D点云地图生成模块2包括事件深度计算模块21、融合事件深度模块22以及点云地图生成模块23。

所述事件深度计算模块21用于根据相邻时间戳的时间曲面,使用优化的GTS深度计算方法计算时间戳t下时间曲面内事件深度信息,得到的深度信息集合记作ρ

其中,ρ

所述融合事件深度模块22用于设变量k=0,同一事件的左右相机时间残差满足t分布,假设时间曲面内同一像素的相邻时间戳(t,t

其中,μ

若这两个事件满足上述公式,则事件深度信息可以融合;反之无法融合事件深度,生成可靠的点云地图需融合k≤15的全部的ρ

所述点云地图生成模块23用于根据深度帧,生成局部点云,并依据位姿计算模块得到的位姿变换库,对不同时间戳的局部点云进行拼接,生成全局点云地图。

所述位姿估计模块3用于进行信息匹配和微小位姿的迭代计算。

具体的,为提高位姿计算的精度及速度,使用Luacas-Kanade方法最小化位姿估计过程的误差,并降低计算复杂度。在相邻时间戳下,通过下述公式计算相机运动参数:

其中,

再结合图2所示,本申请实施例提供了一种基于所述的系统的快速场景下的基于事件相机的双目视觉SLAM方法,包括:

步骤S1:采用开源数据集作为事件流的输入;

步骤S2:对输入的事件流采用基于事件密度的滤波算法进行滤波处理;

步骤S3:对滤波处理后的事件流按照时间戳进行封装,随后使用SAE框架生成时间曲面;

步骤S4:利用相邻时间戳的时间曲面计算事件深度信息,并融合多个时间曲面上事件的深度信息;

步骤S5:使用Luacas-Kanade方法将当前时间戳时间曲面内事件与上一时间戳具有深度的事件在2D像素平面上对齐,并迭代求解出像素平面对齐所要求的相机位姿。

可选的,在步骤S3中,所述使用SAE框架生成时间曲面,包括:

使用SAE结构对事件像素平面进行角点检测,追踪的事件形成时间曲面可视化显示,其中,所述时间曲面包含事件坐标、时间戳以及事件极性信息。

可选的,步骤S4具体包括:

步骤S41:另变量k=1,通过相邻时间戳,t

步骤S42:计算k≤15的(t

步骤S43:通过多个深度帧的深度信息,实时还原环境,并使用3D点云地图可视化。

可选的,步骤S5具体包括:

步骤S51:通过步骤S41所得到的t

步骤S52:使用Luacas-Kanade方法迭代求解相机位姿,计算位姿增量。

本申请的有益效果如下:

1、融合相邻时间戳TS内事件深度增加建图的稠密程度,降低建图过程中的深度不确定性,提高了建图的精度;

2、在融合TS建图的过程中,使用IRLS算法降低计算复杂度,从而增加了3D点云地图的生成速度,在快速场景下更适用;

3、使用Luacas-Kanade方法最小化位姿估计过程的误差,使定位更加精确;降低了计算复杂度,使位姿更新频率达到100Hz,实现实时跟踪。

需要说明的是,在本文中,术语“包括”、“包含”或者其任何其他变体意在涵盖非排他性的包含,从而使得包括一系列要素的过程、方法、物品或者装置不仅包括那些要素,而且还包括没有明确列出的其他要素,或者是还包括为这种过程、方法、物品或者装置所固有的要素。在没有更多限制的情况下,由语句“包括一个……”限定的要素,并不排除在包括该要素的过程、方法、物品或者装置中还存在另外的相同要素。

此外,需要指出的是,本申请实施方式中的方法和系统的范围不限按示出或讨论的顺序来执行功能,还可包括根据所涉及的功能按基本同时的方式或按相反的顺序来执行功能,例如,可以按不同于所描述的次序来执行所描述的方法,并且还可以添加、省去、或组合各种步骤。另外,参照某些示例所描述的特征可在其他示例中被组合。

上面结合附图对本申请的实施例进行了描述,但是本申请并不局限于上述的具体实施方式,上述的具体实施方式仅仅是示意性的,而不是限制性的,本领域的普通技术人员在本申请的启示下,在不脱离本申请宗旨和权利要求所保护的范围情况下,还可做出很多形式,均属于本申请的保护之内。

- 一种双目视觉相机硬件系统、三维场景重建系统及方法

- 一种基于视觉反馈的TDI-CCD相机双目视觉系统视场对齐方法

- 一种基于全景相机的双目视觉SLAM方法及系统

- 一种基于双目视觉SLAM的动态场景密集建模方法