一种基于特征融合的图像检索方法

文献发布时间:2023-06-19 09:23:00

技术领域

本发明属于图像检索领域,更具体地,涉及一种基于特征融合的图像检索方法。

背景技术

基于内容的图像检索方法提取图像的视觉特征来描述图像,可以比文本更加准确全面的描述图像。尺度不变特征变换(Scale Invariant Feature Transform,SIFT)在1999年由David提出,以用于计算机视觉领域的图像匹配问题。SIFT不仅对尺度、平移、旋转具有较强的不变性,还对光照变化、遮挡及噪声具有很好的鲁棒性。RootSIFT是SIFT的改进版,RootSIFT在SIFT的基础上进行1-范数标准化和平方根变换,从而提高了SIFT的描述力。局部聚合描述符向量(Vector of Locally Aggregated Descriptors,VLAD)用于将特征集编码为一个定长的向量,VLAD对k-means算法生成的每一个聚类求残差,将每一个聚类中的残差分别相加,再将各“残差和”向量串连起来。IntraVLAD使用“内部归一化”方法,来消除视觉爆发现象。内部归一化分别对各个视觉单词对应的“残差和”子向量进行2-范数归一化处理。

卷积神经网络(Convolutional Neural Net,CNN)的研究源于Hubel和Wiesel对猫的视觉神经系统的研究,Hubel和Wiesel发现,视觉皮层的神经网络具有一种层次结构,“复杂细胞”在接受“简单细胞”的输出后,会选择性地对更加复杂的视觉模式产生响应,并且具有更大的“感受野”,对视觉模式的平移更加不敏感。基于CNN的方法是一种数据驱动的方法,首先利用图像数据来训练神经网络,然后通过训练后的神经网络来提取特征。网络参数是可以在训练过程中调节的,机器自动学习如何提取特征。而与此相对的,SIFT的提取过程是利用复杂的专业知识设计的,其参数一般是固定的。由于全连接层特征在描述图像上的较高准确性,一些研究者利用全连接层来提取图像的特征。然而,经过合适的处理,卷积层特征形成的图像表示可以在图像检索任务上获得较高的准确率。

CNN一般是在分类任务上训练的,为了适应分类任务,位于CNN后面的全连接层包含了较多的高层语义,而位于前面的卷积层则包含了较多的低层局部信息。因此,在仅使用全连接层特征的情况下,生成的图像表示缺乏局部信息。为了弥补底层图像特征与高层语义特征间的鸿沟以及提高检索的准确率,如何构建区分力强且占空间小的描述符具有重要意义。

发明内容

针对现有技术的缺陷和改进需求,本发明提供了一种基于特征融合的图像检索方法,其目的在于,提高增强图像描述符的区分力,同时节省存储开销。

为实现上述目的,按照本发明的一个方面,提供了一种基于特征融合的图像检索方法,包括:

模型训练步骤:建立用于提取图像特征的卷积神经网络,并利用训练图像集对其进行训练,得到特征提取网络;

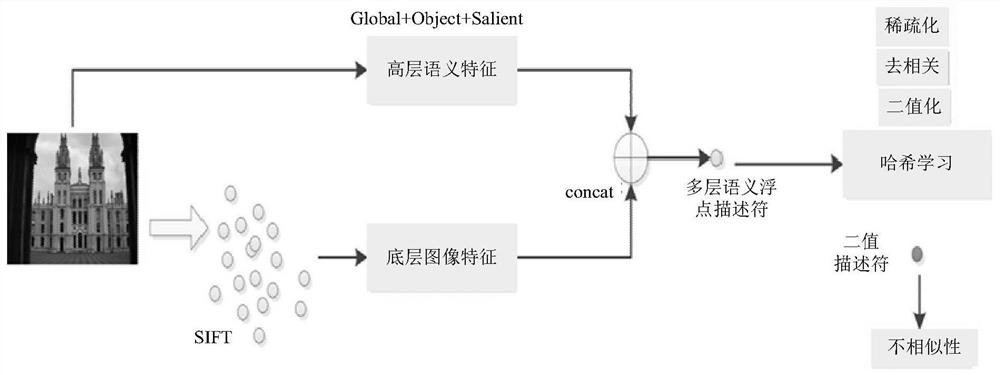

多层语义浮点描述符构建步骤:提取图像的至少一种高层语义特征和至少一种底层图像特征,并将所提取的高层语义特征和底层图像特征进行融合,得到图像的多层语义浮点描述符;高层语义特征包括全局描述符,全局描述符的提取方式为:将图像缩放至多个不同尺度,利用特征提取网络分别提取缩放后各尺度图像的特征,并融合为图像的全局描述符;底层图像特征包括SIFT描述符,SIFT描述符的提取方式为:提取图像的多个SIFT特征,并聚合为局部聚合描述符向量,作为图像的SIFT描述符;

哈希学习步骤:根据多层语义浮点描述符构建步骤提取训练图像集中每一幅图像的多层语义浮点描述符,得到浮点描述符集合F,并利用浮点描述符集合F进行哈希学习生成旋转矩阵R;

描述符库构建步骤:根据多层语义浮点描述符构建步骤提取图像库中每一幅图像的多层语义浮点描述符,并利用旋转矩阵R进行旋转,将旋转后的多层语义浮点描述符进行二值化,得到图像的二值描述符;利用已训练好的分类网络对图像库中的每一幅图像进行分类,得到各图像的类概率向量;对应存储各图像的二值描述符和类概率向量,以构建用于图像检索的描述符库。

本发明同时融合高层语义特征和底层图像特征,得到图像的多层语义浮点描述符,能够有效得弥补底层图像特征和高层语义特征间鸿沟,提高图像描述符的区分力;同时,本发明对图像描述图进行二值化压缩,能够有效节省存储开销。总的来说,本发明能够有效提高图像描述符的区分力,并降低图像描述符的存储开销。

本发明在构建图像描述符时,所提取的高层语义特征包括全局描述符,该全局描述符描述了图像的全局特征,同时,本发明在提取图像的全局描述符时,会对图像进行多尺度缩放,因此所提取的全局描述符可以捕获图像多个尺度的模式或对象信息,并且具有一定的尺度不变性,对几何变换更加的鲁棒。

本发明在构建图像描述符时,所提取的底层图像特征包括SIFT描述符,SIFT描述符描述了图像的小区域特征,包括图像的纹理、边缘等信息,由于SIFT特征对尺度、平移、旋转具有较强的不变性,还对光照变化、遮挡及噪声具有很好的鲁棒性,本发明能够利用SIFT特征与CNN特征的互补性,使得融合得到的多层语义浮点描述符具有更强的区分力,并增强描述符的几何不变性。

进一步地,高层语义特征还包括对象描述符,对象描述符的提取方式为:将图像缩放至多个不同的尺度,并分别对各尺度的图像进行对象检测,得到多个可能包含对象的图像分片,利用特征提取网络提取各图像分片的特征,并聚合为局部聚合描述符向量,作为图像的对象描述符。

本发明在构建图像描述符时,还会融合对象描述符,对象描述符描述了图像中的对象信息,因此,本发明所构建的多层语义浮点描述符能够很好地捕获图像对象信息,具有更强的区分力;本发明在提取对象描述符时,同样会对图像进行多尺度缩放操作,能够进一步增强几何不变性。

进一步地,在将提取的图像分片的特征聚合为聚合描述符向量时,使用软分配。

本发明在将提取的图像分片的特征聚合为聚合描述符向量时,使用软分配,能够解决码字二义性(visual word ambiguity)问题,提高对象描述符的准确性。

进一步地,高层语义特征还包括显著性区域描述符,显著性区域描述符的提取方式为:对图像进行显著性区域检测,生成图像的显著性图,将显著性图缩放至预设尺寸后与图像进行点乘,得到显著性区域,利用特征提取网络提取显著性区域的特征,作为图像的显著性区域描述符。

对象检测得到的图像分片是方形的,这些图像分片可能仅包含对象的一部分,还有可能来自杂乱的背景,不包含前景对象;本发明在提取了图像的对象描述符的基础上,进一步提取并融合了图像的显著性区域描述符,显著性区域描述符描述了显著性区域信息,进一步增强了所构建的多层语义浮点描述符的信息含量和区分力。

进一步地,哈希学习步骤中,利用浮点描述符集合F进行哈希学习生成旋转矩阵R,包括:

(S1)将浮点描述符集合F表示为矩阵形式,并对该矩阵进行正交旋转,得到矩阵X,基于矩阵X设置哈希学习的目标函数如下:

其中,f表示目标函数;B表示学到的哈希编码,R表示旋转矩阵,I表示单位矩阵;b

(S2)初始化旋转矩阵R和哈希编码B;

(S3)根据稠密度k逐列对哈希编码B中的列向量进行稀疏化,以保证在

(S4)固定哈希编码B,令矩阵变量C=BR

其中,SVD()表示奇异值分解,U和V表示奇异值分解得到的酉矩阵,S表示奇异值分解得到的半正定的对角矩阵;

(S5)固定旋转矩阵R,按照B=sign(RX)对编码矩阵B进行更新;其中,sign(.)表示符号函数;

(S6)迭代执行步骤(S3)~(S5),直至达到预设的最大迭代次数。

本发明在哈希学习的过程中,所设置的目标函数中,第一项||RX-B||

进一步地,描述符库构建步骤中,将旋转后的多层语义浮点描述符进行二值化,通过符号函数完成。

进一步地,本发明提供的基于特征融合的图像检索方法,还包括:

检索步骤:对于待检索的目标图像,根据多层语义浮点描述符构建步骤提取其多层语义浮点描述符,并利用旋转矩阵R进行旋转,将旋转后的多层语义浮点描述符进行二值化,得到目标图像的二值描述符;利用分类网络对目标图像进行分类,得到目标图像的类概率向量;分别计算目标图像与描述符库中各图像的二值描述符距离和类概率向量距离,以基于所计算的距离度量目标图像与描述符库中各图像之间的不相似性;按照不相似性从小到大的顺序对描述符库中的图像进行排序,将排序在前top-K的图像作为检索结果;

其中,top-K为预设的正整数或比例。

本发明基于目标图像与描述符库中图像之间的二值描述符距离和类概率向量距离来衡量目标图像与描述符库中图像之间的不相似性,并根据不相似性完成图像检索,由于二值描述符距离中携带了哈希视觉信息,类概率向量距离描述了图像的类语义信息,因此,本发明所计算的不相似性同时融合了哈希视觉信息和类语义信息,可以有效提高图像检索的准确率。

进一步地,不相似性为:

D(I

其中,I

进一步地,权重W

其中, 按照本发明的另一个方面,提供了一种计算机可读存储介质,该计算机可读存储介质包括存储的计算机程序,其中,在计算机程序被处理器运行时控制计算机可读存储介质所在设备执行本发明提供的基于特征融合的图像检索方法。 总体而言,通过本发明所构思的以上技术方案,能够取得以下有益效果: (1)本发明同时提取图像的高层语义特征和底层图像特征,融合为图像的多层语义浮点描述符,能够有效弥补底层图像特征和高层语义特征间的鸿沟,提高图像描述符的区分力;通过对多层语义浮点描述符进行二值化压缩处理,能够有效降低图像描述符的存储开销。总的来说,本发明构建了一种区分力强且存储开销小的图像描述符。 (2)本发明所构建的多层语义浮点描述符中,融合了图像的全局描述符和SIFT描述符,能够利用SIFT特征与CNN特征的互补性,使得融合得到的多层语义浮点描述符具有更强的区分力,并增强描述符的几何不变性。 (3)在本发明的优选方案中,所构建的多层语义浮点描述符中还融合了对象描述符,由此能够很好地捕获图像对象信息,具有更强的区分力。 (4)在本发明的优选方案中,所构建的多层语义浮点描述符中还融合了显著性区域描述符,能够进一步增强所构建的多层语义浮点描述符的信息含量和区分力。 (5)本发明在提取各层次的描述符时,都会对图像进行多尺度操作,能够有效提高尺度不变性,对几何变换更加的鲁棒。 (6)本发明在进行图像检索时,会基于目标图像与描述符库中图像之间的二值描述符距离和类概率向量距离来衡量目标图像与描述符库中图像之间的不相似性,并根据不相似性完成图像检索,由于二值描述符距离中携带了哈希视觉信息,类概率向量距离描述了图像的类语义信息,因此,本发明所计算的不相似性同时融合了哈希视觉信息和类语义信息,可以有效提高图像检索的准确率。 附图说明 图1为本发明实施例提供的基于特征融合的图像检索方法示意图; 图2为本发明实施例提供的多层语义浮点描述符的构建方法示意图; 图3为本发明实施例提供的特征提取网络架构图; 图4为本发明实施例提供的不相似性度量示意图。 具体实施方式 为了使本发明的目的、技术方案及优点更加清楚明白,以下结合附图及实施例,对本发明进行进一步详细说明。应当理解,此处所描述的具体实施例仅仅用以解释本发明,并不用于限定本发明。此外,下面所描述的本发明各个实施方式中所涉及到的技术特征只要彼此之间未构成冲突就可以相互组合。 在本发明中,本发明及附图中的术语“第一”、“第二”等(如果存在)是用于区别类似的对象,而不必用于描述特定的顺序或先后次序。 为了在图像检索任务中,构建区分力强且占空间小的描述符,以弥补底层图像特征与高层语义特征间的鸿沟,提高检索的准确率,本发明提供了一种基于特征融合的图像检索方法,其整体思路在于:同时利用全局和局部信息,结合深度特征及浅层特征,使描述符可以同时捕获全局和局部、高层和低层的信息,通过融合多个特征层次及多尺度信息,增强描述符的区分力和尺度不变性,通过对描述符进行二值化压缩,节省存储开销。 以下为实施例。 实施例1: 一种基于特征融合的图像检索方法,如图1所示,包括: 模型训练步骤:建立用于提取图像特征的卷积神经网络,并利用训练图像集对其进行训练,得到特征提取网络; 多层语义浮点描述符构建步骤:提取图像的至少一种高层语义特征和至少一种底层图像特征,并将所提取的高层语义特征和底层图像特征进行融合,得到图像的多层语义浮点描述符;图1和图2所示,本实施例中,高层语义特征包括全局描述符(Global)、对象描述符(Object)和显著性区域描述符(Salient),底层图像特征包括SIFT描述符,其中,全局描述符描述了图像的全局特征,对象描述符描述了图像中的对象信息,显著性区域描述符描述了图像显著性区域信息,SIFT描述符描述了图像的小区域特征,包括图像的纹理、边缘等信息; 哈希学习步骤:根据多层语义浮点描述符构建步骤提取训练图像集中每一幅图像的多层语义浮点描述符,得到浮点描述符集合F,并利用浮点描述符集合F进行哈希学习生成旋转矩阵R; 描述符库构建步骤:根据多层语义浮点描述符构建步骤提取图像库中每一幅图像的多层语义浮点描述符,并利用旋转矩阵R进行旋转,将旋转后的多层语义浮点描述符进行二值化,得到图像的二值描述符;利用已训练好的分类网络对图像库中的每一幅图像进行特征分类,得到各图像的类概率向量;对应存储各图像的二值描述符和类概率向量,以构建用于图像检索的描述符库; 本实施例中,在模型训练步骤中,所选取的卷积神经网络(CNN)可根据实际的精度要求选取,作为一种可选的实施方式,在本实施例中,所选取的卷积神经网络为VGG-16,其架构如图3所示;特征提取网络利用了CNN多个层的信息来生成输入图像的特征,在图3中,“GMP”表示Global Max-pooling层,“concat”表示“串连”;在训练时,特征提取网络首先会用在ImageNet数据集上训练的网络进行初始化,然后在目标数据集上进行微调,将特征提取网络作为一个softmax分类器进行训练;应当说明的是,此处仅为本发明一种可选的实施方式,不应理解为对本发明的唯一限定,在本发明其他的一些实施例中,也可以使用ResNet等其他的卷积神经网络; 本实施例中,所选用的训练图像集中,每一个样本由图像及其对应的类标签构成,具体可使用图像检索领域常用的Oxford5K,Paris6K,Holidays,UKB,Landmarks等数据集。 本实施例中,所述多层语义浮点描述符构建步骤具体如图2所示,以I表示输入图像各描述符的具体提取方式如下: 全局描述符的提取方式为: 将图像缩放至多个不同尺度,可选地,本实施例中,具体将图像缩放至三个尺度{0.75,1.0,1.25}; 利用特征提取网络分别提取缩放后各尺度图像的特征,并融合为图像的全局描述符;作为一种可选的实施方式,本实施例中,具体通过平均池化(Average Pooling)的方式将不同尺度的图像特征融合为图像的全局描述符; 本实施例提取图像的全局描述符的过程,可通过如下公式(1)~(3)进行描述: I g

在公式(1)~(3)中,resize 本实施例在提取图像的全局描述符时,会对图像进行多尺度缩放,因此所提取的全局描述符可以捕获图像多个尺度的模式或对象信息,并且具有一定的尺度不变性,对几何变换更加的鲁棒; 对象描述符的提取方式为: 将图像缩放至多个不同的尺度,由此能够充分捕获到各个尺度的对象信息;可选地,本实施例中,将图像缩放至三个尺度{1.25,1.0,0.75},保持长宽比不变; 分别对各尺度的图像进行对象检测,得到多个可能包含对象的图像分片; 利用特征提取网络提取各图像分片的特征,并聚合为局部聚合描述符向量,作为图像的对象描述符;作为一种可选的实施方式,本实施例中,在将图像分片的特征聚合为局部聚合描述符向量(VLAD)时,使用的是IntraVLAD;同时,为了提高描述符的准确性,在本实施例中,在使用IntraVLAD生成VLAD时,还使用了软分配,具体地,在生成VLAD时,每个特征分配到10个码字,码书的大小为200; 本实施例提取图像的对象描述符的过程,可通过如下公式(4)~(6)进行描述:

f F 在公式(4)~(6)中,resize 本实施例中,通过在多层语义浮点描述符中融合对象描述符,能够很好地捕获图像对象信息,具有更强的区分力;通过对图像进行多尺度缩放操作,能够进一步增强几何不变性;在将提取的图像分片的特征聚合为聚合描述符向量时,使用软分配,能够解决码字二义性(visual word ambiguity)问题,提高对象描述符的准确性; 显著性区域描述符的提取方式为: 对图像进行显著性区域检测,生成图像的显著性图,将显著性图缩放至预设尺寸后与图像进行点乘,得到显著性区域,利用特征提取网络提取显著性区域的特征,作为图像的显著性区域描述符; 本实施例提取图像的显著性区域描述符的过程,可通过如下公式(7)~(9)进行描述: M=resize(S(I)) (7)

F 在公式(7)~(9)中,S表示显著性区域检测器,resize表示对显著性区域检测结果进行缩放,可选地,在本实施例中,最终缩放为500*500,M表示缩放后的显著性图; 对象检测得到的图像分片是方形的,这些图像分片可能仅包含对象的一部分,还有可能来自杂乱的背景,不包含前景对象;本实施例在提取了图像的对象描述符的基础上,进一步提取并融合了图像的显著性区域描述符,显著性区域描述符描述了显著性区域信息,进一步增强了所构建的多层语义浮点描述符的信息含量和区分力; SIFT描述符的提取方式为: 提取图像的多个SIFT特征,并聚合为局部聚合描述符向量,作为图像的SIFT描述符;作为一种可选的实施方式,本实施例中,具体通过IntraVLAD将多个SIFT特征聚合为局部聚合描述符向量(VLAD); 本实施例中,SIFT描述符的提取方式,可通过如下公式(10)~(11)进行描述: {sf F 在公式(10)~(11)中,SIFT表示提取输入图像I的SIFT特征,可选的,本实施例中,提取图像的SIFT特征,具体使用的是HessianAffine-rootSIFT;sf 本实施例将SIFT特征与利用卷积神经网络提取的高层语义特征融合为图像的多层语义浮点描述符,能够利用SIFT特征与CNN特征的互补性,使得融合得到的多层语义浮点描述符具有更强的区分力,并增强描述符的几何不变性。 在本实施例中,提取到图像的高层语义特征和底层图像特征后,融合为多层语义浮点描述符的具体方式,可通过如下公式(12)~(16)所示:

F 在公式(12)~(16)中, 总体而言,本实施例同时融合高层语义特征和底层图像特征,得到图像的多层语义浮点描述符,能够有效得弥补底层图像特征和高层语义特征间鸿沟,提高图像描述符的区分力;同时,本发明对图像描述图进行二值化压缩,能够有效节省存储开销。 为了在通过二值化对图像描述符进行压缩的同时,最大程度上保持描述符的区分力,本实施例的哈希学习步骤中,利用浮点描述符集合F进行哈希学习生成旋转矩阵R,包括: (S1)将浮点描述符集合F表示为矩阵形式,并对该矩阵进行正交旋转,得到矩阵X,基于矩阵X设置哈希学习的目标函数如下:

其中,f表示目标函数;B表示学到的哈希编码,R表示旋转矩阵,I表示单位矩阵;b (S2)初始化旋转矩阵R和哈希编码B;作为一种可选的实施方式,在本实施例中,利用PCA旋转矩阵初始化旋转矩阵R,用ITQ哈希编码初始化哈希编码B,ITQ的具体方法可参考文献“Iterative quantization:A procrustean approach to learning binary codesfor large-scale image retrieval”,在此将不作复述,本实施例中,ITQ的迭代次数设为50; (S3)根据稠密度k逐列对哈希编码B中的列向量进行稀疏化,以保证在 (S4)固定哈希编码B,令矩阵变量C=BR 其中,SVD()表示奇异值分解,U和V表示奇异值分解得到的酉矩阵,S表示奇异值分解得到的半正定的对角矩阵; (S5)固定旋转矩阵R,按照B=sign(RX)对哈希编码B进行更新;其中,sign(.)表示符号函数; (S6)迭代执行步骤(S3)~(S5),即使用坐标下降法交替更新旋转矩阵R和哈希编码B,直至达到预设的最大迭代次数。 本实施例在哈希学习的过程中,所设置的目标函数中,第一项||RX-B|| 作为一种可选的实施方式,本实施例的描述符库构建步骤中,将旋转后的多层语义浮点描述符进行二值化,通过符号函数完成。 作为一种可选的实施方式,本实施例的描述符库构建步骤中,所选用的分类网络为ResNet网络,该网络在数据集ImageNet上训练好了之后,在目标数据集上进行了微调;应当说明的是,此处关于分类网络的选择,仅为本发明的一种优选的实施方式,不应理解为对本发明的唯一限定,在本发明其他的一些实施例中,也可以选用AlexNet等其他的分类网络; 基于所构建的描述符库,如图1所示,本实施例还包括: 检索步骤:对于待检索的目标图像,根据多层语义浮点描述符构建步骤提取其多层语义浮点描述符,并利用旋转矩阵R进行旋转,将旋转后的多层语义浮点描述符进行二值化,得到目标图像的二值描述符;利用ResNet网络对目标图像进行分类,得到目标图像的类概率向量;分别计算目标图像与描述符库中各图像的二值描述符距离和类概率向量距离,以基于所计算的距离度量目标图像与描述符库中各图像之间的不相似性;按照不相似性从小到大的顺序对描述符库中的图像进行排序,将排序在前top-K的图像作为检索结果; 本实施例中,不相似性的计算方式如图4所示,具体地,不相似性为: D(I 其中,I 本实施例基于目标图像与描述符库中图像之间的二值描述符距离和类概率向量距离来衡量目标图像与描述符库中图像之间的不相似性,并根据不相似性完成图像检索,由于二值描述符距离中携带了哈希视觉信息,类概率向量距离描述了图像的类语义信息,因此,所计算的不相似性同时融合了哈希视觉信息和类语义信息,可以有效提高图像检索的准确率。 实施例2: 一种基于特征融合的图像检索方法,本实施例与上述实施例1类似,所不同之处在于,本实施例中,高层语义特征包括全局描述符、对象描述符,底层图像特征包括SIFT描述符。 本实施例的具体实现,可参考上述实施例1中的描述,在此将不作复述。 实施例3: 一种基于特征融合的图像检索方法,本实施例与上述实施例1类似,所不同之处在于,本实施例中,高层语义特征包括全局描述符,底层图像特征包括SIFT描述符。 本实施例的具体实现,可参考上述实施例1中的描述,在此将不作复述。 实施例4: 一种计算机可读存储介质,该计算机可读存储介质包括存储的计算机程序,其中,在计算机程序被处理器运行时控制计算机可读存储介质所在设备执行上述实施例1-3任意任一项提供的基于特征融合的图像检索方法。 本领域的技术人员容易理解,以上所述仅为本发明的较佳实施例而已,并不用以限制本发明,凡在本发明的精神和原则之内所作的任何修改、等同替换和改进等,均应包含在本发明的保护范围之内。

- 一种基于特征融合的图像检索方法

- 一种基于特征融合的图像检索方法