一种基于神经网络的数据分类方法、系统及存储介质

文献发布时间:2023-06-19 12:18:04

技术领域

本发明涉及数据处理领域,更具体的,涉及一种基于神经网络的数据分类方法、系统及存储介质。

背景技术

随着互联网技术的高速发展,海量的信息通过互联网发布,同时也在系统中进行数字化存储。信息量的不断增加提升了信息检索的难度,也对信息的有序管理提出更高的挑战。这就需要更加有效的方法和工具以高效地、自动地完成海量信息的组织、理解、检索,提高信息的利用效率和精准度,减少信息利用难度。数据分类是数据挖掘和自然语言处理领域中的一个重要处理步骤,是许多应用技术实现的前提,同时能够提高信息的处理效率,节约人工处理成本,改善用户使用体验,近年来已得到了广泛的关注,已成为信息检索与数据挖掘研究领域的热点方向。

为了能够对数据信息实现精准的分类,需要开发一款系统与之进行匹配,该系统通过对待分类数据通过预处理进行分词,获取数据的特征项,建立特征表达模型,将所述特征项进行转换,生成特征项向量表达,基于所述特征项向量表达及神经网络建立数据分类模型,将向量化的特征项导入所述数据分类模型,通过所述数据分类模型中的分类模块进行结果预测,根据投票得分方式得到预测分类结果。在系统的实现过程中,如何将数据特征项进行向量化表达以及如何通过数据分类模型实现待分类数据的精确分类都是亟不可待需要解决的问题。

发明内容

为了解决上述至少一个技术问题,本发明提出了一种基于神经网络的数据分类方法、系统及存储介质。

本发明第一方面提供了一种基于神经网络的数据分类方法,包括:

获取待分类数据,将所述待分类数据通过预处理,获取数据的特征项;

基于神经网络建立特征表达模型;

通过上下文获取目标数据特征项的领域半径内的特征项,得到获取训练数据特征项的序列;

利用输入层向量和数据特征项矩阵进行相乘,将相乘后所得矩阵映射到输出层,得到特征项向量;

对训练序列中的全部特征项向量进行平均化处理,得到特征项的平均向量,生成特征项向量表达;

基于所述特征项向量表达及神经网络建立数据分类模型,将向量化的特征项导入所述数据分类模型;

通过所述数据分类模型中的分类模块进行结果预测,根据投票得分方式得到预测分类结果。

本方案中,所述平均化处理的计算公式,具体为:

其中,

本方案中,所述的基于所述特征项向量表达及神经网络建立数据分类模型,具体为:

基于所述特征项向量及神经网络建立数据分类模型,将所述数据分类模型中的分类模块进行初始化训练;

获取训练样本,将训练样本进行分类生成训练集,采集所述训练集的特征,进行随机合并生成新训练样本特征;

通过所述训练集及所述新训练样本特征随机导入所述分类模块进行训练;

生成训练后数据分类模型,将所述特征项向量导入训练后数据分类模型,对待分类数据进行分类预测。

本方案中,所述通过所述训练集及所述新训练样本特征随机导入所述分类模块进行训练,具体为:

根据随机抽样算法将原始的训练样本分类生成若干训练集;

在所述训练集中,基于特征项向量表达随机生成数据特征,将所述数据特征生成新训练样本特征子集;

将所述训练集及新训练样本特征子集随机导入分类模块中的子分类器中训练各子分类器;

根据各子分类器的获取第一次分类结果,将所述第一次分类结果再次输入到数据分类模型,并进行多次迭代,得到多次迭代后的若干分类结果;

预设数据分类模型的误差阈值,比较计算所述若干分类结果得到误差值;

判断所述误差值是否小于所述误差阈值,若小于,则证明所述数据分类模型训练完毕。

本方案中,所述的数据分类模型的数学表示形式为:

其中,

本方案中,通过修正参数对数据分类模型的分类精度进行补偿,具体为:

给定已明确所属类别的数据信息,导入数据分类模型;

获取数据分类模型的分类结果,根据所述分类结果计算得出数据分类模型的分类精度;

将所述分类精度与数据信息的所属类别进行比较,生成偏差率;

判断所述偏差率是否大于预设偏差率;

若大于,根据所述修正参数调整分类模块中的分类器数量信息及特征选择率信息确定修正参数;

通过所述修正参数对数据分类模型的分类精度进行补偿。

本发明第二方面还提供了一种基于神经网络的数据分类系统,该系统包括:存储器、处理器,所述存储器中包括一种基于神经网络的数据分类方法程序,所述一种基于神经网络的数据分类方法程序被所述处理器执行时实现如下步骤:

获取待分类数据,将所述待分类数据通过预处理,获取数据的特征项;

基于神经网络建立特征表达模型;

通过上下文获取目标数据特征项的领域半径内的特征项,得到获取训练数据特征项的序列;

利用输入层向量和数据特征项矩阵进行相乘,将相乘后所得矩阵映射到输出层,得到特征项向量;

对训练序列中的全部特征项向量进行平均化处理,得到特征项的平均向量,生成特征项向量表达;

基于所述特征项向量表达及神经网络建立数据分类模型,将向量化的特征项导入所述数据分类模型;

通过所述数据分类模型中的分类模块进行结果预测,根据投票得分方式得到预测分类结果。

本方案中,所述平均化处理的计算公式,具体为:

其中,

本方案中,所述的基于所述特征项向量表达及神经网络建立数据分类模型,具体为:

基于所述特征项向量及神经网络建立数据分类模型,将所述数据分类模型中的分类模块进行初始化训练;

获取训练样本,将训练样本进行分类生成训练集,采集所述训练集的特征,进行随机合并生成新训练样本特征;

通过所述训练集及所述新训练样本特征随机导入所述分类模块进行训练;

生成训练后数据分类模型,将所述特征项向量导入训练后数据分类模型,对待分类数据进行分类预测。

本方案中,所述通过所述训练集及所述新训练样本特征随机导入所述分类模块进行训练,具体为:

根据随机抽样算法将原始的训练样本分类生成若干训练集;

在所述训练集中,基于特征项向量表达随机生成数据特征,将所述数据特征生成新训练样本特征子集;

将所述训练集及新训练样本特征子集随机导入分类模块中的子分类器中训练各子分类器;

根据各子分类器的获取第一次分类结果,将所述第一次分类结果再次输入到数据分类模型,并进行多次迭代,得到多次迭代后的若干分类结果;

预设数据分类模型的误差阈值,比较计算所述若干分类结果得到误差值;

判断所述误差值是否小于所述误差阈值,若小于,则证明所述数据分类模型训练完毕。

本方案中,所述的数据分类模型的数学表示形式为:

其中,

本方案中,通过修正参数对数据分类模型的分类精度进行补偿,具体为:

给定已明确所属类别的数据信息,导入数据分类模型;

获取数据分类模型的分类结果,根据所述分类结果计算得出数据分类模型的分类精度;

将所述分类精度与数据信息的所属类别进行比较,生成偏差率;

判断所述偏差率是否大于预设偏差率;

若大于,根据所述修正参数调整分类模块中的分类器数量信息及特征选择率信息确定修正参数;

通过所述修正参数对数据分类模型的分类精度进行补偿。

本发明第三方面还提供一种计算机可读存储介质,所述计算机可读存储介质中包括一种基于神经网络的数据分类方法程序,所述一种基于神经网络的数据分类方法程序被处理器执行时,实现如上述任一项所述的一种基于神经网络的数据分类方法的步骤。

本发明公开的一种基于神经网络的数据分类方法、系统及存储介质,包括:获取待分类数据,将所述待分类数据通过预处理,获取数据的特征项,建立特征表达模型,将所述特征项进行转换,生成特征项向量表达,基于所述特征项向量表达及神经网络建立数据分类模型,将向量化的特征项导入所述数据分类模型,通过所述数据分类模型中的分类模块进行结果预测,根据投票得分方式得到预测分类结果。本发明中将训练样本通过随机抽样算法将样本分割,并重新提取数据特征充分利用了多样性原理,提高了数据分类模型的分类精度,保证了模型的鲁棒性,使得数据分类模型保持长时间的准确判断,同时训练样本的多样性和数据特征的多样性确保了数据分类模型的分类性能。

附图说明

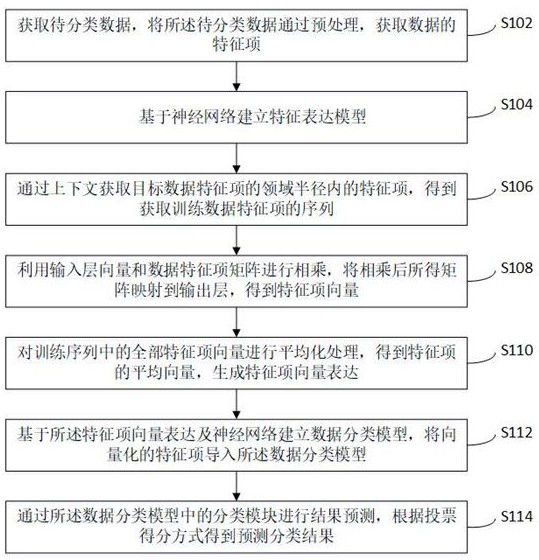

图1示出了本发明一种基于神经网络的数据分类方法的流程图;

图2示出了本发明基于特征项向量表达及神经网络建立数据分类模型的方法流程图;

图3示出了本发明通过修正参数对数据分类模型的分类精度进行补偿的方法流程图;

图4示出了本发明一种基于神经网络的数据分类系统的框图。

具体实施方式

为了能够更清楚地理解本发明的上述目的、特征和优点,下面结合附图和具体实施方式对本发明进行进一步的详细描述。需要说明的是,在不冲突的情况下,本申请的实施例及实施例中的特征可以相互组合。

在下面的描述中阐述了很多具体细节以便于充分理解本发明,但是,本发明还可以采用其他不同于在此描述的其他方式来实施,因此,本发明的保护范围并不受下面公开的具体实施例的限制。

图1示出了本发明一种基于神经网络的数据分类方法的流程图。

如图1所示,本发明第一方面提供了一种基于神经网络的钢筋检测分类方法,包括:

S102,获取待分类数据,将所述待分类数据通过预处理,获取数据的特征项;

S104,基于神经网络建立特征表达模型;

S106,通过上下文获取目标数据特征项的领域半径内的特征项,得到获取训练数据特征项的序列;

S108,利用输入层向量和数据特征项矩阵进行相乘,将相乘后所得矩阵映射到输出层,得到特征项向量;

S110,对训练序列中的全部特征项向量进行平均化处理,得到特征项的平均向量,生成特征项向量表达;

S112,基于所述特征项向量表达及神经网络建立数据分类模型,将向量化的特征项导入所述数据分类模型;

S114,通过所述数据分类模型中的分类模块进行结果预测,根据投票得分方式得到预测分类结果。

需要说明的是,获取待分类数据,待分类数据可以是文本或文档,通过预处理对待分类数据进行分词,根据分词结果获取数据的特征项。

需要说明的是,数据分类模型中的分类模块进行结果预测后,统计分类模块中子分类器的数量,对当前数据分类模型中的各个子分类器进行投票,生成各个子分类器的投票结果,具体为:向数据分类模型中待投票子分类器外的其他子分类器进行投票请求,生成待投票子分类器的投票结果;判断当前数据分类模型中的各个子分类器是否都具有投票结果;若是,则生成各个子分类器的投票结果;若否,则继续进行待投票子分类器外的其他子分类器进行投票请求操作;将各个子分类器的得分进行整理分析,当至少有两个子分类器得分相同时,获取得分相同的子分类器对应的投票结果,根据所述投票结果的均匀度对得分相同的子分类器进行分析比较;选取得分符合预设条件的分类结果,将所述符合预设条件的分类结果进行整合化处理得到数据分类模型中的最终分类结果。

需要说明的是,所述平均化处理的计算公式具体为:

其中,

图2示出了本发明基于特征项向量表达及神经网络建立数据分类模型的方法流程图。

根据本发明实施例,基于特征项向量表达及神经网络建立数据分类模型,具体为:

S202,基于所述特征项向量及神经网络建立数据分类模型,将所述数据分类模型中的分类模块进行初始化训练;

S204,获取训练样本,将训练样本进行分类生成训练集,采集所述训练集的特征,进行随机合并生成新训练样本特征;

S206,通过所述训练集及所述新训练样本特征随机导入所述分类模块进行训练;

S208,生成训练后数据分类模型,将所述特征项向量导入训练后数据分类模型,对待分类数据进行分类预测。

需要说明的是,所述通过所述训练集及所述新训练样本特征随机导入所述分类模块进行训练,具体为:

根据随机抽样算法将原始的训练样本分类生成若干训练集;

在所述训练集中,基于特征项向量表达随机生成数据特征,将所述数据特征生成新训练样本特征子集;

将所述训练集及新训练样本特征子集随机导入分类模块中的子分类器中训练各子分类器;

根据各子分类器的获取第一次分类结果,将所述第一次分类结果再次输入到数据分类模型,并进行多次迭代,得到多次迭代后的若干分类结果;

预设数据分类模型的误差阈值,比较计算所述若干分类结果得到误差值;

判断所述误差值是否小于所述误差阈值,若小于,则证明所述数据分类模型训练完毕。

需要说明的是,所述的数据分类模型的数学表示形式为:

其中,

需要说明的是,构建数据分类模型过程通过一系列算法实现,上述公式为基于神经网络的数据分类模型的数学表示形式,确定隐藏层中分类器个数,通过赋予不同的连接隐藏层和输出层权值向量,对于训练样本中的训练集及新训练样本特征子集,增强新训练样本特征子集中数据的影响,减弱训练集中数据的影响,从而达到提升数据分类精度的目的。

图3示出了本发明通过修正参数对数据分类模型的分类精度进行补偿的方法流程图。

根据本发明实施例,本发明还包括,通过修正参数对数据分类模型的分类精度进行补偿,具体为:

S302,给定已明确所属类别的数据信息,导入数据分类模型;

S304,获取数据分类模型的分类结果,根据所述分类结果计算得出数据分类模型的分类精度;

S306,将所述分类精度与数据信息的所属类别进行比较,生成偏差率;

S308,判断所述偏差率是否大于预设偏差率;

S310,若大于,根据所述修正参数调整分类模块中的分类器数量信息及特征选择率信息确定修正参数;

S312,通过所述修正参数对数据分类模型的分类精度进行补偿。

根据本发明实施例,本发明中为了度量特征项在不同类别的数据信息中的类别区分能力,具体为:

对待分类数据中的数据信息进行预处理,进行特征项的提取;

经过预处理后,将所述数据信息表示为特征项的集合;

通过训练样本生成训练集,计算训练集中各个特征项的信息熵;

设置信息熵阈值,将所述信息熵与信息熵阈值进行比较判断;

若大于,则说明该特征项区分类别作用明显,若小于,则将该特征项标记为低频特征项,在进行数据分类时减少其投票得分权重。

需要说明的是,所述的计算训练集中各个特征项的信息熵计算公式,具体为:

其中,

需要说明的是,通过训练样本生成训练集,设所述训练集中含有

根据本发明实施例,本发明还可以根据目标用户的需求对待分类数据进行分类处理,具体为:

将目标用户的需求进行特征值提取,根据所述特征值将生成需求标签;

根据所述需求标签确定待分类数据的所属类别及分类项数目信息;

根据所述需求标签计算待分类数据中各所属类别的权重信息,同时根据所述需求标签训练数据分类模型;

通过数据分类模型中的分类模块根据所述权重信息对输入数据分类模型的数据进行投票,生成最终分类结果;

根据所述类别及分类项数目将最终分类结果进行第一次核验;

将所述最终分类结果进行n次随机抽验,判断选取待分类数据中的特征项在最终分类结果中的分类信息与预设分类信息是否一致,并将n次抽验的结果计算偏差率,生成第二次核验结果;

将所述第一次核验结果和所述第二次核验结果进行整合分析,生成最终核验结果,预设最终核验结果阈值;

判断所述最终核验结果是否小于所述最终核验结果阈值;

若小于,则证明最终分类结果符合目标用户需求,完成数据分类项目。

图4示出了本发明一种基于神经网络的数据分类系统的框图。

本发明第二方面还提供了一种基于神经网络的数据分类系统4,该系统包括:存储器41、处理器42,所述存储器中包括一种基于神经网络的数据分类方法程序,所述一种基于神经网络的数据分类方法程序被所述处理器执行时实现如下步骤:

获取待分类数据,将所述待分类数据通过预处理,获取数据的特征项;

基于神经网络建立特征表达模型;

通过上下文获取目标数据特征项的领域半径内的特征项,得到获取训练数据特征项的序列;

利用输入层向量和数据特征项矩阵进行相乘,将相乘后所得矩阵映射到输出层,得到特征项向量;

对训练序列中的全部特征项向量进行平均化处理,得到特征项的平均向量,生成特征项向量表达;

基于所述特征项向量表达及神经网络建立数据分类模型,将向量化的特征项导入所述数据分类模型;

通过所述数据分类模型中的分类模块进行结果预测,根据投票得分方式得到预测分类结果。

需要说明的是,数据分类模型中的分类模块进行结果预测后,统计分类模块中子分类器的数量,对当前数据分类模型中的各个子分类器进行投票,生成各个子分类器的投票结果,具体为:向数据分类模型中待投票子分类器外的其他子分类器进行投票请求,生成待投票子分类器的投票结果;判断当前数据分类模型中的各个子分类器是否都具有投票结果;若是,则生成各个子分类器的投票结果;若否,则继续进行待投票子分类器外的其他子分类器进行投票请求操作;将各个子分类器的得分进行整理分析,当至少有两个子分类器得分相同时,获取得分相同的子分类器对应的投票结果,根据所述投票结果的均匀度对得分相同的子分类器进行分析比较;选取得分符合预设条件的分类结果,将所述符合预设条件的分类结果进行整合化处理得到数据分类模型中的最终分类结果。

需要说明的是,所述平均化处理的计算公式具体为:

其中,

根据本发明实施例,基于特征项向量表达及神经网络建立数据分类模型,具体为:

基于所述特征项向量及神经网络建立数据分类模型,将所述数据分类模型中的分类模块进行初始化训练;

获取训练样本,将训练样本进行分类生成训练集,采集所述训练集的特征,进行随机合并生成新训练样本特征;

通过所述训练集及所述新训练样本特征随机导入所述分类模块进行训练;

生成训练后数据分类模型,将所述特征项向量导入训练后数据分类模型,对待分类数据进行分类预测。

需要说明的是,所述通过所述训练集及所述新训练样本特征随机导入所述分类模块进行训练,具体为:

根据随机抽样算法将原始的训练样本分类生成若干训练集;

在所述训练集中,基于特征项向量表达随机生成数据特征,将所述数据特征生成新训练样本特征子集;

将所述训练集及新训练样本特征子集随机导入分类模块中的子分类器中训练各子分类器;

根据各子分类器的获取第一次分类结果,将所述第一次分类结果再次输入到数据分类模型,并进行多次迭代,得到多次迭代后的若干分类结果;

预设数据分类模型的误差阈值,比较计算所述若干分类结果得到误差值;

判断所述误差值是否小于所述误差阈值,若小于,则证明所述数据分类模型训练完毕。

需要说明的是,所述的数据分类模型的数学表示形式为:

其中,

需要说明的是,构建数据分类模型过程通过一系列算法实现,上述公式为基于神经网络的数据分类模型的数学表示形式,确定隐藏层中分类器个数,通过赋予不同的连接隐藏层和输出层权值向量,对于训练样本中的训练集及新训练样本特征子集,增强新训练样本特征子集中数据的影响,减弱训练集中数据的影响,从而达到提升数据分类精度的目的。

根据本发明实施例,本发明还包括,通过修正参数对数据分类模型的分类精度进行补偿,具体为:

给定已明确所属类别的数据信息,导入数据分类模型;

获取数据分类模型的分类结果,根据所述分类结果计算得出数据分类模型的分类精度;

将所述分类精度与数据信息的所属类别进行比较,生成偏差率;

判断所述偏差率是否大于预设偏差率;

若大于,根据所述修正参数调整分类模块中的分类器数量信息及特征选择率信息确定修正参数;

通过所述修正参数对数据分类模型的分类精度进行补偿。

根据本发明实施例,本发明中为了度量特征项在不同类别的数据信息中的类别区分能力,具体为:

对待分类数据中的数据信息进行预处理,进行特征项的提取;

经过预处理后,将所述数据信息表示为特征项的集合;

通过训练样本生成训练集,计算训练集中各个特征项的信息熵;

设置信息熵阈值,将所述信息熵与信息熵阈值进行比较判断;

若大于,则说明该特征项区分类别作用明显,若小于,则将该特征项标记为低频特征项,在进行数据分类时减少其投票得分权重。

需要说明的是,所述的计算训练集中各个特征项的信息熵计算公式,具体为:

其中,

需要说明的是,通过训练样本生成训练集,设所述训练集中含有

根据本发明实施例,本发明还可以根据目标用户的需求对待分类数据进行分类处理,具体为:

将目标用户的需求进行特征值提取,根据所述特征值将生成需求标签;

根据所述需求标签确定待分类数据的所属类别及分类项数目信息;

根据所述需求标签计算待分类数据中各所属类别的权重信息,同时根据所述需求标签训练数据分类模型;

通过数据分类模型中的分类模块根据所述权重信息对输入数据分类模型的数据进行投票,生成最终分类结果;

根据所述类别及分类项数目将最终分类结果进行第一次核验;

将所述最终分类结果进行n次随机抽验,判断选取待分类数据中的特征项在最终分类结果中的分类信息与预设分类信息是否一致,并将n次抽验的结果计算偏差率,生成第二次核验结果;

将所述第一次核验结果和所述第二次核验结果进行整合分析,生成最终核验结果,预设最终核验结果阈值;

判断所述最终核验结果是否小于所述最终核验结果阈值;

若小于,则证明最终分类结果符合目标用户需求,完成数据分类项目。

本发明第三方面还提供一种计算机可读存储介质,所述计算机可读存储介质中包括一种基于神经网络的数据分类方法程序,所述一种基于神经网络的数据分类方法程序被处理器执行时,实现如上述任一项所述的一种基于神经网络的数据分类方法的步骤。

本发明公开的一种基于神经网络的数据分类方法、系统及存储介质,包括:获取待分类数据,将所述待分类数据通过预处理,获取数据的特征项,建立特征表达模型,将所述特征项进行转换,生成特征项向量表达,基于所述特征项向量表达及神经网络建立数据分类模型,将向量化的特征项导入所述数据分类模型,通过所述数据分类模型中的分类模块进行结果预测,根据投票得分方式得到预测分类结果。本发明中将训练样本通过随机抽样算法将样本分割,并重新提取数据特征充分利用了多样性原理,提高了数据分类模型的分类精度,保证了模型的鲁棒性,使得数据分类模型保持长时间的准确判断,同时训练样本的多样性和数据特征的多样性确保了数据分类模型的分类性能。

在本申请所提供的几个实施例中,应该理解到,所揭露的设备和方法,可以通过其它的方式实现。以上所描述的设备实施例仅仅是示意性的,例如,所述单元的划分,仅仅为一种逻辑功能划分,实际实现时可以有另外的划分方式,如:多个单元或组件可以结合,或可以集成到另一个系统,或一些特征可以忽略,或不执行。另外,所显示或讨论的各组成部分相互之间的耦合、或直接耦合、或通信连接可以是通过一些接口,设备或单元的间接耦合或通信连接,可以是电性的、机械的或其它形式的。

上述作为分离部件说明的单元可以是、或也可以不是物理上分开的,作为单元显示的部件可以是、或也可以不是物理单元;既可以位于一个地方,也可以分布到多个网络单元上;可以根据实际的需要选择其中的部分或全部单元来实现本实施例方案的目的。

另外,在本发明各实施例中的各功能单元可以全部集成在一个处理单元中,也可以是各单元分别单独作为一个单元,也可以两个或两个以上单元集成在一个单元中;上述集成的单元既可以采用硬件的形式实现,也可以采用硬件加软件功能单元的形式实现。

本领域普通技术人员可以理解:实现上述方法实施例的全部或部分步骤可以通过程序指令相关的硬件来完成,前述的程序可以存储于计算机可读取存储介质中,该程序在执行时,执行包括上述方法实施例的步骤;而前述的存储介质包括:移动存储设备、只读存储器(ROM,Read-Only Memory)、随机存取存储器(RAM,Random Access Memory)、磁碟或者光盘等各种可以存储程序代码的介质。

或者,本发明上述集成的单元如果以软件功能模块的形式实现并作为独立的产品销售或使用时,也可以存储在一个计算机可读取存储介质中。基于这样的理解,本发明实施例的技术方案本质上或者说对现有技术做出贡献的部分可以以软件产品的形式体现出来,该计算机软件产品存储在一个存储介质中,包括若干指令用以使得一台计算机设备(可以是个人计算机、服务器、或者网络设备等)执行本发明各个实施例所述方法的全部或部分。而前述的存储介质包括:移动存储设备、ROM、RAM、磁碟或者光盘等各种可以存储程序代码的介质。

以上所述,仅为本发明的具体实施方式,但本发明的保护范围并不局限于此,任何熟悉本技术领域的技术人员在本发明揭露的技术范围内,可轻易想到变化或替换,都应涵盖在本发明的保护范围之内。因此,本发明的保护范围应以所述权利要求的保护范围为准。

- 一种基于神经网络的数据分类方法、系统及存储介质

- 一种基于神经网络的钢筋检测分类方法、系统及存储介质