头戴式遥操作控制设备

文献发布时间:2023-06-19 10:35:20

技术领域

本说明书涉及遥操作设备技术领域,具体涉及一种头戴式遥操作控制设备。

背景技术

遥操作机器人主要用于各种危险性场合,诸如在军事领域实现高危险物的搜索、转移和销毁任务,在工业运维领域完成特殊场合的运维和仪器设备操作等工作。目前,遥操作机器人工作时,操作人员需要采用采用控制端的操控组件触发生成控制指令;而当前的操控组件多为按钮、摇杆、推杆、踏板或者触摸屏等常规组件。

此外,遥操作控制端向用户提供沉浸式场景,实现用户的临场感;但是用户临场感的增加使得用户对控制端的感知能力减弱;而采用按钮、摇杆等常规组件控制方式需要用户在临场环境和控制端真实环境的切换,如此增加了用户的操作负担、降低了指令触发效率。

发明内容

本说明书提供一种头戴式遥操作控制设备,包括:

头盔组件,用于使所述控制设备佩戴于操作人员的头部;

显示输出组件,安装在所述头盔组件上,用于输出由执行端传输至所述控制设备的远程状态信息;

头部生物信息采集装置,用于生成对应类型的源特征信号;各种所述头部生物信息采集装置均安装在所述头盔组件上;

控制芯片,用于:将接收到的预设周期内的各个源特征信号转换为对应生物信息源的行为向量;

根据行为向量和对应源的特征向量确定行为向量在模糊可测空间的坐标区间,根据所述坐标区间和对应源的隶属度函数计算隶属度向量;

将各个源对应的隶属度向量输入指令预测神经网络模型,得到输出指令;

以及用于向所述显示输出组件提供显示驱动信号。

可选地,所述头部生物信息采集装置包括用眼动组件;

所述眼动组件设置在所述显示输出组件靠近操作人员头部的一侧,用于检测操作人员的眼动特征,生成眼动特征信号。

可选地,所述头部生物信息采集装置包括脑电电极;

所述脑电电极用于贴合操作人员头部皮肤而检测操作人员的脑电特征,生成脑电特征信号。

可选地,所述脑电电极包括用于抵靠操作人员额部皮肤的第一电极,以及用于抵靠操作人员的耳部周围的皮肤的第二电极。

可选地,所述头部生物信息采集装置包括拾音器;

所述拾音器用于采集操作人员的声音,生成声音特征信号。

可选地,所述显示输出组件为双目视觉输出组件,包括两个独立的输出显示屏,以及实现操作人员双眼视场隔离的隔离部件。

可选地,所述显示输出组件还用于各种控制指令的输出状态。

可选地,包括背包组件;

所述控制芯片安装在所述背包组件上的设备板卡上;

所述显示输出组件和各个所述头部生物信息采集装置分别通过对应的数据接口与所述板卡连接。

可选地,还包括设置在所述背包组件中、用于实现与执行端通信的无线通信部件;所述无线通信部件与所述控制芯片的数据通信。

可选地,还包括扬声器;所述扬声器也用于输出由执行端传输至所述控制设备的远程状态信息。

采用本说明书提供的头戴式遥操作控制设备的情况下,操作人员可以在观察显示输出组件输出的图像信息而处在临场感觉的情况下,同时输出各种控制指令而无需感知控制端各种控制组件的位置,也就是操作人员无需在临场感觉和真实场景感觉之间进行感觉切换,继而提高了控制指令输出效率。

本发明中,上述各技术方案之间还可以相互组合,以实现更多的优选组合方案。本发明的其他特征和优点将在随后的说明书中阐述,并且,部分优点可从说明书中变得显而易见,或者通过实施本发明而了解。本发明的目的和其他优点可通过说明书以及附图中所特别指出的内容中来实现和获得。

附图说明

附图仅用于示出具体实施例的目的,而并不认为是对本发明的限制。

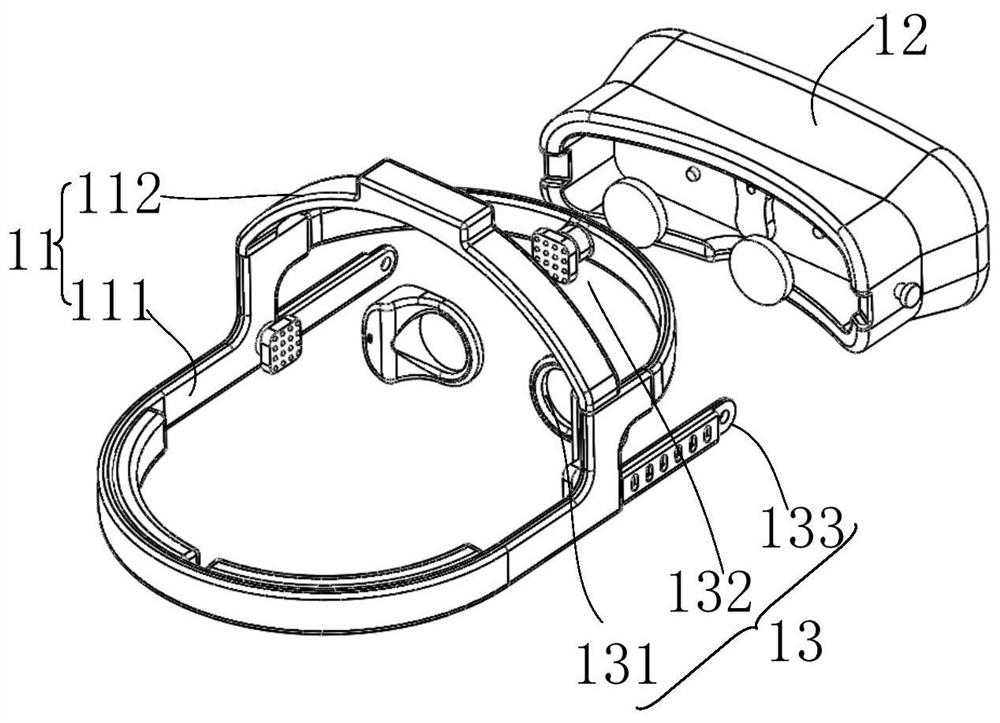

图1是实施例提供的头戴式遥操作控制设备的爆炸结构示意图;

图2是控制芯片生成控制指令的流程图;

其中:11-头盔组件,111-周向箍部,112-顶部半箍部,12-显示输出组件,13-生物信息源采集装置,131-眼动组件,132-脑电电极,133-拾音器。

具体实施方式

下面结合附图来具体描述本发明的优选实施例,其中,附图构成本申请一部分,并与本发明的实施例一起用于阐释本发明的原理,并非用于限定本发明的范围。

本发明实施例提供一种头戴式遥操作控制设备,用于在操作人员处在临场感环境下能够方便地输出各种控制指令。

图1是实施例提供的头戴式遥操作控制设备的爆炸结构示意图。如图1所示,本实施例中的控制设备包括头盔组件11、显示输出组件12、生物信息源采集装置13;另外,控制设备还包括控制芯片(图中未示出)。

头盔组件11用于使得控制设备佩戴于操作人员的头部。如图1所示,本实施例中的头盔组件11采用周向箍部111和顶部半箍部112,利用周向箍部111和顶部半箍部112实现定位功能,使得控制设备能够稳固地佩戴在操作人员的头部,并保证操作人员在执行各种动作时控制设备并不相对操作人员头部发生晃动。

显示输出组件12用于通过图像显示的方式,向用户输出执行端传输至控制设备的远程状态信息。显示输出组件12安装在头盔组件11的前部,能够直接将显示输出信息呈现在操作人员的眼前。具体应用中,为了提高操作人员的临场感觉,显示输出组件12为双目视觉输出组件,其包括两个独立地输出显示屏;两个独立的输出显示屏用于分别显示远程执行端的双目摄像头分别采集的图像信息;另外显示输出组件12还包括用于实现操作人员双眼视场隔离的隔离部件。在隔离部件的隔离限制下,操作人员的两个眼睛分别获取不同的图像,随后操作人员通过大脑的自适应处理形成三维场景图像,而提高临场感。

生物信息源采集装置13也安装在头盔组件11上,用于采集操作人员头部相应类型的行为特征,生成源特征信号。实际应用中,操作人员的特定的行为特征和特定的控制指令建立对应关系,后续处理过程中根据源特征信号可以确定对应的控制指令。

实际应用中,操作人员头部的行为特征包括眼部动作、脑电信号、声音等(当然也包括诸如口部动作、耳部动作,但是考虑到此类动作很少与操作人员的理性思考直接关联,因此本实施例中并不考虑此类生物特征)。对应的,头戴式遥操作控制设备中的生物信息源采集装置13至少包括眼动组件131、脑电电极132和拾音器133中的至少一种。

本说明实施例提供的设备中,为了尽可能的形成各种控制方式的组合,以及能够校验相关指令信息输出的可靠性,生物信息源采集装置13包括前述的眼动组件131、脑电电极132和拾音器133。

本实施例中,眼动组件131设置在显示输出组件12靠近操作人员头部的一侧,用于检测操作人员的眼动特征,生成眼动特征信号,并将眼动特征信号发送给控制芯片。如图1所示,本实施例中,眼动组件131包括两个子采集组件,两个子采集组件分别设置在操作人员的双眼前侧对应的位置,分别用于采集用户两个眼睛的眼动特征。本实施例中,为了避免对操作人员观看显示输出组件12输出的图像造成干扰,两个子采集组件的中间区域均设置有通孔,并且通孔的尺寸保证不会对操作人员的正常视场造成影响。

本实施例中,脑电电极132用于贴合操作人员头部皮肤而检测操作人员输出的脑电特征而生成脑电特征信号,并将脑电特征信号发送给控制芯片。如图1所示,本实施例中的脑电电极132包括第一电极和两个第二电极。第一电极设置在头盔组件11的前部,用于贴合操作人员的头部皮肤;第二电极设置在头盔组件11的两侧侧部,用于抵靠操作人员耳部周围的皮肤。实际应用中,第一电极和第二电极分别生成独立的脑电特征信号,独立的脑电特征信号可以用于对用户的脑电特征进行校验。

本实施例中,拾音器133设置在头盔组件11的前侧侧部,用于采集操作人员的声音,生成声音特征信号,并将声音特征信号发送给控制芯片。

控制芯片用于对前述各种的源特征信号(眼动特征信号、脑电特征信号和声音特征信号)进行处理,生成控制指令。

图2是控制芯片生成控制指令的流程图。如图2所示,为生成控制指令,控制芯片的处理过程包括步骤S101-S104。

S101:将接受到的预设周期内的各个源特征信号转换为对应生物信息源的行为向量。

步骤S101中,为了形成相应的行为向量,控制芯片首先对接受到的源特征信号进行模数转换,并对模数转换后的数据进行特征提取,而得到对应的行为向量。

S102:根据行为向量和对应源的特征向量确定对行为向量在模糊可测空间中坐标区间。

在一个应用中,可以采用公式

与前述公式对应的,各个控制指令对应的各个生物信息源行为特征均对应一个模糊可测空间[0,1]中的隶属度函数,此隶属度函数表示了在坐标区间中各个坐标点,行为特征隶属于某一特定行为特征的程度。

本实施例中,各个源的特征向量通过对操作人员的行为特征进行统计处理获得。具体的,可以对各个生物特征源的行为特征进行大量的采样处理,获得采样样本,并且各个采样样本都和相应的操作指令对应。随后,采用距离分析方法处理大量的采样样本,确定与各个操作指令对应的聚类样本;最后,根据聚类样本确定对应各个操作指令的特征向量。

S103:根据坐标区间和对应源的隶属度函数计算隶属度向量。

步骤S103中,隶属度函数是对操作人员的行为特征进行分析,根据分析数据和经验确定的分布函数。每个生物信息源均包括对不同行为特征的隶属度函数;根据隶属度函数和坐标区间计算隶属度向量的过程,是以坐标区间为积分区间进行积分的过程。计算得到的隶属度向量对应了每个生物信息源在统计周期内与各个控制指令对应的特性。

S104:将各个源对应的隶属度向量输入到指令预测神经网络模型,得到输出指令。

步骤S104中指令预测神经网络模型采用步骤S201-S206实现。

S201:建立各个生物信息源行为特征与控制指令的对应规则。

S202:基于对应规则训练操作人员,获取每个控制指令对应的各个生物信息源行为特征的特征向量。

步骤S202中,获取各个控制指令对应的各个生物信息源行为特征的特征向量,是确定与各个控制指令相关联的典型生物信息源行为特征,并对典型生物信息源行为特征进行处理而获得特征向量的过程。

例如,为了获得各个控制指令对应的眼动行为特征,则采集操作人员为表示相应的控制指令的眼动动作,进行相应的处理确定其特征向量。

S203:获取一个采样周期内各个生物信息源的行为特征,并计算各个生物信息源对应的行为向量;以及获取第一时间时操作人员表示行为特征欲表示的控制指令。

S204:根据生物信息源的行为向量,以及生物信息源行为特征对应各个控制指令的特征向量,计算行为向量在模糊可测空间中的坐标。

在一个应用中,可以采用公式

与前述公式对应的,各个控制指令对应的各个生物信息源行为特征均对应一个模糊可测空间[0,1]中的隶属度函数,此隶属度函数表示了在坐标区间中各个坐标点,行为特征隶属于某一特定行为特征的程度。

S205:根据生物信息源行为特征对应各个控制指令的隶属函数,以及坐标计算第一时间内各个生物信息源的行为特征对应各个控制指令的隶属度,组成各个生物新源在第一时间内行为特征对应的隶属度向量。

应当注意的是,为了能够在后续步骤中实现模型训练,需要针对大量的操作人员的动作执行步骤S203-S205的步骤,以获取足够的训练样本。

S206:将第一时间对应的隶属度向量和操作人员欲表示的控制指令作为输入,训练模糊神经网络模型,得到基于多元素生物信息确定输出指令的模型。

本实施例中,对模糊神经网络模型进行训练的过程是将部分各个第一时间对应的隶属度向量和操作人员欲表示的控制指令作为输入数据,将另外部分数据作为验证数据,求算模糊神经网络各个节点之间参数的过程。

本实施例中,步骤S206采用的神经网络模型为五层,包括操控行为输入层、模糊化层、模糊规则层、去模糊化层和输出层。其中,模糊化层包括采用的生物信息源数量相同的节点,去模糊化层包括与控制指令数量相同的节点。

本实施例中,采用

采用前述的步骤S101-S104后,控制芯片即可以确定输出指令。另外,控制芯片还用于向显示输出组件12提供显示驱动信号。

通过前述的分析可知,在采用本实施例中的头戴式遥操作控制设备的情况下,操作人员可以在观察显示输出组件12输出的图像信息而处在临场感觉的情况下,同时输出各种控制指令而无需感知控制端各种控制组件的位置,也就是操作人员无需在临场感觉和真实场景感觉之间进行感觉切换,继而提高了控制指令输出效率。

本实施例中,显示输出组件12除了输出远程执行端输出的图像信号外,还用于显示各种控制指令的输出状态;控制指令是输出状态优选地在显示数据组件输出图像的边缘显示。更为优选地,控制指令的显示位置和对应的眼动特征信息进行关联,当用户查看相应的控制指令时,相应的眼动特征也直接和此控制指令关联。

本说明书实施例中,头戴式遥操作控制设备需要操作人员佩戴在头部,实际应用中需要尽可能地减小头戴部件的重量;因为需要处理大量的数据,控制芯片工作时会产生大量的热量,并需要消耗加多的电能。综合考虑,本实施例中的控制芯片并没有安装在头盔组件11上;对应的,控制芯片包括背包组件,背包组件内设置有设备板卡、供电电源和无线通信部件;控制芯片安装在设备板卡上,通过设备板卡上的数据接口与显示组件、各个头部生物信息采集装置连接;另外无线通信组件也安装在设备板卡上,实现与控制芯片的数据通信。

另外,本实施例中的头戴式遥操作控制设备还可以包括扬声器。扬声器可以用于输出由执行端传输至控制设备的远程状态信息以及其他的各种声音信息。

以上所述,仅为本发明较佳的具体实施方式,但本发明的保护范围并不局限于此,任何熟悉本技术领域的技术人员在本发明揭露的技术范围内,可轻易想到的变化或替换,都应涵盖在本发明的保护范围之内。

- 头戴式遥操作控制设备

- 遥操作机械手及其摇臂结构、遥操作设备