模型训练方法、图像增强方法、装置、电子设备及介质

文献发布时间:2023-06-19 12:18:04

技术领域

本申请涉及图像处理技术领域,特别涉及一种模型训练方法、图像增强方法、装置、电子设备及介质。

背景技术

在相关技术中,在图像去噪方面,基于深度学习的图像去噪算法主要针对高斯噪声、泊松噪声等特定噪声,而且大多通过不断优化网络结构实现去噪,这将导致网络参数量大,推理时间长的问题,而简单的网络虽然处理速度块,但去噪效果却不佳。在图像去模糊方面,经典算法估计运动模糊核的方式只适用于由于运动而产生的模糊,不能解决由于网络压缩或传输损失导致的图像模糊问题。因此,亟需一种能够同时去噪和去模糊的图像增强网络模型。

发明内容

本申请的实施方式提供了一种模型训练方法、图像增强方法、装置、电子设备及介质。

本申请实施方式的模型训练方法包括:构造包括多组图像对的训练数据集,每组所述图像对包括第一训练图像和与所述第一训练图像的场景相同的第二训练图像,所述第二训练图像的清晰度高于所述第一训练图像的清晰度;构建基于生成对抗网络的图像增强网络模型,所述图像增强网络模型包括生成器和判别器;设计与所述生成器对应的生成器损失函数和与所述判别器对应的判别器损失函数,所述生成器损失函数包括内容损失、纹理损失、全变分损失和Charbonnier损失,所述判别器损失函数包括纹理损失和梯度惩罚损失;将一组所述图像对中的所述第一训练图像和所述第二训练图像输入所述图像增强网络模型,优化所述判别器损失函数以更新所述判别器的参数,在所述判别器的参数更新之后,再次将所述图像对中的所述第一训练图像和所述第二训练图像输入所述图像增强网络模型,优化所述生成器损失函数以更新所述生成器的参数,直至利用每组所述图像对优化所述生成器损失函数的次数均达到预设次数,确定最后一次优化对应的所述判别器的参数和所述生成器的参数为所述图像增强网络模型的目标参数。

本申请实施方式的图像增强方法基于图像增强网络模型。所述图像增强网络模型包括生成器和判别器,所述生成器对应的生成器损失函数包括内容损失、纹理损失、全变分损失和Charbonnier损失,所述判别器对应的判别器损失函数包括纹理损失和梯度惩罚损失,所述图像增强网络模型的目标参数是在利用训练数据集中每组图像对均优化所述生成器损失函数预设次数之后确定的,所述图像对包括第一训练图像和与所述第一训练图像的场景相同的第二训练图像,所述第二训练图像的清晰度高于所述第一训练图像的清晰度。所述图像增强方法包括:利用配置所述目标参数的所述图像增强网络模型,增强输入图像。

本申请实施方式的模型训练装置包括构造模块、构建模块、设计模块、训练模块。构造模块用于构造包括多组图像对的训练数据集,每组所述图像对包括第一训练图像和与所述第一训练图像的场景相同的第二训练图像,所述第二训练图像的清晰度高于所述第一训练图像的清晰度。构建模块用于构建基于生成对抗网络的图像增强网络模型,所述图像增强网络模型包括生成器和判别器。设计模块用于设计与所述生成器对应的生成器损失函数和与所述判别器对应的判别器损失函数,所述生成器损失函数包括内容损失、纹理损失、全变分损失和Charbonnier损失,所述判别器损失函数包括纹理损失和梯度惩罚损失。训练模块用于将一组所述图像对中的所述第一训练图像和所述第二训练图像输入所述图像增强网络模型,优化所述判别器损失函数以更新所述判别器的参数,在所述判别器的参数更新之后,再次将所述图像对中的所述第一训练图像和所述第二训练图像输入所述图像增强网络模型,优化所述生成器损失函数以更新所述生成器的参数,直至利用每组所述图像对优化所述生成器损失函数的次数均达到预设次数,确定最后一次优化对应的所述判别器的参数和所述生成器的参数为所述图像增强网络模型的目标参数。

本申请实施方式的图像增强装置基于图像增强网络模型。所述图像增强网络模型包括生成器和判别器,所述生成器对应的生成器损失函数包括内容损失、纹理损失、全变分损失和Charbonnier损失,所述判别器对应的判别器损失函数包括纹理损失和梯度惩罚损失,所述图像增强网络模型的目标参数是在利用训练数据集中每组图像对均优化所述生成器损失函数预设次数之后确定的,所述图像对包括第一训练图像和与所述第一训练图像的场景相同的第二训练图像,所述第二训练图像的清晰度高于所述第一训练图像的清晰度。所述图像增强装置包括增强模块。所述增强模块用于利用配置所述目标参数的所述图像增强网络模型,增强输入图像。

本申请实施方式的电子设备包括一个或多个处理器和存储器。所述存储器存储有计算机程序。所述计算机程序被所述处理器执行的情况下,实现上述实施方式所述的模型训练方法或图像增强方法的步骤。

本申请实施方式的计算机可读存储介质,其上存储有计算机程序,其特征在于,所述程序被处理器执行的情况下,实现上述实施方式所述的模型训练方法或图像增强方法的步骤。

上述模型训练方法、图像增强方法、装置、电子设备及介质,确定了图像增强网络模型的目标参数,从而在利用配置有目标参数的图像增强网络模型处理图像时,可以同时去除图像的噪声和模糊,有效提升图像的质量。

本申请的附加方面和优点将在下面的描述中部分给出,部分将从下面的描述中变得明显,或通过本申请的实践了解到。

附图说明

本申请的上述和/或附加的方面和优点从结合下面附图对实施方式的描述中将变得明显和容易理解,其中:

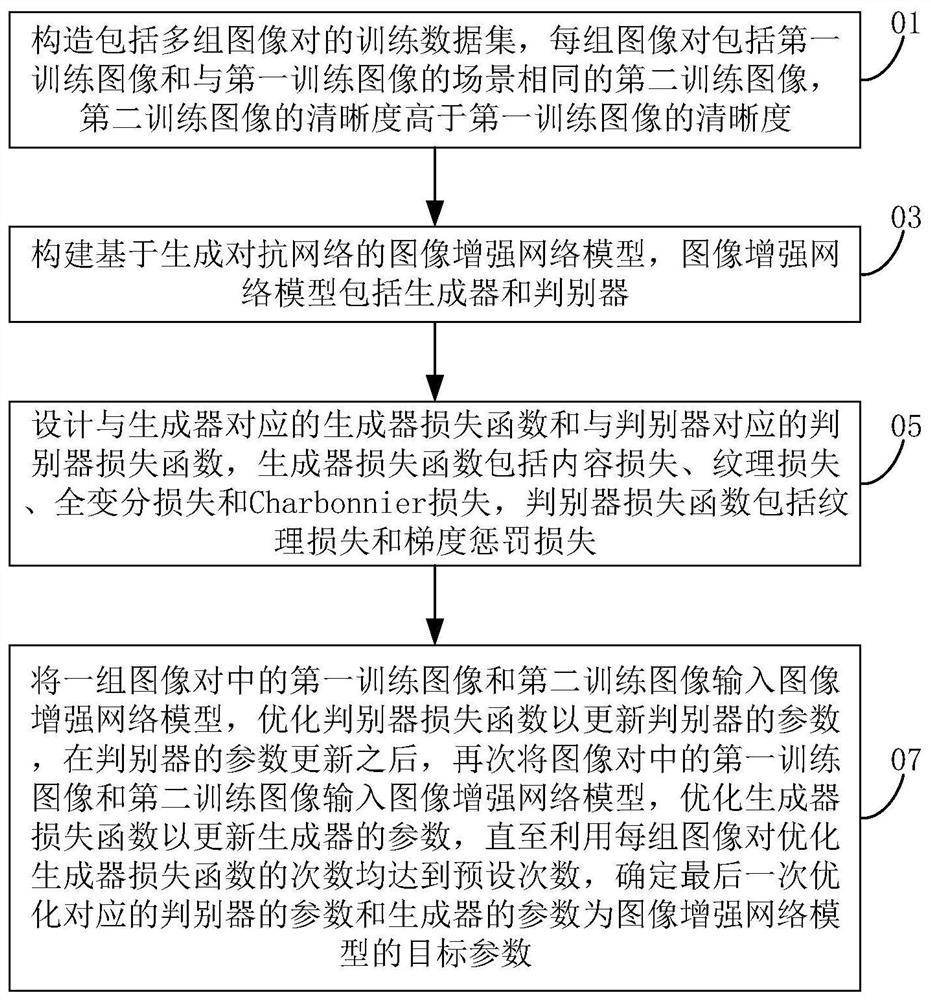

图1是本申请实施方式的模型训练方法的流程示意图;

图2是本申请实施方式的模型训练装置的示意图;

图3是本申请实施方式的电子设备的示意图;

图4是本申请实施方式的模型训练方法的效果示意图;

图5是本申请实施方式的模型训练方法的生成器的示意图;

图6是本申请实施方式的模型训练方法的示意图;

图7是本申请实施方式的模型训练方法的VGG-19的网络结构的示意图;

图8是本申请实施方式的图像增强方法的流程示意图;

图9是本申请实施方式的图像增强装置的示意图;

图10是本申请实施方式的图像增强方法的流程示意图;

图11是本申请实施方式的图像增强装置的示意图;

图12是本申请实施方式的图像增强方法的效果示意图。

具体实施方式

下面详细描述本申请的实施方式,所述实施方式的实施方式在附图中示出,其中自始至终相同或类似的标号表示相同或类似的元件或具有相同或类似功能的元件。下面通过参考附图描述的实施方式是示例性的,仅用于解释本申请,而不能理解为对本申请的限制。

在本申请的实施方式的描述中,术语“第一”、“第二”仅用于描述目的,而不能理解为指示或暗示相对重要性或者隐含指明所指示的技术特征的数量。由此,限定有“第一”、“第二”的特征可以明示或者隐含地包括一个或者更多个所述特征。在本申请的实施方式的描述中,“多个”的含义是两个或两个以上,除非另有明确具体的限定。

请参阅图1-图3,本申请实施方式的模型训练方法包括:

01:构造包括多组图像对的训练数据集,每组图像对包括第一训练图像和与第一训练图像的场景相同的第二训练图像,第二训练图像的清晰度高于第一训练图像的清晰度;

03:构建基于生成对抗网络的图像增强网络模型,图像增强网络模型包括生成器和判别器;

05:设计与生成器对应的生成器损失函数和与判别器对应的判别器损失函数,生成器损失函数包括内容损失、纹理损失、全变分损失和Charbonnier损失,判别器损失函数包括纹理损失和梯度惩罚损失;

07:将一组图像对中的第一训练图像和第二训练图像输入图像增强网络模型,优化判别器损失函数以更新判别器的参数,在判别器的参数更新之后,再次将图像对中的第一训练图像和第二训练图像输入图像增强网络模型,优化生成器损失函数以更新生成器的参数,直至利用每组图像对优化生成器损失函数的次数均达到预设次数,确定最后一次优化对应的判别器的参数和生成器的参数为图像增强网络模型的目标参数。

本申请实施方式的模型训练方法可由本申请实施方式的模型训练装置100实现。具体地,模型训练装置100包括包括构造模块10、构建模块30、设计模块50、训练模块70。构造模块10用于构造包括多组图像对的训练数据集,每组图像对包括第一训练图像和与第一训练图像的场景相同的第二训练图像,第二训练图像的清晰度高于第一训练图像的清晰度。构建模块30用于构建基于生成对抗网络的图像增强网络模型,图像增强网络模型包括生成器和判别器。设计模块50用于设计与生成器对应的生成器损失函数和与判别器对应的判别器损失函数,生成器损失函数包括内容损失、纹理损失、全变分损失和Charbonnier损失,判别器损失函数包括纹理损失和梯度惩罚损失。训练模块70用于将一组图像对中的第一训练图像和第二训练图像输入图像增强网络模型,优化判别器损失函数以更新判别器的参数,在判别器的参数更新之后,再次将图像对中的第一训练图像和第二训练图像输入图像增强网络模型,优化生成器损失函数以更新生成器的参数,直至利用每组图像对优化生成器损失函数的次数均达到预设次数,确定最后一次优化对应的判别器的参数和生成器的参数为图像增强网络模型的目标参数。

本申请实施方式的模型训练方法可由本申请实施方式的电子设备200实现。具体地,电子设备200包括一个或多个处理器201和存储器202。存储器202存储有计算机程序。计算机程序被处理器201执行的情况下,实现上述实施方式的模型训练方法的步骤。

上述模型训练方法、模型训练装置及电子设备,确定了图像增强网络模型的目标参数,从而在利用配置有目标参数的图像增强网络模型处理图像时,可以同时去除图像的噪声和模糊,有效提升图像的质量。

具体地,第一训练图像可以理解为存在噪声、模糊的清晰度低的低质量图像,第二训练图像可以理解为去除第一生成图像中的噪声、模糊后得到的清晰度高的高质量图像,第一训练图像与第二训练图像中的场景相同,第一生成图像的清晰度介于第一训练图像和第二训练图像之间。在某些实施方式中,在图像中的噪声面积大于预设噪声面积时,确定图像中存在噪声;在图像中的模糊面积大于预设模糊面积时,确定图像中存在模糊。第一训练图像的噪声面积大于第二训练图像的噪声面积,第一训练图像的模糊面积大于第二训练图像的模糊面积。第一训练图像与第二训练图像用于训练图像增强网络模型。

在某些实施方式中,图像增强网络模型的训练数据集包括多个质量图像对,每个质量图像对包括一帧存在噪声、模糊、清晰度低的低质量图像和一帧对应低质量图像的去除噪声、模糊后得到的清晰度高的高质量图像,其中高质量图像认为是训练的标签。为方便训练,在低质量图像中选取预设尺寸的图像块作为第一训练图像,在高质量图像中选取与低质量图像对应位置的相同尺寸的图像块作为第二训练图像,利用由第一训练图像和第二训练图像组成的图像对训练图像增强网络模型。在某些实施方式中,在利用第一训练图像和第二训练图像训练一次图像增强网络模型之后,对第一训练图像和第二训练图像进行变换处理,利用变换处理后的第一训练图像和第二训练图像再次训练图像增强网络模型,变换处理可包括水平翻转、垂直翻转、旋转90度中的至少一种。如此,在降低训练样本大小的同时增加训练样本数量。

进一步地,在图像增强网络模型的训练过程中,利用图像增强网络模型的生成器处理第一训练图像以获得第一生成图像;根据第一生成图像和第二训练图像,计算判别器损失函数和生成器损失函数;采用Adam算法通过损失反向传播优化判别器损失函数和生成器损失函数,从而确定能够使得判别器损失函数和生成器损失函数取得最小值图像增强网络模型的目标参数。可以理解,优化判别器损失函数可使判别器梯度分布均匀、防止梯度弥散。优化生成器损失函数即优化内容损失、纹理损失、全变分(Total Variation,TV)损失和Charbonnier损失,其中优化内容损失和纹理损失可提高图像增强网络模型的去模糊能力,优化全变分损失和Charbonnier损失可提高图像增强网络模型的去噪能力。

在步骤07中,具体地,利用Adam算法通过损失反向传播优化判别器损失函数和生成器损失函数。在优化判别器损失函数的过程中,首先固定生成器的参数,以第一训练图像和第二训练图像作为输入,连续训练判别器5次。即在此过程中,第一训练图像通过生成器得到第一生成图像,然后将第一生成图像与第二训练图像输入判别器得到判别器损失函数,利用Adam算法优化判别器的参数以最小化判别器损失函数,将最后一次训练对应的判别器的参数作为判别器的新的参数。在训练判别器5次的过程中判别器的参数会更新,但是生成器的参数不更新。

在优化生成器损失函数的过程中,固定判别器的参数,更新生成器的参数1次,判别器的参数为优化判别器损失函数的过程中最后一次训练确定的判别器的参数。即在此过程中,还是以优化判别器损失函数的过程中的第一训练图像和第二训练图像作为输入,第一训练图像通过生成器得到第一生成图像,然后将第一生成图像与第二训练图像输入判别器计算纹理损失,进而计算新的生成器损失函数,利用Adam算法优化生成器的参数以最小化生成器损失函数,将优化后的生成器的参数作为生成器的新的参数。在训练生成器的过程中判别器的参数不更新。

重复上述优化判别器损失函数的过程和优化生成器损失函数的过程,即每训练5次判别器,训练1次生成器,直至利用每组图像对优化生成器损失函数的次数均达到预设次数,确定最后一次优化对应的判别器的参数和生成器的参数为图像增强网络模型的目标参数。

在一个例子中,在优化图像增强网络模型时,采用Nvidia Tesla V100显卡,基于tensorflow框架构建图像增强网络模型,学习速率为10

在一个例子中,为了验证本方法的图像增强网络模型的效果,将本方法与经典去模糊算法DeblurGAN和去噪算法Noise2noise进行对比。表2为算法对比结果,以峰值信噪比(PSNR)和结构相似度(SSIM)作为评价指标,本方法在PSNR和SSIM这两个指标上分别为34.13和0.996,与基于深度学习的去噪算法Noise2noise和去模糊算法DeblurGAN相比均为最佳。在算法处理速度上帧率为6.25,稍差于DeblurGAN,但是远高于Noise2noise,为Noise2noise速度的2.7倍,因此可以认为本方法具有较快的处理速度。

表2

进一步地,请结合图4,图4为本方法与DeblurGAN和Noise2noise算法效果对比图。从图中可以直观看到,DeblurGAN可以使图像更加清晰,纹理变得鲜明,但是同时带来了较大的噪声,增加图像的颗粒感。而Noise2noise对去噪有较好效果,整体图像更加平滑,但是同时丢失大量细节信息,让图像也变得模糊。而本方法兼具DeblurGAN和Noise2noise的优点,从视觉上保留图像内容同时丰富了图像细节,很好的做到图像去模糊,并且去掉了图像中部分噪点,使其更加平滑自然。因此本方法实现了图像去噪的同时对图像进行去模糊,具有很强的实际应用价值。

在某些实施方式中,电子设备可包括智能手机、平板电脑、笔记本电脑等移动终端或服务器。具体地,在图3所示的实施方式中,电子设备为智能手机。

请参阅图5,在某些实施方式中,第一训练图像包括第一尺寸,生成器包括下采样模块、多层残差模块和上采样模块,下采样模块用于缩小第一训练图像的第一尺寸为第二尺寸,多层残差模块用于整合、提取第二尺寸的第一训练图像的图像特征,上采样模块用于放大多层残差模块输出的图像的尺寸为第一尺寸。

如此,第一训练图像通过生成器可生成第一生成图像。

具体地,生成器用于从低质量图像恢复高质量图像,第一生成图像的清晰度高于第一训练图像的清晰度。下采样(Down Sampling,DS)模块包括连续两个卷积核为3*3、步长为2的卷积层,用于缩小第一训练图像的第一尺寸为第二尺寸。多层残差(Residual,RS)模块由9个单残差模块组成,9个单残差模块能够充分整合、提取图像特征,同时防止出现梯度消失的现象。RS模块包括快捷(Shortcut,SC)模块,SC模块用于提升训练速度、提高训练效果。上采样(Up Sampling,US)模块包括连续两个卷积核为3*3、步长为2的反卷积层,用于放大多层残差模块输出的图像的尺寸为第一尺寸。此外,在生成器网络的后端进行全局的残差补偿,进一步融合第一训练图像的信息。

在一个例子中,第一训练图像输入生成器之前具有第一尺寸,为256*256,第一训练图像经过DS模块处理之后,尺寸缩小为64*64(第二尺寸)并进入RS模块,RS模块输出的图像的尺寸与输入RS模块的图像的尺寸均为64*64,进而RS模块输出的图像经过US模块处理之后,图像的尺寸从64*64恢复至256*256,最后生成器输出尺寸为256*256的第一生成图像。第一生成图像的尺寸与第一训练图像的第一尺寸相同,第一训练图像与第二训练图像均为第一尺寸,即第一生成图像的尺寸与第二训练图像的尺寸相同,从而第一生成图像可以与第二训练图像进行后续运算。

在某些实施方式中,判别器包括第一网络结构、第二网络结构和第三网络结构,第一网络结构用于进行卷积、实例正则化和第一激活函数运算,第二网络结构用于进行卷积运算,第三网络结构用于通过第二激活函数,将输出值规范到预设范围。

如此,判别器能够判断第一生成图像与第二训练图像的接近程度。

具体地,第一网络结构中包括5层网络,每层网络均进行卷积、实例正则化(Instance Normalization,IN)和第一激活函数运算,第二网络结构中包括1层网络,第三网络结构中包括1层网络。第一激活函数为leaky_relu激活函数,第二激活函数为Sigmoid激活函数。请结合表1,表1为判别器的网络结构部分参数表,其中,运算指每层网络的功能,ConvA为组合卷积层,包含卷积、实例正则化和leaky_relu激活函数,conv表示仅进行卷积计算,Sigmoid表示仅通过激活函数,将输出规范到[0,1]。S表示卷积步长,S1表示卷积步长为1,S2表示卷积步长为2。在判断过程中,第一生成图像和第二训练图像依次通过第一网络结构、第二网络结构和第三网络结构,第三网络结构输出判断结果。

表1

请参阅图6,在某些实施方式中,判别器损失函数由以下公式表示:D

如此,优化判别器损失函数可使判别器梯度分布均匀、防止梯度弥散。

在某些实施方式中,生成器损失函数由以下公式表示:G

如此,优化生成器损失函数可使生成器兼顾图像去噪与图像去模糊两个任务。可以理解,优化生成器损失函数即优化内容损失、纹理损失、全变分(Total Variation,TV)损失和Charbonnier损失,其中优化内容损失和纹理损失可提高图像增强网络模型的去模糊能力,优化全变分损失和Charbonnier损失可提高图像增强网络模型的去噪能力。

在某些实施方式中,W

在某些实施方式中,纹理损失根据判别器的判别结果进行计算,判别器的输入为第一生成图像的灰度图像和第二训练图像的灰度图像。

如此,优化纹理损失有利于提升图像增强网络模型的去模糊能力。可以理解,纹理是一种不依赖于颜色或亮度而反映图像中同质现象的视觉特征,包含了物体表面结构组织排列的重要信息以及它们与周围环境的联系。由于纹理是由灰度分布在空间位置上反复出现而形成的,因而在图像空间中相隔某距离的两像素之间会存在一定的灰度关系,即图像中灰度的空间相关特性,因此图像的纹理信息与灰度空间分布有关。判别器的输入为第一生成图像的灰度图像和第二训练图像的灰度图像,从而可以较好地进行纹理损失评价。

具体地,纹理损失可由以下公式表示:L

在某些实施方式中,梯度惩罚损失根据第一生成图像和第二训练图像的融合图像进行计算。

如此,优化梯度惩罚损失可以获得较佳的判别器,避免判别器梯度分布不匀、防止梯度弥散。可以理解,在相关技术中,强制限制判别器的参数,使得判别器在生成对抗网络中的权重固定在一定区间内,这将导致判别器的权重分布集中在区间两侧,并且容易出现梯度弥散或梯度消失的问题,而在本申请中,引入梯度惩罚损失来代替强制限制判别器的参数的方法,从而避免梯度弥散或梯度消失的问题。

具体地,梯度惩罚损失可由以下公式表示:

在某些实施方式中,内容损失基于预训练的VGG-19模型的特征图进行计算。

如此,内容损失能够保留图像的语义信息,优化内容损失有利于提升图像增强网络模型的去模糊能力。可以理解,在相关技术中,通过单纯的计算第一生成图像和第二训练图像之间的差异获得内容损失,并不能获得内容和感知等各个方面的相似表示,而在本申请中,内容损失基于预训练的VGG-19模型的特征图来计算内容损失,可以保留图像的语义信息,对于图像去模糊有较好的效果。

具体地,内容损失基于预训练好的VGG-19的relu3_3生成的特征图来计算,VGG-19的结构如图7所示。内容损失可由以下公式表示:

在某些实施方式中,全变分损失基于第一生成图像的梯度、通道数、高度和宽度进行计算。

如此,优化全变分损失有利于提升图像增强网络模型的去噪声能力。可以理解,在相关技术中,图像复原算法会放大图像中的噪声,图像上的一点点噪声就会对复原的结果产生非常大的影响,因此需要在图像增强网络模型中添加一些正则项来保持图像的光滑性。由于受噪声污染的图像的全变分比无噪图像的全变分明显的大,因此可通过最小化全变分损失来最小化噪声,从而达到去噪的效果。

具体地,全变分损失可由以下公式表示:

在某些实施方式中,Charbonnier损失基于第一生成图像的像素值、通道数、高度、宽度和第二训练图像的像素值进行计算。

如此,优化Charbonnier损失能够平滑图像噪点,从而有利于提升图像增强网络模型的去噪声能力。

具体地,Charbonnier损失可由以下公式表示:

请参阅图8和图9,本申请实施方式的图像增强方法基于图像增强网络模型,图像增强网络模型包括生成器和判别器,生成器对应的生成器损失函数包括内容损失、纹理损失、全变分损失和Charbonnier损失,判别器对应的判别器损失函数包括纹理损失和梯度惩罚损失,图像增强网络模型的目标参数是在利用训练数据集中每组图像对均优化生成器损失函数预设次数之后确定的,图像对包括第一训练图像和与第一训练图像的场景相同的第二训练图像,第二训练图像的清晰度高于第一训练图像的清晰度。图像增强方法包括:

09:利用配置目标参数的图像增强网络模型,增强输入图像。

上述实施方式的图像增强方法可由本申请实施方式的图像增强装置300实现。具体地,图像增强装置300包括增强模块90。增强模块90用于利用配置目标参数的图像增强网络模型,增强输入图像。

上述实施方式的图像增强方法可由本申请实施方式的电子设备200实现。具体地,处理器201用于利用配置目标参数的图像增强网络模型,增强输入图像。

如此,能够有效实现输入图像的去噪和去模糊。

具体地,目标参数可通过预先训练获得,将输入图像输入至配置有目标参数的图像增强网络模型,图像增强网络模型可以有效去除输入图像中的噪声和模糊,从而达到增强输入图像的效果。图像增强网络模型可以通过本申请实施方式的模型训练方法获得。

请参阅图10和图11,在某些实施方式中,步骤09包括:

091:将输入图像输入配置目标参数的图像增强网络模型以获得第二生成图像;

093:对第二生成图像进行滤波以获得滤波图像;

095:融合第二生成图像和滤波图像以获得输入图像的增强图像。

上述实施方式的图像增强方法可由本申请实施方式的图像增强装置300实现。具体地,增强模块90包括生成单元91、滤波单元93、融合单元95。生成单元91用于将输入图像输入配置目标参数的图像增强网络模型以获得第二生成图像。滤波单元93用于对第二生成图像进行滤波以获得滤波图像。融合单元95用于融合第二生成图像和滤波图像以获得输入图像的增强图像。

上述实施方式的图像增强方法可由本申请实施方式的电子设备200实现。具体地,处理器201用于将输入图像输入配置目标参数的图像增强网络模型以获得第二生成图像,及用于对第二生成图像进行滤波以获得滤波图像,及用于融合第二生成图像和滤波图像以获得输入图像的增强图像。

如此,进一步去除输入图像中的模糊部分,获得清晰度更高的输入图像的增强图像。可以理解,在配置目标参数的图像增强网络模型的去噪能力强较强、去模糊能力稍弱的情况下,通过对图像增强网络模型生成的第二生成图像进行后处理,去除第二生成图像中的模糊部分,可以进一步提高图像的清晰度。

具体地,在某些实施方式中,对第二生成图像进行均值滤波以获得滤波图像。如此,能够进一步去除第二生成图像中的模糊部分。

在某些实施方式中,输入图像的增强图像可由以下公式表示:H=λ

如此,第二生成图像和滤波图像能够按照一定的权重进行融合,从而获得清晰度较高的输入图像的增强图像。

具体地,请结合图12,在某些实施方式中,λ

需要指出的是,上述所提到的具体数值只为了作为例子详细说明本申请的实施,而不应理解为对本申请的限制。在其他例子或实施方式或实施例中,可根据本申请来选择其他数值,在此不作具体限定。

本申请实施方式的计算机可读存储介质,其上存储有计算机程序,程序被处理器执行的情况下,实现上述任一实施方式的模型训练方法或图像增强方法的步骤。

例如,程序被处理器执行的情况下,实现以下模型训练方法的步骤:

01:构造包括多组图像对的训练数据集,每组图像对包括第一训练图像和与第一训练图像的场景相同的第二训练图像,第二训练图像的清晰度高于第一训练图像的清晰度;

03:构建基于生成对抗网络的图像增强网络模型,图像增强网络模型包括生成器和判别器;

05:设计与生成器对应的生成器损失函数和与判别器对应的判别器损失函数,生成器损失函数包括内容损失、纹理损失、全变分损失和Charbonnier损失,判别器损失函数包括纹理损失和梯度惩罚损失;

07:将一组图像对中的第一训练图像和第二训练图像输入图像增强网络模型,优化判别器损失函数以更新判别器的参数,在判别器的参数更新之后,再次将图像对中的第一训练图像和第二训练图像输入图像增强网络模型,优化生成器损失函数以更新生成器的参数,直至利用每组图像对优化生成器损失函数的次数均达到预设次数,确定最后一次优化对应的判别器的参数和生成器的参数为图像增强网络模型的目标参数。

可以理解,计算机程序包括计算机程序代码。计算机程序代码可以为源代码形式、对象代码形式、可执行文件或某些中间形式等。计算机可读存储介质可以包括:能够携带计算机程序代码的任何实体或装置、记录介质、U盘、移动硬盘、磁碟、光盘、计算机存储器、只读存储器(ROM,Read-Only Memory)、随机存取存储器(RAM,Random Access Memory)、以及软件分发介质等。处理器可以是中央处理器,还可以是其他通用处理器、数字信号处理器(Digital Signal Processor,DSP)、专用集成电路(Application Specific IntegratedCircuit,ASIC)、现成可编程门阵列(Field-Programmable Gate Array,FPGA)或者其他可编程逻辑器件、分立门或者晶体管逻辑器件、分立硬件组件等。

在本说明书的描述中,参考术语“一个实施例”、“一些实施例”、“示例”、“具体示例”、或“一些示例”等的描述意指结合该实施例或示例描述的具体特征、结构、材料或者特点包含于本申请的至少一个实施例或示例中。在本说明书中,对上述术语的示意性表述不必须针对的是相同的实施例或示例。而且,描述的具体特征、结构、材料或者特点可以在任一个或多个实施例或示例中以合适的方式结合。此外,在不相互矛盾的情况下,本领域的技术人员可以将本说明书中描述的不同实施例或示例以及不同实施例或示例的特征进行结合和组合。

流程图中或在此以其他方式描述的任何过程或方法描述可以被理解为,表示包括一个或更多个用于实现特定逻辑功能或过程的步骤的可执行指令的代码的模块、片段或部分,并且本申请的优选实施方式的范围包括另外的实现,其中可以不按所示出或讨论的顺序,包括根据所涉及的功能按基本同时的方式或按相反的顺序,来执行功能,这应被本申请的实施例所属技术领域的技术人员所理解。

尽管上面已经示出和描述了本申请的实施例,可以理解的是,上述实施例是示例性的,不能理解为对本申请的限制,本领域的普通技术人员在本申请的范围内可以对上述实施例进行变化、修改、替换和变型。

- 模型训练方法、图像增强方法、装置、电子设备及介质

- 模型训练方法、图像边缘增强方法、装置、介质和终端