一种基于差分运算和联合字典学习的骨导语音增强方法

文献发布时间:2023-06-19 09:26:02

技术领域

本发明涉及单通道语音增强领域,尤其涉及一种基于差分运算和联合字典学习的骨导语音增强方法。

背景技术

在人们的交流活动中,语音发挥着主导作用。由于受到环境噪声的污染,人耳和包含空气传导麦克风(简称气导麦克风)的相关智能装置收到的是带噪语音,语音的质量和可懂度会有明显的下降,影响了人们的主观听觉感受和智能装置的语音识别率。语音增强技术就是解决这类问题的主要方法。如何从带噪语音中恢复出干净语音一直都是人们试图解决的问题。气导麦克风接收的语音简称为气导语音。

骨导麦克风是另一种非声传感器,其语音传输通道能够屏蔽环境噪声,抗噪性能好。然而人体传导的低通性能以及传感器工艺水平的限制等因素,导致骨导麦克风接收的语音清晰度低,听起来比较沉闷。骨导麦克风接收的语音简称骨导语音。

针对骨导语音的增强对于在强噪声环境下的语音通信应用具有重要的现实意义。

发明内容

本发明提供一种基于差分运算和联合字典学习的骨导语音增强方法。尽管骨导麦克风具有抗噪性能好的特点,但其语音的时频谱信息不丰富,听起来比较沉闷。针对这一问题,专门设计了骨导麦克风和气导麦克风组成的异型双麦克风阵列,同步采集说话人训练语音,构建骨导语音和气导语音的联合训练集,对骨导语音和气导语音做短时傅里叶变换得到其时频谱幅度,考虑到气导语音的时频谱比骨导语音时频谱信息更丰富,设计了特定的差分公式计算气导语音与骨导语音的差分时频谱幅度;充分利用骨导语音时频谱幅度和差分时频谱幅度的对应关系以及语音的稀疏性,得到反映骨导语音时频谱幅度和差分时频谱幅度对应特征的联合语音字典。用待检测骨导语音在骨导语音子字典上投影得到的最优稀疏表示系数与差分时频谱幅度子字典一起重建差分时频谱幅度,该重建气导语音时频谱具有更丰富的频谱信息,用于补充骨导语音的缺失信息,达到提高骨导语音的清晰度的目的。

本发明的目的是通过以下技术方案实现的:

一种基于差分运算和联合字典学习的骨导语音增强方法,包括:

训练阶段,在室内无噪环境下用骨导麦克风和空气传导麦克风组成的异型双麦克风阵列同步采集训练语音,构建训练集;对骨导语音和气导语音做短时傅里叶变换,提取其时频谱的幅度,设计特定的差分公式计算气导语音与骨导语音的差分时频谱幅度;充分利用骨导语音时频谱幅度和差分时频谱幅度的对应关系以及语音的稀疏性,得到反映骨导语音时频谱幅度和差分时频谱幅度对应特征的联合语音字典。

检测阶段,对于待检测骨导语音进行短时傅里叶变换,提取时频谱的幅度和相位;将时频谱幅度在联合语音字典中的骨导语音子字典上进行投影,得到最优稀疏表示系数;用得到稀疏表示系数与联合语音字典的差分时频谱幅度子字典一起重建差分时频谱幅度,并与待检测骨导语音相位一起来增强骨导语音时频谱,最后做短时傅里叶逆变换,得到增强后的骨导语音时域信号。

由上述本发明提供的技术方案可以看出,本方法在训练阶段,首先在室内无噪环境下用骨导麦克风和空气传导麦克风组成的异型双麦克风阵列同步采集训练语音,构建训练集,提供了时间对齐的骨导语音和差分语音,便于揭示它们在时间域上的异同性;其次考虑到气导语音的时频谱比骨导语音时频谱信息更丰富,设计了特定的差分公式计算气导语音与骨导语音的差分时频谱幅度,充分利用了它们的时频谱幅度对应关系以及语音稀疏性学习出骨导语音时频谱幅度和差分时频谱幅度特征关系的联合语音字典;本方法在检测阶段,对于待检测骨导语音,进行短时傅里叶变换,提取时频谱的幅度和相位,将时频谱幅度在联合语音字典的骨导语音子字典上进行投影,用得到的最优稀疏表示系数与联合语音字典的差分时频谱幅度子字典一起重建差分语音时频谱的幅度,用于补偿骨导语音时频谱幅度,结合待检测骨导语音时频谱相位增强骨导语音时频谱,最后做短时傅里叶逆变换,得到增强后的骨导语音时域信号,能够为骨导语音补充由于人体传导低通性和传感器工艺水平限制等因素引起的缺失信息,提升了骨导语音信号的听觉质量。

附图说明

为了更清楚地说明本发明实施例的技术方案,下面将对实施例描述中所需要使用的附图作简单的介绍,显而易见地,下面描述中的附图仅仅是本发明的一些实施例,对于本领域的普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他附图。

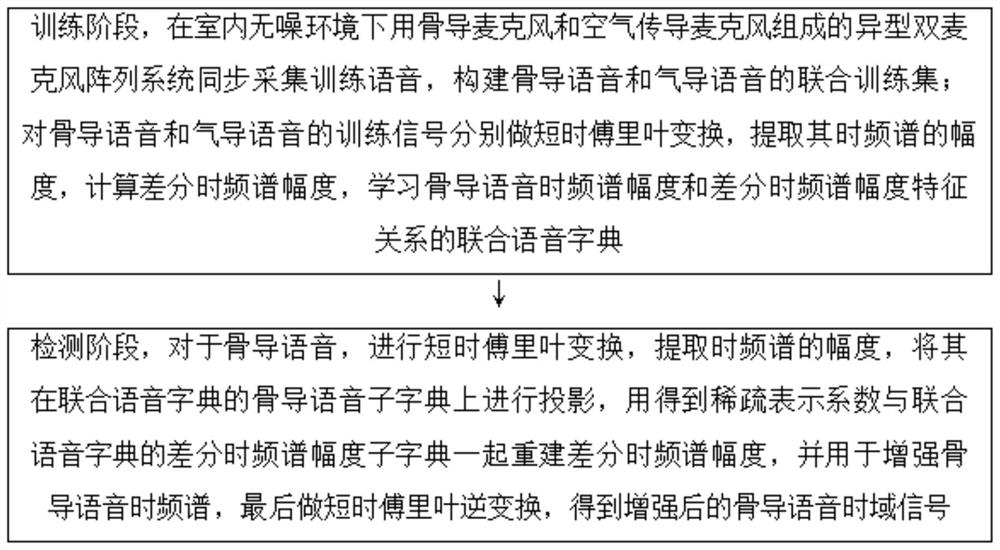

图1为本发明实施例提供的一种基于差分运算和联合字典学习的骨导语音增强方法的流程图。

图2为骨导麦克风和气导麦克风组成的异型双麦克风阵列同步采集系统示意图。

具体实施方式

下面结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例。基于本发明的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本发明的保护范围。

不同于已有的大多数单通道语音增强算法,本发明实施例提供一种基于差分运算和联合字典学习的骨导语音增强方法,本方法在训练阶段,首先在室内无噪环境中,用骨导麦克风和气导麦克风组成的异型双麦克风阵列同步采集训练语音,构建训练集,提供了时间对齐的骨导语音和气导语音,便于揭示骨导语音和差分语音在时间域上的异同性;其次考虑到气导语音的时频谱比骨导语音时频谱信息更丰富,设计了特定的差分公式计算气导语音与骨导语音的差分时频谱幅度,充分利用了它们的时频谱幅度对应关系以及语音稀疏性学习出骨导语音时频谱幅度和差分时频谱幅度特征关系的联合语音字典;本方法在检测阶段,对于待检测骨导语音,进行短时傅里叶变换,提取时频谱的幅度和相位,将时频谱幅度在联合语音字典的骨导语音子字典上进行投影,用得到稀疏表示系数与联合语音字典的差分语音子字典一起重建差分时频谱幅度,用于补偿骨导语音时频谱幅度,结合待检测骨导语音时频谱相位增强骨导语音时频谱,能够为骨导语音补充由于人体传导的低通性和传感器工艺水平限制等因素引起的缺失信息,最后做短时傅里叶逆变换,得到增强后的骨导语音时域信号,提升了骨导语音信号的听觉质量。如图1所示,其主要包括:

步骤1、训练阶段

步骤11、在室内无噪环境下用骨导麦克风和空气传导麦克风(简称气导麦克风)组成的异型双麦克风阵列同步采集训练语音,x

步骤12、对骨导麦克风和气导麦克风同步采集的骨导语音和气导语音分别做短时傅里叶变换,得到时频域上的复数谱(简称时频谱),即:

X

Y

其中,STFT{}为短时傅里叶变换算子,tf和f分别为时间帧和频率点,|X

步骤13、按下式计算|X

|Δ

其中,U{}为单位阶跃函数算子;

步骤14、将|X

其中,DX和DΔ分别是骨导语音时频谱幅度和差分时频谱幅度的子字典;C是骨导语音时频谱幅度和差分时频谱幅度的联合稀疏表示系数,联合稀疏表示系数为矩阵形式,c

步骤2、检测阶段

步骤21、对骨导语音x(t)做短时傅里叶变换,得到其时频域谱,即:

X(tf,f)=STFT{x(t)}

其中,STFT{}为短时傅里叶变换算子,tf和f分别为时间帧和频率点,|X(tf,f)|为X(tf,f)的幅度,Φ(tf,f)为X(tf,f)的相位,保留相位信息留待后面进一步使用;

步骤22、把骨导语音的时频谱幅度|X(tf,f)|在联合字典中的骨导语音子字典上进行投影,获得投影的骨导语音的稀疏表示系数,计算如下:

其中,E为|X(tf,f)|在骨导语音子字典DX上的候选稀疏表示系数,E

步骤23,估计差分时频谱幅度;

利用稀疏表示系数E

步骤24,对骨导语音时频谱幅度的增强;

首先,用估计的差分时频谱幅度补偿骨导语音时频谱幅度,如下式所示:

然后,结合待检测骨导语音时频谱X(tf,f)的相位Φ(tf,f),计算增强后的骨导语音时频谱,如下式所示:

步骤25,对增强后的骨导语音时频谱

其中ISTFT{}为短时傅里叶逆变换算子。

本发明实施例上述方案,在训练阶段,在室内无噪环境下用骨导麦克风和空气传导麦克风组成的异型双麦克风阵列系统同步采集训练语音,得到骨导语音和气导语音,构建训练集;对骨导语音和气导语音的训练信号分别做短时傅里叶变换,提取其时频谱的幅度,设计特定的差分公式计算气导语音与骨导语音的差分时频谱幅度,充分利用了它骨导语音时频谱幅度和差分时频谱幅度对应关系以及语音稀疏性学习出骨导语音时频谱幅度和差分时频谱幅度特征关系的联合语音字典。在检测阶段,对于骨导语音,进行短时傅里叶变换,提取时频谱的幅度,将其在联合语音字典的骨导语音子字典上进行投影,用得到稀疏表示系数与联合语音字典的差分语音子字典一起重建差分语音时频谱的幅度,用于补偿骨导语音时频谱幅度,结合待检测骨导语音时频谱相位增强骨导语音时频谱,最后做短时傅里叶逆变换,得到增强后的骨导语音时域信号,提高了语音的清晰度。

通过以上的实施方式的描述,本领域的技术人员可以清楚地了解到上述实施例可以通过软件实现,也可以借助软件加必要的通用硬件平台的方式来实现。基于这样的理解,上述实施例的技术方案可以以软件产品的形式体现出来,该软件产品可以存储在一个非易失性存储介质(可以是CD-ROM,U盘,移动硬盘等)中,包括若干指令用以使得一台计算机设备(可以是个人计算机,服务器,或者网络设备等)执行本发明各个实施例所述的方法。

以上所述,仅为本发明较佳的具体实施方式,但本发明的保护范围并不局限于此,任何熟悉本技术领域的技术人员在本发明披露的技术范围内,可轻易想到的变化或替换,都应涵盖在本发明的保护范围之内。因此,本发明的保护范围应该以权利要求书的保护范围为准。

- 一种基于差分运算和联合字典学习的骨导语音增强方法

- 一种基于联合字典学习和稀疏表示的骨导语音增强方法