基于改进YOLOv3的任意方向舰船检测方法

文献发布时间:2023-06-19 10:11:51

技术领域

本发明属于SAR图像舰船目标检测领域,涉及一种基于改进YOLOv3的任意方向舰船目标检测方法。

背景技术

海面舰船目标检测对于维护我国海洋权益、促进海洋资源开发起到至关重要的作用。目前,用于舰船目标探测的主要数据来源包括雷达一维距离像、合成孔径雷达(Synthetic Aperture Radar,SAR)图像、卫星或无人机拍摄的遥感图像、近岸或海面舰船搭载的光电平台拍摄的视频图像等。

SAR是一种主动式微波成像传感器,具有全天时、全天候工作能力,对土壤、植被和云雾等具有一定的穿透性,在军事和民用领域具有广泛的应用。目前,国内外研究学者在SAR图像舰船目标检测与识别方面开展了大量的研究工作,建立了较为成熟的SAR图像舰船目标监视系统。

随着深度学习理论和优化技术的发展,基于卷积神经网络(Convolution NeuralNetwork,CNN)的目标检测识别模型取得了远超传统方法的性能。用于目标检测的深度模型可分为一阶段检测模型和两阶段检测模型。一阶段检测模型中的YOLOv3目标检测模型兼顾了检测精度与实时性的需求,通过重新设计特征提取网络(记做Darknet-53),采用特征金字塔网络(Feature Pyramid Network,FPN)的设计理念构建多尺度检测网络,提高了对不同尺度尤其是小目标的检测性能。

在一些应用场合,舰船目标的方位角信息具有重要的参考价值,因此学者开始研究能够输出目标方位角估计的深度检测模型。CHEN C等人采用一阶段检测框架,设计了一个多尺度自适应校正网络来检测任意方向的舰船目标,设计的模型采用目标中心点坐标、长宽和方位角共5个参数描述目标旋转框信息,其中目标方位角定义为水平轴沿逆时针方向旋转到与目标旋转框相交的角度,范围为(-90°,0°],与传统的一阶段检测模型不同,采用旋转锚框以解决目标方位角估计问题,但锚框角度和长宽比需通过实验进行优化设置,其对检测结果影响较大。AnQ等人基于SSD框架,采用旋转锚框策略实现目标方位角预测,目标方位角范围定义为[0°,180°)或[0°,330°),综合利用线上难例挖掘、Focal损失等解决正负样本不均衡问题。

发明内容

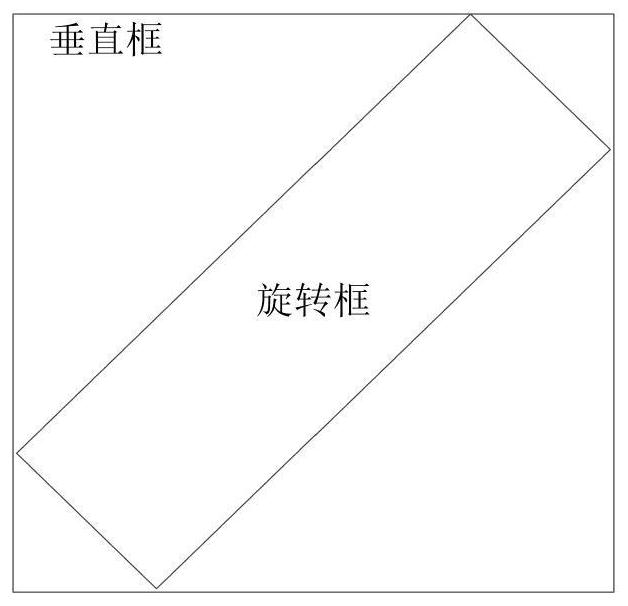

本发明的目的是为实现SAR图像舰船目标检测能同时输出位置和方位角估计信息,且兼顾检测精度和实时性的需求,基于YOLOv3框架,提出了一种能够同时输出垂直框和旋转框的SAR图像任意方向舰船目标检测方法。首先检测网络能同时输出垂直框和旋转框的预测结果,其次基于垂直框和旋转框预测结果设计了多任务损失函数,最后采用基于旋转框的非极大值抑制方法剔除重叠检测结果时,通过融合垂直框和旋转框预测结果进行目标方位角估计校正,以进一步提高检测性能。

基于Tensorflow深度学习框架实现本发明提出的方法并进行参数训练,采用SSDD+和HRSID SAR舰船目标检测数据集、可见光高分辨率舰船目标识别数据集(HighResolution Ship Collection 2016,HRSC2016)分别进行了提出改进模型的性能、迁移性和适用性测试,验证了本发明提出模型的有效性。

本发明采用的技术方案包括以下步骤:

步骤(1).获取SAR图像数据集。

步骤(2).预处理。

步骤(3).构建改进YOLOv3模型。

步骤(4).目标方位角校正。

本发明与现有技术相比,其显著优点为:

(1)本发明采用改进YOLOv3模型,同时输出垂直框和旋转框的预测结果,能够同时获取目标位置信息和方位角信息;

(2)本发明基于垂直框和旋转框预测结果设计了多任务损失函数,利用多任务损失函数对改进YOLOv3模型进行优化。

(3)针对可能存在的目标方位角估计偏差,在采用旋转非极大值抑制方法剔除重叠目标的同时,基于垂直框和旋转框预测判定方位角估计的准确性,并进行校正。

(4)本发明提出的改进模型适用于纯海洋背景下SAR图像中的舰船目标检测,能够准确估计目标的方位角,并满足舰船目标检测的实时性需求。

附图说明

图1是旋转框及目标方位角示意图;

图2是与旋转框对应的垂直框示意图;

图3是SSDD+数据集舰船目标长宽分布图;

图4是SSDD+测试集舰船目标检测结果;(a)离岸情况-大目标;(b)离岸情况-小目标;(c)近岸情况-1;(d)近岸情况-2;

图5是HRSID数据集舰船目标检测结果;(a)离岸情况;(b)近岸情况;

图6是HRSC2016舰船目标检测结果;(a)不同尺度情况-1;(b)不同尺度情况-2;(c)标注不完整情况;(d)密集目标情况。

具体实施方式

以下结合附图对本发明作进一步说明。

本发明具体实施步骤如下:

步骤(1)、获取SAR图像数据集。具体如下:

当采用(x

步骤(2)、对数据集预处理。具体如下:

采用最小包围盒估计算法将8参数形式描述任意角度的目标框转换为(t

步骤(3)、构建改进YOLOv3模型。具体如下:

本发明重新定义YOLOv3模型的输出为(t

改进YOLOv3模型多任务损失函数共包含5部分,具体为:

Loss=Loss

其中Loss

其中i、j分别表示特征图中第i个坐标点第j个锚框,

Loss

其中

目标置信度估计误差Loss

其中

类别预测误差Loss

其中

目标方位角估计损失采用均方误差损失,具体定义如下:

其中

训练阶段,训练集数据首先通过Darknet网络进行特征提取,得到特征图;将上述特征图输入到类FPN结构化网络中,分别得到三个尺度的特征图;再将这三个特征图输入到逻辑回归判断层中,得到判断结果;将这一结果与真实结果通过公式(1)多任务损失函数计算出损失值,再通过反向传播算法调整网络参数,最终得到训练的模型文件。

表1训练超参数

把训练好的改进YOLOv3模型在测试集上测试模型的检测性能,具体如下:

将测试集样本输入到训练得到的模型中,得到预测结果,与真实值比对,通过计算mAP等性能指标来评价模型的性能。

测试阶段,本发明在剔除重检测结果时,采用旋转非极大值抑制的方法剔除重检测目标,即根据旋转框的交并比来进行非极大值抑制剔除重叠目标,在目标密集的情况下,减少了目标的漏检。

步骤(3)、目标方位角估计矫正

融合垂直框和旋转框的预测结果进行目标方位角估计矫正,进一步提高了模型的检测性能。由于目标方位角范围为[0°,-180°),当目标处于水平方向时,角度估计会出现较大偏差。为解决该问题,计算估计得到的旋转框外接矩形,将其与基于检测网络输出的垂直框计算IOU值,若IOU值小于某个阈值(本发明设定为0.5),说明旋转框中角度参数估计不准确,此时将目标方位角估计值设定为0°。

为了验证本发明提出的模型改进方法的有效性,采用SSDD+SAR图像舰船目标检测数据集验证提出模型的性能,并基于HRSID数据集进行模型迁移测试。为进一步验证提出模型的适用性,采用HRSC2016数据集进行了可见光图像舰船目标检测实验。

训练时对输入数据除进行常规增强,包括水平翻转、随机裁剪和mixup等,还进行了旋转增强,主要是因为对目标方位角进行回归学习,应尽量使训练集中目标方位角覆盖(-180°,0°],增强后训练数据集数量变为原来的11倍。

SSDD+数据集描述如表2所示。由于对原始的SAR图像人为进行了裁剪,故该数据集的图像分辨率相对较低。SSDD+数据集采用8参数形式(x

表2 SSDD+数据集描述

实验结果:从图4(a)和图4(b)中可以看出,在纯海洋背景下,即使目标尺寸很小,目标仍能够被全部检出,且目标方位角估计准确。图4(c)中的靠岸舰船目标没有被检出,这是因为舰船与周围具有较强后向散射系数的背景区域连在一起,此时很难分辨目标。图4(d)中虽然为近岸情况,但是舰船目标周围背景具有较强的对比度,故也能检测出大部分目标,仅有一个虚警。当设定IOU阈值为0.5,置信度阈值为0.05,NMS阈值为0.45时,采用本发明改进模型对测试集进行测试可得,mAP

为验证本发明提出改进模型中各模块的有效性,进行了消融实验,具体如表3所示。表3实验2未采用多任务损失函数,仅预测目标的旋转框预测结果,因没有垂直框预测结果,无需进行目标方位角校正,故此时算法耗时较少。比较表3中实验2和实验5结果可以看出,采用多任务损失显著提高了mAP

表3消融实验

当采用HRSID数据集进行模型迁移测试实验时,由于与SSDD+数据集的图像分辨率存在差异,故当采用三种不同模型输入分辨率时,在其它参数设置相同的情况下分别计算mAP

表4基于HRSID数据集的舰船目标检测精度

在HRSC2016数据集上采用同样的训练超参数基于增广后的训练集进行模型参数训练,然后采用同样的参数计算mAP

- 基于改进YOLOv3的任意方向舰船检测方法

- 基于级联神经网络的任意方向舰船目标检测方法