一种室内多人追踪及姿态估量的方法及装置

文献发布时间:2023-06-19 12:02:28

技术领域

本发明属于智慧城市新零售领域,尤其是一种基于深度学习神经网络和边缘计算的室内多人追踪及姿态估量的方法。

背景技术

目前,基于深度学习的应用呈爆发式增长,尤其是在图像处理领域,已经成为一种日常的工具。在智能时代,依靠高成本的人力和重复性的机械工作,必然会被人工智能所取代。例如,在智慧城市的安防领域,视频分析需要巨大的工作量。在过去,只可以通过人工视图处理的问题。现在能通过智能算法来解决。对于多目标跟踪其核心是人体检测和跟踪分析,可用于行人计数、行为分析和异常检测等领域。

近年来,针对多目标跟踪所提出的方法主要有:1、基于多特征融合多目标跟踪算法2:基于自适应模板的目标跟踪。其中,多特征融合多目标跟踪算法结合了颜色、纹理等多种特征,构造了一个表示目标的模板。该方法在某些特定场景下可以达到很好的跟踪效果,但其缺点是特征的鲁棒性较弱,在复杂场景(如复杂背景、目标变形或遮挡)下很容易中断跟踪。另外,模板匹配跟踪和相关系数法是目标跟踪的经典方法,它的优点是简单,适用面广,计算速度快,缺点是也不能在复杂场景(如适应光照变化和目标形变)使用。

发明内容

在下文中给出了关于本发明实施例的简要概述,以便提供关于本发明的某些方面的基本理解。应当理解,以下概述并不是关于本发明的穷举性概述。它并不是意图确定本发明的关键或重要部分,也不是意图限定本发明的范围。其目的仅仅是以简化的形式给出某些概念,以此作为稍后论述的更详细描述的前序。

根据本申请的一个方面,提供一种室内多人追踪及姿态估量的方法,包括:

连续采集图像和视频流,对采集的图像进行预处理,对采集的视频流进行多人追踪处理和姿态估量;

其中,所述对采集的图像进行预处理具体包括:接收所述采集的图像,检测每帧所述采集的图像是否具有预定特征区域,并对检测出的所述预定特征区域进行截取;计算预定特征区域的置信度,并将所述置信度超过预定阀值的所述预定特征区域对应的图像保存并输出至算法服务器;所述算法服务器用于对采集的视频流进行多人追踪处理和姿态估量;该步骤用于检测视频流中的画面内容是否改变,如果画面内容保持不动的时候就不传输给图像服务器,一旦视频画面与之前不一致或者收到软件后台请求就开始处理视频图像;

所述对采集的视频流进行多人追踪处理和姿态估量包括:过程1:生成检测框列表,执行追踪进行预测,过程2:更新检测框列表,过程3:根据预测与轨迹执行下述相应操作:对未匹配的轨迹标记为丢失状态,对未匹配的检测重写初始化,对追踪到的匹配轨迹更新对应轨迹,更新已确认的轨迹ID;过程4:通过关键点模型检测选出人体关键点中置信度较高的点以及位置预测较准的点并定位;过程5:通过姿态分类网络确定姿态。

进一步的,所述对采集的视频流进行多人追踪处理和姿态估量具体包括多人追踪处理过程和姿态估量过程;

所述多人追踪处理过程:先运行目标检测器,获取目标检测框;使用级联匹配,针对每一个检测器分配一个跟踪器,且每个跟踪器设定一时间参数;如果跟踪器完成匹配并更新,则参数重置,否则+1;使用马氏距离与余弦距离,针对运动信息与外观信息的计算,在计算中添加协方差矩阵,并进行方差归一化;添加深度学习特征,加入一深度学习特征提取网络,将所有确定的追踪器(confirmed状态)每次完成匹配对应的特征集存储为一个清单list;每次匹配之后同时更新该特征集,并去除一些已经出镜头的目标的特征集,保留最新的特征,将老的特征过滤掉;这个特征集在进行余弦距离计算的时候将会发挥作用;最后采用IOU(Intersection over Union)与匈牙利算法匹配,IOU进行衡量;计算检测器与跟踪器的IOU,将其作为置信度的高低;

所述姿态估量过程包括:对视频流中的图像利用关键点检测模型进行人体关键点检测;选出人体关键点中置信度较高且位置预测较准的点并定位;通过姿态分类网络确定姿态。

进一步的,所述多人追踪处理过程的算法如下:

将第j个检测对象和第i条轨迹之间的运动匹配度d

d

函数

当前捕捉的视频流中最新对轨迹100次成功跟踪记为L

每个轨迹保留最后L

对每个检测边界框d

上述计算余弦距离的度量确定一门限函数:

将计算马氏距离的度量和计算余弦距离的度量融合并加权平均:c

其中,d

进一步的,所述算法服务器预先制备网络训练数据集,用网络训练数据集对行人检测网络、体态特征检测网络、人体关节点识别网络这三个网络分别进行训练;边缘设备采集的多角度体态特征存储在临时数据库;用训练好的行人检测网络检测图像行人区域并跟踪行人区域;用训练好的体态特征检测网络在行人区域内检测体态区域;在体态区域提取的特征与体态特征数据库进行特征匹配,取特征匹配最好的作为结果;用人体关节点识别网络获得不同部位检测框并对不同部位进行跟踪。

更进一步的,所述算法服务器在制备数据集时,使用CNN网络在大规模行人数据集进行训练,并提取特征,以增加网络对遗失和障碍的鲁棒性。

本发明通过上述两种度量公式融合加权得到的公式来实现的方案,在复杂场景(如复杂背景、目标变形或遮挡)下更容易中断跟踪。

根据本申请的另一方面,提供一种室内多人追踪及姿态估量的装置,包括:

用于连续采集图像和视频流的摄像头、用于对采集的图像进行预处理的预处理模块、用于对采集的视频流进行多人追踪处理和姿态估量的算法服务器、用于将摄像头和预处理模块的输出传输给算法服务器的远程通信模块、用于接收并存储数据的存储模块;

其中,所述预处理模块用于接收所述采集的图像,检测每帧所述采集的图像是否具有预定特征区域,并对检测出的所述预定特征区域进行截取;计算预定特征区域的置信度,并将所述置信度超过预定阀值的所述预定特征区域对应的图像保存并输出至算法服务器;

所述算法服务器用于对采集的视频流进行多人追踪处理和姿态估量,其具体执行如下操作:生成检测框列表,执行追踪进行预测;更新检测框列表;根据预测与轨迹执行下述相应操作:对未匹配的轨迹标记为丢失状态,对未匹配的检测重写初始化,对追踪到的匹配轨迹更新对应轨迹,更新已确认的轨迹ID;通过关键点模型检测选出人体关键点中置信度较高的点以及位置预测较准的点并定位;通过姿态分类网络确定姿态。

本发明采用的是物联网设备传输相关信息+算法服务做数据处理。边缘计算设备(Xavier)将视频流传输至算法服务器,算法服务器做图像识别相关操作。在边缘计算中Xavier控制摄像头采集数据经Opencv预处理后通过ffmpeg远程推流。在复杂场景(如复杂背景、目标变形或遮挡)下很容易中断跟踪。

本发明的多人追踪及姿态估量通过运动模型、特征提取、观测模型、模型更新、集成方法与框架实现,使用边缘计算设备(Xavier)能够预处理视频帧并稳定输出视频流给服务器,另外基于深度学习延续了卡尔曼滤波加匈牙利算法的思路,在这个基础上增加了行人重识别网络和行人鉴别网络及人体关键节点识别网络,从而区分出不同的行人在室内的状态并保持追踪,并且较长时间遮挡的目标也是能够跟踪。其中,运动模型、观测模型是通过网络训练得到的。特征提取公式为:D(A,M)2A∩M/A+M,A是自动分割的区域,M是正确标记。

本发明在边缘计算上使用边缘计算设备(Xavier)能够预处理视频帧并稳定输出视频流给服务器,具体采用rtsp推流到服务器,服务器多线程一个管道逐帧提供图片,一个管道逐帧解析,有效缓解图像处理过程中通信负载大、不能提供特定的图像信息、不能达到实时的目标检测以及存储空间浪费等缺陷。

附图说明

本发明可以通过参考下文中结合附图所给出的描述而得到更好的理解,其中在所有附图中使用了相同或相似的附图标记来表示相同或者相似的部件。所述附图连同下面的详细说明一起包含在本说明书中并且形成本说明书的一部分,而且用来进一步举例说明本发明的优选实施例和解释本发明的原理和优点。在附图中:

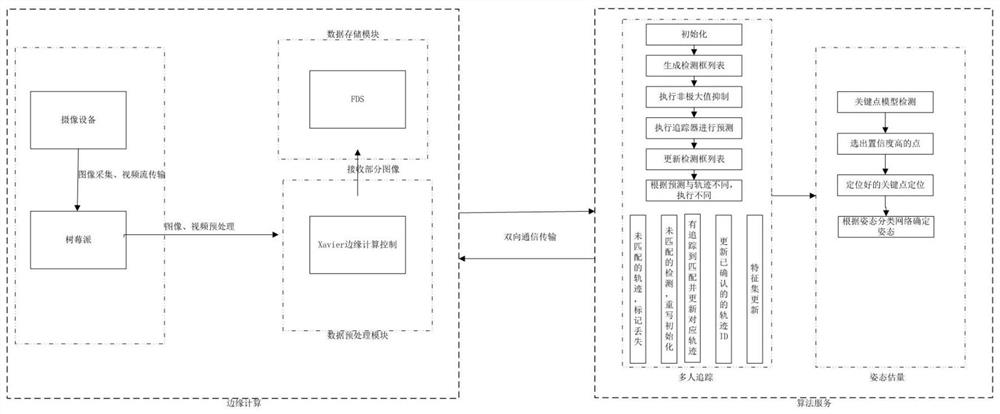

图1为本发明的室内多人追踪及姿态估量的方法流程图;

图2为本发明的室内多人追踪及姿态估量方法的部分算法代码流程图。

具体实施方式

下面将参照附图来说明本发明的实施例。应当注意,为了清楚的目的,附图和说明中省略了与本发明无关的、本领域普通技术人员已知的部件和处理的表示和描述。

本发明多人追踪与姿态估量使用边缘计算设备(Xavier)能够预处理视频帧并稳定输出视频流给服务器,另外基于深度学习延续了卡尔曼滤波加匈牙利算法的思路,在这个基础上增加了行人重识别网络和行人鉴别网络及人体关键节点识别网络。目的是区分出不同的行人在室内的状态并保持追踪,并且较长时间遮挡的目标也是能够跟踪。

实施例1

本实施例提供一种室内多人追踪及姿态估量装置,其包括如下设备:用于边缘计算的摄像头、树莓派(Raspberry Pi,微型电脑)、工控机(JETSON AGX XAVIER)和路由网关,用于算法服务的算法服务器(tesla GV100)。摄像头、树莓派、算法服务器和路由网关均与工控机建立通讯连接。

其中,摄像头用于连续采集图像和视频流,树莓派用于控制摄像头,算法服务器用于对采集的视频流进行多人追踪处理和姿态估量;工控机包括用于对采集的图像进行预处理的预处理模块、用于将摄像头和预处理模块的输出传输给算法服务器的远程通信模块以及用于接收并存储数据的存储模块。

预处理模块用于接收所述采集的图像,检测每帧所述采集的图像是否具有预定特征区域,并对检测出的所述预定特征区域进行截取;计算预定特征区域的置信度,并将所述置信度超过预定阀值的所述预定特征区域对应的图像保存并输出至算法服务器。

算法服务器用于对采集的视频流进行多人追踪处理和姿态估量,其具体执行如下操作:生成检测框列表,执行追踪进行预测;更新检测框列表;根据预测与轨迹执行下述相应操作:对未匹配的轨迹标记为丢失状态,对未匹配的检测重写初始化,对追踪到的匹配轨迹更新对应轨迹,更新已确认的轨迹ID;通过关键点模型检测选出人体关键点中置信度较高的点以及位置预测较准的点并定位;通过姿态分类网络确定姿态。

本发明在边缘计算上有效缓解图像处理过程中通信负载大、不能提供特定的图像信息、不能达到实时的目标检测以及存储空间浪费等缺陷。

实施例2

本实施例提供一种实施例1的室内多人追踪及姿态估量的装置的处理方法,在服务算法上能够基于深度学习对多人的追踪和姿态估量,应用于无人零售中。具体通过以下技术方案予以实现:

首先构建边缘计算的硬件架构及嵌入式软件:1、视频采集:树莓派控制摄像头用于连续采集图像和视频流,图像传送给数据预处理模块,采集的视频流传输给远程通信模块;2,数据预处理:工控机作为边缘计算设备(Xavier)来接收所述视像采集模块采集的图像,检测每帧图像是否具有预定特征区域,并对检测出的所述预定特征区域进行截取;数据处理模块计算预定特征区域的置信度,并将所述置信度超过预定阀值的所述预定特征区域对应的图像传输给存储模块以及远程通信模块;3、存储模块,用于接收并存储特定图像;4、远程通信模块,用于接收所述置信度超过所述预定阀值的所述预定特征区域对应的图像和视频流,并转发给远程算法服务端。

然后,在算法服务端接收到视频流和对应的截取图像后,针对视频流执行多人追踪以及姿态估量。参见图1和图2,算法服务端主要包括如下过程:过程1:生成检测框列表,执行追踪进行预测,过程2:更新检测框列表,过程3:根据预测与轨迹执行下述相应操作:对未匹配的轨迹标记为丢失状态,对未匹配的检测重写初始化,对追踪到的匹配轨迹更新对应轨迹,更新已确认的轨迹ID;过程4:通过关键点模型检测选出人体关键点中置信度较高的点以及位置预测较准的点并定位;过程5:通过姿态分类网络确定姿态。

其中,算法服务器针对视频流执行多人追踪包括如下过程:1、先运行目标检测器,获取目标检测框;2、使用级联匹配,针对每一个检测器会分配一个跟踪器,并且每一个跟踪器会设定一个时间参数。如果跟踪器完成匹配并更新,参数会重置,否则+1,3、使用马氏距离与余弦距离,针对运动信息与外观信息的计算,在计算中添加协方差矩阵,并进行方差归一化,4、添加深度学习特征,加入了一个深度学习的特征提取网络,将所有确定的追踪器(confirmed状态)每次完成匹配对应的特征集(detection的featuremap存储进一个list)。在每次匹配之后都会更新这个特征集,比如去除掉一些已经出镜头的目标的特征集,保留最新的特征将老的特征过滤掉等等。这个特征集在进行余弦距离计算的时候将会发挥作用。5、最后IOU与匈牙利算法匹配,IOU进行衡量,计算检测器与跟踪器的IOU,将这个作为置信度的高低。

具体的,其多人追踪算法描述如下:

第j个检测对象(detection)和第i条轨迹之间的运动匹配度d

其中,d

也即函数

当前捕捉的视频流中最新对轨迹100次成功跟踪记为L

每个轨迹保留最后L

该度量同样可以确定一个门限函数

两种度量的融合:加权平均c

d

门限函数

上述公式中,阈值t

算法服务器针对视频流执行姿态估量包括如下过程:1、对视频流中的图像利用关键点检测模型进行人体关键点检测;2、选出人体关键点中置信度较高且位置预测较准的点并定位3、通过姿态分类网络确定姿态。

本发明在边缘计算上有效缓解图像处理过程中通信负载大、不能提供特定的图像信息、不能达到实时的目标检测以及存储空间浪费等缺陷。在服务算法上能够基于深度学习对多人的追踪和姿态估量,使其非常适用于无人零售中。

应该强调,术语“包括/包含”在本文使用时指特征、要素、步骤或组件的存在,但并不排除一个或更多个其它特征、要素、步骤或组件的存在或附加。

此外,本发明的方法不限于按照说明书中描述的时间顺序来执行,也可以按照其他的时间顺序地、并行地或独立地执行。因此,本说明书中描述的方法的执行顺序不对本发明的技术范围构成限制。

尽管上面已经通过对本发明的具体实施例的描述对本发明进行了披露,但是,应该理解,上述的所有实施例和示例均是示例性的,而非限制性的。本领域的技术人员可在所附权利要求的精神和范围内设计对本发明的各种修改、改进或者等同物。这些修改、改进或者等同物也应当被认为包括在本发明的保护范围内。

- 一种室内多人追踪及姿态估量的方法及装置

- 一种多人姿态识别方法和装置