一种基于深度学习的图像跨尺度超分辨率方法

文献发布时间:2023-06-19 12:19:35

技术领域

本发明属于图像处理技术领域,具体涉及一种图像跨尺度超分辨率方法。

背景技术

近年来,跨尺度分析方法与技术已成为生命科学、材料科学、信息科学等研究领域的重要手段,但是由于获取到的图像的分辨率有限,限制了跨尺度方法与技术的进展。因此,构建跨尺度超分辨率检测方法,对于满足当前科研与市场的迫切需求具有重大意义。

基于传统图像处理算法的图像跨尺度超分辨技术,包括基于差值的图像处理算法、基于退化模型的图像处理算法、基于学习的图像处理算法等,普适性较差,当图像稍有变动或任务需求稍有改变,已有的处理算法便不再适用。近年来,各种基于深度学习的超分辨率方法得到了发展。2014年起,SRCNN、FSRCNN、SRGAN等深度神经网络陆续被提出,图像超分辨率技术日益成熟并被广泛应用。

然而,学者们提出的基于深度学习的超分辨率方法绝大多数是针对自然图像的,对于特定领域的特殊图像并不适用。对于生物图像而言,首先,生物图像的公开数据集比较少,且由于生物图像比较难获取,数据集中的图像数量也较少;其次,由于生物图像的获取方式更加困难,生物图像中往往比自然图像含有更多的噪声和其他的一些冗余信息并且很难进行模拟仿真,使得生物图像的超分辨率处理更加困难。

发明内容

为了克服现有技术的不足,本发明提供了一种基于深度学习的图像跨尺度超分辨率方法,首先通过传统的图像处理算法创建生物图像数据集;然后基于深度学习网络U-net,去除原始生物图像中的噪声及冗余信息,得到网络处理后的超分辨率的生物图像;接下来基于生物图像数据集和深度学习网络,提升图像的空间分辨率,实现生物图像的跨尺度超分辨率;最后基于网络输出的结果图,进行三维重构,得到跨尺度微纳结构的三维构象的高分辨率的还原。本发明可以在少量数据图像的情况下实现的生物图像跨尺度超分辨率,达到了比较好的效果。

本发明解决其技术问题所采用的技术方案包括如下步骤:

步骤1:采集低分辨率原始共聚焦生物图像;

步骤2:对于获取到的原始共聚焦生物图像,通过图像处理算法去除噪声和冗杂信息,并得到对应的高分辨率清晰生物图像;

步骤3:将原始共聚焦生物图像和对应的高分辨率清晰生物图像组成图像对,构建生物图像数据集;

步骤4:使用步骤3生成的生物图像数据集对深度神经网络U-net进行训练,将低分辨率原始共聚焦生物图像作为输入,高分辨率清晰生物图像作为标签图像,使深度神经网络U-net学习到低分辨率原始共聚焦生物图像和高分辨率清晰生物图像之间的关系;

步骤5:将待检测的低分辨率原始共聚焦生物图像输入到步骤4训练完成的深度神经网络U-net中,进行超分辨率检测,得到去除噪声及冗余信息的清晰的超分辨率图像;

步骤6:使用峰值信噪比PSNR和图像截面亮度曲线对比低分辨率原始共聚焦生物图像和由深度神经网络U-net得到的对应的清晰的超分辨率图像之间的质量提升;

步骤7:将多张相邻的原始共聚焦生物图像输入步骤4训练完成的深度神经网络U-net中得到对应的清晰的超分辨率输出结果图,对这些结果图进行三维重构,得到跨尺度微纳结构的三维构象高分辨率还原。

进一步地,所述采集低分辨率原始共聚焦生物图像的方法为共聚焦显微镜分层扫描的方法。

进一步地,所述图像处理算法包括小波算法、Lucy-Richardson算法、裁剪和插值方法。

进一步地,所述裁剪是将一张2048×2048尺寸大小的原始共聚焦生物图像,按照等间隔裁剪为16张512×512的图像。

进一步地,所述步骤5中进行超分辨率检测时,进行以下处理:

步骤5-1:将原始的2048×2048尺寸大小的原始共聚焦生物图像按等间隔裁剪为16张512×512尺寸大小的子图像;

步骤5-2:将这16张子图像输入U-net深度神经网络中,得到对应的16张超分辨率子图像;

步骤5-3:将这16张超分辨率子图像组合,则得到原始共聚焦生物图像对应的2048×2048尺寸大小的超分辨率图像。

进一步地,所述峰值信噪比PSNR的计算方法如下:

将低分辨率原始共聚焦生物图像用I表示,经过深度神经网络U-net得到的对应的清晰的超分辨率图像用J表示,则I是J的噪声近似,它们的尺寸大小是m×n,它们的均方差表示为:

图像的峰值信噪比为:

其中,MAX

进一步地,所述图像截面亮度曲线是对低分辨率原始共聚焦生物图像和对应的清晰的超分辨率图像分别做横切面和纵切面进行获取的;对比图像截面亮度曲线,根据图像半高全宽FWHM的变化,估算图像空间分辨率的提升倍数。

本发明的有益效果如下:

1、本发明将U-net深度神经网络模型应用到图像跨尺度超分辨中,提升了生物图像的空间分辨率,实现了生物图像的纳米-微米-毫米的跨尺度超分辨率检测和跨尺度微纳结构的三维构象进行高分辨率的还原。

2、本发明提出生物图像数据集的建立,获取到的原始生物图像噪声和冗杂信息的处理,原始低分辨率共聚焦生物图像的超分辨率还原,引入深度学习网络,在少量数据图像的情况下实现生物图像跨尺度超分辨率。

附图说明

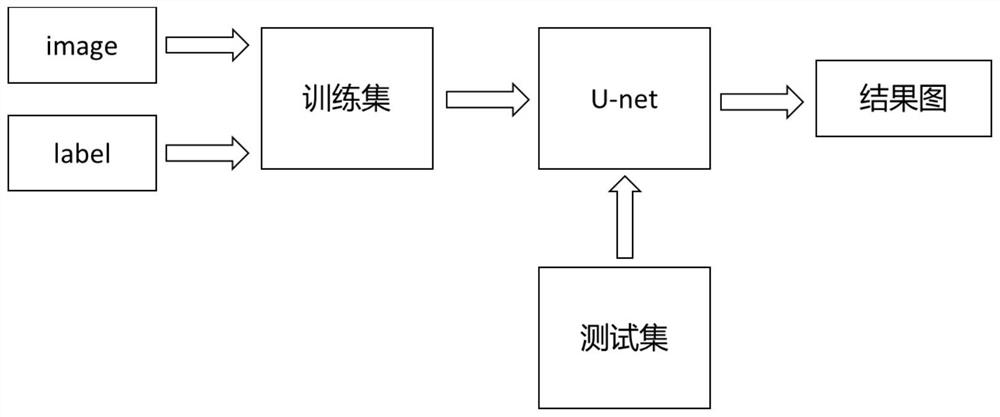

图1为本发明方法整体框架图。

图2为本发明生物图像数据集制作流程。

图3为U-net深度神经网络结构框架图。

具体实施方式

下面结合附图和实施例对本发明进一步说明。

本发明提出一种基于U-net深度神经网络的图像跨尺度超分辨率方法,实现生物图像的纳米-微米-毫米的跨尺度超分辨率检测及跨尺度微纳结构的三维构象的高分辨率的还原。

如图1所示,一种基于深度学习的图像跨尺度超分辨率方法,包括如下步骤:

步骤1:使用共聚焦显微镜分层扫描的方法采集原始共聚焦生物图像;

步骤2:如图2所示,对于获取到的原始共聚焦生物图像,通过小波算法、Lucy-Richardson算法、裁剪和插值方法去除噪声和冗杂信息,并得到对应的高分辨率清晰生物图像;由于原始共聚焦生物图像是2048×2048尺寸大小的,对于计算机来讲运算量和计算时间较大,因此将图像对分别裁剪为512×512的图片;

步骤3:将原始共聚焦生物图像和对应的高分辨率清晰生物图像组成图像对,构建生物图像数据集;

步骤4:使用步骤3生成的生物图像数据集对深度神经网络U-net进行训练,将低分辨率原始共聚焦生物图像作为输入,高分辨率清晰生物图像作为标签图像,使深度神经网络U-net学习到低分辨率原始共聚焦生物图像和高分辨率清晰生物图像之间的关系;

步骤4-1:如图3所示,搭建U-net深度神经网络模型:

U-net深度神经网络模型可分为编码网络和解码网络,编码器网络使通道数量翻倍,使特征图的样本量减少一半;解码网络使特征图的大小翻倍,通道数量减半。因此,编码解码网络可以将输入图像转换为小尺寸的多通道特征映射,然后将特征映射解码为相同尺寸的输出图像。

U-net深度神经网络模型中包括多个卷积操作,最大池化操作,转置卷积操作以及特征图裁剪拼接等;

U-net深度神经网络模型中采用了skip-connection,这种操作可以连接不同大小的feature maps,有利于梯度传播和网络收敛;

U-net深度神经网络模型是卷积网络的典型结构。它由重复的两个3x3卷积,每个后面跟着一个整流线性单元(ReLU)和一个步数为2的2x2最大池化操作组成;

U-net深度神经网络模型中的所有卷积都进行批处理归一化(BN)和校正线性单元(ReLU),以提高训练速度和更好的非线性能力;

在Unet最后一层,一个1x1卷积被用来映射每个64组件特征向量到所需的类数;

在U-net深度神经网络中,它的损失函数是特征映射结合交叉熵损失函数,通过像素级的软最大来计算的。

其中P

对于具有最大激活函数值a

交叉熵通过公式(2)惩罚每一个位置偏离1的

步骤4-2:训练U-net深度神经网络模型:

使用U-net深度神经网络,在步骤3构建生物图像数据集的基础上进行训练,学习原始共聚焦生物图像和对应的高分辨率清晰生物图像对之间的映射关系。

步骤5:将待检测的低分辨率原始共聚焦生物图像输入到步骤4训练完成的深度神经网络U-net中,进行超分辨率检测,得到去除噪声及冗余信息的清晰的超分辨率图像;

由于原始共聚焦生物图像是2048×2048尺寸大小,U-net深度神经网络模型的训练集为512×512尺寸大小的图片,在检测原始生物图像的超分辨率图像时,需要做以下处理:

步骤5-1:将原始的2048×2048尺寸大小的原始共聚焦生物图像按等间隔裁剪为16张512×512尺寸大小的子图像;

步骤5-2:将这16张子图像输入U-net深度神经网络中,得到对应的16张超分辨率子图像;

步骤5-3:将这16张超分辨率子图像组合,则得到原始共聚焦生物图像对应的2048×2048尺寸大小的超分辨率图像。

步骤6:将原始的低分辨率原始共聚焦生物图像和深度神经网络U-net预测得到的对应的清晰的超分辨率图像进行比较,计算图像的峰值信噪比(PSNR)的数值对比图像的质量和分辨率;

将低分辨率原始共聚焦生物图像用I表示,经过深度神经网络U-net得到的对应的清晰的超分辨率图像用J表示,则I是J的噪声近似,它们的尺寸大小是m×n,它们的均方差表示为:

图像的峰值信噪比为:

其中,MAX

对于原始的低分辨率原始共聚焦生物图像和深度神经网络U-net预测得到的对应的清晰的超分辨率图像分别做横切面和纵切面,进行图像截面亮度曲线的对比,观察图像半高全宽(FWHM)的变化,估算图像空间分辨率的提升倍数。

步骤7:将多张相邻的原始共聚焦生物图像输入步骤4训练完成的深度神经网络U-net中得到对应的清晰的超分辨率输出结果图,对这些结果图进行三维重构,得到跨尺度微纳结构的三维构象高分辨率还原。

具体实施例:

本实施例采用Python语言,在PyTorch平台上进行实验。在训练过程中,训练次数设置为200,Batch_size值设置为1。在整个训练过程中,U-net网络采用了Adam优化器。本发明的实验的硬件环境为:GPU:Intel;独立显卡:NVidia RTX 2080TI;系统环境为Ubuntu16.0.4;软件环境为python3.6.2,pytorch1.0.1。

如图1所示,是本发明方法整体框架图,为本发明实施例中,一种基于深度学习的图像跨尺度超分辨率方法,包括以下步骤:

1、通过使用共聚焦显微镜分层扫描的方法采集原始共聚焦生物图像;

2、对于原始共聚焦生物图像,分析图像特征,使用MATLAB软件中使用传统的图像处理算法小波算法和Lucy-Richardson算法结合进行处理,去除图像中的噪声和大量冗余信息,解除图像中结构的缠绕信息,得到对应的图像结构清晰的干净图像;

3、处理得到的干净图像作为其对应的原始共聚焦生物图像的GroundTruth,将原始共聚焦生物图像和对应的GroundTruth分别放在train文件夹下的image和label文件夹中,并对对应的图像标以相同的标号,组建成生物图像对。由于原始共聚焦生物图像是2048×2048尺寸大小的,对于计算机来讲运算量和计算时间较大,将图像对分别裁剪为512×512的图片,构建本发明的生物图像数据集;

4、搭建U-net深度神经网络模型,在自制数据集的基础上,对深度神经网络U-net进行训练,使深度神经网络U-net学习到低分辨率的原始生物图像和处理后的高分辨率的清晰生物图像之间的关系;

(一)搭建U-net深度神经网络模型:

U-net深度神经网络模型可分为编码网络和解码网络,编码器网络使通道数量翻倍,使特征图的样本量减少一半;解码网络使特征图的大小翻倍,通道数量减半。因此,编码解码网络可以将输入图像转换为小尺寸的多通道特征映射,然后将特征映射解码为相同尺寸的输出图像。U-net深度神经网络模型中包括多个卷积操作,最大池化操作,转置卷积操作以及特征图裁剪拼接等.U-net深度神经网络模型中采用了skip-connection,这种操作可以连接不同大小的feature maps,有利于梯度传播和网络收敛。

(二)训练U-net深度神经网络模型:

使用U-net深度神经网络,在第3步的生物图像数据集的基础上进行训练,学习原始共聚焦生物图像和对应的GroundTruth图像对之间的映射关系;

5、根据第4步得到的映射关系对生物图像数据集中的测试集进行超分辨率检测,输出结果。由于原始共聚焦生物图像是2048×2048尺寸大小,U-net深度神经网络模型的训练集为512×512尺寸大小的图片,在检测原始生物图像的超分辨率图像时,需要做以下处理:(一)首先,将原始的2048×2048尺寸大小的生物图像裁剪为16张512×512尺寸大小的子图像;(二)然后,将这16张子图像输入U-net深度神经网络中,得到对应的16张超分辨率子图像;(三)最后,将这16张超分辨率子图像组合,则得到原始共聚焦生物图像对应的2048×2048尺寸大小的超分辨率图像;

6、将低分辨率原始共聚焦生物图像和深度神经网络U-net预测得到的对应的清晰的超分辨率图像进行比较,计算图像的峰值信噪比(PSNR)的计算方法对比图像的质量和分辨率;

7、对于原始的低分辨率原始共聚焦生物图像和深度神经网络U-net预测得到的对应的清晰的超分辨率图像分别做横切面和纵切面,进行图像截面亮度曲线的对比,观察图像半高全宽(FWHM)的变化,估算图像空间分辨率的提升倍数。

8、按照第5步所述的方法,将多张相邻的原始共聚焦生物图像输入训练好的深度神经网络U-net模型中得到对应的清晰的超分辨率输出结果图。将2048×2048尺寸大小的原始共聚焦生物图像和对应的网络输出结果图两组图分别导入MATLAB的APP中,进行图像的三维重构,分别得到原始共聚焦生物图像的三维重构图和U-net深度学习网络超分辨率输出结果图三维重构图,实现了跨尺度微纳结构的三维构象的高分辨率的还原。

- 一种基于深度学习的图像跨尺度超分辨率方法

- 一种基于局部跨尺度自回归模型的单幅图像超分辨率方法