智能设备的交互方法及电子设备

文献发布时间:2023-06-19 19:33:46

技术领域

本发明涉及智能设备技术领域,尤其涉及智能设备的交互方法及电子设备。

背景技术

随着科技的发展,智能家电和智能家居等智能设备走进了人们的日常生活。人们能与智能设备进行人机对话,或者向智能设备发出指令,使其完成特定的工作内容。

现有的智能设备大多是按照预先编制的程序与用户对话,通过识别用户与智能设备进行人机对话的对话文本,并根据对话文本的语义进行情绪识别结果或意图识别结果,进行机械式回答。该类交互技术仅在人机对话的对话文本具有强烈的情绪倾向或意图指向时,才能输出较为准确的应答,当人机对话的对话文本为没有明确的情绪倾向或意图指向的文本时,输出的应答准确度低,交互效果较差,会给用户带来不佳的交互体验。

发明内容

本发明旨在至少解决现有技术中智能设备输出的应答准确度低、交互效果差的技术问题。为此,本发明提出一种智能设备的交互方法,提高智能设备输出的应答准确度,提升智能设备的交互效果,进而提升用户的使用体验。

根据本发明第一方面实施例的智能设备的交互方法,包括:

获取用户语音和用户图像;

对所述用户语音进行语音识别,得到识别文本;

对所述识别文本和所述用户图像进行情绪识别,得到用户情绪特征;

基于所述用户情绪特征和所述识别文本,得到用户意图特征;

基于所述用户意图特征,输出目标应答信息。

根据本发明实施例的智能设备的交互方法,通过结合识别文本和用户情绪特征,得到准确的用户意图特征,基于用户意图特征输出对应的目标应答信息,实现用户与智能设备间情感化的交互,提升用户的使用体验。

根据本发明的一个实施例,在所述获取用户语音和用户图像之后,所述方法还包括:

从所述用户语音中提取语音节奏特征;

所述基于所述用户意图特征,输出目标应答信息,包括:

基于所述用户意图特征和所述语音节奏特征,输出所述目标应答信息。

根据本发明的一个实施例,所述语音节奏特征包括用户音量特征和用户语速特征中的至少一个。

根据本发明的一个实施例,所述基于所述用户意图特征和所述语音节奏特征,输出所述目标应答信息,包括:

基于所述用户意图特征,得到所述目标应答信息;

基于所述语音节奏特征,得到目标输出节奏;

按所述目标输出节奏输出所述目标应答信息。

根据本发明的一个实施例,所述目标应答信息包括应答表情图像和应答内容信息;

其中,所述应答内容信息包括应答文本和应答图像。

根据本发明的一个实施例,所述方法还包括:

获取用户与智能设备上一次交互的用户历史情绪特征;

所述对所述识别文本和所述用户图像进行情绪识别,得到用户情绪特征,包括:

基于所述识别文本、所述用户图像和所述用户历史情绪特征,得到所述用户情绪特征。

根据本发明的一个实施例,所述基于所述识别文本、所述用户图像和所述用户历史情绪特征,得到所述用户情绪特征,包括:

基于所述识别文本和所述用户图像,得到文本情绪特征和图像情绪特征;

获取所述文本情绪特征、所述图像情绪特征和所述用户历史情绪特征的权重值;

基于所述文本情绪特征、所述图像情绪特征和所述用户历史情绪特征各自的权重值进行加权处理,得到所述用户情绪特征。

根据本发明第二方面实施例的智能设备的交互装置,包括:

获取模块,用于获取用户语音和用户图像;

第一处理模块,用于对所述用户语音进行语音识别,得到识别文本;

第二处理模块,用于对所述识别文本和所述用户图像进行情绪识别,得到用户情绪特征;

第三处理模块,用于基于所述用户情绪特征和所述识别文本,得到用户意图特征;

输出模块,用于基于所述用户意图特征,输出目标应答信息。

根据本发明第三方面实施例的智能设备,包括上文描述的智能设备的交互装置。

根据本发明第四方面实施例的电子设备,包括存储器、处理器及存储在所述存储器上并可在所述处理器上运行的计算机程序,所述处理器执行所述计算机程序时实现如上述任一种所述智能设备的交互方法的步骤。

根据本发明第五方面实施例的非暂态计算机可读存储介质,其上存储有计算机程序,所述计算机程序被处理器执行时实现如上述任一种所述智能设备的交互方法的步骤。

根据本发明第六方面实施例的计算机程序产品,包括计算机程序,所述计算机程序被处理器执行时实现如上述任一种所述智能设备的交互方法的步骤。

本发明实施例中的上述一个或多个技术方案,至少具有如下技术效果之一:

通过结合识别文本和用户情绪特征,得到准确的用户意图特征,基于用户意图特征输出对应的目标应答信息,实现用户与智能设备间情感化的交互,提升用户的使用体验。

进一步的,基于语音节奏特征,调节输出的目标应答信息的音量和语速,使得智能设备的反馈更加生动。

更进一步的,应答表情图像和应答内容信息对应情绪和图文的回复内容,使得智能设备的反馈更加生动,人机交互效果提升明显。

本发明的附加方面和优点将在下面的描述中部分给出,部分将从下面的描述中变得明显,或通过本发明的实践了解到。

附图说明

为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

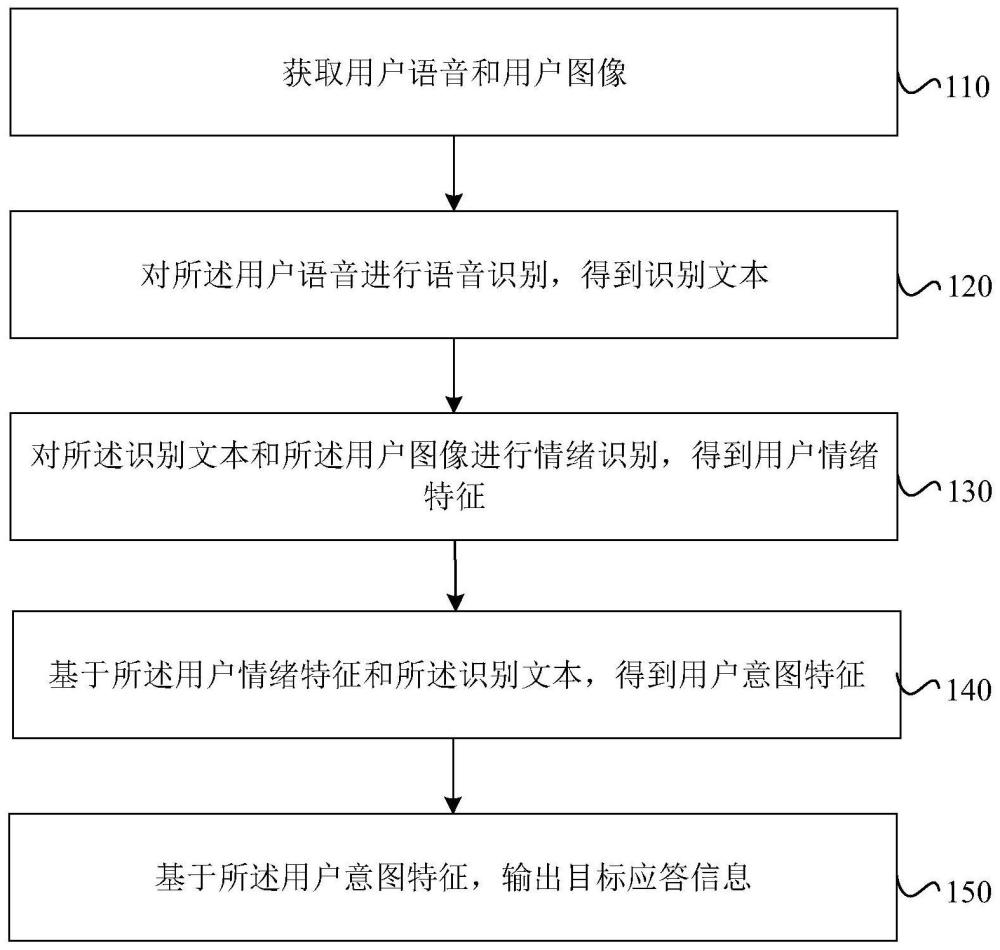

图1是本发明实施例提供的智能设备的交互方法的流程示意图;

图2是本发明实施例提供的智能设备的交互界面之一;

图3是本发明实施例提供的智能设备的交互界面之二;

图4是本发明实施例提供的智能设备的交互装置的结构示意图;

图5是本发明实施例提供的电子设备的结构示意图。

具体实施方式

下面结合附图和实施例对本发明的实施方式作进一步详细描述。以下实施例用于说明本发明,但不能用来限制本发明的范围。

在本发明实施例的描述中,需要说明的是,术语“第一”、“第二”、“第三”仅用于描述目的,而不能理解为指示或暗示相对重要性。

在本说明书的描述中,参考术语“一个实施例”、“一些实施例”、“示例”、“具体示例”、或“一些示例”等的描述意指结合该实施例或示例描述的具体特征、结构、材料或者特点包含于本发明实施例的至少一个实施例或示例中。在本说明书中,对上述术语的示意性表述不必须针对的是相同的实施例或示例。而且,描述的具体特征、结构、材料或者特点可以在任一个或多个实施例或示例中以合适的方式结合。此外,在不相互矛盾的情况下,本领域的技术人员可以将本说明书中描述的不同实施例或示例以及不同实施例或示例的特征进行结合和组合。

下面结合图1至图3描述本发明实施例的智能设备的交互方法,该方法的执行主体可以为智能设备的控制器。

智能设备具有计算处理能力、灵敏准确的感知功能、正确的思维与判断功能以及行之有效的执行功能。

在本发明实施例中,智能设备可以为智能家居设备、智能穿戴设备、手机、平板、计算机或机器人等智能设备。

其中,智能家居设备包括但不限于冰箱、空调、洗衣机、热水器、微波炉、烹饪设备等家居设备。

如图1所示,本发明实施例的智能设备的交互方法包括步骤110至步骤150。

步骤110、获取用户图像和用户语音。

其中,用户语音是用户与智能设备交互时用户产生的语音,用户图像是用户与智能设备交互时用户产生的面部表情或肢体动作。

例如,用户与智能设备交互时,用户产生的语音可以为“我有点难过”或“今天一天累死了,总算下班了”等语音。

用户与智能设备交互时,用户产生的面部表情可以为微笑、皱眉、眉毛上扬、嘴角向上、嘴唇紧闭或流泪等面部表情。

用户产生的肢体动作可以为点头、摇头、鼓掌、晃动拳头、打呵欠或搔头等肢体动作。

在该步骤中,可以通过智能设备上设置的麦克风等拾音装置采集用户语音,可以智能设备上设置的摄像头等图像采集装置采集用户图像。

步骤120、对获得的用户语音进行语音识别,得到用户语音对应的识别文本。

在该步骤中,对获得的用户语音进行处理,将用户语音的声音信息转化为文字信息,得到用户语音对应的识别文本。

例如,用户与智能设备交互时,用户说出“我有点难过”,对应得到识别文本为“我有点难过”。

用户说出“今天一天累死了,总算下班了”,对应得到识别文本为“今天一天累死了,总算下班了”。

在实际执行中,可以采用声学识别模型和语言理解模型对用户语音进行语音识别处理,利用声学识别模型实现用户语音的语音到音节的转化,利用语言理解模型实现音节到文字的转化。

用户语音对应的识别文本是用户与智能设备交互的重要内容,可以体现用户的情绪状态以及用户想要智能设备执行的相应功能。

步骤130、对用户图像和识别文本进行情绪识别,得到用户情绪特征。

可以理解的是,用户与智能设备交互时,用户图像中用户产生的面部表情或肢体动作体现了用户交互时的情绪状态。

例如,用户产生的面部表情为微笑时,可以表示用户当前处于宁静平和的情绪状态,用户产生的面部表情为眉毛上扬时,可以表示用户当前处于的较为惊讶的情绪状态。

再例如,用户产生的肢体动作为打呵欠时,可以表示用户当前处于无聊或疲惫的情绪状态,用户产生的肢体动作为晃动拳头可以表示用户当前处于愤怒或具有攻击性的情绪状态。

在该步骤中,用户与智能设备交互时,用户语音对应的识别文本同样体现了用户交互时的情绪状态。

在实际执行中,通过对识别文本中句子情感的分析,得到识别文本所对应的情绪状态。

例如,识别文本为“我有点难过”,通过对识别文本中句子的情感分析,分析得到用户当前处于难过的情绪状态。

在该实施例中,用户情绪特征是用于表征用户与智能设备交互时所处的情绪状态的特征向量,通过对用户图像和识别文本进行情绪识别,得到用户当前所处的情绪状态所对应的用户情绪特征。

可以理解的是,用户图像和识别文本均能体现用户当前情绪状态,通过结合用户图像和识别文本,得到的用户情绪特征准确度大大提高。

例如,识别文本为“今天一天累死了,总算下班了”,通过对识别文本中句子情感分析,无法准确分析用户当前所处的情绪状态。

结合用户图像为眉毛嘴角上扬和“今天一天累死了,总算下班了”的识别文本,可以得到用户情绪特征为轻松愉快的情绪状态。

结合用户图像为嘴角紧闭和“今天一天累死了,总算下班了”的识别文本,可以得到用户情绪特征为疲惫的情绪状态。

在该实施例中,通过对用户图像和识别文本分别进行情绪识别,得到用户图像对应的情绪特征以及识别文本对应的情绪特征。

用户图像对应的情绪特征代表的是用户与智能设备交互时,用户的面部表情或肢体动作所体现的情绪状态,识别文本对应的情绪特征代表的是用户与智能设备交互时,用户所说出的用户语音对应语义所体现的情绪状态。

通过结合用户图像和识别文本两个维度的情绪特征得到的用户情绪特征,能够同时从用户的面部表情或肢体动作等所表现外表情绪状态,以及语音语义所表现的语言情绪状态两个方面对用户的情绪进行准确的描述。

步骤140、基于识别文本和用户情绪特征,得到用户意图特征。

在该实施例中,用户意图特征是用于表征用户与智能设备交互时,用户所希望达到某种目的特征向量,通过对识别文本和用户情绪特征的处理,得到对应的用户意图特征。

在实际执行中,可以通过自然语言处理(Natural Language Processing,NLP)基于本体词典、词频统计及上下文语义分析等方式对识别文本进行语义识别处理,得到识别文本所表征的用户想要智能设备执行的相应功能,也即用户想要表达的意图。

例如,通过自然语言处理得到的用户想要表达的意图可以为寻求安慰、音乐播放、邮件收发、电视控制、煮饭、空调控制、天气预报及系统设置等。

可以理解的是,用户情绪特征可以表征用户与智能设备交互时所处的情绪状态,识别文本可以表征用户想要智能设备执行的相应功能,结合识别文本和用户情绪特征,能够得到反映用户意图和对应情绪状态的用户意图特征。

相关技术中,通过获取文本信息中的意图要素,对文本信息进行意图识别,确定用户意图,在语音识别到的文本信息中不包含意图要素的词语时,无法准确识别用户意图。

在该实施例中,通过结合识别文本和用户情绪特征,能够提高得到的用户意图特征的准确度。

当识别文本不包含意图要素相关的词语时,用户情绪特征为用户意图特征的识别提供参考的识别方向。

例如,用户与智能设备交互时,用户嘴角上扬并说出“今天下班了”。

其中,“今天下班了”不包含意图要素相关的词语,在结合根据用户图像以及识别文本得到用户情绪特征为轻松愉快的情绪状态后,可以以轻松愉快的用户情绪特征作为用户意图特征的识别方向,最终得到用户意图特征是分享喜悦或提供休闲娱乐的推荐项目。

当识别文本包含意图要素相关的词语时,用户情绪特征可以用于确定或校正用户意图特征的识别方向。

例如,用户与智能设备交互时,用户说出“我有点难过”,用户的面部表情是皱眉和嘴唇紧闭。

用户语音对应的识别文本为“我有点难过”,根据用户图像以及识别文本得到用户情绪特征为轻微悲伤的情绪状态,结合用户情绪特征确定用户意图特征是寻求安慰。

步骤150、基于得到的用户意图特征,输出目标应答信息。

用户意图特征能够反映用户意图和对应情绪状态,根据该用户意图特征,智能设备输出的目标应答信息可以从用户意图和情绪状态两个方向对用户进行反馈应答。

例如,用户与智能设备交互时,用户语音对应的识别文本为“我有点难过”,根据用户图像以及识别文本得到用户情绪特征为轻微悲伤的情绪状态,结合识别文本和用户情绪特征,得到用户意图特征是寻求安慰。

根据用户意图特征中寻求安慰的用户意图和轻微悲伤的情绪状态,输出目标应答信息为“你在难过什么,可以和我聊聊吗”以满足寻求安慰的用户意图,在输出时以拟人的关切语调输出,以匹配用户轻微悲伤的情绪状态。

再例如,用户语音对应的识别文本为“今天一天累死了,总算下班了”,根据用户图像以及识别文本得到用户情绪特征为轻松愉快的情绪状态,结合识别文本和用户情绪特征,得到用户意图特征是分享喜悦。

根据用户意图特征中分享喜悦的用户意图和轻松愉快的情绪状态,输出目标应答信息为“完成工作任务了,真不错呀,需要吃点东西补充能量吗”以满足分享喜悦的用户意图,在输出时以拟人的活泼语调输出,以匹配用户轻松愉快的情绪状态。

相关技术中,通过获取文本信息中的意图要素,对文本信息进行意图识别,确定用户意图,根据用户意图,输出反馈内容,根据文本信息得到的用户意图准确度较低,且无法与用户进行情感或情绪上的交互。

本发明实施例中结合识别文本和用户情绪特征,提高用户意图特征的准确性,根据用户意图特征,确定反馈的目标应答信息,实现用户与智能设备间情感化的交互,提升用户的使用体验。

根据本发明实施例提供的智能设备的交互方法,通过结合识别文本和用户情绪特征,得到更加准确的用户意图特征,基于用户意图特征输出对应的目标应答信息,实现用户与智能设备间情感化的交互,提升用户的使用体验。

在一些实施例中,智能设备的交互方法还包括:从用户语音中提取语音节奏特征,然后基于语音节奏特征和用户意图特征,输出对应的目标应答信息。

其中,语音节奏特征包括用户语音的用户音量特征和用户语速特征中的至少一个,用户音量特征用于表征用户语音的声音大小强弱,用户语速特征用于表征用户语音在单位时间内所包括的词汇容量。

在该实施例中,可以通过语音识别技术(Automatic Speech Recognition)识别提取用户语音的用户音量特征和用户语速特征。

在该实施例中,结合识别文本和用户情绪特征,得到用户意图特征,根据用户意图特征,得到对应的目标应答信息。

根据语音节奏特征调整输出目标应答信息的节奏,使得智能设备输出的目标应答信息更加生动,提升用户的使用体验。

相关技术中,也会通过识别用户语气确定用户情绪状态,由于不同人说话的习惯差异较大,导致以语气识别情绪的准确度较低,且用户所处的环境也会对用户说话的语气造成影响,降低情绪识别的准确度。

本发明通过结合用户图像和识别文本得到用户情绪特征,以用户情绪特征判断用户意图特征,再以语音节奏特征调整用户意图特征对应的目标应答信息的输出,可以有效避免用户所处的环境或说话的习惯对于情绪识别的影响,并且可以通过语音节奏特征判断用户所处的环境或说话的习惯,使得目标应答信息的输出匹配用户的说话环境及说话习惯。

在一些实施例中,根据用户语音对应的语音节奏特征,得到目标应答信息的目标输出节奏,使得智能设备按照目标输出节奏输出对应的目标应答信息。

可以理解的是,语音节奏特征包括用户语音的音量特征和语速特征中的至少一个,目标输出节奏包括对应的目标输出音量和目标输出语速。

在实际执行中,可以针对用户语音或目标应答信息的音量和语速进行评分,音量从0分至10分表示音量从小至大,语速从0分至10分表示语速从慢至快,单位时间内所包括的词汇容量从少到多。

例如,用户语音的音量特征为2分,语速特征的语速特征为3分,用户语速较慢且音量较小,表明用户处于不方便大声说话的场景,如开会场景。

根据音量特征为2分以及语速特征为3分的语音节奏特征,得到目标输出节奏,目标输出音量可以为1分至3分,目标输出语速可以为3分至4分,智能设备同样以较慢的语速以及较小的音量输出目标应答信息,避免影响该场景下的其他用户。

相关技术中,反馈信息的音量语速等节奏是预先设置的,在开会或上课等不方便大声说话的场景下,还是以较大的音量或较快的语速输出反馈信息,会影响到该场景下的其他用户,降低用户的使用体验。

本发明实施例根据语音节奏特征得到对应的目标输出节奏,在实现用户与智能设备情感化的交互的同时,还能避免影响到其他用户。

再例如,用户语音的音量特征为8分,语速特征的语速特征为6分,用户语速较快且音量较大,表明用户处于较为嘈杂的场景,如菜市场买菜场景。

根据音量特征为8分以及语速特征为6分的语音节奏特征,得到目标输出节奏,目标输出音量可以为7分至10分,目标输出语速可以为5分至7分,智能设备同样以较快的语速以及较大的音量输出目标应答信息,保证用户与智能设备间交互的有效性。

可以理解的是,目标输出节奏中目标输出音量和目标输出语速与语音节奏特征中音量特征和语速特征在一定范围内匹配即可,无需完全相同。

在一些实施例中,步骤150输出的目标应答信息包括应答内容信息和应答表情图像210。

目标应答信息的输出的表现形式包括目标应答信息在智能设备上的语音输出以及在智能设备显示屏上的显示。

在该实施例中,扬声器播放和显示屏显示的目标应答信息可以从用户意图和情绪状态两个方向对用户进行反馈应答。

显示屏显示的应答表情图像210是基于情绪状态对用户的反馈应答,与用户情绪特征相关。

在实际执行中,应答表情图像210可以为emoji表情图像、符号表情图像和卡通信息表情图像等表情图像。

例如,如图2所示,用户与智能设备交互时,用户说出“我有点难过”且眉头微皱,智能设备判定用户意图特征为寻求安慰的用户意图和轻微悲伤的情绪状态。

输出的应答表情图像210为代表安抚emoji表情图像,以匹配用户轻微悲伤的情绪状态。

显示屏显示的应答内容信息包括应答图像230和应答文本220,应答内容信息是基于用户意图对用户的反馈应答。

例如,用户与智能设备交互时,用户说出“今天一天累死了,总算下班了”且眉毛上扬,智能设备判定用户意图特征是分享喜悦。

可以输出的应答表情图像210为代表开心emoji表情图像,以匹配用户轻松喜悦的情绪状态。

同时可以输出应答文本220为“完成工作任务了,真不错呀,需要吃点东西补充能量吗”以满足分享喜悦的用户意图以及带有推荐食物的应答图像230以满足用户意图。

再例如,如图3所示,用户与智能设备交互时,用户说出“外面下雨了吗”,智能设备可以同时可以输出为“正在下大雨”的应答文本220以及带有实景下雨图像的应答图像230以满足询问天气的用户意图。

智能设备通过输出应答内容信息和应答表情图像210,在保证用户与智能设备交互有效性的基础上,从用户意图和情绪状态两个方向对用户进行反馈应答,提高用户的使用体验。

在一些实施例中,步骤130包括:对用户语音识别的识别文本以及用户图像进行情绪识别,得到对应的文本情绪特征和图像情绪特征,根据图像情绪特征和文本情绪特征,得到用户情绪特征。

其中,基于识别文本的情绪识别是针对识别文本中词语情感情绪的识别。

在实际执行中,针对识别文本的情绪识别,可以分为基于知识库的分析、基于网络的分析和基于语料库的分析。

对识别文本的文本信息中词语或句子的情感进行识别时,可以创建会包含一些情感符号、缩写、情感词获修饰词的情感数据库。

在情感数据库中定义词语或句子对应的情感,例如,生气、憎恨、害怕、内疚、感兴趣、高兴或悲伤等。

可以通过对识别文本的情感分类,标注识别文本对应的情感类别及对应的情感强度,得到对应的文本情绪特征。

文本情绪特征可以表现为对应的情感类别及对应的情感强度的评分,例如,得到的情感类别及情感强度依次为悲观、失落、消极、一般、快乐、惊喜和兴奋,文本情绪特征对应的评分依次为0分到10分,数值越高代表情绪越正向。

在实际执行中,针对用户图像的情绪识别,包括对用户产生的面部表情或肢体动作的情绪识别。

以面部表情的情绪识别为例,可以通过用户图像的人脸区域上对表情信息进行特征提取,获得面部表情的情绪识别结果,表情特征提取的方法可以为主成分分析法、局部二值模式以及一些其他基于运动和形变的特征提取方法。

同样,可以通过对用户图像中面部表情或肢体动作所代表的情绪进行情感分类,并标注对应的情感强度,得到对应的图像情绪特征。

图像情绪特征同样可以表现为对应的情感类别及情感强度的评分,例如,面部表情或肢体动作所代表的情感类别及情感强度依次为悲观、失落、消极、一般、快乐、惊喜和兴奋,图像情绪特征对应的评分依次为0分到10分,数值越高代表情绪越正向。

在该实施例中,基于图像情绪特征和文本情绪特征,得到的用户情绪特征也可以表现为对应的情感类别及情感强度的评分。

在一些实施例中,可以通过对图像情绪特征和文本情绪特征进行加权处理,得到对应的用户情绪特征。

图像情绪特征的权重值和文本情绪特征的权重值,根据不同的应用场景可以进行设置。

例如,在光线较好且拾音较好的场景中,可以将图像情绪特征的权重值设置为0.4,文本情绪特征的权重值均设置为0.6,以识别文本的文本语义作为情绪识别重点。

在无法准确获取到用户图像的场景下,将图像情绪特征的权重值设置为较小的0.3,文本情绪特征的权重值设置为0.7。

在无法准确获取到用户语音的场景下,将图像情绪特征的权重值设置为较大的0.7,文本情绪特征的权重值设置为0.3。

例如,用户面带微笑与智能设备进行交互,用户说出“今天一天累死了,总算下班了”,微笑对应图像情绪特征分值为6分,文本情绪特征为5分,根据图像情绪特征和文本情绪特征的权重值分别为0.4和0.6,得到用户情绪特征为5.4分。

在一些实施例中,还可以结合用户上一次与智能设备进行交互的用户历史情绪特征进行情绪识别,得到当前交互下更加准确的用户情绪特征。

在该实施例中,基于用户历史情绪特征、识别文本和用户图像,进行情绪识别,得到用户情绪特征。

可以理解的是,用户在与智能设备进行交互时,情绪具有连贯性,基于上一次交互所得到的用户历史情绪特征,对识别文本和用户图像识别到的对应的情绪特征进行更加准确的判断,得到的用户情绪特征的准确度更高。

在一些实施例中,对识别文本和用户图像进行情绪识别,分别得到文本情绪特征和图像情绪特征,再根据上一次交互的用户历史情绪特征、本次交互的文本情绪特征和本次交互的图像情绪特征三个情绪特征的权重,进行加权处理,得到用于本次应答的用户情绪特征。

例如,用户与智能设备进行交互,获取的用户上一次与智能设备交互的用户历史情绪特征分值为6分,属于较为积极的情绪特征。

在用户与智能设备的本次交互过程中,用户本次面带微笑说出“今天一天累死了,总算下班了”。

微笑对应图像情绪特征分值为6分,本次说的“今天一天累死了,总算下班了”文本对应文本情绪特征为4分,上一次的用户历史情绪特征分值为6分。

用户历史情绪特征、文本情绪特征和图像情绪特征分别对应的权重值为0.1、0.5和0.4,得到的用户情绪特征=0.5*4+0.1*6+0.4*6=5分。

本次交互的用户情绪特征的分值为5分,用户所会说出的“今天一天累死了,总算下班了”属于较为积极的情绪特征。

本发明实施例通过图像情绪特征和文本情绪特征结合上一交互的用户历史情绪特征进行综合判断,能够更准确地进行情绪识别。

在一些实施例中,还可以结合用户上一次与智能设备进行交互的历史文本情绪特征,分析得到用户情绪特征。

在该实施例中,基于历史文本情绪特征、文本情绪特征和图像情绪特征,得到用户情绪特征,该用户情绪特征是与之前的交互是连贯的,所得到的用户情绪特征的准确度更高。

例如,用户与智能设备交互时,用户说出“今天一天累死了,总算下班了”且嘴角微微上扬,智能设备根据上一次与智能设备进行交互时,说出的历史识别文本为“哈哈”,判断历史文本情绪特征为喜悦。

基于历史文本情绪特征、文本情绪特征和图像情绪特征,智能设备判定用户情绪特征为轻松喜悦,并输出对应的目标应答信息。

需要说明的是,历史文本情绪特征是用户上一次与智能设备进行交互所产生的语音对应的,与本次交互属于同一交互阶段,智能设备初次开启交互时,没有对应的历史文本情绪特征。

可以理解的是,基于历史文本情绪特征、文本情绪特征和图像情绪特征,可以准确识别得到当前交互阶段的用户情绪特征。

在一些实施例中,获取历史文本情绪特征对应的权重值,基于历史文本情绪特征、文本情绪特征和图像情绪特征各自对应的权重值,进行加权处理得到用户情绪特征。

在该实施例中,历史文本情绪特征可以作为用户情绪识别的基础,文本情绪特征和图像情绪特征是用户情绪识别的重要特征向量,历史文本情绪特征对应的权重值小于图像情绪特征和文本情绪特征的权重值。

例如,用户与智能设备进行交互,上一次说的“哈哈”,本次面带微笑说出“今天一天累死了,总算下班了”。

微笑对应图像情绪特征分值为6分,本次说的“今天一天累死了,总算下班了”文本对应文本情绪特征为4分,上一说的“哈哈”表示喜悦对应历史文本情绪特征为6分。

历史文本情绪特征、文本情绪特征和图像情绪特征分别对应的权重值为0.1、0.5和0.4,得到的用户情绪特征=0.5*4+0.1*6+0.4*6=5分。

本发明实施例通过图像情绪特征和文本情绪特征结合上一交互的历史文本情绪特征进行综合判断,能够更准确地进行情绪识别。

下面对本发明实施例提供的智能设备的交互装置进行描述,下文描述的智能设备的交互装置与上文描述的智能设备的交互方法可相互对应参照。

如图4所示,本发明实施例提供的智能设备的交互装置包括:

获取模块410,用于获取用户语音和用户图像;

第一处理模块420,用于对用户语音进行语音识别,得到识别文本;

第二处理模块430,用于对识别文本和用户图像进行情绪识别,得到用户情绪特征;

第三处理模块440,用于基于用户情绪特征和识别文本,得到用户意图特征;

输出模块450,用于基于用户意图特征,输出目标应答信息。

根据本发明实施例提供的智能设备的交互装置,通过结合识别文本和用户情绪特征,得到更加准确的用户意图特征,基于用户意图特征输出对应的目标应答信息,实现用户与智能设备间情感化的交互,提升用户的使用体验。

在一些实施例中,第一处理模块420还用于从用户语音提取语音节奏特征;输出模块450,还用于基于用户意图特征和语音节奏特征,输出目标应答信息。

在一些实施例中,语音节奏特征包括用户音量特征和用户语速特征中的至少一个。

在一些实施例中,输出模块450还用于基于用户意图特征,得到目标应答信息,并基于语音节奏特征,得到目标输出节奏;并按目标输出节奏输出目标应答信息。

在一些实施例中,目标应答信息包括应答表情图像和应答内容信息;其中,应答内容信息包括应答文本和应答图像。

在一些实施例中,第二处理模块430,用于对识别文本进行情绪识别,得到文本情绪特征;对用户图像进行情绪识别,得到图像情绪特征;基于文本情绪特征和图像情绪特征,得到用户情绪特征。

在一些实施例中,第二处理模块430,用于获取文本情绪特征和图像情绪特征的权重值;将文本情绪特征和图像情绪特征按各自的权重值进行加权处理,得到用户情绪特征。

在一些实施例中,第二处理模块430,用于获取用户与智能设备上一次交互的用户历史情绪特征;基于所述识别文本、所述用户图像和所述用户历史情绪特征,得到所述用户情绪特征。

在一些实施例中,第二处理模块430,用于基于所述识别文本和所述用户图像,得到文本情绪特征和图像情绪特征;

获取所述文本情绪特征、所述图像情绪特征和所述用户历史情绪特征的权重值;

将所述文本情绪特征、所述图像情绪特征和所述用户历史情绪特征各自的权重值进行加权处理,得到所述用户情绪特征。

在一些实施例中,第二处理模块430,用于获取用户与智能设备上一次交互的历史文本情绪特征;基于文本情绪特征、图像情绪特征和历史文本情绪特征,得到用户情绪特征。

在一些实施例中,第二处理模块430,用于获取文本情绪特征、图像情绪特征和历史文本情绪特征的权重值;

将文本情绪特征、图像情绪特征和历史文本情绪特征按各自的权重值进行加权处理,得到用户情绪特征。

本发明实施例提供还提供一种智能设备,该智能设备包括上文描述的智能设备的交互装置。

在本发明实施例中,智能设备可以为智能家居设备、智能穿戴设备、手机、平板、计算机或机器人等智能设备。

其中,智能家居设备包括但不限于冰箱、空调、洗衣机、热水器、微波炉、烹饪设备等家居设备。

智能设备上可以设置摄像头采集用户图像,设置麦克风拾取用户语音,并将用户图像和用户语音输送给智能设备的交互装置,以供智能设备的交互装置进行处理,得到并输出目标应答信息,并通过设置的显示屏和扬声器显示或输出该目标应答信息。

根据实施例提供的智能设备,通过结合识别文本和用户情绪特征,得到更加准确的用户意图特征,基于用户意图特征输出对应的目标应答信息,实现用户与智能设备间情感化的交互,提升用户的使用体验。

图5示例了一种电子设备的实体结构示意图,如图5所示,该电子设备可以包括:处理器(processor)510、通信接口(Communications Interface)520、存储器(memory)530和通信总线540,其中,处理器510,通信接口520,存储器530通过通信总线540完成相互间的通信。处理器510可以调用存储器530中的逻辑指令,以执行智能设备的交互方法,该方法包括:获取用户语音和用户图像;对用户语音进行语音识别,得到识别文本;对识别文本和用户图像进行情绪识别,得到用户情绪特征;基于用户情绪特征和识别文本,得到用户意图特征;基于用户意图特征,输出目标应答信息。

此外,上述的存储器530中的逻辑指令可以通过软件功能单元的形式实现并作为独立的产品销售或使用时,可以存储在一个计算机可读取存储介质中。基于这样的理解,本发明的技术方案本质上或者说对现有技术做出贡献的部分或者该技术方案的部分可以以软件产品的形式体现出来,该计算机软件产品存储在一个存储介质中,包括若干指令用以使得一台计算机设备(可以是个人计算机,服务器,或者网络设备等)执行本发明各个实施例所述方法的全部或部分步骤。而前述的存储介质包括:U盘、移动硬盘、只读存储器(ROM,Read-Only Memory)、随机存取存储器(RAM,Random Access Memory)、磁碟或者光盘等各种可以存储程序代码的介质。

进一步地,本发明还提供一种计算机程序产品,所述计算机程序产品包括计算机程序,计算机程序可存储在非暂态计算机可读存储介质上,所述计算机程序被处理器执行时,计算机能够执行上述各方法实施例所提供的智能设备的交互方法,该方法包括:获取用户语音和用户图像;对用户语音进行语音识别,得到识别文本;对识别文本和用户图像进行情绪识别,得到用户情绪特征;基于用户情绪特征和识别文本,得到用户意图特征;基于用户意图特征,输出目标应答信息。

另一方面,本发明实施例还提供一种非暂态计算机可读存储介质,其上存储有计算机程序,该计算机程序被处理器执行时实现以执行上述各实施例提供的智能设备的交互方法,该方法包括:获取用户语音和用户图像;对用户语音进行语音识别,得到识别文本;对识别文本和用户图像进行情绪识别,得到用户情绪特征;基于用户情绪特征和识别文本,得到用户意图特征;基于用户意图特征,输出目标应答信息。

以上所描述的装置实施例仅仅是示意性的,其中所述作为分离部件说明的单元可以是或者也可以不是物理上分开的,作为单元显示的部件可以是或者也可以不是物理单元,即可以位于一个地方,或者也可以分布到多个网络单元上。可以根据实际的需要选择其中的部分或者全部模块来实现本实施例方案的目的。本领域普通技术人员在不付出创造性的劳动的情况下,即可以理解并实施。

通过以上的实施方式的描述,本领域的技术人员可以清楚地了解到各实施方式可借助软件加必需的通用硬件平台的方式来实现,当然也可以通过硬件。基于这样的理解,上述技术方案本质上或者说对现有技术做出贡献的部分可以以软件产品的形式体现出来,该计算机软件产品可以存储在计算机可读存储介质中,如ROM/RAM、磁碟、光盘等,包括若干指令用以使得一台计算机设备(可以是个人计算机,服务器,或者网络设备等)执行各个实施例或者实施例的某些部分所述的方法。

最后应说明的是:以上实施例仅用以说明本发明的技术方案,而非对其限制;尽管参照前述实施例对本发明进行了详细的说明,本领域的普通技术人员应当理解:其依然可以对前述各实施例所记载的技术方案进行修改,或者对其中部分技术特征进行等同替换;而这些修改或者替换,并不使相应技术方案的本质脱离本发明各实施例技术方案的精神和范围。

以上实施方式仅用于说明本发明,而非对本发明的限制。尽管参照实施例对本发明进行了详细说明,本领域的普通技术人员应当理解,对本发明的技术方案进行各种组合、修改或者等同替换,都不脱离本发明技术方案的精神和范围,均应涵盖在本发明的权利要求范围中。

- 一种智能设备的学习交互方法及智能设备

- 智能设备的交互方法、装置、智能设备和存储介质

- 交互方法、交互装置、电子设备及存储介质

- 一种智能设备及其投影交互方法

- 智能设备交互系统和智能设备交互方法

- 一种智能设备语音交互方法、装置、电子设备及存储介质