穿戴式计算机多通道人机交互方法、装置、设备及系统

文献发布时间:2023-06-19 11:05:16

技术领域

本发明涉及穿戴式计算机人机交互技术领域,具体涉及一种穿戴式计算机多通道人机交互方法、装置、设备及系统。

背景技术

穿戴式计算机是一种可穿戴于用户身上的便携式计算设备,具有微型化、可携带、重量轻、移动性强等特点,由多台穿戴式计算机构成的穿戴式计算体系可以极大地提高使用者及其团队的信息处理能力,增强团队协作完成任务的能力。

可穿戴设备的传统人机交互设备通常仅包括耳机或扬声器用于输出语音,支持的人机交互方式比较单一,无法满足不同场景下多样化的输出需求。

发明内容

本发明解决的问题是传统人机交互形式单一,无法满足不同场景下多样化的输出需求。

为解决上述问题,本发明提供一种穿戴式计算机多通道人机交互方法,包括:

当检测到待输出内容时,获取当前的状态数据,其中,所述状态数据包含环境类型状态和用户类型状态,所述环境类型状态和所述用户类型状态均可划分为一个或多个维度;

获取所述状态数据与输出通道之间的适配关系数据;

根据所述当前的状态数据,结合所述适配关系数据,确定目标输出通道;

将所述待输出内容从所述目标输出通道输出。

可选地,所述适配关系数据包含单一维度与输出通道间的适配关系和维度组合与输出通道间的适配关系,所述根据所述当前的状态数据,结合所述适配关系数据,确定目标输出通道包括:

获取所述当前的状态数据中,所述单一维度和所述维度组合各自适配的输出通道;

根据所述单一维度和所述维度组合各自适配的输出通道,确定所述当前的状态数据适配的输出通道;

从所述当前的状态数据适配的输出通道中确定一个或多个输出通道作为所述目标输出通道。

可选地,所述穿戴式计算机多通道人机交互方法还包括:

当检测到用户输入的交互信息时,基于所述交互信息来源的输入通道,确定所述交互信息对应的预设指令集,其中,语音输入通道对应语音指令集、手势输入通道对应手势指令集、文字输入通道对应文字指令集;

将所述交互信息与其对应的预设指令集进行匹配,确定与所述交互信息匹配的交互指令;

当所述交互指令为非文字指令时,获取所述非文字指令与文字指令间的对应关系,根据所述非文字指令与文字指令间的对应关系,将所述交互指令转换为相应的文字指令。

可选地,所述根据所述非文字指令与文字指令间的对应关系,将所述交互指令转换为相应的文字指令之后,还包括:

当所述相应的文字指令为应用操作指令时,根据所述相应的文字指令对相应的应用程序执行相应控制;

当所述相应的文字指令为团队协作任务指令时,将所述相应的文字指令发送至指定的计算机设备。

可选地,所述待输出内容为应用程序的输出信息或者其他计算机设备发送的文字指令。

可选地,所述穿戴式计算机多通道人机交互方法还包括:

当所述穿戴式计算机处于第一预设模式时,执行所述当检测到待输出内容时,获取当前的状态数据的步骤;

当所述穿戴式计算机处于第二预设模式时,在检测到所述待输出内容时,获取当前的预设输出模式,根据所述当前的预设输出模式确定所述目标输出通道,将所述待输出内容从所述目标输出通道输出。

可选地,所述根据所述非文字指令与文字指令间的对应关系,将所述交互指令转换为相应的文字指令之后,还包括:

将所述相应的文字指令转化为交互原语,其中,所述交互原语包含所述相应的文字指令对应的交互信息的检测时间;

从所述交互原语中提取任务信息,构建最终任务指令;

基于所述最终任务指令控制相应的应用程序执行相应操作,或者,将所述最终任务指令发送至指定的计算机设备。

本发明还提出一种穿戴式计算机多通道人机交互装置,包括:交互输入模块、交互输出模块、多通道指令识别模块、团队任务指令交互模块、处理器模块、数据库以及系统应用程序;

所以交互输入模块包含多个输入通道,用于接收用户输入的交互信息;

所述交互输出模块包含多个输出通道,用于输出待输出内容;

所述多通道指令识别模块,用于识别所述用户输入的交互信息;

所述团队任务指令交互模块,用于与其他计算机设备进行信息交互;

所述数据库用于存储预设指令集;

所述处理器模块用于当检测到待输出内容时,获取当前的状态数据,其中,所述状态数据包含环境类型状态和用户类型状态,所述环境类型状态和所述用户类型状态均可划分为一个或多个维度;获取所述状态数据与输出通道之间的适配关系数据;根据所述当前的状态数据,结合所述适配关系数据,确定目标输出通道;

所述交互输出模块还用于将所述待输出内容从所述目标输出通道输出。

本发明还提出一种穿戴式计算机设备,包括存储有计算机程序的计算机可读存储介质和处理器,所述计算机程序被所述处理器读取并运行时,实现如上任一项所述的穿戴式计算机多通道人机交互方法。

本发明还提出一种穿戴式计算机系统,包括多个如上所述的穿戴式计算机多通道人机交互装置或多个如上所述的穿戴式计算机设备。

相对于现有技术,本发明通过采集当前的状态数据,基于状态数据与输出通道的适配关系,确定与当前的状态数据适配的目标输出通道,将待输出内容从目标输出通道输出,其充分考虑了本设备当前的环境状态数据和用户状态数据,可确定与当前状态最相适应的输出方式,适应不同应用场景下的人机交互需求,提高穿戴式设备的智能性,提高人机交互效率。

附图说明

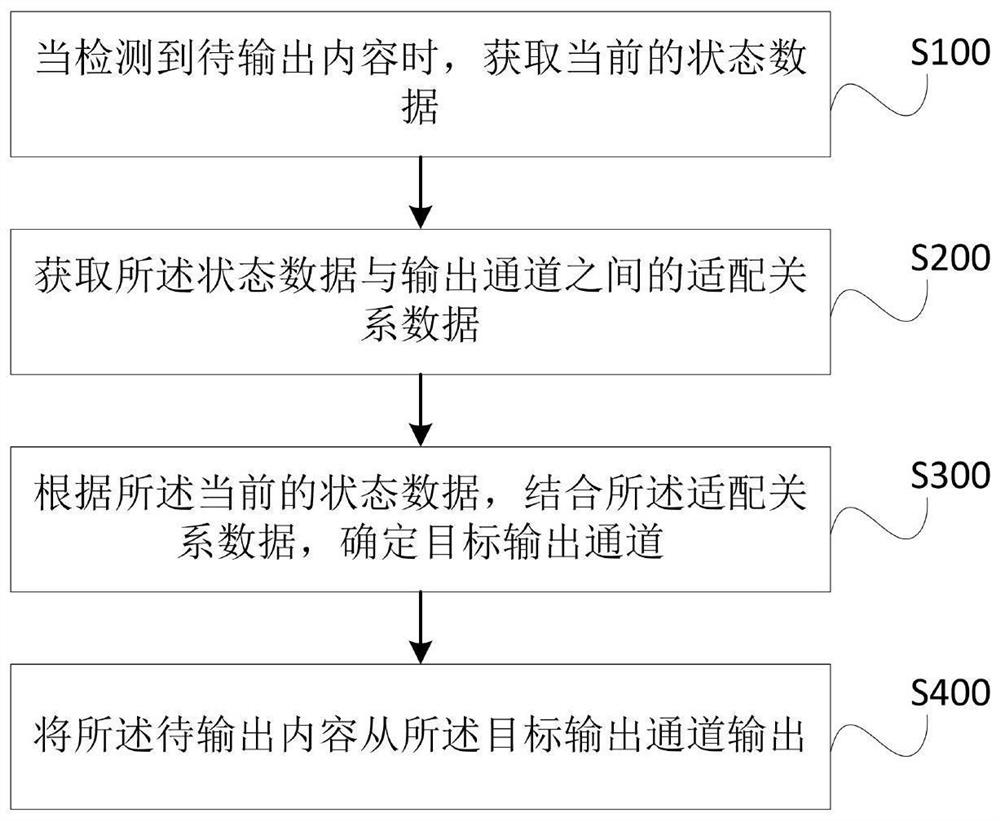

图1为本发明穿戴式计算机多通道人机交互方法一实施例的流程示意图;

图2为本发明穿戴式计算机多通道人机交互方法另一实施例的流程示意图;

图3为本发明穿戴式计算机多通道人机交互装置结构示意图;

图4为本发明穿戴式计算机系统的示意图;

图5为本发明穿戴式计算机设备的示意图。

具体实施方式

为使本发明的上述目的、特征和优点能够更为明显易懂,下面结合附图对本发明的具体实施例做详细的说明。

本发明提供了一种穿戴式计算机多通道人机交互方法、一种穿戴式计算机多通道人机交互装置、一种穿戴式计算机设备及一种穿戴式计算机系统,支持多通道人机交互信息的输入输出,可解放用户的双手及双目,对于军事、公安、消防、救灾等应用领域的用户,可以在不影响用户执行任务的同时,灵活便利地完成交互信息的输入及输出。以下分别进行详细说明。

需要说明的是:本文中所涉及的穿戴式计算机包括但不限于:手环、脚环、腕表、眼镜、耳机、挂饰、融合到衣服/裤子/鞋子/袜子/头盔/帽子中的电子设备,以及上述两项或两项以上的组合等。本文中所指的用户,根据穿戴式计算机应用场景的不同而不同,例如,当其应用场景为军事场景时,用户包含士兵。

请参阅图1,图1为本发明提供的一种穿戴式计算机多通道人机交互方法一实施例的流程示意图。需要说明的是,该方法所包含的以下步骤的执行主体为穿戴式计算机多通道人机交互装置,或者穿戴式计算机设备,或者穿戴式计算机设备中的处理器,如CPU(英文全称:Central Processing Unit),为便于描述,在下文中以穿戴式计算机设备作为主体进行描述。

所述穿戴式计算机多通道人机交互方法包括:

步骤S100,当检测到待输出内容时,获取当前的状态数据,其中,所述状态数据包含环境类型状态和用户类型状态,所述环境类型状态和所述用户类型状态均可划分为一个或多个维度。

待输出内容为应用程序的输出信息或者其他计算机设备发送的文字指令。此处的应用程序指本设备装载的系统应用程序,例如,本设备装载了地图应用程序,地图应用程序输出的本设备的定位信息即属于此处的待输出内容。此处的其他计算机设备可以是其他穿戴式计算机设备或者其他非穿戴式计算机。可选地,待输出内容还可为其他计算机设备发送的非指令信息,如定位信息、图片信息、声音信息等。

状态数据,用于确定目标输出通道,其包括环境类型状态和用户类型状态,环境类型状态指影响输出通道选择的环境因素,包含但不限于以下至少一个维度:任务类型维度、位置类型维度、时间维度、光线维度等;用户类型状态指影响输出通道选择的用户因素,包含但不限于以下至少一个维度:用户体征状态维度和/或用户距离维度等,此处的用户体征状态维度指用户体征状态数据,如心率数据,用户距离维度指用户与本设备的距离。

其中,环境类型状态包含一个或多个维度,用户类型状态包含一个或多个维度。

步骤S200,获取所述状态数据与输出通道之间的适配关系数据。

可预设所有状态数据与输出通道之间的适配关系,具体可预设所有维度的状态数据与输出通道之间的适配关系。状态数据与在该状态数据对应状态下可用的输出通道适配。以时间维度为例,当前时间为夜晚时,可用的输出通道为语音输出通道,则“夜晚”这一时间维度的数据与语音输出通道适配。

步骤S300,根据所述当前的状态数据,结合所述适配关系数据,确定目标输出通道。

基于当前的状态数据和适配关系数据,可确定在当前的状态数据下可用的输出通道,将该可用的输出通道中的一个或多个作为目标输出通道。

当前的状态数据中,可能有多个维度的状态数据,而不同维度对显示屏通道,语音通道等输出通道均进行一定控制,例如,在“夜晚”这一时间维度下,语音输出通道开启,显示屏输出通道关闭。

步骤S400,将所述待输出内容从所述目标输出通道输出。

在确定好目标输出通道后,将待输出内容转换成目标输出通道对应的形式输出,例如,当目标输出通道为语音通道时,将待输出内容转换成语音信息后从语音通道输出,当目标输出通道为显示屏通道时,将待输出内容转换成文字信息后从显示屏通道输出。

本发明通过采集当前的状态数据,基于状态数据与输出通道的适配关系,确定与当前的状态数据适配的目标输出通道,将待输出内容从目标输出通道输出,其充分考虑了本设备当前的环境状态数据和用户状态数据,可确定与当前状态最相适应的输出方式,适应不同应用场景下的人机交互需求,提高穿戴式设备的智能性,提高人机交互效率。

可选地,所述适配关系数据包含单一维度与输出通道间的适配关系和维度组合与输出通道间的适配关系,步骤S300包括:

步骤S301,获取所述当前的状态数据中,所述单一维度和所述维度组合各自适配的输出通道。

环境类型状态可包含任务类型维度、位置类型维度、时间维度、光线维度等,用户类型状态可包含用户体征状态维度和/或用户距离维度等。

其中,任务类型维度指本设备执行的任务类型,可预设不同任务类型对应的可用的输出通道,此处任务类型对应的可用的输出通道即与该任务类型适配的输出通道。一实施方式中,任务类型包含区域清剿任务,协同侦察任务,城市接力跟踪任务,引导装拆任务,其中,区域清剿任务对应的可用的输出通道包含语音输出通道,协同侦察任务对应的可用的输出通道包含语音输出通道和显示屏输出通道,城市接力跟踪任务对应的可用的输出通道包含语音输出通道、显示屏输出通道、增强现实输出通道,引导装拆任务对应的可用的输出通道包含语音输出通道、显示屏输出通道。

位置类型维度指本设备所处的位置类型,例如,敌方阵营、我方阵营,又或者是着火场等特殊位置。其中,敌方阵营关闭语音输出通道或者显示屏输出通道,我方阵营开启所有输出通道,着火场关闭显示屏输出通道,开启语音输出通道。

时间维度指当前的时间,可以划分为白天、黑夜,也可以划分为具体的时间段。

光线维度指当前环境的光线强度,当光线强度较低时,关闭显示屏输出通道,开启语音输出通道;当光线强度较高时,开启所有输出通道。

用户体征状态维度,采集用户体征状态数据,如体温、脉搏、呼吸、血压、心率等体征数据,根据用户体征状态数据判断用户是否处于异常状态,例如当检测到体温低于预设温度值时,说明用户处于异常状态,当用户处于异常状态时,将异常信息向上通报,以提示上级人员存在异常,由上级人员核实相应用户的状态,可由上级人员控制存在异常的相应用户设备的输入通道、输出通道的开启与关闭。

用户距离维度,当用户距离本设备较远时,可将这一异常向上通报,提示上级人员存在异常,由上级人员核实相应用户的状态,可由上级人员控制存在异常的相应用户设备的输入通道、输出通道的开启与关闭,也可当用户距离本设备较远距离且持续时长大于预设时长时,关闭该套设备的信息输出。

此处的单一维度即单个维度,维度组合即多个维度的组合。某些单一维度就可确定其适配的输出通道,而某些单一维度需与其他维度组合才能确定适配的输出通道。例如,时间维度这个单一维度,不结合其他维度,不确定任务类型、位置及光线等,无法确定是否能使用发光的显示屏输出通道,即无法确定适配的输出通道,假设在敌人阵营执行协同侦察任务,时间为黑夜,光线很暗,综合该多个维度的信息即可确定此时应关闭显示屏输出通道,开启语音输出通道。

通过上述分析可知,并非每个单一维度都有其适配的输出通道。

步骤S302,根据所述单一维度和所述维度组合各自适配的输出通道,确定所述当前的状态数据适配的输出通道。

可预设单一维度与输出通道间的适配关系和维度组合与输出通道间的适配关系,基于当前的状态数据中各个维度的状态数据,确定适配的输出通道,以此作为当前的状态数据适配的输出通道。

步骤S303,从所述当前的状态数据适配的输出通道中确定一个或多个输出通道作为所述目标输出通道。

可以将当前的状态数据适配的所有输出通道作为目标输出通道,也可以从当前的状态数据适配的所有输出通道中选取一个或多个作为目标输出通道。

为便于理解,以军事领域为例,通过任务类型维度,位置类型维度,时间维度,安全属性维度,使用者状态维度等五个维度对输入输出通道进行控制。当任务类型为:协同侦察任务,位置为:敌人阵营,时间为:黑夜,安全属性为:危险,使用者状态为:健康,则组合这五个维度信息,得到对通道的控制:关闭文字、触屏输入通道;关闭显示屏输出通道(因为处于侦察任务,且处于黑夜危险状态,又处于敌人阵营,亮屏易暴露己方)。

通过从当前的状态数据中,分别获取单一维度和维度组合各自适配的输出通道,确定所述当前的状态数据适配的输出通道,再从中确定目标输出通道,以使目标输出通道与本设备当前的状态数据最相适应,可自动适应不同应用场景下的人机交互需求,提高穿戴式设备的智能性,提高人机交互效率。

可选地,所述穿戴式计算机多通道人机交互方法还包括:

步骤S500,当检测到用户输入的交互信息时,基于所述交互信息来源的输入通道,确定所述交互信息对应的预设指令集,其中,语音输入通道对应语音指令集、手势输入通道对应手势指令集、文字输入通道对应文字指令集。

用户通过多种方式与穿戴式计算机进行人机交互,如语音、手势、按键等。穿戴式计算机检测到用户输入的交互信息时,首先对用户输入的交互信息进行解码识别,具体而言,通过该交互信息来源的输入通道确定其表现形式,进而确定该交互信息对应的预设指令集,当交互信息来源于语音输出通道时,说明交互信息为语音信息,其对应语音指令集,当交互信息来源于手势输入通道时,说明交互信息为手势,其对应手势指令集,当交互信息来源于文字输入通道时,说明交互信息为文字,其对应文字指令集。

本实施例仅以语音输入通道、手势输入通道及文字输入通道为例,本发明包含但不限于该三个通道。

步骤S600,将所述交互信息与其对应的预设指令集进行匹配,确定与所述交互信息匹配的交互指令。

当交互信息为文字信息时,将其与文字指令集匹配,得到对应的文字形式的交互指令;当交互信息为语音信息时,将其与语音指令集匹配,得到对应的语音形式的交互指令;当交互信息为手势信息时,将其与手势指令集匹配,得到对应的手势形式的交互指令。

步骤S700,当所述交互指令为非文字指令时,获取所述非文字指令与文字指令间的对应关系,根据所述非文字指令与文字指令间的对应关系,将所述交互指令转换为相应的文字指令。

当交互指令为文字指令时,直接基于该文字指令确定指令作用对象,进行应用操作或者发送至其他计算机设备。

当交互指令为语音指令或者手势指令等非文字指令时,将该语音指令或者手势指令转换成相应的文字指令。预设指令数据库,存储语音指令与文字指令、手势指令与文字指令的对应关系,查询指令数据库,查询到语音指令、手势指令对应的文字指令,完成指令转换。

由此,将从各种输入通道得到的信息的格式进行统一化处理,制定统一标准,有利用信息共享及方便团队开发,此外,将语音指令、手势指令转换为文字指令,可减少数据传输量,实现信息的快速传输,保证信息交互的实时性。

可选地,步骤S700之后包括:

步骤S800,当所述相应的文字指令为应用操作指令时,根据所述相应的文字指令对相应的应用程序执行相应控制。

步骤S900,当所述相应的文字指令为团队协作任务指令时,将所述相应的文字指令发送至指定的计算机设备。

本设备中的交互指令,可包含两种类型的指令:应用操作指令和团队协作任务指令。

其中,应用操作指令即对本设备装载的应用程序进行控制的指令,本设备可装载如地图及导航软件、人体生理状态监控软件、人体动作监控软件或照相摄像软件等应用程序。例如,本设备装载了照相摄像软件,则应用操作指令可为拍照指令、摄像指令。

团队协作任务指令,指传输至其他计算机设备(主要是其他穿戴式计算机设备)以实现团队协作的指令。例如,团队协作任务指令可为“搜索”、“运送伤者”、“前往某个位置”等。指定的计算机设备,可基于相应的文字指令确定指定的计算机设备,也可基于预先建立的通信通道确定指定的计算机设备,例如,用户在输入团队协作任务指令时,选定特定的计算机设备发送,则直接基于用户输入的交互信息确定指定的计算机设备;又例如,在团队协作中,不同计算机设备具有不同地位,如组长与组员、队长与队员,队员的信息默认以队长的计算机设备为指定的计算机设备,队长的信息需由队长指定后确定指定的计算机设备。

可选取军事、公安、消防、救灾等作为典型应用领域,为典型应用领域中的典型交互任务构建应用操作指令集、团队协作任务指令集,此处可仅构建文字形式的应用操作指令集、团队协作任务指令集。

通过对所述交互指令相应的文字指令的类型进行判别,实现信息的准确传输和设备的准确控制,丰富本设备的功能的多样性。

可选地,所述穿戴式计算机多通道人机交互方法还包括:

当所述穿戴式计算机处于第一预设模式时,执行步骤S100至步骤S400。

当所述穿戴式计算机处于第二预设模式时,在检测到所述待输出内容时,获取当前的预设输出模式,根据所述当前的预设输出模式确定所述目标输出通道,将所述待输出内容从所述目标输出通道输出。

此处的穿戴式计算机即本设备,包含两种确定目标输出通道的模式,当穿戴式计算机处于第一预设模式时,执行步骤S100至步骤S400,即基于当前的状态数据确定目标输出通道。

当穿戴式计算机处于第二预设模式时,目标输出通道基于当前的预设输出模式确定,预设输出模式对应不同的目标输出通道,一实施方式中,预设输出模式包含正常模式、静默模式、增强现实模式,正常模式下,待输出内容以文字形式显示在触控液晶屏上,即此模式下的目标输出通道为显示屏输出通道;静默模式下,待输出内容以语音形式输出至耳机,穿戴式计算机不亮屏,即此模式下的目标输出通道为语音输出通道;增强现实模式下,待输出内容以文字或图形的形式输出至增强现实眼镜,即此模式下的目标输出通道为增强现实输出通道。

第一预设模式和第二预设模式可人为设置,由此,用户可基于实际的应用场景选择合适的预设模式进行目标输出通道的确定,进而增强穿戴式计算机的适应性,提高用户友好度。

可选地,所述穿戴式计算机多通道人机交互方法还包括:当检测到用户从多个通道输入的交互信息时,分别对各个通道的交互信息执行步骤S500-步骤S700所述的操作,进而得到各个通道相应的文字指令,基于各个通道相应的文字指令进行应用程序控制或将其传输至其他指定的计算机设备。

可选地,步骤S700之后还包括:将所述相应的文字指令转化为交互原语,其中,所述交互原语包含所述相应的文字指令对应的交互信息的检测时间;从所述交互原语中提取任务信息,构建最终任务指令;基于所述最终任务指令控制相应的应用程序执行相应操作,或者,将所述最终任务指令发送至指定的计算机设备。

一个最终任务指令可包含指令名称、指令对象、指令内容。指令名称可标识出该指令的指令类型,如应用操作指令、团队协作任务指令;指令对象指承受该指令的设备或装置;指令内容指该指令做的事情。以“拍照”指令为例,通过“拍照”这一名称可知该指令为应用操作指令,指令对象为:摄像头,指令内容:对摄像头目前对准的物体进行拍照。当检测到用户从多个通道输入的交互信息时,对用户从多通道输入的交互信息对应的指令进行融合处理,进而确定最终任务指令。

交互原语的具体表示形式可选为:数据信息;当前通道;时间标签。

在确定交互原语后,从交互原语中提取任务信息,构建最终任务指令,最终任务指令表示形式可选为:任务动作;任务对象;对象属性1,对象属性2...对象属性n。例如,当本设备用户需要将路线画给另一计算机设备时,可使用语音输入通道和触摸屏输入通道,其中语音输入通道用于指示“路线分享”任务开始,触摸屏输入通道用于输入路线坐标,语音输入通道的交互原语可以表示为(“路线分享”;语音通道;时间标签t),触摸屏输入通道的交互原语可以表示为路线的若干坐标点,例如,(起点坐标(x1,y1),终点坐标(x2,y2);触摸屏通道;时间标签t),最终任务指令表示为:路线分享;路线;起点坐标(x1,y1),终点坐标(x2,y2)。

其中,因多通道信息的输入时间间隔有可能较短,为避免信息混乱,造成最终任务指令出错的情况,通过在交互原语中设置时间标签,记录各个通道输入交互信息的时间,确保信息先后顺序的清晰,以确保最终任务指令的准确性。可选地,若交互原语中时间标签的差值大于预设阈值,则不属于一个任务指令。

可选地,当检测到用户从多个通道输入的交互信息时,对各个通道输入的交互信息转换成相应的文字指令,将各个通道相应的文字指令转换成交互原语,以时间顺序对交互原语进行任务信息提取,若提取出任务动作信息,则创建一新的最终任务指令,若提取出任务对象或者对象属性信息,则判断其是否归属于当前的最终任务指令,若是,则将其用于当前的最终任务指令的生成操作中,若不归属于当前的最终任务指令,则将其存储,用于判断是否归属于随后的最终任务指令。此处是否归属于某最终任务指令,通过时间标签的差值判断,当差值大于预设阈值时,则不属于该最终任务指令,若差值小于预设阈值,则归属于该最终任务指令。

为便于理解本发明,给出一实施例,图2为本实施例的一种穿戴式计算体系多通道人机交互方法的流程图,该方法包括步骤:

步骤一:根据穿戴机应用领域,选取典型交互任务构建多通道指令集。

步骤二:使用数据手套、麦克风、触摸屏、系统虚拟键盘等输入设备,构建穿戴式计算机使用者的手势、语音、触控、文字输入通道;使用耳机、触摸屏、增强现实眼镜等输出设备构建穿戴式计算机使用者的语音、文字、图形、图像等信息的输出通道。

步骤三:分别通过上述输入通道进行手势信息、语音信息、触控信息、文字信息等人机交互信息的输入。

步骤四:分别将上述通道的语音输入信息、手势输入信息、文字输入信息,与语音指令库、手势指令库、文字指令库的特征信息进行匹配,确定出其中包含的指令信息,例如指令名称、指令对象、指令内容;触控屏输入的触控信息,例如点击“发送照片”按钮、点击“地图应用”图标、点击“更新我的位置”按钮等操作,其可以直接确定相应的指令信息。

步骤五:将通过上述四通道输入的指令信息进行融合,如果能确定“指令名称”、“指令对象”、“指令内容”,组合成一条完整的人机交互指令,则将该指令作用于指定的系统应用或团队任务指令交互模块。

步骤六:如人机交互指令为典型应用操作指令,则穿戴计算机进行相应的操作处理。

步骤七:如指令为团队协作任务指令,则根据指令,确定指令传输的对象,并在指令接收者的穿戴式计算机设备上,以适合的呈现方式(即目标输出通道)进行任务指令显示。例如,接收者在危险的黑夜环境,采用语音方式输出指令,防止因夜间显示屏发光导致暴露己方目标。

本发明的有益效果是:1.本发明支持多通道人机交互信息的输入,能够解放用户的双手及双目,对于军事、公安、消防、救灾等应用领域的用户,可以在不影响用户执行任务的同时,灵活便利地完成交互信息的输入。2.本发明支持用户采用多通道协作方式输入交互指令,提高交互指令的输入效率,使用户能够针对特定信息选择最便捷方式进行输入。3.减轻人机交互的操作负荷,使团队能自然灵活的操作穿戴机、传达任务指令,提高使用穿戴式计算体系的团队的任务执行效率。

本发明提出一种穿戴式计算机多通道人机交互装置。如图3,包括:交互输入模块10、交互输出模块50、多通道指令识别模块20、团队任务指令交互模块40、处理器模块30、数据库21以及系统应用程序31。

所以交互输入模块10包含多个输入通道,用于接收用户输入的交互信息。输入通道包含文字输入通道、语音输入通道、触控屏输入通道、手势输入通道,可使用数据手套、麦克风、触控液晶屏、虚拟键盘等作为输入设备。

所述交互输出模块50包含多个输出通道,用于输出待输出内容。输出通道包含语音输出通道、显示屏输出通道及增强显示输出通道,可使用耳机、触控液晶屏、增强现实眼镜等作为输出设备。

所述多通道指令识别模块20,用于识别所述用户输入的交互信息,所述数据库21用于存储预设指令集,数据库21存储预先设计的语音指令集、手势指令集、文字指令集,其中,还存储有每个语音指令、手势指令及其对应的文字指令的对应关系,多通道指令识别模块20在识别用户输入的交互信息时,可调用数据库21中的指令。

所述团队任务指令交互模块40,用于与其他计算机设备进行信息交互,即向其他穿戴式计算机设备发送指令信息或者接收其他穿戴式计算机设备发送的指令信息。

根据应用领域确定穿戴式计算机装载的系统应用程序31,可包括地图及导航软件、人体生理状态监控软件、人体动作监控软件、照相摄像软件等。

所述处理器模块30用于当检测到待输出内容时,获取当前的状态数据,其中,所述状态数据包含环境类型状态和用户类型状态,所述环境类型状态和所述用户类型状态均可划分为一个或多个维度;获取所述状态数据与输出通道之间的适配关系数据;根据所述当前的状态数据,结合所述适配关系数据,确定目标输出通道;所述交互输出模块50还用于将所述待输出内容从所述目标输出通道输出。

本发明穿戴式计算机多通道人机交互装置相对于现有技术所具有的有益效果与上述穿戴式计算机多通道人机交互方法一致,此处不赘述。

本发明还提供一种穿戴式计算机设备。如图5,所述穿戴式计算机设备包括存储有计算机程序的计算机可读存储介质和处理器,所述计算机程序被所述处理器读取并运行时,实现如上所述的穿戴式计算机多通道人机交互方法。

本发明穿戴式计算机设备相对于现有技术所具有的有益效果与上述穿戴式计算机多通道人机交互方法一致,此处不赘述。

本发明还提供一种穿戴式计算机系统,如图4,包括多个穿戴式计算机多通道人机交互装置,或者包含多个如上所述的穿戴式计算机设备。多个穿戴式计算机设备经由无线自组网方式构成穿戴式计算机系统,供团队使用。

虽然本发明披露如上,但本发明的保护范围并非仅限于此。本领域技术人员在不脱离本发明公开的精神和范围的前提下,可进行各种变更与修改,这些变更与修改均将落入本发明的保护范围。

- 穿戴式计算机多通道人机交互方法、装置、设备及系统

- 人机交互系统数据库更新方法、装置、计算机设备和介质