技术领域

本申请涉及大数据的数据采集技术领域,尤其涉及一种基于爬虫的数据抓取方法、装置、计算机设备及存储介质。

背景技术

近些年,互联网已经逐步向大数据方向进行转移,在大数据环境下,数据的获取至关重要。在数据获取的方法中,通常采用爬虫技术进行数据抓取。爬虫技术是一种通过网页的链接地址寻找网页,并按照一定的规则,自动获取网页内容的程序。

目前,传统爬虫抓取网页页面数据,需要通过定位页面元素进行数据解析,也就是说在使用爬虫抓取数据的过程当中,必须进行脚本的编写,不同的网站需要编写不同的脚本,同时,假若网页改版,也需要重新编写抓取脚本,造成数据抓取的工作量巨大,费时费力,效率低下。

发明内容

本申请实施例的目的在于提出一种基于爬虫的数据抓取方法、装置、计算机设备及存储介质,以解决相关技术中爬虫进行数据抓取工作量巨大,费时费力,且抓取效率低的问题。

为了解决上述技术问题,本申请实施例提供一种基于爬虫的数据抓取方法,采用了如下所述的技术方案:

获取目标网页,并对所述目标网页进行解析,得到所述目标网页的所有标签;

根据所述标签得到标签对,遍历所有所述标签对,并对每个所述标签对中的字符进行查找,将满足第一预设条件的字符作为第一字符,并将满足第二预设条件的字符作为第二字符;

以所述第一字符为起点,所述第二字符为终点,读取出所述起点和所述终点之间的目标字符;

判断所述目标字符是否满足提取条件,在确定满足提取条件时,将所述目标字符作为页面内容进行提取。

进一步的,所述对所述目标网页进行解析,得到所述目标网页的标签的步骤包括:

使用网页解析器提取所述目标网页的网页结构;

获取所述网页结构中的所述标签。

进一步的,所述使用网页解析器提取所述目标网页的网页结构的步骤包括:

通过所述网页解析器解析所述目标网页得到HTML文档;

将所述HTML文档解析生成DOM树结构,将生成的所述DOM树结构作为所述目标网页的网页结构。

进一步的,所述遍历所有所述标签的步骤包括:

将所述网页结构中最外层的所述标签作为初始节点;

从所述初始节点开始,以所述DOM树结构中的标签作为遍历节点,对所有所述标签对进行深度优先遍历。

进一步的,所述对每个所述标签对中的字符进行查找的步骤包括:

利用字符串查找方法对所述标签中的全部字符进行查找。

进一步的,所述判断所述目标字符满足提取条件,将所述目标字符作为页面内容进行提取的步骤包括:

记录所述目标字符的长度;

确定所述目标字符的长度满足提取长度,则将所述目标字符作为页面内容,提取所述页面内容。

进一步的,在所述将所述目标字符作为页面内容进行提取的步骤之后还包括:

将所述页面内容以json格式进行存储。

为了解决上述技术问题,本申请实施例还提供一种基于爬虫的数据抓取装置,采用了如下所述的技术方案:

获取模块,用于获取目标网页,并对所述目标网页进行解析,得到所述目标网页的所有标签;

遍历模块,用于根据所述标签得到标签对,遍历所有所述标签对,并对每个所述标签对中的字符进行查找,将满足第一预设条件的字符作为第一字符,并将满足第二预设条件的字符作为第二字符;

读取模块,用于以所述第一字符为起点,所述第二字符为终点,读取出所述起点和所述终点之间的目标字符;

提取模块,用于判断所述目标字符是否满足提取条件,在确定满足提取条件时,将所述目标字符作为页面内容进行提取。

为了解决上述技术问题,本申请实施例还提供一种计算机设备,采用了如下所述的技术方案:

该计算机设备包括存储器和处理器,所述存储器中存储有计算机可读指令,所述处理器执行所述计算机可读指令时实现如上所述的基于爬虫的数据抓取方法的步骤。

为了解决上述技术问题,本申请实施例还提供一种计算机可读存储介质,采用了如下所述的技术方案:

所述计算机可读存储介质上存储有计算机可读指令,所述计算机可读指令被处理器执行时实现如上所述的基于爬虫的数据抓取方法的步骤。

与现有技术相比,本申请实施例主要有以下有益效果:

本申请通过获取目标网页,并对目标网页进行解析,得到目标网页的所有标签,根据标签得到标签对,遍历所有标签对,并对每个所述标签对中的字符进行查找,将满足第一预设条件的字符作为第一字符,并将满足第二预设条件的字符作为第二字符,以第一字符为起点,第二字符为终点,读取出起点和终点之间的目标字符,判断目标字符是否满足提取条件,在确定满足提取条件时,将目标字符作为页面内容进行提取;本申请通过遍历目标网页的所有标签对,查找每个标签对中的第一字符和第二字符,读取出以第一字符为起点,第二字符为终点之间的目标字符,确定目标字符满足提取条件,就将目标字符作为页面内容进行提取,也就是通过查找标签中满足预设条件的字符来进行网页页面数据的抓取,可以避免不同网站需要编写不同的脚本进行抓取,增强爬虫的适应性,同时,减少工作量,提高数据抓取效率。

附图说明

为了更清楚地说明本申请中的方案,下面将对本申请实施例描述中所需要使用的附图作一个简单介绍,显而易见地,下面描述中的附图是本申请的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

图1是本申请可以应用于其中的示例性系统架构图;

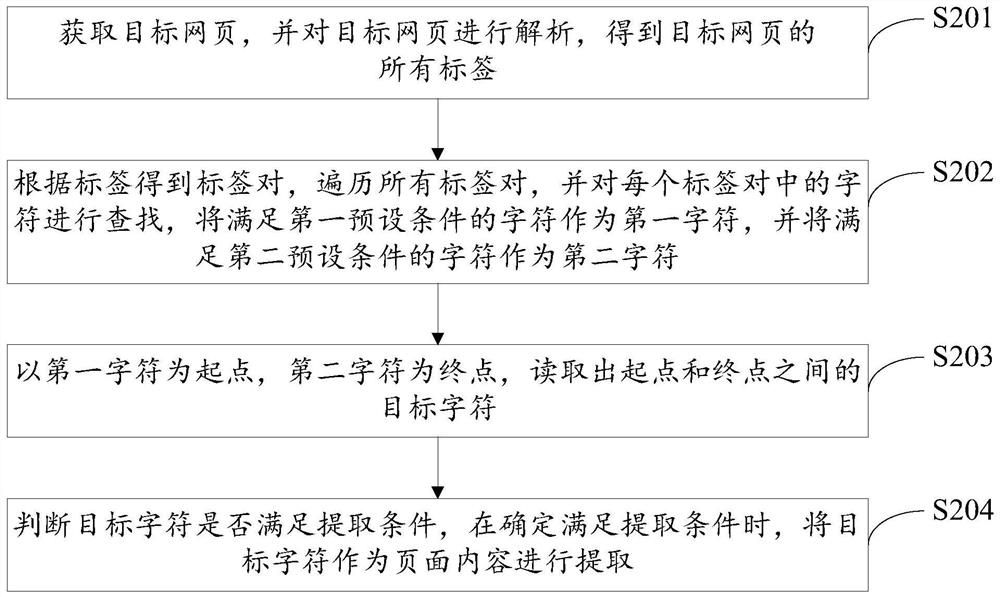

图2根据本申请的基于爬虫的数据抓取方法的一个实施例的流程图;

图3是图2中步骤S201的一种具体实施方式的流程图;

图4是图2中步骤S202的一种具体实施方式的流程图;

图5是根据本申请的基于爬虫的数据抓取装置的一个实施例的结构示意图;

图6是根据本申请的计算机设备的一个实施例的结构示意图。

具体实施方式

除非另有定义,本文所使用的所有的技术和科学术语与属于本申请的技术领域的技术人员通常理解的含义相同;本文中在申请的说明书中所使用的术语只是为了描述具体的实施例的目的,不是旨在于限制本申请;本申请的说明书和权利要求书及上述附图说明中的术语“包括”和“具有”以及它们的任何变形,意图在于覆盖不排他的包含。本申请的说明书和权利要求书或上述附图中的术语“第一”、“第二”等是用于区别不同对象,而不是用于描述特定顺序。

在本文中提及“实施例”意味着,结合实施例描述的特定特征、结构或特性可以包含在本申请的至少一个实施例中。在说明书中的各个位置出现该短语并不一定均是指相同的实施例,也不是与其它实施例互斥的独立的或备选的实施例。本领域技术人员显式地和隐式地理解的是,本文所描述的实施例可以与其它实施例相结合。

为了使本技术领域的人员更好地理解本申请方案,下面将结合附图,对本申请实施例中的技术方案进行清楚、完整地描述。

在对本申请实施例进行进一步详细说明之前,对本申请实施例中涉及的名词和术语进行说明,本申请实施例中涉及的名词和术语适用于如下的解释。

1)爬虫(web crawler),又称网页蜘蛛,网络机器人,是指按照一定的规则,自动地抓取网络信息的程序或者脚本。

2)HTML(HyperTextMackeup Language,超文本标记语言),是一种描述性的标记语言,用于描述超文本中内容的显示方式。

3)标签,也称为标记,是一种HTML的网络术语,每一种标签用于规定特定的含义。

4)网页,由各种标记组成的页面。

为了解决相关技术中爬虫进行数据抓取工作量巨大,费时费力,且抓取效率低的问题,本申请提供了一种基于爬虫的数据抓取方法,可以应用于如图1所示的系统架构100中,系统架构100可以包括终端设备101、102、103,网络104和服务器105。网络104用以在终端设备101、102、103和服务器105之间提供通信链路的介质。网络104可以包括各种连接类型,例如有线、无线通信链路或者光纤电缆等等。

用户可以使用终端设备101、102、103通过网络104与服务器105交互,以接收或发送消息等。终端设备101、102、103上可以安装有各种通讯客户端应用,例如网页浏览器应用、购物类应用、搜索类应用、即时通信工具、邮箱客户端、社交平台软件等。

终端设备101、102、103可以是具有显示屏并且支持网页浏览的各种电子设备,包括但不限于智能手机、平板电脑、电子书阅读器、MP3播放器(Moving Picture ExpertsGroup Audio Layer III,动态影像专家压缩标准音频层面3)、MP4(Moving PictureExperts Group Audio Layer IV,动态影像专家压缩标准音频层面4)播放器、膝上型便携计算机和台式计算机等等。

服务器105可以是提供各种服务的服务器,例如对终端设备101、102、103上显示的页面提供支持的后台服务器。

需要说明的是,本申请实施例所提供的基于爬虫的数据抓取方法一般由服务器执行,相应地,基于爬虫的数据抓取装置一般设置于服务器中。

应该理解,图1中的终端设备、网络和服务器的数目仅仅是示意性的。根据实现需要,可以具有任意数目的终端设备、网络和服务器。

继续参考图2,示出了根据本申请的基于爬虫的数据抓取的方法的一个实施例的流程图,包括以下步骤:

步骤S201,获取目标网页,并对目标网页进行解析,得到目标网页的所有标签。

在本实施例中,爬虫根据提供的入口网址,获取到该地址下的网页,该网页即为待抓取的目标网页。当爬虫抓取目标网页页面时,爬虫会识别出目标网页的标签,并从标签中提取出网页的内容。

在本实施例的一些可选的实现方式中,对目标网页进行解析,得到目标网页的标签的步骤具体如下:

步骤S301,使用网页解析器提取目标网页的网页结构。

具体地,通过网页解析器解析目标网页得到HTML文档,将HTML文档解析生成DOM树结构,将生成的DOM树结构作为目标网页的网页结构。

在网页中,网页的标签是按照一种树状结构排列。网页解析器也称作HTML(HyperText Markup Language,超文本标记语言)解析器,jsoup是一款Java的HTML解析器,可直接解析某个URL地址、HTML文本内容。

在本实施例中,通过jsoup或其他网页解析器解析目标网页,可以获取含有标签的网页内容。例如,以下是一个HTML文档:

ExampleExample

There are three examples:

Example1,

Example2and

Example3

需要说明的是,标签是成对出现的,即本实施例中的标签具体为标签对,例如与为一个标签、

与为一个标签,定义HTML文档,与标签限定了文档的开始点和结束点;定义关于文档的信息;

定义文档的标题;<body>定义文档的主体;<p>定义文档段落;<b>定义粗体字;<a>定义超链接,<a>标签最重要的属性是href属性,它指示链接的目标。</p><p>通过HTML解析器将HTML文档转换成DOM树结构。DOM树结构是HTML解析器输出的解析树,包含元素节点、文本节点、属性节点和注释节点,它是HTML文档的对象表示,作为HTML元素的外部接口供JS等调用。在DOM树结构中存在多个分支,每个分支中存在多个层,层结构是元素节点与元素节点之间的关系。</p><p>作为一个具体示例,使用网页解析器解析将HTML文档解析生成DOM树结构时,可以去除网页中不包含文字信息的节点(即功能性代码),例如,去除无意义的HTML标签,如<style>、</style>、<script>、</script>等。</p><p>在本实施例中,将目标网页解析生成DOM树结构,以DOM树结构中的标签作为遍历节点,可以更方便地对标签进行遍历。</p><p>步骤S302,获取网页结构中的标签。</p><p>需要说明的是,DOM树结构的元素节点就是网页的标签元素,文本节点被包含在元素节点内部,属性节点用于对元素做出具体描述,如上述例子所示,<a>标签的属性是href属性。应当理解,并不是所有的元素节点都包含属性。</p><p>在本实施例中,可以从生成的DOM树结构中得到目标网页的标签,提高解析网页的性能,同时,可以完整准确地获取网页信息。</p><p>本实施例通过网页解析器提取网页结构,并从网页结构中获取到标签,可以更快更简便地得到目标网页的标签。</p><p>步骤S202,根据标签得到标签对,遍历所有标签对,并对每个标签对中的字符进行查找,将满足第一预设条件的字符作为第一字符,并将满足第二预设条件的字符作为第二字符。</p><p>网页是由各种标签组成的页面,网页所展示出来的标签都遵循标签规范,根据标签元素可以区分标签的层级。以如下例子进行说明:</p><p><dd></p><p><ul class=“topic_list”></p><p><li><em>&sdot;</em><a href=“/topics/50245210”target“_black”>关于ADO和数字符号的问题</a></li></p><p></ul></p><p></dd></p><p>在上述例子中,包含三个标签元素,分别为<dd>、<ul>和<li>,由此看出,标签分为三层,每个标签元素对应一层。</p><p>在本实施例中,标签是以标签对的形式存在的,以每个标签作为节点进行遍历,可以获得该标签对应网页的页面内容。</p><p>具体地,遍历所有标签对的步骤如下:</p><p>步骤S401,将网页结构中最外层的标签作为初始节点。</p><p>在本实施例中,将标签作为遍历节点对所有的标签对进行深度优先遍历,具体地,将网页结构中最外层的标签作为第一层,将第一层中嵌套的标签为第二层,以此类推,形成树结构,以第一层的标签作为初始节点,从初始节点开始访问,依次从初始节点的未被访问的邻接节点出发,进行深度优先遍历,直到所有节点均被访问过为止。</p><p>以上述例子为例进行进一步说明,标签元素为<dd>的是最外层的标签,将其作为第一层,标签元素为<ul>是<dd>中嵌套的标签,将其作为第二层,标签元素为<li>是<ul>中嵌套的标签,将其作为第三层。具体地,以<dd>为初始节点,则<dd>的邻接节点为<ul>,<ul>的邻接节点为<li>,进行深度优先遍历的顺序为:<dd>→<ul>→<li>。</p><p>步骤S402,从初始节点开始,以DOM树结构中的标签作为遍历节点,对所有标签对进行深度优先遍历。</p><p>生成的DOM树结构中包含的元素节点为网页的标签元素,则以DOM树结构中的标签元素作为节点,依次对标签元素对应的标签对进行深度优先遍历。例如,在DOM树结构中标签元素为ul,则标签元素对应的标签对为<ul>和</ul>。</p><p>深度优先遍历的方法具体是,从初始节点v出发:</p><p>a、访问初始节点v,并标记初始结点v为已访问;</p><p>b、查找初始节点v的第一个邻接节点w;</p><p>c、若节点w存在,则继续执行步骤d,否则遍历结束;</p><p>d、若节点w未被访问,对节点w进行深度优先遍历递归(即把节点w当作另一个初始节点v,执行步骤a、b和c);</p><p>e、查找初始节点v的下一个邻接节点,转到步骤c。</p><p>举例而言,假设网页结构为:标签A为第一层;标签A中嵌套的标签为标签B和标签C,则标签B和标签C为第二层;标签B中嵌套的标签为标签D和标签E,标签C中嵌套的标签为标签F,则标签D、标签E以及标签F为第三层;于是,标签A作为初始节点,标签A有邻接节点标签B和标签C,标签B有邻接节点标签D和标签E,标签C有邻接节点标签F,进行深度优先遍历的顺序为:标签A→标签B→标签D→标签E→标签C→标签F。</p><p>网页页面的标签定义遵循标签规范,标签格式类似:<lable>页面内容</lable>。在本实施例中,遍历每个标签对,将页面内容提取出来,在进行遍历的过程中,在每个标签对对应的层别中,通过查找字符,将满足第一预设条件的字符作为第一字符,并将满足第二预设条件的字符作为第二字符。</p><p>在本实施例中,第一预设条件具体为当前访问的标签对所对应的层别中出现的“大于号(>)”字符,第二预设条件具体为当前访问的标签对所对应的层别中,紧接于“大于号(>)”字符出现的“小于号(<)”字符。应当理解,“>”字符和“<”字符为标签字符。</p><p>需要说明的是,在一个标签对中,可能存在多个“>”字符和多个“<”字符,将标签对中首次出现的“>”字符作为第一字符,紧接于首次出现的“>”字符之后出现的“<”字符为第二字符,第二次出现的“>”字符作为第一字符,紧接于第二次出现的“>”字符之后出现的“<”字符为第二字符,并以此类推。在本实施例中,第一字符和第二字符是有先后顺序的,第一字符在前,第二字符在后,第一字符和第二字符之间的内容是可能要提取的页面内容。</p><p>在本实施例中,可以对每个标签对中的全部字符进行查找,将查找到的第一字符和第二字符分别进行标记。</p><p>具体地,可以利用字符串查找方法对标签对中所有的字符进行查找。字符串查找方法包括但不限于如下方法:</p><p>1、intindexOf(String str):返回第一次出现的指定子字符串在此字符串中的索引。</p><p>2、intindexOf(String str,intstartIndex):从指定的索引处开始,返回第一次出现的指定子字符串在此字符串中的索引。</p><p>3、intlastIndexOf(String str):返回在此字符串中最右边出现的指定子字符串的索引。</p><p>4、intlastIndexOf(String str,intstartIndex):从指定的索引处开始向后搜索,返回在此字符串中最后一次出现的指定子字符串的索引。</p><p>对于每个标签对,首标签的尾字符为第一次出现的第一字符,尾标签的首字符为最后一次出现的第二字符。每个标签对中,查找第一次出现的第一字符和最后一次出现的第二字符之间所有的第一字符和第二字符。</p><p>在网页改版时,网页的页面内容并不会有很大变更,但是标签会改变,若爬虫按照根据网页标签一行一列地逐个进行数据解析的方法来获取数据,需要重新编写抓取脚本,在本实施例中,通过确定第一字符和第二字符之间的字符长度来提取页面内容,可以避免对于不同的网站或者网页改版时需要编写不同的脚本进行抓取的情况,不需要修改脚本,增强爬虫的适应性。</p><p>本实施例通过深度优先遍历来确定出每个标签对中的第一字符和第二字符,可以确保完整无遗漏地提取到页面内容。</p><p>步骤S203,以第一字符为起点,第二字符为终点,读取出起点和终点之间的目标字符。</p><p>在本实施例中,在一个标签对中,可能存在多个“>”字符和多个“<”字符,以第一次出现的“>”字符为起点,紧接第一次出现的“>”字符出现的“<”字符为终点,以第二次出现的“>”字符为起点,紧接第二次出现的“>”字符出现的“<”字符为终点,读取出起点和终点之间的目标字符,并以此类推。</p><p>步骤S204,判断目标字符是否满足提取条件,在确定满足提取条件时,将目标字符作为页面内容进行提取。</p><p>具体地,记录第一字符与第二字符之间的目标字符的长度,确定目标字符的长度满足提取长度,则将目标字符作为页面内容,提取出页面内容。提取出来的页面内容可以进行保存,方便用户查看。</p><p>在本实施例中,标签格式为<lable>页面内容</lable>,要将第一字符“>”和第二字符“<”之间的页面内容提取出来。</p><p>举例说明,一个标签对如下:</p><p><li><em>&sdot;</em><a href=“/topics/50245210”target“_black”>关于ADO和数字符号的问题</a></li></p><p>需要将页面内容“关于ADO和数字符号的问题”中提取出来,在该标签对中,存在多个第一字符和第二字符,因此,需要将每一对第一字符和第二字符之间的字符长度进行记录,根据长度来确定是否是要提取的页面内容。</p><p>提取长度根据实际情况进行设置,当确定第一字符和第二字符之间的目标字符满足提取的预设长度,将目标字符作为页面内容进行提取。</p><p>需要强调的是,为进一步保证上述页面内容的私密和安全性,页面内容还可以存储于一区块链的节点中。</p><p>本申请所指区块链是分布式数据存储、点对点传输、共识机制、加密算法等计算机技术的新型应用模式。区块链(Blockchain),本质上是一个去中心化的数据库,是一串使用密码学方法相关联产生的数据块,每一个数据块中包含了一批次网络交易的信息,用于验证其信息的有效性(防伪)和生成下一个区块。区块链可以包括区块链底层平台、平台产品服务层以及应用服务层等。</p><p>本实施例通过字符长度确定第一字符和第二字符之间是否为待提取的页面内容,可以避免提取出无用的内容,提高爬虫抓取数据的准确性,同时提高抓取效率。</p><p>在本实施例的一些可选的实现方式中,在步骤203之后,还可以执行以下步骤:</p><p>将页面内容以json格式进行存储。</p><p>具体地,将提取出来的页面内容以json格式进行存储,或者按照数据库形式进行存储,存储的页面内容可以直接用于数据分析。存储的方式包括但不限于以json格式存储到文本文件、存储到excel、存储到SQLite(轻型数据库)以及存储到mySQL(关系型数据库管理系统)数据库。</p><p>JSON,全称为JavaScript Object Notation,也就是JavaScript对象标记,任何支持的类型都可以通过JSON来表示,例如字符串、数字、对象、数组等。在本实施例中,设置用于保存页面内容的json文件的路径,将提取的页面内容通过路径写入json文件中进行存储。</p><p>需要说明的是,json格式可以保证在打开文件时,可以直观的检查所存储的数据,一条数据存储一行,这种方式适用于爬取数据量比较小的情况,后续的读取分析也是很方便的;如果爬取的数据很容易被整理成表格的形式,那么可以存储到excel,打开excel后,对数据的观察更加方便,同时excel也可以进行一些简单的操作;SQLite无需安装,是零配置数据库,当爬虫数据量很大时,需要持久化存储,又没有安装其他数据库,可以选择SQLite进行存储;mySQL可以远程访问,意味着可以将数据存储到远程服务器主机。</p><p>本申请通过遍历目标网页的所有标签对,查找每个标签对中的第一字符和第二字符,读取出以第一字符为起点,第二字符为终点之间的目标字符,确定目标字符满足提取条件,就将目标字符作为页面内容进行提取,也就是通过查找标签中对应的字符来进行网页页面数据的抓取,可以避免不同网站需要编写不同的脚本进行抓取,增强爬虫的适应性,同时,减少工作量,提高数据抓取效率。</p><p>本申请可用于众多通用或专用的计算机系统环境或配置中。例如:个人计算机、服务器计算机、手持设备或便携式设备、平板型设备、多处理器系统、基于微处理器的系统、置顶盒、可编程的消费电子设备、网络PC、小型计算机、大型计算机、包括以上任何系统或设备的分布式计算环境等等。本申请可以在由计算机执行的计算机可执行指令的一般上下文中描述,例如程序模块。一般地,程序模块包括执行特定任务或实现特定抽象数据类型的例程、程序、对象、组件、数据结构等等。也可以在分布式计算环境中实践本申请,在这些分布式计算环境中,由通过通信网络而被连接的远程处理设备来执行任务。在分布式计算环境中,程序模块可以位于包括存储设备在内的本地和远程计算机存储介质中。</p><p>本领域普通技术人员可以理解实现上述实施例方法中的全部或部分流程,是可以通过计算机可读指令来指令相关的硬件来完成,该计算机可读指令可存储于一计算机可读取存储介质中,该程序在执行时,可包括如上述各方法的实施例的流程。其中,前述的存储介质可为磁碟、光盘、只读存储记忆体(Read-Only Memory,ROM)等非易失性存储介质,或随机存储记忆体(Random Access Memory,RAM)等。</p><p>应该理解的是,虽然附图的流程图中的各个步骤按照箭头的指示依次显示,但是这些步骤并不是必然按照箭头指示的顺序依次执行。除非本文中有明确的说明,这些步骤的执行并没有严格的顺序限制,其可以以其他的顺序执行。而且,附图的流程图中的至少一部分步骤可以包括多个子步骤或者多个阶段,这些子步骤或者阶段并不必然是在同一时刻执行完成,而是可以在不同的时刻执行,其执行顺序也不必然是依次进行,而是可以与其他步骤或者其他步骤的子步骤或者阶段的至少一部分轮流或者交替地执行。</p><p>进一步参考图5,作为对上述图2所示方法的实现,本申请提供了一种基于爬虫的数据抓取装置的一个实施例,该装置实施例与图2所示的方法实施例相对应,该装置具体可以应用于各种电子设备中。</p><p>如图5所示,本实施例所述的基于爬虫的数据抓取装置500包括:获取模块501、遍历模块502以及提取模块503。其中:</p><p>获取模块501用于获取目标网页,并对所述目标网页进行解析,得到所述目标网页的所有标签;</p><p>遍历模块502用于根据所述标签得到标签对,遍历所有所述标签对,并对每个所述标签对中的字符进行查找,将满足第一预设条件的字符作为第一字符,并将满足第二预设条件的字符作为第二字符;</p><p>读取模块,用于以所述第一字符为起点,所述第二字符为终点,读取出所述起点和所述终点之间的目标字符;</p><p>提取模块503用于判断所述目标字符是否满足提取条件,在确定满足提取条件时,将所述目标字符作为页面内容进行提取。</p><p>需要强调的是,为进一步保证上述页面内容的私密和安全性,页面内容还可以存储于一区块链的节点中。</p><p>上述的基于爬虫的数据抓取装置,通过遍历目标网页的所有标签对,查找每个标签对中的第一字符和第二字符,读取出以第一字符为起点,第二字符为终点之间的目标字符,确定目标字符满足提取条件,就将目标字符作为页面内容进行提取,也就是通过查找标签中对应的字符来进行网页页面数据的抓取,可以避免不同网站需要编写不同的脚本进行抓取,增强爬虫的适应性,同时,减少工作量,提高数据抓取效率。</p><p>在本实施例中,获取模块501包括解析子模块和获取子模块,解析子模块用于使用网页解析器提取所述目标网页的网页结构;获取子模块用于获取所述网页结构中的所述标签。</p><p>本实施例通过网页解析器提取网页结构,并从网页结构中获取到标签,可以更快更简便地得到目标网页的标签。</p><p>在本实施例的一些可选的实现方式中,解析子模块进一步用于:</p><p>通过所述网页解析器解析所述目标网页得到HTML文档;</p><p>将所述HTML文档解析生成DOM树结构,将生成的所述DOM树结构作为所述目标网页的网页结构。</p><p>本实施例通过将目标网页解析生成DOM树结构,可以提高解析网页的性能,同时,可以完整准确地获取网页信息。</p><p>在本实施例中,遍历模块502进一步用于:</p><p>将所述网页结构中最外层的所述标签作为初始节点;</p><p>从所述初始节点开始,以所述DOM树结构中的标签作为遍历节点,对所有所述标签对进行深度优先遍历。</p><p>在本实施例的一些可选的实现方式中,遍历模块502进一步还用于:</p><p>利用字符串查找方法对所述标签对中的全部字符进行查找。</p><p>本实施例通过深度优先遍历来确定出每个标签对中的第一字符和第二字符,可以确保完整无遗漏地提取到页面内容。</p><p>在本实施例中,提取模块503包括记录子模块和提取子模块,记录子模块用于记录所述目标字符的长度;提取子模块用于确定所述目标字符的长度满足提取长度,则所述将目标字符作为页面内容,提取所述页面内容。</p><p>本实施例通过字符长度确定第一字符和第二字符之间是否为待提取的页面内容,可以避免提取出无用的内容,提高爬虫抓取数据的准确性,同时提高抓取效率。</p><p>在本实施例的一些可选的实现方式中,基于爬虫的数据抓取装置500还包括存储模块,存储模块用于将所述页面内容以json格式进行存储。</p><p>本实施例将提取出来的页面内容存储至数据库,存储的页面内容可以直接用于数据分析。</p><p>为解决上述技术问题,本申请实施例还提供计算机设备。具体请参阅图6,图6为本实施例计算机设备基本结构框图。</p><p>所述计算机设备6包括通过系统总线相互通信连接存储器61、处理器62、网络接口63。需要指出的是,图中仅示出了具有组件61-63的计算机设备6,但是应理解的是,并不要求实施所有示出的组件,可以替代的实施更多或者更少的组件。其中,本技术领域技术人员可以理解,这里的计算机设备是一种能够按照事先设定或存储的指令,自动进行数值计算和/或信息处理的设备,其硬件包括但不限于微处理器、专用集成电路(ApplicationSpecific Integrated Circuit,ASIC)、可编程门阵列(Field-Programmable GateArray,FPGA)、数字处理器(Digital Signal Processor,DSP)、嵌入式设备等。</p><p>所述计算机设备可以是桌上型计算机、笔记本、掌上电脑及云端服务器等计算设备。所述计算机设备可以与用户通过键盘、鼠标、遥控器、触摸板或声控设备等方式进行人机交互。</p><p>所述存储器61至少包括一种类型的可读存储介质,所述可读存储介质包括闪存、硬盘、多媒体卡、卡型存储器(例如,SD或DX存储器等)、随机访问存储器(RAM)、静态随机访问存储器(SRAM)、只读存储器(ROM)、电可擦除可编程只读存储器(EEPROM)、可编程只读存储器(PROM)、磁性存储器、磁盘、光盘等。在一些实施例中,所述存储器61可以是所述计算机设备6的内部存储单元,例如该计算机设备6的硬盘或内存。在另一些实施例中,所述存储器61也可以是所述计算机设备6的外部存储设备,例如该计算机设备6上配备的插接式硬盘,智能存储卡(Smart Media Card,SMC),安全数字(Secure Digital,SD)卡,闪存卡(FlashCard)等。当然,所述存储器61还可以既包括所述计算机设备6的内部存储单元也包括其外部存储设备。本实施例中,所述存储器61通常用于存储安装于所述计算机设备6的操作系统和各类应用软件,例如基于爬虫的数据抓取方法的计算机可读指令等。此外,所述存储器61还可以用于暂时地存储已经输出或者将要输出的各类数据。</p><p>所述处理器62在一些实施例中可以是中央处理器(Central Processing Unit,CPU)、控制器、微控制器、微处理器、或其他数据处理芯片。该处理器62通常用于控制所述计算机设备6的总体操作。本实施例中,所述处理器62用于运行所述存储器61中存储的计算机可读指令或者处理数据,例如运行所述基于爬虫的数据抓取方法的计算机可读指令。</p><p>所述网络接口63可包括无线网络接口或有线网络接口,该网络接口63通常用于在所述计算机设备6与其他电子设备之间建立通信连接。</p><p>本实施例通过处理器执行存储在存储器的计算机可读指令时实现如上述实施例基于爬虫的数据抓取方法的步骤,通过遍历目标网页的所有标签对,查找每个标签对中的第一字符和第二字符,读取出以第一字符为起点,第二字符为终点之间的目标字符,确定目标字符满足提取条件,就将目标字符作为页面内容进行提取,也就是通过查找标签中对应的字符来进行网页页面数据的抓取,可以避免不同网站需要编写不同的脚本进行抓取,增强爬虫的适应性,同时,减少工作量,提高数据抓取效率。</p><p>本申请还提供了另一种实施方式,即提供一种计算机可读存储介质,所述计算机可读存储介质存储有计算机可读指令,所述计算机可读指令可被至少一个处理器执行,以使所述至少一个处理器执行如上述的基于爬虫的数据抓取方法的步骤,通过遍历目标网页的所有标签对,查找每个标签对中的第一字符和第二字符,读取出以第一字符为起点,第二字符为终点之间的目标字符,确定目标字符满足提取条件,就将目标字符作为页面内容进行提取,也就是通过查找标签中对应的字符来进行网页页面数据的抓取,可以避免不同网站需要编写不同的脚本进行抓取,增强爬虫的适应性,同时,减少工作量,提高数据抓取效率。</p><p>通过以上的实施方式的描述,本领域的技术人员可以清楚地了解到上述实施例方法可借助软件加必需的通用硬件平台的方式来实现,当然也可以通过硬件,但很多情况下前者是更佳的实施方式。基于这样的理解,本申请的技术方案本质上或者说对现有技术做出贡献的部分可以以软件产品的形式体现出来,该计算机软件产品存储在一个存储介质(如ROM/RAM、磁碟、光盘)中,包括若干指令用以使得一台终端设备(可以是手机,计算机,服务器,空调器,或者网络设备等)执行本申请各个实施例所述的方法。</p><p>显然,以上所描述的实施例仅仅是本申请一部分实施例,而不是全部的实施例,附图中给出了本申请的较佳实施例,但并不限制本申请的专利范围。本申请可以以许多不同的形式来实现,相反地,提供这些实施例的目的是使对本申请的公开内容的理解更加透彻全面。尽管参照前述实施例对本申请进行了详细的说明,对于本领域的技术人员来而言,其依然可以对前述各具体实施方式所记载的技术方案进行修改,或者对其中部分技术特征进行等效替换。凡是利用本申请说明书及附图内容所做的等效结构,直接或间接运用在其他相关的技术领域,均同理在本申请专利保护范围之内。</p>

</div>

<div class="gradBox" style="display: block;"></div>

<div class="download">

<a href="javascript:orderEmailTipnew('06120112880702',95,12);;">完整全部详细技术资料下载</a>

</div>

</div>

<div class="col-art-footer" style="background-color: #fff;line-height: 25px;padding: 25px;">

<ul>

<li><span>该技术已申请专利。仅供学习研究,如用于商业用途,请联系技术所有人。</span></li>

<li><span>专利发明人:郑如刚;</span></li>

<li><span>专利申请人:深圳壹账通智能科技有限公司;</span></li>

</ul>

<ul>

<li><span>上一篇:</span><a style="color: #666;"

href="https://zhuanli.zhangqiaokeyan.com/patent_7_124/06120112883421.html" title="上一篇">一种高光谱色域型COB光源</a></li>

<li><span>下一篇:</span><a style="color: #666;"

href="https://zhuanli.zhangqiaokeyan.com/patent_7_124/06120112882961.html" title="下一篇">一种用于汽车配件的高效清洗烘干一体装置</a></li>

</ul>

</div>

<div class="detailxgjs">

<div class="tit">相关技术</div>

<div class="left">

<ul>

<li>

基于爬虫的数据抓取方法、装置、计算机设备及存储介质

</li>

<li>

基于Node.js的爬虫方法、装置、计算机设备及存储介质

</li>

</ul>

</div>

</div>

</div>

<div class="aside">

<div class="asidelist">

<div class="title">技术分类</div>

<ul>

<li><a href="/patent_1_9/" title="农业、林业、畜牧业、狩猎、诱捕、捕鱼">农业;林业;畜牧业;狩猎;诱捕;捕鱼</a></li>

<li><a href="/patent_1_10/" title="焙烤;制作或处理面团的设备;焙烤用面团">焙烤;制作或处理面团的设备;焙烤用面团</a></li>

<li><a href="/patent_1_11/" title="屠宰;肉品处理;家禽或鱼的加工">屠宰;肉品处理;家禽或鱼的加工</a></li>

<li><a href="/patent_1_12/" title="其他类不包含的食品或食料;及其处理">其他类不包含的食品或食料;及其处理</a></li>

<li><a href="/patent_1_13/" title="烟草、雪茄烟、纸烟、吸烟者用品">烟草、雪茄烟、纸烟、吸烟者用品</a></li>

<li><a href="/patent_1_14/" title="服装">服装</a></li>

<li><a href="/patent_1_15/" title="帽类制品">帽类制品</a></li>

<li><a href="/patent_1_16/" title="鞋类">鞋类</a></li>

<li><a href="/patent_1_17/" title="服饰缝纫用品、珠宝">服饰缝纫用品、珠宝</a></li>

<li><a href="/patent_1_18/" title="手携物品或旅行品">手携物品或旅行品</a></li>

<li><a href="/patent_1_19/" title="刷类制品">刷类制品</a></li>

<li><a href="/patent_1_20/" title="家具、家庭用的物品或设备、咖啡磨、香料磨、一般吸尘器">家具、家庭用的物品或设备、咖啡磨、香料磨、一般吸尘器</a></li>

<li><a href="/patent_1_21/" title="医学或兽医学、卫生学">医学或兽医学、卫生学</a></li>

<li><a href="/patent_1_22/" title="救生、消防">救生、消防</a></li>

<li><a href="/patent_1_23/" title="运动、游戏、娱乐活动">运动、游戏、娱乐活动</a></li>

<li><a href="/patent_1_24/" title="本部其他类目中不包括的技术主题">本部其他类目中不包括的技术主题</a></li>

<li><a href="/patent_2_25/" title="一般的物理或化学的方法或装置">一般的物理或化学的方法或装置</a></li>

<li><a href="/patent_2_26/" title="破碎、磨粉或粉碎、谷物碾磨的预处理">破碎、磨粉或粉碎、谷物碾磨的预处理</a></li>

<li><a href="/patent_2_27/" title="用液体或用风力摇床或风力跳汰机分离固体物料、从固体物料或流体中分离固体物料的磁或静电分离、高压电场分离">用液体或用风力摇床或风力跳汰机分离固体物料、从固体物料或流体中分离固体物料的磁或静电分离、高压电场分离</a></li>

<li><a href="/patent_2_28/" title="用于实现物理或化学工艺过程的离心装置或离心机">用于实现物理或化学工艺过程的离心装置或离心机</a></li>

<li><a href="/patent_2_29/" title="一般喷射或雾化、对表面涂覆液体或其他流体的一般方法">一般喷射或雾化、对表面涂覆液体或其他流体的一般方法</a></li>

<li><a href="/patent_2_30/" title="一般机械振动的发生或传递">一般机械振动的发生或传递</a></li>

<li><a href="/patent_2_31/" title="将固体从固体中分离、分选">将固体从固体中分离、分选</a></li>

<li><a href="/patent_2_32/" title="清洁">清洁</a></li>

<li><a href="/patent_2_33/" title="固体废物的处理、被污染土壤的再生">固体废物的处理、被污染土壤的再生</a></li>

<li><a href="/patent_2_34/" title="基本上无切削的金属机械加工、金属冲压">基本上无切削的金属机械加工、金属冲压</a></li>

<li><a href="/patent_2_35/" title="铸造、粉末冶金">铸造、粉末冶金</a></li>

<li><a href="/patent_2_36/" title="机床、其他类目中不包括的金属加工">机床、其他类目中不包括的金属加工</a></li>

<li><a href="/patent_2_37/" title="磨削、抛光">磨削、抛光</a></li>

<li><a href="/patent_2_38/" title="手动工具、轻便机动工具、手动器械的手柄、车间设备、机械手">手动工具、轻便机动工具、手动器械的手柄、车间设备、机械手</a></li>

<li><a href="/patent_2_39/" title="手动切割工具、切割、切断">手动切割工具、切割、切断</a></li>

<li><a href="/patent_2_40/" title="木材或类似材料的加工或保存、一般钉钉机或钉U形钉机">木材或类似材料的加工或保存、一般钉钉机或钉U形钉机</a></li>

<li><a href="/patent_2_41/" title="加工水泥、黏土或石料">加工水泥、黏土或石料</a></li>

<li><a href="/patent_2_42/" title="塑料的加工、一般处于塑性状态物质的加工">塑料的加工、一般处于塑性状态物质的加工</a></li>

<li><a href="/patent_2_43/" title="压力机">压力机</a></li>

<li><a href="/patent_2_44/" title="纸品或纸板或类似纸的方式加工的材料制品制作、纸或纸板或类似纸的方式加工的材料的加工">纸品或纸板或类似纸的方式加工的材料制品制作、纸或纸板或类似纸的方式加工的材料的加工</a></li>

<li><a href="/patent_2_45/" title="层状产品">层状产品</a></li>

<li><a href="/patent_2_46/" title="附加制造技术">附加制造技术</a></li>

<li><a href="/patent_2_47/" title="印刷、排版机、打字机、模印机">印刷、排版机、打字机、模印机</a></li>

<li><a href="/patent_2_48/" title="装订、图册、文件夹、特种印刷品">装订、图册、文件夹、特种印刷品</a></li>

<li><a href="/patent_2_49/" title="书写或绘图器具、办公用品">书写或绘图器具、办公用品</a></li>

<li><a href="/patent_2_50/" title="装饰艺术">装饰艺术</a></li>

<li><a href="/patent_2_51/" title="一般车辆">一般车辆</a></li>

<li><a href="/patent_2_52/" title="铁路">铁路</a></li>

<li><a href="/patent_2_53/" title="无轨陆用车辆">无轨陆用车辆</a></li>

<li><a href="/patent_2_54/" title="船舶或其他水上船只、与船有关的设备">船舶或其他水上船只、与船有关的设备</a></li>

<li><a href="/patent_2_55/" title="飞行器、航空、宇宙航行">飞行器、航空、宇宙航行</a></li>

<li><a href="/patent_2_56/" title="输送、包装、贮存、搬运薄的或细丝状材料">输送、包装、贮存、搬运薄的或细丝状材料</a></li>

<li><a href="/patent_2_57/" title="卷扬、提升、牵引">卷扬、提升、牵引</a></li>

<li><a href="/patent_2_58/" title="开启或封闭瓶子、罐或类似的容器、液体的贮运">开启或封闭瓶子、罐或类似的容器、液体的贮运</a></li>

<li><a href="/patent_2_59/" title="鞍具、家具罩面">鞍具、家具罩面</a></li>

<li><a href="/patent_2_60/" title="微观结构技术">微观结构技术</a></li>

<li><a href="/patent_2_61/" title="纳米技术">纳米技术</a></li>

<li><a href="/patent_3_63/" title="无机化学">无机化学</a></li>

<li><a href="/patent_3_64/" title="水、废水、污水或污泥的处理">水、废水、污水或污泥的处理</a></li>

<li><a href="/patent_3_65/" title="玻璃、矿棉或渣棉">玻璃、矿棉或渣棉</a></li>

<li><a href="/patent_3_66/" title="水泥、混凝土、人造石、陶瓷、耐火材料">水泥、混凝土、人造石、陶瓷、耐火材料</a></li>

<li><a href="/patent_3_67/" title="肥料、肥料制造">肥料、肥料制造</a></li>

<li><a href="/patent_3_68/" title="炸药、火柴">炸药、火柴</a></li>

<li><a href="/patent_3_69/" title="有机化学">有机化学</a></li>

<li><a href="/patent_3_70/" title="有机高分子化合物、其制备或化学加工、以其为基料的组合物">有机高分子化合物、其制备或化学加工、以其为基料的组合物</a></li>

<li><a href="/patent_3_71/" title="染料、涂料、抛光剂、天然树脂、黏合剂、其他类目不包含的组合物、其他类目不包含的材料的应用">染料、涂料、抛光剂、天然树脂、黏合剂、其他类目不包含的组合物、其他类目不包含的材料的应用</a></li>

<li><a href="/patent_3_72/" title="石油、煤气及炼焦工业、含一氧化碳的工业气体、燃料、润滑剂、泥煤">石油、煤气及炼焦工业、含一氧化碳的工业气体、燃料、润滑剂、泥煤</a></li>

<li><a href="/patent_3_73/" title="动物或植物油、脂、脂肪物质或蜡、由此制取的脂肪酸、洗涤剂、蜡烛">动物或植物油、脂、脂肪物质或蜡、由此制取的脂肪酸、洗涤剂、蜡烛</a></li>

<li><a href="/patent_3_74/" title="生物化学、啤酒、烈性酒、果汁酒、醋、微生物学、酶学、突变或遗传工程">生物化学、啤酒、烈性酒、果汁酒、醋、微生物学、酶学、突变或遗传工程</a></li>

<li><a href="/patent_3_75/" title="糖工业">糖工业</a></li>

<li><a href="/patent_3_76/" title="使用化学药剂、酶类或微生物处理小原皮、大原皮或皮革的工艺,如鞣制、浸渍或整饰、其所用的设备、鞣制组合物(皮革或毛皮的漂白入D06L、皮革或毛皮的染色入D06P)">使用化学药剂、酶类或微生物处理小原皮、大原皮或皮革的工艺,如鞣制、浸渍或整饰、其所用的设备、鞣制组合物(皮革或毛皮的漂白入D06L、皮革或毛皮的染色入D06P)</a></li>

<li><a href="/patent_3_77/" title="铁的冶金">铁的冶金</a></li>

<li><a href="/patent_3_78/" title="冶金、黑色或有色金属合金、合金或有色金属的处理">冶金、黑色或有色金属合金、合金或有色金属的处理</a></li>

<li><a href="/patent_3_79/" title="对金属材料的镀覆、用金属材料对材料的镀覆、表面化学处理、金属材料的扩散处理、真空蒸发法、溅射法、离子注入法或化学气相沉积法的一般镀覆、金属材料腐蚀或积垢的一般抑制">对金属材料的镀覆、用金属材料对材料的镀覆、表面化学处理、金属材料的扩散处理、真空蒸发法、溅射法、离子注入法或化学气相沉积法的一般镀覆、金属材料腐蚀或积垢的一般抑制</a></li>

<li><a href="/patent_3_80/" title="电解或电泳工艺、其所用设备">电解或电泳工艺、其所用设备</a></li>

<li><a href="/patent_3_81/" title="晶体生长">晶体生长</a></li>

<li><a href="/patent_3_82/" title="组合技术">组合技术</a></li>

<li><a href="/patent_4_84/" title="天然或化学的线或纤维、纺纱或纺丝">天然或化学的线或纤维、纺纱或纺丝</a></li>

<li><a href="/patent_4_85/" title="纱线、纱线或绳索的机械整理、整经或络经">纱线、纱线或绳索的机械整理、整经或络经</a></li>

<li><a href="/patent_4_86/" title="织造">织造</a></li>

<li><a href="/patent_4_87/" title="编织、花边制作、针织、饰带、非织造布">编织、花边制作、针织、饰带、非织造布</a></li>

<li><a href="/patent_4_88/" title="缝纫、绣花、簇绒">缝纫、绣花、簇绒</a></li>

<li><a href="/patent_4_89/" title="织物等的处理、洗涤、其他类不包括的柔性材料">织物等的处理、洗涤、其他类不包括的柔性材料</a></li>

<li><a href="/patent_4_90/" title="绳、除电缆以外的缆索">绳、除电缆以外的缆索</a></li>

<li><a href="/patent_4_91/" title="造纸、纤维素的生产">造纸、纤维素的生产</a></li>

<li><a href="/patent_5_93/" title="道路、铁路或桥梁的建筑">道路、铁路或桥梁的建筑</a></li>

<li><a href="/patent_5_94/" title="水利工程、基础、疏浚">水利工程、基础、疏浚</a></li>

<li><a href="/patent_5_95/" title="给水、排水">给水、排水</a></li>

<li><a href="/patent_5_96/" title="建筑物">建筑物</a></li>

<li><a href="/patent_5_97/" title="锁、钥匙、门窗零件、保险箱">锁、钥匙、门窗零件、保险箱</a></li>

<li><a href="/patent_5_98/" title="一般门、窗、百叶窗或卷辊遮帘、梯子">一般门、窗、百叶窗或卷辊遮帘、梯子</a></li>

<li><a href="/patent_5_99/" title="土层或岩石的钻进、采矿">土层或岩石的钻进、采矿</a></li>

<li><a href="/patent_6_101/" title="一般机器或发动机、一般的发动机装置、蒸汽机">一般机器或发动机、一般的发动机装置、蒸汽机</a></li>

<li><a href="/patent_6_102/" title="燃烧发动机、热气或燃烧生成物的发动机装置">燃烧发动机、热气或燃烧生成物的发动机装置</a></li>

<li><a href="/patent_6_103/" title="液力机械或液力发动机、风力、弹力或重力发动机、其他类目中不包括的产生机械动力或反推力的发动机">液力机械或液力发动机、风力、弹力或重力发动机、其他类目中不包括的产生机械动力或反推力的发动机</a></li>

<li><a href="/patent_6_104/" title="液体变容式机械、液体泵或弹性流体泵">液体变容式机械、液体泵或弹性流体泵</a></li>

<li><a href="/patent_6_105/" title="流体压力执行机构、一般液压技术和气动技术">流体压力执行机构、一般液压技术和气动技术</a></li>

<li><a href="/patent_6_106/" title="工程元件或部件、为产生和保持机器或设备的有效运行的一般措施、一般绝热">工程元件或部件、为产生和保持机器或设备的有效运行的一般措施、一般绝热</a></li>

<li><a href="/patent_6_107/" title="气体或液体的贮存或分配">气体或液体的贮存或分配</a></li>

<li><a href="/patent_6_108/" title="照明">照明</a></li>

<li><a href="/patent_6_109/" title="蒸汽的发生">蒸汽的发生</a></li>

<li><a href="/patent_6_110/" title="燃烧设备、燃烧方法">燃烧设备、燃烧方法</a></li>

<li><a href="/patent_6_111/" title="供热、炉灶、通风">供热、炉灶、通风</a></li>

<li><a href="/patent_6_112/" title="制冷或冷却、加热和制冷的联合系统、热泵系统、冰的制造或储存、气体的液化或固化">制冷或冷却、加热和制冷的联合系统、热泵系统、冰的制造或储存、气体的液化或固化</a></li>

<li><a href="/patent_6_113/" title="干燥">干燥</a></li>

<li><a href="/patent_6_114/" title="炉、窑、烘烤炉、蒸馏炉">炉、窑、烘烤炉、蒸馏炉</a></li>

<li><a href="/patent_6_115/" title="一般热交换">一般热交换</a></li>

<li><a href="/patent_6_116/" title="武器">武器</a></li>

<li><a href="/patent_6_117/" title="弹药、爆破">弹药、爆破</a></li>

<li><a href="/patent_7_119/" title="测量、测试">测量、测试</a></li>

<li><a href="/patent_7_120/" title="光学">光学</a></li>

<li><a href="/patent_7_121/" title="摄影术、电影术、利用了光波以外其他波的类似技术、电记录术、全息摄影术">摄影术、电影术、利用了光波以外其他波的类似技术、电记录术、全息摄影术〔4〕</a></li>

<li><a href="/patent_7_122/" title="测时学">测时学</a></li>

<li><a href="/patent_7_123/" title="控制、调节">控制、调节</a></li>

<li><a href="/patent_7_124/" title="计算、推算、计数">计算、推算、计数</a></li>

<li><a href="/patent_7_125/" title="核算装置">核算装置</a></li>

<li><a href="/patent_7_126/" title="信号装置">信号装置</a></li>

<li><a href="/patent_7_127/" title="教育、密码术、显示、广告、印鉴">教育、密码术、显示、广告、印鉴</a></li>

<li><a href="/patent_7_128/" title="乐器、声学">乐器、声学</a></li>

<li><a href="/patent_7_129/" title="信息存储">信息存储</a></li>

<li><a href="/patent_7_130/" title="仪器的零部件">仪器的零部件</a></li>

<li><a href="/patent_7_131/" title="特别适用于特定应用领域的信息通信技术">特别适用于特定应用领域的信息通信技术</a></li>

<li><a href="/patent_7_132/" title="核物理、核工程">核物理、核工程</a></li>

<li><a href="/patent_8_134/" title="基本电气元件">基本电气元件</a></li>

<li><a href="/patent_8_136/" title="发电、变电或配电">发电、变电或配电</a></li>

<li><a href="/patent_8_137/" title="基本电子电路">基本电子电路</a></li>

<li><a href="/patent_8_138/" title="电通信技术">电通信技术</a></li>

<li><a href="/patent_8_140/" title="其他类目不包含的电技术">其他类目不包含的电技术</a></li>

<li><a href="/patent_9999_9999/" title="其他专利">其他专利</a></li>

</ul>

</div>

</div>

<div class="paging"></div>

</div>

</div>

<div style="clear: both;"></div>

<div style="display:none">

<p id="docid">06120112880702</p>

<span id="06120112880702down" data-source="6,"

data-out-id="CN112925968A," data-f-source-id="6" data-title="基于爬虫的数据抓取方法、装置、计算机设备及存储介质" data-price="10"

data-transnum="0" style="display:none;"></span></div>

<div class="xllindexfooter">

<div style="width: 1120px;margin: 0 auto;margin-top: 30px; ">

<div>

<div class="hotlinklisttitle">

<ul >

<li><a href="javascript:;">友情链接</a></li>

</ul>

</div>

<div class="hotlinklistcontent">

<div class="hotlinklistcontent1">

<ul style="overflow:hidden">

<li><a title="掌桥专利" href="https://zhuanli.zhangqiaokeyan.com/" target="_blank">掌桥专利</a></li>

<li><a title="科技查新" href="https://kejichaxin.zhangqiaokeyan.com/" target="_blank">科技查新</a></li>

<li><a title="掌桥科研" href="https://www.zhangqiaokeyan.com/" target="_blank">掌桥科研</a></li>

<li><a title="浸没式液冷" href="http://www.blueocean-china.net " target="_blank">浸没式液冷</a></li>

<li><a title="步入式恒温恒湿试验箱" href="http://www.deruitest.com" target="_blank">步入式恒温恒湿试验箱</a></li>

<li><a title="杭州室内设计培训" href="http://www.qingfengsheji.com" target="_blank">杭州室内设计培训</a></li>

<li><a title="散文精选" href="http://www.mangowenxue.com" target="_blank">散文精选</a></li>

<li><a title="管理博士" href="https://www.pxemba.com" target="_blank">管理博士</a></li>

</ul>

</div>

</div>

</div>

</div>

</div>

<div class="footer">

<p>

<a href="https://www.zhangqiaokeyan.com/about.html" title="关于我们">关于我们</a><span class="line">|</span>

<a onclick="window.open('https://103941.kefu.easemob.com/webim/im.html?configId=e4dad0df-e3b7-4d34-ba80-342ddc88f278','','width=980,height=600,left=529,top=261');" rel="nofollow" title="联系方式">联系方式</a><span

class="line"></span>

</p>

<p> 六维联合信息科技 (北京) 有限公司©版权所有,并保留所有权利。京ICP备15016152号-6 </p>

</div>

</body>

<script type="text/javascript" src="/js/jquery-1.12.4.js?v=5.1.1"></script>

<script type="text/javascript" src="/js/jquery.cookie.js?v=5.1.1"></script>

<script type="text/javascript" src="/js/common/variable.js?v=5.1.1"></script>

<script type="text/javascript" src="/js/common/tip.js?v=5.1.1"></script>

<script type="text/javascript" src="/js/common/login.js?v=5.1.1"></script>

<script type="text/javascript" src="/js/common/common.js?v=5.1.1"></script>

<script type="text/javascript" src="/js/common/lwlh_ajax.js?v=5.1.1"></script>

<script type="text/javascript" src="/js/common/down.js?v=5.1.1"></script>

<script type="text/javascript" src="/js/common/tj.js?v=5.1.1"></script>

<script type="text/javascript" src="https://www.zhangqiaokeyan.com/statistics/static/pagecollection.js"></script>

<script>

</script>

</html>