一种数据处理方法、装置、电子设备及存储介质

文献发布时间:2023-06-19 09:46:20

技术领域

本申请涉及数据处理领域,具体可应用于医疗技术领域,尤其涉及一种数据处理方法、一种数据处理装置、一种电子设备及一种计算机存储介质。

背景技术

目前,随着互联网的迅速发展,人们在日常生活中会接触到各个领域的文本信息。随着文本信息的增多,如何利用海量文本来挖掘出更多的业务需求所需要的信息是目前亟需解决的问题,也是目前自然语言研究的一个重要方向。

在自然语言研究领域的关系分类问题中,通常会先利用中文预训练模型对待处理文本进行处理,然后再利用关系分类模型确定待处理文本中各实体之间的关系。然而,现有方案确定的待处理文本中各实体之间关系的准确性较低。因此,如何提高关系分类问题中待处理文本中各实体之间关系的准确性是目前亟需解决的问题。

发明内容

本申请实施例提供了一种数据处理方法、装置、电子设备及可读存储介质,可以提高确定待处理文本的实体之间关系的准确性。

第一方面,本申请实施例提供了一种数据处理方法,该方法包括:

通过预创建的中文预训练模型对待处理文本进行数据处理,得到所述待处理文本对应的编码向量,所述编码向量包含所述待处理文本中各个分词的词素信息;所述预创建的中文预训练模型是通过各个知识领域的训练文本训练得到的;

基于所述待处理文本中各个分词的词素信息,确定所述待处理文本对应的知识领域信息;

调用关系分类模型对所述待处理文本对应的编码向量以及所述待处理文本对应的知识领域信息进行数据处理;

依照所述关系分类模型对所述编码向量和所述知识领域信息的数据处理结果,确定在目标知识领域所述待处理文本包含的各目标实体之间的关系类别;所述目标知识领域为所述知识领域信息指示的知识领域。

第二方面,本申请实施例提供了一种数据处理装置,该装置包括:

数据处理模块,用于通过预创建的中文预训练模型对待处理文本进行数据处理,得到所述待处理文本对应的编码向量,所述编码向量包含所述待处理文本中各个分词的词素信息;所述预创建的中文预训练模型是通过各个知识领域的训练文本训练得到的;

确定模块,用于基于所述待处理文本中各个分词的词素信息,确定所述待处理文本对应的知识领域信息;

数据处理模块还用于调用关系分类模型对所述待处理文本对应的编码向量以及所述待处理文本对应的知识领域信息进行数据处理;

确定模块还用于依照所述关系分类模型对所述编码向量和所述知识领域信息的数据处理结果,确定在目标知识领域所述待处理文本包含的各目标实体之间的关系类别;所述目标知识领域为所述知识领域信息指示的知识领域。

第三方面,本申请实施例提供了一种电子设备,包括处理器、输入设备、输出设备和存储器,所述处理器、输入设备、输出设备和存储器相互连接,其中,所述存储器用于存储计算机程序,所述计算机程序包括程序,所述处理器被配置用于调用所述程序,执行上述第一方面所述的方法。

第四方面,本申请实施例提供了一种计算机可读存储介质,所述可读存储介质存储有计算机程序,所述计算机程序包括程序指令,所述程序指令当被处理器执行时使所述处理器执行上述第一方面所述的方法。

在本申请实施例中,通过预创建的中文预训练模型对待处理文本进行数据处理,得到包含待处理文本中各个分词的词素信息的编码向量,然后基于待处理文本中各个分词的词素信息,确定待处理文本对应的知识领域信息;接着调用关系分类模型对待处理文本对应的编码向量以及待处理文本对应的知识领域信息进行数据处理;依照关系分类模型对编码向量和知识领域信息的数据处理结果,确定在目标知识领域待处理文本包含的各目标实体之间的关系类别。通过待处理文本中各个分词的词素信息,确定待处理文本对应的知识领域信息,可以根据知识领域信息确定知识领域内的目标关系分类模型,从而提高确定的待处理文本中目标实体之间关系的准确性。

附图说明

为了更清楚地说明本申请实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本申请的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

图1是本申请实施例提供的一种数据处理系统的架构示意图;

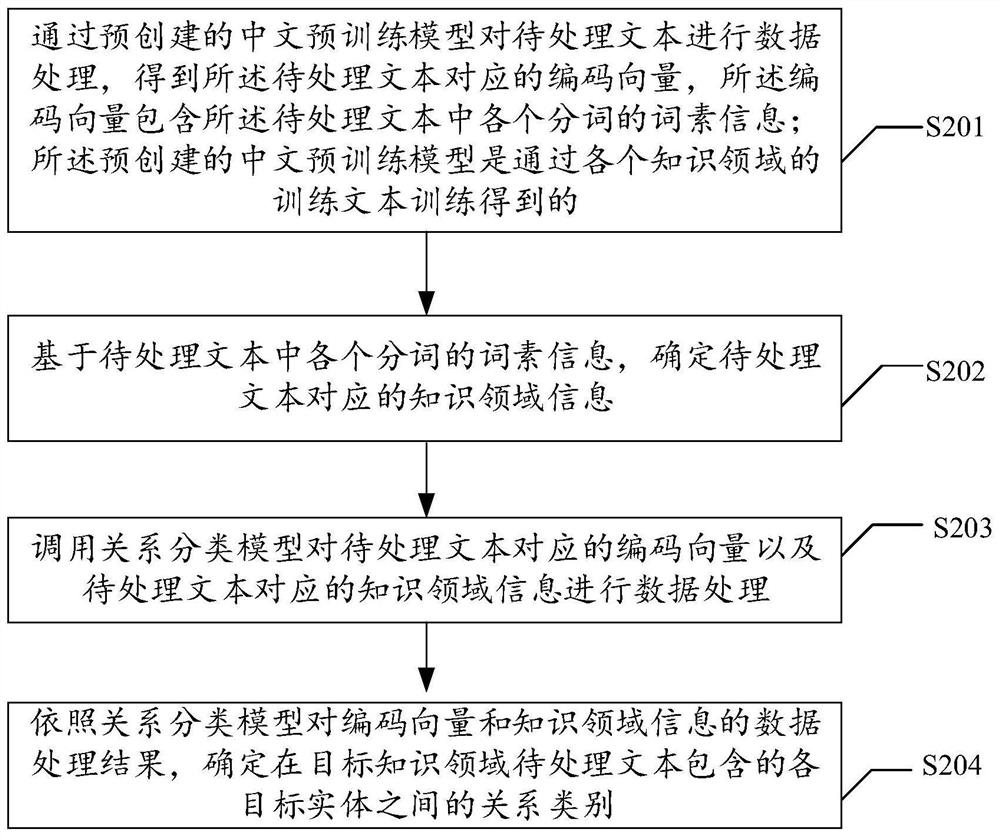

图2是本申请实施例提供的一种数据处理方法的流程示意图;

图3是本申请实施例提供的另一种数据处理方法的流程示意图;

图4A-4B是本申请实施例提供的中文预训练模型的结构示意图;

图5是本申请实施例提供的一种数据处理装置的结构示意图;

图6是本申请实施例提供的一种电子设备的结构示意图。

具体实施方式

下面将结合本申请实施例中的附图,对本申请实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本申请一部分实施例,而不是全部的实施例。基于本申请中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本申请保护的范围。

随着自然语言处理技术的研究和进步,自然语言处理技术在多个任务中展开研究和应用,例如网络管理任务、智能评分任务、关系分类任务等。随着技术的发展,自然语言处理技术将得到更多的应用,并发挥越来越重要的价值。基于此,本申请实施例在关系分类任务中提出了一种数据处理系统以及相应的数据处理方法;以更好对待处理文本进行数据处理,从而提高确定的待处理文本中各实体之间关系的准确性。

请参见图1,是本申请实施例提供的一种数据处理系统的架构示意图,该数据处理系统包括区块链网络10、电子设备102和数据处理平台103,其中:

区块链网络10是指用于进行节点与节点之间数据共享的网络,区块链网络中可以包括多个节点101。每个节点101在进行正常工作可以接收到输入信息,并基于接收到的输入信息维护区块链网络内的共享数据(即区块链)。为了保证区块链网络内的信息互通,每个节点之间可以存在信息连接,任意两个节点之间可以实现点对点(Peer To Peer,P2P)通信,具体可以通过有线通信链路或无线通信链路进行P2P通信。例如,当区块链网络中的任意节点接收到输入信息时,其他节点便根据共识算法获取该输入信息,将该输入信息作为共享数据中的数据进行存储,使得区块链网络中全部节点上存储的数据均一致。

电子设备102、数据处理平台103可以接入该区块链网络,并可以与区块链网络中的节点进行通信,例如,向节点发起数据获取等等。其中,电子设备102具体可以是智能手机、平板电脑、笔记本电脑、台式电脑、车载智能终端等,本申请实施例不做限定。

需要说明的是,图1中所示的节点的数目仅仅是示意性的,根据实际需要,可以部署任意数目的节点,电子设备102、数据处理平台103可以与区块链网络中的同一节点进行通信,也可以分别与区块链网络中的不同节点进行通信。

在一种可行的实施例中,用户可以通过电子设备102登录数据处理平台103,当想要确定待处理文本中实体之间的关系时,用户可以通过电子设备102提交对待处理文本的数据处理请求。

在一种可行的实施例中,数据处理平台103在接收到数据处理请求后,可以调用中文预训练模型以及关系分类模型对待处理文本进行数据处理,可以确定在目标知识领域该待处理文本包含的各目标实体之间的关系类别。

在一种可行的实施例中,数据处理平台103可以将中文预训练模型上传至区块链网络10,以便后续可以直接从区块链网络10中获取该中文预训练模型,并利用该中文预训练模型对待处理文本进行数据处理,得到包含待处理文本中各个分词的词素信息的编码向量,以便后续解决其他任务,如智能评分任务。

请参见图2,图2是本申请实施例基于图1所示的数据处理系统提供的一种数据处理方法的流程示意图,该数据处理方法应用于数据处理平台,该数据处理方法包括步骤S201-S204:

S201:通过预创建的中文预训练模型对待处理文本进行数据处理,得到待处理文本对应的编码向量。编码向量包含待处理文本中各个分词的词素信息;预创建的中文预训练模型是通过各个知识领域的训练文本训练得到的。

在一个可行的实施方式中,通过预创建的中文预训练模型先对待处理文本进行分词处理,得到待处理文本对应的分词序列,并获取分词序列中各分词的词素信息,基于分词序列中各分词的词素信息生成待处理文本的词素序列。对分词序列以及词素序列进行嵌入处理,得到嵌入向量以及词素向量,将词素向量注入嵌入向量得到目标嵌入向量,对目标嵌入向量进行编码得到待处理文本对应的编码向量。

其中,中文预训练模型是通过各个知识领域的训练文本训练得到的,例如医疗技术领域、通信领域、金融领域等。中文预训练模型可以包括基于循环神经网络(RerrentNeural Network,RNN)的语言向量模型(Embeddings from LanguageModel,ELMo)、通用语言模型微调(Universal Language Model Fine-tuning forText Classification,ULMFiT)、基于机器翻译模型的OpenAI(Generative Pre-Training,GPT)以及进行参数共享的轻量级BERT模型(即ALBERT模型)等。

其中,分词的词素信息可以理解为分词的语义信息,可以指示分词在文本中的作用。分词的词素信息中可以只包含一个词素,如分词“一”的词素信息中只包括词素“基数”;分词的词素信息中也可以包含两个或更多的词素,如分词“中国”的词素信息包括“中国”、“国家”、“亚洲”、“政治”和“地方”等。

S202:基于待处理文本中各个分词的词素信息,确定待处理文本对应的知识领域信息。

在一个可行的实施方式中,获取待处理文本中各个分词之间的上下文信息,然后根据各个分词对应的词素信息和各个分词之间的上下文信息确定待处理文本对应的知识领域信息。其中,知识领域信息可以是指示待处理文本所属的知识领域,还可以是指示待处理文本中的各个实体所属的知识领域。

其中,待处理文本中的分词的词素信息可以包括多个知识领域信息。例如,分词“苹果”的词素信息中可包括词素“水果”“电子品牌”。词素“水果”属于农业领域,词素“电子品牌”属于数码领域。因此需要根据各个分词对应的词素信息和各个分词之间的上下文信息确定待处理文本对应的知识领域信息。当待处理文本为“苹果成熟期多是在秋季”时,可以根据上下文信息中的分词“成熟期”确定待处理文本属于农业领域。当待处理文本为“乔布斯是苹果公司联合创始人之一”时,可以根据上下文信息中的分词“乔布斯”确定待处理文本属于数码领域。

S203:调用关系分类模型对待处理文本对应的编码向量以及待处理文本对应的知识领域信息进行数据处理。

在一个可行的实施方式中,可以根据知识领域信息确定该目标关系分类模型,该目标关系分类模型为知识领域信息指示的目标知识领域内的关系分类模型。然后调用目标关系分类模型对待处理文本的编码向量进行数据处理。其中,目标关系分类模型是通过目标知识领域内的训练样本训练得到的。

例如,可以通过通信领域内的训练样本训练得到通信领域的关系分类模型,可以通过医疗技术领域内的训练样本训练得到医疗技术领域的关系分类模型。在根据知识领域信息确定待处理文本属于医疗技术领域时,可以调用医疗技术领域内的关系分类模型对待处理文本进行数据处理。

S204:依照关系分类模型对编码向量和知识领域信息的数据处理结果,确定在目标知识领域待处理文本包含的各目标实体之间的关系类别。

在一个可行的实施方式中,可以通过关系分类模型(也可以叫做目标关系分类模型)确定在目标知识领域内各个关系类别的预测概率,将目标知识领域内各个关系类别的概率中的最大概率对应的关系类别作为待处理文本包含的目标实体之间的关系类别。

以医疗技术领域为例,待处理文本中的目标实体可以包括与疾病关联的第一实体和与药物关联的第二实体,关系分类模型的关系类别可以包括以下任一种或者多种:不良反应、治疗关系和无关系。例如待处理文本为“头孢菌素是β-内酰胺类抗生素中的一大类,主要用于治疗敏感细菌引起的各种细菌感染”。可以通过关系分类模型确定,与疾病关联的“第一实体“细菌感染”和与药物关联的第二实体“头孢菌素”之间各个关系类别的概率。将最大概率的关系类别“治疗关系”作为“细菌感染”与“头孢菌素”之间的关系类别,具体的治疗关系为:通过药物“头孢菌素”可以治疗疾病“细菌感染”。

在本申请实施例中,通过预创建的中文预训练模型对待处理文本进行数据处理,得到包含待处理文本中各个分词的词素信息的编码向量,然后基于待处理文本中各个分词的词素信息,确定待处理文本对应的知识领域信息;接着调用关系分类模型对待处理文本对应的编码向量以及待处理文本对应的知识领域信息进行数据处理;依照关系分类模型对编码向量和知识领域信息的数据处理结果,确定在目标知识领域待处理文本包含的各目标实体之间的关系类别。通过待处理文本中各个分词的词素信息,确定待处理文本对应的知识领域信息,可以根据知识领域信息确定知识领域内的目标关系分类模型,从而提升确定的待处理文本中目标实体之间的关系的准确性。

请参见图3,是本申请实施例基于图1所示的数据处理系统提供的另一种数据处理方法的流程示意图,该数据处理方法包括如下步骤:

S301:对待处理文本进行分词处理,得到待处理文本对应的分词序列。

在一个可行的实施方式中,可以根据前向字典树对待处理文本进行前向最大匹配分词,得到前向分词结果,以及根据后向字典树对待处理文本进行后向最大匹配分词,得到后向分词结果;判断前向分词结果的词数与后向分词结果的词数是否相同;若前向分词结果的词数与后向分词结果的词数相同,则将前向分词结果确定为待处理文本对应的分词序列;若前向分词结果的词数与后向分词结果的词数不相同,则将词数较少的分词结果确定为待处理文本的分词序列。

示例性的,若待处理文本为“中国的一部分”,那么对待处理文本进行分词处理得到的分词序列为““中国”“的”“一”“部分””。

S302:获取分词序列中各分词的词素信息,并基于分词序列中各分词的词素信息生成待处理文本的词素序列。

在一个可行的实施方式中,在确定了待处理文本的分词序列后,直接获取待处理文本的分词序列中各分词的词素信息,并基于分词序列中各分词的词素信息生成待处理文本的词素序列。

示例性的,若分词序列为““中国”“的”“一”“部分””,从知识库中获取到“中国”的词素信息为“国家、中国、亚洲、政治、地方”,“的”的词素信息为“的”,“一”的词素信息为“基数”,“部分”的词素信息为“部分”,那么生成待处理文本的词素序列为““国家、中国、亚洲、政治、地方”“的”“基数”“部分””。

在另一个可行的实施方式中,电子设备在确定了待处理文本的分词序列后,可以对待处理文本的分词序列去停用词得到更新后的分词序列,然后再获取待处理文本的更新后的分词序列中各分词的词素信息,并基于分词序列中各分词的词素信息生成待处理文本的词素序列。其中,停用词常为冠词、介词、副词或连词等。可以根据停用词表去除分词序列中的停用词。

示例性的,若分词序列为““中国”“的”“一”“部分””,那么经过去停词处理可以得到更新后的分词序列为““中国”“一”“部分””从知识库中获取到“中国”的词素信息为“国家、中国、亚洲、政治、地方”,“一”的词素信息为“基数”,“部分”的词素信息为“部分”,那么生成待处理文本的词素序列为““国家、中国、亚洲、政治、地方”“基数”“部分””。

在另一个可行的实施方式中,电子设备在确定了待处理文本的分词序列后,可以输出待处理文本的分词序列。当接收到用户针对待处理文本的确认消息时,获取待处理文本的分词序列中各分词的词素信息,并基于分词序列中各分词的词素信息生成待处理文本的词素序列。

可选的,待处理文本中各个分词对应的词素信息中可包括各个分词对应的至少一个词素。电子设备可以从知识库中获取待处理文本中各个分词对应的词素信息,例如通过flashtext从知网中文词库中获取待处理文本中各个分词对应的词素信息。

进一步的,若待处理文本的分词序列中的一个分词经过toknization处理后包含多个符号,那么这多个符号对应的词素信息相同,且这多个符号的词素信息均为该分词对应的词素信息。

例如,分词“中国”经过toknization处理后包含符号“中”和符号“国”,“中国”对应的词素信息包括“国家、中国、亚洲、政治、地方”,那么“中”对应的词素信息包括“国家、中国、亚洲、政治、地方”,“国”对应的词素信息包括“国家、中国、亚洲、政治、地方”。

S303:对分词序列以及词素序列进行嵌入处理,得到嵌入向量以及词素向量。

在一个可行的实施方式中,可以通过参数共享的轻量级BERT模型(即ALBERT模型)的嵌入层进行嵌入。该嵌入层可具体包括词嵌入层、位置嵌入层、类型嵌入层和语义嵌入层。词嵌入层用于将待处理文本的分词序列的各个符号转换为固定维度的词向量;位置嵌入层用于将待处理文本的分词序列的各个符号的位置信息转换为固定维度的位置向量;类型嵌入层用于将待处理文本的分词序列的各个符号的分类信息转换为固定维度的类型向量。最后根据各个符号的词向量、位置向量和类型向量确定各个符号的嵌入向量,进而可以确定待处理文本对应的嵌入向量。

词素嵌入层用于将待处理文本的分词序列的各个符号的词素信息转换为固定维度的词素向量,从而可以根据各个符号的词素向量确定待处理文本的词素向量。

S304:将词素向量注入嵌入向量得到目标嵌入向量。

在一个可行的实施方式中,依照嵌入向量以及词素向量确定至少一个目标参数;对至少一个目标参数进行线性变换得到至少一个线性向量;将至少一个线性向量进行放缩点积得到放缩点积向量,并对放缩点积向量进行线性变换得到目标嵌入向量。

例如,将嵌入向量作为Query输入参数,以及将词素向量作为Key输入参数和Value输入参数。对Query输入参数,Key输入参数,Value输入参数分别进行线性变换得到第一线性向量、第二线性向量和第三线性向量。然后将第一线性向量、第二线性向量和第三线性向量进行放缩点积h次,并将h次的放缩点积结果进行拼接得到放缩点积向量。对放缩点积向量进行线性变换得到目标嵌入向量。

S305:对目标嵌入向量进行编码得到待处理文本对应的编码向量。

在一个可行的实施方式中,可以直接通过参数共享的轻量级BERT模型(即ALBERT模型)的编码层对该目标嵌入向量进行编码得到编码向量。其中,编码层可以是具有前馈连接的多头自保持层。

可选的,步骤S301-S305可通过五层的中文预训练模型完成。请参见图4A,图4A示出了一种中文预训练模型的结构示意图。如图4A所示,该中文预训练模型可包括五层,第一层为输入层、第二层为嵌入层、第三层为第一多头注意力层、第四层为编码层、第五层为输出层。其中,输入层可用于对待处理文本进行分词处理,得到待处理文本对应的分词序列,以及获取分词序列中各分词的词素信息,并基于分词序列中各分词的词素信息生成待处理文本的词素序列;嵌入层用于对分词序列和词素序列进行嵌入处理得到分词序列对应的嵌入向量以及词素序列对应的词素向量;第一多头注意力层用于将词素向量注入嵌入向量得到目标嵌入向量;编码层用于对该目标嵌入向量进行编码处理得到编码向量;输出层用于输出编码向量。

在另一个可行的实施方式中,可以对目标嵌入向量进行编码生成待处理文本对应的初始编码向量,然后将词素向量注入初始编码向量得到待处理文本对应的编码向量。

可选的,可以依照初始编码向量以及词素向量确定至少一个目标参数;对至少一个目标参数进行线性变换得到至少一个线性向量;将至少一个线性向量进行放缩点积得到放缩点积向量,并对放缩点积向量进行线性变换得到编码向量。

例如,将初始编码向量作为Query输入参数,以及将词素向量作为Key输入参数和Value输入参数。对Query输入参数,Key输入参数,Value输入参数分别进行线性变换得到第四线性向量、第五线性向量和第六线性向量。然后将第四线性向量、第五线性向量和第六线性向量进行放缩点积h次,并将h次的放缩点积结果进行拼接得到放缩点积向量,对放缩点积向量进行线性变换得到编码向量。

可选的,步骤S301-S305可通过六层的中文预训练模型完成。请参见图4B,图4B示出了另一种中文预训练模型的结构示意图。如图4B所示,该中文预训练模型可包括六层。第一层为输入层、第二层为嵌入层、第三层为第一多头注意力层、第四层为编码层、第五层为第二多头注意力层、第六层为输出层。其中,输入层可用于对待处理文本进行分词处理,得到待处理文本对应的分词序列,以及获取分词序列中各分词的词素信息,并基于分词序列中各分词的词素信息生成待处理文本的词素序列;嵌入层用于对分词序列和词素序列进行嵌入处理得到分词序列对应的嵌入向量以及词素序列对应的词素向量;第一多头注意力层用于将词素向量注入嵌入向量得到目标嵌入向量;编码层用于对该目标嵌入向量进行编码处理得到初始编码向量;第二多头注意力层用于将词素向量注入初始编码向量得到编码向量;输出层用于输出编码向量。

S306:基于待处理文本中各个分词的词素信息,确定待处理文本对应的知识领域信息。

S307:调用关系分类模型对待处理文本对应的编码向量以及待处理文本对应的知识领域信息进行数据处理。

S308:依照关系分类模型对编码向量和知识领域信息的数据处理结果,确定在目标知识领域待处理文本包含的各目标实体之间的关系类别。

其中,步骤306-308可参照上述实施例图2中步骤202-204,在此不再赘述。

在本申请实施例中,对待处理文本进行分词处理,得到待处理文本对应的分词序列并获取分词序列中各分词的词素信息,基于分词序列中各分词的词素信息生成待处理文本的词素序列。对分词序列以及词素序列进行嵌入处理,得到嵌入向量以及词素向量。以及将词素向量注入嵌入向量得到目标嵌入向量,对目标嵌入向量进行编码得到待处理文本对应的编码向量。然后基于待处理文本中各个分词的词素信息,确定待处理文本对应的知识领域信息;接着调用关系分类模型对待处理文本对应的编码向量以及待处理文本对应的知识领域信息进行数据处理;依照关系分类模型对编码向量和知识领域信息的数据处理结果,确定在目标知识领域待处理文本包含的各目标实体之间的关系类别。将词素向量注入嵌入向量,使得编码向量中包含词素信息。在利用该包含词素信息的编码向量进行数据处理时,可以提高确定的待处理文本中目标实体之间关系的准确性。并且,通过待处理文本中各个分词的词素信息,确定待处理文本对应的知识领域信息,可以根据知识领域信息确定知识领域内的目标关系分类模型,使得由目标关系分类模型确定的待处理文本中目标实体之间的关系更准确。

请参见图5,图5为本申请实施例提供的一种数据处理装置的结构示意图。本实施例中所描述的数据处理装置,包括数据处理模块501、确定模块502。

数据处理模块501用于通过预创建的中文预训练模型对待处理文本进行数据处理,得到所述待处理文本对应的编码向量,所述编码向量包含所述待处理文本中各个分词的词素信息;所述预创建的中文预训练模型是通过各个知识领域的训练文本训练得到的。

确定模块502用于基于所述待处理文本中各个分词的词素信息,确定所述待处理文本对应的知识领域信息。

数据处理模块501还用于调用关系分类模型对所述待处理文本对应的编码向量以及所述待处理文本对应的知识领域信息进行数据处理。

确定模块502还用于依照所述关系分类模型对所述编码向量和所述知识领域信息的数据处理结果,确定在目标知识领域所述待处理文本包含的各目标实体之间的关系类别;所述目标知识领域为所述知识领域信息指示的知识领域。

在一些可行的实施方式中,数据处理模块501通过预创建的中文预训练模型对待处理文本进行数据处理,得到所述待处理文本对应的编码向量,具体包括:

对所述待处理文本进行分词处理,得到所述待处理文本对应的分词序列;

获取所述分词序列中各分词的词素信息,并基于所述分词序列中各分词的词素信息生成所述待处理文本的词素序列;

对所述分词序列以及所述词素序列进行嵌入处理,得到嵌入向量以及词素向量;

将所述词素向量注入所述嵌入向量得到目标嵌入向量;

对所述目标嵌入向量进行编码得到所述待处理文本对应的编码向量。

在一些可行的实施方式中,所述分词序列中的任一分词包含至少一个符号,所述至少一个符号的词素信息相同。

在一些可行的实施方式中,数据处理模块501将所述词素向量注入所述嵌入向量得到目标嵌入向量,包括:

依照所述嵌入向量以及所述词素向量确定至少一个目标参数;

对所述至少一个目标参数进行线性变换得到至少一个线性向量;

将所述至少一个线性向量进行放缩点积得到放缩点积向量,并对所述放缩点积向量进行线性变换得到所述目标嵌入向量。

在一些可行的实施方式中,数据处理模块501对所述待处理文本进行分词处理,得到所述待处理文本对应的分词序列,包括:

根据前向字典树对所述待处理文本进行前向最大匹配分词,得到前向分词结果;

根据后向字典树对所述待处理文本进行后向最大匹配分词,得到后向分词结果;

判断所述前向分词结果的词数与所述后向分词结果的词数是否相同;

若所述前向分词结果的词数与所述后向分词结果的词数相同,则将所述前向分词结果确定为所述待处理文本对应的分词序列;若所述前向分词结果的词数与所述后向分词结果的词数不相同,则将词数较少的分词结果确定为所述待处理文本的分词序列。

在一些可行的实施方式中,数据处理模块501对所述目标嵌入向量进行编码得到所述待处理文本对应的编码向量包括:

对所述目标嵌入向量进行编码生成所述待处理文本对应的初始编码向量;

将所述词素向量注入所述初始编码向量得到所述待处理文本对应编码向量。

在一些可行的实施方式中,确定模块502基于所述待处理文本中各个分词的词素信息,确定所述待处理文本对应的知识领域信息,包括:

获取所述待处理文本中各个分词之间的上下文信息;

根据所述各个分词对应的词素信息和所述各个分词之间的上下文信息确定所述待处理文本对应的知识领域信息。

可以理解的是,本实施例的数据处理装置的各功能模块可根据上述方法实施例图2或者图3中的方法具体实现,其具体实现过程可以参照上述方法实施例图2或者图3的相关描述,此处不再赘述。

本实施例可以适用于医疗技术领域。在本申请实施例中,通过预创建的中文预训练模型对待处理文本进行数据处理,得到包含待处理文本中各个分词的词素信息的编码向量,然后基于待处理文本中各个分词的词素信息,确定待处理文本对应的知识领域信息;接着调用关系分类模型对待处理文本对应的编码向量以及待处理文本对应的知识领域信息进行数据处理;依照关系分类模型对编码向量和知识领域信息的数据处理结果,确定在目标知识领域待处理文本包含的各目标实体之间的关系类别。通过待处理文本中各个分词的词素信息,确定待处理文本对应的知识领域信息,可以根据知识领域信息确定知识领域内的目标关系分类模型,从而提升确定的待处理文本中目标实体之间的关系的准确性。

请参阅图6,图6为本申请实施例提供的一种电子设备的结构示意图。该电子设备可以包括:一个或多个处理器601;一个或多个输入设备602,一个或多个输出设备603和存储器604。上述处理器601、输入设备602、输出设备603和存储器604通过总线605连接。存储器604用于存储计算机程序,所述计算机程序包括程序指令,处理器601用于执行存储器604存储的程序指令,执行以下操作:

通过预创建的中文预训练模型对待处理文本进行数据处理,得到所述待处理文本对应的编码向量,所述编码向量包含所述待处理文本中各个分词的词素信息;所述预创建的中文预训练模型是通过各个知识领域的训练文本训练得到的;

基于所述待处理文本中各个分词的词素信息,确定所述待处理文本对应的知识领域信息;

调用关系分类模型对所述待处理文本对应的编码向量以及所述待处理文本对应的知识领域信息进行数据处理;

依照所述关系分类模型对所述编码向量和所述知识领域信息的数据处理结果,确定在目标知识领域所述待处理文本包含的各目标实体之间的关系类别;所述目标知识领域为所述知识领域信息指示的知识领域。

在一些可行的实施方式中,处理器601通过预创建的中文预训练模型对待处理文本进行数据处理,得到所述待处理文本对应的编码向量,包括:

对所述待处理文本进行分词处理,得到所述待处理文本对应的分词序列;

获取所述分词序列中各分词的词素信息,并基于所述分词序列中各分词的词素信息生成所述待处理文本的词素序列;

对所述分词序列以及所述词素序列进行嵌入处理,得到嵌入向量以及词素向量;

将所述词素向量注入所述嵌入向量得到目标嵌入向量;

对所述目标嵌入向量进行编码得到所述待处理文本对应的编码向量。

在一些可行的实施方式中,所述分词序列中的任一分词包含至少一个符号,所述至少一个符号的词素信息相同。

在一些可行的实施方式中,处理器601将所述词素向量注入所述嵌入向量得到目标嵌入向量,包括:

依照所述嵌入向量以及所述词素向量确定至少一个目标参数;

对所述至少一个目标参数进行线性变换得到至少一个线性向量;

将所述至少一个线性向量进行放缩点积得到放缩点积向量,并对所述放缩点积向量进行线性变换得到所述目标嵌入向量。

在一些可行的实施方式中,处理器601对所述待处理文本进行分词处理,得到所述待处理文本对应的分词序列,包括:

根据前向字典树对所述待处理文本进行前向最大匹配分词,得到前向分词结果;

根据后向字典树对所述待处理文本进行后向最大匹配分词,得到后向分词结果;

判断所述前向分词结果的词数与所述后向分词结果的词数是否相同;

若所述前向分词结果的词数与所述后向分词结果的词数相同,则将所述前向分词结果确定为所述待处理文本对应的分词序列;若所述前向分词结果的词数与所述后向分词结果的词数不相同,则将词数较少的分词结果确定为所述待处理文本的分词序列。

在一些可行的实施方式中,处理器601对所述目标嵌入向量进行编码得到所述待处理文本对应的编码向量包括:

对所述目标嵌入向量进行编码生成所述待处理文本对应的初始编码向量;

将所述词素向量注入所述初始编码向量得到所述待处理文本对应编码向量。

在一些可行的实施方式中,处理器601基于所述待处理文本中各个分词的词素信息,确定所述待处理文本对应的知识领域信息,包括:

获取所述待处理文本中各个分词之间的上下文信息;

根据所述各个分词对应的词素信息和所述各个分词之间的上下文信息确定所述待处理文本对应的知识领域信息。

应当理解,在本申请实施例中,所称处理器601可以是中央处理单元(CentralProcessing Unit,CPU),该处理器601还可以是其他通用处理器、数字信号处理器(DigitalSignal Processor,DSP)、专用集成电路(Application Specific Integrated Circuit,ASIC)、现成可编程门阵列(Field-Programmable Gate Array,FPGA)或者其他可编程逻辑器件、分立门或者晶体管逻辑器件、分立硬件组件等。通用处理器可以是微处理器或者该处理器也可以是任何常规的处理器等。

该存储器604可以包括只读存储器和随机存取存储器,并向处理器601提供指令和数据。存储器604的一部分还可以包括非易失性随机存取存储器。该存储器604可用于存储知识领域信息、中文预训练模型等。

具体实现中,本申请实施例中所描述的处理器601、输入设备602、输出设备603和存储器604可执行本申请实施例提供的数据处理方法所描述的实现方式,也可执行本申请实施例所描述的数据处理装置的实现方式,在此不再赘述。

本实施例可以适用于医疗技术领域。在本申请实施例中,通过预创建的中文预训练模型对待处理文本进行数据处理,得到包含待处理文本中各个分词的词素信息的编码向量,然后基于待处理文本中各个分词的词素信息,确定待处理文本对应的知识领域信息;接着调用关系分类模型对待处理文本对应的编码向量以及待处理文本对应的知识领域信息进行数据处理;依照关系分类模型对编码向量和知识领域信息的数据处理结果,确定在目标知识领域待处理文本包含的各目标实体之间的关系类别。通过待处理文本中各个分词的词素信息,确定待处理文本对应的知识领域信息,可以根据知识领域信息确定知识领域内的目标关系分类模型,从而提升确定的待处理文本中目标实体之间的关系的准确性。

本申请实施例中还提供一种计算机可读存储介质,所述计算机可读存储介质存储有计算机程序,所述计算机程序包括程序指令,所述程序指令被处理器执行时,可执行上述数据处理方法实施例中所执行的步骤。

本申请实施例还提供一种计算机程序产品,所述计算机程序产品包括计算机程序代码,当所述计算机程序代码在计算机上运行时,使得计算机执行上述数据处理方法实施例中所执行的步骤。

本领域普通技术人员可以理解实现上述实施例方法中的全部或部分流程,是可以通过计算机程序来指令相关的硬件来完成,所述的程序可存储于一计算机可读取存储介质中,该程序在执行时,可包括如上述各方法的实施例的流程。其中,所述的存储介质可为磁碟、光盘、只读存储记忆体(Read-Only Memory,ROM)或随机存储记忆体(Random AccessMemory,RAM)等。所述的计算机可读存储介质可主要包括存储程序区和存储数据区,其中,存储程序区可存储操作系统、至少一个功能所需的应用程序等;存储数据区可存储根据区块链节点的使用所创建的数据等。

其中,本申请所指区块链是分布式数据存储、点对点传输、共识机制、加密算法等计算机技术的新型应用模式。区块链(Blockchain),本质上是一个去中心化的数据库,是一串使用密码学方法相关联产生的数据块,每一个数据块中包含了一批次网络交易的信息,用于验证其信息的有效性(防伪)和生成下一个区块。区块链可以包括区块链底层平台、平台产品服务层以及应用服务层等。

以上所揭露的仅为本申请一种较佳实施例而已,当然不能以此来限定本申请之权利范围,本领域普通技术人员可以理解实现上述实施例的全部或部分流程,并依本申请权利要求所作的等同变化,仍属于发明所涵盖的范围。

- 一种数据处理方法、装置、电子设备和存储介质

- 一种图像数据处理方法、装置、电子设备及其存储介质