视频的生成方法、装置及设备

文献发布时间:2023-06-19 11:27:38

技术领域

本发明涉及视频处理技术领域,尤其涉及一种视频的生成方法、装置及设备。

背景技术

连续的图像变化每秒超过24帧(frame)画面以上时,根据视觉暂留原理,人眼无法辨别单幅的静态画面,看上去是平滑连续的视觉效果,这样连续的画面叫做视频。由于视频通常由静态的背景和动态的前景构成,因此,在制作视频时,一般会需要前期拍摄和后期处理两个部分。然而,这样的视频制作方式存在以下缺点:不同的视频需要不同的视频脚本,需要根据视频脚本进行重新拍摄,并且,视频通常会需要模特、主持人或者演员,演员档期需要提前排定,视频的生成效率较低,成本较高。

发明内容

本发明实施例提供了一种视频的生成方法、装置及设备,能够提高视频的生成效率,降低成本,并且还可以针对不同用户的需求生成不同的视频,满足了用户的个性化需求。

第一方面,本发明实施例提供一种视频的生成方法,包括:

获取待播报信息;

确定与所述待播报信息相对应的数据对象的形象;

根据所述待播报信息确定与所述数据对象的形象相对应的面部表情参数;

利用所述面部表情参数驱动所述数据对象的形象进行动作,生成与所述待播报信息相对应的视频。

第二方面,本发明实施例提供一种视频的生成装置,包括:

获取模块,用于获取待播报信息;

确定模块,用于确定与所述待播报信息相对应的数据对象的形象;

所述确定模块,还用于根据所述待播报信息确定与所述数据对象的形象相对应的面部表情参数;

处理模块,用于利用所述面部表情参数驱动所述数据对象的形象进行动作,生成与所述待播报信息相对应的视频。

第三方面,本发明实施例提供一种电子设备,包括:存储器、处理器;其中,所述存储器用于存储一条或多条计算机指令,其中,所述一条或多条计算机指令被所述处理器执行时实现上述第一方面中的视频的生成方法。

第四方面,本发明实施例提供了一种计算机存储介质,用于储存计算机程序,所述计算机程序使计算机执行时实现上述第一方面中的视频的生成方法。

本实施例提供的视频的生成方法、装置及设备,通过获取待播报信息,确定与所述待播报信息相对应的数据对象的形象,根据所述待播报信息确定与所述数据对象的形象相对应的面部表情参数,而后可以利用所述面部表情参数驱动所述数据对象的形象进行动作,生成与所述待播报信息相对应的视频,从而实现了可以针对不同用户的需求生成不同的视频,这样不仅保证了视频生成的质量,并且也提高了视频的生成效率,降低了视频制作成本,从而满足了用户的视频制作需求,有效地提高了该方法使用的灵活可靠性,有利于市场的推广与应用。

附图说明

为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作一简单地介绍,显而易见地,下面描述中的附图是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

图1为本发明实施例提供的一种视频的生成方法的流程图一;

图2为本发明实施例提供的确定与所述待播报信息相对应的数据对象的形象的流程图一;

图3为本发明实施例提供的确定与所述待播报信息相对应的数据对象的形象的流程图二;

图4为本发明实施例提供的一种视频的生成方法的流程图二;

图5为本发明实施例提供的根据所述待播报信息确定与所述数据对象的形象相对应的面部表情参数的流程图;

图6为本发明实施例提供的基于所述预设语音信息生成与数据对象的形象相对应的面部表情参数的流程图;

图7为本发明实施例提供的利用所述面部表情参数驱动所述数据对象的形象进行动作,生成与所述待播报信息相对应的视频的流程图一;

图8为本发明实施例提供的利用所述面部表情参数驱动所述数据对象的形象进行动作,生成与所述待播报信息相对应的视频的流程图二;

图9为本发明实施例提供的获取视频背景信息的流程图;

图10为本发明实施例提供的一种视频的生成方法的流程图三;

图11为本发明实施例提供的一种视频的生成方法的流程图四;

图12为本发明实施例提供的获取用于进行场景切换的转场音视频的流程图;

图13为本发明实施例提供的一种视频的生成方法的流程图四;

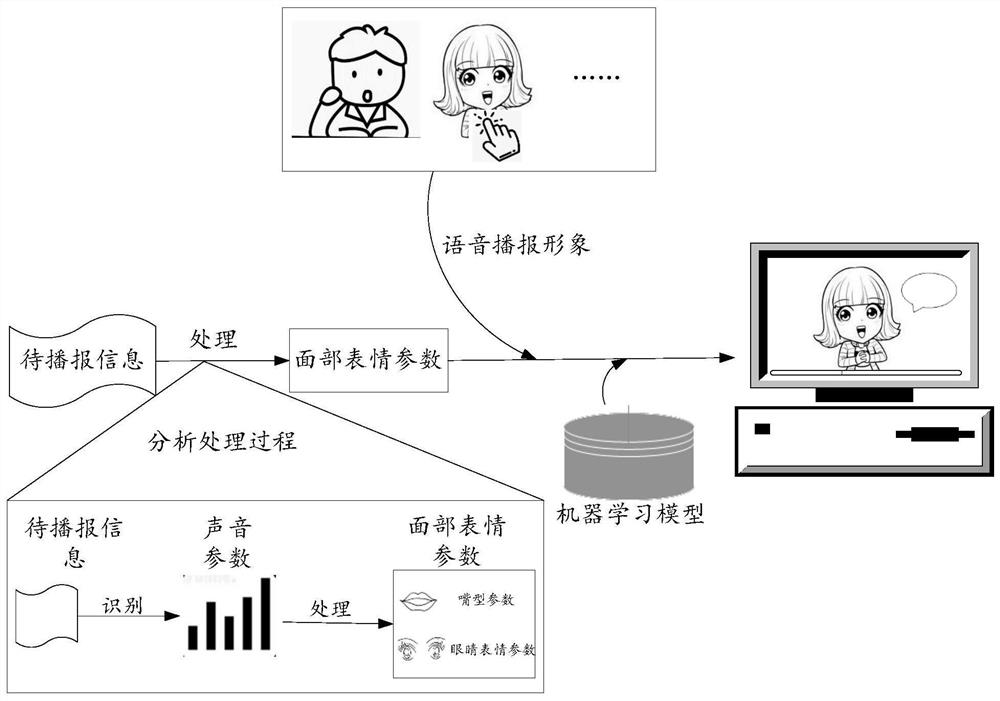

图14为本发明实施例提供的一种视频的生成方法的示意图一;

图15为本发明实施例提供的一种视频的生成方法的示意图二;

图16为本发明实施例提供的一种视频的生成装置的结构示意图;

图17为与图16所示实施例提供的视频的生成装置对应的电子设备的结构示意图。

具体实施方式

为使本发明实施例的目的、技术方案和优点更加清楚,下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有作出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

在本发明实施例中使用的术语是仅仅出于描述特定实施例的目的,而非旨在限制本发明。在本发明实施例和所附权利要求书中所使用的单数形式的“一种”、“所述”和“该”也旨在包括多数形式,除非上下文清楚地表示其他含义,“多种”一般包含至少两种,但是不排除包含至少一种的情况。

应当理解,本文中使用的术语“和/或”仅仅是一种描述关联对象的关联关系,表示可以存在三种关系,例如,A和/或B,可以表示:单独存在A,同时存在A和B,单独存在B这三种情况。另外,本文中字符“/”,一般表示前后关联对象是一种“或”的关系。

取决于语境,如在此所使用的词语“如果”、“若”可以被解释成为“在……时”或“当……时”或“响应于确定”或“响应于检测”。类似地,取决于语境,短语“如果确定”或“如果检测(陈述的条件或事件)”可以被解释成为“当确定时”或“响应于确定”或“当检测(陈述的条件或事件)时”或“响应于检测(陈述的条件或事件)”。

还需要说明的是,术语“包括”、“包含”或者其任何其他变体意在涵盖非排他性的包含,从而使得包括一系列要素的商品或者系统不仅包括那些要素,而且还包括没有明确列出的其他要素,或者是还包括为这种商品或者系统所固有的要素。在没有更多限制的情况下,由语句“包括一个……”限定的要素,并不排除在包括所述要素的商品或者系统中还存在另外的相同要素。

另外,下述各方法实施例中的步骤时序仅为一种举例,而非严格限定。

术语定义:

声音参数,包括声音频率信息、音调信息、音色信息以及音量信息等等,其中,声音频率信息低,相应的音调就低,声音就越低沉;声音频率信息高,相应的音调就高,声音就越尖锐;音调信息用于标识声音频率信息的高低,其与声源每秒钟振动的次数有关;音色信息是指声音的色彩和特点,不同的人和不同的乐器都会发出各具特色的声音,其与声源振动的频谱有关;音量是指声音的强度或响度,用于标识声音的强弱程度。

为了便于理解本申请的技术方案,下面对现有技术进行简要说明:

在对视频进行制作时,一般会需要前期拍摄和后期处理两个部分。然而,这样的视频生成方式存在以下缺点:(a)不同的视频需要不同的视频脚本,并需要根据视频脚本进行重新拍摄,视频的制作周期较长,制作成本较高;(b)视频通常会需要模特、主持人或者演员,演员档期需要提前排定,拍摄成本较高;(c)在获得拍摄视频后,需要对拍摄视频进行后期处理,例如:配字幕、做效果等处理,视频的制作效率较低,成本较高。

下面结合附图,对本发明的一些实施方式作详细说明。在各实施例之间不冲突的情况下,下述的实施例及实施例中的特征可以相互组合。

图1为本发明实施例提供的一种视频的生成方法的流程图;参考附图1所示,本实施例提供了一种视频的生成方法,该生成方法的执行主体是视频的生成装置,可以理解的是,该生成装置可以实现为软件、或者软件和硬件的组合。具体的,该视频的生成方法可以包括:

S101:获取待播报信息。

其中,待播报信息可以用于限定视频中的播报音频内容,也即:在生成与待播报信息相对应的视频时,视频中所播报的音频内容与待播报信息中的内容相一致,具体应用时,待播报信息包括以下至少之一:待播报文本、待播报语音。

另外,本实施例对于待播报信息的具体获取方式不做限定,本领域技术人员可以根据具体的应用需求和设计需求进行设置,可以理解的是,不同类型的待播报信息可以对应有不同的获取方式。例如:在待播报信息为待播报文本时,该待播报文本可以是用户直接输入至生成装置,或者,待播报文本也可以是通过其他装置发送至生成装置,或者,用户可以对生成装置输入相应的执行操作,从而根据执行操作生成待播报文本等等;或者,在用户对生成装置输入待播报语音,而后对待播报语音进行分析识别,从而可以获得与待播报语音相对应的待播报文本。在待播报信息为待播报语音时,该待播报语音可以是用户直接输入至生成装置,此时的生成装置中可以包括有用于接收语音信息的语音接收装置;或者,待播报语音也可以是通过其他装置发送至生成装置。当然的,本领域技术人员也可以采用其他的方式来获取到待播报信息,只要能够保证待播报信息获取的准确可靠性即可,在此不再赘述。

S102:确定与待播报信息相对应的数据对象的形象。

在获取到待播报信息之后,则说明用户存在生成视频的需求。此时,可以先确定与视频相对应的数据对象的形象,其中,数据对象的形象用于对待播报信息进行播放。可以想到的是,数据对象的形象的个数可以为一个或多个;而所确定的数据对象的形象可以是三维或者二维的人物形象、动物形象或者卡通形象等等,本领域技术人员可以根据具体的应用需求来确定与待播报信息相对应的数据对象的形象。具体的,参考附图2所示,一种可实现确定与待播报信息相对应的数据对象的形象的方式包括:

S1021:获取用户针对预设的多个播报形象输入的执行操作。

S1022:根据执行操作在多个播报形象中确定与待播报信息相对应的数据对象的形象。

具体的,在视频的生成装置中,可以预先设置有多个播报形象,用户可以针对多个播报形象中的任意一个或几个输入相应的执行操作,该执行操作可以为触控操作,例如:滑动操作、点选操作等等;在获取到用户针对多个播报形象输入的执行操作之后,则可以根据执行操作在多个播报形象中确定至少一个与待播报信息相对应的数据对象的形象。举例来说:预先设置有播报形象a、播报形象b和播报形象c,在用户针对播报形象b输入了点选操作,从而则可以根据点选操作将播报形象b确定为与待播报信息相对应的数据对象的形象。或者,在用户针对播报形象a和播报形象b输入了点选操作时,则可以根据点选操作将播报形象a和播报形象b同时确定为与待播报信息相对应的数据对象的形象。

本实施例中提供的确定与待播报信息相对应的数据对象的形象的方式,实现方式简单,用户操作方便,从而有效地提高了对数据对象的形象进行确定的质量和效率,进一步提高了视频的生成效率。

此外,参考附图3所示,另一种可实现确定与待播报信息相对应的数据对象的形象的方式包括:

S1023:获取用户输入的形象配置参数。

S1024:根据形象配置参数生成与待播报信息相对应的数据对象的形象。

具体的,为了满足不同用户对数据对象的形象的个性化需求,视频的生成装置可以支持对数据对象的形象的个性化定制操作;具体的,该生成装置中预先存储有用于生成数据对象的形象的配置数据库,用户可以在配置数据库的设定参数范围内选择或者输入相对应的形象配置参数,在视频的生成装置获取到用户输入的形象配置参数之后,可以根据形象配置参数生成至少一个与待播报信息相对应的数据对象的形象。

本实施例中提供的确定与待播报信息相对应的数据对象的形象的方式,实现方式简单、可靠,并且可以满足不同用户对数据对象的形象的个性化需求,进而提高了该方法使用的灵活可靠性,保证了视频的生成质量和效率。

S103:根据待播报信息确定与数据对象的形象相对应的面部表情参数。

在获取到待播报信息之后,可以对待播报信息进行分析处理,从而可以确定与数据对象的形象相对应的面部表情参数,其中,面部表情参数可以包括以下至少之一:嘴型参数、眼睛参数、脸部参数。具体的,本实施例中对于根据待播报信息确定与数据对象的形象相对应的面部表情参数的具体实现方式不做限定,本领域技术人员可以根据具体的应用需求和设计需求进行设置,例如:可以利用预设的机器学习算法对待播报信息进行分析处理,从而可以确定与数据对象的形象相对应的面部表情参数。

具体应用时,在待播报形象的个数为多个时,例如:待播报形象为两个,而待播报信息为一个时,此时,本实施例中的方法还可以包括:对待播报信息进行划分处理,获得与每个待播报形象相对应的子播报信息,需要注意的是,所有待播报信息所对应的子播报信息可以构成一个完成的待播报信息;而后,对于每个待播报形象而言,可以基于所对应的子播报信息的内容来确定与数据对象的形象相对应的面部表情参数。举例来说:待播报形象包括待播报形象a和待播报形象b,而后可以对待播报信息进行划分处理,例如:将待播报信息中的奇数自然段中的数据确定为与待播报形象a所对应的子播报信息A,将待播报信息中偶数自然段中的数据确定为与待播报形象b所对应的子播报信息B;而后可以基于子播报信息确定与所对应的数据对象的形象的面部表情参数。

S104:利用面部表情参数驱动数据对象的形象进行动作,生成与待播报信息相对应的视频。

在获取到面部表情参数之后,可以基于面部表情参数驱动数据对象的形象进行动作,例如:可以利用面部表情参数驱动数据对象的形象的嘴巴进行张开和闭合的动作,利用面部表情参数驱动数据对象的形象的眼睛进行睁眼和闭眼的动作,利用面部表情参数驱动数据对象的形象的面部进行微笑或者严肃的动作等等;从而可以生成与待播报信息相对应的视频。

具体应用时,在待播报形象的个数为多个时,例如:待播报形象包括第一播报形象和第二播报形象时,本实施例中的利用面部表情参数驱动数据对象的形象进行动作,生成与待播报信息相对应的视频还可以包括:确定与第一播报形象相对应的第一面部表情参数、以及与第二播报形象相对应的第二面部表情参数,基于待播报信息确定第一面部表情参数与第二面部表情参数的时序信息;基于所述时序信息,利用第一面部表情参数驱动第一播报形象进行动作,利用第二面部表情参数驱动第二播报形象进行动作,此时,第一播报形象所生成的动作与第二播报形象所生成的动作满足上述的时序信息,从而可以生成与待播报信息相对应的视频。

在另一些实例中,利用面部表情参数驱动数据对象的形象进行动作,生成与待播报信息相对应的视频可以包括:利用面部表情参数驱动数据对象的形象进行动作,生成多种不同播放格式、不同播放风格的视频,获取用户针对任意的视频所输入的执行操作,根据所述执行操作确定与待播报信息相对应的目标视频。

举例来说,在获取到面部表情参数之后,可以利用预设算法基于面部标签参数驱动数据对象的形象进行动作,生成多种不同播放格式的视频,例如:生成运动图像专家组格式(Moving Picture Experts Group,简称MPEG格式)、音频视频交错格式(Audio VideoInterleaved,简称AVI格式)、高级流格式(Advanced Streaming Format,简称ASF)、流媒体格式(Windows Media Video,简称WMV格式)、3G流媒体-3GP、视频流媒体格式(FlashVideo,简称FLV格式)等等播放格式的视频,而后获取用户针对上述任意一个格式的视频所输入的确认操作,则可以基于上述的确认操作生成相应格式的与待播报信息相对应的目标视频。

或者,在获取到面部表情参数之后,可以利用预设算法基于面部标签参数驱动数据对象的形象进行动作,生成多种不同播放风格的视频,例如:生成不同场景风格的视频、不同画面色调的视频、不同视觉效果的视频、不同人物色调的视频等等,而后获取用户针对上述任意一个播放风格的视频所输入的确认操作,则可以基于上述的确认操作生成相应格式的与待播报信息相对应的目标视频。本实施例中,在与待播报信息相对应的视频的过程中,可以生成多个待选择的不同风格、不同格式的视频,而后,通过获取用户输入的执行操作来选择相应的视频,从而实现了基于与用户的交互操作来选择与待播报信息相对应的目标视频,从而保证了所生成的视频可以满足用户的使用需求和设计需求,进一步提高了视频生成的质量和效率。

本实施例提供的视频的生成方法,通过获取待播报信息,确定与所述待播报信息相对应的数据对象的形象,根据所述待播报信息确定与所述数据对象的形象相对应的面部表情参数,而后可以利用所述面部表情参数驱动所述数据对象的形象进行动作,生成与所述待播报信息相对应的视频,从而实现了可以针对不同用户的需求生成不同的视频,这样不仅保证了视频生成的质量,并且也提高了视频的生成效率,降低了视频制作成本,从而满足了用户的视频制作需求,有效地提高了该方法使用的灵活可靠性,有利于市场的推广与应用。

图4为本发明实施例提供的一种视频的生成方法的流程图二;在上述实施例的基础上,继续参考附图4所示,在确定与待播报信息相对应的数据对象的形象之后,本实施例中的方法还可以包括:

S201:确定数据对象的形象的姿态信息。

S202:控制数据对象的形象以所确定的姿态信息在视频中进行显示。

其中,姿态信息可以包括站姿信息、坐姿信息、全身姿态信息、半身姿态信息、头部姿态信息等等;该数据对象的形象的姿态信息可以是用户直接输入至生成装置的,或者,姿态信息也可以是通过其他装置发送至生成装置的,或者,用户可以对生成装置输入相应的执行操作,从而根据执行操作生成数据对象的形象的姿态信息等等。例如:在生成装置中预先存储有多个姿态信息,获取用户针对多个姿态信息输入的执行操作,将与该执行操作相对应的姿态信息确定为数据对象的形象的姿态信息。在确定数据对象的形象的姿态信息之后,而后可以控制数据对象的形象以所确定的姿态信息在视频中进行显示,从而有效地实现了用户可以根据不同的需求对视频中数据对象的形象的姿态信息进行调整,从而保证了数据对象的形象在视频中显示效果的多样性,以生成满足不同用户需求的视频,保证了视频的播放显示效果,进一步提高了该方法的实用性。

图5为本发明实施例提供的根据待播报信息确定与数据对象的形象相对应的面部表情参数的流程图;在上述实施例的基础上,继续参考附图5所示,本实施例对于根据待播报信息确定与数据对象的形象相对应的面部表情参数的具体实现方式不做限定,本领域技术人员可以根据具体的应用需求和设计需求进行设置,较为优选的,本实施例中的根据待播报信息确定与数据对象的形象相对应的面部表情参数可以包括:

S1031:将待播报信息转换为相对应的预设语音信息。

S1032:基于预设语音信息生成与数据对象的形象相对应的面部表情参数。

具体的,在获取到待播报信息之后,可以从文本到语音TTS技术对待播报信息进行分析处理,从而可以将待播报信息转换为相对应的预设语音信息,该预设语音信息的播报声音为视频的生成装置中预先存储的默认声音或者是机器合成声音。

在一些实例中,在获取到待播报信息之后,若待播报信息为文本信息时,则可以利用从文本到语音TTS技术将文本信息转换为相对应的预设语音信息,该预设语音信息可以具有多种播放类型,例如:普通话类型、四川话类型、儿童声音类型、男士声音类型、女士声音类型等等,而后,获取用户针对任意风格的声音所输入的执行操作,根据所述执行操作确定与待播报信息相对应的预设语音信息。从而实现了基于与用户的交互操作来选择出一个与待播报信息相对应的预设语音信息,从而保证了所生成的预设语音信息可以满足用户的使用需求和设计需求,进一步提高了视频生成的质量和效率。

在获取到预设语音信息之后,可以基于预设语音信息生成与数据对象的形象相对应的面部表情参数,该面部表情参数可以包括以下至少之一:嘴型参数、眼睛参数、脸部参数。具体的,参考附图6所示,本实施例中的基于预设语音信息生成与数据对象的形象相对应的面部表情参数可以包括:

S10321:获取与预设语音信息相对应的振幅信息。

S10322:根据振幅信息生成与数据对象的形象相对应的嘴型参数。

具体的,在面部表情参数包括嘴型参数时,可以获取与预设语音信息相对应的振幅信息,而后基于振幅信息生成与数据对象的形象相对应的嘴型参数;例如:在振幅信息大于预设振幅阈值时,则可以确定与数据对象的形象相对应的嘴型参数为张开嘴型的参数;在振幅信息小于或等于预设振幅阈值时,则可以确定与数据对象的形象相对应的嘴型参数为闭合嘴型的参数。

相类似的,在面部表情参数包括脸部参数时,可以获取与待播报信息相对应的信息关键词,或者,获取与预设语音信息相对应的信息关键词,而后根据信息关键词确定与数据对象的形象相对应的脸部参数,该脸部参数可以用于控制数据对象的形象进行微笑或者严肃的表情操作。在面部表情参数包括眼睛参数时,可以获取与预设语音信息相对应的播报时间信息,通过播报时间信息来确定与数据对象的形象相对应的眼睛参数,例如:在播报时间信息中确定多个与眼睛参数相对应的时间点信息,在当前时刻为所确定的时间点信息时,则控制数据对象的形象进行眨眼动作。

当然的,本领域技术人员也可以根据具体的应用需求和设计需求,采用其他的方式来实现基于预设语音信息生成与数据对象的形象相对应的面部表情参数,只要能够保证对与数据对象的形象相对应的面部表情参数进行生成的准确可靠性即可,在此不再赘述。

本实施例中,通过将待播报信息转换为相对应的预设语音信息,而基于预设语音信息生成与数据对象的形象相对应的面部表情参数,有效地保证了对与数据对象的形象相对应的面部表情参数进行确定的准确可靠性,进一步保证了该方法使用的稳定可靠性。

图7为本发明实施例提供的利用面部表情参数驱动数据对象的形象进行动作,生成与待播报信息相对应的视频的流程图;在上述实施例的基础上,参考附图7所示,在待播报信息包括待播报语音时,本实施例中的利用面部表情参数驱动数据对象的形象进行动作,生成与待播报信息相对应的视频可以包括:

S1041:根据待播报语音确定与数据对象的形象相对应的声音参数。

S1042:利用面部表情参数和声音参数驱动数据对象的形象进行动作,生成与待播报信息相对应的视频。

在待播报信息包括待播报语音时,可以根据待播报语音确定与数据对象的形象相对应的声音参数,该声音参数可以包括以下至少之一:声音频率信息、音调信息、音色信息和音量信息等等。具体的,本实施例对于根据待播报语音确定与数据对象的形象相对应的声音参数的具体实现方式不做限定,例如:在声音参数包括声音频率信息时,获取与待播报语音相对应的基准频率和预设倍频程数的信号频率,根据基准频率和信号频率确定来获取用于标识声音频率信息的倍频程数。或者,在声音参数包括音色信息时,可以获取与待播报语音的声谱信息,而后识别声谱信息中的泛音部分结构,根据泛音部分的结构确定与待播报语音相对应的音色信息。当然的,本本领域技术人员可以根据不同的应用场景采用不同的方式来获取声音参数,只要能够保证对与数据对象的形象相对应的声音参数进行获取的准确可靠性即可,在此不再赘述。

在获取到与数据对象的形象相对应的声音参数之后,可以利用面部表情参数和声音参数驱动数据对象的形象进行动作,从而可以生成与待播报信息相对应的视频。举例来说:在用户甲向视频的生成装置发送待播报语音时,可以根据待播报语音确定与数据对象的形象相对应的面部表情参数和声音参数,其中,声音参数与用户甲相对应;在获取到面部表情参数和声音参数之后,可以利用面部表情参数和声音参数驱动数据对象的形象进行动作,生成与待播报信息相对应的视频,此时,视频中的待播报信息可以以用户甲的声音、以面部表情参数所确定的表情信息来驱动数据对象的形象进行播报操作,从而生成了与待播报信息相对应的视频。

本实施例中,通过待播报语音确定与数据对象的形象相对应的声音参数,而后利用面部表情参数和声音参数驱动数据对象的形象进行动作,有效地实现了可以生成与用户相同的声音来进行语音播报操作的视频,使得视频的播报更加真实、逼真,提高了视频生成的质量和效率。

图8为本发明实施例提供的利用面部表情参数驱动数据对象的形象进行动作,生成与待播报信息相对应的视频的流程图二;在上述任意一个实施例的基础上,继续参考附图8所示,本实施例中的利用面部表情参数驱动数据对象的形象进行动作,生成与待播报信息相对应的视频可以包括:

S1043:获取视频背景信息。

其中,视频背景信息用于作为视频的背景信息,以提高所生成的视频的显示质量和显示效果;具体的,本实施例对于视频背景信息的具体获取方式不做限定,本领域技术人员可以根据具体的应用需求和设计需求进行设置,较为优选的,参考附图9所示,本实施例中的获取视频背景信息可以包括:

S10431:获取用户针对预设的多个视频背景输入的执行操作。

S10432:根据执行操作在多个视频背景中确定视频背景信息。

具体的,预先设置有多个视频背景信息,用户可以针对多个视频背景输入相应的执行操作,该执行操作可以包括以下至少之一:滑动操作、点选操作等等;在获取到用户针对预设的多个视频背景输入的执行操作之后,可以根据执行操作在多个视频背景中确定视频背景信息,例如:可以将与执行操作相对应的视频背景确定为视频背景信息;从而有效地保证了视频背景信息获取的准确可靠性,并且也提高了该方法使用的稳定可靠性。

S1044:在视频背景信息中,利用面部表情参数驱动数据对象的形象进行动作,生成与待播报信息相对应的视频。

在获取到视频背景信息之后,可以在视频背景信息中,利用面部表情参数驱动数据对象的形象进行动作,生成与待播报信息相对应的视频,有效地保证了视频生成的质量和效率,进一步提高了该方法使用的稳定可靠性。

图10为本发明实施例提供的一种视频的生成方法的流程图三;在上述任意一个实施例的基础上,继续参考附图10所示,在生成与待播报信息相对应的视频之后,可以对视频进行分析识别,确定视频是否需要插入用于进行场景切换的转场音视频;具体的,本实施例中的方法还可以包括:

S301:对视频中的相邻视频帧进行相似度识别。

S302:在相似度大于或等于预设阈值时,则确定在相邻视频帧之间不需要转场音视频。或者,

S303:在相似度小于预设阈值时,则确定在相邻视频帧之间需要转场音视频。

在生成与待播报信息相对应的视频之后,为了保证视频的播报质量和效果,可以对视频中的相邻视频帧之间是否需要插入转场音视频进行分析识别,具体的,可以获取到视频中的相邻视频帧之间的相似度,在获取到相邻视频帧之间的相似度之后,可以将相似度与预设阈值进行分析比较,在相似度大于或等于预设阈值时,则可以确定相似视频帧之间不需要插入转场音视频,即可保证视频的视频播放质量和效果;在相似度小于预设阈值时,则确定在相邻视频帧之间需要转场音视频,也即此时的视频中需要用于进行场景切换操作的转场音视频。

可以理解的是,在确定在相邻视频帧之间需要插入转场音视频之后,可以提醒用户此时的视频需要进行插入转场音视频的操作,或者,也可以根据相邻视频帧自动生成相对应的转场音视频,以保证视频播放时的流畅和自然程度,提高视频的播放质量和效果。

进一步的,参考附图11所示,在生成与待播报信息相对应的视频之后,本实施例中的方法还可以包括:

S401:获取用于进行场景切换的转场音视频。

具体的,参考附图12所示,本实施例中的获取用于进行场景切换的转场音视频可以包括:

S4011:获取转场文本和转场视频。

S4012:将转场文本转换为相对应的转场语音。

S4012:对转场语音和转场视频进行合成,获得转场音视频。

其中,转场文本用于限定转场音视频中的播报内容,转场视频用于限定与转场音视频相对应的除了声音之外的其他信息;具体应用时,转场文本和转场视频可以是预先设置的,或者,转场文本和转场视频也可以是用户上传的,或者,转场文本和转场视频也可以是其他装置发送至视频的生成装置等等,只要能够使得生成装置可以稳定地获取转场文本和转场视频即可,在获取到转场文本和转场视频之后,可以利用TTS技术将转场文本转换为相对应的转场语音,而后利用视频剪辑技术将转场语音和转场视频进行合成,从而可以获得转场音视频,这样不仅保证了转场音视频获取的准确可靠性,并且也提高了转场音视频的生成质量和效率。

S402:将转场音视频与视频进行剪辑处理,获得与待播报信息相对应的目标视频。

在获取到转场音视频之后,可以将转场音视频与视频进行剪辑处理,具体的,可以将转场音视频插入至视频中需要进行场景切换的两个视频帧之间,从而可以获得与待播报信息相对应的目标视频,此时的目标视频中的各个场景之间的播放效果和切换效果比较自然和流畅,进而提高了目标视频的播放质量和效果。

进一步的,在上述任意一个实施例的基础上,在生成与待播报信息相对应的视频之后,本实施例中的方法还可以包括:

S501:针对视频生成相对应的视频指纹。

其中,视频指纹是与视频相对应的身份标识信息,为了能够识别视频的来源和身份,可以针对视频生成相对应的视频指纹,从而使得用户可以在多个视频中,通过视频指纹识别到相对应的视频,进而便于实现对视频的版权保护操作。

图13为本发明实施例提供的一种视频的生成方法的流程图四;在上述任意一个实施例的基础上,继续参考附图13所示,在获取待播报信息之后,本实施例中的方法还可以包括:

S601:对待播报信息进行合法性识别。

S602:在待播报信息为合法信息时,则允许确定与待播报信息相对应的数据对象的形象。或者,

S603:在待播报信息为非法信息时,则禁止确定与待播报信息相对应的数据对象的形象。

其中,在视频的生成过程,为了保证信息处理的安全可靠性,在获取到用户上传或者其他装置传输的待播报信息之后,可以对待播报信息进行合法性识别,具体的,可以确定与待播报信息相对应的信息关键字,将信息关键字与预先设置的数据库中的标准关键字进行分析比较,该数据库中预先存储有多个用于标识非法信息的标准关键字;若信息关键字与数据库中的标准关键字的相似度小于预设的阈值,则确定待播报信息为合法信息,在信息关键字与数据库中的标准关键字的相似度大于或等于预设的阈值,则确定待播报信息为非法信息。在待播报信息为合法信息时,则可以允许确定与待播报信息相对应的数据对象的形象,并生成与待播报信息相对应的视频;在待播报信息为非法信息时,则可以禁止确定与待播报信息相对应的数据对象的形象,以避免非法信息的恶意传播。

具体应用时,参考附图14-图15所示,本应用实施例提供了一种视频的生成方法,该方法通过整合面部重塑、语音识别(ASR)、语音合成(TTS)、机器问答等多领域的AI技术来生成视频,该视频可以从视觉和听觉上给用户带来宛如和真人对话般的交互体验。具体的,以人物形象作为数据对象的形象为例进行说明,该方法可以包括:

step1、选择视频背景或者视频场景;

其中,视频背景可以是用户上传的,或者,视频背景也可以是用户选择或者配置的,例如:在预设的多个图片或者视频中执行选择操作,而后利用图片或者视频生成视频背景或者视频场景。在选择视频背景或者视频场景之后,可以利用自动审核工具对视频背景或者视频场景进行审核,该审核主要是针对黄暴恐政治等内容的审核,以避免非法信息的传播;在视频背景或者视频场景中的图片或者视频通过审核后,则可以用于生成满足用户需求的视频。

step2、选择人物形象和底板视频。

用户可以根据不同的需求和应用场景选择不同的人物形象,具体的,可以选择不同的人物面部重塑模型。在选择人物形象之后,可以确定与人物形象相对应的底板视频,该底板视频用于限定人物形象的姿态信息,例如:人物形象的站姿或者坐姿等等。

step3、获取人物形象要说的文本信息。

在获取到人物形象要说的文本信息之后,可以利用自动审核工具对文本信息进行合法性识别,在文本信息通过审核之后,则可以通过语音合成技术将文本信息转换为合成语音,并基于该合成语音确定与人物形象相对应的面部表情参数;然后,利用预设的机器学习模型对面部表情参数和人物形象进行分析处理,生成对应于所选择的人物形象的音视频,并可以结合所选择的视频背景,生成具有背景/场景的音视频。

需要注意的是,在用户以语音的方式输入人物形象要说的内容时,则可以获取在将输入文本(人物)到语音合成的过程中,使用用户的原声生成视频,此时,人物形象可以是与用户相对应的面部原声模型。进而,在生成具有背景/场景的音视频时,可以听到人物形象利用用户的原声进行说话,从而使得视频的播放效果更加真实,保证了视频的播放质量。

另外,本实施例中的方法还可以利用语音合成技术生成人物形象的声音参数,例如:在获取到输入文本、并且所确定的人物形象是主持人A时,则可以对主持人A进行TTS建模,高度模拟生成A的声音,而后可以生成以A的人物形象、以A的声音对输入文本进行播报的视频,进一步提高了视频的播放质量和效果。

step4、获取转场文本,转场文本通过文本自动审核后,通过语音合成技术转换为合成语音。

step5、获取转场视频,通过视频自动审核后,与上述step4中的合成语音进行处理,生成转场音视频。

step6、将上述的“具有背景/场景的音视频”和“转场音视频”经过“视频剪辑模块”进行剪辑,并通过对视频进行打指纹操作,生成最终视频。

本应用实施例提供的视频的生成方法,通过语音合成技术、面部重塑技术以及自动审核和自动合成工具来生成视频,有效地保证了视频的生成质量和效率,并且也降低了视频制作的成本。另外,该方法可以适用于丰富的应用场景,例如:可以广泛应用在智能客服、智能点餐、智能导览/指路、智能问答、智能陪伴、智能政务、智能导医台、智能汽车可视交互、智能新闻/电视播音员、广告/电视/电影短片制作、游戏行业、智能家居电视、其他可视交互场景,有效地提高了该方法的适用范围。

图16为本发明实施例提供的一种视频的生成装置的结构示意图;参考附图16所示,本实施例提供了一种视频的生成装置,该视频的生成装置可以执行上述图1的视频的生成方法,具体的,该视频的生成装置可以包括:

获取模块11,用于获取待播报信息;

确定模块12,用于确定与待播报信息相对应的数据对象的形象;

确定模块12,还用于根据待播报信息确定与数据对象的形象相对应的面部表情参数;

处理模块13,用于利用面部表情参数驱动数据对象的形象进行动作,生成与待播报信息相对应的视频。

进一步的,在确定模块12确定与待播报信息相对应的数据对象的形象时,该确定模块12可以用于执行:获取用户针对预设的多个播报形象输入的执行操作;根据执行操作在多个播报形象中确定与待播报信息相对应的数据对象的形象。

进一步的,在确定模块12确定与待播报信息相对应的数据对象的形象时,该确定模块12可以用于执行:获取用户输入的形象配置参数;根据形象配置参数生成与待播报信息相对应的数据对象的形象。

进一步的,在确定与待播报信息相对应的数据对象的形象之后,本实施例中的处理模块13还可以用于执行:确定数据对象的形象的姿态信息;控制数据对象的形象以所确定的姿态信息在视频中进行显示。

其中,待播报信息包括以下至少之一:待播报文本、待播报语音。

进一步的,在处理模块13根据待播报信息确定与数据对象的形象相对应的面部表情参数时,该处理模块13可以用于执行:将待播报信息转换为相对应的预设语音信息;基于预设语音信息生成与数据对象的形象相对应的面部表情参数。

其中,面部表情参数包括以下至少之一:嘴型参数、眼睛参数、脸部参数。

进一步的,在处理模块13基于预设语音信息生成与数据对象的形象相对应的面部表情参数时,该处理模块13可以用于执行:获取与所述预设语音信息相对应的振幅信息;根据振幅信息生成与数据对象的形象相对应的嘴型参数。

进一步的,在待播报信息包括待播报语音时,在处理模块13利用面部表情参数驱动数据对象的形象进行动作,生成与待播报信息相对应的视频时,该处理模块13可以用于执行:根据待播报语音确定与数据对象的形象相对应的声音参数;利用面部表情参数和声音参数驱动数据对象的形象进行动作,生成与待播报信息相对应的视频。

进一步的,在处理模块13利用面部表情参数驱动数据对象的形象进行动作,生成与待播报信息相对应的视频时,该处理模块13可以用于执行:获取视频背景信息;在视频背景信息中,利用面部表情参数驱动数据对象的形象进行动作,生成与待播报信息相对应的视频。

进一步的,在处理模块13获取视频背景信息时,该处理模块13可以用于执行:获取用户针对预设的多个视频背景输入的执行操作;根据执行操作在多个视频背景中确定视频背景信息。

进一步的,在生成与待播报信息相对应的视频之后,本实施例中的处理模块13还可以用于:对视频中的相邻视频帧进行相似度识别;在相似度大于或等于预设阈值时,则确定在相邻视频帧之间不需要转场音视频;或者,在相似度小于预设阈值时,则确定在相邻视频帧之间需要转场音视频。

进一步的,在生成与待播报信息相对应的视频之后,本实施例中的处理模块13还可以用于:获取用于进行场景切换的转场音视频;将转场音视频与视频进行剪辑处理,获得与待播报信息相对应的目标视频。

进一步的,在处理模块13获取用于进行场景切换的转场音视频时,该处理模块13可以用于执行:获取转场文本和转场视频;将转场文本转换为相对应的转场语音;对转场语音和转场视频进行合成,获得转场音视频。

进一步的,在生成与待播报信息相对应的视频之后,本实施例中的处理模块13还可以用于:针对视频生成相对应的视频指纹。

进一步的,在获取待播报信息之后,本实施例中的处理模块13还可以用于:对待播报信息进行合法信息性识别;在待播报信息为合法信息时,则允许确定与待播报信息相对应的数据对象的形象;或者,在待播报信息为非法信息时,则禁止确定与待播报信息相对应的数据对象的形象。

图16所示装置可以执行图1-图15所示实施例的方法,本实施例未详细描述的部分,可参考对图1-图15所示实施例的相关说明。该技术方案的执行过程和技术效果参见图1-图15所示实施例中的描述,在此不再赘述。

在一个可能的设计中,图16所示视频的生成装置的结构可实现为一电子设备,该电子设备可以是手机、平板电脑、服务器等各种设备。如图17所示,该电子设备可以包括:处理器21和存储器22。其中,存储器22用于存储相对应电子设备执行上述图1-图15所示实施例中提供的视频的生成方法的程序,处理器21被配置为用于执行存储器22中存储的程序。

程序包括一条或多条计算机指令,其中,一条或多条计算机指令被处理器21执行时能够实现如下步骤:

获取待处理数据;

确定与待处理数据相对应的至少一个操作节点;

对至少一个操作节点进行加密处理,获得与待处理数据相对应的目标数据。

进一步的,处理器21还用于执行前述图1-图15所示实施例中的全部或部分步骤。

其中,电子设备的结构中还可以包括通信接口23,用于电子设备与其他设备或通信网络通信。

另外,本发明实施例提供了一种计算机存储介质,用于储存电子设备所用的计算机软件指令,其包含用于执行上述图1-图15所示方法实施例中视频的生成方法所涉及的程序。

以上所描述的装置实施例仅仅是示意性的,其中所述作为分离部件说明的单元可以是或者也可以不是物理上分开的,作为单元显示的部件可以是或者也可以不是物理单元,即可以位于一个地方,或者也可以分布到多个网络单元上。可以根据实际的需要选择其中的部分或者全部模块来实现本实施例方案的目的。本领域普通技术人员在不付出创造性的劳动的情况下,即可以理解并实施。

通过以上的实施方式的描述,本领域的技术人员可以清楚地了解到各实施方式可借助加必需的通用硬件平台的方式来实现,当然也可以通过硬件和软件结合的方式来实现。基于这样的理解,上述技术方案本质上或者说对现有技术做出贡献的部分可以以计算机产品的形式体现出来,本发明可采用在一个或多个其中包含有计算机可用程序代码的计算机可用存储介质(包括但不限于磁盘存储器、CD-ROM、光学存储器等)上实施的计算机程序产品的形式。

本发明是参照根据本发明实施例的方法、设备(系统)、和计算机程序产品的流程图和/或方框图来描述的。应理解可由计算机程序指令实现流程图和/或方框图中的每一流程和/或方框、以及流程图和/或方框图中的流程和/或方框的结合。可提供这些计算机程序指令到通用计算机、专用计算机、嵌入式处理机或其他可编程设备的处理器以产生一个机器,使得通过计算机或其他可编程设备的处理器执行的指令产生用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的装置。

这些计算机程序指令也可存储在能引导计算机或其他可编程设备以特定方式工作的计算机可读存储器中,使得存储在该计算机可读存储器中的指令产生包括指令装置的制造品,该指令装置实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能。

这些计算机程序指令也可装载到计算机或其他可编程设备上,使得在计算机或其他可编程设备上执行一系列操作步骤以产生计算机实现的处理,从而在计算机或其他可编程设备上执行的指令提供用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的步骤。

在一个典型的配置中,计算设备包括一个或多个处理器(CPU)、输入/输出接口、网络接口和内存。

内存可能包括计算机可读介质中的非永久性存储器,随机存取存储器(RAM)和/或非易失性内存等形式,如只读存储器(ROM)或闪存(flash RAM)。内存是计算机可读介质的示例。

计算机可读介质包括永久性和非永久性、可移动和非可移动媒体可以由任何方法或技术来实现信息存储。信息可以是计算机可读指令、数据结构、程序的模块或其他数据。计算机的存储介质的例子包括,但不限于相变内存(PRAM)、静态随机存取存储器(SRAM)、动态随机存取存储器(DRAM)、其他类型的随机存取存储器(RAM)、只读存储器(ROM)、电可擦除可编程只读存储器(EEPROM)、快闪记忆体或其他内存技术、只读光盘只读存储器(CD-ROM)、数字多功能光盘(DVD)或其他光学存储、磁盒式磁带,磁带磁磁盘存储或其他磁性存储设备或任何其他非传输介质,可用于存储可以被计算设备访问的信息。按照本文中的界定,计算机可读介质不包括暂存电脑可读媒体(transitory media),如调制的数据信号和载波。

最后应说明的是:以上实施例仅用以说明本发明的技术方案,而非对其限制;尽管参照前述实施例对本发明进行了详细的说明,本领域的普通技术人员应当理解:其依然可以对前述各实施例所记载的技术方案进行修改,或者对其中部分技术特征进行等同替换;而这些修改或者替换,并不使相应技术方案的本质脱离本发明各实施例技术方案的精神和范围。

- 视频数据生成单元、图像显示设备、视频数据生成方法、视频图像显示方法、以及视频图像文件数据结构

- 视频模板生成方法、视频生成方法、装置和电子设备