婴儿视频自动剪辑的方法、装置、设备及存储介质

文献发布时间:2023-06-19 11:35:49

技术领域

本发明涉及视频剪辑技术领域,尤其涉及婴儿视频自动剪辑的方法、装置、设备及存储介质。

背景技术

随着计算机和网络技术的发展,电子设备的功能越来越多样化。通过视频剪辑手段将感兴趣的视频段拼接成新的视频越来越受用户喜爱。

现有技术中,用户通过拍摄一段视频,通过手动方式进行截取感兴趣的视频段,然后将各段视频进行拼接,得到感兴趣的视频。在视频中有婴儿的婴儿视频剪辑过程中,由于婴儿完成一个动作常常需要经过多次尝试,且会随着尝试次数增加,而不断提高动作的完成度;若采用常规的视频剪辑方式,剪辑的各帧图像常常存在流畅性差、图像质量差等问题,造成剪辑后的视频质量低,影响用户体验。

发明内容

有鉴于此,本发明实施例提供了一种婴儿视频自动剪辑的方法、装置及设备,用以解决采用常规视频剪辑技术剪辑的婴儿视频,存在流畅性、图像质量差所导致剪辑后的视频质量低的技术问题。

本发明采用的技术方案是:

本发明提供了一种婴儿视频自动剪辑的方法,所述方法包括:

S1:提取待剪辑的婴儿视频中各关键帧,输出关键帧集合;

S2:将所述关键帧集合送入婴儿动作检测模型中,输出各所述关键帧的动作类型标记和动作位置标记;

S3:根据各所述动作类型标记和各所述动作位置标记,输出各动作类型对应的目标关键帧;

S4:根据各所述目标关键帧对所述婴儿视频进行裁剪,输出与各动作类别对应的目标视频。

优选地,所述S1包括:

S11:获取待剪辑的婴儿视频在HSV颜色空间的各图像帧;

S12:根据公式

S13:根据各所述图像帧的各通道的图像熵,由公式:E=a*E(f(i

S14:根据各所述图像帧的合熵,从所有所述图像帧中筛选出多个所述图像帧组成所述关键帧集合;

其中,a、b、c为常数,D表示图像帧的像素值,i表示颜色通道,E表示图像帧的合熵,E(f(i

优选地,所述S14包括:

S141:获取用于筛选关键帧的图像帧数量Q;

S142:对各所述图像帧的合熵进行排序,输出合熵序列;

S143:根据所述图像帧数量Q和所述合熵序列,筛选出Q个所述图像帧组成的基准图像组;

S144:对所述基准图像组的各所述图像帧进行筛选,输出所述关键帧集合;

其中,Q为正整数。

优选地,所述S144包括:

S1441:对比所述基准图像组中各所述图像帧的合熵,输出最大合熵值对应的所述图像帧作为参考图像;

S1442:计算其余(Q-1)张各所述图像帧与所述参考图像的EMD值,得到与其余(Q-1)张各所述图像帧一一对应的各EMD值;

S1443:对各所述EMD值进行排序,输出EMD序列;

S1444:根据所述EMD序列以间隔(Q-1)/m进行一次EMD取值,将得到的m个EMD值对应的图像帧组成所述关键帧集合;

其中,m为大于等于1的正整数,且(Q-1)能被m整除,EMD(Earth Mover'sDistance)值为图像帧与参考图像的向量相似度度量。

优选地,所述S3包括:

S31:根据各关键帧的所述动作位置标记和所述动作类型标记,按所述动作类型标记给各关键帧分配动作位置坐标;

S32:根据各所述关键帧的所述动作位置坐标,由公式

其中,R表示动作位置坐标,i表示视频流中第i段视频,k表示第i段视频中包括k个关键帧,Center(j)表示k张关键帧中的第j张关键帧的图像中心点,Pi表示第i段视频的居中度最小值的关键帧,dis表示动作位置坐标到中心点的距离。

优选地,所述S31包括:

S311:获取各关键帧中对应的人体所有骨骼关键点;

S312:将各关键帧中对应的所有骨骼关键点围成一封闭的几何图形;

S313:将与各关键帧一一对应的所述几何图形中心的坐标作为所述动作位置坐标。

优选地,所述S4包括:

S41:获取各所述目标关键帧的在所述婴儿视频的时间信息和视频流被截取的各视频段的图像帧数;

S42:根据各所述目标关键帧对应的所述时间信息,输出各所述目标关键帧对应的视频流的截取方式;

S43:根据各所述截取方式和对应的各所述图像帧数,对各所述视频流进行截取,得到与各所述目标关键帧对应的各所述视频段;

S44:根据各所述动作类别标记对各所述视频段进行分类,然后按时间先后顺序对各动作类别的各所述视频段分别进行拼接,输出各动作类别对应的所述目标视频。

本发明还提供了一种婴儿视频自动剪辑的装置,包括:

关键帧提取模块:用于提取待剪辑的婴儿视频中各关键帧,输出关键帧集合;

关键帧检测模块:用于将所述关键帧集合送入婴儿动作检测模型中,输出各所述关键帧的动作类型标记和动作位置标记;

目标关键帧筛选模块:用于根据各所述动作类型标记和各所述动作位置标记,输出各动作类型对应的目标关键帧;

视频截取模块:用于根据各所述目标关键帧对所述婴儿视频进行裁剪,输出与各动作类别对应的目标视频。

本发明还提供了一种电子设备,包括:至少一个处理器、至少一个存储器以及存储在所述存储器中的计算机程序指令,当所述计算机程序指令被所述处理器执行时实现上述任一项所述的方法。

本发明还提供了一种介质,其上存储有计算机程序指令,当所述计算机程序指令被处理器执行时实现上述任一项所述的方法。

综上所述,本发明的有益效果如下:

本发明提供的一种婴儿视频自动剪辑的方法、装置、设备及存储介质,提取婴儿视频中的各关键帧;利用婴儿动作检测模型对各关键帧进行检测,得到各关键帧的动作类型和动作位置;根据各关键帧的动作位置筛选出各动作类别的目标关键帧,根据目标关键帧对婴儿视频进行裁剪,得到各类别的视频段,然后对各类别的视频段进行独立拼接,得到剪辑的各类别的目标视频;通过目标关键帧自动截取婴儿视频,既能保证各图像帧的图像质量,又能提高剪辑效率;同时,对各视频段分类拼接,可以直观体现婴儿动作的熟练程度,为婴儿看护提供依据。

附图说明

为了更清楚地说明本发明实施例的技术方案,下面将对本发明实施例中所需要使用的附图作简单地介绍,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图,这些均在本发明的保护范围内。

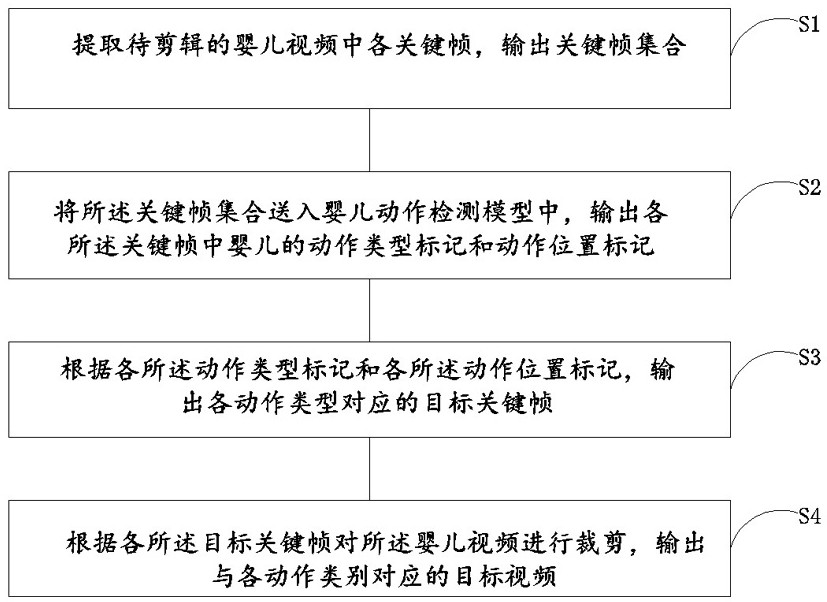

图1为本发明实施例1中婴儿视频自动剪辑的方法的流程示意图;

图2为本发明实施例1中获取关键帧集合的流程示意图;

图3为本发明实施例1中通过基准图像帧筛选关键帧集合的流程示意图;

图4为本发明实施例1中通过EMD值获取关键帧集合的流程示意图;

图5为本发明实施例1中通过居中度获取目标关键帧的流程示意图;

图6为本发明实施例1中获取各类别的目标视频的流程示意图;

图7为本发明实施例2中婴儿视频自动剪辑的装置的结构示意图;

图8为本发明实施例3中的电子设备的结构示意图。

具体实施方式

为使本发明实施例的目的、技术方案和优点更加清楚,下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述。需要说明的是,在本文中,诸如第一和第二等之类的关系术语仅仅用来将一个实体或者操作与另一个实体或操作区分开来,而不一定要求或者暗示这些实体或操作之间存在任何这种实际的关系或者顺序。在本发明的描述中,需要理解的是,术语“中心”、“上”、“下”、“前”、“后”、“左”、“右”、“竖直”、“水平”、“顶”、“底”、“内”、“外”等指示的方位或位置关系为基于附图所示的方位或位置关系,仅是为了便于描述本申请和简化描述,而不是指示或暗示所指的装置或元件必须具有特定的方位、以特定的方位构造和操作,因此不能理解为对本发明的限制。而且,术语“包括”、“包含”或者其任何其他变体意在涵盖非排他性的包含,从而使得包括一系列要素的过程、方法、物品或者设备不仅包括那些要素,而且还包括没有明确列出的其他要素,或者是还包括为这种过程、方法、物品或者设备所固有的要素。在没有更多限制的情况下,由语句“包括……”限定的要素,并不排除在包括所述要素的过程、方法、物品或者设备中还存在另外的相同要素。如果不冲突,本发明施例以及实施例中的各个特征可以相互结合,均在本发明的保护范围之内。

实施方式一

实施例1

请参见图1,图1为本发明实施例1中婴儿视频自动剪辑的方法的流程示意图;所述方法包括:

S1:提取待剪辑的婴儿视频中各关键帧,输出关键帧集合;

具体的,利用婴儿的看护相机获取被看护婴儿的婴儿视频,对婴儿视频的各帧进行处理,得到多个关键帧组成的关键帧卷集合;在一应用实施例中,利用熵值法提取婴儿的关键帧。

在一实施例中,请参见图2,所述S1包括:

S11:获取待剪辑的婴儿视频在HSV颜色空间的各图像帧;

具体的,对待剪辑的婴儿视频进行分解,得到各图像帧,然后各图像帧的颜色空间转换为HSV颜色空间,H为色调、S为饱和度、V为明度;利用熵值法进行合熵计算。

S12:根据公式

S13:根据各所述图像帧的各通道的图像熵,由公式:E=a*E(f(i

S14:根据各所述图像帧的合熵,从所有所述图像帧中筛选出多个所述图像帧组成所述关键帧集合;

其中,a、b、c为常数,D表示图像帧的像素值,i表示颜色通道,E表示图像帧的合熵,E(f(i

具体的,在获得各图像帧后,将图像帧的色彩空间转换为HSV色彩空间,然后计算各通道的图像熵,根据各图像帧对应的色调通道的图像熵E(f(i

在一实施例中,请参见图3,所述S14包括:

S141:获取用于筛选关键帧的图像帧数量Q;

具体的,设置用于选择关键帧的图像帧数量的大小为Q,也就是说,从Q张图像帧中选出用于组成关键帧集合的所有关键帧,其中,Q为正整数。

S142:对各所述图像帧的合熵进行排序,输出合熵序列;

具体的,根据各图像帧的合熵值的大小对各合熵从大到小进行排序,得到合熵序列。

S143:根据所述图像帧数量Q和所述合熵序列,筛选出Q个所述图像帧组成的基准图像组;

S144:对所述基准图像组的各所述图像帧进行筛选,输出所述关键帧集合。

具体的,从合熵序列中筛选出Q个合熵值,将该Q个合熵值对应的图像帧组成基准图像集合。

在一实施例中,从合熵序列中选择合熵值最大的Q个合熵对应的图像帧,该Q张图像帧组成基准图像集合;Q张图像帧的选择方式还可以是:选择前Q个偶数或奇数位置的合熵值对应的图像帧;可以保证筛选出来的图像帧的质量。

在另一应用实施例中,根据各图像帧的时间先后顺序对各合熵进行排序,输出合熵序列,将合熵序列按时间顺序分为相等Q段,从各段分别筛选出一合熵值,从而得到与Q个合熵值对应的Q张关键帧;保证各关键帧之间的连续性,有利于截取视频的流畅性,提高视频的观赏性。

在一实施例中,请参见图4,所述S144包括:

S1441:对比所述基准图像组中各所述图像帧的合熵,输出最大合熵值对应的所述图像帧作为参考图像;

具体的,对比基准图像组中Q张图像帧的各合熵,将合熵值最大的图像帧作为参考图像。

S1442:计算其余(Q-1)张各所述图像帧与所述参考图像的EMD值,得到与其余(Q-1)张各所述图像帧一一对应的各EMD值;

具体的,将其余(Q-1)张图像帧与参考图像进行对比,获得各图像帧与参考图像的EMD值(Earth Mover's Distance,向量相似度度量),EMD值越大,则对应的图像帧与参考图像的相似度越高。

S1443:对各所述EMD值进行排序,输出EMD序列;

S1444:根据所述EMD序列以间隔(Q-1)/m进行一次EMD取值,将得到的m个EMD值对应的图像帧组成所述关键帧集合。

具体的,在EMD序列上每间隔(Q-1)/m取一个EMD值,最终得到m个EMD值,然后由该m个EMD值对应的图像帧构成该关键帧集合,以等时间隔选取关键帧,保持各图像帧的动作位置的自然演变,保证视频的流畅性;其中,m为大于等于1的正整数,且(Q-1)能被m整除。

S2:将所述关键帧集合送入婴儿动作检测模型中,输出各所述关键帧中婴儿的动作类型标记和动作位置标记;

具体的,获取包括婴儿多种动作的样本图像集,动作类型至少包括以下之一:爬、跳、举手、站立、吮吸、挥舞、蹲下和进食等;将该样本图像集输入深度学习分类模型中进行训练,得到可以用于检测婴儿动作类别的动作检测模型;将各关键帧输入动作检测模型中,动作检测模型输出各关键帧对应的动作位置标记和动作类型标记。其中,该动作检测模型采用的是基于MobileNetV2分类模型进行训练得到的一个轻量级分类模型。

需要说明的是:将轻量级模型MobileNetV2作为基础模型,为了能在移动端进行实时的人脸关键点检测,本实验采用最新的轻量化模型——MobileNetV2 作为基础模型,在CelebA 数据上,进行两级的级联 MobileNetV2 实现人脸关键点检测,其中,CelebA 数据表示:采用的实验数据为公开数据及(CelebFaces Attributes Dataset (CelebA) )。

首先,将 CelebA 数据作为第一级MobileNetV2 的输入,经第一级 MobileNetV2得到粗略的关键点位置;然后,依据第一级 MobileNetV2 的输出,将人脸区域从原始数据上裁剪出来作为第二级 MobileNetV2 的输入;最后,经第二级 MobileNetV2 输出最终人脸关键点定位信息。经初步训练,得到最终的网络单模型,该网络单模型小于 1M,仅956KB,单张图片 inference 耗时 6ms(采用 GTX1080 在未优化的 Caffe)。实验结果表明,将该网络单模型部署到移动终端上作为动作检测模型,利用该动作检测模型可以采用较少的参数获得较好的性能。

需要说明的是:生成目标检测模型不仅限于本实施例提供的MobileNetV2,还可以是MobileNetV1、MobileNetV3、ShuffleNetV1、ShuffleNetV2、SNet等轻量级检测模型,此处不做具体限定。

S3:根据各所述动作类型标记和各所述动作位置标记,输出各动作类型对应的目标关键帧;

具体的,在各段视频中,根据动作类型标记,得到各动作类型对应的各关键帧图像;对比各关键帧中动作位置标记,输出各关键帧的居中度;将居中度最高的关键帧作为该段视频对应动作类型的目标关键帧。

在一实施例中,请参见图5,所述S3包括:

S31:根据各关键帧的所述动作位置标记和所述动作类型标记,按所述动作类型标记给各关键帧分配动作位置坐标;

具体的,将各动作的关键帧进行动作类型和动作位置标记,给各关键帧分配表征关键帧的动作位置坐标,并按动作类型对这个坐标分类,从而将各关键帧转化为多个动作位置坐标,用于计算居中度。

在一实施例中,所述S31包括:

S311:获取各关键帧中对应的人体所有骨骼关键点;

具体的,采集各类动作的所有关键帧对应的人体的骨骼关键点。

S312:将各关键帧中对应的所有骨骼关键点围成一封闭的几何图形;

将每一个关键帧的所有骨骼关键点进行连线,构成与各关键帧一一对应的封闭的几何图形。

S313:将与各关键帧一一对应的所述几何图形中心的坐标作为所述动作位置坐标;

在一实施例中,将几何图像的各顶点与对应的对边中点进行连线;将最终的唯一的交点作为几何图形的中心,将该中心的坐标作为动作位置坐标。

具体的,关键帧的人体的所有骨骼关键点围成的是一个不规则的几何图形;通过顶点与对边中点的连线会得到新的几何图形,且新的几何图形的边数少于前一几何图形的边数,经过多次该操作,最终得到一个交点,该交点作为几何图形的中心,来表征该关键帧。

S32:根据各所述关键帧的所述动作位置坐标,由公式

其中,R表示动作位置坐标,i表示视频流中第i段视频,k表示第i段视频中包括k个关键帧,Center(j)表示k张关键帧中的第j张关键帧的图像中心点,Pi表示第i段视频的居中度最小值的关键帧,dis表示动作位置坐标到中心点的距离。

具体的,根据关键帧的动作位置标记和关键帧的图像中心点,得到各关键帧居中度,按动作类别对各关键帧进行分类,也就是说,根据动作类别将婴儿视频分为多个视频段,对比各视频段中各关键帧的居中度,将居中度值最小的关键帧作为目标关键帧;通过居中度筛选关键帧,使得目标关键帧的动作最正;使得以目标关键帧截取的视频段显示效果最佳,提高用户体验度。

在一实施例中,所述S3包括:

获取关键帧居中度的居中度阈值;

根据各所述动作位置标记计算各所述关键帧的居中度;

根据各所述关键帧的居中度,由公式

将各段视频中各动作类型的所有关键帧的居中度与所述居中度阈值比较,将符合要求的居中度对应的关键帧作为所述目标关键帧;

其中,R表示动作位置坐标,i表示视频流中第i段视频,k表示第i段视频中包括k个关键帧,Center(j)表示k张关键帧中的第j张关键帧的图像中心点,Pi表示第i段视频中各关键帧的居中度,dis表示动作位置标记到中心点的距离。

S4:根据各所述目标关键帧对所述婴儿视频进行裁剪,输出与各动作类别对应的目标视频。

在一实施例中,请参见图6,所述S4包括:

S41:获取各所述目标关键帧的在所述婴儿视频的时间信息和视频流被截取的各视频段的图像帧数;

具体的,对婴儿视频中的各图像帧按时间先后顺序进行排序,根据目标关键帧的时间信息确定在其对应的视频流中的位置,包括:目标关键帧在视频流的开始位置、中间位置或结束位置;同时,获取以目标关键帧对视频流截取视频段对应的图像帧数,也就是说,从视频流截取的视频段中包括的图像帧数量。

在一实施例中,在一所述目标视频中,任一视频段的图像帧数小于等于所述目标视频的总图像帧数的1/2。

具体的,根据各目标关键帧的动作类别标记将截取得到各视频段进行分类;每一类视频段单独拼接成一目标视频;该目标视频需预先设置时长,最后由各视频段拼接出的目标视频的时长要符合预先设置的时长,因此需要设置各视频段的图像帧数,最长的视频段的图像帧数小于等于目标视频的总帧数的1/2;如:一目标视频的时长为T秒,视频帧率为20FPS/秒;总帧数的最大值为MaxF=T×20;各视频段的帧数小于等于MaxF/2;设置各视频段的最大图像帧数,使得各段视频的图像帧数处于相对平衡,保证目标视频的流畅性,提高剪辑效果。

S42:根据各所述目标关键帧对应的所述时间信息,输出各所述目标关键帧对应的视频流的截取方式;

具体的, 截取方式包括:截取目标关键帧之前的图像帧和/或截取目标关键帧之后的图像帧。若目标关键帧在带截取视频流的开始位置,则截取目标关键帧之后的图像帧作为视频段;若目标关键帧在带截取视频流的中间位置,则同时截取目标关键帧之前和之后的图像帧作为视频段;若目标关键帧在带截取视频流的结束位置,则同时截取目标关键帧之前的图像帧作为视频段。

S43:根据各所述截取方式和对应的各所述图像帧数,对各所述视频流进行截取,得到与各所述目标关键帧对应的各所述视频段;

S44:根据各所述动作类别标记对各所述视频段进行分类,然后按时间先后顺序对各动作类别的各所述视频段分别进行拼接,输出各动作类别对应的所述目标视频。

具体的,获取各视频段中的目标关键帧,依据各目标关键帧的动作类别标记对各视频段进行分类;然后对各动作类别对应的视频段以时间先后顺序进行拼接,得到各动作类别对应的目标视频;各动作类别单独拼接,可以体现婴儿完成相同动作的差异,掌握婴儿对每一动作的熟练程度,有利于父母对婴儿的看护。如:截取的视频段为婴儿“跳”的动作,通过对比相邻视频段婴儿完成动作的熟练程度,父母可以调整婴儿在进行“跳”时的保护措施,既能保证婴儿安全,又能提高婴儿自主学习能力。

采用本实施例的婴儿视频自动剪辑的方法,提取婴儿视频中的各关键帧;利用婴儿动作检测模型对各关键帧进行检测,得到各关键帧的动作类型和动作位置;根据各关键帧的动作位置筛选出各动作类别的目标关键帧,根据目标关键帧对婴儿视频进行裁剪,得到各类别的视频段,然后对各类别的视频段进行独立拼接,得到剪辑的各类别的目标视频;通过目标关键帧自动截取婴儿视频,既能保证各图像帧的图像质量,又能提高剪辑效率;同时,对各视频段分类拼接,可以直观体现婴儿动作的熟练程度,为婴儿看护提供依据。

实施例2

本发明还提供了一种婴儿视频自动剪辑的装置,请参见图7,包括:

关键帧提取模块:用于提取待剪辑的婴儿视频中各关键帧,输出关键帧集合;

关键帧检测模块:用于将所述关键帧集合送入婴儿动作检测模型中,输出各所述关键帧的动作类型标记和动作位置标记;

目标关键帧筛选模块:用于根据各所述动作类型标记和各所述动作位置标记,输出各动作类型对应的目标关键帧;

视频截取模块:用于根据各所述目标关键帧对所述婴儿视频进行裁剪,输出与各动作类别对应的目标视频。

采用本实施例的通过婴儿视频自动剪辑的装置,提取婴儿视频中的各关键帧;利用婴儿动作检测模型对各关键帧进行检测,得到各关键帧的动作类型和动作位置;根据各关键帧的动作位置筛选出各动作类别的目标关键帧,根据目标关键帧对婴儿视频进行裁剪,得到各类别的视频段,然后对各类别的视频段进行独立拼接,得到剪辑的各类别的目标视频;通过目标关键帧自动截取婴儿视频,既能保证各图像帧的图像质量,又能提高剪辑效率;同时,对各视频段分类拼接,可以直观体现婴儿动作的熟练程度,为婴儿看护提供依据。

在一实施例中,关键帧提取包括:

颜色空间转换单元:获取待剪辑的婴儿视频在HSV颜色空间的各图像帧;

通道的图像熵单元:根据公式

图像的合熵单元:根据各所述图像帧的各通道的图像熵,由公式:E=a*E(f(i

关键帧集合单元:根据各所述图像帧的合熵,从所有所述图像帧中筛选出多个所述图像帧组成所述关键帧集合;

其中,a、b、c为常数,D表示图像帧的像素值,i表示颜色通道,E

优选地,关键帧集合单元包括:

图像帧数量单元:获取用于筛选关键帧的图像帧数量Q;

合熵序列单元:对各所述图像帧的合熵进行排序,输出合熵序列;

基准图像单元:根据所述图像帧数量Q和所述合熵序列,筛选出Q个所述图像帧组成的基准图像组;

图像帧筛选单元:对所述基准图像组的各所述图像帧进行筛选,输出所述关键帧集合;

其中,Q为正整数。

在一实施例中,图像帧筛选单元包括:

参考图像单元:对比所述基准图像组中各所述图像帧的合熵,输出最大合熵值对应的所述图像帧作为参考图像;

EMD值计算单元:计算其余(Q-1)张各所述图像帧与所述参考图像的EMD值,得到与其余(Q-1)张各所述图像帧一一对应的各EMD值;

EMD值序列单元:对各所述EMD值进行排序,输出EMD序列;

EMD值取点单元:根据所述EMD序列以间隔(Q-1)/m进行一次EMD取值,将得到的m个EMD值对应的图像帧组成所述关键帧集合;

其中,m为大于等于1的正整数,且(Q-1)能被m整除,EMD(Earth Mover'sDistance)值为图像帧与参考图像的向量相似度度量。

在一实施例中,所述目标关键帧筛选模块包括:

居中度参数单元:根据各关键帧的所述动作位置标记和所述动作类型标记,按所述动作类型标记给各关键帧分配动作位置坐标;

居中度计算单元:根据各所述关键帧的居中度,由公式

其中,R表示动作位置坐标,i表示视频流中第i段视频,k表示第i段视频中包括k个关键帧,Center(j)表示k张关键帧中的第j张关键帧的图像中心点,Pi表示第i段视频的居中度最小值的关键帧,dis表示动作位置标记到中心点的距离。

在一实施例中,所述视频截取模块包括:

图像帧数量单元:获取各所述目标关键帧的在所述婴儿视频的时间信息和视频流被截取的各视频段的图像帧数;

截取方式单元:根据各所述目标关键帧对应的所述时间信息,输出各所述目标关键帧对应的视频流的截取方式;

截取单元:根据各所述截取方式和对应的各所述图像帧数,对各所述视频流进行截取,得到与各所述目标关键帧对应的各所述视频段;

视频拼接单元:根据各所述动作类别标记对各所述视频段进行分类,然后按时间先后顺序对各动作类别的各所述视频段分别进行拼接,输出各动作类别对应的所述目标视频。

在一实施例中,在一所述目标视频中,任一视频段的图像帧数小于等于所述目标视频的总图像帧数的1/2。

采用本实施例的通过婴儿视频自动剪辑的装置,提取婴儿视频中的各关键帧;利用婴儿动作检测模型对各关键帧进行检测,得到各关键帧的动作类型和动作位置;根据各关键帧的动作位置筛选出各动作类别的目标关键帧,根据目标关键帧对婴儿视频进行裁剪,得到各类别的视频段,然后对各类别的视频段进行独立拼接,得到剪辑的各类别的目标视频;通过目标关键帧自动截取婴儿视频,既能保证各图像帧的图像质量,又能提高剪辑效率;同时,对各视频段分类拼接,可以直观体现婴儿动作的熟练程度,为婴儿看护提供依据。

实施例3

本发明提供了一种电子设备,如图8所示,包括至少一个处理器、至少一个存储器以及存储在所述存储器中的计算机程序指令。

具体地,上述处理器可以包括中央处理器(CPU),或者特定集成电路(ApplicationSpecific Integrated Circuit,ASIC),或者可以被配置成实施本发明实施例的一个或多个集成电路,电子设备至少包括以下之一:摄像头、具有摄像头的移动设备、具有摄像头的穿戴设备。

存储器可以包括用于数据或指令的大容量存储器。举例来说而非限制,存储器可包括硬盘驱动器(Hard Disk Drive,HDD)、软盘驱动器、闪存、光盘、磁光盘、磁带或通用串行总线(Universal Serial Bus,USB)驱动器或者两个或更多个以上这些的组合。在合适的情况下,存储器可包括可移除或不可移除(或固定)的介质。在合适的情况下,存储器可在数据处理装置的内部或外部。在特定实施例中,存储器是非易失性固态存储器。在特定实施例中,存储器包括只读存储器(ROM)。在合适的情况下,该ROM可以是掩模编程的ROM、可编程ROM(PROM)、可擦除PROM(EPROM)、电可擦除PROM(EEPROM)、电可改写ROM(EAROM)或闪存或者两个或更多个以上这些的组合。

处理器通过读取并执行存储器中存储的计算机程序指令,以实现上述实施例方式一中任意一种婴儿视频自动剪辑的方法。

在一个示例中,电子设备还可包括通信接口和总线。其中,处理器、存储器、通信接口通过总线连接并完成相互间的通信。

通信接口,主要用于实现本发明实施例中各模块、装置、单元和/或设备之间的通信。

总线包括硬件、软件或两者,将电子设备的部件彼此耦接在一起。举例来说而非限制,总线可包括加速图形端口(AGP)或其他图形总线、增强工业标准架构(EISA)总线、前端总线(FSB)、超传输(HT)互连、工业标准架构(ISA)总线、无限带宽互连、低引脚数(LPC)总线、存储器总线、微信道架构(MCA)总线、外围组件互连(PCI)总线、PCI-Express(PCI-X)总线、串行高级技术附件(SATA)总线、视频电子标准协会局部(VLB)总线或其他合适的总线或者两个或更多个以上这些的组合。在合适的情况下,总线可包括一个或多个总线。尽管本发明实施例描述和示出了特定的总线,但本发明考虑任何合适的总线或互连。

综上所述,本发明实施例提供了一种婴儿视频自动剪辑的方法、装置、设备及存储介质,提取婴儿视频中的各关键帧;利用婴儿动作检测模型对各关键帧进行检测,得到各关键帧的动作类型和动作位置;根据各关键帧的动作位置筛选出各动作类别的目标关键帧,根据目标关键帧对婴儿视频进行裁剪,得到各类别的视频段,然后对各类别的视频段进行独立拼接,得到剪辑的各类别的目标视频;通过目标关键帧自动截取婴儿视频,既能保证各图像帧的图像质量,又能提高剪辑效率;同时,对各视频段分类拼接,可以直观体现婴儿动作的熟练程度,为婴儿看护提供依据。

需要明确的是,本发明并不局限于上文所描述并在图中示出的特定配置和处理。为了简明起见,这里省略了对已知方法的详细描述。在上述实施例中,描述和示出了若干具体的步骤作为示例。但是,本发明的方法过程并不限于所描述和示出的具体步骤,本领域的技术人员可以在领会本发明的精神后,作出各种改变、修改和添加,或者改变步骤之间的顺序。

以上所述的结构框图中所示的功能块可以实现为硬件、软件、固件或者它们的组合。当以硬件方式实现时,其可以例如是电子电路、专用集成电路(ASIC)、适当的固件、插件、功能卡等等。当以软件方式实现时,本发明的元素是被用于执行所需任务的程序或者代码段。程序或者代码段可以存储在机器可读介质中,或者通过载波中携带的数据信号在传输介质或者通信链路上传送。“机器可读介质”可以包括能够存储或传输信息的任何介质。机器可读介质的例子包括电子电路、半导体存储器设备、ROM、闪存、可擦除ROM(EROM)、软盘、CD-ROM、光盘、硬盘、光纤介质、射频(RF)链路,等等。代码段可以经由诸如因特网、内联网等的计算机网络被下载。

最后应说明的是:以上各实施例仅用以说明本发明的技术方案,而非对其限制;尽管参照前述各实施例对本发明进行了详细的说明,本领域的普通技术人员应当理解:其依然可以对前述各实施例所记载的技术方案进行修改,或者对其中部分或者全部技术特征进行等同替换;而这些修改或者替换,并不使相应技术方案的本质脱离本发明各实施例技术方案的范围。

- 婴儿视频自动剪辑的方法、装置、设备及存储介质

- 基于婴儿动作视频自动剪辑方法、装置、设备及存储介质