联邦学习的模型参数优化方法及系统

文献发布时间:2023-06-19 12:24:27

技术领域

本发明涉及深度学习技术领域,特别涉及一种联邦学习的模型参数优化方法、一种计算机可读存储介质、一种计算机设备以及一种联邦学习的模型参数优化系统。

背景技术

在信息技术高速发展的今天,在海量数据上经过机器学习算法训练的模型被应用于各行各业。然而随着人们隐私意识的提升和相关法律的推行,直接获取用户数据用于训练模型或将不再可行。而联邦学习作为一种具有隐私保护能力的分布式机器学习范式应运而生。它不再要求用户上传数据,而只交换加密后的模型参数,这样既可以利用用户的数据和算力协同训练一个模型,又可以保护用户数据的隐私。

相关技术中,在实际应用场景下,由于数据在每个客户端上非独立分布,且在数量上有所差异,以及不同个体的网络状态各不相同,有可能存在掉线或僵尸用户的情形,所以容易为模型引入不公平性,而这种不公平性将为模型训练带来负面影响,因为较差的模型性能将有可能抑制部分用户参与训练的意愿,从而不愿意贡献出自己的数据,最终导致模型缺失某类数据,愈发地偏向另一类用户群体的同时,损失了泛化能力,进而大大降低了联邦模型的公平性。

发明内容

本发明旨在至少在一定程度上解决上述技术中的技术问题之一。为此,本发明的一个目的在于提出一种联邦学习的模型参数优化方法,能够通过降低客户端之间的梯度矛盾以对模型参数进行优化,从而提高联邦学习模型的准确性和公平性。

本发明的第二个目的在于提出一种计算机可读存储介质。

本发明的第三个目的在于提出一种计算机设备。

本发明的第四个目的在于提出一种联邦学习的模型参数优化系统。

为达到上述目的,本发明第一方面实施例提出了一种联邦学习的模型参数优化方法,包括以下步骤:

获取多个客户端上传的模型参数及其对应的训练损失值;根据所述模型参数计算每个客户端对应的梯度值,以便根据所述梯度值更新历史梯度列表,其中,所述历史梯度列表包括每个客户端的梯度值和对应的轮数;根据每个客户端上传的训练损失值对所述每个客户端对应的梯度值进行排序,并依次判断所述每个客户端对应的梯度值与除自身外的其他梯度值之间是否存在矛盾分量;如果是,则采用投影的方式依次消去所述每个客户端对应的梯度值与排序出的其他梯度值相矛盾的分量,以得到每个客户端投影后的梯度值;对所述每个客户端投影后的梯度值进行聚合处理,以得到更新后的初步梯度值;从指定轮数起按轮数判断所述更新后的初步梯度值与指定轮数中被采样且当前轮数未被采样的客户端的历史梯度值之间是否存在矛盾分量;如果是,则采用投影的方式消去初步梯度值中与指定轮数中被采样且当前轮数未被采样的客户端的历史梯度值的所有矛盾分量的总和,以得到最终的梯度值。。

根据本发明实施例的联邦学习的模型参数优化方法,首先,获取多个客户端上传的模型参数及其对应的训练损失值;接着,根据模型参数计算每个客户端对应的梯度值,以便根据梯度值更新历史梯度列表,其中,历史梯度列表包括每个客户端的梯度值和对应的轮数;然后,根据每个客户端上传的训练损失值对每个客户端对应的梯度值进行排序,并依次判断每个客户端对应的梯度值与除自身外的其他梯度值之间是否存在矛盾分量;再接着,如果是,则采用投影的方式依次消去每个客户端对应的梯度值与排序出的其他梯度值相矛盾的分量,以得到每个客户端投影后的梯度值;再然后,对每个客户端投影后的梯度值进行聚合处理,以得到更新后的初步梯度值;接着,从指定轮数起按轮数判断更新后的初步梯度值与指定轮数中被采样且当前轮数未被采样的客户端的历史梯度值之间是否存在矛盾分量;最后,如果是,则采用投影的方式消去初步梯度值中与指定轮数中被采样且当前轮数未被采样的客户端的历史梯度值的所有矛盾分量的总和,以得到最终的梯度值;由此,能够通过降低客户端之间的梯度矛盾以对模型参数进行优化,从而提高联邦学习模型的准确性和公平性。

另外,根据本发明上述实施例提出的联邦学习的模型参数优化方法还可以具有如下附加的技术特征:

可选地,当两个梯度值之间的内积小于零时,则判断两个梯度值之间存在矛盾分量;当两个梯度值之间的内积大于等于零时,则判断两个梯度值之间不存在矛盾分量。

可选地,在得到最终的梯度值后,还对所述最终的梯度值的步长进行修正,以便根据修正后的梯度值对所述模型参数进行优化。

需要说明的是,在消除投影操作时潜在地增大了梯度值的步长,为此,需要对最终的梯度值的步长进行修正。

可选地,在获取多个客户端上传的模型参数及其对应的训练损失值前,还包括:初始化模型参数和历史梯度表,并将模型参数分别广播给随机采样的多个客户端;每个客户端根据本地数据集对模型进行训练,以便根据接收到的模型参数计算得到新的模型参数及其对应的训练损失值。

为达到上述目的,本发明第二方面实施例提出了一种计算机可读存储介质,其上存储有联邦学习的模型参数优化程序,该联邦学习的模型参数优化程序被处理器执行时实现如上述的联邦学习的模型参数优化方法。

根据本发明实施例的计算机可读存储介质,通过存储联邦学习的模型参数优化程序,以使得处理器在执行该联邦学习的模型参数优化程序时,实现如上述的联邦学习的模型参数优化方法,由此,能够通过降低客户端之间的梯度矛盾以对模型参数进行优化,从而提高联邦学习模型的准确性和公平性。

为达到上述目的,本发明第三方面实施例提出了一种计算机设备,包括存储器、处理器及存储在存储器上并可在处理器上运行的计算机程序,所述处理器执行所述程序时,实现如上述的联邦学习的模型参数优化方法。

根据本发明实施例的计算机设备,通过存储器对联邦学习的模型参数优化程序进行存储,以使得处理器在执行该联邦学习的模型参数优化程序时,实现如上述的联邦学习的模型参数优化方法,由此,能够通过降低客户端之间的梯度矛盾以对模型参数进行优化,从而提高联邦学习模型的准确性和公平性。

为达到上述目的,本发明第四方面实施例提出了一种联邦学习的模型参数优化系统,包括服务器端和多个客户端,其中,所述服务器端包括:获取模块,用于获取多个客户端上传的模型参数及其对应的训练损失值;计算模块,用于根据所述模型参数计算每个客户端对应的梯度值,以便根据所述梯度值更新历史梯度列表,其中,所述历史梯度列表包括每个客户端的梯度值和对应的轮数;判断模块,用于根据每个客户端上传的训练损失值对所述每个客户端对应的梯度值进行排序,并依次判断所述每个客户端对应的梯度值与除自身外的其他梯度值之间是否存在矛盾分量;第一分量处理模块,用于在存在矛盾分量时采用投影的方式依次消去所述每个客户端对应的梯度值与排序出的其他梯度值相矛盾的分量,以得到每个客户端投影后的梯度值;聚合模块,用于对所述每个客户端投影后的梯度值进行聚合处理,以得到更新后的初步梯度值;所述判断模块,还用于从指定轮数起按轮数判断所述更新后的初步梯度值与指定轮数中被采样且当前轮数未被采样的客户端的历史梯度值之间是否存在矛盾分量;第二分量处理模块,用于在存在矛盾分量时则采用投影的方式消去所述初步梯度值中与指定轮数中被采样且当前轮数未被采样的客户端的历史梯度值的所有矛盾分量的总和,以得到最终的梯度值。

根据本发明实施例的联邦学习的模型参数优化系统,通过获取模块获取多个客户端上传的模型参数及其对应的训练损失值;计算模块根据模型参数计算每个客户端对应的梯度值,以便根据梯度值更新历史梯度列表,其中,历史梯度列表包括每个客户端的梯度值和对应的轮数;判断模块根据每个客户端上传的训练损失值对每个客户端对应的梯度值进行排序,并依次判断每个客户端对应的梯度值与除自身外的其他梯度值之间是否存在矛盾分量;第一分量处理模块在存在矛盾分量时采用投影的方式依次消去每个客户端对应的梯度值与排序出的其他梯度值相矛盾的分量,以得到每个客户端投影后的梯度值;聚合模块对每个客户端投影后的梯度值进行聚合处理,以得到更新后的初步梯度值;判断模块从指定轮数起按轮数判断更新后的初步梯度值与指定轮数中被采样且当前轮数未被采样的客户端的历史梯度值之间是否存在矛盾分量;第二分量处理模块在存在矛盾分量时则采用投影的方式消去初步梯度值中与指定轮数中被采样且当前轮数未被采样的客户端的历史梯度值的所有矛盾分量的总和,以得到最终的梯度值。由此,能够通过降低客户端之间的梯度矛盾以对模型参数进行优化,从而提高联邦学习模型的准确度和公平性。

可选地,所述判断模块还用于当两个梯度值之间的内积小于零时,则判断两个梯度值之间存在矛盾分量;当两个梯度值之间的内积大于等于零时,则判断两个梯度值之间不存在矛盾分量。

可选地,所述服务器端还包括修正模块,用于在得到最终的梯度值后,对所述最终的梯度值的步长进行修正,以便根据修正后的梯度值对所述模型参数进行优化。

可选地,所述,服务器端还包括参数处理模块,用于初始化模型参数和历史梯度表,并将模型参数分别广播给随机采样的多个客户端;每个客户端包括训练模块,用于根据本地数据集对模型进行训练,以便根据接收到的模型参数计算得到新的模型参数及其对应的训练损失值。

附图说明

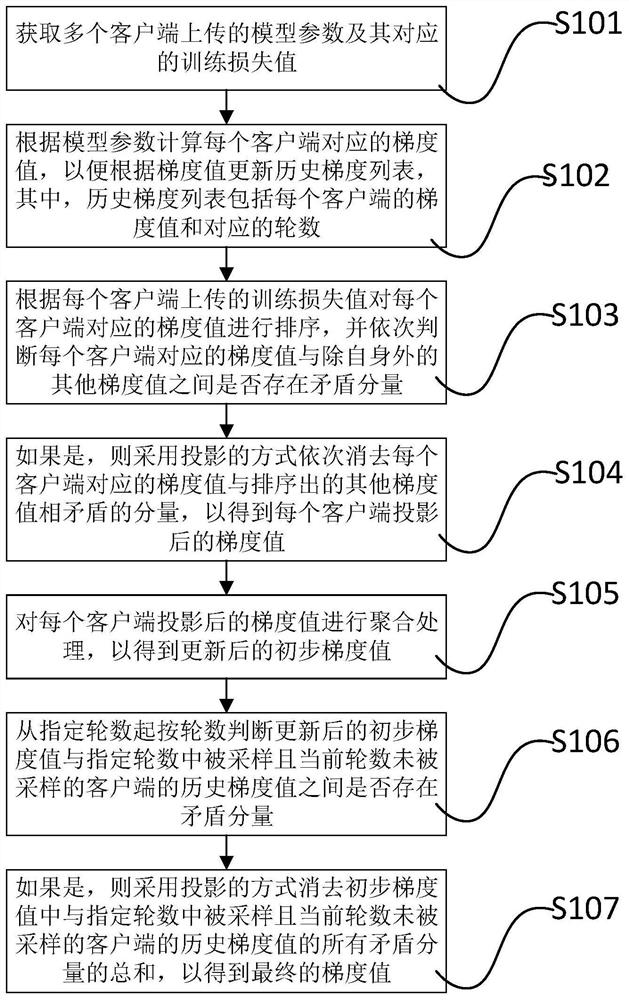

图1为根据本发明实施例的联邦学习的模型参数优化方法的流程示意图;

图2为根据本发明实施例的联邦学习流程示意图;

图3为根据本发明实施例的消除两个梯度之间矛盾分量的前后对比示意图;

图4为根据本发明实施例的联邦学习的模型参数优化系统的结构示意图;

具体实施方式

下面详细描述本发明的实施例,所述实施例的示例在附图中示出,其中自始至终相同或类似的标号表示相同或类似的元件或具有相同或类似功能的元件。下面通过参考附图描述的实施例是示例性的,旨在用于解释本发明,而不能理解为对本发明的限制。

为了更好的理解上述技术方案,下面将参照附图更详细地描述本发明的示例性实施例。虽然附图中显示了本发明的示例性实施例,然而应当理解,可以以各种形式实现本发明而不应被这里阐述的实施例所限制。相反,提供这些实施例是为了能够更透彻地理解本发明,并且能够将本发明的范围完整的传达给本领域的技术人员。

为了更好的理解上述技术方案,下面将结合说明书附图以及具体的实施方式对上述技术方案进行详细的说明。

图1为根据本发明实施例的联邦学习的模型参数优化方法的流程示意图,如图1所示,该联邦学习的模型参数优化方法包括以下步骤:

S101,获取多个客户端上传的模型参数及其对应的训练损失值。

需要说明的是,在获取多个客户端上传的模型参数及其对应的训练损失值前,还包括:初始化模型参数和历史梯度表,并将模型参数分别广播给随机采样的多个客户端;每个客户端根据本地数据集对模型进行训练,以便根据接收到的模型参数计算得到新的模型参数及其对应的训练损失值。

即言,每个客户端将计算得到的新的模型参数及其对应的训练损失值上传给服务器端,以便服务器端可以获取多个客户端上传的模型参数及其对应的训练损失值。

S102,根据模型参数计算每个客户端对应的梯度值,以便根据梯度值更新历史梯度列表,其中,历史梯度列表包括每个客户端的梯度值和对应的轮数。

作为一个示例,通过以下公式计算每个客户端对应的梯度值:

其中,t表示通信轮数,k表示客户端个数,k∈{1,2,…,N},

S103,根据每个客户端上传的训练损失值对每个客户端对应的梯度值进行排序,并依次判断每个客户端对应的梯度值与除自身外的其他梯度值之间是否存在矛盾分量。

需要说明的是,如果每个客户端对应的梯度值与除自身外的其他梯度值之间的内积小于零,则判断两个梯度值之间存在矛盾分量;如果大于等于零,则判断两个梯度值之间不存在矛盾分量。

S104,如果是,则采用投影的方式依次消去每个客户端对应的梯度值与排序出的其他梯度值相矛盾的分量,以得到每个客户端投影后的梯度值。

作为一个示例,通过以下公式计算每个客户端投影后的梯度值:

其中,

S105,对每个客户端投影后的梯度值进行聚合处理,以得到更新后的初步梯度值。

作为一个示例,通过以下公式得到更新后的初步梯度值:

其中,g

由此,本发明设计了一种按训练损失大小顺序通过投影消除客户端之间梯度矛盾的方法,使得最终聚合出的梯度与优化越差的客户端的梯度之间的矛盾越小,从而实现了公平性。

S106,从指定轮数起按轮数判断更新后的初步梯度值与指定轮数中被采样且当前轮数未被采样的客户端的历史梯度值之间是否存在矛盾分量。

需要说明的是,上述指定轮数为当前轮数中的先前轮数中的某一轮,可由用户根据实际需要指定。

S107,如果是,则采用投影的方式消去初步梯度值中与指定轮数中被采样且当前轮数未被采样的客户端的历史梯度值的所有矛盾分量的总和,以得到最终的梯度值。

也就是说,如果存在矛盾分量,则采用投影的方式消去初步梯度值中与指定轮数中被采样且当前轮数未被采样的客户端的历史梯度值的所有矛盾分量的总和,以得到最终的梯度值。

作为一个示例,假设当前轮数为第7轮,指定轮数为第3轮,则判断第7轮得到的更新后的初步梯度值与第3轮中被采样且第7轮未被采样的所有客户端的历史梯度值之间是否存在矛盾分量,如果存在矛盾分量,则计算第3轮中与第7轮得到的更新后的初步梯度值相矛盾的所有矛盾分量的总和,并采用投影的方式消除第7轮得到的更新后的初步梯度值中的所有矛盾分量的总和,接着按上述方式计算指定轮数为第4轮的矛盾分量,依次类推直至第6轮。

需要说明的是,由于通信资源有限,每一轮服务器端仅选择部分客户端参与训练,所以容易出现采样偏差,为此,本发明还通过按时间顺序的投影方式从前往后消去与先前轮数中每个客户端的梯度值之间相矛盾的分量,以降低服务器选择客户端时出现的采样偏差的负面影响,从而提高联邦学习模型的准确度和公平性。

作为一个具体实施例,通过以下公式计算客户端的历史梯度表GH所属轮数为i的客户端梯度值中与更新后的梯度值g

接着,服务器端通过以下公式消去更新后的梯度值g

其中,g

作为一个示例,在得到最终的梯度值后,还对最终的梯度值的步长进行修正,以便根据修正后的梯度值对模型参数进行优化。

需要说明的是,在消除投影操作时潜在地增大了梯度值的步长,为此,需要对最终的梯度值的步长进行修正。

作为一个具体实施例,服务器端通过以下公式修正最终的梯度值的步长:

其中,g

需要说明的是,服务器端通过θ

综上所述,根据本发明实施例的联邦学习的模型参数优化方法,首先,获取多个客户端上传的模型参数及其对应的训练损失值;接着,根据模型参数计算每个客户端对应的梯度值,以便根据梯度值更新历史梯度列表,其中,历史梯度列表包括每个客户端的梯度值和对应的轮数;然后,根据每个客户端上传的训练损失值对每个客户端对应的梯度值进行排序,并依次判断每个客户端对应的梯度值与除自身外的其他梯度值之间是否存在矛盾分量;再接着,如果是,则采用投影的方式依次消去每个客户端对应的梯度值与排序出的其他梯度值相矛盾的分量,以得到每个客户端投影后的梯度值;再然后,对每个客户端投影后的梯度值进行聚合处理,以得到更新后的初步梯度值;接着,从指定轮数起按轮数判断更新后的初步梯度值与指定轮数中被采样且当前轮数未被采样的客户端的历史梯度值之间是否存在矛盾分量;最后,如果是,则采用投影的方式消去初步梯度值中与指定轮数中被采样且当前轮数未被采样的客户端的历史梯度值的所有矛盾分量的总和,以得到最终的梯度值;由此,能够通过降低客户端之间的梯度矛盾以对模型参数进行优化,从而提高联邦学习模型的公平性。

如图2和图3所示,为了更好的理解上述技术方案,下面通过一个具体实施例更详细地描述本发明的技术方案:

步骤A,服务器端初始化和广播参数。

步骤A.1,服务器端初始化深度学习模型参数θ

步骤A.2,服务器端从用户集

步骤B,客户端本地训练模型。

步骤B.1,第t轮中被选中的用户c

步骤B.2,用户c

步骤C,服务器端接收参数。

步骤C.1,服务器端接收来自S

步骤C.2,服务器端计算各个用户的梯度

步骤D,服务器端消除本轮用户间梯度矛盾。

步骤D.1,服务器端根据上传的用户训练损失大小对用户的梯度进行排序,得到排序后的用户梯度数组

步骤D.2,对于PO

最终得到各个用户的投影后的梯度

步骤D.3,将消除矛盾后的梯度聚合,得到初步梯度

步骤E,服务器端修正采样偏差。

步骤E.1,若当前轮数t≤τ,则直接跳转至步骤A.2;否则令i=t-τ。

步骤E.2,服务器端计算用户历史梯度表GH所属轮数为i的用户梯度中与初步梯度g

步骤E.3,服务器端消去初步梯度g

步骤E.4,令i=i+1,若i 步骤F,服务器端更新模型参数。 步骤F.1,为了消除投影操作潜在地增大了步长的影响,服务器修正最终梯度的步长为

步骤F.2,服务器端更新模型参数θ 由此,本发明提出了一种按训练损失大小顺序通过投影消除用户之间梯度矛盾的方法,使得最终聚合出的梯度与优化越差的用户的梯度之间的矛盾越小,实现了公平性;以及提出了一种通过投影按时间顺序从前往后消除采样偏见的方法,降低了服务器端选择用户时的采样偏差的负面影响,从而提高联邦学习模型的准确度和公平性。 为了实现上述实施例,本发明实施例提出了一种计算机可读存储介质,其上存储有联邦学习的模型参数优化程序,该联邦学习的模型参数优化程序被处理器执行时实现如上述的联邦学习的模型参数优化方法。 根据本发明实施例的计算机可读存储介质,通过存储联邦学习的模型参数优化程序,以使得处理器在执行该联邦学习的模型参数优化程序时,实现如上述的联邦学习的模型参数优化方法,由此,能够通过降低客户端之间的梯度矛盾以对模型参数进行优化,从而提高联邦学习模型的公平性。 为了实现上述实施例,本发明实施例提出了一种计算机设备,包括存储器、处理器及存储在存储器上并可在处理器上运行的计算机程序,所述处理器执行所述程序时,实现如上述的联邦学习的模型参数优化方法。 根据本发明实施例的计算机设备,通过存储器对联邦学习的模型参数优化程序进行存储,以使得处理器在执行该联邦学习的模型参数优化程序时,实现如上述的联邦学习的模型参数优化方法,由此,能够通过降低客户端之间的梯度矛盾以对模型参数进行优化,从而提高联邦学习模型的公平性。 另外,如图4所示,本发明实施例还提出了一直联邦学习的模型参数优化系统,包括服务器端1和多个客户端2,其中,服务器端1包括:获取模块11,用于获取多个客户端上传的模型参数及其对应的训练损失值;计算模块12,用于根据所述模型参数计算每个客户端对应的梯度值,以便根据所述梯度值更新历史梯度列表,其中,所述历史梯度列表包括每个客户端的梯度值和对应的轮数;判断模块13,用于根据每个客户端上传的训练损失值对所述每个客户端对应的梯度值进行排序,并依次判断所述每个客户端对应的梯度值与除自身外的其他梯度值之间是否存在矛盾分量;第一分量处理模块14,用于在存在矛盾分量时采用投影的方式依次消去所述每个客户端对应的梯度值与排序出的其他梯度值相矛盾的分量,以得到每个客户端投影后的梯度值;聚合模块15,对所述每个客户端投影后的梯度值进行聚合处理,以得到更新后的初步梯度值;判断模块13,还用于从指定轮数起按轮数判断更新后的初步梯度值与指定轮数中被采样且当前轮数未被采样的客户端的历史梯度值之间是否存在矛盾分量;第二分量处理模块16在存在矛盾分量时则采用投影的方式消去初步梯度值中与指定轮数中被采样且当前轮数未被采样的客户端的历史梯度值的所有矛盾分量的总和,以得到最终的梯度值。 作为一个示例,判断模块13还用于当两个梯度值之间的内积小于零时,则判断两个梯度值之间存在矛盾分量;当两个梯度值之间的内积大于等于零时,则判断两个梯度值之间不存在矛盾分量。 作为一个示例,服务器端1还包括修正模块17,用于在得到最终的梯度值后,对最终的梯度值的步长进行修正,以便根据修正后的梯度值对模型参数进行优化。 作为一个示例,服务器端1还包括参数处理模块18,用于初始化模型参数和历史梯度表,并将模型参数分别广播给随机采样的多个客户端;每个客户端包括训练模块21,用于根据本地数据集对模型进行训练,以便根据接收到的模型参数计算得到新的模型参数及其对应的训练损失值。 需要说明的是,上述关于联邦学习的模型参数优化方法的描述及举例说明同样适用于本实施例的联邦学习的模型参数优化系统,在此不做赘述。 综上所述,根据本发明实施例的联邦学习的模型参数优化系统,通过获取模块获取多个客户端上传的模型参数及其对应的训练损失值;计算模块根据模型参数计算每个客户端对应的梯度值,以便根据梯度值更新历史梯度列表,其中,历史梯度列表包括每个客户端的梯度值和对应的轮数;判断模块根据每个客户端上传的训练损失值对每个客户端对应的梯度值进行排序,并依次判断每个客户端对应的梯度值与除自身外的其他梯度值之间是否存在矛盾分量;第一分量处理模块在存在矛盾分量时采用投影的方式依次消去每个客户端对应的梯度值与排序出的其他梯度值相矛盾的分量,以得到每个客户端投影后的梯度值;聚合模块对每个客户端投影后的梯度值进行聚合处理,以得到更新后的初步梯度值;判断模块从指定轮数起按轮数判断更新后的初步梯度值与指定轮数中被采样且当前轮数未被采样的客户端的历史梯度值之间是否存在矛盾分量;第二分量处理模块在存在矛盾分量时则采用投影的方式消去初步梯度值中与指定轮数中被采样且当前轮数未被采样的客户端的历史梯度值的所有矛盾分量的总和,以得到最终的梯度值。由此,能够通过降低客户端之间的梯度矛盾以对模型参数进行优化,从而提高联邦学习模型的准确度和公平性。。 本领域内的技术人员应明白,本发明的实施例可提供为方法、系统、或计算机程序产品。因此,本发明可采用完全硬件实施例、完全软件实施例、或结合软件和硬件方面的实施例的形式。而且,本发明可采用在一个或多个其中包含有计算机可用程序代码的计算机可用存储介质(包括但不限于磁盘存储器、CD-ROM、光学存储器等)上实施的计算机程序产品的形式。 本发明是参照根据本发明实施例的方法、设备(系统)、和计算机程序产品的流程图和/或方框图来描述的。应理解可由计算机程序指令实现流程图和/或方框图中的每一流程和/或方框、以及流程图和/或方框图中的流程和/或方框的结合。可提供这些计算机程序指令到通用计算机、专用计算机、嵌入式处理机或其他可编程数据处理设备的处理器以产生一个机器,使得通过计算机或其他可编程数据处理设备的处理器执行的指令产生用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的装置。 这些计算机程序指令也可存储在能引导计算机或其他可编程数据处理设备以特定方式工作的计算机可读存储器中,使得存储在该计算机可读存储器中的指令产生包括指令装置的制造品,该指令装置实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能。 这些计算机程序指令也可装载到计算机或其他可编程数据处理设备上,使得在计算机或其他可编程设备上执行一系列操作步骤以产生计算机实现的处理,从而在计算机或其他可编程设备上执行的指令提供用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的步骤。 应当注意的是,在权利要求中,不应将位于括号之间的任何参考符号构造成对权利要求的限制。单词“包含”不排除存在未列在权利要求中的部件或步骤。位于部件之前的单词“一”或“一个”不排除存在多个这样的部件。本发明可以借助于包括有若干不同部件的硬件以及借助于适当编程的计算机来实现。在列举了若干装置的单元权利要求中,这些装置中的若干个可以是通过同一个硬件项来具体体现。单词第一、第二、以及第三等的使用不表示任何顺序。可将这些单词解释为名称。 尽管已描述了本发明的优选实施例,但本领域内的技术人员一旦得知了基本创造性概念,则可对这些实施例作出另外的变更和修改。所以,所附权利要求意欲解释为包括优选实施例以及落入本发明范围的所有变更和修改。 显然,本领域的技术人员可以对本发明进行各种改动和变型而不脱离本发明的精神和范围。这样,倘若本发明的这些修改和变型属于本发明权利要求及其等同技术的范围之内,则本发明也意图包含这些改动和变型在内。 在本发明的描述中,需要理解的是,术语“第一”、“第二”仅用于描述目的,而不能理解为指示或暗示相对重要性或者隐含指明所指示的技术特征的数量。由此,限定有“第一”、“第二”的特征可以明示或者隐含地包括一个或者更多个该特征。在本发明的描述中,“多个”的含义是两个或两个以上,除非另有明确具体的限定。 在本发明中,除非另有明确的规定和限定,术语“安装”、“相连”、“连接”、“固定”等术语应做广义理解,例如,可以是固定连接,也可以是可拆卸连接,或成一体;可以是机械连接,也可以是电连接;可以是直接相连,也可以通过中间媒介间接相连,可以是两个元件内部的连通或两个元件的相互作用关系。对于本领域的普通技术人员而言,可以根据具体情况理解上述术语在本发明中的具体含义。 在本发明中,除非另有明确的规定和限定,第一特征在第二特征“上”或“下”可以是第一和第二特征直接接触,或第一和第二特征通过中间媒介间接接触。而且,第一特征在第二特征“之上”、“上方”和“上面”可是第一特征在第二特征正上方或斜上方,或仅仅表示第一特征水平高度高于第二特征。第一特征在第二特征“之下”、“下方”和“下面”可以是第一特征在第二特征正下方或斜下方,或仅仅表示第一特征水平高度小于第二特征。 在本说明书的描述中,参考术语“一个实施例”、“一些实施例”、“示例”、“具体示例”、或“一些示例”等的描述意指结合该实施例或示例描述的具体特征、结构、材料或者特点包含于本发明的至少一个实施例或示例中。在本说明书中,对上述术语的示意性表述不应理解为必须针对的是相同的实施例或示例。而且,描述的具体特征、结构、材料或者特点可以在任一个或多个实施例或示例中以合适的方式结合。此外,在不相互矛盾的情况下,本领域的技术人员可以将本说明书中描述的不同实施例或示例以及不同实施例或示例的特征进行结合和组合。 尽管上面已经示出和描述了本发明的实施例,可以理解的是,上述实施例是示例性的,不能理解为对本发明的限制,本领域的普通技术人员在本发明的范围内可以对上述实施例进行变化、修改、替换和变型。