一种高精度的细粒度SAR目标检测方法

文献发布时间:2023-06-19 18:27:32

技术领域

本发明属于计算机视觉与模式识别技术领域,特别是一种高精度的细粒度SAR目标检测方法。

背景技术

合成孔径雷达(Synthetic Aperture Radar,SAR)是一种主动式的对地观测系统,能实现全天时,全天候对地观测,在灾害监测、环境监测、海洋监测、测绘和军事等方面的应用上具有独特的优势,可发挥其他遥感手段难以发挥的作用。目标检测任务为给出图像中所有感兴趣目标的坐标位置并识别目标所属的具体类别,是SAR图像处理的重要基础任务之一。更进一步,细粒度检测要求模型准确地识别出SAR图像中相似但不同类的目标。由于SAR图像中的目标缺乏细节信息,其异类目标的类间差异较小,如何更精确地进行细粒度检测具有理论上的研究价值与实际的应用价值。

目前主流的先进目标检测算法大多更加关注如何准确地定位目标,不能有效地处理检测中的细粒度分类识别问题,会出现定位准确但分类错误的情况。并且,相比于光学图像,SAR图像因其成像方式的特殊性会缺乏细节纹理信息,且容易受到噪声和冗余背景的干扰,这使得一般的检测算法更难在SAR图像中区分容易混淆的异类相似目标。

对比学习有增大类间目标差异,提高类内目标相似度的作用,是增强细粒度分类性能的一种有效方法。然而目前的对比学习技术大多基于图像级分类任务开发,且集中于无监督预训练领域,在监督学习尤其是目标检测任务上的应用较少。同时,一些较成功的对比学习方法需要提取大量的正负样本对进行对比训练,而SAR图像幅面广的特性以及飞机目标分布的稀疏性导致在检测模型的训练中无法一次提取大量的样本。此外,对比学习的关键在于在投影空间拉近相同类别特征向量的距离,同时使得不同类别的特征具有足够的差异性。然而考虑到定位任务对特征的需求,过于追求特征的差异性可能会损害定位的精度。

因此,实现准确的SAR细粒度目标检测需要提出一种实例级的,不需要在一次训练步骤中提取大量样本的对比学习方法,同时还要注意修正其对定位任务精度的影响,而这也成为当前研究的关键问题。

发明内容

鉴于上述问题,本发明提供一种至少解决上述部分技术问题的一种高精度的细粒度SAR目标检测方法,通过该方法可以减少对比学习方法中的样本数量。

本发明实施例提供了一种高精度的细粒度SAR目标检测方法,包括:

获取待检测SAR图像,并将所述待检测SAR图像输入到训练后的SAR图像细粒度检测模型中,输出所述待检测SAR图像中,所有感兴趣目标的坐标位置和所属类别;

其中,所述SAR图像细粒度检测模型的训练方法如下:

S1、基于训练数据集,构建全局实例集;

S2、构建SAR图像细粒度检测模型框架;将所述训练数据集输入至所述SAR图像细粒度检测模型框架中;由所述SAR图像细粒度检测模型框架对所述训练集中感兴趣目标的坐标位置进行提取,以及识别所提取出来的感兴趣目标的所属类别;将提取和识别的内容组合成模型采集数据集;

S3、从全局实例集随机抽取实例,组成抽样数据集;

S4、分别对模型采集数据集和抽样数据集中的感兴趣目标编码后,进行全局实例对比;

S5、根据对比结果对所述SAR图像细粒度检测模型框架进行优化,直至获得最终的SAR图像细粒度检测模型。

进一步地,所述S1具体包括:

获取SAR图像训练样本;所述SAR图像训练样本中包括多个目标区域;

将SAR图像训练样本,以及所有目标区域内已知的所有感兴趣目标的坐标位置和所属类别作为训练数据集;

对训练数据集中的所有目标区域进行裁剪和缩放,组成一个全局实例集。

进一步地,在所述S2中,由所述SAR图像细粒度检测模型框架对所述训练集中感兴趣目标的坐标位置进行提取,以及识别所提取出来的感兴趣目标的所属类别,具体包括:

通过SAR图像细粒度检测模型框架中的骨干卷积网络对输入的SAR图像训练样本进行特征图提取,并通过计算特征金字塔得到多个不同尺寸的特征图;

将每个所述特征图送入检测头,对每个所述特征图中感兴趣目标的坐标位置进行提取,以及识别所提取出来的感兴趣目标的所属类别。

进一步地,对于每个所述特征图,进入全局实例对比前的准备工作包括:

根据输入的感兴趣目标的所属类别,将该特征图裁剪为多个区域,记作第一特征区域集;

从所述全局实例集中的目标区域进行随机抽样,并采用骨干卷积网络对抽样得到的目标区域进行特征提取,记作第二特征区域集;

分别对所述第一特征区域集和第二特征区域集中的感兴趣目标编码后,进行全局实例对比。

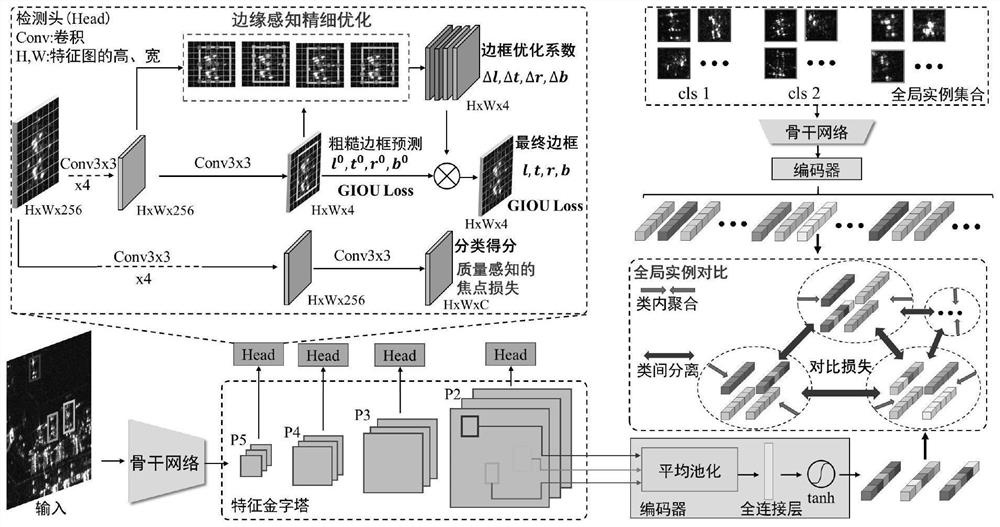

进一步地,采用由平均池化和全连接层组成的编码器,使用tanh做为非线性激活函数来对感兴趣目标进行编码。

进一步地,全局实例对比所采用的实例级对比损失定义如下:

其中,L

进一步地,所述检测头使用了全卷积的anchor-free结构;

所述检测头用于在不同尺度的特征图上对每个感兴趣目标的位置和类别置信度进行预测。

进一步地,所述检测头采用基于定位质量感知的焦点损失作为分类损失;

所述基于定位质量感知的焦点损失表示为:

其中,q表示在该点的预测边框和真实边框的交并比;p表示SAR图像细粒度检测模型得出的当前样本分类置信度;y=1/0表示该点属于或不属于该类别;当y=0时,对应的q也将被设为0;t,β,γ均为控制损失各项比例的超参数。

进一步地,所述SAR图像细粒度检测模型采用两阶段定位方式;

在第一阶段,所述SAR图像细粒度检测模型所有正样本点预测向量,分别表示样本点到真实边框四个边界的粗糙距离预测;

在第二阶段,基于第一阶段的预测结果,采用边界感知边框精细优化模块对边框进行调整。

进一步地,所述SAR图像细粒度检测模型的总体损失函数由分类损失,定位损失和目标定位损失函数三部分组成。

与现有技术相比,本发明记载的一种高精度的细粒度SAR目标检测方法,具有如下有益效果:

首先,本发明将监督对比学习方法运用到了检测模型中,从数据集中构建了实例集合并提出全局实例采样来增大对比学习的样本量。

本发明在训练过程中,模型将对图像中的目标和采样得到的目标一同计算对比损失来强化表示学习能力。

为同时增强模型的定位能力,本发明设计了一个边缘感知的精细边框优化模块。通过分别提取目标上、下、左、右的边界特征,模型能够实现更加精准地定位。

本发明提出了一种定位质量感知的焦点损失,通过给予定位准确但分类错误的样本更大的权重,让模型更加关注高质量定位下的精细分类问题。

本发明的其它特征和优点将在随后的说明书中阐述,并且,部分地从说明书中变得显而易见,或者通过实施本发明而了解。本发明的目的和其他优点可通过在所写的说明书、权利要求书、以及附图中所特别指出的结构来实现和获得。

下面通过附图和实施例,对本发明的技术方案做进一步的详细描述。

附图说明

附图用来提供对本发明的进一步理解,并且构成说明书的一部分,与本发明的实施例一起用于解释本发明,并不构成对本发明的限制。在附图中:

图1为本发明实施例提供的基于全局实例对比的SAR图像细粒度检测模型框架示意图。

图2为本发明实施例提供的边缘感知的精细边框优化示意图。

图3为本发明实施例提供的全局实例对比对细粒度检测性能的效果对比示意图。

具体实施方式

下面将参照附图更详细地描述本公开的示例性实施例。虽然附图中显示了本公开的示例性实施例,然而应当理解,可以以各种形式实现本公开而不应被这里阐述的实施例所限制。相反,提供这些实施例是为了能够更透彻地理解本公开,并且能够将本公开的范围完整的传达给本领域的技术人员。

本发明实施例提供了一种高精度的SAR图像细粒度目标检测方法,能够为学术界细粒度目标检测领域的研究提供理论与技术支撑,同时也能够应用于实践中SAR图像的处理与感兴趣目标的提取中;该方法具体包括如下步骤:

获取待检测SAR图像,并将所述待检测SAR图像输入到训练后的SAR图像细粒度检测模型中,输出所述待检测SAR图像中,所有感兴趣目标的坐标位置和所属类别;

其中,所述SAR图像细粒度检测模型的训练方法如下:

S1、获取SAR图像训练样本;该SAR图像训练样本中包括多个目标区域;将SAR图像训练样本,以及所有目标区域内已知的所有感兴趣目标的坐标位置和所属类别作为训练数据集;对训练数据集中的所有目标区域进行裁剪和缩放,组成一个全局实例集;

S2、构建SAR图像细粒度检测模型框架;将所述训练数据集输入至所述SAR图像细粒度检测模型框架中;由所述SAR图像细粒度检测模型框架对所述训练集中感兴趣目标的坐标位置进行提取,以及识别所提取出来的感兴趣目标的所属类别;将提取和识别的内容组合成模型采集数据集;

S3、从全局实例集随机抽取实例,组成抽样数据集;

S4、分别对模型采集数据集和抽样数据集中的感兴趣目标编码后,进行全局实例对比;

S5、根据对比结果对所述SAR图像细粒度检测模型框架进行优化,直至获得最终的SAR图像细粒度检测模型。

上述S1、S2、S3、S4和S5仅为了便于理解,而不会对训练方法的具体步骤构成限定。

接下来对上述SAR图像细粒度检测模型的训练方法进行具体说明。

(1)任务定义

SAR图像细粒度检测模型的任务定义如下:给定SAR图像I,经过训练的模型能够在图像上推理得到所有待检测目标的坐标位置和所属的类别:

其中model(I)代表检测模型;bbox

(2)SAR图像细粒度检测模型的总体架构

模型训练时的输入为SAR图像I及其对应的待检测目标位置和类别标注,这里表示为集合B:

对于输入的SAR图像,模型采用骨干卷积网络G(·)进行特征图的提取,并通过计算特征金字塔得到P

就特征图P

(3)全局实例对比(Global Instance Contrast,GIC)

在模型训练前,将训练数据集中的所有目标区域裁剪、缩放,组成一个全局实例集合(如图1右上角所示)。训练中,首先根据输入的标注(即感兴趣目标的所属类别)将P

在本发明实施例中,在编码时,采用一个由平均池化和全连接层组成的编码器,使用tanh做为非线性激活函数来对感兴趣目标进行编码:

f

上式中,FC(·)表示全连接层;avgpool(·)表示平均池化计算。对于一个来自实例集合或训练图片中的目标F

F={<f

式(2)中<f

本发明实施例中,全局实例对比所采用的实例级对比损失定义如下:

其中,L

(4)边缘感知精细优化

本方法实施例中,检测头使用了全卷积的anchor-free结构。检测器在不同尺度特征图上的每个点对目标的位置和类别置信度进行预测。对于

为了增强检测器的定位能力,本发明实施例中,SAR图像细粒度检测模型采用两阶段定位方式;在第一阶段,所述SAR图像细粒度检测模型为所有正样本点预测向量(l

式(5)中l,r,t,b分别为正样本点与真实边框四个边界距离的最终预测结果。

对于特征图上某一正样本点(x,y),其映射到输入图片上的坐标表示为

式(6)中(x

L

式(7)中bbox

(5)定位质量感知的焦点损失

目前主流的一阶段检测器大多采用焦点损失(FocalLoss)作为分类损失。然而FocalLoss在计算时并没有考虑定位精度的影响。为避免出现边框预测准确但分类发生错误的情况,分类损失应当能够对定位精度较高的预测边框给与更多的关注,提高高质量边框的分类正确率。因此,本方法将预测的边界框与真实值的交并比(IntersectionoverUnion,IOU)引入,提出了定位质量感知的焦点损失(IOU-AwareFocalLoss,IAFL),定义如下:

对于正样本点,用q表示在该点的预测边框和真实边框的IOU;p为模型得出的当前样本分类置信度。检测器为每一个点都预测了一个长度为C的向量(p

IAFL在Focal Loss的基础上增加了IOU权重q和边框质量系数(t+max(q-p,0))

(6)总体损失函数

模型的损失函数由分类损失,定位损失和目标定位损失函数三部分组成,总体损失函数如下:

其中K为样本点总数,P为所有正样本点组成的集合,i为遍历的指标,bbox

接下来通过一个具体的实施例对上述内容进行具体说明。

SAR图像细粒度飞机目标检测:

使用GaoFen-3号遥感卫星得到的SAR图像数据进行细粒度飞机目标检测任务的训练,并与其他的目标检测方法进行对比,得到的结果如表1所示:

表1本方法与其他检测模型在SAR图像细粒度飞机检测的精度对比

由表1可知,实验结果表明,本发明所提供的一种高精度的细粒度SAR目标检测方法,能够很好地处理SAR图像细粒度识别问题,在不同骨干网络上几乎都超越了现有的检测方法。使用ResneXt作为骨干网络的最佳模型取得了74.7的AP,98的AP50以及84.7的AP75,达到了现阶段SAR细粒度飞机检测任务的SOTA结果。实验结果充分验证了本方法的有效性。值得一提的是,模型的AP75在ResNet-50和ResNeXt-101上相比于次优的检测方法分别有3.0/0.6的性能提升,这表明此模型在准确定位的情况下具有更强的细粒度分类能力。

此外,本方法还在检测模型FCOS上测试了全局实例对比的效果,效果图可参见图3所示;从图3可以看出,加入全局实例对比模块后,原模型中许多的误检结果被纠正,这表明提取类别特异性特征对细粒度检测的分类正确率是非常重要的。上述结果也验证了本方法的有效性和普遍性。

显然,本领域的技术人员可以对本发明进行各种改动和变型而不脱离本发明的精神和范围。这样,倘若本发明的这些修改和变型属于本发明权利要求及其等同技术的范围之内,则本发明也意图包含这些改动和变型在内。

- 一种细粒度导向的小目标检测方法

- 一种基于目标检测和细粒度识别的故障分类可视化方法