一种基于深度学习的道路灾情遥感智能检测方法

文献发布时间:2023-06-19 11:29:13

技术领域

本发明属于遥感影像处理的技术领域,更具体涉及一种基于深度学习的道路灾情智能检测方法,适用于分辨率0.5m-2m的光学遥感影像。

背景技术

交通运输在震后救援中扮演着不可或缺的重要角色,然而,由于地震的影响,交通要素往往受到不同程度的毁坏而无法正常通行,给整个救援活动带来诸多的挑战,其中道路受灾对救援影响最大。因此,如何快速准确的获取震后道路受灾情况对整个灾后救援活动的顺利进行至关重要。依靠传统的方法很难从地面快速了解受灾区道路的受灾情况,从而无法快速地制定并实施救援方案,影响了整个救援活动的进度。

遥感作为一种快速获取地面情况的技术手段能够克服传统手段的局限性,对于道路而言,遥感的手段能够帮助决策者快速判断交通路线受阻的位置以及它的损毁程度,从而制定相应的疏通计划和救援路线,确保救援活动能够快速有效的进行。过去的遥感震后灾情提取多以人工目视解译为主,往往耗费大量的人力和时间,且依赖于专家的判读经验,速度慢,无法满足快速救援的时效性需求。随着计算机图像处理、模式识别和图像分类等技术的发展,遥感震后灾情提取逐渐自动化,使得灾情提取更具时效性,能够不断去满足灾情救援快速高效的需求。

道路在地震灾害收到破坏的形式包括由于地震本身造成交通线路的震毁、崩塌、断裂等以及由于次生灾害如滑坡、泥石流、堰塞湖等对道路造成的掩埋、淹没、封堵。

秦军等人以低空遥感平台获取的地震灾区大比例尺真彩色遥感影像为信息源,提取灾区道路、桥梁和隧道洞口等交通构筑物的空间信息,以及滑坡、崩塌、堰塞湖等灾害体的空间分布信息,形成崩塌、滑坡灾害分布和道路设施空间分布专题图。王艳萍等通过面向对象的方法快速提取道路灾情信息,利用震后道路网络图并结合路径优化算法建立了地震紧急救援路径优选模型。然而此类方法仍然无法直接针对道路受灾的部分进行检测,自动化程度有限,对人为干涉的依赖性较高。随着近年来地理信息系统(GeographicInformation System,GIS)基础数据的不断完善,GIS数据在灾害遥感信息提取中的应用也愈加广泛。谢翠容等提出了一种改进的矢量与影像叠加的算法,实现了道路灾情信息提取的高效率与高精度。通过建立道路缓冲区,使得提取受损路面的过程更加简洁有效,从而实现准确提取受灾路段。由此可见,将GIS数据与遥感数据结合并进行叠加分析,能够有效地约束目标检测的范围,从而提高道路灾情目标的检测精度。

发明内容

针对上述现有技术存在的缺陷,本发明解决的问题在于提供了一种基于深度学习的道路灾情遥感智能检测方法,方法易行,操作方便。通过结合GIS技术和深度学习技术,针对道路灾情目标本身进行检测。首先利用构建的道路灾情样本,将检测对象锁定到灾情本身,解决一般灾情提取技术由于多步操作导致的误差乘积效应;接着将样本输入YOLOv3网络进行训练,利用模型学习道路灾情语义特征,训练完成后对道路灾情进行检测,解决了常规方法自动化程度不高,道路灾情的检测精度依赖于道路提取精度且检测时间长的问题;此外,待检测数据输入网络前,采用道路矢量数据构建图像中相关道路的道路缓冲区,并通过图像掩膜技术将道路及其周边区域提取,解决了检测过程中由于影像范围过大导致的错检问题,又保留了检测必要的语义信息,进一步提高了检测效率。

为了实现上述目的,本发明采用以下技术措施:

本发明的构思为:首先,根据道路灾情的上下文语义信息构建道路灾情样本训练YOLOv3网络。其次,检测时,根据道路矢量数据建立相应的半径为道路宽度3-4倍的缓冲区;根据建成的缓冲区对遥感图像进行掩膜,获取道路及其周边区域的遥感图像数据,进一步缩小检测范围。最后利用改进的YOLOV3网络对掩膜后图像内的道路灾情目标进行预测,定位相应的道路灾情目标。

针对以上问题,本发明提出了一种基于深度学习的道路灾情遥感智能检测方法,目的是提供一种针对0.5m-2m的光学遥感影像上的道路灾情目标检测方法,即通过深度学习模型学习道路灾情特征,结合道路矢量数据,建立道路及其周边区域缓冲区,缩小灾情目标的检测范围,选择改进的YOLOV3网络为基本网络。相对于传统的道路灾情提取方法,本发明能够有效解决无法直接检测道路灾情目标本身的问题,以及灾情检测精度受制于道路提取精度、灾害提取精度等问题,实现了速度更快、自动化程度更高的道路灾情检测。

本发明的一种基于深度学习的道路灾情遥感智能检测方法,选择了改进的YOLOV3网络作为核心检测网络,结合道路灾情的上下文背景构建道路灾情特殊目标,并利用道路矢量数据构建缓冲区限制检测范围,解决了一般方法无法直接检测道路灾情目标本身的问题。具体包括以下步骤:

A、图像预处理:对遥感影像进行辐射定标、大气校正、几何校正、正射校正、图像配准;

B、建立道路缓冲区:根据道路矢量数据,依据图像分辨率建立基于道路宽度3-4倍区域作为道路缓冲区;

C、影像掩膜:根据建立的道路缓冲区,对遥感影像进行掩膜处理;

D、影像块裁切:将掩膜后的遥感影像裁切成多个影像块;

E、影像块预测:将裁剪好的影像块即有效影像块输入到训练好的YOLOV3网络中,预测其属于道路不同损毁类别的概率;

F、影像块合并:将进行预测之后的影像块进行合并,生成原始尺寸大小的影像结果图。

进一步的,所述的步骤B中,根据道路矢量数据建立道路缓冲区,将检测范围缩小至道路道路缓冲区所在区域的范围内,所述道路缓冲区是指沿着道路中心线向两边扩展得到宽度为3-4倍道路宽度的区域。

进一步的,所述的步骤C中,根据建立的道路周边缓冲区,对遥感影像进行掩膜,保留缓冲区内的遥感影像灰度值,缓冲区外的灰度值设为NULL。

进一步的,所述的步骤D中,通过直接裁切,对掩膜后的道路周边遥感影像裁切成N*N大小的影像块,N为像素数目。

进一步的,所述的步骤E中,将裁剪后的影像块输入到改进的YOLOV3网络中,预测每个影像块中是否存在道路灾情目标,同时预测其属于道路不同损毁类别的概率,所述的改进的YOLOV3网络是指将YOLOV3网络中的Darknet53网络改为shuffleNet网络,并使用GIoU作为loss函数。

进一步的,所述的步骤F中,将预测后的影像块进行影像合并,获取道路灾情信息在遥感影像中的宏观分布情况。

进一步的,所述步骤A之前还包括:

根据道路灾情目标特征以及背景信息标注制作道路灾情目标样本的数据集,并进行图像增强,将制作好的数据集输入到YOLOV3网络中进行训练。

进一步的,所述根据道路灾情目标特征以及背景信息标注制作道路灾情目标样本的数据集,包括:

收集震区震后的高分辨率遥感影像,裁剪出包含道路灾情目标的图像块,根据道路灾情目标特征以及背景信息标注制作道路灾情目标样本,使用labelmg软件以PASCALVOC格式进行标注。

进一步的,所述数据集增强包括通过旋转、翻转、增加噪声以及色彩转换的方式对标注完的数据集进行图像增强,利用有限的数据进行样本集的扩充,从而降低模型过拟合的可能性。

进一步的,所述网络训练包括将制作好的数据集输入到YOLOV3网络中进行训练,随着迭代次数的不断增加,loss会不断减小,最后训练完成。

通过上述六个步骤的技术措施,可以利用深度学习模型完成对道路灾情目标的识别。由于传统方法不能直接针对道路灾情目标进行检测,往往通过阈值分割或提取道路,根据提取道路的连续性来判断道路受灾与否,提取精度收到诸多因素的影响。所以在关键步骤C和E中,在约束检测范围的同时,直接建立道路灾情目标样本进行目标检测,该创新点成功解决了一般方法无法直接检测道路灾情目标的问题。

本发明针对0.5m-2m分辨率的遥感影像上的道路灾情目标进行检测识别,采用了道路矢量数据作为道路检测范围的约束,通过结合GIS技术与深度学习技术,针对震后道路灾情进行目标检测。利用掩膜技术将检测范围缩小至道路双侧20-30M范围内,既保留YOLO模型进行目标检测所需的上下文信息,又有效地缩小了道路灾情目标检测范围,剔除了背景过多导致对检测的干扰。根据高分辨率遥感影像构建道路灾情样本集,利用YOLOv3模型检测道路灾情,实现了自动化程度更高、速度更快的道路灾情提取。具有实际意义和应用价值。

本发明通过道路缓冲区掩膜缩小了目标检测的范围,成功减少了背景带来的检测误差,其次通过建立道路目标灾情样本成功解决了道路灾情无法直接检测的问题,提高了定位道路灾情的效率。

与现有技术相比,本发明在进行道路灾情目标检测的过程中,结合了道路矢量建立缓冲区对遥感影像进行掩膜,避免了由于背景带来的检测干扰,直接定位道路灾情目标,提高了获取道路灾情分布的效率,结果具有实际意义。本发明,结果具有更高的准确性和更高的泛化性能。

本发明与现有技术相比,具有以下有些优点和效果:

(1)本发明首次构建震后道路灾情特殊目标,根据道路灾情的上下文语义信息构建道路灾情样本,有效提高了震后道路受灾信息提取模型的检测效率;

(2)本发明采用道路矢量数据构建图像中相关道路的道路缓冲区,通过图像掩膜技术将道路及其周边区域提取,解决了检测过程中由于影像范围过大导致的错检问题;

(3)本发明利用改进的YOLOV3网络对道路灾情进行检测,解决了一般道路灾情检测方法无法直接对道路灾情进行定位检测的问题,使得检测结果具有更高的准确性和更强的鲁棒性,实现了自动化程度更高的道路灾情提取。

附图说明

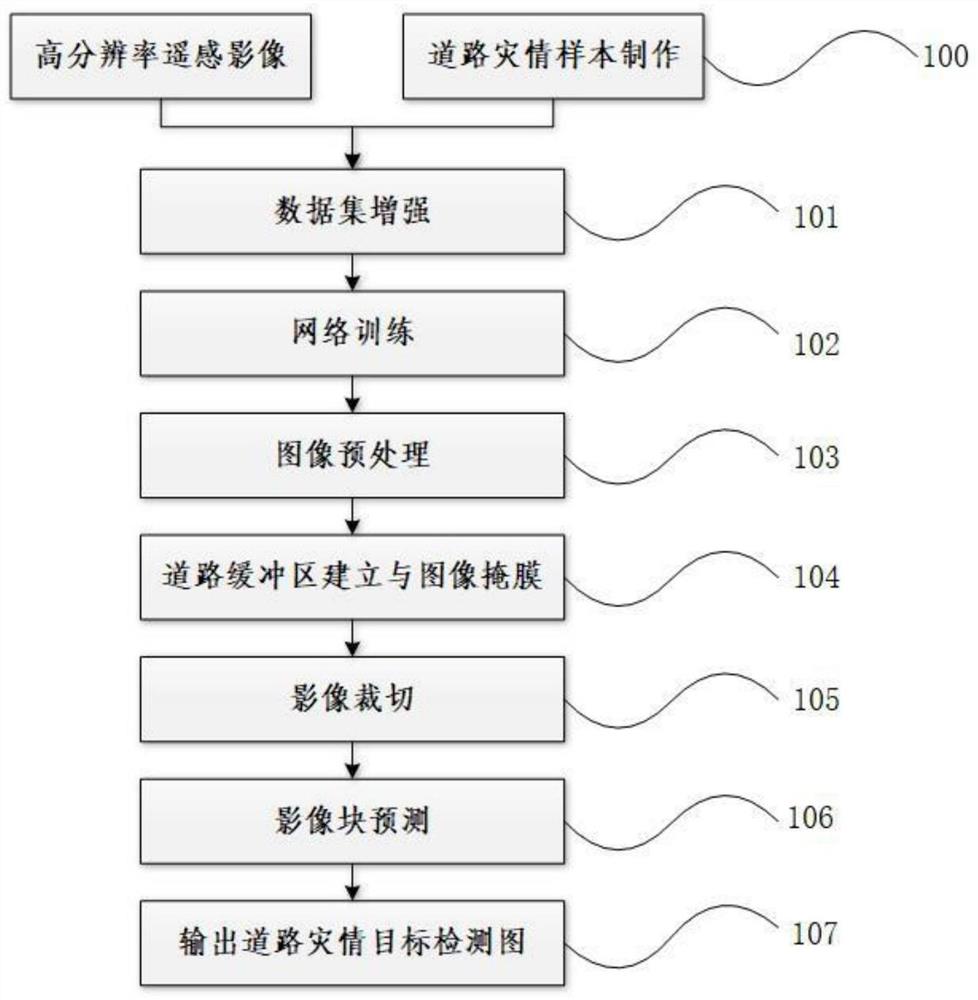

图1为本发明基于深度学习的道路灾情遥感智能检测方法的流程图;

图2为本发明改进的YOLOV3网络框架图;

图3为建立道路缓冲区示意图;

图4为道路矢量叠加示意图;

图5为训练过程中的损失值和精度变化曲线;

图6为本发明实施例中YOLOv3在13×13、26×26、52×52的单元格中预测边界框示意图;

图7为本发明实施例中的道路灾情目标检测结果图;

图8为本发明实施例耗费时长记录图。

具体实施方式

下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整的描述,显然,所描述的实施例仅为本发明的一部分实施例,而不是全部的实施例,基于本发明中的实施例,本领域的普通技术人员在不付出创造性劳动的前提下所获得的所有其他实施例,都属于本发明的保护范围。

实施例1:

如图1所示,为解决传统方法自动程度不高,人为干涉多等问题,本发明提出了一种基于深度学习的道路灾情智能检测方法,以速度较快、小目标检测精度高的深度学习YOLOV3模型作为核心网络进行道路灾情目标检测。针对道路灾情检测精度过度依赖于道路提取、灾害提取精度的问题,本发明利用上下文语义知识,结合震后道路灾情的背景特点,构建道路灾情目标样本,直接定位道路灾情目标本身,解决了以往道路灾情提取精度依赖性高的问题,实现了自动化程度更高的道路灾情检测,提高了检测的效率,本次实施例中的检测共耗时26秒。针对检测范围过大导致的检测精度下降,本发明提出了以道路矢量缓冲区掩膜方法有效限制目标检测范围,解决了大范围检测带来的错检问题。

本发明的基于深度学习的道路灾情遥感智能检测方法流程如图1所示,本发明提出的基于深度学习的道路灾情遥感智能检测方法,选择YOLOV3模型作为目标检测模型,如图2所示,通过构建道路灾情目标样本,训练YOLOV3模型,改进了传统方法先检测道路再检测灾害或先检测灾害再定位道路的两步走检测,直接定位道路灾情目标,同时通过创建道路矢量缓冲区掩膜将检测区域缩小至道路两侧,目的是可以使检测模型更准确的检测出道路灾情及其类别。

一种基于深度学习的道路灾情遥感智能检测方法,其步骤是:

100、高分辨率遥感影像与道路灾情样本:收集震区震后的高分辨率遥感影像(0.5m-2m),裁剪出包含道路灾情目标的图像块,图像块大小为416×416。根据道路灾情目标特征以及背景信息标注制作道路灾情目标样本,使用labelmg软件以PASCAL VOC格式进行标注。

101、数据集增强:通过旋转、翻转、增加噪声以及色彩转换的方式对标注完的数据集进行图像增强,利用有限的数据进行样本集的扩充,从而降低模型过拟合的可能性。具体操作是将图像分别旋转90°、180°和270°,水平和上下翻转、向上旋转和向下旋转、颜色转换和图片拉伸。

102、网络训练:将制作好的数据集输入到YOLOV3网络中进行训练,随着迭代次数的不断增加,loss会不断减小,如图所示,曲线抖动范围逐渐减小,损失值总体呈下降趋势,当loss值不再有明显下降时,训练结束。

103、图像预处理:对遥感影像进行几何校正、正射校正、图像配准。几何校正是通过一系列的数学模型来改正和消除遥感影像成像时因摄影材料变形、物镜畸变、大气折光、地球曲率、地球自转、地形起伏等因素导致的原始图像上各地物的几何位置、形状、尺寸、方位等特征与在参照系统中的表达要求不一致时产生的变形;正射校正是通过在像片上选取一些地面控制点,并利用原来已经获取的该像片范围内的数字高程模型(DEM)数据,对影像同时进行倾斜改正和投影差改正,将影像重采样成正射影像。

104、道路缓冲区建立与图像掩膜:根据研究区域内的道路矢量数据生成缓冲区,缓冲距离是指以输入矢量要素为中心向外或向内扩展的空间距离,本发明中缓冲距离设置为3-4倍道路宽度,以确保足够将道路周边的特征信息包含在缓冲区内。如图3所示,为建议道路缓冲区示意图;利用建成的缓冲区进行图像掩膜处理,获取道路周边遥感影像数据,此步骤利用GDAL库中的warp()函数完成。图4为实施例中缓冲区与遥感影像的叠加图;

105、影像块裁切:对掩膜后的遥感影像进行裁切处理,由于YOLOV3网络的输入是416×416×3,因此需要将待检测遥感影像裁切成若干个416×416大小的影像块;设置15%的重复率保证所有的区域都能被处理。

106、影像块预测:将每个有效影像块输入到训练好的YOLOV3网络中,两类道路灾情在训练完成后的精度分别为65.18%和68.18%,如图5所示。预测其属于每个道路灾情类别的概率并获取相应的包围盒BoundingBox,此步骤在YOLOV3的detection检测模块中处理完成。在检测过程中经过Darknet53提取特征,原始图像变为13×13的特征图,再结合中间层大小为26×26、52×52的两个特征图,在这三个尺度上进行检测,且相邻两个尺度的特征图之间使用2倍的上采样进行传递,不同尺度的预测边界框如图6所示。

107、输出道路灾情目标检测图:将多个图像块的结果组合起来进行图像合并,输出完整的道路目标检测结果图,如图7所示,框中标记了局部检测放大图。检测的类别包括:轻微受灾、严重受灾。实施例检测共耗时26秒,如图8所示。

本发明的实施例在PC平台上实现,经实验验证,能够得到较理想的结果。

本发明提出的道路灾情目标检测方法解决了一般道路灾情提取无法直接提取灾情本身的问题,同时解决了大范围影像检测道路灾情小目标困难的问题。本发明利用2017年8月10日的四川省九寨沟航拍数据开展道路灾情目标检测实验,定量评价结果显示,测试的总体精度81.2%,验证了该方法的有效性。

通过对2017年8月10日的四川省九寨沟获取的0.5m航空遥感影像数据开展道路灾情目标检测实验,可以得到的结论是该方法可以有效提取道路受灾部分并进行受损程度的判断,严重损毁检测精度为82.2%,轻微损毁检测精度为75.4%,满足灾后救援的精度要求。

以上所述,仅为本发明的具体实施方式,但本发明的保护范围并不局限于此,任何熟悉该技术的人在本发明所揭露的技术范围内,可理解得到的变换或者替换,都应该涵盖在本发明的包含范围之内。

- 一种基于深度学习的道路灾情遥感智能检测方法

- 一种基于深度学习的大坝遥感智能检测方法