一种图像复原与图像增强相融合的图像去雾方法及其卷积网络

文献发布时间:2023-06-19 09:32:16

技术领域

本发明涉及图像增强技术及计算机视觉技术领域,具体涉及一种图像复原与图像增强相融合的图像去雾方法及其卷积网络。

背景技术

悬浮在空气中的固体小颗粒和液体小液滴会导致雾霾效应。物体的反射光会由于雾霾天气产生衰减和散射,从而降低了环境的可见度和对比度。在雾霾天气下使用传感器采集图像时,会获得含有雾霾的图像,称为有雾图像。去雾算法是一种图像增强算法,其目标为在不影响图像信息的情况下,提高图像的质量、清晰度、对比度等等,或者作为其他高级视觉任务的预处理步骤。去雾算法的输入为单一的有雾图像,其目标输出为干净清晰的去雾图像。目前主要方法可以分为基于传统的方法和基于深度学习的方法。

基于传统的方法在早期去雾工作中被大量使用,但随着深度学习在其他计算机图像领域的发展,在去雾算法中基于深度学习的方法得到了广泛使用。在基于深度学习的方法中分为基于物理模型的复原方法和端到端的增强方法。基于物理模型的复原方法需要输入的有雾图像符合当前方法的物理模型,否则会导致结果不佳。基于端到端的增强方法缺乏信息指导,而可能在复杂场景中表现不佳。

AtJ网络(Guo T,Li X,Cherukuri V,et al.Dense Scene InformationEstimation Network for Dehazing[C]//Proceedings of the IEEE Conference onComputer Vision and Pattern Recognition Workshops.2019:0-0.)使用了一个包含一个编码器和三个解码器的网络,其中使用了大气散射模型进行去雾。

发明内容

针对上述问题,本发明通过提供一种图像复原与图像增强相融合的图像去雾卷积网络,充分利用大气散射模型并结合复原和增强方法的优点,以达到最优去雾结果。

本发明为解决其技术问题所采用的技术方案是:

一种图像复原与图像增强相融合的图像去雾方法,该方法利用三个不同的卷积神经网络进行融合去雾,该所述方法模拟原始有雾图像到无雾图像的映射来实现去雾,其实施步骤为:

步骤一:设计三个不同的卷积神经网络,所述该三个卷积神经网络分别负责有雾图像复原、有雾图像增强、去雾图像融合三个任务,所述负责有雾图像复原任务的网络为复原网络,所述负责有雾图像增强网络为增强网络,所述负责去雾图像融合的网络为门控融合网络;

步骤二:从NYU Depth Dataset V2数据集中提取无雾图和深度图,合成有雾图;

步骤三:训练参数设置;

步骤四:训练复原网络;

步骤五:结合复原网络的去雾图,训练增强网络;

步骤六:训练门控融合网络;

所述步骤四、五、六基于深度学习框架来实现;

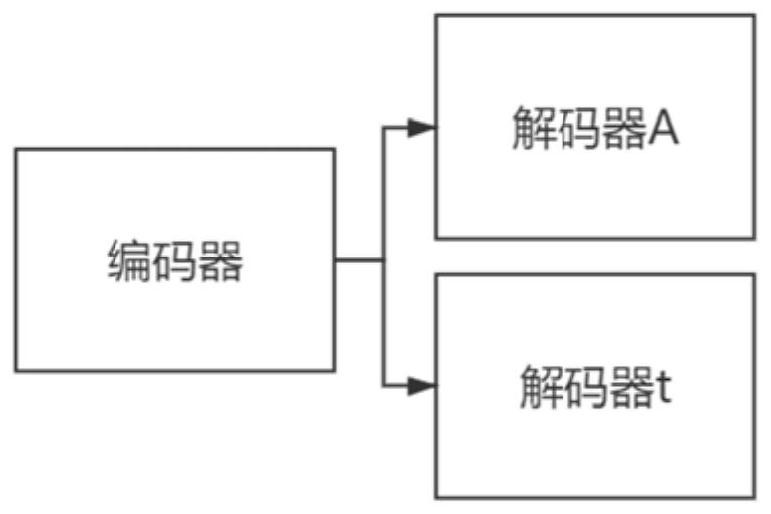

进一步的,所述的复原网络的结构使用了一个编码器和两个解码器。

所述的增强网络的结构使用了一个编码器和一个解码器。

所述的门控融合网络的结构使用了一个编码器和一个解码器。

所述深度学习框架为Pytorch;

所述步骤四的输出收敛时,步骤四停止;

所述步骤五的输出收敛时,步骤五停止;

所述步骤六的输出收敛时,步骤六停止;

复原网络输出为复原后的去雾图;增强网络输出为增强后的去雾图;门控融合网络输入图像为复原网络和增强网络的输出,输出为最终去雾图。

所述步骤二中合成有雾图的过程中,对散射系数和大气光值随机取值。

所述步骤四中输出的图像使用深度学习框架库提供的反向传播算法进行网络参数更新。

所述步骤四复原网络的输出收敛时,步骤四停止;所述步骤五增强网络的输出收敛时,步骤五停止;所述步骤六门控融合网络的输出收敛时,步骤六停止。

本方法使用了大气散射模型作为物理模型,大气散射模型用公式表达为如下:

I=J×t+A×(1-t)

其中I为有雾图;J为无雾图,和有雾图I尺寸一致;A为大气光图,和有雾图I尺寸一致;t为透射图,表示有雾图受雾霾影响的程度,与深度d和散射系数β有关,和有雾图I尺寸一致,透射图t用公式表达为:

t=e

其中e为数学常数,β为散射系数,表示单位空间内雾霾浓度;d为深度图,它和有雾图I尺寸一致,通道数为1,表示有雾图或者无雾图中每个像素对应位置的深度值。

本发明图像去雾方法,具体步骤为:

步骤1:设计图像复原与图像增强相融合的图像去雾卷积网络,并设计相应的损失函数和训练策略;

其中,复原网络输入为有雾图I,输出为透射图

去雾图J

增强网络输入为有雾图I,输出为去雾图J

门控融合网络输入为去雾图J

J

⊙表示逐像素点乘。

在复原网络的训练过程中使用的损失函数L

A

其中n表示像素数量;

在增强网络的训练过程中使用的损失函数L

⊙为逐像素点乘,M

M

M

其中e表示数学常数,W

在门控融合网络的训练中,使用以下损失函数:

L

J

步骤二:从NYU Depth Dataset V2数据集中提取无雾图和深度图,合成有雾图;

在生成数据时,本方法从NYU Depth Dataset V2数据集中提取了无雾图J

t

I=J

其中散射系数β

步骤三:训练参数设置;网络结构在深度学习框架Pytorch上实现和训练,训练的优化器为Adam,初始学习率为4×10

步骤四:训练复原网络,复原网络的输入为有雾图I,输出为透射图

步骤五:训练增强网络,增强网络的输入为有雾图I,输出为去雾图J

步骤六:训练门控融合网络,门控融合网络的输入为去雾图J

所述的步骤三、四、五中输出的图像使用深度学习框架Pytorch提供的反向传播算法进行网络参数更新。

其中,在计算机视觉里训练数据为图像时称为训练图像,是用来让网络学习的数据,训练数据包括一张原始有雾图像(输入到网络中的图像),与一张目标图像(对应的无雾图像)。输入图像通过网络时会产生一个输出图像(输出的去雾图像),通过计算输出和目标图像的差距(损失函数规定了差距的计算方式),来更新网络模型参数,使网络学习该映射过程,这就是训练过程。

另外,本发明提供一种图像复原与图像增强相融合的图像去雾卷积网络,包括负责有雾图像复原任务的复原网络,负责有雾图像增强的增强网络和负责去雾图像融合的门控融合网络。

本发明利用卷积神经网络进行去雾,所述该方法模拟有雾图像到无雾图像的映射来实现去雾,其实施步骤为设计三个基于编码器和解码器的卷积神经网络、训练数据合成、图像预处理、训练参数设置和训练模型;通过调研和观察发现,基于物理模型和端到端的去雾方法都存在一些问题,但融合它们的输出结果能够解决这些问题。本发明通过在增强网络的损失计算中结合复原网络的去雾图,提高了增强网络学习非物理模型去雾的能力;门控融合网络对复原网络和增强网络的两个去雾图计算各自的自适应权重图,权重图能够起到融合两者中好的部分,提高去雾表现的作用。该方法主要解决了当前基于物理模型和端到端的卷积神经去雾网络分别存在的设计缺陷,优化了去雾图,扩大了去雾算法的适用范围,增强了去雾算法的鲁棒性。

本发明的优点在于:综合基于嵌入物理模型的深度学习复原去雾方法和基于端到端的深度学习增强去雾方法,将这两者方法的输出结果输入到门控融合网络中,得到最终去雾图。复原网络结合大气散射模型,有效降低了去雾任务的复杂度。增强网络通过结合复原网络的去雾图,提高了对非物理模型图像去雾的能力。门控融合网络灵活融合了两种不同去雾策略的去雾图,并通过学习获得组合它们的最佳比例,从而合并两者的优点,规避两者的缺点。

附图说明

图1是复原网络的网络结构。

图2是增强网络和门控融合网络的网络结构。

具体实施方式

为了使本发明实现的技术手段、创作特征、达成目的与功效易于明白了解,下面结合图示与具体实施过程,进一步阐述本发明。

这是一种图像复原与图像增强相融合的图像去雾卷积网络,该方法利用三个不同的卷积神经网络实现去雾,所述该方法模拟原始有雾图像到无雾图像的映射来实现去雾。

在本方法使用了大气散射模型作为物理模型,大气散射模型用公式表达为如下:

I=J×t+A×(1-t)

其中I为有雾图;J为无雾图,和有雾图I尺寸一致;A为大气光图,和有雾图I尺寸一致;t为透射图,表示有雾图受雾霾影响的程度,与深度d和散射系数β有关,和有雾图I尺寸一致,透射图t用公式表达为:

t=e

其中e为数学常数,β为散射系数,表示单位空间内雾霾浓度;d为深度图,它和有雾图I尺寸一致,通道数为1,表示有雾图或者无雾图中每个像素对应位置的深度值。

步骤1:设计图像复原与图像增强相融合的图像去雾卷积网络,并设计相应的损失函数和训练策略;

本方法中的复原网络输入为有雾图I,输出为透射图

去雾图J

本方法中的增强网络输入为有雾图J,输出为去雾图J

本方法中的门控融合网络输入为去雾图J

J

⊙表示逐像素点乘。门控融合网络结构来自AtJ网络,如图2所示,与增强网络有相同网络结构。

在复原网络的训练过程中使用的损失函数L

A

其中n表示像素数量。

在增强网络的训练过程中使用的损失函数L

⊙表示逐像素点乘,M

M

M

其中e表示数学常数,W

在门控融合网络的训练中,本方法使用了以下损失函数:

L

J

步骤二:从NYU Depth Dataset V2数据集中提取深度信息和彩色图像,合成有雾图;

在生成数据时,本方法从NYU Depth Dataset V2数据集中提取了无雾图J

I=J

其中散射系数β

步骤三:训练参数设置。网络结构在深度学习框架Pytorch上实现和训练,训练的优化器为Adam,初始学习率为4×10

步骤四:训练复原网络,复原网络的输入为有雾图I,输出为透射图

步骤五:训练增强网络,增强网络的输入为有雾图I,输出为去雾图J

步骤六:训练门控融合网络,门控融合网络的输入为去雾图J

所述的步骤三、四、五中输出的图像使用深度学习框架Pytorch提供的反向传播算法进行网络参数更新。

以上显示物限定。

- 一种图像复原与图像增强相融合的图像去雾方法及其卷积网络

- 基于雾天图像复原和图像融合的图像去雾方法