基于视觉导航技术的无人机高精度饶塔智能巡检方法

文献发布时间:2023-06-19 09:33:52

技术领域

本发明属于电网设备状态检测技术领域,具体涉及一种基于视觉导航技术的无人机高精度饶塔智能巡检方法。

背景技术

近年来,无人机巡检已成为输电线路的重要巡检手段,巡检效益和质量较传统人工巡检有显著提高。以无人机为代表的智能巡检方式自主性好、质量高,大幅提升了巡检的安全性和可靠性。以无人机和巡检机器人代替传统的人工巡检方式已成为发展趋势。

巡线无人机自主水平低、故障识别精度低、续航里程短等问题严重制约了无人机的推广应用。无人机巡线技术已经广泛应用输电线路巡线作业,但是实际运行过程中由人工查看巡线视频和图像,存在人力工作量大、监测效率低、警情掌控不及时,从而无法保障无人机巡检结果的及时性、有效性、全面性。

无人机输电线路巡检主要为人工手动操控无人机进行作业,飞手在地面上手动操控无人机,近距离拍摄采集杆塔各部位的照片影像,采集过程混乱,容易造成漏拍、错拍的现象,巡检效率和质量完全依赖于飞手的技术和责任心。无人机智能化程度低、对飞手专业水平要求高、续航里程短等问题严重制约了无人机的推广应用。

发明内容

针对无人机智能化程度低、无法精确地、高质量地实现图像采集的问题,本发明提出了一种基于视觉导航技术的无人机高精度饶塔智能巡检方法,有效解决了无人机巡检图像高质量高精度采集的问题。

为解决以上技术问题,本发明所采用的技术方案如下:

一种基于视觉导航技术的无人机高精度饶塔智能巡检方法,包括如下步骤:

S1,建立直线杆塔及非直线杆塔类型数据库,收集所有重要部件的标准图像及缺陷图像,对标准图像和缺陷图像中的重要部件进行目标框标示形成重要部件图像数据集;

S2,对步骤S1所建立的重要部件图像数据集中的图像进行处理,将重要部件图像数据集随机划分为样本数据集和测试数据集;

S3,基于yolo v4目标检测算法建立卷积神经网络模型,利用步骤S2中的样本数据集对卷积神经网络模型进行训练分别建立巡检图像前端部件识别模型和巡检图像缺陷识别模型;

S4,通过点云及无人机控制装置生成无人机的自动飞行航线;

S5,无人机按照步骤S4所生成的自动飞行航线飞行,在每一个杆塔处根据步骤S1中的直线杆塔及非直线杆塔类型数据库对杆塔类型进行识别,再利用步骤S3所建立的巡检图像前端部件识别模型对所有杆塔上的各重要部件进行图像拍摄直至航线飞行结束;

S6,利用步骤S3所建立的巡检图像缺陷识别模型对步骤S5中所拍摄的图像进行缺陷识别输出缺陷识别图像。

在步骤S1中,所述直线杆塔及非直线杆塔类型数据库包括直线杆塔及非直线杆塔的图像、直线杆塔上重要部件的拍摄航线;所述重要部件包括绝缘子串、防振锤、间隔棒、均压环。

所述步骤S3包括如下步骤:

S3.1,通过参数配置文件设置参数,所述参数包括初始学习率、学习步长、图像学习次数和判别精度阈值;

S3.2,选取yolo v4单阶段目标检测算法,利用参数配置文件初始化卷积神经网络模型;

S3.3,利用步骤S2中的样本数据集对卷积神经网络模型进行迭代训练分别建立巡检图像前端部件识别模型和巡检图像缺陷识别模型;

S3.4,利用测试数据集分别对巡检图像前端部件识别模型和巡检图像缺陷识别模型进行模型精度测试,利用巡检图像前端部件识别模型和巡检图像缺陷识别模型的判别结果目标框与测试数据集中的目标框进行重叠度计算,最终获得模型平均准确率;

S3.5,将步骤S3.4所计算出的模型平均准确率分别与步骤S3.1所设定的判别精度阈值进行比较,若模型平均准确率均大于判别精度阈值,则执行步骤S4,否则,返回步骤S3.3。

所述模型平均准确率的计算公式为:

式中,AP表示模型平均准确率,P表示准确率,r表示召回率。

所述步骤S4包括如下步骤:

S4.1,无人机控制装置对无人机进行控制,无人机对所有杆塔进行杆塔图像拍照并对应记录杆塔的位置数据,通过多角度拍摄照片生成LAS点云;

所述位置数据包括经度、纬度和海拔高度。

S4.2,根据步骤S4.1所生成的LAS点云判断所述杆塔是否为直线塔,若为直线塔,调用步骤S1中的直线杆塔及非直线杆塔类型数据库生成直线塔飞行航线,若不为直线塔,利用无人机控制装置手动打点,同时记录手动打点位置的位置数据生成非直线塔飞行航线;

S4.3,根据步骤S4.1中的杆塔的位置数据和步骤S4.2中的直线塔飞行航线和非直线塔飞行航线生成自动飞行航线。

所述巡检图像缺陷识别模型识别缺陷的方法为:

S6.1,巡检图像缺陷识别模型对输入的图像进行检测,根据图像获取每个图像所对应的至少3个尺度的特征图;

S6.2,巡检图像缺陷识别模型对每个特征图进行目标窗口预测,利用非极大值抑制算法去除目标窗口中的冗余窗口;

S6.3,利用巡检图像缺陷识别模型对步骤S6.2所得到的去除冗余窗口后的目标窗口进行识别,输出对应的缺陷识别图像。

本发明的有益效果:本发明显著提升了巡检过程的智能化水平及巡检效率,是实现一键式巡检的基础;规范了无人机巡检工作规范,减少了人工操作无人机拍摄图片的随意性及工作量,实现了无人机的智能巡检;提高了无人机巡检的安全性与效率、大大节省了人力、物力和财力。与传统手动操作无人机巡检方式相比,极大提高了绕塔巡检作业自主性、自动化和智能化水平,使无人机绕塔巡检作业安全性更高、效率更高、易推广性更强,减轻运检人员劳动强度,大幅度降低运维成本。可精准实现对关键目标的捕捉和高精度抓拍,避免因环境因素飞机扰动和对焦等问题造成的漏拍或错拍,保证图像质量,显著提高国网巡检自动化作业水平,为电网管理获得更高的经济效益、安全效益和社会效益具有重要的意义。

附图说明

为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

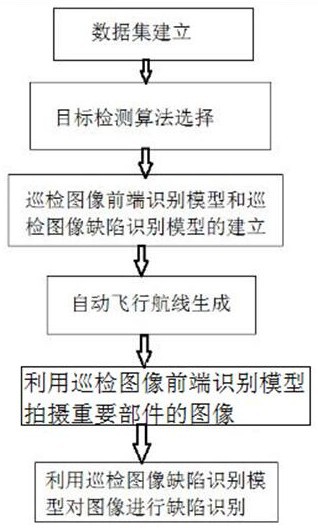

图1为本发明的流程示意图。

图2为P-R曲线图。

具体实施方式

下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有付出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

为了便于更好地理解本专利,现对yolo v4s进行简要介绍:

Yolo v4在主干网络部分提出一种CSPDarkNet53特征提取网络和特征加强网络SPP,CSPDarkNet53特征提取网络用来解决以往网络结构需要大量推理计算的问题。特征融合部分使用PANet代替YOLOv3中的FPN作为参数聚合的方法,针对不同的检测器级别从不同的主干层进行参数聚合,并且对原PANet方法进行了修改,使用张量连接(concat)代替了原来的捷径连接(shortcut connection);SPP结构参杂在对CSPdarknet53的最后一个特征层进行三次激活卷积后,分别利用四个不同尺度的最大池化进行处理,其可以它能够极大地增加感受野,分离出最显著的上下文特征。最大池化的池化核大小分别为13x13、9x9、5x5、1x1。

Yolo v4能够应用于实际工作环境中的快速目标检测系统,且能够被并行优化,并没有很刻意的去追求理论上的低计算量(BFLOP)。同时,yolo v4算法能够很轻易的被训练,且能够得到一个较好的结果。

一种基于视觉导航技术的无人机高精度饶塔智能巡检方法,如图1所示,包括如下步骤:

S1,建立直线杆塔及非直线杆塔类型数据库,收集重要部件的标准图像及所有缺陷图像,对标准图像和缺陷图像中的所有重要部件进行目标框标示形成重要部件图像数据集。

所述直线杆塔及非直线杆塔类型数据库包括直线杆塔及非直线杆塔的图像、直线杆塔上重要部件的拍摄航线;所述重要部件包括绝缘子串、防振锤、间隔棒、均压环,目标框标示是指标识出重要部件的轮廓,便于后期训练模型时很快地识别重要部件。当无人机飞行至某一杆塔时,首先对杆塔进行拍照,利用所拍摄的杆塔图像与线杆塔及非直线杆塔类型数据库进行比对准确地识别出杆塔类型后,然后再根据杆塔类型对杆塔上重要部件分别进行拍照。

S2,对步骤S1所建立的重要部件图像数据集中的图像进行处理,将重要部件图像数据集随机划分为样本数据集和测试数据集。

所述重要部件图像数据集中的图像进行处理是指对图像进行归一化处理,得到大小为M*M的图像样本。

S3,基于yolo v4目标检测算法建立卷积神经网络模型,利用步骤S2中的样本数据集对卷积神经网络模型进行训练分别建立巡检图像前端部件识别模型和巡检图像缺陷识别模型,包括以下步骤:

S3.1,通过参数配置文件设置参数,所述参数包括初始学习率、学习步长、图像学习次数和判别精度阈值;

S3.2,选取yolo v4单阶段目标检测算法,利用参数配置文件初始化卷积神经网络模型;

S3.3,利用步骤S2中的样本数据集对卷积神经网络模型进行迭代训练分别建立巡检图像前端部件识别模型和巡检图像缺陷识别模型;

S3.4,利用测试数据集分别对巡检图像前端部件识别模型和巡检图像缺陷识别模型进行模型精度测试,利用两个模型的判别结果目标框与测试数据集中的真实目标框分别进行重叠度计算,最终获得两个模型所对应的模型平均准确率;

所述模型平均准确率的计算公式为:

式中,AP表示模型平均准确率,P表示准确率,它可以衡量两个模型输出的误报情况,r表示召回率,它可以衡量两个模型的实用水平;

所述准确率P的计算公式为:

P=TP/(TP+FP);

式中,TP表示缺陷目标被正确分类的数量,FP表示背景干扰被错误认为是缺陷目标的数量;

所述召回率的计算公式为:

P=TP/(TP+FN);

式中,FN表示缺陷目标被错误的分为背景的数量。

所述模型平均准确率AP可以衡量两个模型的综合性能,是通过计算召回率r和准确率P所组成的P-R曲线下的面积得到。

S3.5,将步骤S3.4所计算出的模型平均准确率分别与步骤S3.1所设定的判别精度阈值进行比较,若模型平均准确率均大于判别精度阈值,则执行步骤S4,否则,返回步骤S3.3。

S4,通过点云及无人机控制装置生成无人机的自动飞行航线,包括如下步骤:

S4.1,无人机控制装置对无人机进行控制,利用无人机上的摄像装置对所有杆塔进行拍照并对应记录杆塔的位置数据,并通过多角度拍摄照片生成LAS点云;

所述位置数据包括经度、纬度和海拔高度。

S4.2,根据步骤S4.1所生成的LAS点云判断所述杆塔是否为直线塔,若为直线塔,调用步骤S1中的直线杆塔及非直线杆塔类型数据库生成直线塔飞行航线,若不为直线塔,利用无人机控制装置手动打点,同时记录手动打点位置的位置数据生成非直线塔飞行航线;

所述手动打点是指飞手利用遥控器手动操控无人机飞行,并自行设置巡检拍摄视点,即航点,也即无人机的悬停位置,方便拍摄重要部件的图像。

S4.3,根据步骤S4.1中的杆塔的位置数据、直线塔飞行航线和非直线塔飞行航线生成自动飞行航线。

S5,无人机按照步骤S4所生成的自动飞行航线飞行,在每一个杆塔处利用步骤S1中的直线杆塔及非直线杆塔类型数据库对杆塔类型进行识别,再利用步骤S3所建立的巡检图像前端部件识别模型对杆塔上的重要部件进行精准图像拍摄直至航线飞行结束。

无人机识别出杆塔后,再飞行至各个航点悬停,通过巡检图像前端部件识别模型对杆塔上的重要部件进行识别,利用巡检图像前端识别部件模型实现精准拍照,无人机依照此种方法,将杆塔上的重要部件全部拍照完成后,飞至下一杆塔进行识别并拍照,直至完成所有航线飞行。

S6,利用步骤S3所建立的巡检图像缺陷识别模型对步骤S5中所拍摄的所有图像进行缺陷识别,输出缺陷识别图像。

巡检图像缺陷识别模型识别缺陷的方法为:

S6.1,巡检图像缺陷识别模型对输入的图像进行检测,根据图像获取每个图像所对应的至少3个尺度的特征图;

所述3个尺度的特征图分别为:eat1->(256*52*52),feat2->(512*26*26),feat3->(1024*13*13);

S6.2,对每个特征图进行目标窗口预测,利用非极大值抑制算法去除目标窗口中的冗余窗口;

对每个特征图进行目标窗口预测的方法为:先对特征图进行缩放,将特征图划分为S*S的网格,再对每个网格预测B个边框,这样一个特征图即对应于S*S*B个目标窗口。

S6.3,利用巡检图像缺陷识别模型对步骤S6.2所得到的去除冗余窗口后的目标窗口进行识别,输出对应的缺陷识别图像。

以上所述仅为本发明的较佳实施例而已,并不用以限制本发明,凡在本发明的精神和原则之内,所作的任何修改、等同替换、改进等,均应包含在本发明的保护范围之内。

- 基于视觉导航技术的无人机高精度饶塔智能巡检方法

- 基于RTK高精度定位与机器视觉融合的无人机自主巡检方法