一种图像分类模型的构建方法和图像分类方法

文献发布时间:2023-06-19 11:05:16

技术领域

本发明涉及图像分类技术领域,尤其是涉及一种图像分类模型的构建方法和图像分类方法。

背景技术

图像分类技术是计算机视觉领域的热门研究方向之一,它是实现人脸识别、无人驾驶和医学检测等应用的重要基础,因此,图像分类具有很高的学术研究意义和现实应用价值。典型的图像分类算法主要涉及图像特征的表示和获得好的分类参数这两个问题。

在实现本发明过程中,发明人发现现有图像分类方法主要依赖人工设计的图像描述符对图像特征进行提取,例如:尺度不变特征变换(SIFT)、方向梯度直方图(HOG)和词袋模型(BoW)等,这些方法不仅效率低下,而且局限性很大。

另外,随着大数据、云计算和计算机硬件GPU等技术的不断发展,深度学习显示出极大优势,大样本数据集让机器可以充分进行有效地学习。然而,很多情况下用于训练的数据集并不充足,比如,因病人隐私等原因不能全部公开的医学图像数据,数据量不足会导致模型过拟合,虽然,简单的数据增强和正则化技术在一定程度上可以缓解该问题,但该问题还是没有得到彻底解决。因此,针对小样本数据集的小样本学习方法便成为解决这类问题的关键技术。

此外,随着卷积神经网络模型的发展,网络层数越来越多的同时,精度也越来越高,同时也出现了参数过多、训练困难,梯度爆炸、错误率上升等退化问题。

因此,现有技术缺乏一种利用深度学习模型实现图像分类功能的技术方案,以解决上述一种或几种技术问题。

发明内容

为了解决上述技术问题,本发明实施例提供了一种图像分类模型的构建方法,包括:建立密集型神经网络,其中,所述密集型神经网络包含若干个密集块和过渡层,并且所有密集块通过所述过渡层以密集连接方式相连;使用有限图像数据集,对所述密集型神经网络进行训练,形成图像分类模型,以利用所述图像分类模型完成图像分类任务。

优选地,在建立密集型神经网络步骤中,包括:确定所述密集型神经网络的总体结构及各密集块的内部结构,其中,不同的密集块包含不同组数个的基本神经网络结构;确定当前模型训练所需的损失函数及相应的优化方法,以利用当前损失函数及优化方法对所述密集型神经网络进行训练。

优选地,所述基本神经网络结构包括:瓶颈层、具有预设尺寸卷积核的卷积层、以及dropout层。

优选地,所述预设尺寸优选为2,所述优化方法优选为自适应矩估计法,所述瓶颈层和所述卷积层的激活函数采用带泄露的修正线性单元。

优选地,所述密集型神经网络包括:4个密集块和3个过渡层,其中,4个依次连接的密集块所对应的基本神经网路结构组数分别为6、12、24和16。

优选地,在所述密集型神经网络中的最后一层密集块之后,依次连接有池化层和分类层,其中,所述分类层采用softmax函数实现。

优选地,所述方法还包括:对所述密集型神经网络进行评估。

优选地,在对所述密集型神经网络进行评估步骤中,包括:为待构建的神经网络模型设置不同的超参数,并形成相应的所述密集型神经网络;使用所述有限图像数据集对不同的所述密集型神经网络分别进行训练并测试,优选具有最佳超参数的密集型神经网络体系结构,从而确定最优密集型神经网络。

优选地,所述有限图像数据集采用Oxford flower17图像数据集。

另一方面,本发明实施例还提供了一种图像分类方法,所述图像分类方法利用如上述所述的构建方法所生成的图像分类模型来实现。

与现有技术相比,上述方案中的一个或多个实施例可以具有如下优点或有益效果:

本发明提出了一种图像分类模型的构建方法和图像分类方法。具体根据小样本图像数据集样本量少的特点,采用小核卷积可以充分有效地提取到图像中更细微的特征,并基于小核卷积分别设计出相适应的密集块数量、密集块内部结构、密集块的密集连接方式、卷积层的激活函数、以及训练所需的优化方法的类型等信息,从而不仅完成了对现有DenseNet网络模型的改进设计,还是提出了适用于当前改进模型的最佳训练方法。这样,本发明所提出的改进模型及其训练方法所形成的构建方法,在传统DenseNet的基础上进一步提高了特征的重复使用率,并且有效解决了深层DenseNet在小样本数据集上的过拟合问题,大大提高了深度学习的精度。

本发明的其它特征和优点将在随后的说明书中阐述,并且,部分地从说明书中变得显而易见,或者通过实施本发明而了解。本发明的目的和其他优点可通过在说明书、权利要求书以及附图中所特别指出的结构来实现和获得。

附图说明

附图用来提供对本发明的进一步理解,并且构成说明书的一部分,与本发明的实施例共同用于解释本发明,并不构成对本发明的限制。在附图中:

图1为现有DenseNet网络的结构示意图。

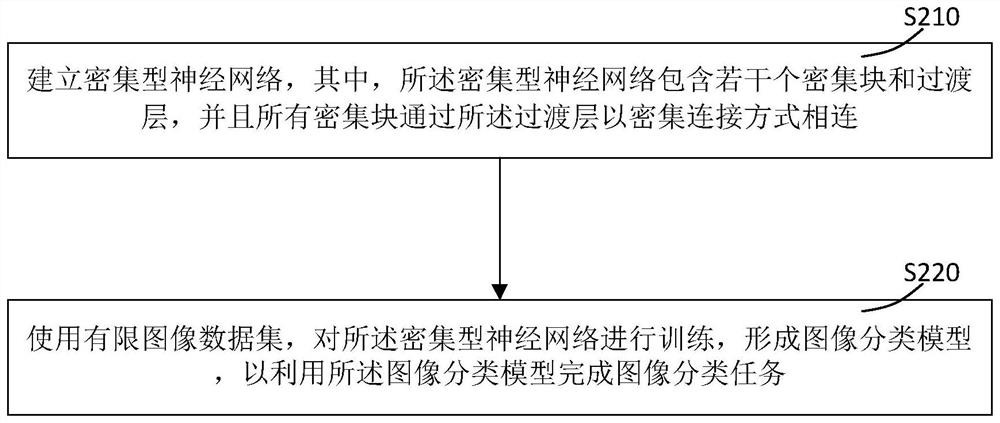

图2为本申请实施例的图像分类模型的构建方法的步骤图。

图3为本申请实施例的图像分类模型的构建方法中的密集型神经网络的结构示意图。

具体实施方式

以下将结合附图及实施例来详细说明本发明的实施方式,借此对本发明如何应用技术手段来解决技术问题,并达成技术效果的实现过程能充分理解并据以实施。需要说明的是,只要不构成冲突,本发明中的各个实施例以及各实施例中的各个特征可以相互结合,所形成的技术方案均在本发明的保护范围之内。

另外,附图的流程图示出的步骤可以在诸如一组计算机可执行指令的计算机系统中执行。并且,虽然在流程图中示出了逻辑顺序,但是在某些情况下,可以以不同于此处的顺序执行所示出或描述的步骤。

图像分类技术是计算机视觉领域的热门研究方向之一,它是实现人脸识别、无人驾驶和医学检测等应用的重要基础,因此,图像分类具有很高的学术研究意义和现实应用价值。典型的图像分类算法主要涉及图像特征的表示和获得好的分类参数这两个问题。

在实现本发明过程中,发明人发现现有图像分类方法主要依赖人工设计的图像描述符对图像特征进行提取,例如:尺度不变特征变换(SIFT)、方向梯度直方图(HOG)和词袋模型(BoW)等,这些方法不仅效率低下,而且局限性很大。

随着大数据、云计算和计算机硬件GPU等技术的不断发展,深度学习逐渐成为研究热点,例如:2012年提出的AlexNet模型,该卷积神经网络模型在图像特征提取上体现出了巨大优势,基于深度学习方法的模型开始在图像识别领域被广泛研究与应用。另外,在大数据的驱动下,深度学习显示出极大优势,大样本数据集让机器可以充分进行有效地学习。然而,很多情况下用于训练的数据集并不充足,比如,因病人隐私等原因不能全部公开的医学图像数据,数据量不足会导致模型过拟合,虽然,简单的数据增强和正则化技术在一定程度上可以缓解该问题,但该问题还是没有得到彻底解决。因此,针对小样本数据集的小样本学习方法便成为解决这类问题的关键技术。

随着卷积神经网络模型的发展,网络层数越来越多的同时,精度也越来越高,同时也出现了参数过多、训练困难,梯度爆炸、错误率上升等退化问题。2017年提出的DenseNet这种密集型连接的网络结构,它的出现让更深的网络层数训练变简单成为可能,增加准确率的同时大大减少了参数量和计算量。该网络中的密集型连接结构大大提高了特征使用的重复率,使识别精度变高,因此,该模型适合小样本图像分类的任务。

因而,为了解决上述一个或几个技术问题,本发明实施例提出了一种图像分类模型的构建方法。该方法设计了一种基于小核卷积的DenseNet网络模型,由于小核卷积可以更细致地提取图像中的细微特征,因此,将Dense Block密集连接的网络结构应用在DenseNet的基础上,更进一步提高了现有DenseNet网络在使用时特征的重复使用率,准确率进一步提高。并且本发明所构建的图像特征模型可以广泛应用于各种小样本学习任务中。

另外,本发明还利用构建好的图像分类模型,完成小样本分类任务,可以提取更高水平和更细微的特征,具有更好的性能表现,提高了分类精度。

在实际应用过程中,卷积神经网络是计算机视觉领域中效果非常好的图像分类方法。其网络的性能随着深度的增加而增加,但是,随着深度的增加,可能会出现梯度爆炸、识别错误率反而上升等一系列“退化”问题。尽管ResNet网络中的“跃层连接”有效地解决了这类问题,但是ResNet网络在每一层中会生成大量的特征图,导致参数大量增加,训练变得更加困难。

图1为现有DenseNet网络的结构示意图。然而,DenseNet网络中引入了“密集连接”机制,参考图1,在一个密集块中,每一层的输入都会接收来自所有先前层的输出,并将每一层的输出传递到密集块中的所有后续层,这种连接结构的优势在于实现特征的重用,减少梯度消失的影响,从而使更深层的网络执行更好的分类。

给定一个有L

其中,[·]操作表示第l层之前的所有网络层的输出,变量中的上、下标k和l分别表示所在密集块的编号与当前密集块中层的编号,

其中,

在小样本图像数据分类学习过程中,训练数据少是小样本的首要特点;其次,在有限的图像数据集里,可能存在图像背景复杂、有效信息分布杂乱、特征小且不明显、以及不同种类之间差别细微而同种类别之间差别反而较大等不同的情况。因此,本发明实施例针对上述问题,提出一种针对小样本图像分类的模型。

图2为本申请实施例的图像分类模型的构建方法的步骤图。如图2所示,在本发明实施例所述的构建方法中,首先,步骤S210建立密集型神经网络。其中,密集型神经网络包含:若干个密集块和过渡层,并且所有密集块通过所述过渡层以密集连接方式相连。而后,步骤S220使用有限图像数据集,对步骤S210构建好的密集型神经网络进行训练,形成适用于小样本图像分类任务的图像分类模型,从而利用本发明实施例所构建的图像分类模型完成小样本图像分类任务。

下面参考图2,对本发明实施例所述的图像分类模型的构建方法(以下简称“构建方法”)进行详细说明。

在步骤S210中,首先(步骤S2101,未图示)需要确定待构建密集型神经网络的总体结构及各密集块的内部结构。图3为本申请实施例的图像分类模型的构建方法中的密集型神经网络的结构示意图。参考图3,在本发明实施例中,待构建密集型神经网络的总体结构至少包括:输入层、若干个密集块、分别插入相邻密集块之间的若干个过渡层(其中,过渡层的数量为密集块的数量减1)。其中,不同的密集块需要包括:不同组数个的基本神经网络结构。也就是说,由于待构建的密集型神经网络是包含有若干个密集块的,因此,针对每个密集块需要由不同数量(组数)个的基本神经网络结构所构成。

进一步,在本发明实施例中,待构建的密集型神经网络具备2~4个密集块。在一个优选实施例中,待构建的密集型神经网络中的密集块设置有4个,并且,过渡层设置有3个。其中,4个依次连接的密集块所对应的基本神经网路结构组数分别为6、12、24和16。如图3所示,图3下半部分展示了一个具有6组基本神经网路结构的密集块。

进一步,在本发明实施例中,基本神经网络结构依次连接有:瓶颈层(1×1的卷积核)、具有预设尺寸卷积核的卷积层、以及dropout层。需要说明的是,由于本发明实施例需要构架出基于小卷积核的DenseNet网络模型,因此,上述预设尺寸为2或3。在一个优选实施例中,上述预设尺寸为2。这样,本发明实施例中的想要构建的密集型(小核卷积)神经网络总体结构中的不同位置处的密集块,是需要由相应组数且结构相同的基本神经网络结构所构成的。并且为了提高整个密集型神经网络模型的泛化能力,还需要在小核卷积的后端再加上一层dropout层来防止过拟合的问题。

进一步,在本发明实施例中,瓶颈层和卷积层的激活函数均采用带泄露修正线性单元(Leaky ReLU)来实现。Leaky ReLU函数形式如下述表达式(3)所示,α一般取0.01,Leaky ReLU函数是ReLU激活函数的变体,在ReLU函数遵循了仿生学原理、避免梯度爆炸和梯度消失问题、简化计算过程等优势的基础上,Leaky ReLU函数的输出对负值输入有很小的坡度,由于导数总是不为零,从而能够减少静默神经元的出现,允许基于梯度的学习,解决了ReLU函数进入负区间后,导致神经元不学习的问题。其中,表达式(3)如下所示:

由此,本发明实施例中的密集型神经网络体系结构中的密集块,在保留传统DenseNet密集块的基础上,在密集块内使用(具有预设尺寸卷积核的)小核卷积,在网络总层数不变的条件下,在密集块间添加密集连接的方式以增强信息流通。进一步,小核卷积可以提取到图像中更加细微的特征,同时,Dense Block密集连接也可以充分利用小核卷积提取到的特征进行特征的密集传递。

另外,在最后一个密集块的后端,本发明实施例所述的待构建密集型神经网络还依次连接有池化层和分类层。在本发明实施例中,上述分类层采用softmax函数来实现。Softmax回归模型是logistic回归模型在多分类问题上的推广,它将多个神经元的输出,映射到(0,1)之内,以概率的形式来处理多分类问题。softmax函数利用如下表达式表示:

其中,j=1,2,…,K,K表示样本总数量,x

在完成上述待构建密集型神经网络的体系结构及相应表达式的构建后,进入到步骤S2102(未图示)中。步骤S2102确定当前模型训练时所需的损失函数及相应的优化方法,以利用确定好的损失函数及对应的优化方法对构建完成的密集型神经网络模型进行训练学习。

进一步,在本发明实施例中,采用交叉熵来作为当前密集型神经网络模型在训练时所需的损失函数,从而利用交叉熵评估当前训练得到的概率分布与真实分布的差异情况,减少交叉熵损失函数的值就是在提高模型的预测准确率。

其中,y

在实际应用过程中,训练过程中所需的优化方法是一种最小化损失函数的处理过程。其中,常用的最小化损失函数处理过程有几种优化方法,如:随机梯度下降(SGD)、自适应梯度算法(AdaGrad)和自适应矩估计(Adam)等。在本发明实施例中,上述优化方法优选为自适应矩估计法。

因此,本发明实施例采用自适应矩估计方法与上述已构建的基于小卷积核的DenseNet网络模型(即步骤S1201所构建的密集型神经网络,也称密集型小核卷积神经网络)进行结合,从而对密集型小核卷积神经网络进行训练,继而使得完成训练后所得到的图像分类模型在小样本图像分类任务中具有更加优异的分类结果精确度。其中,上述自适应矩估计方法的迭代等式利用如下表达式表示:

其中,α表示步长或学习率,t表示时间步长,

这样,在确定好当前密集型小核卷积神经网络在训练过程中所需的损失函数及相应的优化方法后,步骤S210结束,进入到步骤S220中。步骤S220使用有限图像数据集,对已完成总体结构构建的密集型小核卷积神经网络进行训练,形成图像分类模型,从而利用该图像分类模型完成小样本图像分类任务。其中,上述有限图像数据集为小样本图像分类数据集。在本发明实施例中,有限图像数据集采用Oxford flower17图像数据集。具体地,Oxford flower17图像数据集包括:训练集777张、验证集291张以及测试集292张,并给出了17种花卉种类的类别标签。由于Oxford flower图像数据集的图像尺寸存在差异,在网络模型训练前,需要将每张图片进行尺寸归一化处理,并采取数据增强措施对数据集进行一定地扩充(小范围扩充)。

另外,在本发明实施例所述的构建方法中,还包括:对步骤S210所构建的密集型神经网络模型进行评估。

在完成密集型神经网络模型的构建后,本发明实施例还包括:利用小样本数据集对SK-DCNN网络模型(待构建的密集型小核卷积神经网络模型)进行一系列训练和分类评估,从而达到对步骤S210所构建的密集型神经网络模型进行评估的目的。首先,使用小样本数据集内的训练集训练待构建的密集型小核卷积神经网络模型,通过在小样本数据集内的验证集上的分类效果调整SK-DCNN的模型参数,对比不同层数结构的SK-DCNN的分类性能,选取表现最佳的密集型小核卷积神经网络模型;最后,将最佳的密集型小核卷积神经网络模型分别与传统DenseNet网络、经典卷积神经网络模型进行比较,并用同一测试集对各模型的分类准确率进行评估比较。需要说明的是,在整个模型评估过程中,基于Ubuntu16.4的操作系统,GPU使用一块TITAN Xp,CUDA版本为9.2,编程基于Python3.6的语言环境,结合使用了Keras 2.1.6深度学习工具包。

具体地,在确定最优密集型小核卷积神经网络模型过程中,需要经过如下步骤:第一步,为待构建的神经网络模型设置不同的超参数,并形成相应的密集型神经网络。其中,在本发明实施例中,超参数包括:卷积核尺寸(上述预设尺寸)、网络层数(密集块的数量)、损失函数的类型、学习率、池化层的函数类型和隐藏层神经元数量等元素。需要说明的是,超参数的选择直接影响训练速度和分类性能。第二步,使用有限图像数据集(例如:Oxfordflower17图像数据集)对第一步所生成的不同体系结构的密集型小核卷积神经网络分别进行训练并测试,计算各密集型小核卷积神经网络的模型精度测试结果,基于此,优选具有最佳超参数的密集型小核卷积神经网络体系结构,从而确定最优密集型小核卷积神经网络。

表1给出了在不同超参数和密集块之间连接方式不同的情况下,基于不同超参数组合条件所生成的密集型小核卷积神经网络在同一测试集上的模型精度测试结果。

表1不同超参数形成的各模型对应的精度测试结果

从表1可以看出,网络卷积核尺寸为2×2、具有4个密集块、且密集块以密集连接方式连接时分类效果最佳,该模型(步骤S210所构建的密集型神经网络模型)准确率为0.969。由此,在本发明实施例中,步骤S210所构建的密集型神经网络模型,各密集块之间采用密集连接的方式比普通连接方式性最高提高了3%;用2×2小卷积核代替3×3卷积,性能也提高了大约3%;使用Leaky ReLU激活函数,性能提高了2%;使用Adam优化器,性能可以提高7%~9%。

表2展示了本发明实施例所构建的密集型小核卷积神经网络模型,与其他类型的卷积神经网络模型的比较结果,例如:VGG19、Inception V3和DenseNet121,这些CNN神经网络模型的所有方法均由最初提出的方法实现。

表2SK-DCNN与现有CNN神经网络模型的对比

根据表2所示的对比结果,本发明实施例所构建的基于小卷积核的密集型DenseNet模型,在小样本图像分类任务中可以获得更好的性能表现,分类精度提高了大约10%。

另一方面,基于上述已构建的密集型神经网络及训练完成的图像分类模型(也就是基于上述图像分类模型构建方法),本发明实施例还提出了一种图像分类方法。该图像分类方法利用上述所述的构建方法所生成的图像分类模型来实现。具体利用上述构建方法所生成的图像分类模型来执行各类小样本图像数据集的分类任务。

本发明实施例提出了一种图像分类模型的构建方法和图像分类方法。具体根据小样本图像数据集样本量少的特点,采用小核卷积可以充分有效地提取到图像中更细微的特征,并基于小核卷积分别设计出相适应的密集块数量、密集块内部结构、密集块的密集连接方式、卷积层的激活函数、以及训练所需的优化方法的类型等信息,从而不仅完成了对现有DenseNet网络模型的改进设计,还是提出了适用于当前改进模型的最佳训练方法。这样,本发明所提出的改进模型及其训练方法所形成的构建方法,在传统DenseNet的基础上进一步提高了特征的重复使用率,并且有效解决了深层DenseNet在小样本数据集上的过拟合问题,大大提高了深度学习的精度。

以上所述,仅为本发明较佳的具体实施方式,但本发明的保护范围并不局限于此,任何熟悉该技术的人员在本发明所揭露的技术范围内,可轻易想到的变化或替换,都应涵盖在本发明的保护范围之内。因此,本发明的保护范围应该以权利要求的保护范围为准。

应该理解的是,本发明所公开的实施例不限于这里所公开的特定结构、处理步骤或材料,而应当延伸到相关领域的普通技术人员所理解的这些特征的等同替代。还应当理解的是,在此使用的术语仅用于描述特定实施例的目的,而并不意味着限制。

说明书中提到的“一个实施例”或“实施例”意指结合实施例描述的特定特征、结构或特性包括在本发明的至少一个实施例中。因此,说明书通篇各个地方出现的短语“一个实施例”或“实施例”并不一定均指同一个实施例。

虽然本发明所披露的实施方式如上,但所述的内容只是为了便于理解本发明而采用的实施方式,并非用以限定本发明。任何本发明所属技术领域内的技术人员,在不脱离本发明所揭露的精神和范围的前提下,可以在实施的形式上及细节上作任何的修改与变化,但本发明的专利保护范围,仍须以所附的权利要求书所界定的范围为准。

- 一种图像分类模型的构建方法、图像分类方法及存储介质

- 一种胃镜图像分类模型构建方法及胃镜图像分类方法