一种全光非线性衍射神经网络的图像识别方法

文献发布时间:2023-06-19 11:35:49

技术领域

本发明属于光学和深度学习领域,特别涉及一种全光非线性衍射神经网络的图像识别方法。

背景技术

近年来,深度神经网络作为机器学习的重要方法,在图像识别领域取得了突破性的进展。但是,相比于传统机器学习算法,深度神经网络计算成本较高。因此,国内外很多公司、研究机构和高校采用不同的物理机制来实现深度学习算法,如FPGA、量子计算、光子计算等。在这些研究中,加州大学洛杉矶分校林博士等人提出的全光衍射深度神经网络框架,在仿真情况下,取得了较高的图像识别准确率,其成果以论文的形式发表于Science期刊。该方法利用光学瑞利-索末菲衍射公式建立单个神经元输出函数,并构建前向传播推理模型。在前向传播路径中,通过调节光的相位和幅度以此连接各个神经层,其最大优势在于计算功耗低、速度快、且不受冯洛伊曼瓶颈限制。

然而,目前的衍射深度神经网络模型中并没有实现非线性,其表达的映射仅是线性的,难以表达实际应用中的非线性数据。相比于传统深度神经网络(电子方式)而言,其数据非线性可分能力较弱,进而在图像识别准确度上仍有较大的上升空间。鉴于现有技术中存在的缺陷,本发明采用泄漏(Leaky LReLU)修正线性单元作为衍射深度神经网络的神经元激活函数,构建非线性衍射深度神经网络模型用于图识别任务。

发明内容

本发明的目的在于克服现有技术的缺点,提供一种全光非线性衍射神经网络的图像识别方法,所提供的方法具有更强的非线性数据可分能力,分类精度高,且计算简便,增加装置的适用性。

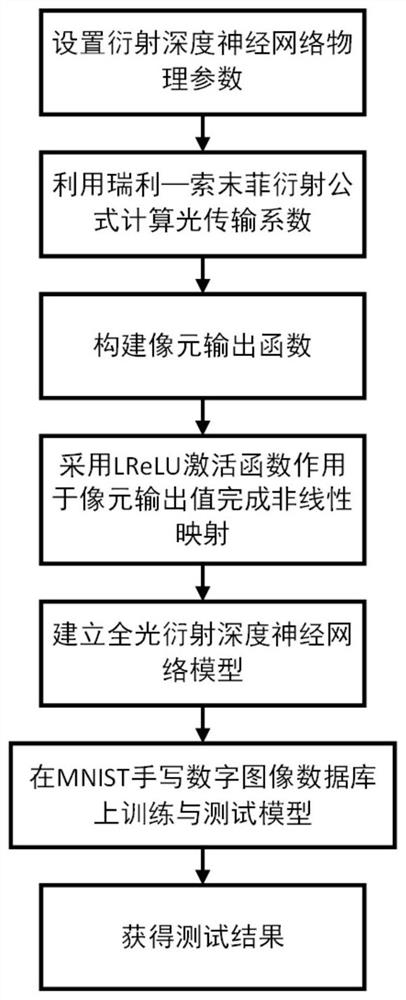

为解决上述技术问题,本发明采用的技术方案是:一种全光非线性衍射神经网络的图像识别方法,所述方法包括以下步骤:步骤a、设置全光非线性衍射深度神经网络物理参数,其中,所述参数包括所使用的光源波长、像元尺寸、每层像元个数和光栅层间距;步骤b、利用光学瑞利-索末菲衍射公式计算所述神经网络相邻层间光路的光波传输系数;步骤c、构建像元输出函数;步骤d、采用LreLU激活函数作用于所述像元输出值完成非线性映射;步骤e、建立全光非线性衍射深度神经网络模型;步骤f、在MNIST手写数字图像数据库上训练与测试模型,获得测试结果。

优选的,所述参数中,所述光源波长为10.6μm,像元尺寸为5μm,光栅层间距为300μm,每层像元个数为784。

优选的,所述光学瑞利-索末菲衍射公式为:

优选地,获得光波传输系数后,每个像元输出函数表示为:

优选的,第l层上的第i个像元输出值,通过所述激活函数

优选的,步骤e中,所述全光非线性衍射深度神经网络损失函数表示为:

优选的,采用MNIST手写数字图像集作为测试图像,所述数据图像集共70000幅大小为28×28手写数字0~9图像,其中,55000幅图像为训练集,5000幅图像为验证集,10000幅图像为测试集。

优选的,所述测试方法包括以下步骤:步骤①、对MNIST中的三个图像数据集进行处理,将二维图像数据转为一维数据;步骤②、使用55000幅训练图像训练全光非线性衍射深度神经网络模型,然后,使用5000幅验证图像集对训练模型进行验证。训练参数分别为:训练周期为500,每个周期采用的批量为100个样本;步骤③、使用10000测试图像对所述训练模型进行测试。

与现有技术相比,本发明的有益效果在于:

本发明通过将泄漏(Leaky ReLU,LReLU)修正线性激活函数加入到全光衍射深度神经网络中,并采用交叉熵作为目标函数,创造性的构建了全光非线性衍射深度神经网络模型,实质并显著地提高了识别过程的效率和准确度;本发明所提供的方法具有更强的非线性数据可分能力,分类精度高,且计算简便。

应当理解,前述大体的描述和后续详尽的描述均为示例性说明和解释,并不应当用作对本发明所要求保护内容的限制。

附图说明

参考随附的附图,本发明更多的目的、功能和优点将通过本发明实施方式的如下描述得以阐明,其中:

图1示意性示出了本发明方法流程示意图;

图2示意性示出了本发明网络相邻层间光传输示意图;

图3示意性示出了本发明全光衍射深度神经网络结构示意图;

图4示意性示出了本发明所使用的MNIST手写数字示例图像0~9示意图;

图5示意性示出了本发明在MNIST手写数字图像集上的测试准确率示意图;

图6示意性示出了本发明在MNIST手写数字图像集上每个数字的测试准确率示意图。

具体实施方式

通过参考示范性实施例,本发明的目的和功能以及用于实现这些目的和功能的方法将得以阐明。然而,本发明并不受限于以下所公开的示范性实施例;可以通过不同形式来对其加以实现。说明书的实质仅仅是帮助相关领域技术人员综合理解本发明的具体细节。

在下文中,将参考附图描述本发明的实施例。在附图中,相同的附图标记代表相同或类似的部件,或者相同或类似的步骤。

本发明的目的是为了解决现有全光衍射深度神经网络模型在图像识别中无法实现非线性的缺陷,提供一种全光非线性衍射深度神经网络的图像识别方法来解决上述问题。

为了实现上述目的,本发明采用的技术方案如下:

一种全光非线性衍射深度神经网络的图像识别方法,包括以下几个步骤:

步骤1、设置全光非线性衍射深度神经网络物理参数,具体包括所使用的光源波长、像元尺寸、每层像元个数和光栅层间距;

步骤2、利用光学瑞利-索末菲(Rayleigh-sommerfeld)衍射公式计算网络相邻层间光路的光波传输系数;

步骤3、上一层所有像元的光传输系数与下一层接收像元透射系数的乘积作为单个像元输出值,然后,通过泄漏(Leaky ReLU,LReLU)修正线性激活函数获得非线性映射;

步骤4、构建全光非线性衍射前向传播模型,即给出网络输入层、隐藏层和输出层计算公式;

步骤5、确定全光非线性衍射神经网络待优化参数,利用随机梯度下降算法进行优化;

步骤6、实例测试,首先,获取MNIST手写数字数据库中的训练与验证图像集,对全光非线性衍射深度神经网络进行训练,然后,获取MNIST手写数字数据库中的测试图像集,输入至训练后的全光非线性衍射深度神经网络中,通过待测图像的输出值与目标值最小判断得出待测手写数字图像所属识别结果类。

在上述方法中,所述步骤1,光源采用波长为10.6μm二氧化碳激光器作为光源,像元尺寸为5μm,光栅层间距为300μm。

在上述方法中,所述步骤3,上一层所有像元的光波传输系数和下一层接收像元透射系数均为复数,其乘积过程分别在实部与虚部中独立完成,进而合并成新的复数值。

在上述方法中,所述步骤3,LReLU激活函数的负激活系数为0.01,但不局限于该系数值。

在上述方法中,所述步骤4,隐藏层中每个像元的输出值均传送至LReLU激活函数。

在上述方法中,所述步骤4,输出层采用Softmax函数,用于得到图像属于各个类别的概率值。

在上述方法中,所述步骤5,待优化参数为像元的相位值(φ),采用交叉熵作为目标函数。

下面结合附图与实施例对本发明作进一步说明:

一种全光非线性衍射深度神经网络的图像识别方法,其流程图如图1所示,具体步骤描述如下:

步骤1:选择波长为10.6μm二氧化碳激光器作为系统光源,像元尺寸为5μm,光栅层间距为300μm,每层像元个数为784(28×28)。

步骤2:计算网络相邻层间光路的光波传输系数,使用的光学瑞利-索末菲衍射公式为:

其中,λ表示光的波长,

步骤3:获得光波传输系数后,每个像元输出函数表示为:

其中,

第l层上的第i个像元输出值,通过激活函数

其中

由于数值为复数形式,因此,本发明采用复数计算方法,其过程表示为:W·X=(W

其中,W

步骤4:在上述公式基础上,构建全光非线性衍射深度神经网络前向传播模型,其整体网络结构示意图,如图3所示。

输入层表示为:

其中,o表示输入层,k表示输入层像元,p表示隐层上的像元,

隐藏层表示为:

其中,i表示第l层像元,p表示l+1层像元。

输出层表示为:

其中,M表示隐层总数,本发明M=5。

步骤5:全光非线性衍射深度神经网络损失函数表示为:

其中为

然后,通过随机梯度下降算法优化相位参数值。

步骤六:实施例采用MNIST手写数字图像集作为测试图像,该数据集共70,000幅大小为28×28手写数字0~9图像,其中,55,000幅图像为训练集,5,000幅图像为验证集,10,000幅图像为测试集,样例图如图4所示。

具体步骤如下:

(1)对MNIST中的三个图像数据集进行处理,将二维图像数据转为一维数据;

(2)设置整个计算模型的相关参数,具体值见上述描述;

(3)使用55,000幅训练图像训练全光非线性衍射深度神经网络模型,然后,使用5,000幅验证图像集对训练的模型进行验证。训练参数分别为:训练周期(epoch)为500,每个周期采用的批量为100个样本;

(4)使用10,000测试图像对(3)中训练得到的模型进行测试,图5和图6分别为图像准确率和每个类别识别准确率。由图5和图6能够观察到,与现有全光衍射深度神经网络比较,本发明构建的全光非线性衍射深度神经网络性能优于前者。

本发明的有益效果:本发明通过将泄漏(Leaky ReLU,LReLU)修正线性激活函数加入到全光衍射深度神经网络中,并采用交叉熵作为目标函数,创造性的构建了全光非线性衍射深度神经网络模型,实质并显著地提高了识别过程的效率和准确度;本发明所提供的方法具有更强的非线性数据可分能力,分类精度高,且计算简便。

结合这里披露的本发明的说明和实践,本发明的其他实施例对于本领域技术人员都是易于想到和理解的。说明和实施例仅被认为是示例性的,本发明的真正范围和主旨均由权利要求所限定。

- 一种全光非线性衍射神经网络的图像识别方法

- 一种非线性光学卷积神经网络的图像识别方法