一种增强CT图像的重建方法

文献发布时间:2023-06-19 12:07:15

技术领域

本发明涉及人工智能技术领域,尤其涉及一种增强CT图像的重建方法。

背景技术

计算机断层扫描(CT)扫描已常规地集成到整个临床工作流程中,包括病变检测,病变特征,临床分期,治疗计划和指导,治疗评估以及随访等。与平扫CT相比,增强CT显示更高的病变检出率。在增强型CT中,病变的特征不仅提供其解剖学信息,而且还提供其他血流特性,这对于鉴别诊断至关重要。就癌症临床阶段而言,增强CT可以更好地描绘出原发癌病变与周围结构的联系(T期),并且可以特异性地检测和表征与血管紧密混合的转移性淋巴结(N期)。此外,为了增强目标病变和正常组织的轮廓,造影增强型CT在放射治疗计划中起着关键作用。此外,对比增强的CT特别描绘了有血供的组织,该组织可指导精确的活检,并协助临床医生确定根治性手术或放疗后是否存在残留的肿瘤组织,或者在化疗后肿瘤中是否存在活组织,或者用于消融疗法。

增强CT仅能为CT的检测和表征提供一些价值,然而,这显着增加了对患者的辐射暴露以及放射学评估的工作量。这可能是部分机构对原本需要多次或定期进行CT扫描的癌症患者进行一次增强CT扫描照射的部分原因。一言蔽之,即使我们都充分意识到各种副作用的存在,增强CT已经成为CT检查中必不可少的部分,并且在各种临床情况下比平扫CT发挥着更为重要的作用。尽管在某些临床情况下重要性不高,但平扫CT为评估对比增强CT图像上的增强程度提供了参考图像,这对于鉴别诊断至关重要。此外,平扫CT明确描述了钙化,结石和出血,所有这些都是表征病变的重要线索。在放射治疗计划中,与平扫CT相比,尽管增强CT可以更好地划定靶病变和正常组织,但对比增强CT可能会不可避免地引入高Z元素(碘)以显著增加局部CT值,从而高估了组织电子密度,并且会导致剂量错误。因此,增强CT和平扫CT彼此互补。

现有技术将平扫CT从相应的增强CT中重建,使其图像质量与原始获得的平扫CT相当,可以减少患者近一半放射量,但是现有的平扫CT重建方法仍然存在生成的虚拟平扫CT中产生变形和结构损失的问题。

近年来,生成模型是学习未对齐标签图像的首选方案,而GAN成为医学图像处理算法的主流。在先前关于CT重建的工作中,Song等人。(Song et al.,2020)提出了使用CycleGAN架构的对比增强CT(CTce)的CT重建。他们的实验结果表明,使用CycleGAN网络重建了非对比CT。然而,上述实验主要应用于肝脏分割,并且忽略了在生成的CT中结构重建的验证。在实验评估中,CycleGAN网络重建了带有模糊伪像和明显噪声的无对比度衰减。尽管CycleGAN在其他图像处理任务上显示出具有模式转换的优势,尽管GAN是研究模式转换的合适网络,但它降低了结构重建的质量。

发明内容

本发明提出一种增强CT图像的重建方法,以解决现有的重建方法存在结构重建的质量差的问题。

本发明解决上述问题的技术方案是:一种增强CT图像的重建方法,包括:

获取至少一张增强CT图像以及与增强CT图像相配对的平扫CT图像;

构建基于结合邻近内容迁移的U型残差网络;

设计损失监督函数;

将至少一张所述增强CT图像作为基于结合邻近内容迁移的U型残差网络的输入,与其相配对的平扫CT图像作为标签,并利用损失监督函数训练基于结合邻近内容迁移的U型残差网络直至收敛;

将增强CT图像输入至训练好的基于结合邻近内容迁移的U型残差网络,得到重建后的虚拟平扫CT图像。

优选的是,所述基于结合邻近内容迁移的U型残差网络包括编码器网络和解码器网络;其中:

所述解码器网络包括一个卷积层和四个下采样顺序层,每个下采样顺序层均是将多个残差减法模块序列化后进行下采样;且每个下采样顺序层中的第一个残差减法模块均用于将输入压缩为深通道的输出;

所述解码器网络包含与编码器网络对称的四个上采样顺序层和一个反卷积层;

所述编码器网络的特征图与解码器网络的同一维的特征图之间通过跳跃连接进行拼接。

优选的是,所述残差减法模块均包括依次相连的1x1的卷积、3x3卷积和1x1卷积,每个所述残差减法模块的输入端和输出端近连接;所述残差减法模块的公式为:

y=W_s x-F(x,W_i)

其中:y是残差减法模块的输出映射,W_s,即short connection连接参数,是残差减法模块的short connection连接层中通道匹配的恒等映射参数,残差连接参数W_i是残差减法模块的残差连接层中生成衰减因子特征参数。

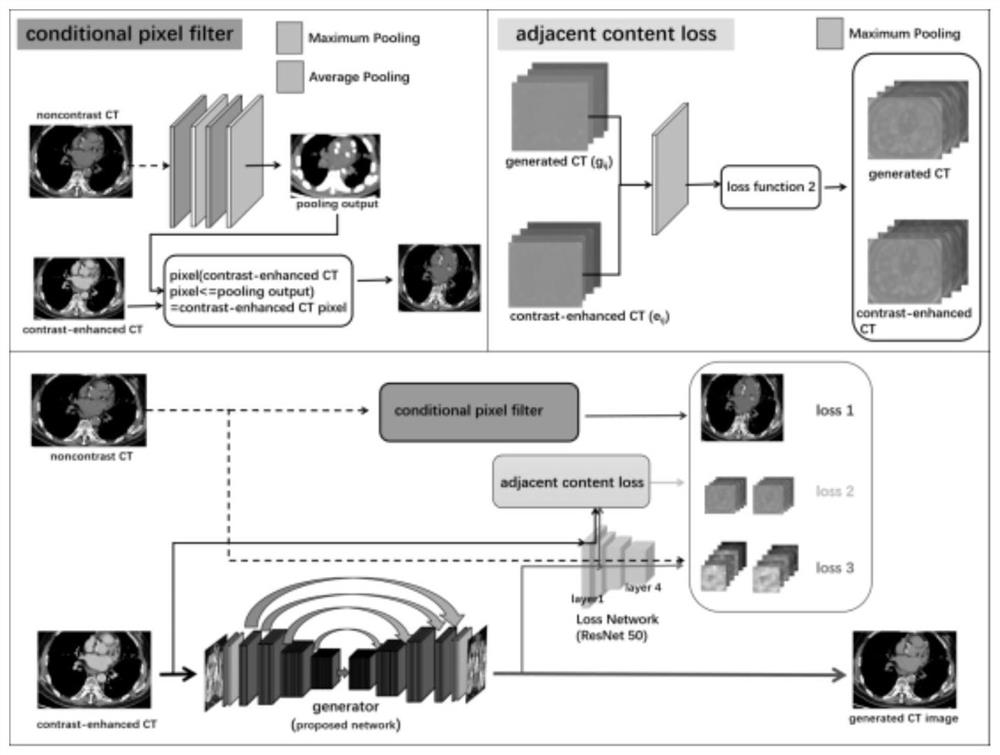

优选的是,在设计损失监督函数步骤之前还包括:设置条件像素滤波器,根据所述平扫CT图像并利用条件像素滤波器的池化网络结构,得到一个模糊化像素矩阵;

判断模糊化像素矩阵的像素值是否小于增强CT图像中的像素值,若否,条件像素滤波器覆盖增强CT图像中的像素。

优选的是,所述池化网络结构包括依次连接的平均池化层、最大池化层、平均池化层和最大池化层。

优选的是,所述损失监督函数的表达式为:

Total Loss=loss

其中,loss

优选的是,利用损失监督函数训练基于结合邻近内容迁移的U型残差网络直至收敛的步骤中,通过Adam优化器来优化损失函数。

优选的是,构建基于结合邻近内容迁移的U型残差网络步骤之前还包括:预处理至少一张增强CT图像;所述预处理包括中心裁剪、翻转以及缩放。

相比于现有技术,本发明的有益效果在于:本发明在多种解剖部位数据中考虑到输入图像的不同解剖结构,通过引入解剖部位先验(属性),结合注意力机制以权重的形式将解剖属性信息加入到基于结合邻近内容迁移的U型残差网络框架中,进而提高图像的去噪性能。基于结合邻近内容迁移的U型残差网络采用残差减法模块,对输入增强图像的衰减稀释。加入条件像素滤波器,利用序列池化层提取增强图像保留像素。基于风格迁移的损失计算,通过邻近内容结构损失计算和高维衰减损失计算实现迁移效果。基于损失监督算法,实现风格转换中从平扫CT中学习衰减,并且在转换成平扫CT的基础上尽可能保留原增强CT图像结构细节。有效提高了网络增强特征衰减能力,使重建图像可以快速实现衰减收敛,并逐渐恢复输入图像结构重建,减少图像中的伪影和噪声。提升了低剂量图像质量,减少扫描的次数,避免病人承受多次高剂量的CT辐射。

附图说明

图1为本发明重建方法的流程示意图;

图2为基于结合邻近内容迁移的U型残差网络的结构图;

图3为编码模块与解码模块之间跳跃连接的示意图;

图4为残差减法模块与残差模块的对比图;

图5为CycleGAN模型、BEGAN模型、pixel2pixel模型以及本申请模型的结果对照图;

图6为CycleGAN模型、BEGAN模型、pixel2pixel模型以及本申请模型的相似度评估图;

图7-11均为CycleGAN模型、BEGAN模型、pixel2pixel模型以及本申请模型的模拟学习曲线;

图12-16均为CycleGAN模型、BEGAN模型、pixel2pixel模型以及本申请模型的相似度散点图;

图17为CycleGAN模型、BEGAN模型、pixel2pixel模型以及本申请模型的生成结果与增强CT图像和平扫CT图像的HU分布;

图18为CycleGAN模型、BEGAN模型、pixel2pixel模型以及本申请模型的生成结果与增强CT图像和平扫CT图像基于HU分布的KDL曲线。

其中:图7、图12中的MAE是平均绝对误差;图8、图13中的MSE是均方误差;图9、图14中的SSIM是结构相似性;图10、图15中的NRMSE是标准根均方差;图11、图16中的PSNR是峰值信噪比。

具体实施方式

为使本发明实施方式的目的、技术方案和优点更加清楚,下面将结合本发明实施方式中的附图,对本发明实施方式中的技术方案进行清楚、完整地描述,显然,所描述的实施方式是本发明一部分实施方式,而不是全部的实施方式。基于本发明中的实施方式,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施方式,都属于本发明保护的范围。因此,以下对在附图中提供的本发明的实施方式的详细描述并非旨在限制要求保护的本发明的范围,而是仅仅表示本发明的选定实施方式。

实施例1:一种增强CT图像的重建方法。

1、一种增强CT图像的重建方法,参加图1,包括以下步骤:

步骤1:获取增强CT图像数据集以及与增强CT图像数据集相配对的平扫CT图像数据集。

步骤2:通过中心裁剪、翻转以及缩放的方式预处理增强CT图像数据集。

步骤3:构建残差减法模块

参见图4,本申请的残差减法模块是经过修改的残差模块得到的。残差减法模块包括依次相连的1x1的卷积、3x3卷积和1x1卷积,残差减法模块的输入端和输出端近连接一个1x1卷积。1x1的卷积、3x3卷积和1x1卷积用于实现特征提取,近连接用于获取高维度的原信息。

残差减法模块是采用一个近连接特征减提取特征的像素减法运算替换残差模块的像素加法运算。近连接的输入映射x是衰减因子映射函数F(x)和输出残差映射R(x)的相加。因此,生成公式为R(x)=x-F(x)。减法运算是对输入增强图像的衰减稀释,通过减法运算可以通过输出层的学习特征来激励对输入图像中增强域的衰减。

残差减法模块的公式为:

y=W_s x-F(x,W_i)

其中:y是残差块的输出投影,W_s是残差模块的shortcut connection连接层中用于生成匹配维度的线性映射参数,W_i是残差模块连接层中用于削弱因子映射的一组参数。

步骤4:构建基于结合邻近内容迁移的U型残差网络

参见图2、3,基于结合邻近内容迁移的U型残差网络由编码器网络和解码器网络组成。编码器网络用于压缩输入功能并在更高的通道中生成输出特征向量,解码器网络用于从较高的通道特征中恢复维度并恢复与输入特征相同的上采样图像。编码器网络和解码器网络的深度与ResNet-152体系结构的深度相同。

编码器网络包括一个卷积层和四个顺序层,每个顺序层均是将几个残差减法模块序列化以后进行下采样操作。每个顺序层中第一个残差减法模块用于将输入压缩为深通道的输出。

解码器网络包含与编码器网络对称的最后一级开始连接的四个上采样顺序层和一个反卷积层,每个上采样顺序层均是将几个残差减法模块序列化以后进行上采样操作。解码器网络中残差减法模块输出的特征图与编码器网络中残差减法模块输出层的同一维的特征图在每一层上串联在一起。

本申请采用残差减法模块作为U型残差网络的单位,从上层到下层最后阶段的输出进行信息补充。与残差神经网络中的残差模块不同,U型残差网络采用近连接与生成特征的像素减法运算来取代残差模块中的加法运算。为了避免在解码器阶段出现大范围的像素损失,将U型残差网络用于解码器网络中的重建步骤,方法是将编码器网络中的输出特征与解码器网络的输入特征做一个矩阵拟合。

步骤5:设置条件像素滤波器

对于结构信息损失计算,通过条件像素滤波器生成训练标签,在生成模型后阶段用于计算输入增强像素和生成结果的像素到像素的损失。条件像素滤波器包括池化网络结构,池化网络结构用将平扫CT图像中的重要特征(例如结构)与增强型CT图像对齐,池化网络结构的输出为一个模糊化像素矩阵,根据增强CT图像生成目标域;条件像素滤波器作为增强CT图像和平扫CT像素图像之间的对比器,当输出表征中的像素值小于增强型CT图像中的像素值的情况下,像素矩阵滤波器覆盖增强型CT图像中的像素。最终生成域会从原始的增强CT图像中滤除在平扫CT图像中不会出现的高亮区域。条件像素滤波器的推导如下面公式所示:

其中,e

表1条件像素滤波器池化网络结构

步骤6:设计损失函数

损失函数分为两个损失:第一次损失计算中的目标是从条件像素滤波器生成的输出,而输出是来自增强CT图像的平扫CT滤波场。因此,使用L

第二次损失计算中的参考变量是从预训练的ResNet-50模型生成的目标。参考风格迁移的原理,对于平扫CT图像的衰减误差,误差计算是在预训练网络第四层的平扫CT高维通道特征矩阵与生成的输出特征矩阵之间的距离的L

关于结构损失,L

其中,g是基于结合邻近内容迁移的U型残差网络的映射输出,e是增强CT矩阵,e

总损失函数计算中,loss

Total Loss=loss

步骤7:将增强CT图像数据集作为基于结合邻近内容迁移的U型残差网络的输入,与其相配对的平扫CT图像数据集作为标签,并利用总损失函数训练基于结合邻近内容迁移的U型残差网络直至收敛,采用Adam优化器来优化损失函数。

步骤8:将增强CT图像输入至训练好的基于结合邻近内容迁移的U型残差网络,得到重建后的虚拟平扫CT图像。

2、基于结合邻近内容迁移的U型残差网络的生成结果测试

本申请采用CycleGAN模型、BEGAN模型、pixel2pixel模型作为对比模型进行测试,各个模型对照的结果如图5-18及表2-3所示。

图5-6为实验对采样实验组部分扫描切片结果的定性分析,从图5-6可以看出,本申请和BEGAN模型在结构重建中显著降低了噪声伪影的效果,而相较于BEGAN模型,本申请模型在平扫衰减重建上有更好的效果。

图7-11为本申请模型与实验对照方法的模型训练曲线趋势,在图7-11中,相比于其他生成对抗模型,本申请模型表现出相对稳定的学习曲线,并且能实现快速收敛,更易于用于现实医疗图像处理场景中的大样本训练。

图12-16为提出方法结果与输入增强CT图像相似度和提出方法结果与标签平扫CT图像相似度的差异分布散点图,从图12-16可以看出,相较其他模型,本申请模型合成图像在与增强CT图像和平扫CT图像的差异性较小,反映了本申请模型在与真实增强CT图像和平扫CT图像的相似度拟合中有更好的效果。

图17-18为实验组模型合成平扫结果与真实CT平扫图像、增强CT图像的HU值分布,并以KDE曲线的形式展示,通过分析图17-18,得出模型在重建中的平扫衰减转换的效果,从曲线中可得知,本申请模型在HU分布上相比其他模型更拟合真实平扫CT的HU值分布,并且与真实增强CT图像有较大的衰减分布差异。这也表明模型在平扫衰减转换有显著效果。

在表2中,本申请模型在感兴趣区域中与增强CT的相似度指标MAE,SSIM,MSE,PSNR上优于Pixel2Pixel模型和CycleGAN模型。BEGAN模型虽然在部分区域有略微高于本申请模型的SSIM值,然而在大部分指标上,BEGAN模型在结构重建保持与增强CT的结构相似度上低于本申请模型。在表3中,本申请模型在整体测试数据集中的整体CT图像区域表现的结果更优异于其他基准模型。

表2:训练50周期的CycleGAN模型、BEGAN模型、pixel2pixel模型以及本申请模型与增强CT相似度值结果

Whole Region 1 indicates slice(2),Whole Region 2 indicates slice(3).*Similarity Improvement>10%,**>20%,***>30%,Bold letters:>1%.

表3:CycleGAN模型、BEGAN模型、pixel2pixel模型以及本申请模型与增强CT图像相似度值结果

Bold letters:Similarity improvements in the baseline and proposedmodels.cst indi-cates contrast-enhanced CT scans,non-cst indicatesnoncontrast CT scans.

以上所述仅为本发明的实施例,并非以此限制本发明的保护范围,凡是利用本发明说明书及附图内容所作的等效结构或等效流程变换,或直接或间接运用在其他相关的系统领域,均同理包括在本发明的保护范围内。

- 一种增强CT图像的重建方法

- 一种基于卷积神经网络的CT图像重建方法