一种可以供盲人使用的情绪识别眼镜

文献发布时间:2023-06-19 13:45:04

技术领域

本发明属于视障者辅助产品技术领域,更具体地,涉及一种可以供盲人使用的情绪识别眼镜。

背景技术

当前的视障者辅助产品中,关注于视障者在社交中的情绪识别领域的比较少,由于涉及领域不够广泛,使用起来也比较麻烦,而视障者由于在视觉的缺陷,在社交中,并不能像正常人那样比较好的跟社交对象进行交流,并且从对方的面部表情来识别对象在沟通中的情绪变化。

发明内容

本发明的目的是针对现有技术中存在的不足,提供一种可以供盲人使用的情绪识别眼镜,该可以供盲人使用的情绪识别眼镜通过表情与微表情识别分析,能够实时向视障用户反馈对方的情绪信息,及时、高效的帮忙视障者更好的独立社交。

为了实现上述目的,本发明提供一种可以供盲人使用的情绪识别眼镜,包括:

眼镜,所述眼镜上设置有图像捕捉模块和微表情获取模块,所述图像捕捉模块和所述微表情获取模块分别能够采集人物面部表情和微表情;

处理模块,所述处理模块与所述图像捕捉模块和所述微表情获取模块电连接,所述处理模块能够根据采集的人物面部表情和微表情识别出对应人物的情绪信息;

情绪反馈模块,所述情绪反馈模块用于接收所述情绪信息。

可选地,还包括语音信息获取模块,所述语音信息获取模块能够采集声音信息,所述声音信息包括语速、语调和声音大小,所述处理模块与所述语音信息获取模块电连接,所述处理模块根据采集的人物面部表情和微表情配合声音信息识别出对应人物的情绪信息。

可选地,所述图像捕捉模块还能够采集环境背景和身体语言。

可选地,还包括数据库单元,所述数据库单元包括面部表情数据、微表情数据、语音数据和历史人物数据。

可选地,所述处理模块包括图像识别模块、语音和语义识别模块、微表情识别模块和情绪综合分析模块;

所述图像对比模块用于将人物面部表情与所述面部表情数据对比,所述语音和语义对比模块用于将声音信息与所述语音数据对比,所述微表情对比模块用于将微表情与所述微表情数据进行对比,所述图像识别模块、所述语音和语义识别模块、所述微表情识别模块的识别比对结果输入所述情绪综合分析模块进行分析。

可选地,所述眼镜包括镜框和镜腿,所述镜框的鼻梁处设置有与所述图像捕捉模块和所述微表情获取模块电连接的摄像头,所述镜框的眉梢处设置有与所述语音信息获取模块电连接的收音器,所述镜腿上设置有与所述处理单元电连接的播音器,能够播报所述处理单元的分析结果。

可选地,所述镜腿上还设置有调节开关,所述调节开关能够调节所述播音器的播报音量。

可选地,所述镜框上还设置有电源键。

可选地,所述情绪综合分析模块进行分析包括:

根据面部表情数据进行面部表情分析,得出第一分析结果;

根据第一分析结果和语音数据进行声音信息分析,得出第二分析结果;

根据微表情数据进行微表情分析,得出第三分析结果;

将所述第二分析结果和所述第三分析结果进行比对,得出最终结果;

所述第一分析结果、所述第二分析结果和所述第三分析结果通过比例形式输出,综合比例最高的为所述最终结果。

可选地,所述处理模块能够根据所述图像捕捉模块自动捕捉对象,且优先捕捉历史人物数据中有记载的对象。

本发明提供一种可以供盲人使用的情绪识别眼镜,其有益效果在于:

1、该可以供盲人使用的情绪识别眼镜通过表情与微表情识别分析,能够实时向视障用户反馈对方的情绪信息,及时、高效的帮忙视障者更好的独立社交。

2、该可以供盲人使用的情绪识别眼镜使用便利、操作简单,通过语音的方式传达给视障者,解决了部分视障者是由于后天视觉缺失,不懂盲文的现状,减轻视障者在独立社交中的负担。

3、该可以供盲人使用的情绪识别眼镜,帮助视障者进行更好的社交,一定程度上避免了由于视觉缺失,导致被欺骗、语言冲突,识别出异常情绪。

4、该可以供盲人使用的情绪识别眼镜通过数据库单元的技术模型进一步优化,能够应用于视障者学习生活,在精确性、灵敏性、可操作性、经济性等方面有较高的应用价值。

5、该可以供盲人使用的情绪识别眼镜的造型跟普通眼镜相似,携带方便,且不会引起他人异样的眼光。

本发明的其它特征和优点将在随后具体实施方式部分予以详细说明。

附图说明

通过结合附图对本发明示例性实施方式进行更详细的描述,本发明的上述以及其它目的、特征和优势将变得更加明显,其中,在本发明示例性实施方式中,相同的参考标号通常代表相同部件。

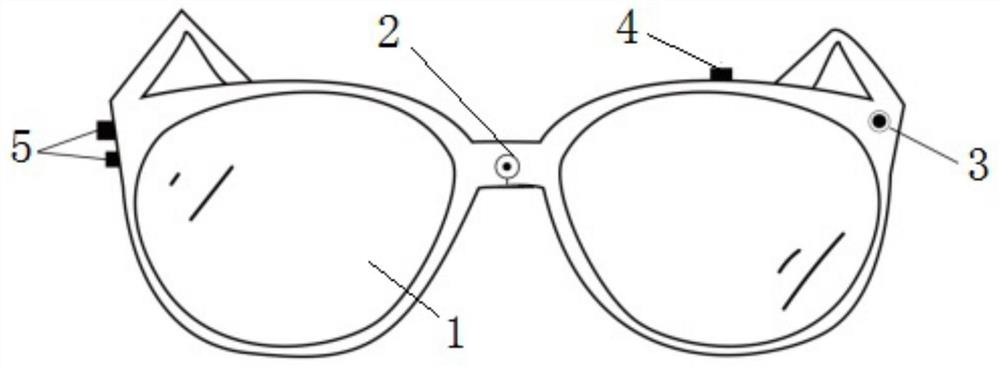

图1示出了根据本发明的一个实施例的一种可以供盲人使用的情绪识别眼镜的结构示意图。

图2示出了根据本发明的一个实施例的一种可以供盲人使用的情绪识别眼镜的原理图。

附图标记说明:

1、眼镜;2、摄像头;3、收音器;4、电源键;5、调节开关。

具体实施方式

下面将更详细地描述本发明的优选实施方式。虽然以下描述了本发明的优选实施方式,然而应该理解,可以以各种形式实现本发明而不应被这里阐述的实施方式所限制。相反,提供这些实施方式是为了使本发明更加透彻和完整,并且能够将本发明的范围完整地传达给本领域的技术人员。

图1示出了根据本发明的一个实施例的一种可以供盲人使用的情绪识别眼镜的结构示意图;图2示出了根据本发明的一个实施例的一种可以供盲人使用的情绪识别眼镜的原理图。

如图1-2所示,一种可以供盲人使用的情绪识别眼镜,包括:

眼镜1,眼镜1上设置有图像捕捉模块和微表情获取模块,图像捕捉模块和微表情获取模块能够采集人物面部表情和微表情;

处理模块,处理模块与图像捕捉模块和微表情获取模块电连接,处理模块能够根据采集的人物面部表情和微表情识别出对应人物的情绪信息,;

情绪反馈模块,情绪反馈模块用于接收情绪信息。

具体的,人物情绪信息包括开心、难过、生气、尴尬、恐惧、说谎、真诚、紧迫、平静;

情绪反馈模块为播音器,通过处理模块、图像捕捉模块和微表情获取模块集成在眼镜1上方便视障者随身携带使用,隐蔽方便,通过处理模块根据采集的人物面部表情和微表情识别出对应人物的情绪信息,方便视障人员及时掌握对象的情绪变化,提高双方的沟通效率,更好的方便视障人员独立社交,通过播音器播报识别结果。

进一步,处理模块根据采集的人物面部表情和微表情配合声音信息识别出对应人物的情绪信息包括利用虚拟技术结合声音信息、人物面部表情和微表情与数据库单元进行比对分析,识别对象的图像与语言信息,进行分析确定对象的情绪。

在本实施例中,还包括语音信息获取模块,语音信息获取模块能够采集声音信息,声音信息包括语速、语调和声音大小,处理模块与语音信息获取模块电连接,处理模块根据采集的人物面部表情和微表情配合声音信息识别出对应人物的情绪信息。

具体的,通过人物面部表情和微表情结合语速、语调和声音大小的变化确认对象的情绪状态,提高识别准确性。例如紧迫时声音变大,语速加快。

在本实施例中,图像捕捉模块还能够采集环境背景和身体语言。

具体的,通过结合环境背景分析现场状况,并通过肢体动作的身体语言结合心理学进行分析,适应多人物的套论交流环境使用,有效分析出情绪发泄对象,确认相应情绪对象,避免识别错误。

在本实施例中,还包括数据库单元,数据库单元包括面部表情数据、微表情数据、语音数据和历史人物数据。

具体的,通过数据库单元储存相应比对文件,同时利用历史人物数据记录熟人信息,方便熟人之间交流,降低运算负担。

在本实施例中,处理模块包括图像识别模块、语音和语义识别模块、微表情识别模块和情绪综合分析模块;

图像对比模块用于将人物面部表情与面部表情数据对比,语音和语义对比模块用于将声音信息与语音数据对比,微表情对比模块用于将微表情与微表情数据进行对比,图像识别模块、语音和语义识别模块、微表情识别模块的识别比对结果输入情绪综合分析模块进行分析。

具体的,情绪综合分析模块结合图像识别模块、语音和语义识别模块、微表情识别模块的识别结果进行综合判定,提高判定准确度。

在本实施例中,眼镜1包括镜框和镜腿,镜框的鼻梁处设置有与图像捕捉模块和微表情获取模块电连接的摄像头2,镜框的眉梢处设置有与语音信息获取模块电连接的收音器3,镜腿上设置有与处理单元电连接的播音器,能够播报处理单元的分析结果。

具体的,通过摄像头2和收音器3采集影音用于分析,通过播音器播报分析结果。

进一步,播音器为骨传导耳机,能够及时隐蔽的传递分析结果,避免外放声音引起对象尴尬。

在本实施例中,镜腿上还设置有调节开关5,调节开关5能够调节播音器的播报音量。

在本实施例中,镜框上还设置有电源键4。

具体的,通过电源键4控制处理模块的启闭,节约电能。

在本实施例中,情绪综合分析模块进行分析包括:

根据面部表情数据进行面部表情分析,得出第一分析结果;

根据第一分析结果和语音数据进行声音信息分析,得出第二分析结果;

根据微表情数据进行微表情分析,得出第三分析结果;

将第二分析结果和第三分析结果进行比对,得出最终结果;

第一分析结果、第二分析结果和第三分析结果通过比例形式输出,综合比例最高的为最终结果。

具体的,通过情绪综合分析模块综合分析面部表情、声音信息和微表情的分析判断结果,通过三个结果相互验证进行最终判定,提高准确性,避免单一信息判定出现识别错误。

进一步,能够预先进行实验,分析三种条件下,对于情绪识别的判断是否统一,设置误差值的比例。首先根据数据库单元结合不同的面部图像,先通过面部图像跟数据库单元对比进行分析,得出情绪可能性占比;其次根据上下文语义进行判断得出情绪可能性占比;最后根据微表情对比得出情绪可能性占比。综合三类情绪识别占比综合分析,得出最终占比。占比率最高的即为当下情绪识别结果。

在本实施例中,处理模块能够根据图像捕捉模块捕捉对象,且优先捕捉历史人物数据中有记载的对象。

具体的,通过历史人物数据方便快速识别熟人,有效从人群中锁定对象,适应多人交流见面使用。

本实施例可以供盲人使用的情绪识别眼镜使用时,以使用者和对象二人对话为例,启动眼镜后,摄像头和收音器实时收集现场信息,图像捕捉模块和微表情获取模块通过摄像头采集环境背景、身体语言、人物面部表情和微表情,语音信息获取模块通过收音器采集对象的语速、语调和声音大小,处理模块根据采集的信息进行分析判断,确认对象的情绪拨动变化,并在变化时通过播音器进行播报,方便使用者判断对象情绪,以及及时调整谈话。例如:

1.通过摄像头结合图像捕捉模块和微表情获取模块捕捉沟通对象的面部表情(包括正面和侧面)和微表情,同时通过收音器和语音信息获取模块采集声音信息,通过数据库单元进行文本语义对比分析,结合面部表情对比分析,以及微表情数据库单元对照分析,通过三种识别方式的有机统一分析,更加准确的定位被捕捉用户的情绪状态;

2.运用虚拟技术进行数据比对后的场景模拟综合分析,结合环境背景,通过场景模拟分析出社交对象的情绪状态以及最佳的沟通方式,实时反馈给视障者以便进行最佳的沟通交流调动;

3.语音反馈:通过语音实时反馈交流对象的情绪反应,视障者通过语音的反馈,及时调整自己的沟通表达,帮助视障者在独立的情况下进行更好的社交。

4.除了传统的情绪识别,还包括微表情分析,通过微表情识别分析,能够帮忙视障者识别社交对象的潜在情绪、潜在意识,如同为视障者提供了一双接近真实的“眼睛”。

以上已经描述了本发明的各实施例,上述说明是示例性的,并非穷尽性的,并且也不限于所披露的各实施例。在不偏离所说明的各实施例的范围和精神的情况下,对于本技术领域的普通技术人员来说许多修改和变更都是显而易见的。

- 一种可以供盲人使用的情绪识别眼镜

- 盲人眼镜及其使用方法