基于特征融合和丢失判定机制的目标跟踪方法及装置

文献发布时间:2024-01-17 01:26:37

技术领域

本申请涉及目标跟踪技术领域,尤其涉及一种基于特征融合和丢失判定机制的目标跟踪方法及装置。

背景技术

目标跟踪是通过分析视频图片序列,对检测出的各个候选目标区域实施匹配,定位出目标在图像中的坐标位置,进而得到一系列相同目标的连续变化的过程。即目标跟踪是对待跟踪目标的运动轨迹进行预测和定位。目标跟踪可以应用在计算机视觉领域,例如,安防监控、交通运输、医学图像、军事打击等领域。

目标跟踪的方法是将待跟踪目标的第一帧图像信息输入至跟踪器进行初始化,然后跟踪器根据先验信息、图像序列上下文信息对待跟踪目标的表观特征进行建模和处理,并结合算法对待跟踪目标的运动状态进行预测,最后输出待跟踪目标实时的位置信息。

然而,跟踪器对目标特征的抓取能力较低,且不能准确及时的进行丢失判定,使得在受到外界环境因素和目标自身因素的影响,例如,相似物干扰、尺度变化、眩光、遮挡、复杂背景等场景下,会导致待跟踪目标的跟踪失败。

发明内容

本申请提供一种基于特征融合和丢失判定机制的目标跟踪方法,以解决目标跟踪过程中受外界环境干扰导致跟踪失败的问题。

第一方面,本申请提供一种基于特征融合和丢失判定机制的目标跟踪方法,包括:

获取视频流数据,所述视频流数据中包括多个帧图像;

在第一帧图像中识别待跟踪目标,以及提取所述待跟踪目标的目标特征,所述目标特征包括多种特征;

基于所述目标特征训练相关滤波器;

提取第二帧图像的图像特征,所述第二帧图像为所述第一帧图像的后一关键帧图像;

基于所述图像特征和所述相关滤波器在所述第二帧图像中定位所述待跟踪目标的目标位置,所述目标位置根据所述图像特征和所述相关滤波器执行相关滤波运算得到;

基于预设丢失判定机制监测所述待跟踪目标的跟踪状态,所述跟踪状态包括丢失状态和非丢失状态;

如果所述跟踪状态为丢失状态,在所述第二帧图像的后一关键帧图像中重新识别所述待跟踪目标;

如果所述跟踪状态为非丢失状态,输出所述目标位置,以及在所述第二帧图像中提取所述待跟踪目标的目标特征,以更新所述相关滤波器。

可选的,基于所述目标特征训练相关滤波器的步骤,包括:

对所述目标特征执行循环移位处理,以生成多个循环样本;

根据多个所述循环样本构建循环矩阵,以及基于循环矩阵训练相关滤波器。

可选的,所述方法还包括:

获取不同尺度空间的图像特征;

对不同尺度空间的所述图像特征和所述相关滤波器执行相关滤波运算,以生成不同尺度空间的响应图;

比较不同尺度空间响应图的响应峰值;

定位所述待跟踪目标的目标位置,所述目标位置为所述响应图中响应峰值最大的位置。

可选的,获取不同尺度空间的图像特征的步骤,包括:

按照预设比例对所述第二帧图像执行缩放处理,以生成不同尺度空间上的第二帧图像;

提取不同尺度空间上第二帧图像的图像特征。

可选的,所述方法还包括:

提取所述第二帧图像的多种图像特征;

将多种所述图像特征分别与所述相关滤波器执行相关滤波运算,以得到每种所述图像特征的响应图;

根据所述响应图计算每种所述图像特征的置信度,所述置信度用于表征所述图像特征的匹配程度;

根据所述置信度对多种所述图像特征执行加权融合处理。

可选的,所述图像特征包括方向梯度直方图特征、局部二值模式特征、颜色特征和灰度共生矩阵对比度特征。

可选的,基于预设丢失判定机制监测所述待跟踪目标的跟踪状态的步骤,包括:

获取所述图像特征和所述相关滤波器执行相关滤波运算后的最大响应值和最小响应值;

根据所述最大响应值和所述最小响应值计算平均峰值相关能量;

如果所述平均峰值相关能量大于第一阈值且所述最大响应值大于第二阈值,标记所述跟踪状态为非丢失状态;

如果所述平均峰值相关能量小于第一阈值或者所述最大响应值小于第二阈值,标记所述跟踪状态为丢失状态。

可选的,基于预设丢失判定机制监测所述待跟踪目标的跟踪状态的步骤,包括:

获取所述图像特征和所述相关滤波器执行相关滤波运算后的响应峰值;

检测响应值大于响应阈值的像素点面积,所述响应阈值为所述响应峰值与预设倍率的乘积;

计算响应横截峰值比,所述响应横截峰值比为所述像素点面积与所述第二帧图像总面积的比值;

如果所述响应横截峰值比大于峰值比阈值,标记所述跟踪状态为丢失状态;

如果所述响应横截峰值比小于或等于峰值比阈值,标记所述跟踪状态为非丢失状态。

可选的,基于预设丢失判定机制监测所述待跟踪目标的跟踪状态的步骤,包括:

获取目标检测区域和目标跟踪区域,所述目标检测区域为检测到的所述待跟踪目标的区域,所述目标跟踪区域为根据所述图像特征和所述相关滤波器定位到的所述待跟踪目标的区域;

计算所述目标检测区域和所述目标跟踪区域的交并比值;

如果所述交并比值大于交并比阈值,标记所述跟踪状态为非丢失状态,所述交并比阈值为所述目标检测区域中心坐标和所述目标跟踪区域中心坐标之间的距离;

如果所述交并比值小于或等于交并比阈值,标记所述跟踪状态为丢失状态。

第二方面,本申请提供一种基于特征融合和丢失判定机制的目标跟踪装置,所述目标跟踪装置被配置为:

获取视频流数据,所述视频流数据中包括多个帧图像;

在第一帧图像中识别待跟踪目标,以及提取所述待跟踪目标的目标特征,所述目标特征包括多种特征;

基于所述目标特征训练相关滤波器;

提取第二帧图像的图像特征,所述第二帧图像为所述第一帧图像的后一关键帧图像;

基于所述图像特征和所述相关滤波器在所述第二帧图像中定位所述待跟踪目标的目标位置,所述目标位置根据所述图像特征和所述相关滤波器执行相关滤波运算得到;

基于预设丢失判定机制监测所述待跟踪目标的跟踪状态,所述跟踪状态包括丢失状态和非丢失状态;

如果所述跟踪状态为丢失状态,在所述第二帧图像的后一关键帧图像中重新识别所述待跟踪目标;

如果所述跟踪状态为非丢失状态,输出所述目标位置,以及在所述第二帧图像中提取所述待跟踪目标的目标特征,以更新所述相关滤波器。

由上述技术方案可知,本申请提供一种基于特征融合和丢失判定机制的目标跟踪方法及装置,所述方法可以获取到视频流数据后,在第一帧图像中识别待跟踪目标,并提取待跟踪目标的目标特征,基于目标特征训练相关滤波器,再提取第二帧图像的图像特征,基于图像特征和相关滤波器在第二帧图像中定位待跟踪目标的目标位置,其中,目标位置根据图像特征和相关滤波器执行相关滤波运算得到。并且可以基于预设丢失判定机制监测待跟踪目标的跟踪状态,如果跟踪状态为丢失状态,可以在第二帧图像的后一关键帧图像中重新识别待跟踪目标;如果跟踪状态为非丢失状态,输出目标位置,以及在第二帧图像中提取待跟踪目标的目标特征,以更新相关滤波器。所述方法可以提高对目标特征的提取能力,在目标跟踪过程中及时判定跟踪目标的丢失,并对目标进行重捕获,从而实现目标的准确跟踪。

附图说明

为了更清楚地说明本申请实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本申请的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

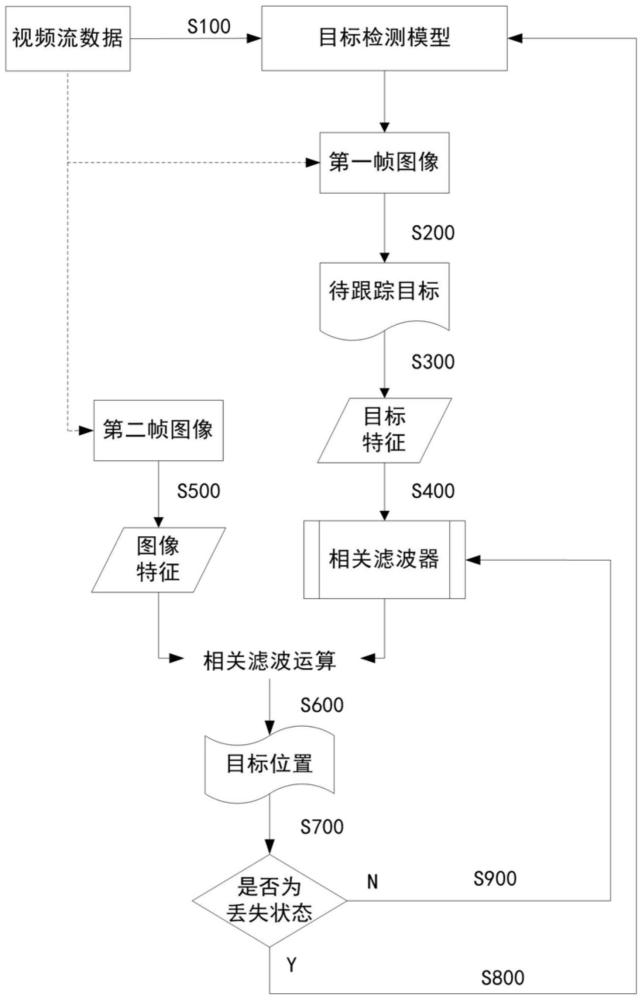

图1为本申请实施例中目标跟踪方法的流程示意图;

图2为本申请实施例中核函数的映射示意图;

图3为本申请实施例中核相关滤波跟踪模型进行目标跟踪的架构图;

图4为本申请实施例中多尺度匹配的示意图;

图5为本申请实施例中多特征融合的示意图;

图6为本申请实施例中待跟踪目标遮挡不同程度时帧图像和对应响应图的示意图;

图7为本申请实施例中检测与跟踪结果协同的示意图;

图8为本申请实施例中目标跟踪方法的架构图;

图9为本申请实施例中受外界环境因素干扰时目标跟踪的示意图;

图10为本申请实施例中目标重捕获的示意图。

具体实施方式

下面将详细地对实施例进行说明,其示例表示在附图中。下面的描述涉及附图时,除非另有表示,不同附图中的相同数字表示相同或相似的要素。以下实施例中描述的实施方式并不代表与本申请相一致的所有实施方式。仅是与权利要求书中所详述的、本申请的一些方面相一致的系统和方法的示例。

目标跟踪是对待跟踪目标的运动轨迹进行预测和定位。在一些实施例中,目标跟踪的方法是通过将待跟踪目标的第一帧图像信息输入至跟踪器进行初始化,其中,跟踪器可以为MOSSE、CSK、KCF、DSST、SRDCF等。然后跟踪器根据先验信息、图像序列上下文信息对待跟踪目标的表观特征进行建模和处理,并结合算法对待跟踪目标的运动状态进行预测,最后输出待跟踪目标实时的位置信息。

然而,受到外界环境因素和目标自身因素的影响,例如,相似物干扰、尺度变化、目标形态尺度变化、光照变化、快速运动、遮挡、复杂背景等场景,需要对跟踪器模型中跟踪目标的模板信息进行及时准确的更新,以及对跟踪目标进行丢失判定,如果未能及时判定目标丢失或者及时更新,可能会降低跟踪器模型的跟踪性能,进而导致待跟踪目标的跟踪失败,例如,跟踪跟到背景上。因此,提高对目标特征的表达能力以及设置有效的跟踪丢失判定机制和模板更新策略对于跟踪器应对上述各种干扰来说是至关重要的。

为了解决目标跟踪过程中受外界环境干扰导致跟踪失败的问题,本申请部分实施例提供一种基于特征融合和丢失判定机制的目标跟踪方法,通过跟踪丢失判定机制和模板更新策略实现目标的准确跟踪。所述目标跟踪方法可以应用于目标跟踪装置,目标跟踪装置被配置为执行所述目标跟踪方法,如图1所示,所述目标跟踪方法包括:

S100:获取视频流数据。

其中,视频流数据为进行目标跟踪的图像序列,视频流数据中包括多个帧图像。通过分析视频流数据中每帧图像,进而定位待跟踪目标在每帧图像中的坐标位置。需要说明的是,本申请提供的目标跟踪方法可以应用于多个领域,例如,应用于航空领域,可以用于飞行器吊舱、导引头中对于目标的精确跟踪;应用于医学影像处理领域,可以用于医疗中医疗器械(如机械手追踪定位),或辅助用户进行精准诊断或治疗(如瞳孔追踪);应用于安防监控领域,可以用于对监控视频中不同目标(如行人、车辆等)进行实时跟踪和检测。

S200:在第一帧图像中识别待跟踪目标。

获取到视频流数据后,读取第一帧图像,并基于目标检测模型对第一帧图像进行目标检测,定位待跟踪目标在第一帧图像中的目标位置。其中,目标检测模型包括但不限于R-CNN、Fast R-CNN、YOLO、SSD等模型,例如,可以基于YOLOv5s模型进行目标检测,YOLOv5模型进行目标检测的准确性较高,对不同尺度目标的综合检测能力较高。同时,YOLOv5模型具有较快推理速度的同时模型尺度更小,可以满足硬件部署需求,提高目标跟踪的实时性,可以部署在计算资源有限的环境中。

S300:提取待跟踪目标的目标特征。

对第一帧图像中的待跟踪目标进行特征提取,提取待跟踪目标的目标特征。其中,目标特征可以为单一特征,但由于目标跟踪过程中受外界因素干扰,使得无法在干扰下提取正确的目标特征,进而导致跟踪算法在复杂场景下的适应能力受限。为了提高跟踪算法的抗干扰能力,目标特征也可以为多种特征的融合,通过从不同层面提取待跟踪目标的多种特征,并进行融合,融合后的目标特征更加综合全面,增强对目标特征的表达能力,从而提高目标跟踪准确率。例如,可以提取待跟踪目标的方向梯度直方图特征(FastHistograms of Oriented Gradients,FHOG)、局部二值模式特征(Local Binary Pattern,LBP)、颜色特征(Hue-Saturation-Value,HSV)和灰度共生矩阵对比度特征(Grey-LevelCo-occurrence Matrix,GLCM-C),将上述特征进行融合,生成待跟踪目标的目标特征。

S400:基于目标特征训练相关滤波器。

获取到待跟踪目标的目标特征后,可以以目标特征作为训练样本,训练相关滤波器,即目标跟踪模型,用于在第一帧图像的后一关键帧图像中定位待跟踪目标的目标位置。

在一些实施例中,目标跟踪模型可以为相关滤波跟踪模型(KemelizedCorrelation Filters,KCF),将目标特征作为训练样本训练KCF模型,进而基于KCF模型对待跟踪目标进行跟踪定位。其中,KCF模型为判别类的跟踪模型,其可以将跟踪问题描述为背景与目标的二分类问题,通过训练分类器来提高其判别能力。

为了提高搜索速度,减少分类器训练所需的时间,在KCF模型中可以采用循环矩阵位移的方式代替密集采样的遍历方式。即在一些实施例中,基于目标特征训练相关滤波器时,可以对目标特征执行循环移位处理,以生成多个循环样本,根据多个循环样本构建循环矩阵,以及基于循环矩阵训练相关滤波器。

KCF模型的初始训练样本为第一帧图像中提取的待跟踪目标的目标特征,以目标特征为一维矩阵为例,其中,目标特征为:

x=[x

循环矩阵为:

对目标特征执行一次循环移位处理后得到的循环样本为:

Qx=[x

对目标特征执行n-1次循环移位处理后得到的循环样本为:

{Q

将所有循环样本组合构建循环矩阵X,即训练样本集:

为了减少数据计算量,可以将循环矩阵通过离散傅里叶变换进行对角化,使用对角化后的矩阵进行运算。例如,基于下式进行对循环矩阵进行对角化:

其中,F为离散傅里叶常量矩阵,例如,酉矩阵;

在一些实施例中,KCF模型的分类器可以为岭回归模型,基于最小二乘方法,并通过增加正则项,进而有效处理变态数据,提高估计精度。其中,岭回归模型的目标函数如下所示:

其中,y

为了计算目标函数的最小值,可以对上式关于w求导,令导函数值为0,得到:

w=(X

将循环矩阵代入上式,并执行傅里叶变换,得到:

上述模型建立在线性回归基础上,实际应用时,跟踪问题可能导致线性不可分。因此,可以引入核函数原理,将低维线性不可分数据映射到高维空间实现可分。例如,如图2所示,以二维样本为例,二维样本包括正样本和负样本,通过核函数方法将二维样本非线性映射到三维空间,实现线性可分。

假设非线性映射函数为

核函数K是训练样本集的核相关矩阵,核函数将高维空间的内积运算转化为低维内积,进而减少运算量,核函数K定义如下:

将非线性空间的映射函数转换为高维空间的内积求解,使用循环矩阵进行对K角化,并通过傅里叶变换,计算相关滤波器参数:

KCF模型中采用的高斯核k

通过上述步骤,可以基于第一帧图像中待跟踪目标的目标特征训练相关滤波器,用于在第二帧图像中定位待跟踪目标的目标位置,其中,第二帧图像为第一帧图像的后一关键帧图像。

S500:提取第二帧图像的图像特征。

在第二帧图像中定位待跟踪目标的目标位置时,可以根据第一帧图像中待跟踪目标的目标位置,进行区域循环采样,并提取图像特征。为了提高跟踪算法的抗干扰能力,图像特征为多种特征的融合。通过从不同层面提取待跟踪目标的多种特征,并进行融合。在一些实施例中,图像特征包括方向梯度直方图特征、局部二值模式特征、颜色特征和灰度共生矩阵对比度特征。

其中,方向梯度直方图特征基于快速图像特征提取(Fast Histograms ofOriented Gradients,FHOG)方法对第二帧图像进行特征提取得到,其采用学习空间变换不变的梯度直观维数(Channel-wise SIFT,C-SIFT)算法,具有一定的平移、旋转、尺度不变性,且包含图像的梯度信息、纹理信息等多种通道,从而提高鲁棒性和运算效率。首先提取图像中每个区域(cell)的梯度特征,并对梯度特征执行归一化截断,再将梯度特征的9维向量扩展为36维向量H(i,j),其中,根据下式执行归一化:

其中,C(i+δ,j+ε)表示当前梯度特征向量偏移(δ,ε)个单位的特征向量。T

局部二值模式特征(Local Binary Pattern,LBP)是一种局部纹理特征描述符,LBP特征具有灰度不变性和旋转不变性,计算图像中每个区域内的LBP特征并执行归一化处理,再将每个区域的统计直方图连接,构成一个特征向量,即得到图像的LBP纹理特征向量,即图像的LBP特征,LBP特征根据下式计算:

其中,(x

颜色特征为颜色模型(Hue-Saturation-Value,HSV)色域下的颜色矩特征,HSV色域包括色相、饱和度和亮度三个维度的颜色属性,HSV色域可以更好的表示和描述颜色特征,并且HSV色域对光照等环境因素具有较好的抗干扰性,能够减少光照变化等因素对目标跟踪的影响,同时,提高目标的颜色信息区分度。因此,本申请实施例引入HSV色域提取目标的颜色特征。

颜色矩特征不受图像缩放或旋转影响,具有一定的抗目标尺度变化性。可以采用二阶矩来计算颜色矩特征,二阶矩表示颜色通道的响应方差,颜色矩特征根据下式计算:

其中,P

灰度共生矩阵对比度特征(Grey-Level Co-occurrence Matrix,GLCM-C)用于表征图像纹理复杂度和灰度级别之间的差异性。即基于灰度共生矩阵中灰度值对出现位置关系的概率分布模型,在不同方向上计算灰度共生矩阵元素之差平方和的加权平均值。GLCM-C特征根据下式计算:

其中,N

S600:基于图像特征和相关滤波器在第二帧图像中定位待跟踪目标的目标位置。

其中,目标位置根据图像特征和相关滤波器执行相关滤波运算得到。在一些实施例中,相关滤波器可以为KCF模型,KCF模型是基于相关滤波的跟踪算法。其中,相关用于衡量两个信号之间的相似性,二维信号的相关计算(相关滤波运算)即两个信号向量内积的连续化形式表达:

目标跟踪中可以将帧图像作为二维离散信号,令f表示目标模板,即相关滤波器的目标模板,g表示样本,即图像特征,将目标模板f在样本g的候选区域内进行平移,同时在每个采样点上计算两者的相关度,当目标模板f平移到与目标位置重合时,两者计算得到的相关度(响应峰值)达到最高。KCF模型将信号相关性引入跟踪算法中,并借助循环矩阵和快速傅里叶变换加速模型的计算。

如图3所示,为KCF模型进行目标跟踪的架构图,获取第一帧图像,对第一帧图像进行采样,确定待跟踪目标的目标位置和目标模板,并对待跟踪目标进行特征提取,以训练初始化相关滤波器。根据第一帧图像中待跟踪目标的目标位置,对第二帧图像进行区域循环采样,以获取图像特征。对图像特征和相关滤波器执行相关滤波运算,得到响应图,根据最大响应位置(响应峰值对应的位置)定位待跟踪目标的目标位置。

由于在目标跟踪过程中,待跟踪目标的属性和周围环境在不断变化,因此,需要及时更新模型参数。在第二帧图像中定位待跟踪目标的目标位置后,重新在第二帧图像中采样,在第二帧图像中提取待跟踪目标的目标特征,训练相关滤波器,进而对相关滤波器的模型参数和目标模板进行更新,用于在第三帧图像中定位待跟踪目标的目标位置。

对于第t+1帧图像,根据第t帧图像中待跟踪目标的目标位置进行区域循环采样,提取图像特征,再通过相关滤波计算得到响应图,根据最大响应位置定位待跟踪目标的目标位置,根据当前帧跟踪结果,提取目标特征进行训练,更新相关滤波器,以持续跟踪目标。

其中,为了提高模型计算速度,如图3所示,可以引入循环矩阵、快速傅里叶变换FFT和逆快速傅里叶变换iFFT,可以在执行相关滤波运算前对数据进行快速傅里叶变换FFT,执行相关滤波运算后执行逆快速傅里叶变换iFFT。

在一些实施例中,KCF模板中可以使用线性插值法对分类器的模型参数和目标模板进行更新,根据下式进行更新:

α

x

其中,η表示模型更新率,t表示视频序列的帧数,α

为了更好适应目标运动过程中带来的尺度变化问题,本申请实施例借助图像金字塔的思想,在多个尺度空间上对第二帧图像进行特征提取,并通过相关滤波计算得到各个尺度空间上的响应图,通过在多个尺度空间上进行匹配,进而准确定位待跟踪目标的目标位置。

因此,在一些实施例中,可以按照预设比例对第二帧图像执行缩放处理,以生成不同尺度空间上的第二帧图像,并提取不同尺度空间上第二帧图像的图像特征。进而可以获取不同尺度空间的图像特征,对不同尺度空间的图像特征和相关滤波器执行相关滤波运算,以生成不同尺度空间的响应图。通过比较不同尺度空间响应图的响应峰值,定位待跟踪目标的目标位置。其中,目标位置为响应图中响应峰值最大的位置。

例如,如图4所示,可以按照预设比例对第二帧图像执行缩放处理,生成3个尺度上的第二帧图像,分别为原始尺度、大尺度和小尺度上的图像,并提取3个尺度对应的图像特征,并通过相关滤波运算生成3个尺度对应的响应图(Peak-value)。将大尺度和小尺度对应的响应图乘以预设权重系数(weight),例如,权重系数为0.92。再比较3个尺度对应响应图的响应峰值,响应峰值最大对应的位置即为目标位置。即如果在缩放尺度上的响应峰值作衰减后还比原始尺度的响应峰值高,则采信缩放尺度上的结果。

在一些实施例中,可以通过多源特征融合的方式来增强跟踪算法的抗干扰能力,通过提取第二帧图像的多种图像特征。将多种图像特征分别与相关滤波器执行相关滤波运算,以得到每种图像特征的响应图。根据响应图计算每种图像特征的置信度,其中,置信度用于表征图像特征的匹配程度。根据所述置信度对多种图像特征执行加权融合处理。

例如,如图5所示,提取多种图像特征,分别为方向梯度直方图特征(FHOG特征)、局部二值模式特征(LBP特征)、颜色特征(HSV特征)和灰度共生矩阵对比度特征(GLCM-C特征)。每种图像特征通过相关滤波器可以生成相应的响应图,不同图像特征对应响应图的最大响应值不同,该最大响应值用于表征该种图像特征的匹配程度,即置信度。因此,可以将不同图像特征的最大响应值作为依据,对多种图像特征进行自适应融合:

其中,ω

根据置信度对多种图像特征进行加权融合:

S700:基于预设丢失判定机制监测待跟踪目标的跟踪状态。

其中,跟踪状态包括丢失状态和非丢失状态。由于相关滤波类跟踪算法在出现相似物干扰、遮挡、目标出视场等情况,如果未能及时判定目标的丢失,且在跟丢时依然更新模板,会导致目标跟踪失败。因此,本申请实施例可以基于丢失判定机制,同时结合当前实时目标检测结果,对当前目标的跟踪状态进行监测,在判定目标丢失时,停止模型更新,并借助目标检测模型重新捕获目标。

在一些实施例中,丢失判定机制可以采用平均峰值相关能量APCE进行目标丢失的判定,APCE值可以反映跟踪置信水平及相关滤波器响应的震荡程度,如果前后时刻中目标发生遮挡,APCE值将发生剧烈波动。因此,可以获取图像特征和相关滤波器执行相关滤波运算后的最大响应值和最小响应值,根据最大响应值和最小响应值计算平均峰值相关能量。其中,平均峰值相关能量即APCE值,可以根据下式计算:

其中,F

预先设置第一阈值和第二阈值,如果平均峰值相关能量大于第一阈值且最大响应值大于第二阈值,标记跟踪状态为非丢失状态。如果平均峰值相关能量小于第一阈值或者最大响应值小于第二阈值,标记跟踪状态为丢失状态。

在一些实施例中,丢失判定机制可以采用响应横截峰值比进行目标丢失的判定。如图6所示,图6示出了待跟踪目标未遮挡、部分遮挡和严重遮挡情况下的帧图像和对应的响应图,可以理解的是,当待跟踪目标成像清晰、不存在遮挡、跟踪稳定等情况时,相关滤波器输出的响应值方差较小,而当待跟踪目标发生遮挡、成像模糊,跟踪丢失等情况时,相关滤波器输出的响应值方差较大。上述变化可以通过三维响应横截峰值占比体现。因此,可以获取图像特征和相关滤波器执行相关滤波运算后的响应峰值,检测响应值大于响应阈值的像素点面积,其中,响应阈值为响应峰值与预设倍率的乘积。例如,取响应峰值的

根据下式计算响应横截峰值比:

S=num(F>F

其中,响应横截峰值比为像素点面积与第二帧图像总面积的比值,V

预先设置峰值比阈值,如果响应横截峰值比大于峰值比阈值,标记跟踪状态为丢失状态。如果响应横截峰值比小于或等于峰值比阈值,标记跟踪状态为非丢失状态。

在一些实施例中,丢失判定机制可以采用检测结果协同的方式进行目标丢失的判定。在目标跟踪的过程中,可以借助目标检测模型的检测结果对当前的跟踪结果进行判定。通过获取目标检测区域和目标跟踪区域,其中,目标检测区域为目标检测模型检测到的待跟踪目标的区域,目标跟踪区域为根据图像特征和相关滤波器定位到的待跟踪目标的区域,即目标跟踪模型定位的区域。计算目标检测区域和目标跟踪区域的交并比值。根据交并比值判定跟踪状态,其中,交并比阈值为目标检测区域中心坐标和目标跟踪区域中心坐标之间的距离。

如图7所示,示出了目标检测区域和目标跟踪区域,计算目标检测区域和目标跟踪区域的交并比值,以及计算目标检测区域中心坐标和目标跟踪区域中心坐标之间的距离:

其中,x

根据交并比值判定跟踪状态,如果交并比值大于交并比阈值,标记跟踪状态为非丢失状态,如果交并比值小于或等于交并比阈值,标记跟踪状态为丢失状态。

在一些实施例中,为了提高效率,可以对丢失判定机制作隔帧处理。即每间隔预设数量的帧图像,基于丢失判定机制监测待跟踪目标的跟踪状态,例如,每间隔3帧基于丢失判定机制判定待跟踪目标的跟踪状态,以提高速度。

本申请实施例可以基于上述任一丢失判定机制对待跟踪目标的跟踪状态进行判定,还可以基于多级丢失判定机制对待跟踪目标的跟踪状态进行判定。例如,设置三级丢失判定机制,一级丢失判定机制采用平均峰值相关能量进行判定,二级丢失判定机制采用响应横截峰值比进行判定,三级丢失判定机制采用检测结果协同的方式进行判定。

S800:如果跟踪状态为丢失状态,在第二帧图像的后一关键帧图像中重新识别待跟踪目标。

基于上述丢失判定机制对待跟踪目标的跟踪状态进行判定后,如果跟踪状态为丢失状态,可以基于目标检测模块重新对待跟踪目标进行重捕获,再重新初始化目标跟踪模块(相关滤波器)重新进行目标跟踪。

S900:如果跟踪状态为非丢失状态,输出目标位置,以及在第二帧图像中提取待跟踪目标的目标特征,以更新相关滤波器。

如果跟踪状态为非丢失状态,可以输出当前帧的待跟踪目标的目标位置,并根据当前帧跟踪结果,提取目标特征进行训练,更新相关滤波器,以进行下一帧的跟踪。

如图8所示,本申请实施例提供的目标跟踪方法,首先通过目标检测器(目标检测器模块)读入初始帧图像,并检测待跟踪目标,确定初始帧的目标位置和目标模板,将待跟踪目标作为目标样本,通过提取初始帧待跟踪目标的目标特征,训练初始化滤波器。

根据滤波器进行目标位置的更新。即在每帧图像中定位待跟踪目标的目标位置,更新当前帧的目标位置时,可以根据前一帧的目标位置,进行区域循环采样,即对于第t+1帧图像,根据第t帧图像中待跟踪目标的目标位置进行区域循环采样,并在多个尺度空间上进行特征提取,将提取的多种特征进行融合,通过相关滤波运算得到各个尺度空间上的响应图,在多个尺度空间上进行匹配,进而定位待跟踪目标,以更新目标位置。

再通过多级丢失判定机制,根据当前帧跟踪结果,同时结合当前帧实时目标检测结果,对待跟踪目标的跟踪状态进行判定。若判定待跟踪目标丢失,则停止模型的更新,基于目标检测器对目标进行目标重捕获,并重新初始化相关滤波器进行跟踪,若判定待跟踪目标未丢失,则对待跟踪目标进行特征提取,根据提取的特征训练更新滤波器的模型参数和目标模板,以继续跟踪目标。

如图9所示,在带有树木、电线杆、土堆等场景的公路,对图9所示的车辆进行跟踪。从图9示出的4帧图像中可以看出,本申请实施例提供的目标跟踪方法在受到外界环境因素干扰,例如,图9所示的图像中树木、电线杆、土堆遮挡等干扰,可以基于目标多种特征的提取和融合,使得对目标的特征表达更加综合全面,进而精确地跟踪目标。

如图10所示,对于山区场景的公路,该场景包含目标尺度变化、相似物干扰、强光照射、遮挡、出视场等诸多干扰。在对图9所示的车辆进行跟踪时,首先根据目标检测器检测到车辆目标,然后根据检测到的一个车辆目标进行跟踪。可以看出,本申请实施例提供的目标跟踪方法可以在受到目标尺度变化、相似物干扰、强光照射、遮挡、出视场等干扰时,准确跟踪目标。并且,在车辆目标被严重遮挡时,基于多级丢失判定机制能够及时判定丢失,转入目标检测器,当车辆目标再次出现在视场中时,能对车辆目标进行重捕获,而后重新转入跟踪。

基于上述目标跟踪方法,本申请部分实施例还提供一种基于特征融合和丢失判定机制的目标跟踪装置,所述目标跟踪装置被配置为:

获取视频流数据。其中,视频流数据中包括多个帧图像。

在第一帧图像中识别待跟踪目标,以及提取待跟踪目标的目标特征,目标特征包括多种特征。

基于目标特征训练相关滤波器。

提取第二帧图像的图像特征。其中,第二帧图像为第一帧图像的后一关键帧图像。

基于图像特征和相关滤波器在第二帧图像中定位待跟踪目标的目标位置。其中,目标位置根据图像特征和相关滤波器执行相关滤波运算得到。

基于预设丢失判定机制监测待跟踪目标的跟踪状态。其中,跟踪状态包括丢失状态和非丢失状态。

如果跟踪状态为丢失状态,在第二帧图像的后一关键帧图像中重新识别待跟踪目标。

如果跟踪状态为非丢失状态,输出目标位置,以及在第二帧图像中提取待跟踪目标的目标特征,以更新相关滤波器。

由以上技术方案可知,上述实施例提供的基于特征融合和丢失判定机制的目标跟踪方法及装置,可以获取到视频流数据后,在第一帧图像中识别待跟踪目标,并提取待跟踪目标的目标特征,基于目标特征训练相关滤波器,再提取第二帧图像的图像特征,基于图像特征和相关滤波器在第二帧图像中定位待跟踪目标的目标位置,其中,目标位置根据图像特征和相关滤波器执行相关滤波运算得到。并且可以基于预设丢失判定机制监测待跟踪目标的跟踪状态,如果跟踪状态为丢失状态,可以在第二帧图像的后一关键帧图像中重新识别待跟踪目标;如果跟踪状态为非丢失状态,输出目标位置,以及在第二帧图像中提取待跟踪目标的目标特征,以更新相关滤波器。所述方法可以提高对目标特征的提取能力,在目标跟踪过程中及时判定跟踪目标的丢失,并对目标进行重捕获,从而实现目标的准确跟踪。

本申请提供的实施例之间的相似部分相互参见即可,以上提供的具体实施方式只是本申请总的构思下的几个示例,并不构成本申请保护范围的限定。对于本领域的技术人员而言,在不付出创造性劳动的前提下依据本申请方案所扩展出的任何其他实施方式都属于本申请的保护范围。

- 一种基于多峰值判定的弱小目标跟踪丢失重检方法

- 一种基于多峰值判定的弱小目标跟踪丢失重检方法