一种音色转换方法和装置

文献发布时间:2023-06-19 09:32:16

技术领域

本发明涉及数据处理技术领域,特别是涉及一种音色转换方法和一种音色转换装置。

背景技术

VC(Voice Conversion,音色转换)是将一个人语音的声线音色转换为另一个人的声线音色,语音的内容不变。音色转换与语音合成的区别,后者是从文字到语音,前者是从语音到语音,从文字到语音需要先进行NLP(Natural Language Processing,自然语言处理)分析,再生成表音、表义、表情的语音,侧重于在语音的生成;从语音到语音不涉及NLP,直接声学层面的变化,重在语音的映射。

音色转换的应用较广,从普通娱乐、发音矫正、直到身份攻防等,都可广泛应用。音色转换的发展历史不算短,最初只能用两个人朗读同样内容的语音(即平行语料)训练一个这两个人之间的“一对一”转换模型,对数据总量要求高,转换稳定性不好。

目前,音色转换主要是将任意人的语音转换成特定目标人的声线音色,而内容保持不变,转换出的语音,各方面接近目标人,包括语调。然而,有些需求场景,更希望转换后的语音能保留原说话人的语气,比如生气的语音转换后仍是生气。

发明内容

鉴于上述问题,提出了本发明实施例以便提供一种克服上述问题或者至少部分地解决上述问题的一种音色转换方法和相应的一种音色转换装置。

本发明实施例公开了一种音色转换方法,所述方法包括:

获取待转换语音;

提取所述待转换语音的多种特征参数;

组合所述多种特征参数得到特征向量;

对所述特征向量进行音色转换得到目标特征参数;

采用所述目标特征参数进行发声处理得到目标语音。

可选地,所述特征参数包括第一谱参数,基频参数和非周期性分量参数;所述组合所述多种特征参数得到特征向量,包括:

提取所述第一谱参数的声学特征得到第二谱参数,所述第二谱参数对应于所述待转换语音的发声内容;

组合所述第二谱参数、基频参数和非周期性分量参数,得到特征向量。

可选地,所述对所述特征向量进行音色转换得到目标特征参数,包括:

对所述特征向量进行音色转换,得到目标谱参数,目标基频参数和目标非周期性成分参数。

可选地,所述采用所述目标特征参数进行发声处理,得到目标语音,包括:

将所述目标谱参数,目标基频参数和目标非周期性分量参数输入至预设声码器进行发声处理,得到目标语音。

可选地,所述对所述特征向量进行音色转换得到目标特征参数,包括:

采用预设U型的音色转换模型,对所述特征向量进行音色转换得到目标特征参数。

可选地,所述预设U型结构的音色转换模型包含池化层和反卷积层,其中,所述池化层的运算核包含二元上下文预测模型,所述反卷积层的运算核包含二元上下文预测模型。

可选地,采用预设U型结构的音色转换模型,对所述特征向量进行音色转换得到目标特征参数,包括:

在所述预设的U型结构的音色转换模型的池化层中,采用二元上下文预测模型对所述特征向量进行降采样处理,得到第一中间向量;

在所述预设的U型结构的音色转换模型的反卷积层中,采用所述二元上下文预测模型对所述第一中间向量进行升采样处理,得到第二中间向量;

对所述第二中间向量进行转换,得到目标特征参数。

可选地,所述在所述预设的U型结构的音色转换模型的池化层中,采用二元上下文预测模型对所述特征向量进行降采样处理,得到第一中间向量,包括:

在所述预设的U型结构的音色转换模型的池化层中,采用二元上下文预测模型,根据两个相邻时刻的所述特征向量预测一个时刻的向量,得到第一中间向量。

可选地,所述在所述预设的U型结构的音色转换模型的反卷积层中,采用所述二元上下文预测模型对所述第一中间向量进行升采样处理,得到第二中间向量,包括:

在所述预设的U型结构的音色转换模型的反卷积层中,采用所述二元上下文预测模型,根据两个相邻时刻的所述第一中间向量预测一个时刻的向量,得到第二中间向量。

可选地,所述池化层和反卷积层的权值共享。

本发明实施例还公开了一种音色转换装置,所述装置包括:

语言获取模块,用于获取待转换语音;

特征参数提取模块,用于提取所述待转换语音的多种特征参数;

特征参数组合模块,用于组合所述多种特征参数得到特征向量;

音色转换模块,用于对所述特征向量进行音色转换得到目标特征参数;

发声处理模块,用于采用所述目标特征参数进行发声处理得到目标语音。

可选地,所述特征参数包括第一谱参数,基频参数和非周期性分量参数;所述特征参数组合模块,包括:

谱参数提取子模块,用于提取所述第一谱参数的声学特征得到第二谱参数,所述第二谱参数对应于所述待转换语音的发声内容;

特征参数组合子模块,用于组合所述第二谱参数、基频参数和非周期性分量参数,得到特征向量。

可选地,所述音色转换模块包括:

第一音色转换子模块,用于对所述特征向量进行音色转换,得到目标谱参数,目标基频参数和目标非周期性成分参数。

可选地,所述发声处理模块包括:

发声处理子模块,用于将所述目标谱参数,目标基频参数和目标非周期性分量参数输入至预设声码器进行发声处理,得到目标语音。

可选地,所述音色转换模块包括:

第二音色转换子模块,用于采用预设U型的音色转换模型,对所述特征向量进行音色转换得到目标特征参数。

可选地,所述预设U型结构的音色转换模型包含池化层和反卷积层,其中,所述池化层的运算核包含二元上下文预测模型,所述反卷积层的运算核包含二元上下文预测模型。

可选地,所述第二音色转换子模块,包括:

降采样处理单元,用于在所述预设的U型结构的音色转换模型的池化层中,采用二元上下文预测模型对所述特征向量进行降采样处理,得到第一中间向量;

升采样处理单元,用于在所述预设的U型结构的音色转换模型的反卷积层中,采用所述二元上下文预测模型对所述第一中间向量进行升采样处理,得到第二中间向量;

转换单元,用于对所述第二中间向量进行转换,得到目标特征参数。

可选地,所述降采样处理单元,包括:

降采样处理子单元,用于在所述预设的U型结构的音色转换模型的池化层中,采用二元上下文预测模型,根据两个相邻时刻的所述特征向量预测一个时刻的向量,得到第一中间向量。

可选地,所述升采样处理单元,包括:

升采样处理子单元,用于在所述预设的U型结构的音色转换模型的反卷积层中,采用所述二元上下文预测模型,根据两个相邻时刻的所述第一中间向量预测一个时刻的向量,得到第二中间向量。

可选地,所述池化层和反卷积层的权值共享。

本发明实施例还公开了一种电子设备,包括:

一个或多个处理器;和

其上存储有指令的一个或多个机器可读介质,当由所述一个或多个处理器执行时,使得所述电子设备执行如本发明实施例任一项所述的方法。

本发明实施例还公开了一种计算机可读存储介质,其上存储有指令,当由一个或多个处理器执行时,使得所述处理器执行如本发明实施例任一项所述的方法。

本发明实施例包括以下优点:

在本发明实施例中,通过获取待转换语音,提取待转换语音的多种特征参数,组合多种特征参数得到特征向量,并对特征向量进行音色转换得到目标特征参数,采用目标特征参数进行发声处理得到目标语音,使得可以对待转换语音的多种特征参数进行音色转换,彻底将待转换语音的多种特征参数转换到目标人的特征参数,改善转换结果的自然度和稳定度,使得转换后的语音能保留原发音人的语气,语调等特征。

附图说明

图1是本发明的一种音色转换系统的结构框图;

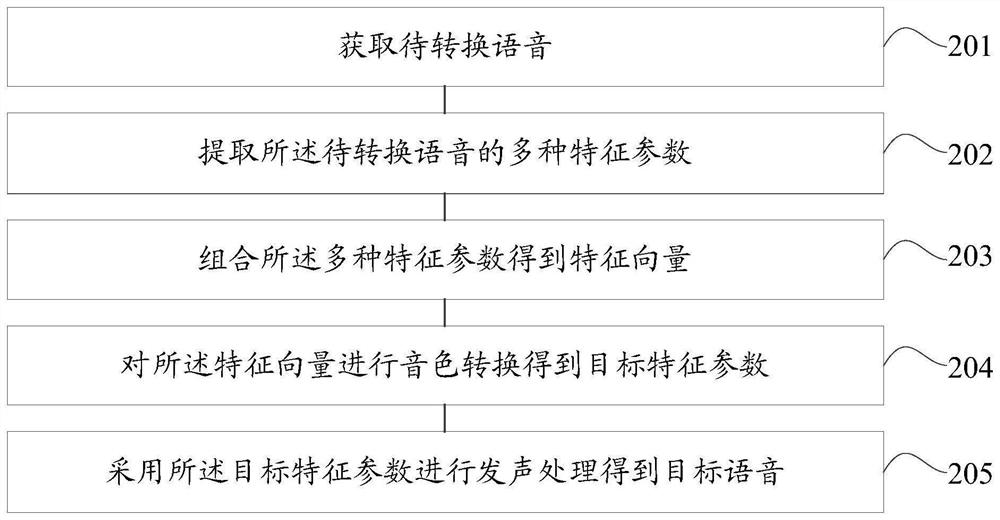

图2是本发明的一种音色转换方法实施例的步骤流程图;

图3是本发明的一种二元上下文预测模型的结构示意图;

图4是本发明的一种音色转换装置实施例的结构框图。

具体实施方式

为使本发明的上述目的、特征和优点能够更加明显易懂,下面结合附图和具体实施方式对本发明作进一步详细的说明。

基于PPGs(Phonetic posteriorgrams,语音后验语音)的音色转换方式:引入语音识别,首先通过语音识别提取不含个人特色的基础发音特征,然后再转换到特定目标人,这种方式能够做到“任意对一”的转换,转换效果的自然度较好。如图1所示,系统整体包含ASR(Automatic Speech Recognition,语音识别)、转换模型和声码器(Vocoder)三部分,图中虚线隔开的三部分,前两部份为模型训练步骤,分别训练语音识别的声学模型和作用于谱参数的音色转换模型;第三部分为模型训练好后真正的音色转换流程。ASR负责从语音中提取一种发音人无关的、只体现发音内容的声学特征,称为PPGs;转换模型负责从PPGs转换到特定人的谱参数,然后生成的谱参数连同输入语音的Log F0和AP等其他参数送入声码器发声。音色转换流程为:

1)待转换的语音输入到语音信号参数提取算法中,提取两套参数:第一套是用语音识别系统自带的特征预提取模块,提取谱参数MFCC(Mel Frequency CepstrumCoefficient,梅尔频率倒谱系数),以供下一步语音识别之用;第二套是用语音合成领域的声码器的参数提取算法提取谱参数MCEPs、基频F0(并取对数得到Log F0)和非周期性成分AP(MCEPs经后续步骤做完音色转换后再与这里的Log F0和AP一起送回声码器的重构合成算法得到语音,此时的语音听起来已经是转换后的音色)。

2)将MFCC送入语音识别系统的声学模型中,得到PPGs。

3)将PPGs送入音色转换模型,得到目标人的MCEPs。

4)将1)中得到的Log F0做简单的线性变换,比如预先计算好转换前后两人Log F0的全局平均值的差,然后将1)中得到的Log F0统一加上这个差值。

5)将目标人的MCEPs连同4)中得到的Log F0和1)中得到的AP送入声码器,得到最终转换后的语音。

其中,ASR部分用Kaldi工具包训练DNN识别模型;声码器采用传统信号类的STRAIGHT工具包提取MCEP、Log F0和AP;转换模型采用简单的双向LSTM结构,建模PPGs到MCEPs的转换关系。

上述方案能够做到将任意人的语音转换成特定目标人的声线音色,而内容保持不变,转换出的语音,各方面接近目标人,包括语调。然而,有些需求场景,更希望转换后的语音能保留原说话人的语气,比如生气的语音转换后仍是生气。在语音学中,影响语气的首要因素就是语调,包括整体语调的音高和变化模式,再进一步扩展,如果能细粒度精细化控制语调,就是歌唱了。

因此,在本发明实施例中,可以将MCEPs、AP和Log F0三套参数一起送入音色转换模型得到目标人的三种参数,一体化地将三套参数彻底转换到目标人,相较于只针对MCEPs进行音色转换的方案,对三套参数一体化同步转换,能明显改善转换结果的自然度和稳定度。

UFNANS(U-shaped Fully-parallel Acoustic Neural Structure,U型全平行声神经结构)是一种面向一维序列建模任务(如语音,自然语言处理等)的深度神经网络结构,该结构有两大特色:首先,是U型结构,该结构借鉴于图像领域近年来十分热门的U-Net,结构内部一轮一轮地通过降采样递归地将输入尺寸减半,然后,其中每轮的结果又回头通过反卷积将尺寸加倍,作为残差加到该轮的输入上,对于每一轮,可以看作两路信息的加和,基本的卷积和经过一趟尺寸下探到底后再回复回来的另一路信息,有了第二路信息,能够覆盖到更宽的视野。其次,是全卷积网络,模型内部只有卷积、反卷积和Pooling池化操作,不包含任何RNN(Recurrent Neural Network,循环神经网络)类基础结构,从而达到全并行化计算的效果,能够大幅提升计算速度。

下面具体示例说明UFANS的前向计算过程,假设模型的输入为尺寸为[_T,_D]的矩阵,其中_T表示时间长度(如语音的分帧数目),_D表示每帧的特征维度。计算流程如下:

1)对输入的结尾沿时间轴补0,得到尺寸为[T,_D]的矩阵IN,使得补足后的长度T刚好是2的整数次方(如4,8,16,32,64,128等)。

2)IN经过卷积层A1(卷积核尺寸为3,输出特征维度为F)以及配套的激励函数组,得到尺寸为[T,F]的矩阵O_A1。

3)O_A1经过平均值Pooling层B1(单元尺寸为2,跳跃单位2),得到尺寸为[T/2,F]的矩阵O_B1。平均值Pooling层B1的计算过程是:求第一帧和第二帧的均值作为输出的第一时刻;求第三帧和第四帧的均值作为输出的第二时刻;求第五帧和第六帧的均值作为输出的第三时刻;照此逐个向后计算完毕,相当于从前向后两两时刻计算得到一个时刻,所以最终的时间长度减半。

4)O_B1经过卷积层A2(卷积核尺寸为3,输出特征维度为F)以及配套的激励函数组,得到尺寸为[T/2,F]的矩阵O_A2。

5)O_A2经过平均值Pooling层B2(单元尺寸为2,跳跃单位2),得到尺寸为[T/4,F]的矩阵O_B2。

6)O_B2经过反卷积层C2(卷积核尺寸为2,跳跃单位2,输出特征维度为F),得到尺寸为[T/2,F]的矩阵O_C2。反卷积层C2的计算过程是:先将输入两两时刻间插入一个全零向量得到尺寸加倍的临时矩阵,然后再做普通的卷积计算,这样得到的结果比输入尺寸加倍。

7)将4)中得到的O_A2和6)中得到的O_C2相加(长度都是T/2),相加之和经过卷积层D2(卷积核尺寸为3,输出特征维度为F)以及配套的激励函数组,得到尺寸为[T/2,F]的矩阵O_D2。

8)O_D2经过反卷积层C1(卷积核尺寸为2,跳跃单位2,输出特征维度为F),得到尺寸为[T,F]的矩阵O_C1。

9)将2)中得到的O_A1和8)中得到的O_C1相加(长度都是2),相加之和经过卷积层D1(卷积核尺寸为3,输出特征维度为F)以及配套的激励函数组,得到尺寸为[T,F]的矩阵O_D1。

10)O_D1经过最终卷积层E(卷积核尺寸为3,输出特征维度为2F)以及配套的激励函数(如tanh),得到尺寸为[T,2F]的矩阵OUT。

需要说明的是,以上过程说明的是内部只有2层的结构,真实情况下一般会设计成更多层,区别就是将4)到7)的单层过程再反复迭代更多轮。

在本发明实施例中,可以上述基于PPGs的音色转换方式中的音色转换模型由原来的DBLSTM结构替换为效果和性能都更出色的UFNANS结构。LSTM(Long Short-Term Memory,长短期记忆网络)是高级的RNN结构,靠内部的一个状态单元来缓释记忆先前一段时间的状态,随着时间的推进边走边接纳新信息并渐渐遗忘最旧的信息,模型对上下文视野的覆盖宽度取决于状态单元的记忆力,因此对于任意时刻,只能看到先前有限时刻的上文信息,DBLSTM是把从前往后和从后往前两个反方向的LSTM简单加在一起,本质上每个方向还是单独记忆。而UFNANS的原理则更优异:首先,U型构内部的基本操作本质上全部是卷积运算,卷积运算先天是向前和向后一体归并信息的,优于DBLSTM的两个方向分别单独记忆。其次,U型结构使得对于每一时刻,能够同时看到[前1,后1][前2,后2][前4,后4][前8,后8][前16,后16]…不同跨度上下文的信息,并自行学习这些不同组信息的融合权重大小。U型层数越深,覆盖到的上下文跨度就越宽,没有局限。最后是性能,RNN结构的神经网络都必须从前到后一个时刻一个一个时刻地递归运算,而卷积结构的神经网络可把卷积核的逐个运算合并为一个矩阵运算一次性完成,就是所谓的并行运算,性能快很多。

参照图2,示出了本发明的一种音色转换方法实施例的步骤流程图,具体可以包括如下步骤:

步骤201,获取待转换语音;

待转换语音可以是需要进行音色转换的音频数据。在本发明实施例中,可以获取待转换语音,以将待转换语音输入至预先训练好的语音识别系统中,采用语音识别系统对待转换语音进行识别并转换音色。

步骤202,提取所述待转换语音的多种特征参数;

特征参数可以是能够待转换语音的关键特征的参数,例如,特征参数可以为MFCC(Mel Frequency Cepstrum Coefficient,梅尔频率倒谱系数),人通过声道产生声音,声道的shape形状决定了发出怎样的声音,声道的shape在语音短时功率谱的包络中显示出来,而MFCC就是一种准确描述这个包络的一种特征;特征参数还可以为基频F0,用于表示基音的振动频率,基频F0决定语音音调的高低;特征参数还可以为非周期性分量AP。

具体的,可以将待转换语音输入到语音信号参数提取算法中,采用语音信号参数提取算法来提取待转换语音的多种特征参数。作为一种示例,提取的特征参数可以包括两套:第一套可以采用语音识别系统自带的特征预提取模块中,提取第一谱参数MFCC,以供后续进行语音识别;第二套可以采用声码器的参数提取算法,提取谱参数MCEPs(Mel-cepstral Coefficients)、基频参数F0(在提取到F0之后,可以取其对数得到Log F0)和非周期性分量参数AP。

步骤203,组合所述多种特征参数得到特征向量;

针对每一帧待转换语音提取到的特征参数可以有多种,可以将每一帧待转换语音对应的多种特征参数拼接在一起,得到一个长的特征向量,以便于后续采用该特征向量进行音色转换。

步骤204,对所述特征向量进行音色转换得到目标特征参数;

目标特征参数指目标人的语音对应的特征参数,在本发明实施例中,可以通过音色转换,将特征向量转换为目标特征参数。

具体的,语音识别系统可以包括音色转换模型,可以采用音色转换模型特征向量进行音色转换得到目标特征参数,由于输入到音色转换模型中特征向量包括多种特征参数,因此,可以一体化地将多种特征参数彻底转换到目标人的特征参数,从而改善转换结果的自然度和稳定度。

步骤205,采用所述目标特征参数进行发声处理得到目标语音。

语音识别系统可以与声码器连接,该声码器可以对接收到的特征参数进行合成生成语音。在本发明实施例中,可以将目标特征参数输入至声码器中,采用该声码器对目标特征参数进行发声处理得到目标语音,其中,目标语言可以是符合目标人的音色的语音。

在本发明实施例中,通过获取待转换语音,提取待转换语音的多种特征参数,组合多种特征参数得到特征向量,并对特征向量进行音色转换得到目标特征参数,采用目标特征参数进行发声处理得到目标语音,使得可以对待转换语音的多种特征参数进行音色转换,彻底将待转换语音的多种特征参数转换到目标人的特征参数,改善转换结果的自然度和稳定度,使得转换后的语音能保留原发音人的语气,语调等特征。

在本发明的一种优选实施例中,所述特征参数包括第一谱参数,基频参数和非周期性分量参数;所述步骤203可以包括如下子步骤:

提取所述第一谱参数的声学特征得到第二谱参数,所述第二谱参数对应于所述待转换语音的发声内容;组合所述第二谱参数、基频参数和非周期性分量参数,得到特征向量。

其中,第一谱参数可以为MFCC梅尔频率倒谱参数。

在本发明实施例中,可以对第一谱参数MFCC进行进一步提取,得到第二谱参数,该第二谱参数可以为PPGs(Phonetic posteriorgrams,语音后验语音),PPGs是一种与发音人无关的、只体现发音内容的声学特征,第二谱参数对应与待转换语音的发声内容。

在提取到第二谱参数PPGs之后,可以将第二谱参数、基频参数和非周期性分量参数拼成一个长特征向量。在具体实现中,可以对基频参数F0取其对数得到Log F0,然后将每一帧的PPGs、Log F0和AP拼成一个长特征向量。

在本发明的一种优选实施例中,所述步骤204可以包括如下子步骤:

对所述特征向量进行音色转换,得到目标谱参数,目标基频参数和目标非周期性成分参数。

特征向量包含待转换语音的PPGs、Log F0和AP,可以采用语音识别系统中的音色转换模块,对特征向量中的PPGs、Log F0和AP进行音色转换得到目标谱参数,目标基频参数和目标非周期性成分参数。其中,目标谱参数为目标人的谱参数MCEPs,目标基频参数为目标人的基频参数Log F0,目标非周期性成分参数为目标人的非周期性成分参数AP。

通过音色转换模块可以将待转换语音的第二谱参数PPGs转换为目标人的谱参数MCEPs,待转换语音的Log F0转换为目标人的Log F0,待转换语音的AP转换为目标人的AP。

在本发明的一种优选实施例中,所述步骤205可以包括如下子步骤:

将所述目标谱参数,目标基频参数和目标非周期性分量参数输入至预设声码器进行发声处理,得到目标语音。

预设声码器可以是预先设置的用于合成语音的模块。在本发明实施例中,可以将目标谱参数,目标基频参数和目标非周期性分量参数输入至预设声码器,该声码器可以对接收到的目标谱参数,目标基频参数和目标非周期性分量参数进行合成生成目标语音,其中,目标语言可以是符合目标人的音色的语音。

在本发明的一种优选实施例中,所述步骤204可以包括如下子步骤:

采用预设U型的音色转换模型,对所述特征向量进行音色转换得到目标特征参数。

其中,预设U型的音色转换模型可以是预先设定的UFNANS结构的音色转换模型,该预设U型的音色转换模型用于对输入数据进行音色转换。

在本发明实施例中,可以采用预设U型的音色转换模型,对特征向量进行音色转换得到目标特征参数,相较于采用DBLSTM结构的音色转换模型进行音色转换,UFNANS结构的音色转换模型效果和性能都更出色,效果方面的优势源于足够宽的上下文视野,性能方面的优势源于全并行的网络结构,进一步提高转换结果的自然度和稳定度。

在本发明的一种优选实施例中,所述预设的U型结构的音色转换模型包含池化层和反卷积层,其中,所述池化层的运算核包含二元上下文预测模型,所述反卷积层的运算核包含二元上下文预测模型。

二元上下文预测模型可以是2-gram预测模型,在池化层中该2-gram预测模型可以输入两个时刻的特征向量,并输出一个时刻的特征向量,如图2示出了本发明实施例的一种二元上下文预测模型的结构示意图,其中,Input1和Input2分别为两个时刻的特征向量,Output为输出的特征向量,二元上下文预测模型可以看作是将两个时刻的特征向量降采样到一个时刻的特征向量。

在本发明实施例中,池化层的运算核包含二元上下文预测模型,反卷积层的运算核包含二元上下文预测模型。在原先的UFNANS结构中,在池化层通过Average Pooling平均值的方式进行降采样,在反卷积层通过补零的方式进行升采样,处理得到的向量存在偏差,在本发明实施例中,对UFNANS的内部缺陷做进一步改进,通过在降采样和升采样引入并共享一套二元上下文预测模型,一方面改善信息量无本之木的窘境,另一方面模型共享有对抗生成的效果,使得训练收敛更精确。

在本发明的一种优选实施例中,所述池化层和反卷积层的权值共享。

由于池化层和反卷积层关注的是相同的上下文信息,因此,可以采用相同的权值联合学习池化层和反卷积层,使得可以减少对训练数据的需求,而且可以在降采样和升采样的过程中共同挖掘具有共性的信息。

在本发明的一种优选实施例中,采用预设的U型结构的音色转换模型,对所述特征向量进行音色转换,得到目标特征参数,包括:

在所述预设的U型结构的音色转换模型的池化层中,采用二元上下文预测模型对所述特征向量进行降采样处理,得到第一中间向量;在所述预设的U型结构的音色转换模型的反卷积层中,采用所述二元上下文预测模型对所述第一中间向量进行升采样处理,得到第二中间数据;对所述第二中间数据进行转换,得到目标特征参数。

在本发明实施例中,可以在预设的U型结构的音色转换模型的池化层中,采用二元上下文预测模型对特征向量进行降采样处理,得到第一中间向量;在预设的U型结构的音色转换模型的反卷积层中,采用二元上下文预测模型对第一中间向量进行升采样处理,得到第二中间向量;对第二中间向量进行转换,得到目标特征参数。

在本发明的一种优选实施例中,所述在所述预设的U型结构的音色转换模型的池化层中,采用二元上下文预测模型对所述特征向量进行降采样处理,得到第一中间向量,包括:

在所述预设的U型结构的音色转换模型的池化层中,采用二元上下文预测模型,根据两个相邻时刻的所述特征向量预测一个时刻的向量,得到第一中间向量。

具体的,可以在预设的U型结构的音色转换模型的池化层中,采用二元上下文预测模型,根据两个相邻时刻的特征向量预测一个时刻的向量,得到第一中间向量。相较于原先的UFNANS结构的Average Pooling均值池化层中的运算核不包含二元上下文预测模型的方式,可以由原来的两两相邻时刻的特征向量计算一个均值。在Average Pooling均值池化层的运算核中添加二元上下文预测模型之后,改为两两相邻时刻的特征向量送入二元上下文预测模型得到一个降采样的结果,Average Pooling均值池化层的初衷是通过降采样实现长度减半,使用二元上下文预测模型灵活预测出结果比简单粗暴地两两取均值能更灵活精确地学习到相邻时刻间的关系。

在本发明的一种优选实施例中,所述在所述预设的U型结构的音色转换模型的反卷积层中,采用所述二元上下文预测模型对所述第一中间向量进行升采样处理,得到第二中间向量,包括:

在所述预设的U型结构的音色转换模型的反卷积层中,采用所述二元上下文预测模型,根据两个相邻时刻的所述第一中间向量预测一个时刻的向量,得到第二中间向量。

具体的,在预设的U型结构的音色转换模型的反卷积层中,采用二元上下文预测模型,根据一个时刻的所述第一中间向量预测两个时刻的向量,得到第二中间向量。Deconvolution反卷积层的初衷是实现长度加倍(升采样),无奈要加的一倍长度的信息是无本之木,只能先以补零这种最惨淡的方式补足长度,再通过卷积适当地摊平。Deconvolution反卷积层的运算核中添加二元上下文预测模型之后,在每个位置补上的是基于前后文真实预测出的结果,具有真实含义,二元上下文预测模型的信息量又可追溯于Average Pooling均值池化层降采样的真实统计分布。从而降采样和升采样共享一套二元上下文预测模型,联合训练,相得益彰,有对抗生成的效果,使得预设的U型结构的音色转换模型的收敛更精确。

需要说明的是,对于方法实施例,为了简单描述,故将其都表述为一系列的动作组合,但是本领域技术人员应该知悉,本发明实施例并不受所描述的动作顺序的限制,因为依据本发明实施例,某些步骤可以采用其他顺序或者同时进行。其次,本领域技术人员也应该知悉,说明书中所描述的实施例均属于优选实施例,所涉及的动作并不一定是本发明实施例所必须的。

参照图4,示出了本发明的一种音色转换装置实施例的结构框图,具体可以包括如下模块:

语言获取模块401,用于获取待转换语音;

特征参数提取模块402,用于提取所述待转换语音的多种特征参数;

特征参数组合模块403,用于组合所述多种特征参数得到特征向量;

音色转换模块404,用于对所述特征向量进行音色转换得到目标特征参数;

发声处理模块405,用于采用所述目标特征参数进行发声处理得到目标语音。

在本发明的一种优选实施例中,所述特征参数包括第一谱参数,基频参数和非周期性分量参数;所述特征参数组合模块403,包括:

谱参数提取子模块,用于提取所述第一谱参数的声学特征得到第二谱参数,所述第二谱参数对应于所述待转换语音的发声内容;

特征参数组合子模块,用于组合所述第二谱参数、基频参数和非周期性分量参数,得到特征向量。

在本发明的一种优选实施例中,所述音色转换模块404包括:

第一音色转换子模块,用于对所述特征向量进行音色转换,得到目标谱参数,目标基频参数和目标非周期性成分参数。

在本发明的一种优选实施例中,所述发声处理模块405包括:

发声处理子模块,用于将所述目标谱参数,目标基频参数和目标非周期性分量参数输入至预设声码器进行发声处理,得到目标语音。

在本发明的一种优选实施例中,所述音色转换模块404包括:

第二音色转换子模块,用于采用预设U型的音色转换模型,对所述特征向量进行音色转换得到目标特征参数。

在本发明的一种优选实施例中,所述预设U型结构的音色转换模型包含池化层和反卷积层,其中,所述池化层的运算核包含二元上下文预测模型,所述反卷积层的运算核包含二元上下文预测模型。

在本发明的一种优选实施例中,所述第二音色转换子模块,包括:

降采样处理单元,用于在所述预设的U型结构的音色转换模型的池化层中,采用二元上下文预测模型对所述特征向量进行降采样处理,得到第一中间向量;

升采样处理单元,用于在所述预设的U型结构的音色转换模型的反卷积层中,采用所述二元上下文预测模型对所述第一中间向量进行升采样处理,得到第二中间向量;

转换单元,用于对所述第二中间向量进行转换,得到目标特征参数。

在本发明的一种优选实施例中,所述降采样处理单元,包括:

降采样处理子单元,用于在所述预设的U型结构的音色转换模型的池化层中,采用二元上下文预测模型,根据两个相邻时刻的所述特征向量预测一个时刻的向量,得到第一中间向量。

在本发明的一种优选实施例中,所述升采样处理单元,包括:

升采样处理子单元,用于在所述预设的U型结构的音色转换模型的反卷积层中,采用所述二元上下文预测模型,根据两个相邻时刻的所述第一中间向量预测一个时刻的向量,得到第二中间向量。

在本发明的一种优选实施例中,所述池化层和反卷积层的权值共享。

对于装置实施例而言,由于其与方法实施例基本相似,所以描述的比较简单,相关之处参见方法实施例的部分说明即可。

本发明实施例提供了一种电子设备,包括:

一个或多个处理器;和其上存储有指令的一个或多个机器可读介质,当由所述一个或多个处理器执行时,使得所述电子设备执行如本发明实施例任一项所述的方法。

本发明实施例公开了一种计算机可读存储介质,其上存储有指令,当由一个或多个处理器执行时,使得所述处理器执行如本发明实施例任一项所述的方法。

本说明书中的各个实施例均采用递进的方式描述,每个实施例重点说明的都是与其他实施例的不同之处,各个实施例之间相同相似的部分互相参见即可。

本领域内的技术人员应明白,本发明实施例的实施例可提供为方法、装置、或计算机程序产品。因此,本发明实施例可采用完全硬件实施例、完全软件实施例、或结合软件和硬件方面的实施例的形式。而且,本发明实施例可采用在一个或多个其中包含有计算机可用程序代码的计算机可用存储介质(包括但不限于磁盘存储器、CD-ROM、光学存储器等)上实施的计算机程序产品的形式。

本发明实施例是参照根据本发明实施例的方法、终端设备(系统)、和计算机程序产品的流程图和/或方框图来描述的。应理解可由计算机程序指令实现流程图和/或方框图中的每一流程和/或方框、以及流程图和/或方框图中的流程和/或方框的结合。可提供这些计算机程序指令到通用计算机、专用计算机、嵌入式处理机或其他可编程数据处理终端设备的处理器以产生一个机器,使得通过计算机或其他可编程数据处理终端设备的处理器执行的指令产生用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的装置。

这些计算机程序指令也可存储在能引导计算机或其他可编程数据处理终端设备以特定方式工作的计算机可读存储器中,使得存储在该计算机可读存储器中的指令产生包括指令装置的制造品,该指令装置实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能。

这些计算机程序指令也可装载到计算机或其他可编程数据处理终端设备上,使得在计算机或其他可编程终端设备上执行一系列操作步骤以产生计算机实现的处理,从而在计算机或其他可编程终端设备上执行的指令提供用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的步骤。

尽管已描述了本发明实施例的优选实施例,但本领域内的技术人员一旦得知了基本创造性概念,则可对这些实施例做出另外的变更和修改。所以,所附权利要求意欲解释为包括优选实施例以及落入本发明实施例范围的所有变更和修改。

最后,还需要说明的是,在本文中,诸如第一和第二等之类的关系术语仅仅用来将一个实体或者操作与另一个实体或操作区分开来,而不一定要求或者暗示这些实体或操作之间存在任何这种实际的关系或者顺序。而且,术语“包括”、“包含”或者其任何其他变体意在涵盖非排他性的包含,从而使得包括一系列要素的过程、方法、物品或者终端设备不仅包括那些要素,而且还包括没有明确列出的其他要素,或者是还包括为这种过程、方法、物品或者终端设备所固有的要素。在没有更多限制的情况下,由语句“包括一个……”限定的要素,并不排除在包括所述要素的过程、方法、物品或者终端设备中还存在另外的相同要素。

以上对本发明所提供的一种音色转换方法和一种音色转换装置,进行了详细介绍,本文中应用了具体个例对本发明的原理及实施方式进行了阐述,以上实施例的说明只是用于帮助理解本发明的方法及其核心思想;同时,对于本领域的一般技术人员,依据本发明的思想,在具体实施方式及应用范围上均会有改变之处,综上所述,本说明书内容不应理解为对本发明的限制。

- 一种音色转换方法和装置

- 一种音色转换方法、装置、电子设备及可读存储介质