虚拟对象的控制方法、装置、终端设备及存储介质

文献发布时间:2023-06-19 11:39:06

技术领域

本申请涉及终端技术领域,特别涉及一种虚拟对象的控制方法、装置、终端设备及存储介质。

背景技术

随着科学技术领域的发展,终端设备中安装的应用程序越来越多,提供给用户的功能也越来越多。其中,有些应用程序运行过程中,用户可以通过操作与终端设备连接的键盘、鼠标等硬件设备来控制应用程序中的虚拟对象进行移动,用户也可以通过操作终端设备在应用界面中展示的虚拟摇杆,来控制虚拟对象进行移动,实现对虚拟对象的控制。

在上述相关技术中,在控制虚拟对象移动时,需要用户手动进行操控,导致控制虚拟对象移动的步骤繁琐,存在控制效率低的问题。

发明内容

本申请实施例提供了一种虚拟对象的控制方法、装置、终端设备及存储介质,可以提高终端设备对虚拟对象的控制效率。

一方面,本申请实施例提供了一种虚拟对象的控制方法,所述方法应用于终端设备,所述终端设备包括摄像头,所述方法包括:

通过所述摄像头采集第一面部图像;

对所述第一面部图像进行图像识别,提取所述第一面部图像中的眼睛图像区域的图像特征;

根据所述图像特征,确定第一偏移位置信息,所述第一偏移位置信息包括眼睛瞳孔在所述眼睛图像区域的当前位置相对于原始位置的偏移距离和偏移方向,所述原始位置是所述眼睛图像区域中眼睛轮廓的中心位置;

根据所述第一偏移位置信息,控制所述终端设备中展示的虚拟对象在所述应用界面中移动。

可选的,所述根据所述图像特征,确定第一偏移位置信息,包括:

根据所述图像特征,获取眼睛轮廓信息以及眼睛瞳孔在所述眼睛图像区域的当前位置;

根据所述眼睛轮廓信息,确定原始位置;

根据所述原始位置以及所述眼睛瞳孔在所述眼睛图像区域的当前位置,获取第一偏移位置信息。

可选的,所述根据所述原始位置以及所述眼睛瞳孔在所述眼睛图像区域的当前位置,获取所述第一偏移位置信息,包括:

将所述原始位置作为坐标原点建立目标坐标系;

根据所述眼睛瞳孔在所述眼睛图像区域的当前位置与所述原始位置之间的相对位置关系,将所述当前位置转换为在所述目标坐标系下的第一位置坐标;

根据所述第一位置坐标,获取所述第一偏移位置信息。

可选的,在所述根据所述眼睛图像,获取第一偏移位置信息之前,还包括:

获取采集所述第一面部图像时第一面部与所述摄像头之间的采集距离;

根据所述采集距离,确定第一转换关系,所述第一转换关系是所述偏移距离与所述虚拟对象在所述应用界面中移动的距离之间的转换关系;

所述根据所述第一偏移位置信息,控制所述终端设备中展示的虚拟对象在应用界面中移动,包括:

根据所述第一偏移位置信息以及所述第一转换关系,获取目标移动距离;

控制所述虚拟对象在所述应用界面中按照所述偏移方向移动所述目标移动距离。

可选的,所述虚拟对象在所述应用界面中有起始位置,在所述根据所述第一偏移位置信息,控制所述终端设备中展示的虚拟对象在所述应用界面中移动之前,还包括:

当所述虚拟对象处于所述起始位置时,启动计时器;

通过所述摄像头采集所述第一面部图像时,获取所述计时器的时长;

根据所述第一偏移位置信息以及所述计时器的时长,获取移动速度;

所述根据所述第一偏移位置信息,控制所述终端设备中展示的虚拟对象在所述应用界面中移动,包括:

根据所述第一偏移位置信息,控制所述虚拟对象按照所述移动速度在所述应用界面中移动。

可选的,在所述根据所述第一偏移位置信息以及所述计时器的时长,获取移动速度之前,还包括:

获取第一系数,所述第一系数是瞳孔移动的速度与所述虚拟对象在所述应用界面中移动的速度之间换算的系数;

所述根据所述第一偏移位置信息以及所述计时器的时长,获取移动速度,包括:

根据所述第一偏移位置信息中包括的所述偏移距离以及所述计时器的时长,获取第一速度;

根据所述第一速度以及所述第一系数,获取所述移动速度。

可选的,在所述通过所述摄像头采集第一面部图像之前,还包括:

展示第一选择界面,所述第一选择界面中包含至少两种运动方式,所述至少两种运动方式是所述虚拟对象在所述应用界面中移动时所述虚拟对象的运动方式;

通过所述摄像头采集多帧面部图像;

根据所述多帧面部图像,获取眨眼次数;

根据所述眨眼次数,从所述至少两种运动方式中获取与所述眨眼次数对应的目标运动方式;

所述根据所述第一偏移位置信息,控制所述终端设备中展示的虚拟对象在所述应用界面中移动,包括:

根据所述第一偏移位置信息,控制所述虚拟对象按照所述目标运动方式在所述应用界面中移动。

另一方面,本申请实施例提供了一种虚拟对象的控制装置,所述装置应用于终端设备,所述终端设备包括摄像头,所述装置包括:

图像采集模块,用于通过所述摄像头采集第一面部图像;

特征提取模块,用于对所述第一面部图像进行图像识别,提取所述第一面部图像中的眼睛图像区域的图像特征;

信息确定模块,用于根据所述图像特征,确定第一偏移位置信息,所述第一偏移位置信息包括眼睛瞳孔在所述眼睛图像区域的当前位置相对于原始位置的偏移距离和偏移方向,所述原始位置是所述眼睛图像区域中眼睛轮廓的中心位置;

对象控制模块,用于根据所述第一偏移位置信息,控制所述终端设备中展示的虚拟对象在所述应用界面中移动。

另一方面,本申请实施例提供了一种终端设备,包括存储器及处理器,所述存储器中存储有计算机程序,所述计算机程序被所述处理器执行时,使得所述处理器实现如上述一个方面及其任一可选方式所述的虚拟对象的控制方法。

另一方面,本申请实施例提供了一种计算机可读存储介质,其上存储有计算机程序,所述计算机程序被处理器执行时实现如上述一个方面及其任一可选方式所述的虚拟对象的控制方法。

另一方面,本申请实施例提供了一种计算机程序产品,当所述计算机程序产品在计算机上运行时,使得所述计算机执行如上述一个方面及其任一可选方式所述的虚拟对象的控制方法。

另一方面,本申请实施例提供了一种应用发布平台,所述应用发布平台用于发布计算机程序产品,其中,当所述计算机程序产品在计算机上运行时,使得所述计算机执行如上述一个方面及其任一可选方式所述的虚拟对象的控制方法。

本申请实施例提供的技术方案可以至少包含如下有益效果:

本申请终端设备通过摄像头采集第一面部图像;对第一面部图像进行图像识别,提取第一面部图像中的眼睛图像区域的图像特征;根据图像特征,确定第一偏移位置信息,第一偏移位置信息包括眼睛瞳孔在眼睛图像区域的当前位置相对于原始位置的偏移距离和偏移方向,原始位置是眼睛图像区域中眼睛轮廓的中心位置;根据第一偏移位置信息,控制终端设备中展示的虚拟对象在应用界面中移动。终端设备可以根据采集到的第一面部图像获取到眼睛瞳孔的第一偏移位置信息,根据该第一偏移位置信息来控制虚拟对象进行移动,不需要用户手动操作,实现了根据用户的眼睛瞳孔位置来控制虚拟对象,提高了对虚拟对象的控制效率。

附图说明

为了更清楚地说明本发明实施例中的技术方案,下面将对实施例中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

图1是本申请一示例性实施例提供的一种虚拟场景的场景画面示意图;

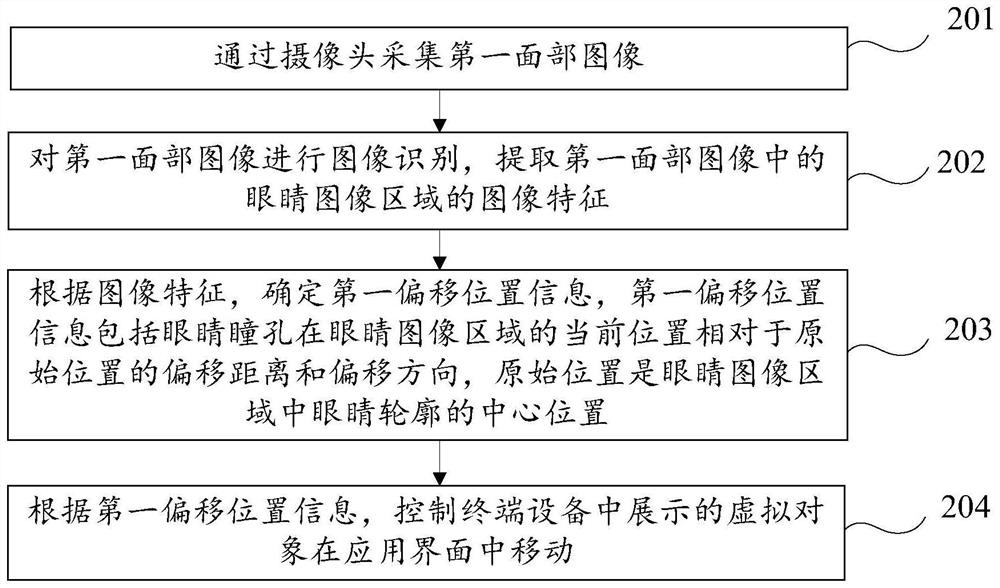

图2是本申请一示例性实施例提供的一种虚拟对象的控制方法的方法流程图;

图3是本申请一示例性实施例涉及的一种第一面部图像的图像示意图;

图4是本申请一示例性实施例提供的一种虚拟对象的控制方法的方法流程图;

图5是本申请一示例性实施例涉及的一种应用界面的界面示意图;

图6是本申请一示例性实施例涉及的一种目标坐标系的结构示意图;

图7是本申请一示例性实施例涉及的一种控制虚拟对象移动的界面示意图;

图8是本申请一示例性实施例涉及的一种应用界面的界面示意图;

图9是本申请一示例性实施例涉及图8的一种应用界面的界面示意图;

图10是本申请一示例性实施例涉及的一种第一选择界面的界面示意图;

图11是本申请一示例性实施例涉及的一种运动方式的示意图;

图12是本申请一示例性实施例提供的一种虚拟对象的控制方法的方法流程图;

图13是本申请一示例性实施例提供的虚拟对象的控制装置的结构框图;

图14是本申请一示例性实施例公开的一种终端设备的结构示意图。

具体实施方式

这里将详细地对示例性实施例进行说明,其示例表示在附图中。下面的描述涉及附图时,除非另有表示,不同附图中的相同数字表示相同或相似的要素。以下示例性实施例中所描述的实施方式并不代表与本申请相一致的所有实施方式。相反,它们仅是与如所附权利要求书中所详述的、本申请的一些方面相一致的装置和方法的例子。

在本文中提及的“多个”是指两个或两个以上。“和/或”,描述关联对象的关联关系,表示可以存在三种关系,例如,A和/或B,可以表示:单独存在A,同时存在A和B,单独存在B这三种情况。字符“/”一般表示前后关联对象是一种“或”的关系。

本申请提供的方案,可以用于人们在日常生活中使用终端设备时,通过终端设备连接的摄像头采集固定在载玻片支架上采集载玻片上的物体图像的现实场景中,为了便于理解,下面首先对本申请实施例涉及的一些名词以及场景架构进行简单介绍。

虚拟场景:是指应用程序在终端上运行时显示(或提供)的虚拟的场景。该虚拟场景可以是对真实世界的仿真环境场景,也可以是半仿真半虚构的三维环境场景,还可以是纯虚构的三维环境场景。虚拟场景可以是二维虚拟场景、2.5维虚拟场景和三维虚拟场景中的任意一种。虚拟场景通常由终端等计算机设备中的应用程序生成基于终端中的硬件(比如显示屏)进行展示。

虚拟对象:是指在虚拟场景中的可活动对象。该可活动对象可以是虚拟人物、虚拟动物、虚拟载具中的至少一种。可选的,当虚拟场景为三维虚拟场景时,虚拟对象是基于动画骨骼技术创建的三维立体模型。每个虚拟对象在三维虚拟场景中具有自身的形状、体积以及朝向,并占据三维虚拟场景中的一部分空间。当虚拟场景为二维虚拟场景时,虚拟对象是基于平面技术创建的二维模型。

随着科学技术的发展,各种各样的终端设备已经出现在人们的日常生活中,人们可以通过终端设备进行工作、娱乐、学习等。其中,终端设备可以通过运行应用程序在显示屏中展示出虚拟环境,又或者,该虚拟场景也可以由服务器生成,即服务器执行或者调用存储器中存储的程序代码和数据生成虚拟场景的展示数据,并将虚拟场景的展示数据通过有线或无线网络发送给终端设备,终端设备根据服务器下发的展示数据,通过显示屏展示该虚拟场景。在展示虚拟场景的过程中,用户可以通过终端中的触控系统,或者,通过外接设备中的键盘按键、鼠标、游戏手柄按键以及游戏摇杆,控制虚拟对象,终端设备检测到用户与虚拟场景进行交互时执行响应的控制操作。

可选的,上述游戏摇杆包括实体摇杆和虚拟摇杆,实体遥杆是实体游戏手柄上,用来控制虚拟对象移动、瞄准的操作设备;虚拟摇杆是触摸屏幕上显示出的虚拟操作控件,用户触碰到屏幕中的该虚拟操作控件并拖拽后,可以控制虚拟对象的移动。

请参考图1,其示出了本申请一示例性实施例提供的一种虚拟场景的场景画面示意图。如图1所示,在该终端设备100中包含了虚拟对象110和虚拟场景的环境画面120。

其中,虚拟对象110可以是终端设备被用户控制的当前虚拟对象,用户可以通过控制虚拟对象110与虚拟场景的环境画面120进行交互,比如,控制虚拟对象110在环境画面120中移动。

可选的,上述终端设备100是可以安装有摄像头的设备。比如,该终端设备可以是手机、平板电脑、电子书阅读器、智能眼镜、智能手表、MP3播放器(Moving Picture ExpertsGroup Audio Layer III,动态影像专家压缩标准音频层面3)、MP4(Moving PictureExperts Group Audio Layer IV,动态影像专家压缩标准音频层面4)播放器、笔记本电脑、膝上型便携计算机和台式计算机等等。

可选的,上述终端设备100还可以与服务器之间存在通信网络连接,该通信网络是有线网络或无线网络。即,终端设备通过可以通过接收服务器发送的图像数据,将该图像数据展示在显示屏中。

可选的,上述的无线网络或有线网络使用标准通信技术和/或协议。网络通常为因特网、但也可以是任何网络,包括但不限于局域网(Local Area Network,LAN)、城域网(Metropolitan Area Network,MAN)、广域网(Wide Area Network,WAN)、移动、有线或者无线网络、专用网络或者虚拟专用网络的任何组合。在一些实施例中,使用包括超文本标记语言(Hyper Text Mark-up Language,HTML)、可扩展标记语言(Extensible MarkupLanguage,XML)等的技术和/或格式来代表通过网络交换的数据。此外还可以使用诸如安全套接字层(Secure Socket Layer,SSL)、传输层安全(Transport Layer Security,TLS)、虚拟专用网络(Virtual Private Network,VPN)、网际协议安全(Internet ProtocolSecurity,IPsec)等常规加密技术来加密所有或者一些链路。在另一些实施例中,还可以使用定制和/或专用数据通信技术取代或者补充上述数据通信技术。

在相关技术中,用户在控制上述图1中的虚拟对象110移动时,就可以通过键盘、鼠标、游戏手柄按键以及游戏摇杆等输入设备控制虚拟对象110在虚拟场景中移动(例如,以通过键盘和鼠标控制虚拟对象110移动为例,用户可以通过键盘中的W、A、S、D四个按键控制虚拟对象前后左右移动,并通过鼠标控制虚拟对象110面向的方向);或者,若终端的屏幕支持触控操作,且虚拟场景的场景画面120中包含虚拟控制按钮,则用户触控该虚拟控制按钮时,虚拟对象110可以在虚拟场景中,根据触控点相对于虚拟控制按钮的中心的方向进行移动。

上述在对虚拟场景中的虚拟对象进行控制时,终端设备直接将用户通过键盘、鼠标、游戏手柄等输入设备控制做出的移动输入指令,转化为用户对应的虚拟对象的移动参数,从而控制虚拟对象移动。对于这类虚拟场景的操作的用户来说,用户在长时间操作过程中,用户的肢体(比如手指、胳膊等)容易劳累,容易造成用户对终端设备做出的移动输入指令不及时,导致终端设备控制虚拟对象移动的效率低。

为了避免上述技术方案中存在的问题,提高终端设备对虚拟对象的控制效率。本申请提供了一种虚拟对象的控制方法,可以实现终端设备主动控制摄像头采集用户的第一面部图像,并基于该面部图像控制虚拟对象的移动,提高控制虚拟对象移动的效率。

请参考图2,其示出了本申请一示例性实施例提供的一种虚拟对象的控制方法的方法流程图。该方法可以用于图1所示的终端设备中,该终端设备包括摄像头,如图2所示,该虚拟对象的控制方法可以包括如下几个步骤。

步骤201,通过摄像头采集第一面部图像。

可选的,第一面部图像可以是摄像头对处于终端设备前的用户进行拍摄得到的图像。比如,终端设备在展示应用界面之后,在应用界面中展示有虚拟对象,此时,终端设备可以调用摄像头并且对进行拍摄,采集到包含用户的图像,从而得到第一面部图像。

步骤202,对第一面部图像进行图像识别,提取第一面部图像中的眼睛图像区域的图像特征。

可选的,终端设备可以对获取到的第一面部图像进行识别,提取第一面部图像中的眼睛图像区域的图像特征。其中,该识别过程可以由预先设置的机器学习模型执行,通过对该机器学习模型输入第一面部图像,机器学习模型可以输出该第一面部图像中的眼睛图像区域的图像特征,从而提取到眼睛图像区域的图像特征。

可选的,眼睛图像区域的图像特征可以包括眼睛图像区域的轮廓信息、眼睛图像区域的面积大小、眼睛图像区域的像素点数量、眼睛图像区域的像素值等。请参考图3,其示出了本申请一示例性实施例涉及的一种第一面部图像的图像示意图。如图3所示,在第一面部图像300中包含了眼睛图像区域310。终端设备通过上述图像识别,可以提取到眼睛图像区域310中的图像特征。

步骤203,根据图像特征,确定第一偏移位置信息,第一偏移位置信息包括眼睛瞳孔在眼睛图像区域的当前位置相对于原始位置的偏移距离和偏移方向,原始位置是眼睛图像区域中眼睛轮廓的中心位置。

其中,终端设备根据得到的眼睛图像区域的图像特征,确定出眼睛瞳孔在眼睛图像区域的当前位置相对于原始位置的偏移距离和偏移方向。可选的,原始位置可以通过上述获取的图像特征中的眼睛轮廓确定出来,眼睛瞳孔可以通过上述获取到的图像特征中的像素值确定出来。终端设备通过图像特征得到原始位置和当前位置之后,就可以根据原始位置和当前位置确定出两者之间的偏移距离和偏移方向。

步骤204,根据第一偏移位置信息,控制终端设备中展示的虚拟对象在应用界面中移动。

可选的,终端设备根据上述得到的第一偏移位置信息,控制虚拟对象在应用界面中移动。其中,终端设备控制虚拟对象在应用界面中移动的方向和距离可以分别与上述偏移方向和偏移距离对应。即,虚拟对象的移动方向可以与上述偏移方向之间可以有第一对应关系,虚拟对象的移动距离可以与上述偏移距离之间可以有第二对应关系,终端设备可以根据该第一对应关系获取到虚拟对象在应用界面中应该移动的方向,还可以根据该第二对应关系获取到虚拟对象在应用界面中应该移动的距离,从而控制虚拟对象移动。可选的,第一对应关系和第二对应关系可以由开发人员预先设置,也可以根据采集的第一面部图像获取。

综上所述,本申请终端设备通过摄像头采集第一面部图像;对第一面部图像进行图像识别,提取第一面部图像中的眼睛图像区域的图像特征;根据图像特征,确定第一偏移位置信息,第一偏移位置信息包括眼睛瞳孔在眼睛图像区域的当前位置相对于原始位置的偏移距离和偏移方向,原始位置是眼睛图像区域中眼睛轮廓的中心位置;根据第一偏移位置信息,控制终端设备中展示的虚拟对象在应用界面中移动。终端设备可以根据采集到的第一面部图像获取到眼睛瞳孔的第一偏移位置信息,根据该第一偏移位置信息来控制虚拟对象进行移动,不需要用户手动操作,实现了根据用户的眼睛瞳孔位置来控制虚拟对象,提高了对虚拟对象的控制效率。

在一种可能实现的方式中,在终端设备获取到眼睛瞳孔在眼睛图像区域中的原始位置之后,还可以将该原始位置作为坐标原点建立目标坐标系,基于该目标坐标系来获取第一偏移位置信息。请参考图4,其示出了本申请一示例性实施例提供的一种虚拟对象的控制方法的方法流程图。该方法可以用于图1所示的终端设备中,该终端设备包括摄像头,如图4所示,该虚拟对象的控制方法可以包括如下几个步骤。

步骤401,通过摄像头采集第一面部图像。

可选的,用户在打开终端设备中的应用程序之后,终端设备可以在显示屏中展示对应的应用界面,该应用界面中可以展示有虚拟对象,用户在控制虚拟对象进行移动时,需要让摄像头拍摄到自己的面部图像,从而使得摄像头进行后续步骤的执行。

请参考图5,其示出了本申请一示例性实施例涉及的一种应用界面的界面示意图。如图5所示,在应用界面500中,包含了虚拟对象501,虚拟环境画面502。其中,该应用界面500可以是用户打开第一应用程序后在终端设备中展示的,此时用户如果想要控制虚拟对象501在虚拟场景画面502中移动,可以通过看向虚拟场景画面502中不同的位置,让终端设备采集到自己的面部图像,从而进行后续步骤,使得虚拟对象501在虚拟场景画面502中移动。例如,在展示上述图5所示的应用界面之后,终端设备可以在间隔预设时长之后进行图像采集,采集到的图像即为第一面部图像。其中,该预设时长可以由开发人员或者运维人员预先设置在终端设备中。

步骤402,对第一面部图像进行图像识别,提取第一面部图像中的眼睛图像区域的图像特征。

可选的,终端设备可以将采集到的第一面部图像输入至图像识别模型中,通过该图像识别模型对第一面部图像进行识别,并提取第一面部图像中的眼睛图像区域的图像特征。其中,该图像识别模型可以通过各个包含用户面部的样本图像进行训练,从而得到通过输入一个面部图像,可以提取到该面部图像中的眼睛图像区域的图像特征的机器学习模型。

可选的,终端设备在提取第一面部图像中的眼睛图像区域的图像特征过程中,可以先对第一面部图像进行图像识别,获取到第一面部图像中的眼睛图像区域,再对该眼睛图像区域进行提取,获取到对应的眼睛图像区域的图像特征。例如,上述图3所示,终端设备可以从第一面部图像中识别出眼睛图像区域,并对该区域进行特征提取,得到眼睛图像区域中的图像特征。

可选的,在上述识别过程中,如果发现采集的第一面部图像中未包含眼睛图像区域,终端设备还可以在应用界面中展示反馈信息,该反馈信息用于指示用户将面部对准终端设备的摄像头,从而重新进行第一面部图像的采集。例如,终端设备通过识别后发现第一面部图像中未包含眼睛图像区域,终端设备在应用界面中展示“请对准摄像头”的反馈信息。

步骤403,根据图像特征,确定第一偏移位置信息,第一偏移位置信息包括眼睛瞳孔在眼睛图像区域的当前位置相对于原始位置的偏移距离和偏移方向,原始位置是眼睛图像区域中眼睛轮廓的中心位置。

可选的,终端设备通过上述得到的图像特征可以确定出眼睛瞳孔在眼睛图像区域的当前位置相对于原始位置的偏移距离和偏移方向,得到第一偏移位置信息。

在一种可能实现的方式中,终端设备可以根据图像特征,获取眼睛轮廓信息以及眼睛瞳孔在眼睛图像区域的当前位置;并根据眼睛轮廓信息,确定原始位置;根据原始位置以及眼睛瞳孔在眼睛图像区域的当前位置,获取第一偏移位置信息。

例如,终端设备可以从上述图像特征中获取到眼睛轮廓信息,在终端设备获取到眼睛轮廓信息之后,根据该眼睛轮廓信息,获取眼睛轮廓信息的中心位置,将中心位置确定为原始位置。比如,终端设备在得到眼睛轮廓信息之后,做眼睛轮廓信息的外接矩形,将外接矩形的中心位置确定为原始位置。

可选的,终端设备还可以根据图像特征中眼睛图像区域的像素值获取到眼睛瞳孔在眼睛图像区域的当前位置。例如,由于通常眼睛瞳孔都是黑色,在获取到眼睛瞳孔在眼睛图像区域的当前位置的过程中,终端设备可以从眼睛图像区域的各个像素值中选出黑色对应的像素值,从而将该位置确定为当前位置。

在一种可能实现的方式中,终端设备在上述获取到原始位置之后,还可以将原始位置作为坐标原点建立目标坐标系;根据眼睛瞳孔在眼睛图像区域的当前位置与原始位置之间的相对位置关系,将当前位置转换为在目标坐标系下的第一位置坐标;根据第一位置坐标,获取第一偏移位置信息。

例如,请参考图6,其示出了本申请一示例性实施例涉及的一种目标坐标系的结构示意图。如图6所示,在目标坐标系600中,包含了第一坐标轴601,第二坐标轴602,第三坐标轴603,坐标原点604,第一位置坐标605。其中,该坐标原点604是根据上述原始位置确定的,第一位置坐标605是终端设备根据眼睛图像中瞳孔的当前位置与原始位置之间的相对位置关系转换至目标坐标系下的。可选的,终端设备可以在上述目标坐标系中对第一面部图像中的眼睛进行建模,得到眼球模型,基于该眼球模型,模拟眼球的转动方向,使得眼球转动后,瞳孔所在位置在摄像头拍摄方向上与终端设备从第一面部图像获取到的眼睛瞳孔的当前位置相同,从而将此时模拟转动后的位置坐标作为第一位置坐标。终端设备可以根据第一位置坐标以及原点,获取到第一位置坐标相对于原点的第一向量,将该第一向量作为第一偏移位置信息。

例如,在第一面部图像中,眼睛瞳孔的当前位置距离原始位置在横向上相差30个像素点,在纵向上相差50个像素点,终端设备在上述建立的目标坐标系中模拟出眼球转动后,使得转动后的位置坐标与原点坐标之间计算的距离在摄像头拍摄方向上看来,横向上也相差30个像素点,在纵向上也相差50个像素点,从而确定出第一位置坐标。

可选的,上述目标坐标系可以是球坐标系,也可以是直角坐标系,图6所示的坐标系是球坐标系时,第一位置坐标可以是(r,θ,Φ),其中,r表示眼球半径,θ表示天顶角,Φ表示方位角。图6所示的坐标系是球坐标系时,第一位置坐标可以是(a,b,c),其中,a表示第一坐标轴的坐标,b表示第二坐标轴的坐标,c表示第三坐标轴的坐标。

步骤404,获取采集第一面部图像时第一面部与摄像头之间的采集距离。

可选的,第一面部就是在摄像头前的用户的面部,终端设备还可以获取到用户的面部与摄像头之间的采集距离。例如,终端设备可以通过距离传感器来获取拍摄第一面部图像时用户的面部与摄像头之间的距离,或者,终端设备还可以通过获取到的第一面部图像的眼睛图像区域大小,根据该眼睛图像区域大小,判断用户距离摄像头的距离。

其中,终端设备通过上述获取到的图像特征中眼睛图像区域的像素点数量,计算眼睛图像区域在第一面部图像中所占的面积比值,根据该面积比值,获取用户的眼睛距离摄像头的距离。例如,上述图像特征中眼睛图像区域的像素点数量600个,第一面部图像的总像素点数量是3000个,终端设备计算眼睛图像区域在第一面部图像中所占的面积比值是0.2,根据该面积比值获取到用户的眼睛距离摄像头的距离。可选的,上述面积比值与采集距离之间具有对应关系,该对应关系如下表1所示。

表1

如上述表1所示,终端设备可以根据面积比值来查询表1,从而得到面积比值对应的采集距离。

步骤405,根据采集距离,确定第一转换关系,第一转换关系是偏移距离与虚拟对象在应用界面中移动的距离之间的转换关系。

即,得到第一偏移位置信息之后,在对虚拟对象进行控制时,还需要将第一偏移位置信息转化到虚拟对象在应用界面中的移动距离,从而控制虚拟对象移动相应长度的距离。在本申请中,终端设备可以根据上述获取到的采集距离,确定出第一转换关系,从而使得终端设备可以基于该第一转换关系将第一偏移位置信息转化到虚拟对象在应用界面中的移动距离。例如,采集距离与第一转换关系之间也具有对应关系,该对应关系如下表2所示。

表2

如上述表2所示,终端设备可以根据采集距离来查询表2,从而得到采集距离对应的采集距离。例如,终端设备获取到的采集距离是距离二,可以从上述表2中获取到对应的转换关系二,该转换关系二就是第一转换关系。

步骤406,根据偏移距离以及第一转换关系,获取目标移动距离。

其中,目标移动距离就是上述虚拟对象在应用界面中需要移动的距离。比如,上述第一转换关系是1:10,终端设备根据第一偏移位置信息中的偏移距离,按照1:10的换算关系,获取到目标移动距离。即,如果第一偏移位置信息中的偏移距离是10,那么终端设备根据第一偏移位置信息中的偏移距离,按照1:10的换算关系,获取到目标移动距离是100。

步骤407,控制虚拟对象在应用界面中按照偏移方向移动目标移动距离。

可选的,终端设备控制虚拟对象在应用界面中按照偏移方向,将虚拟对象移动目标移动距离。其中,如果虚拟对象所在的虚拟环境是三维场景或者2.5维场景,上述偏移方向就是虚拟对象的移动方向,如果虚拟对象所在的虚拟环境是二维场景,则终端设备可以将第一偏移位置信息在摄像头拍摄的方向上进行投影,将投影后的方向作为偏移方向,控制虚拟对象在应用界面中按照该偏移方向移动。

例如,请参考图7,其示出了本申请一示例性实施例涉及的一种控制虚拟对象移动的界面示意图。如图7所示,在应用界面700中包含了虚拟对象701,偏移方向702,目标移动距离703,该虚拟场景是2.5维的,终端设备根据第一偏移位置信息以及第一转换关系获取到目标移动距离之后,可以控制虚拟对象701按照偏移方向702移动目标移动距离703的长度,实现虚拟对象的控制。

在一种可能实现的方式中,虚拟对象在应用界面中有起始位置,在本步骤之前,终端设备可以检测虚拟对象在应用界面中所处的位置,当虚拟对象处于起始位置时,启动计时器;并在摄像头采集第一面部图像时,获取计时器的时长;根据第一偏移位置信息以及计时器的时长,获取移动速度;在本步骤控制虚拟对象移动时,控制虚拟对象按照获取到的移动速度在应用界面中移动。其中,该起始位置可以由应用程序的开发人员或者运维人员预先设置。

比如,终端设备预先设置有计时器,终端设备可以通过应用程序实时获取到虚拟对象在应用界面中的位置,当虚拟对象在应用界面中的位置是起始位置时,启动自身设置的计时器,获取到第一面部图像时,记录计时器的时长,在上述获取到第一偏移位置信息之后,根据偏移距离以及计时器的时长,计算出需要控制虚拟对象移动时施加的移动速度,控制虚拟对象按照获取到的移动速度在应用界面中移动。例如,当终端设备获取到第一面部图像时,计时器的时长是1秒,通过上述步骤获取到的偏移距离是3厘米,那么,终端设备可以用偏移距离除以时长得到移动速度3厘米每秒。

在一种可能实现的方式中,在根据第一偏移位置信息以及计时器的时长,获取移动速度之前,终端设备还可以获取第一系数,第一系数是瞳孔移动的速度与虚拟对象在应用界面中移动的速度之间换算的系数;获取移动速度时,根据第一偏移位置信息中包括的偏移距离以及计时器的时长,获取第一速度;根据第一速度以及第一系数,获取移动速度。其中,终端设备获取第一系数可以根据上述获取的面积比值获取,也可以根据上述获取的采集距离获取,也可以根据上述第一转换关系获取。

例如,终端设备在计算移动速度时,还可以将偏移距离除以时长得到的计算结果乘以第一系数,将乘以第一系数的计算结果作为移动速度。以终端设备根据第一转换关系获取第一系数为例,该第一系数与上述第一转换关系具有对应关系。请参考表3,其示出了本申请一示例性实施例涉及的一种第一转换关系与第一系数的对应关系表。

表3

如表3所示,终端设备可以在上述得到第一转换关系后,还可以查询该表3,得到第一转换关系对应的第一系数,在本步骤中计算移动速度时,以偏移距离除以时长得到的计算结果再乘以第一系数,得到移动速度。

在一种可能实现的方式中,虚拟对象在应用界面中有目标位置,在控制终端设备中展示的虚拟对象在应用界面中移动之后,终端设备可以继续检测虚拟对象在应用界面中的位置是否处于目标位置,当虚拟对象处于目标位置时,控制虚拟对象返回至起始位置,并重置计时器;当虚拟对象未处于目标位置时,在应用界面中展示第一提示信息,第一提示信息用于指示眼睛的转动方向。其中,该目标位置也可以由应用程序的开发人员或者运维人员预先设置。

例如,请参考图8,其示出了本申请一示例性实施例涉及的一种应用界面的界面示意图。在应用界面800中,包含了起始位置801,目标位置802,虚拟对象803。在终端设备控制虚拟对象在应用界面中移动之后,如果虚拟对象处于目标位置802处,终端设备控制虚拟对象返回至起始位置801,并重置计时器;如果虚拟对象不处于目标位置802处,终端设备还可以展示在应用界面中展示第一提示信息。

请参考图9,其示出了本申请一示例性实施例涉及图8的一种应用界面的界面示意图。在应用界面900中,包含了起始位置901,目标位置902,虚拟对象903,第一提示信息904。在终端设备控制虚拟对象在应用界面中移动之后,如果虚拟对象不处于目标位置802处,终端设备还可以展示在应用界面中展示第一提示信息904,从而提示用户将眼睛继续转动。

在一种可能实现的方式中,终端设备可以展示第一选择界面,第一选择界面中包含至少两种运动方式,至少两种运动方式是虚拟对象在应用界面中移动时的运动方式;终端设备通过摄像头在一定时长内采集多帧第二面部图像;对多帧第二面部图像进行识别,并获取在一定时长内的眨眼次数;根据眨眼次数,从至少两种运动方式中获取与眨眼次数对应的目标运动方式;并控制虚拟对象按照目标运动方式在应用界面中移动。

例如,请参考图10,其示出了本申请一示例性实施例涉及的一种第一选择界面的界面示意图。在第一选择界面1000中包含了第一运动方式1001,第二运动方式1002。可选的,该第一选择界面可以是用户通过触发对应的控件展示的,也可以是进入上述包含虚拟对象的应用界面之前终端设备自动弹出的,本申请对此并不加以限定。在图10中,终端设备通过拍摄多帧面部图像来获取用户的眨眼次数,根据眨眼次数从第一运动方式1001,第二运动方式1002中选择出与眨眼次数对应的运动方式。例如,图10中第一运动方式对应的眨眼次数小于第一阈值,第二运动方式对应的眨眼次数不小于第一阈值,终端设备获取到眨眼次数之后,通过眨眼次数与第一阈值之间的大小关系,获取对应的运动方式。

可选的,上述第一运动方式可以是直线运动方式,第二运动方式可以是跳跃式运动方式。请参考图11,其示出了本申请一示例性实施例涉及的一种运动方式的示意图。如图11所示,其中包含了直线运动方式的运动轨迹1101,跳跃式运动方式的运动轨迹1102。其中,上述几种运动方式可以由开发人员预先设置在终端设备中。

综上所述,本申请终端设备通过摄像头采集第一面部图像;对第一面部图像进行图像识别,提取第一面部图像中的眼睛图像区域的图像特征;根据图像特征,确定第一偏移位置信息,第一偏移位置信息包括眼睛瞳孔在眼睛图像区域的当前位置相对于原始位置的偏移距离和偏移方向,原始位置是眼睛图像区域中眼睛轮廓的中心位置;根据第一偏移位置信息,控制终端设备中展示的虚拟对象在应用界面中移动。终端设备可以根据采集到的第一面部图像获取到眼睛瞳孔的第一偏移位置信息,根据该第一偏移位置信息来控制虚拟对象进行移动,不需要用户手动操作,实现了根据用户的眼睛瞳孔位置来控制虚拟对象,提高了对虚拟对象的控制效率。

另外,通过建立目标坐标系获取第一偏移位置信息,并基于获取到的用户距离摄像头的距离,确定第一转换关系,获取虚拟对象在应用界面中需要移动的距离,可以提高终端设备控制虚拟对象移动的准确性。

另外,通过计时器的时长来获取虚拟对象的移动速度,通过眨眼次数获取虚拟对象的运动方式,可以提高在应用界面中控制虚拟对象移动时的灵活性,增加应用界面展示的多样性。

下面,以上述终端设备是平板电脑,虚拟对象所处的虚拟环境是二维环境,平板电脑通过自身的摄像头获取第一面部图像为例,对上述图2和图4所示的实施例进行举例介绍。请参考图12,其示出了本申请一示例性实施例提供的一种虚拟对象的控制方法的方法流程图。该方法可以用于平板电脑中,该平板电脑包括摄像头,如图12所示,该虚拟对象的控制方法可以包括如下几个步骤。

步骤1201,平板电脑展示第一应用界面。

可选的,用户通过点击平板电脑中应用程序的图标,使得平板电脑中展示第一应用界面。其中,该第一应用界面可以参照上述几种第一应用界面的形式,此处不再赘述。

步骤1202,平板电脑通过摄像头采集第一面部图像。

可选的,当平板电脑获取到虚拟对象在初始位置时,可以通过摄像头采集第一面部图像。

步骤1203,平板电脑对第一面部图像进行图像识别,提取第一面部图像中的眼睛图像区域的图像特征。

可选的,该步骤中实现的细节可以参照上述步骤402中的描述,此处不再赘述。

步骤1204,平板电脑根据图像特征,确定第一偏移位置信息,第一偏移位置信息包括眼睛瞳孔在眼睛图像区域的当前位置相对于原始位置的偏移距离和偏移方向,原始位置是眼睛图像区域中眼睛轮廓的中心位置。

可选的,该步骤中实现的细节可以参照上述步骤403中的描述,此处不再赘述。

步骤1205,根据第一偏移位置信息,控制终端设备中展示的虚拟对象在应用界面中沿着直线移动。

可选的,该步骤中实现的细节可以参照上述步骤407中的描述,此处不再赘述。

综上所述,本申请平板电脑通过摄像头采集第一面部图像;对第一面部图像进行图像识别,提取第一面部图像中的眼睛图像区域的图像特征;根据图像特征,确定第一偏移位置信息,第一偏移位置信息包括眼睛瞳孔在眼睛图像区域的当前位置相对于原始位置的偏移距离和偏移方向,原始位置是眼睛图像区域中眼睛轮廓的中心位置;根据第一偏移位置信息,控制平板电脑中展示的虚拟对象在应用界面中移动。平板电脑可以根据采集到的第一面部图像获取到眼睛瞳孔的第一偏移位置信息,根据该第一偏移位置信息来控制虚拟对象进行移动,不需要用户手动操作,实现了根据用户的眼睛瞳孔位置来控制虚拟对象,提高了对虚拟对象的控制效率。

下述为本申请装置实施例,可以用于执行本申请方法实施例。对于本申请装置实施例中未披露的细节,请参照本申请方法实施例。

请参考图13,其示出了本申请一示例性实施例提供的虚拟对象的控制装置的结构框图。该虚拟对象的控制装置1300可以用于图1所示的终端设备中,以实现图2,图4或者图12所示实施例提供的方法中由终端设备执行的全部或者部分步骤。该终端设备包括摄像头,该虚拟对象的控制装置1300可以包括如下几个模块:

图像采集模块1301,用于通过所述摄像头采集第一面部图像;

特征提取模块1302,用于对所述第一面部图像进行图像识别,提取所述第一面部图像中的眼睛图像区域的图像特征;

信息确定模块1303,用于根据所述图像特征,确定第一偏移位置信息,所述第一偏移位置信息包括眼睛瞳孔在所述眼睛图像区域的当前位置相对于原始位置的偏移距离和偏移方向,所述原始位置是所述眼睛图像区域中眼睛轮廓的中心位置;

对象控制模块1304,用于根据所述第一偏移位置信息,控制所述终端设备中展示的虚拟对象在所述应用界面中移动。

可选的,所述信息确定模块1303,包括:第一获取单元,第一确定单元和第二获取单元;

所述第一获取单元,用于根据所述图像特征,获取眼睛轮廓信息以及眼睛瞳孔在所述眼睛图像区域的当前位置;

所述第一确定单元,用于根据所述眼睛轮廓信息,确定原始位置;

所述第二获取单元,用于根据所述原始位置以及所述眼睛瞳孔在所述眼睛图像区域的当前位置,获取第一偏移位置信息。

可选的,所述第二获取单元,包括:坐标系建立子单元,坐标转换子单元和信息获取子单元;

所述坐标系建立子单元,用于将所述原始位置作为坐标原点建立目标坐标系;

所述坐标转换子单元,用于根据所述眼睛瞳孔在所述眼睛图像区域的当前位置与所述原始位置之间的相对位置关系,将所述当前位置转换为在所述目标坐标系下的第一位置坐标;

所述信息获取子单元,用于根据所述第一位置坐标,获取所述第一偏移位置信息。

可选的,所述装置还包括:

距离获取模块,用于在所述对象控制模块1304之前,获取采集所述第一面部图像时第一面部与所述摄像头之间的采集距离;

关系确定模块,用于根据所述采集距离,确定第一转换关系,所述第一转换关系是所述偏移距离与所述虚拟对象在所述应用界面中移动的距离之间的转换关系;

所述对象控制模块1304,用于根据所述第一偏移位置信息以及所述第一转换关系,获取目标移动距离;控制所述虚拟对象在所述应用界面中按照所述偏移方向移动所述目标移动距离。

可选的,所述虚拟对象在所述应用界面中有起始位置,所述装置还包括:

启动模块,用于在所述对象控制模块1304根据所述第一偏移位置信息,控制所述终端设备中展示的虚拟对象在所述应用界面中移动之前,当所述虚拟对象处于所述起始位置时,启动计时器;

时长获取模块,用于通过所述摄像头采集所述第一面部图像时,获取所述计时器的时长;

速度获取模块,用于根据所述第一偏移位置信息以及所述计时器的时长,获取移动速度;

所述对象控制模块1304,用于根据所述第一偏移位置信息,控制所述虚拟对象按照所述移动速度在所述应用界面中移动。

可选的,所述装置还包括:

系数获取模块,用于在所述速度获取模块根据所述第一偏移位置信息以及所述计时器的时长,获取移动速度之前,获取第一系数,所述第一系数是瞳孔移动的速度与所述虚拟对象在所述应用界面中移动的速度之间换算的系数;

所述速度获取模块,用于根据所述第一偏移位置信息中包括的所述偏移距离以及所述计时器的时长,获取第一速度;根据所述第一速度以及所述第一系数,获取所述移动速度。

可选的,所述装置还包括:

界面展示模块,用于在所述图像采集模块1301通过所述摄像头采集第一面部图像之前,展示第一选择界面,所述第一选择界面中包含至少两种运动方式,所述至少两种运动方式是所述虚拟对象在所述应用界面中移动时所述虚拟对象的运动方式;

多帧采集模块,用于通过所述摄像头在一定时长内采集多帧第二面部图像;

次数获取模块,用于对所述多帧第二面部图像进行识别,并获取在所述一定时长内的眨眼次数;

运动方式确定模块,用于根据所述眨眼次数,从所述至少两种运动方式中获取与所述眨眼次数对应的目标运动方式;

所述对象控制模块1304,用于根据所述第一偏移位置信息,控制所述虚拟对象按照所述目标运动方式在所述应用界面中移动。

综上所述,本申请终端设备通过摄像头采集第一面部图像;对第一面部图像进行图像识别,提取第一面部图像中的眼睛图像区域的图像特征;根据图像特征,确定第一偏移位置信息,第一偏移位置信息包括眼睛瞳孔在眼睛图像区域的当前位置相对于原始位置的偏移距离和偏移方向,原始位置是眼睛图像区域中眼睛轮廓的中心位置;根据第一偏移位置信息,控制终端设备中展示的虚拟对象在应用界面中移动。终端设备可以根据采集到的第一面部图像获取到眼睛瞳孔的第一偏移位置信息,根据该第一偏移位置信息来控制虚拟对象进行移动,不需要用户手动操作,实现了根据用户的眼睛瞳孔位置来控制虚拟对象,提高了对虚拟对象的控制效率。

请参考图14,其示出了本申请一示例性实施例公开的一种终端设备的结构示意图。如图14所示,可以包括:射频(Radio Frequency,RF)电路1410、存储器1420、输入单元1430、显示单元1440、传感器1450、音频电路1460、WiFi模块1470、处理器1480、以及电源1490等部件。在上述实施例中,该终端设备是可以作为按摩设备,也可以作为目标设备。本领域技术人员可以理解,图14中示出的终端设备结构并不构成对终端设备的限定,可以包括比图示更多或更少的部件,或者组合某些部件,或者不同的部件布置。

下面结合图14对终端设备的各个构成部件进行介绍:

RF电路1410可用于收发信息或通话过程中,信号的接收和发送,特别地,将基站的下行信息接收后,给处理器1480处理;另外,将设计上行的数据发送给基站。通常,RF电路1410包括但不限于天线、至少一个放大器、收发信机、耦合器、低噪声放大器(Low NoiseAmplifier,LNA)、双工器等。此外,RF电路1410还可以通过无线通信与网络和其他设备通信。上述无线通信可以使用任一通信标准或协议,包括但不限于全球移动通讯系统(GlobalSystem of Mobile communication,GSM)、通用分组无线服务(General Packet RadioService,GPRS)、码分多址(Code Division Multiple Access,CDMA)、宽带码分多址(Wideband Code Division Multiple Access,WCDMA)、长期演进(Long Term Evolution,LTE)、电子邮件、短消息服务(Short Messaging Service,SMS)等。

存储器1420可用于存储软件程序以及模块,处理器1480通过运行存储在存储器1420的软件程序以及模块,从而执行终端设备的各种功能应用以及数据处理。存储器1420可主要包括存储程序区和存储数据区,其中,存储程序区可存储操作系统、至少一个功能所需的应用程序(比如声音播放功能、图像播放功能等)等;存储数据区可存储根据终端设备的使用所创建的数据(比如音频数据、电话本等)等。此外,存储器1420可以包括高速随机存取存储器,还可以包括非易失性存储器,例如至少一个磁盘存储器件、闪存器件、或其他易失性固态存储器件。

输入单元1430可用于接收输入的数字或字符信息,以及产生与终端设备的用户设置以及功能控制有关的键信号输入。具体地,输入单元1430可包括触控面板1431以及其他输入设备1432。触控面板1431,也称为触摸屏,可收集用户在其上或附近的触摸操作(比如用户使用手指、触笔等任何适合的物体或附件在触控面板1431上或在触控面板1431附近的操作),并根据预先设定的程式驱动相应的连接装置。可选的,触控面板1431可包括触摸检测装置和触摸控制器两个部分。其中,触摸检测装置检测用户的触摸方位,并检测触摸操作带来的信号,将信号传送给触摸控制器;触摸控制器从触摸检测装置上接收触摸信息,并将它转换成触点坐标,再送给处理器1480,并能接收处理器1480发来的命令并加以执行。此外,可以采用电阻式、电容式、红外线以及表面声波等多种类型实现触控面板1431。除了触控面板1431,输入单元1430还可以包括其他输入设备1432。具体地,其他输入设备1432可以包括但不限于物理键盘、功能键(比如音量控制按键、开关按键等)、轨迹球、鼠标、操作杆等中的一种或多种。

显示单元1440可用于显示由用户输入的信息或提供给用户的信息以及终端设备的各种菜单。显示单元1440可包括显示面板1441,可选的,可以采用液晶显示器(LiquidCrystal Display,LCD)、有机发光二极管(Organic Light-Emitting Diode,OLED)等形式来配置显示面板1441。进一步的,触控面板1431可覆盖显示面板1441,当触控面板1431检测到在其上或附近的触摸操作后,传送给处理器1480以确定触摸事件的类型,随后处理器1480根据触摸事件的类型在显示面板1441上提供相应的视觉输出。虽然在图14中,触控面板1431与显示面板1441是作为两个独立的部件来实现终端设备的输入和输入功能,但是在某些实施例中,可以将触控面板1431与显示面板1441集成而实现终端设备的输入和输出功能。

终端设备还可包括至少一种传感器1450,比如光传感器、运动传感器以及其他传感器。具体地,光传感器可包括环境光传感器及接近传感器,其中,环境光传感器可根据环境光线的明暗来调节显示面板1441的亮度,接近传感器可在终端设备移动到耳边时,关闭显示面板1441和/或背光。作为运动传感器的一种,加速计传感器可检测各个方向上(一般为三轴)加速度的大小,静止时可检测出重力的大小及方向,可用于识别终端设备姿态的应用(比如横竖屏切换、相关游戏、磁力计姿态校准)、振动识别相关功能(比如计步器、敲击)等;至于终端设备还可配置的陀螺仪、气压计、湿度计、温度计、红外线传感器等其他传感器,在此不再赘述。

音频电路1460、扬声器1461,传声器1462可提供用户与终端设备之间的音频接口。音频电路1450可将接收到的音频数据转换后的电信号,传输到扬声器1461,由扬声器1461转换为声音信号输出;另一方面,传声器1462将收集的声音信号转换为电信号,由音频电路1460接收后转换为音频数据,再将音频数据输出处理器1480处理后,经RF电路1410以发送给比如另一终端设备,或者将音频数据输出至存储器1420以便进一步处理。

WiFi属于短距离无线传输技术,终端设备通过WiFi模块1470可以帮助用户收发电子邮件、浏览网页和访问流式媒体等,它为用户提供了无线的宽带互联网访问。虽然图14示出了WiFi模块1470,但是可以理解的是,其并不属于终端设备的必须构成,完全可以根据需要在不改变发明的本质的范围内而省略。

处理器1480是终端设备的控制中心,利用各种接口和线路连接整个终端设备的各个部分,通过运行或执行存储在存储器1420内的软件程序和/或模块,以及调用存储在存储器1420内的数据,执行终端设备的各种功能和处理数据,从而对终端设备进行整体监控。可选的,处理器1480可包括一个或多个处理单元;优选的,处理器1480可集成应用处理器和调制解调处理器,其中,应用处理器主要处理操作系统、用户界面和应用程序等,调制解调处理器主要处理无线通信。可以理解的是,上述调制解调处理器也可以不集成到处理器1480中。

终端设备还包括给各个部件供电的电源1490(比如电池),优选的,电源可以通过电源管理系统与处理器1480逻辑相连,从而通过电源管理系统实现管理充电、放电、以及功耗管理等功能。

尽管未示出,终端设备还可以包括摄像头、蓝牙模块等,在此不再赘述。

本申请实施例公开一种计算机可读存储介质,其存储计算机程序,其中,该计算机程序被处理器执行时实现上述方法实施例中的方法。

本申请实施例公开一种计算机程序产品,该计算机程序产品包括存储了计算机程序的非瞬时性计算机可读存储介质,且该计算机程序可操作来使计算机执行上述方法实施例中的方法。

本申请实施例公开一种应用发布平台,其中,应用发布平台用于发布计算机程序产品,其中,当计算机程序产品在计算机上运行时,使得计算机执行上述方法实施例中的方法。

应理解,说明书通篇中提到的“一个实施例”或“一实施例”意味着与实施例有关的特定特征、结构或特性包括在本申请的至少一个实施例中。因此,在整个说明书各处出现的“在一个实施例中”或“在一实施例中”未必一定指相同的实施例。此外,这些特定特征、结构或特性可以以任意适合的方式结合在一个或多个实施例中。本领域技术人员也应该知悉,说明书中所描述的实施例均属于可选实施例,所涉及的动作和模块并不一定是本申请所必须的。

在本申请的各种实施例中,应理解,上述各过程的序号的大小并不意味着执行顺序的必然先后,各过程的执行顺序应以其功能和内在逻辑确定,而不应对本申请实施例的实施过程构成任何限定。

上述作为分离部件说明的单元可以是或者也可以不是物理上分开的,作为单元显示的部件可以是或者也可以不是物单元,即可位于一个地方,或者也可以分布到多个网络单元上。可根据实际的需要选择其中的部分或全部单元来实现本实施例方案的目的。

另外,在本申请各实施例中的各功能单元可以集成在一个处理单元中,也可以是各个单元单独物理存在,也可以两个或两个以上单元集成在一个单元中。上述集成的单元既可以采用硬件的形式实现,也可以采用软件功能单元的形式实现。

上述集成的单元若以软件功能单元的形式实现并作为独立的产品销售或使用时,可以存储在一个计算机可获取的存储器中。基于这样的理解,本申请的技术方案本质上或者说对现有技术做出贡献的部分或者该技术方案的全部或者部分,可以以软件产品的形式体现出来,该计算机软件产品存储在一个存储器中,包括若干请求用以使得一台计算机设备(可以为个人计算机、服务器或者网络设备等,具体可以是计算机设备中的处理器)执行本申请的各个实施例上述方法的部分或全部步骤。

本领域普通技术人员可以理解上述实施例的各种方法中的全部或部分步骤是可以通过程序来指令相关的硬件来完成,该程序可以存储于一计算机可读存储介质中,存储介质包括只读存储器(Read-Only Memory,ROM)、随机存储器(Random Access Memory,RAM)、可编程只读存储器(Programmable Read-only Memory,PROM)、可擦除可编程只读存储器(Erasable Programmable Read Only Memory,EPROM)、一次可编程只读存储器(One-time Programmable Read-Only Memory,OTPROM)、电子抹除式可复写只读存储器(Electrically-Erasable Programmable Read-Only Memory,EEPROM)、只读光盘(CompactDisc Read-Only Memory,CD-ROM)或其他光盘存储器、磁盘存储器、磁带存储器、或者能够用于携带或存储数据的计算机可读的任何其他介质。

以上对本申请实施例公开的一种虚拟对象的控制方法、装置、终端设备以及存储介质进行了举例介绍,本文中应用了个例对本申请的原理及实施方式进行了阐述,以上实施例的说明只是用于帮助理解本申请的方法及其核心思想;同时,对于本领域的一般技术人员,依据本申请的思想,在实施方式及应用范围上均会有改变之处,综上所述,本说明书内容不应理解为对本申请的限制。

- 虚拟对象的控制方法、装置、终端设备及存储介质

- 虚拟场景中的虚拟对象控制方法、装置、设备及存储介质