信息处理方法以及记录介质

文献发布时间:2023-06-19 18:32:25

技术领域

本发明涉及信息处理方法以及记录介质。

背景技术

近年来,已知有如下技术:将由摄像机拍摄到的图像输入到深度神经网络(DNN),通过DNN的推论处理,对图像内的深度、摄像机姿态(拍摄了两张图像的拍摄装置之间的相对移动以及旋转)进行推定(非专利文献1以及非专利文献2)。为了通过以往的(不使用DNN的手动的)推定方法对相对的摄像机姿态进行推定,需要在推定出两张图像之间的对应关系的基础上,将适合于该图像的对应关系的摄像机姿态、深度映射图作为最优化问题来求解,通过上述的使用DNN的方法,能够在图像之间的对应关系、深度的推定中得到更准确的推定结果。

另一方面,在非专利文献1以及非专利文献2所提出的技术中,关于摄像机姿态,与利用以往的(不使用DNN的手动的)推定方法对相对的摄像机姿态进行推定的情况相比,存在无法获得较高的性能这样的问题。

现有技术文献

非专利文献

非专利文献1:Vitor Guizilini,其以外三名,“3D Packing for Self-Supervised Monocular Depth Estimation”,arXiv:1905.02693v4[cs.CV]28Mar 2020(https://arxiv.org/pdf/1905.02693.pdf)

非专利文献2:Clement Godard,其以外三名,“Digging Into Self-SupervisedMonocular Depth Estimation”,arXiv:1806.01260v4[cs.CV]17Aug 2019(https://arxiv.org/pdf/1806.01260.pdf)

非专利文献3:John Flynn,其以外七名,“DeepView:View Synthesis withLearned Gradient Descent”,arXiv:1906.07316v1[cs.CV]18Jun 2019(https://arxiv.org/pdf/1906.07316.pdf)

发明内容

发明所要解决的问题

顺便提及的是,已知有如下技术:在使用了DNN的推论处理中,将以DNN的输出为基础的损失的梯度输入到DNN来进行反复运算,由此将梯度下降法的参数变更所涉及的设计(例如学习系数、标准化等)置换为DNN。非专利文献3提出了如下技术:进行对一个DNN(CNN)输入损失的梯度的运算,根据从多个视点拍摄到的图像生成每个深度的多个图像(多平面图像),并生成在拍摄图像中没有的新视点的合成图像。上述的非专利文献1以及非专利文献2所涉及的技术只不过是通过一次的DNN的运算而对摄像机姿态等进行推定的技术而已,另外,非专利文献3所涉及的技术未考虑对摄像机姿态进行推定的构成。

本发明是鉴于上述问题而完成的,其目的在于提供一种在使用机器学习模型对摄像机姿态进行推定的情况下,能够提高摄像机姿态的推定精度的推定技术。

用于解决问题的手段

根据本发明,提供一种信息处理方法,所述信息处理方法在信息处理装置中执行,其特征在于,

所述信息处理方法包含:

将第一图像或者与所述第一图像成对的第二图像输入到第一机器学习模型而对深度映射图进行预测;

将所述第一图像和所述第二图像输入到第二机器学习模型,对拍摄了所述第一图像和所述第二图像后的拍摄装置的相对移动以及旋转进行预测;

生成将如下图像转换应用于所述第一图像而得到的第一转换图像,该图像转换以预测出的从所述第一图像向所述第二图像的所述相对移动以及旋转、和针对所述第一图像预测出的所述深度映射图为基础;

对包含所述第一转换图像与所述第二图像之间的误差在内的损失进行计算;以及

将与所述相对移动以及旋转相关的所述损失的梯度、所述第一转换图像、所述第一图像以及所述第二图像输入到所述第二机器学习模型,对所述相对移动以及旋转进行反复预测,使包含以新预测的所述相对移动以及旋转为基础的新的所述第一转换图像与所述第二图像之间的误差在内的所述损失收敛。

另外,根据本发明,提供一种记录介质,其保存用于使计算机执行在信息处理装置中执行的信息处理方法的各步骤的程序,其中,

所述信息处理方法包含:

将第一图像或者与所述第一图像成对的第二图像输入到第一机器学习模型而对深度映射图进行预测;

将所述第一图像和所述第二图像输入到第二机器学习模型,对拍摄了所述第一图像和所述第二图像后的拍摄装置的相对移动以及旋转进行预测;

生成将如下图像转换应用于所述第一图像而得到的第一转换图像,该图像转换以预测出的从所述第一图像向所述第二图像的所述相对移动以及旋转、和针对所述第一图像预测出的所述深度映射图为基础;

对包含所述第一转换图像与所述第二图像之间的误差在内的损失进行计算;以及

将与所述相对移动以及旋转相关的所述损失的梯度、所述第一转换图像、所述第一图像以及所述第二图像输入到所述第二机器学习模型,对所述相对移动以及旋转进行反复预测,使包含以新预测的所述相对移动以及旋转为基础的新的所述第一转换图像与所述第二图像之间的误差在内的所述损失收敛。

发明效果

根据本发明,在使用机器学习模型对摄像机姿态进行推定的情况下,能够提高摄像机姿态的推定精度。

附图说明

图1是表示第一实施方式所涉及的信息处理服务器的功能构成例的模块图。

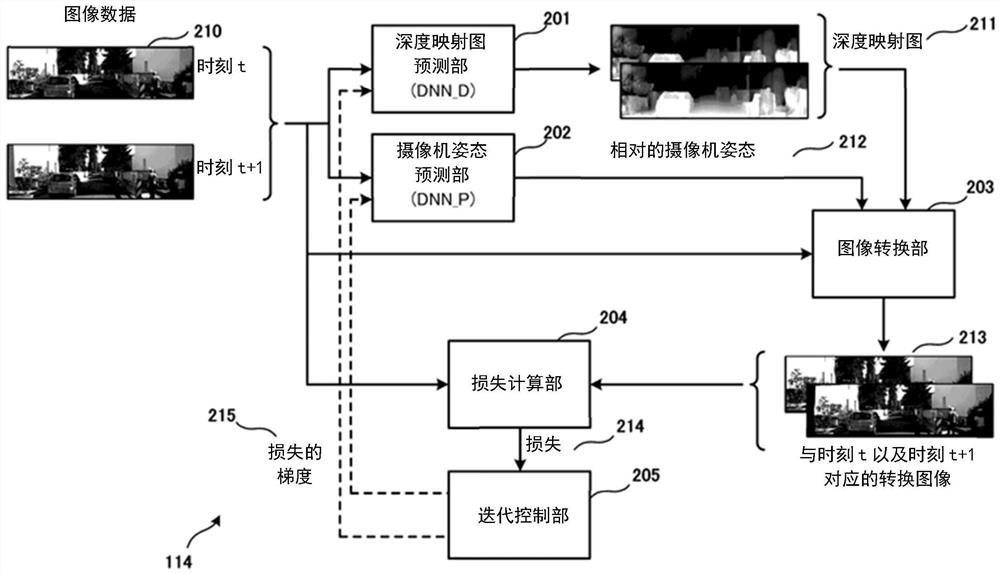

图2是用于对第一实施方式所涉及的模型处理部114中的深度映射图预测以及摄像机姿态预测进行说明的图。

图3A是对第一实施方式所涉及的图像转换(从时刻t到时刻t+1)进行说明的图。

图3B是对第一实施方式所涉及的反向的图像转换(从时刻t+1到时刻t)进行说明的图。

图4A是对第一实施方式所涉及的预测出的摄像机姿态的损失进行说明的图。

图4B是对第一实施方式所涉及的预测出的深度映射图的损失进行说明的图。

图5是对第一实施方式所涉及的伴随着迭代的深度映射图预测进行说明的图。

图6是对第一实施方式所涉及的伴随着迭代的摄像机姿态预测进行说明的图。

图7是表示第一实施方式所涉及的模型处理部中的(摄像机姿态以及深度映射图的)预测处理的一系列动作的流程图。

图8是表示第二实施方式所涉及的车辆的功能构成例的模块图。

图9是表示用于第二实施方式所涉及的车辆的行驶控制的主要构成的图。

附图标记说明

100:信息处理服务器;113:图像数据获取部;114:模型处理部;201:深度映射图预测部;202:摄像机姿态预测部;203:图像转换部;204:损失计算部;205:迭代控制部。

具体实施方式

以下,参照附图对实施方式进行详细说明。此外,以下的实施方式并非对权利要求书所涉及的发明进行限定,另外,在实施方式中说明的特征的组合未必全部都是发明所必须的。也可以对实施方式中说明的多个特征中的两个以上的特征任意地进行组合。另外,对相同或者同样的构成标注相同的附图标记,并省略重复的说明。

<信息处理服务器的构成>

接着,参照图1对信息处理服务器的功能构成例进行说明。此外,参照以后的图进行说明的各个功能模块可以被合并或分离,另外,所说明的功能也可以通过其他的模块来实现。另外,作为硬件而说明的部分可以通过软件来实现,反之亦然。信息处理服务器配置在车辆等移动体的外部。

控制部104例如包含CPU110、RAM111、ROM112,对信息处理服务器100的各部的动作进行控制。控制部104通过由CPU110将保存在ROM112中的计算机程序加载在RAM111中并执行而发挥构成控制部104的各部的功能。控制部104除了CPU110之外,还可以包含GPU或者适于机器学习的处理、神经网络的处理的执行的专用的电路,GPU或者该电路也可以执行模型处理部114的处理。

图像数据获取部113获取从用户所操作的车辆等外部装置发送的图像数据。图像数据获取部113将所获取的图像数据保存在存储部103中。为了得到针对所获取的图像数据的推论结果,将所获取的图像数据输入到推论阶段的机器学习模型(也简称为学习模型)。另外,图像数据获取部113所获取的图像数据也可以用于使模型处理部114的模型进行学习。

模型处理部114包含本实施方式所涉及的机器学习模型,执行该学习模型的学习阶段的处理、推论阶段的处理。学习模型例如输入第一图像数据以及第二图像数据,对拍摄了第一图像数据的摄像机1与拍摄了第二图像数据的摄像机2之间的相对的摄像机姿态进行预测。相对的摄像机姿态例如包含相对于一方的摄像机的另一方的摄像机的相对移动和相对的绕三轴的旋转。另外,学习模型对与第一图像数据以及第二图像数据分别对应的深度映射图进行预测。

第一图像数据和第二图像数据例如可以是由以朝向车辆的前方的方式搭载的一台摄像机在不同的时刻(例如时刻t和之后的时刻t+1)拍摄到的图像数据。此时,由于摄像机因车辆的移动而在时刻t与时刻t+1之间进行了移动,因此对各个图像数据进行拍摄时的摄像机的摄像机姿态不同。另外,第一图像数据和第二图像数据例如也可以是由以朝向车辆的前方的方式搭载的两台摄像机拍摄到的两个图像数据。在该情况下,对各个图像数据进行拍摄时的摄像机的摄像机姿态也不同。在对由固定的两台摄像机拍摄到的图像数据使用本实施方式的预测处理的情况下,能够根据所推定的摄像机参数进行摄像机的校准、摄像机的异常检测。

DNN通过进行学习阶段的处理而成为学习完毕的状态,通过将新的图像数据输入到学习完毕的DNN,能够进行针对新的图像数据的摄像机姿态预测和深度映射图预测(推论阶段的处理)。当在信息处理服务器100中执行使用了学习完毕模型的推论处理的情况下,执行推论阶段的处理。信息处理服务器100在信息处理服务器100侧执行学习到的学习完毕的模型,并将推论结果发送到车辆、信息处理装置等外部装置。一般而言,信息处理服务器100能够使用比车辆等更丰富的计算资源,因此适于如后述的预测处理那样进行反复运算的情况。另外,通过接收、累积由各种车辆拍摄到的图像数据,能够收集各种各样的状况下的图像数据,能够进行与更多的状况对应的学习。

预测结果提供部115将由模型处理部114预测出的深度映射图和摄像机姿态的信息提供给发送了图像数据的车辆等外部装置。

通信部101例如是包含通信用电路等的通信设备,例如通过因特网等网络而与车辆、信息处理装置等外部装置进行通信。通信部101除了接收从车辆、信息处理装置等外部装置发送的实际图像之外,还将通过学习模型而预测出的摄像机参数、深度映射图发送给车辆。电源部102对信息处理服务器100内的各部供给电力。存储部103是硬盘、半导体存储器等非易失性存储器。存储部103保存后述的DNN的学习完毕参数、学习数据。

<模型处理部的学习模型的例子>

接着,对本实施方式所涉及的模型处理部114中的学习模型的例子进行说明。此外,在以下的说明中,以由搭载于车辆的一台摄像机在时刻t和之后的时刻t+1拍摄到的两个图像数据被输入到模型处理部114的情况为例进行说明。

参照图2,对模型处理部114的构成和模型处理部114所包含的学习模型的处理例进行说明。模型处理部114包含DNN_D201、DNN_P202、图像转换部203、损失计算部204以及迭代控制部205。另外,模型处理部114包含学习模型。本实施方式所涉及的学习模型例如包含DNN_D201、DNN_P202、图像转换部203、损失计算部204以及迭代控制部205。

深度映射图预测部201(以下,也称为DNN_D201)由作为机器学习模型的一个例子的一个以上的深度神经网络(DNN)构成,将所输入的图像数据的深度映射图211作为预测结果输出。例如,DNN_D201在被输入时刻t的图像数据时输出与时刻t的图像数据对应的深度映射图,在被输入时刻t+1的图像数据时输出与时刻t+1的图像数据对应的深度映射图。深度映射图例如是关于输入图像的各像素值,以图像表示所预测的深度(从摄像机到物体的距离)的信息,距摄像机越近则以白色表示,越远则以黑色表示。另外,如后述那样,DNN_D201为了输出深度映射图而进行迭代(反复运算),能够提高所预测的深度映射图的精度。此时,DNN_D201能够被输入图像数据、在紧前的迭代中预测出的深度映射图、以及后述的与深度映射图相关的损失的梯度,并输出当前的迭代中的深度映射图。DNN_D201例如可以由CNN(Convolutional Neural Network:卷积神经网络)、自动编码器等构成。

摄像机姿态预测部202(也称为DNN_P202)由作为机器学习模型的一个例子的一个以上的DNN构成,将所输入的两个图像数据之间的相对的摄像机姿态212作为预测结果输出。例如,DNN_P202在被输入时刻t和时刻t+1这两个图像数据时,输出时刻t与时刻t+1的图像数据之间的相对的摄像机姿态(例如摄像机的移动量和绕三轴的旋转量)。另外,如后述那样,DNN_P202为了输出作为预测结果的摄像机姿态而进行迭代,能够提高所预测的摄像机姿态的精度。此时,DNN_P202能够被输入两个图像数据、在紧前的迭代中预测出的摄像机姿态、以及后述的与摄像机姿态相关的损失的梯度,并输出当前的迭代中的摄像机姿态。DNN_P202能够输出与摄像机姿态从时刻t到时刻t+1进行了变化的情况对应的、相对的摄像机姿态P(I

图像转换部203使用预测出的(相对的)摄像机姿态和深度映射图,对在一个时刻拍摄到的图像数据进行转换,生成与另一个时刻对应的转换图像213。例如,如图3A所示那样,图像转换部203被输入在时刻t拍摄的图像数据301、针对时刻t的图像数据301推定的深度映射图302、以及从时刻t到时刻t+1的相对的摄像机姿态303。然后,图像转换部203基于输入数据,生成与时刻t+1对应的转换图像304。

在此,由图像转换部203进行的图像转换相当于对由一方的摄像机拍摄到的图像数据应用以预测出的相对的摄像机姿态和深度映射图为基础的图像转换,再现由另一方的摄像机拍摄到的虚拟的图像数据。因而,根据时刻t的图像数据和时刻t+1的图像数据而预测出的(相对的)摄像机姿态(和深度映射图)越准确,时刻t+1的图像数据和与时刻t+1对应的转换图像304之间的误差越小。相反,在实际的时刻t+1的图像数据和与时刻t+1对应的转换图像304之间的误差较大的情况下,所预测的摄像机姿态或深度映射图不准确。因而,通过反复进行所预测的摄像机姿态或深度映射图的预测,以使得与时刻t+1对应的转换图像和实际的时刻t+1的图像数据之间的差异变得更小,能够得到精度较高的(相对的)摄像机姿态和深度映射图。

此外,图像转换部203在进行使用了图像数据I

损失计算部204对以拍摄到的图像与转换图像之间的误差为基础的损失214进行计算。例如,损失计算部204可以将图像数据I

损失计算部204也可以在图像数据与转换图像之间的误差的基础上,或者代替该误差,使用基于图像特征的误差、SSIM(构造上的类似性)指标等,对损失进行计算。损失计算部204例如也可以使用以提取出预定的特征量的方式预先进行了学习的其他DNN,对图像数据I

损失计算部204也可以进一步考虑根据拍摄图像预测出的深度映射图与由图像转换部203进行图像转换后的深度映射图之间的误差而对损失进行计算。例如,损失计算部204使用时刻t的深度映射图411和与时刻t对应的深度映射图的转换图像412,对与深度映射图相关的损失413进行计算。此时,损失计算部204例如考虑比较对象的两个深度映射图的各像素值(深度的值)之差。损失计算部204也可以进一步地在此基础上或者取而代之地,考虑比较对象的两个深度映射图的各像素值的梯度(深度的平滑度)之差。

另外,损失计算部204也可以在图像转换中,对隐藏区域进行掩码而不将该隐藏区域用于误差的计算。例如,在从时刻t的图像数据获得与时刻t+1对应的转换图像的情况下,对于仅在时刻t+1出现在图像中的区域,本质上无法获得预测精度。因此,损失计算部204使用时刻t的深度映射图和时刻t+1的深度映射图来确定隐藏区域,并将表示隐藏区域的掩码信息存储于存储部103。表示隐藏区域的掩码信息例如可以是具有0或1的二进制数据,也可以将在与时刻t+1对应的转换图像中无法得到准确的预测的区域设定为0,将不是这样的区域设定为1。

例如,作为一个例子,损失计算部204能够如以下那样对损失L进行计算。

L=(I

其中,I

迭代控制部205为了实现基于DNN_D201以及DNN_P202的最优化,对反复运算(即迭代)进行控制。DNN_D201如上述那样通过反复运算来提高所预测的深度映射图的精度。具体而言,如图5所示那样,对DNN_D201例如输入时刻t的图像数据、针对时刻t的图像数据在紧前(例如N)的迭代中预测到的深度映射图502、以及与深度映射图相关的损失的梯度503。然后,DNN_D201输出第N+1次的迭代中的深度映射图504。在基于迭代的计算中,在每次迭代中,对第N次的迭代的深度映射图502、和与深度映射图相关的损失的梯度503进行更新。与时刻t的深度映射图相关的损失的梯度503是损失中的时刻t的深度映射图(D

DNN_P202如上述那样通过反复运算来提高所预测的摄像机姿态的精度。具体而言,如图6所示那样,对DNN_P202例如输入时刻t以及时刻t+1的图像数据601、针对图像数据601的在紧前(例如N)的迭代中预测出的摄像机姿态602、与摄像机姿态相关的损失的梯度603。然后,DNN_P202输出第N+1次的迭代中的摄像机姿态604。在基于迭代的计算中,在每次迭代中,对第N次的迭代的摄像机姿态602、和与摄像机姿态相关的损失的梯度603进行更新。(从时刻t到时刻t+1的)与摄像机姿态相关的损失的梯度603是损失中的从时刻t到时刻t+1的摄像机姿态的梯度(例如,上述损失L中的基于该摄像机姿态的偏微分)。另外,与(从时刻t+1到时刻t的)摄像机姿态相关的损失的梯度是损失中的从时刻t+1到时刻t的摄像机姿态的梯度(例如,上述损失L中的基于该摄像机姿态的偏微分)。

迭代控制部205反复进行迭代,直到损失214收敛为止。迭代控制部205例如在计算出的损失214经过预定的次数而变为阈值以下的情况下,判定为损失214收敛而结束迭代。

<模型处理部中的预测处理的一系列动作>

接着,参照图7,对模型处理部114中的(摄像机参数以及深度映射图的)预测处理的一系列动作进行说明。此外,例如,通过由控制部104的CPU110(或GPU)将存储在ROM112中的程序加载到RAM111中并执行而实现本处理。此外,控制部104的模型处理部114的学习模型在学习完毕的状态(即,上述的DNN_D201以及DNN_P202为学习完毕的状态)下执行。

在S701中,控制部104的图像数据获取部113从车辆等外部装置获取两个图像数据。两个图像数据例如是搭载于车辆的一台摄像机在时刻t以及之后的时刻t+1拍摄到的图像。

在S702中,控制部104的模型处理部114对分别针对时刻t的图像数据(I

在S703中,模型处理部114对针对从时刻t的图像数据(I

在S704中,图像转换部203使用所预测的深度映射图和摄像机姿态,对时刻t的图像数据(I

此外,图像转换部203使用相对的摄像机姿态P(I

在S705中,损失计算部204对包含转换前的数据与转换图像之间的差分在内的损失进行计算。损失例如可以是上述的损失L。即,损失计算部204将时刻t和时刻t+1的各个图像、以及与时刻t和时刻t+1对应的各个转换图像的2次方误差包含在损失中。进一步地,损失计算部204将时刻t和时刻t+1的各个深度映射图、以及与时刻t和时刻t+1对应的各个深度映射图的2次方误差包含在损失中。即,向时刻t和时刻t+1这两个方向的摄像机姿态、以及时刻t和时刻t+1这两个时刻下的深度映射图以使损失最小化的方式被最优化。

在S706中,迭代控制部205对由损失计算部204计算出的损失进行监视,并判定损失是否满足收敛的条件。迭代控制部205例如在计算出的损失经过预定的次数而变为损失值的阈值以下的情况下,判定为满足收敛的条件,结束本一系列的处理。另一方面,迭代控制部205在判定为计算出的损失经过预定的次数而没有变为损失值的阈值以下的情况下,使处理进入S707。

在S707中,迭代控制部205基于在S705中计算出的损失,对与深度映射图相关的损失的梯度进行计算。与深度映射图相关的损失的梯度能够针对时刻t以及时刻t+1的各个深度映射图来进行计算。损失中的时刻t的深度映射图(D

迭代控制部205使用与深度映射图相关的损失的梯度、当前的迭代(即S702的预测结果)和各图像数据(I

在S708中,迭代控制部205基于在S705中计算出的损失,对与摄像机姿态相关的损失的梯度进行计算。与摄像机姿态相关的损失的梯度能够分别针对相对的摄像机姿态P(I

迭代控制部205使用与摄像机姿态相关的损失的梯度、当前的迭代(即S703的预测结果)、各图像数据(I

迭代控制部205在S708的处理结束后,使处理进入S704,反复进行S704~S708的处理,以继续进行迭代的处理。

这样,在模型处理部114中的预测处理中,计算出将原来的图像数据与根据所推定的摄像机参数和深度映射图得到的转换图像进行比较而得到的损失,使用与深度映射图相关的损失的梯度、与摄像机参数相关的损失的梯度,通过反复运算使深度映射图以及摄像机姿态最优化。由此,根据梯度对由DNN预测的摄像机参数、深度映射图进行修正,与通过基于DNN的一次的处理而预测出的结果相比,能够提高预测精度。

虽然在上述的预测处理中没有明示,但是模型处理部114能够将最终求出的摄像机姿态和深度映射图发送到例如车辆等外部装置。即,模型处理部114能够从车辆等外部装置接受处理对象的两个图像,并将根据该图像预测出的深度映射图和摄像机参数回复给该外部装置。这样,车辆等外部装置能够一边从信息处理服务器100适当地获取针对所拍摄的图像的推论结果,一边进行例如自动驾驶等行驶控制。

此外,上述的预测处理的一系列的动作是模型处理部114的学习模型在推论阶段(即,已学习完毕)中进行的动作。在对学习模型进行学习的情况下,模型处理部114在上述S701~S708的处理的基础上,增加对DNN_D201和DNN_P202的权重参数进行更新的处理即可。具体而言,在S705中计算了损失之后,进行使用了损失的梯度的反向传播并对各DNN的权重参数进行更新即可。或者,也可以使用在S706中判定为满足了收敛的条件之后(即,结束了反复运算之后)的最终的摄像机姿态和深度映射图,与S705同样地对包含转换前的数据与转换图像之间的差分在内的损失进行计算。在该情况下,也可以将计算出的损失全部传递给学习数据并累积在学习数据中,并基于累积的损失进行DNN的反向传播。

另外,在上述的例子中,对模型处理部114基于所获取的图像生成深度映射图的例子进行了说明。但是,模型处理部114也可以使用由车辆等的Lidar(Light Detection andRanging:激光探测及测距)、雷达生成的深度映射图,对摄像机参数进行推定。

(第二实施方式)

接着,对本发明的第二实施方式进行说明。在上述的实施方式中,以在信息处理服务器100中执行基于学习模型的预测处理的情况为例进行了说明。但是,本实施方式不限于在信息处理服务器中执行该预测处理的情况,也能够应用于在作为移动体的一个例子的车辆中执行该预测处理的情况。即,在车辆中模型处理部的学习模型进行动作,能够在车辆内对摄像机参数和深度映射图进行预测。以下,对这样的实施方式中的车辆的功能构成例进行说明。此外,在以下的例子中,以控制部808是组装于车辆800的控制单元的情况为例进行说明。但是,也可以在车辆800搭载具有控制部808的构成的信息处理装置。即,车辆800也可以是搭载有具备控制部808所包含的CPU810、模型处理部814等构成的信息处理装置的车辆。

在车辆中进行学习模型的推论阶段的处理的情况下,例如,信息处理服务器100向车辆800提供学习完毕模型的信息(例如学习后的神经网络的权重参数等)。这样,车辆800能够使用利用在信息处理服务器100中收集的各种学习数据进行学习后的最新的学习完毕模型。

<车辆的构成>

参照图8,对本实施方式所涉及的车辆800的功能构成例进行说明。此外,参照以后的图进行说明的各个功能模块可以被合并或分离,另外,所说明的功能也可以通过其他的模块来实现。另外,作为硬件而说明的部分可以通过软件来实现,反之亦然。

传感器部801包含输出对车辆的前方(或者,进一步地后方方向、周围)进行拍摄而得到的拍摄图像的摄像机(拍摄装置)。传感器部801还可以包含输出对车辆的前方(或者,进一步地后方方向、周围)的距离进行测量而得到的距离图像的Lidar(Light Detectionand Ranging:激光探测及测距)。拍摄图像例如用于模型处理部814中的预测处理。另外,传感器部801也可以包含输出车辆800的加速度、位置信息、转向角等的各种传感器。

通信部802例如是包含通信用电路等的通信设备,例如经由LTE、LTE-Advanced等或者作为所谓的5G而标准化的移动体通信,与信息处理服务器100、周围的交通系统等进行通信。通信部802从信息处理服务器100获取学习模型的信息。除此以外,通信部802从其他信息处理服务器、周围的交通系统接收地图数据的一部分或全部、交通信息等。

操作部803除了安装于车辆800内的按钮、触摸面板等操作构件之外,还包含方向盘、制动踏板等接受用于驾驶车辆800的输入的构件。电源部804包含例如由锂离子电池等构成的电池,向车辆800内的各部供给电力。动力部805例如包含产生用于使车辆行驶的动力的发动机、马达。

行驶控制部806使用从模型处理部814输出的预测处理的结果(例如摄像机姿态、深度映射图),对车辆800的移动进行推定、或对外界进行识别,从而对车辆800的行驶进行控制。此外,移动推定、外界的识别以及行驶控制能够使用已知的方法来进行。此外,在本实施方式的说明中,将行驶控制部806作为与控制部808不同的构成而举例说明,但也可以包含在控制部808中。

存储部807包含半导体存储器等非易失性的大容量的存储设备。临时存储从传感器部801输出的实际图像、其他的从传感器部801输出的各种传感器数据。另外,例如,保存经由通信部802从外部的信息处理服务器100接收的学习完毕模型的参数。

控制部808例如包含CPU810、RAM811、ROM812,并对车辆800的各部的动作进行控制。另外,控制部808从传感器部801获取图像数据,执行上述的预测处理。控制部808通过由CPU810将保存在ROM812中的计算机程序加载在RAM811中并执行而发挥控制部808所具有的模型处理部814等各部的功能。

CPU810包含一个以上的处理器。RAM811例如由DRAM等易失性的存储介质构成,作为CPU810的工作存储器而发挥功能。ROM812由非易失性的存储介质构成,对由CPU810执行的计算机程序、使控制部808进行动作时的设定值等进行存储。此外,在以下的实施方式中,以由CPU810执行模型处理部814的处理的情况为例进行说明,但模型处理部814的处理也可以由未图示的一个以上的其他处理器(例如GPU)执行。

学习参数获取部813从信息处理服务器100获取学习完毕模型的信息(学习参数),并存储在存储部807中。

模型处理部814具有与第一实施方式中图2所示的构成相同的构成的学习模型,模型处理部814执行该学习模型的推论阶段的处理。模型处理部814所执行的推论阶段的处理能够与第一实施方式所示的预测处理同样地进行。

<用于车辆的行驶控制的主要构成>

接着,参照图9,对用于车辆800的行驶控制的主要构成进行说明。传感器部801例如对车辆800的前方进行拍摄,以每秒预定的张数输出拍摄到的图像数据。从传感器部801输出的图像数据被输入到控制部808的模型处理部814。输入到模型处理部814的图像数据用于摄像机姿态以及深度映射图的预测处理(推定阶段的处理)。模型处理部814被输入从传感器部801输出的图像数据,执行该预测处理,将摄像机姿态、深度映射图输出给行驶控制部806。

行驶控制部806基于摄像机姿态、深度映射图的预测结果、以及从传感器部801得到的车辆的加速度、转向角等各种传感器信息,进行移动推定、外界的识别等,并且例如向动力部805输出控制信号,进行车辆800的车辆控制。使用了摄像机姿态、深度映射图而进行的移动推定、外界的识别以及车辆控制能够使用公知的方法来进行。动力部805根据行驶控制部806的控制信号,对动力的产生进行控制。

学习参数获取部813获取从信息处理服务器100发送的学习模型的信息。所获取的数据用于使模型处理部814的DNN进行学习。

这样,在本实施方式中,在车辆800中的模型处理部814中执行对摄像机姿态以及深度映射图进行预测的学习模型。即,车辆对将原来的图像数据与根据所推定的摄像机参数和深度映射图得到的转换图像进行比较而得到的损失进行计算,使用与深度映射图相关的损失的梯度、与摄像机参数相关的损失的梯度,通过反复运算使深度映射图以及摄像机姿态最优化。由此,在车辆中执行的学习模型中,与通过基于DNN的一次的处理而预测出的结果相比,能够提高预测精度。

<实施方式的总结>

(1)在上述的实施方式中,提供一种信息处理方法,所述信息处理方法在信息处理装置中执行,其特征在于,

所述信息处理方法包含:

将第一图像或者与所述第一图像成对的第二图像输入到第一机器学习模型而对深度映射图进行预测;

将所述第一图像和所述第二图像输入到第二机器学习模型,对拍摄了所述第一图像和所述第二图像后的拍摄装置的相对移动以及旋转进行预测;

生成将如下图像转换应用于所述第一图像而得到的第一转换图像,该图像转换以预测出的从所述第一图像向所述第二图像的所述相对移动以及旋转、和针对所述第一图像预测出的所述深度映射图为基础;

对包含所述第一转换图像与所述第二图像之间的误差在内的损失进行计算;以及

将与所述相对移动以及旋转相关的所述损失的梯度、所述第一转换图像、所述第一图像以及所述第二图像输入到所述第二机器学习模型,对所述相对移动以及旋转进行反复预测,使包含以新预测的所述相对移动以及旋转为基础的新的所述第一转换图像与所述第二图像之间的误差在内的所述损失收敛。

根据这样的实施方式,通过将与相对移动以及旋转相关的损失的梯度提供给机器学习模型并进行反复计算,从而在使用机器学习模型对摄像机姿态进行推定的情况下,能够提高摄像机姿态的推定精度。

(2)进一步地,在上述的实施方式中,

所述信息处理方法还包含:

生成将如下图像转换应用于所述第二图像而得到的第二转换图像,该图像转换以预测出的从所述第二图像向所述第一图像的所述相对移动以及旋转、和针对所述第二图像预测出的所述深度映射图为基础;以及

对包含所述第二转换图像与所述第一图像之间的误差在内的所述损失进行计算,

使所述损失收敛包含:将与所述相对移动以及旋转相关的所述损失的梯度、所述第二转换图像、所述第一图像以及所述第二图像输入到所述第二机器学习模型,对所述相对移动以及旋转进行反复预测。

根据这样的实施方式,能够进行在从所述第一图像向所述第二图像的转换和从所述第二图像向所述第一图像的转换这两个方向上成为正解的数据的比较,因此能够进一步提高推定精度。另外,能够减少在使机器学习模型进行学习的情况下所需的学习数据的量。

(3)进一步地,在上述的实施方式中,

所述损失包含所述第一转换图像与所述第二图像之间的误差、和所述第二转换图像与所述第一图像之间的误差这两者。

根据这样的实施方式,由于以使所述第一转换图像和第二转换图像这两者的损失降低的方式进行约束,因此能够提高各自的推定精度。

(4)进一步地,在上述的实施方式中,

所述信息处理方法还包含:

生成针对所述第一转换图像的深度映射图;以及

对包含针对所述第一转换图像的深度映射图与针对所述第一图像的深度映射图之间的误差在内的所述损失进行计算,

使所述损失收敛包含:将与所述深度映射图相关的损失的梯度、针对所述第一转换图像的深度映射图、以及所述第一图像输入到所述第一机器学习模型,对所述深度映射图进行反复预测。

根据这样的实施方式,通过将使用了机器学习的反复计算应用于深度映射图的推定,能够更高精度地进行深度映射图的推定。

(5)进一步地,在上述的实施方式中,

所述信息处理装置是配置在移动体的外部的信息处理服务器。

根据这样的实施方式,能够在计算资源更丰富的信息处理服务器中执行机器学习模型的处理。

(6)进一步地,在上述的实施方式中,

所述信息处理装置是包含车辆的移动体。

通过在包含车辆的移动体中执行上述信息处理方法,能够在移动体中高精度地进行拍摄装置的校准、移动预测。

本发明不限于上述的实施方式,可以在本发明的主旨的范围内进行各种变形、变更。

- 信息处理方法、信息处理装置以及记录有程序的记录介质

- 信息处理设备、信息处理方法以及计算机可读记录介质

- 信息处理装置、信息处理方法以及记录介质

- 处理装置、处理系统、处理方法以及计算机可读记录介质

- 销售数据处理装置、销售数据处理方法以及记录介质

- 信息处理服务器、信息处理方法、信息处理程序、记录了信息处理程序的记录介质、便携终端、便携式计算机的信息处理方法、便携终端用程序、以及记录了便携终端用程序的记录介质

- 图像处理设备以及图像处理方法,信息处理设备以及信息处理方法,信息记录设备以及信息记录方法,信息再现设备以及信息再现方法,记录介质和程序