基于虚拟物品的交互方法、装置及存储介质

文献发布时间:2023-06-19 09:49:27

技术领域

本申请涉及计算机技术领域,尤其是一种基于虚拟物品的交互方法、装置及存储介质。

背景技术

随着计算机技术的发展和人机交互需求的日益提升,多种交互方式相继出现,如抢红包、直播互动、增强现实游戏等,为人们的日常生活添加了很多乐趣。

相关技术中,提供了一种基于虚拟物品的交互方法,包括:服务器、远程监控终端、上位机等将虚拟物品信息(如可供用户选取的虚拟物品列表等信息)发送给用户终端,用户终端的用户根据该虚拟物品信息选择需要的虚拟物品后,用户终端再将选择的结果以请求的形式发送给服务器、远程监控终端、上位机等,服务器、远程监控终端、上位机等接着将用户所需的虚拟物品发送给用户终端,实现对虚拟物品的获取。这种交互方式服务器、远程监控终端、上位机等需要与用户终端不断进行交互,在用户终端较多的情况下,会给服务器、远程监控终端、上位机等带来较大的运算负担和压力,严重时甚至会导致服务器、远程监控终端、上位机等崩溃。

发明内容

本申请实施例提供一种基于虚拟物品的交互方法、装置、设备及存储介质,以减轻运算负担与压力。

根据本申请实施例的一方面,提供一种基于虚拟物品的交互方法,应用于第一终端,包括以下步骤:

在第一终端中显示第一增强现实画面;

响应于所述第一终端触发的虚拟物品放置指令,在所述第一增强现实画面中呈现虚拟物品,并确定所述虚拟物品的目标属性信息,所述目标属性信息包括所述虚拟物品的放置地点的第一地理位置信息和所述虚拟物品放置时的第一场景特征信息;

发送所述目标属性信息。

根据本申请实施例的另一方面,提供一种基于虚拟物品的交互方法,应用于服务器,包括以下步骤:

接收并存储第一终端发送的虚拟物品的目标属性信息;所述目标属性信息包括所述虚拟物品的放置地点的第一地理位置信息和所述虚拟物品放置时的第一场景特征信息;

接收第二终端的目标属性信息获取请求,将所述目标属性信息发送给所述第二终端。

根据本申请实施例的另一方面,提供一种基于虚拟物品的交互方法,应用于第二终端,包括以下步骤:

在第二终端中显示第二增强现实画面;

响应于所述第二终端触发的虚拟物品寻找指令,接收虚拟物品的目标属性信息,所述目标属性信息包括所述虚拟物品的放置地点的第一地理位置信息和所述虚拟物品放置时的第一场景特征信息;

获取所述第二增强现实画面的第二属性信息,所述第二属性信息包括当前位置的第二地理位置信息和所述第二增强现实画面的第二场景特征信息;

当所述第二属性信息与所述目标属性信息相匹配时,在所述第二增强现实画面中显示所述虚拟物品;

响应于所述第二终端触发的虚拟物品领取指令,领取所述虚拟物品。

根据本申请实施例的另一方面,提供一种基于虚拟物品的交互方法,应用于由第一终端、第二终端和服务器组成的系统,包括以下步骤:

在第一终端中显示第一增强现实画面;

响应于所述第一终端触发的虚拟物品放置指令,在所述第一增强现实画面中呈现虚拟物品,并确定所述虚拟物品的目标属性信息,所述目标属性信息包括所述虚拟物品的放置地点的第一地理位置信息和所述虚拟物品放置时的第一场景特征信息;

通过所述第一终端将所述目标属性信息发送给服务器;

通过所述服务器接收并存储所述目标属性信息;

在第二终端中显示第二增强现实画面;

响应于所述第二终端触发的虚拟物品寻找指令,通过所述第二终端发送所述目标属性信息获取请求给所述服务器;

通过所述第二终端接收所述服务器返回的所述目标属性信息;

通过所述第二终端获取所述第二增强现实画面的第二属性信息,所述第二属性信息包括当前位置的第二地理位置信息和所述第二增强现实画面的第二场景特征信息;

当所述第二属性信息与所述目标属性信息相匹配时,在所述第二增强现实画面中显示所述虚拟物品;

响应于所述第二终端触发的虚拟物品领取指令,领取所述虚拟物品。

根据本申请实施例的另一方面,提供一种基于虚拟物品的交互装置,应用于第一终端,包括:

第一显示单元,用于在第一终端中显示第一增强现实画面;

呈现与信息确定单元,用于响应于所述第一终端触发的虚拟物品放置指令,在所述第一增强现实画面中呈现虚拟物品,并确定所述虚拟物品的目标属性信息,所述目标属性信息包括所述虚拟物品的放置地点的第一地理位置信息和所述虚拟物品放置时的第一场景特征信息;

第一发送单元,用于发送所述目标属性信息。

根据本申请实施例的另一方面,提供一种基于虚拟物品的交互装置,应用于服务器,包括:

接收与存储单元,用于接收并存储第一终端发送的虚拟物品的目标属性信息;所述目标属性信息包括所述虚拟物品的放置地点的第一地理位置信息和所述虚拟物品放置时的第一场景特征信息;

收发单元,用于接收第二终端的目标属性信息获取请求,将所述目标属性信息发送给所述第二终端。

根据本申请实施例的另一方面,提供一种基于虚拟物品的交互装置,应用于第二终端,包括:

第二显示单元,用于在第二终端中显示第二增强现实画面;

接收单元,用于响应于所述第二终端触发的虚拟物品寻找指令,接收虚拟物品的目标属性信息,所述目标属性信息包括所述虚拟物品的放置地点的第一地理位置信息和所述虚拟物品放置时的第一场景特征信息;

获取单元,用于获取所述第二增强现实画面的第二属性信息,所述第二属性信息包括当前位置的第二地理位置信息和所述第二增强现实画面的第二场景特征信息;

第三显示单元,用于当所述第二属性信息与所述目标属性信息相匹配时,在所述第二增强现实画面中显示所述虚拟物品;

领取单元,用于响应于所述第二终端触发的虚拟物品领取指令,领取所述虚拟物品。

根据本申请实施例的另一方面,提供一种基于虚拟物品的交互系统,包括第一终端、第二终端和服务器,

所述第一终端,用于显示第一增强现实画面;响应于所述第一终端触发的虚拟物品放置指令,在所述第一增强现实画面中呈现虚拟物品,并确定所述虚拟物品的目标属性信息,所述目标属性信息包括所述虚拟物品的放置地点的第一地理位置信息和所述虚拟物品放置时的第一场景特征信息;发送所述目标属性信息给所述服务器;

所述第二终端,用于显示第二增强现实画面;响应于所述第二终端触发的虚拟物品寻找指令,接收虚拟物品的目标属性信息,所述目标属性信息包括所述虚拟物品的放置地点的第一地理位置信息和所述虚拟物品放置时的第一场景特征信息;获取所述第二增强现实画面的第二属性信息,所述第二属性信息包括当前位置的第二地理位置信息和所述第二增强现实画面的第二场景特征信息;当所述第二属性信息与所述目标属性信息相匹配时,在所述第二增强现实画面中显示所述虚拟物品;响应于所述第二终端触发的虚拟物品领取指令,领取所述虚拟物品;

所述服务器,用于接收并存储所述第一终端发送的所述目标属性信息,接收所述第二终端发送的目标属性信息获取请求,将所述目标属性信息返回给所述第二终端。

根据本申请实施例的另一方面,提供一种计算机设备,包括:

至少一个处理器;

至少一个存储器,用于存储至少一个程序;

当所述至少一个程序被所述至少一个处理器执行,使得所述至少一个处理器实现前面所述的方法。

根据本申请实施例的另一方面,提供一种计算机可读存储介质,其中存储有处理器可执行的程序,所述处理器可执行的程序在由所述处理器执行时用于实现前面所述的方法。

本申请实施例的技术方案通过第一终端在第一增强现实画面中呈现放置好的虚拟物品,确定虚拟物品放置时的目标属性信息并发送给服务器、远程监控终端等,服务器、远程监控终端等在接收到第二终端的目标属性信息获取请求后再将该目标属性信息返回给第二终端,由第二终端根据该目标属性信息以及当前位置的第二属性信息进行地理位置信息和场景特征信息的匹配,当该第二属性信息与该目标属性信息匹配时,第二终端在第二增强现实画面中显示出该虚拟物品并根据虚拟物品领取指令实现虚拟物品的领取。本方案通过第一终端实现虚拟物品的放置,通过第二终端的目标属性信息匹配实现虚拟物品的寻找与领取,服务器、远程监控终端等进行目标属性信息的存储与数据转发即可,减少了服务器、远程监控终端等与终端的交互数据量,减轻了服务器、远程监控终端等的运算负担和压力;结合增强现实技术采用了基于地理位置信息匹配和场景特征信息匹配的线上线下交互方式,提供了更为丰富的用户交互体验。

附图说明

为了更清楚地说明本申请实施例中的技术方案,下面将对实施例描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本申请的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

图1为申请实施例提供的基于虚拟物品的交互方法的一种实施环境示意图;

图2为申请实施例提供的基于虚拟物品的交互系统的软件架构示意图;

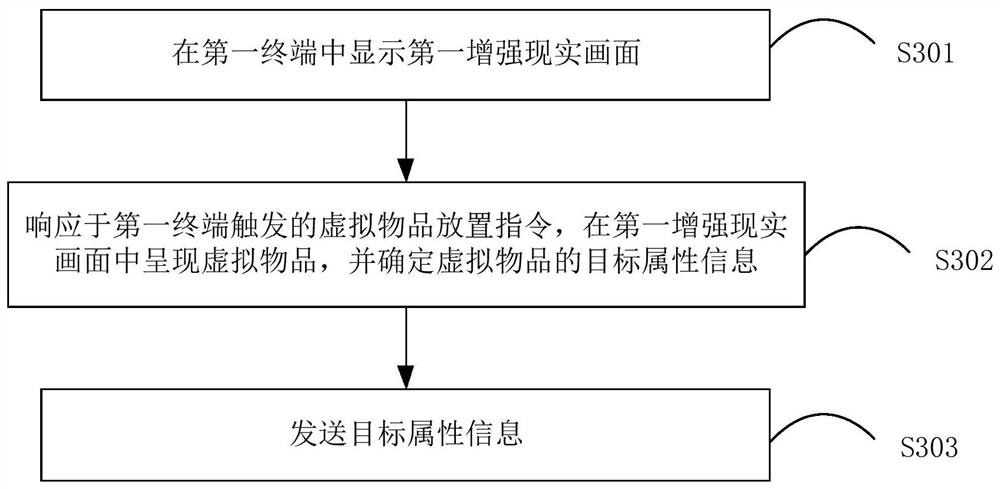

图3为本申请实施例基于虚拟物品的交互方法应用于第一终端时的流程图;

图4为本申请实施例第一终端或第二终端提供的一种主界面示意图;

图5为本申请实施例放置地点为某条马路时显示的第一终端的界面示意图;

图6为本申请实施例虚拟物品的样式设置界面的示意图;

图7为本申请实施例用户权限设置界面的示意图;

图8为本申请实施例将虚拟物品进行目标位置放置时的界面示意图;

图9为本申请实施例基于虚拟物品的交互方法应用于服务器时的流程图;

图10为本申请实施例基于虚拟物品的交互方法应用于第二终端时的流程图;

图11为本申请实施例当前位置为某条马路时显示的第二终端的界面示意图;

图12为本申请实施例成功找到该虚拟物品时第二终端的界面示意图;

图13为本申请实施例第二终端切换到场景识别显示模式时的界面图;

图14为本申请实施例基于虚拟物品的交互方法应用于图2的系统时的流程图;

图15为本申请实施例的交互方法的一种具体应用场景交互时序图;

图16为基于虚拟物品的交互装置用于第一终端时的结构示意图;

图17为基于虚拟物品的交互装置用于服务器时的结构示意图;

图18为基于虚拟物品的交互装置用于第二终端时的结构示意图;

图19为基于虚拟物品的交互装置的另一种结构示意图。

具体实施方式

为了使本技术领域的人员更好地理解本申请方案,下面将结合本申请实施例中的附图,对本申请实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本申请一部分的实施例,而不是全部的实施例。基于本申请中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都应当属于本申请保护的范围。

本申请的说明书和权利要求书及所述附图中的术语“第一”、“第二”、“第三”和“第四”等是用于区别不同对象,而不是用于描述特定顺序。此外,术语“包括”和“具有”以及它们任何变形,意图在于覆盖不排他的包含。例如包含了一系列步骤或单元的过程、方法、系统、产品或设备没有限定于已列出的步骤或单元,而是可选地还包括没有列出的步骤或单元,或可选地还包括对于这些过程、方法、产品或设备固有的其它步骤或单元。

在本文中提及“实施例”意味着,结合实施例描述的特定特征、结构或特性可以包含在本申请的至少一个实施例中。在说明书中的各个位置出现该短语并不一定均是指相同的实施例,也不是与其它实施例互斥的独立的或备选的实施例。本领域技术人员显式地和隐式地理解的是,本文所描述的实施例可以与其它实施例相结合。

首先,对本申请实施例中涉及的相关名词术语进行介绍和说明:

增强现实(Augmented Reality,AR):是一种由真实世界与虚拟元素融合而成的技术,广泛运用了多媒体、三维建模、实时跟踪及注册、智能交互、传感等多种技术手段,将计算机生成的文字、图像、三维模型、音乐、视频等虚拟元素模拟仿真后,应用到真实世界中,两种信息互为补充,从而实现对真实世界的增强。常见的使用场景是用户通过手机屏幕、VR(虚拟现实)眼镜(HMD),显示基于摄像头所拍摄到的真实场景上叠加虚拟元素,虚拟元素一般为三维模型(模拟化妆、游戏、家具展示、职业教育的三维模型居多)或是二维信息(导航方向距离、翻译文字居多)。

同步定位与地图构建(Simultaneous Localization And Mapping,SLAM):是指搭载特定传感器(如相机或摄像头)的主体,在没有环境先验信息的情况下,于运动过程中建立环境的地图或模型,同时估计自己的运动。SLAM可用于解决移动机器人在未知环境中运行时定位导航与地图构建的问题;例如在机器视觉的技术领域中,可以通过同步定位与地图构建的方法,实现机器人的智能巡航和避障。

地理信息系统(Geographic Information System,GIS):是在计算机硬、软件系统支持下,对整个或部分地球表层(包括大气层)空间中的有关地理分布数据进行采集、储存、管理、运算、分析、显示和描述的技术系统。

应用程序编程接口(Application Programming Interface,API):是一些预先定义的函数,目的是提供应用程序与开发人员基于某软件或硬件得以访问一组例程的能力,而又无需访问源码,或理解内部工作机制的细节。

企业对消费者(business to customer,B2C)模式:是按交易对象分类中的一种电子商务模式,一般以网络零售业为主,主要借助于互联网和独立网店系统软件开展在线销售活动,同时也是企业或品牌推广的一种新形式。

生产厂家对消费者(Manufacturers to Consumer,M2C)模式:生产厂家直接对消费者提供自己生产的产品或服务的一种商业模式,特点是流通环节减少至一对一,销售成本降低,从而保障了产品品质和售后服务质量。

个人消费者对个人消费者(Consumer to Consumer,C2C)模式:是指个人与个人之间的消费活动。

随着AR技术的成熟,AR越来越多地应用于各个行业,例如游戏、教育、培训、医疗、设计、直播、广告等。尤其是在游戏领域中,随着AR技术日趋成熟,基于AR的游戏产品或者游戏玩法越来越丰富。相关技术基于AR的互动过程,需要用户终端与服务器、远程监控终端等之间进行多次的数据交互,在用户终端较多的情况下,会给服务器、远程监控终端等带来较大的运算负担和压力,严重时甚至会导致服务器、远程监控终端等崩溃。

为此,本申请实施例提供了一种基于虚拟物品的交互方法,由虚拟物品的提供者(即放置者)通过第一终端在放置地点(如某地某处)生成的第一AR画面(由放置地点拍摄的现实场景图像叠加虚拟元素得到)中放置虚拟物品,通过GIS信息(如经纬度信息)和视觉SLAM,分析虚拟物品放置到第一AR画面时的场景特征信息,记录该虚拟物品在第一AR画面中的目标放置位置等场景特征信息以及放置地点的地理位置信息并发送给服务器、远程监控终端等;其他用户可以通过第二终端从服务器、远程监控终端等获取该放置地点的地理位置信息,在该放置地点的地理位置信息的指引下抵达该放置地点,再通过第二终端从服务器、远程监控终端等获取虚拟物品的场景特征信息,并根据该场景特征信息通过场景特征匹配找到虚拟物品的放置场景,取出该虚拟物品。该交互方法通过第一终端实现虚拟物品的放置,通过第二终端的特征匹配实现虚拟物品的寻找与领取,服务器、远程监控终端等进行目标属性信息的存储与数据转发即可,减少了服务器、远程监控终端等与终端的交互数据量,减轻了服务器、远程监控终端等的运算负担和压力,在用户终端(即第二终端)数量较多时服务器、远程监控终端等仍能正常工作而不会崩溃,可靠性更高。另外,该方法可将用户终端划分为虚拟物品的放置端和寻找端,并结合了AR+GIS+SLAM线上线下互动的方式,提供了更为丰富的用户体验和更高的用户参与度。

该基于虚拟物品的交互方法可以应用于各种场景中。

例如,B2C模式的直播或短视频场景下:

直播主播或是短视频拍摄者,可以在某地点直播或者拍摄小视频,应用本申请实施例的交互方法将虚拟物品放置到某个地点指定某处(例如树下)对应的第一AR画面中,并将该虚拟物品的目标属性信息发送给服务器存储。这样直播或短视频的观众就可以通过本申请实施例的交互方法找到该地点指定某处以及对应的场景,取出虚拟物品,该虚拟物品可以是虚拟宝物、现金红包等。

再例如,B2C/M2C模式的带货直播场景下:

直播主播在直播宣传某景点的指定地点或地标物时,例如雕像或线下商店的招牌处,应用本申请实施例的交互方法将虚拟物品(如该线下商店的优惠券)放置到该景点的指定地点或地标物处对应的第一AR画面中,并将该虚拟物品的目标属性信息发送给服务器存储。这样直播或短视频的观众就可以通过本申请实施例的交互方法找到该景点的指定地点或地标物以及对应的场景,取出该虚拟物品。

再例如,C2C模式的红包或权益券寻找场景下:

某个用户可以在某个地点指定某处(某个购物广场的某个建筑)应用本申请实施例的交互方法将若干个(如10个等)红包或权益券放置到该地点指定某处对应的第一AR画面中,并将该虚拟物品的目标属性信息发送给服务器存储。这样其他个人用户就可以通过本申请实施例的交互方法自主找到该地点指定某处以及对应的场景,取出红包或权益券。

图1是本申请各个实施例所涉及的实施环境的示意图,如图1所示,该实施环境可以包括:第一终端101、服务器102和第二终端103。其中,第一终端101和第二终端103分别与服务器端102通信连接,该通信连接可以是无线连接或有线连接,该无线连接可以包括但不限于无线保真(Wireless Fidelity,WIFI)连接、数据连接、蓝牙连接或红外连接等,该有线连接可以包括但不限于通用串行总线(Universal Serial Bus,USB)连接。

在图1所示的实施环境示意图中,第一终端101是供虚拟物品所有人或提供方(如主播、促销商家、个人用户等)放置或埋藏虚拟物品的一端,也可以称为埋宝端;第二终端103是供虚拟物品寻找者(如直播观众、消费者或个人用户等)寻找与领取虚拟物品的一端,也可以称为寻宝端。第一终端101和第二终端103均可以是任何一种可通过键盘、触摸板、触摸屏、遥控器、语音交互或手写设备等一种或多种方式进行人机交互的电子产品,例如个人计算机(Personal Computer,PC)、手机、智能手机、个人数字助手(PersonalDigitalAssistant,PDA)、可穿戴设备、掌上电脑PPC(Pocket PC)、平板电脑、智能车机、智能电视、智能音箱、智能手表等。图1以智能手机1011和个人计算机1012为例对第一终端101进行说明,并以智能手机1031和个人计算机1032为例对第二终端103进行说明。

服务器102,用于为第一终端101和第二终端103提供信息或数据存储与数据转发服务。服务器102可以是独立的物理服务器,也可以是多个物理服务器构成的服务器集群或者分布式系统,还可以是提供云服务、云数据库、云计算、云函数、云存储、网络服务、云通信、中间件服务、域名服务、安全服务、CDN以及大数据和人工智能平台等基础云计算服务的云服务器。本领域的技术人员可以理解,服务器102还可以替换为远程监控终端、上位机等具有存储与数据转发等功能的设备。

本领域技术人员应能理解第一终端101、第二终端103和服务器端102仅为举例,其他现有的或今后可能出现的终端或服务器如可适用于本申请,也应包含在本申请保护范围以内,并在此以引用方式包含于此。

该实施环境的基于虚拟物品的交互方法主要实现过程为:

放置者(例如主播或者商家)通过第一终端101在放置地点放置虚拟物品,在放置虚拟物品的过程中,放置者可以通过第一终端101拍摄该放置地点的现实场景图像,并在第一终端101中显示该放置地点的第一AR画面(由放置地点拍摄的现实场景图像叠加虚拟元素得到),在第一AR画面中,放置者可通过对第二终端的点击等交互操作触发放置指令进行虚拟物品的放置,同时可结合视觉SLAM等技术得到该虚拟物品放置到第一AR画面时的场景特征信息。放置好虚拟物品后,第一终端将该虚拟物品的目标属性信息上传至服务器102;该目标属性信息包括但不限于放置地点的地理位置信息,以及放置虚拟物品到第一AR画面时所确定的场景特征信息。第二终端103的用户需要寻找该虚拟物品时,向服务器102发送目标属性信息请求,服务器102将该目标属性信息分发至请求的第二终端103。第二终端103接收到目标属性信息后,在第二终端的103中显示当前位置的第二AR画面,实时更新第二终端103的第二AR画面所得到的第二属性信息(与目标属性信息的所包含的信息种类相同,包括但不限于当前地点的地理位置信息和场景特征信息),并将第二属性信息与目标属性信息进行对比。当第二属性信息与目标属性信息匹配时,在第二终端103的第二AR画面中显示该虚拟物品,寻找该虚拟物品的用户可通过对第二终端103的第二AR画面中显示的虚拟物品进行点击等操作触发领取指令,领取该虚拟物品。

基于图1所示的实施环境,提出本申请实施例的基于虚拟物品的交互系统的软件架构图。如图2所示,基于虚拟物品的交互系统主要包括客户端、服务器和云计算服务。

客户端可以是运行于第一终端101或第二终端103的应用(如独立运行的应用程序、公众号或小程序等)。具体地,对于安卓系统来说,运行于第一终端101的客户端,可以为JAVA端并以谷歌提供的AR套件实现;对于苹果iOS系统来说,运行于第一终端101的客户端,也可以通过调用苹果公司提供的ARKit工具包实现。运行于第一终端101的客户端,主要提供视频流/图像的采集或拍摄、虚拟物品的选择或上传、用户当前位置的定位(可以通过调用百度地图、谷歌、高德地图等应用的位置定位功能,或者调用第一终端101自带的位置定位功能来实现)、虚拟物品的放置或埋藏、SLAM视觉分析(得到场景特征信息)与AR画面渲染合成、将采集或获取的信息(如虚拟物品的地理位置信息或放置时的场景特征信息等)上传给服务器、远程监控终端等服务。

运行于第二终端103的客户端,主要提供视频流/图像的采集或拍摄、虚拟物品的选择或上传、用户当前位置的定位(可以通过调用百度地图、谷歌、高德地图等应用的位置定位功能,或者调用第二终端103自带的位置定位功能来实现)、位置计算(用户当前位置与虚拟物品放置地点的距离计算等)与虚拟物品寻找、SLAM视觉分析(得到场景特征信息)与AR画面渲染合成、向服务器发起数据或信息获取(如虚拟的地理位置信息或放置时的场景特征信息等)请求等服务。

服务器,主要提供信息存储与数据转发服务。如图2所示,服务器存储的信息包括但不限于第一终端上传的虚拟物品的目标属性信息,该虚拟物品的目标属性信息可包括虚拟物品的放置地点的地理位置信息、虚拟物品放置时的场景特征信息、虚拟物品的放置者、虚拟物品的样式、用户权限、虚拟物品外包装的类型、虚拟物品的种类等。具体地,虚拟物品的放置地点的地理位置信息可由第一终端在放置虚拟物品时采集,可以包括经度和维度信息。虚拟物品放置时的场景特征信息可由第一终端在放置虚拟物品时采集,可以包括虚拟物品在第一终端的AR画面中的目标放置位置、放置地点拍摄的场景特征点(如SLAM特征点)、虚拟物品在放置到第一终端的AR画面时的朝向和放置地点的场景缩略图等。虚拟物品的放置者可以是主播、商家或个人用户等,可以通过第一终端向服务器进行身份认证或注册后得到。虚拟物品的样式可以由放置者通过第一终端进行选择或设置,可以包括外观、尺寸大小等。用户权限可以由放置者通过第一终端进行选择或设置,可以包括基本的用户信息,如年龄、性别、用户VIP等级(可包括普通用户、VIP用户和超级VIP(即SVIP)用户);还可以包括虚拟物品的打开或领取限制条件,如打开或领取对象为特定对象、打开或领取的密钥、打开或领取的时间段等。虚拟物品外包装的类型,是指根据虚拟物品外包装的性质或特点而分成的门类。例如,虚拟物品外包装的类型可以是虚拟宝箱、虚拟红包、虚拟礼盒等。虚拟物品的种类,是指根据虚拟物品自身的性质或特点而分成的门类。例如,虚拟物品的种类可以是兑换券、卡券、视频、广告、现金奖励等。本领域技术人员可以理解的是,虚拟物品外包装内所含有的虚拟物品可以是一个或多个,例如,虚拟物品外包装的类型是宝箱,虚拟物品可以同时包含兑换券和现金奖励。

云计算服务,用于提供底层的计算服务。如图2所示,该底层的计算服务可以包括实时图形运算服务和实时位置计算服务。其中,实时图形运算服务可以进行场景特征点计算,将虚拟物品与客户端采集的图像或视频合成三维图像;实时位置计算服务可以进行经纬度实时距离计算、方位计算、用户的位置追踪与定位等。云计算服务可以是腾讯云计算服务、阿里云计算服务、百度云计算服务等。运行于第一终端101的客户端可以通过API接口调用云计算服务的特征点计算、图像合成服务来实现虚拟物品的放置,运行于第二终端103的客户端可以通过API接口调用云计算服务中的距离计算、位置追踪等服务来实现虚拟物品的寻找与领取。

基于上述实施环境和软件架构的描述,本申请实施例提出了一种基于虚拟物品的交互方法,该方法可以应用于图1或图2所示的第一终端101,具体可应用于第一终端101运行的客户端中。如图3所示,该交互方法可包括以下步骤S301-S303:

S301、在第一终端中显示第一增强现实画面。

在一种可能实现方式中,第一终端101运行的客户端,可以是第一终端101上独立运行的交互应用,该交互应用可以为即时通信应用、电子支付应用或者其他应用等。第一终端101安装该交互应用,基于用户标识登录该交互应用,通过该交互应用实现用户与第一终端101之间的交互。

在另一种可能实现方式中,第一终端101运行的客户端,可以是为在互联网应用中运行的子应用,该互联网应用可以为即时通信应用、电子支付应用、地图应用以及其他应用等。子应用可以为互联网应用中的公众号或小程序等,公众号是一种互动形式,可以通过的文字、图片、语音、视频等,实现与公众号的关注用户全方位沟通、互动。小程序是一种不需要下载安装即可使用的应用程序。第一终端101安装互联网应用,基于用户标识登录互联网应用,通过登录互联网应用的用户标识,登录该子应用,从而在互联网应用中运行该子应用,实现用户与第一终端101之间的交互。

可选地,第一终端101运行的客户端,可显示有虚拟物品放置界面,通过该虚拟物品放置界面,实现用户与第一终端之间的交互(如虚拟物品放置等)。

虚拟物品的放置地点可以由放置者自行选择或设置,该放置地点是现实场景下的真实位置,一般可以通过经纬度等GIS信息来表征。

第一增强现实画面,可由虚拟物品的放置地点的第一现实场景图像叠加虚拟元素(如场景的三维模型、二维导航信息)得到。虚拟物品的放置地点的第一现实场景图像可以通过调用第一终端的摄像头或其他图像采集设备来获取。

具体地,步骤S301可以进一步划分为以下步骤S3011-S3013:

S3011、响应于虚拟物品放置界面开启指令,显示虚拟物品放置界面。

具体地,虚拟物品放置界面开启指令,可以由用户在第一终端101运行的客户端的主界面中通过点击、下拉菜单选取等方式触发。

示例性地,如图4所示,在第一终端101运行的客户端的主界面中提供了虚拟物品放置界面开启控件401和虚拟物品寻找界面开启控件402,当用户点击该虚拟物品放置界面开启控件401即可进入虚拟物品放置界面。

S3012、获取在放置地点拍摄的第一现实场景图像,并将第一现实场景图像显示于第一终端。

示例性地,图5为放置地点为某条马路时第一终端显示的主界面(即虚拟物品放置界面),该马路拍摄的现实场景图像将在第一终端的第一区域501中显示。

S3013、在第一终端显示的第一现实场景图像上叠加虚拟元素,得到第一增强现实画面。

具体地,第一现实场景图像一般为二维图像,可以叠加三维模型、二维导航信息等虚拟元素,来对第一现实场景图像进行增强,从而提升第一增强现实画面的立体感和逼真度。

例如,可以对马路场景进行三维重建,得到该马路的三维模型(可包含树木的三维模型、建筑的三维模型等),根据第一现实场景图像与该马路的三维模型生成三维实景图像作为第一增强现实画面显示于图5所示的第一区域501中。

S302、响应于第一终端触发的虚拟物品放置指令,在第一增强现实画面中呈现虚拟物品,并确定虚拟物品的目标属性信息。

虚拟物品放置指令,可以由用户在第一终端的虚拟物品放置界面通过点击、下拉菜单选取等方式触发。

如前所述,虚拟物品的目标属性信息可包括虚拟物品的放置地点的地理位置信息、虚拟物品放置到第一增强现实画面时的第一场景特征信息、虚拟物品的放置者、虚拟物品的样式、用户权限、虚拟物品外包装的类型、虚拟物品的种类等。

可选地,第一终端的虚拟物品放置界面上还可以设有虚拟物品设置控件,便于放置者对虚拟物品外包装的类型、虚拟物品的样式、用户权限、虚拟物品的放置者或虚拟物品的种类等进行选择或设置。

示例性地,图5中502为虚拟物品设置控件,其上展示有不同的虚拟物品外包装的类型供用户选取,如宝箱、杯体、红包等。

图6为在虚拟物品设置控件502中选取宝箱作为虚拟物品外包装的类型之后,所进入的虚拟物品的样式设置界面,用户可以在该样式设置界面中对虚拟物品的尺寸(长、宽、高等)、虚拟物品的外观进行设置。在对虚拟物品的外观进行设置时,用户可以从预先存储的外观图像库中选取所需的图像作为外观的图像,还可以对外观图像进行自定义。

图7为在虚拟物品设置控件502中选取宝箱作为虚拟物品外包装的类型之后,所进入的用户权限设置界面,放置者可以在该界面中设置虚拟物品的领取资格、领取时间段等内容。

同理,在虚拟物品设置控件502中选取宝箱作为虚拟物品外包装的类型之后,还可以进入虚拟物品的放置者界面或虚拟物品的种类界面设置虚拟物品的放置者或虚拟物品的种类。

由上述的描述可见,步骤S302可以进一步划分为以下步骤S3021-S3023:

S3021、通过虚拟物品设置控件的触发指令确定虚拟物品外包装的类型、虚拟物品的样式、虚拟物品的种类、虚拟物品的放置者或用户权限中的至少一种。

示例性地,可以通过图5的虚拟物品设置控件502、图6的设置界面、图7的设置界面等类似的界面来选择或设置虚拟物品外包装的类型、虚拟物品的样式、虚拟物品的内容、虚拟物品的放置者、虚拟物品的种类或用户权限。

S3022、在第一增强现实画面中呈现放置好的虚拟物品。

示例性地,图8中选取树下的区域5011作为虚拟物品在第一增强现实画面中的目标放置位置,用户可以通过在第一增强现实画面中对虚拟物品进行拖曳等操作将该虚拟物品放置于区域5011中。放置好虚拟物品后,在第一增强现实画面中将会呈现该虚拟物品,呈现的方式可以是但不限于显示该虚拟物品外包装的图标(如图8所示的宝箱的图标),或者可以是通过弹窗的方式显示该虚拟物品放置成功的文字等信息等等。

在一种可能的实施方式中,如果虚拟物品的初始位置与目标放置位置不相同,那么虚拟物品放置指令还可以包含移动触发指令,该移动触发指令被触发后,可以将虚拟物品由初始位置移动至第一增强现实画面的目标放置位置。

S3023、确定虚拟物品放置到第一增强现实画面时的第一场景特征信息。

如前所述,该第一场景特征信息可以包括虚拟物品在第一增强现实画面中的目标放置位置、放置地点拍摄的场景特征点(如SLAM特征点)、虚拟物品在放置到第一增强现实画面时的朝向和放置地点的场景缩略图等。

相应地,步骤S3023可以进一步细分为以下步骤a-d:

a、获取虚拟物品在第一增强现实画面中的目标放置位置。

具体地,虚拟物品在第一增强现实画面中的目标放置位置,可以通过虚拟物品于该第一增强现实画面(即场景)中的相对位置、纵深、大小等图像来描述。

b、获取放置地点拍摄的场景特征点。

具体地,放置地点拍摄的场景特征点,包含了拍摄的视角、场景的透视图、纵深等信息,获取到放置地点拍摄的场景特征点之后,可以在后续虚拟物品的寻找过程中基于场景特征点快速进行目标场景的特征匹配。

在一种可能的实施方式中,可以采用视觉SLAM算法来从拍摄的场景画面中获取若干个特征点作为场景特征点。另外,还可以将用于确认虚拟物品目标放置位置的前后几帧画面的特征点作为场景特征点的一部分,从而提供更丰富的场景特征信息。

c、获取虚拟物品在放置到第一增强现实画面时的朝向。

具体地,虚拟物品在放置到第一增强现实画面时的朝向,可以是东南西北四个方向中的一个方向。该朝向可以通过在放置虚拟物品时用户的面向来确定。

d、获取放置地点的场景缩略图。

具体地,放置地点的场景缩略图,可以为用户提供寻找虚拟物品的线索信息,便于用户进行放置场景的精准寻找。

S303、发送目标属性信息。

本申请实施例中,用户通过第一终端确认虚拟物品的放置地点以及第一场景特征信息之后,会将对应的目标属性信息发送给服务器、远程监控终端(如远程个人电脑端)、上位机等,实现目标属性信息的存储与转发等功能。示例性地,若发送目标属性信息给服务器,那么由于虚拟物品的放置与目标属性信息的设置均由第一终端实现,服务器存储并转发用户确认的目标属性信息即可,减轻了服务器在虚拟物品放置过程中的运算负担和压力。

在一种可能的实施方式中,该基于虚拟物品的交互方法还可进一步包括以下步骤S304和步骤S305:

S304、响应于第一终端触发的视频获取指令,获取放置地点周边直播或拍摄的视频;

S305、发送该视频。

本申请实施例中,第一终端的虚拟物品放置界面中还可以设置视频获取控件,虚拟物品的放置者通过点击该控件等方式触发视频获取指令之后,即可调用第一终端的摄像头等图像采集设备对放置地点周边进行视频直播或拍摄视频,并将该直播视频或拍摄视频发送给服务器、远程监控终端(如远程个人电脑端)、上位机等存储。这样,虚拟物品的寻找者即可通过第二终端的请求获取该直播视频或拍摄视频,从而获知具体的玩法,能吸引流量和为寻找者提供更丰富和更生动的寻找线索。

由上述内容可见,本申请实施例的第一终端可通过第一终端在第一增强现实画面中放置虚拟物品,确定虚拟物品放置时的目标属性信息并发送给服务器、远程监控终端(如远程个人电脑端)等存储,将虚拟物品的放置交由第一终端,使得服务器、远程监控终端等进行目标属性信息的存储与数据转发即可,减少了服务器、远程监控终端等与终端的交互数据量,减轻了服务器、远程监控终端等的运算负担和压力。

基于上述实施环境和软件架构的描述,本申请实施例提出了一种基于虚拟物品的交互方法,该方法可以应用于图1或图2所示的服务器。如图9所示,该基于虚拟物品的交互方法包括以下步骤S901-S902:

S901、接收并存储第一终端发送的虚拟物品的目标属性信息;其中,目标属性信息包括虚拟物品的放置地点的第一地理位置信息和虚拟物品放置(到第一增强现实画面)时的第一场景特征信息;

本申请实施例中,步骤S901中虚拟物品的目标属性信息可以采用前述第一终端的方法实施例来获取,在此不再赘述。

S902、接收第二终端的目标属性信息获取请求,将目标属性信息发送给第二终端。

本申请实施例中,接收到第二终端的目标属性信息获取请求,表明第二终端的用户正在进行虚拟物品的寻找,此时服务器、远程监控终端等将存储的虚拟物品的目标属性信息返回给第二终端,以便于第二终端的用户后续根据该目标属性信息进行虚拟物品的寻找。

由上述内容可见,本申请实施例通过第一终端在第一增强现实画面中放置虚拟物品,确定虚拟物品放置时的目标属性信息之后,服务器、远程监控终端等接收第一终端发送的虚拟物品的目标属性信息进行存储,并根据第二终端的目标属性信息获取请求返回目标属性信息给第二终端,服务器、远程监控终端等进行目标属性信息的存储与数据转发即可,减少了服务器、远程监控终端等与终端的交互数据量,减轻了服务器、远程监控终端等的运算负担和压力。

基于上述实施环境和软件架构的描述,本申请实施例提出了一种基于虚拟物品的交互方法,该方法可以应用于图1或图2所示的第二终端103,具体应用于第二终端103运行的客户端中。如图10所示,该基于虚拟物品的交互方法包括以下步骤S1001-S1005:

S1001、在第二终端中显示第二增强现实画面。

与第一终端103运行的客户端类似,第二终端103运行的客户端,可以是第二终端103上独立运行的交互应用,也可以是为在互联网应用中运行的子应用。

可选地,第二终端103运行的客户端,可显示有虚拟物品寻找界面,通过该虚拟物品寻找界面,实现用户与第二终端103之间的交互。

本申请实施例中的用户为虚拟物品的寻找者,可以是个人用户、直播观众、消费者等。

具体地,步骤S1001可以进一步划分为以下步骤1)-4):

1)响应于虚拟物品寻找界面开启指令,显示虚拟物品寻找界面。

具体地,虚拟物品寻找界面开启指令,可以由用户在第二终端103运行的客户端的主界面中通过点击、下拉菜单选取等方式触发。

示例性地,如图4所示,在第二终端103运行的客户端的主界面中提供了虚拟物品放置界面开启控件401和虚拟物品寻找界面开启控件402,当用户点击该虚拟物品寻找界面开启控件402即可进入虚拟物品寻找界面。

2)获取在当前位置拍摄的第二现实场景图像,将第二现实场景图像显示于第二终端。

示例性地,图11为当前位置为某条马路时显示的虚拟物品寻找界面,该马路拍摄的第二现实场景图像(如包含路灯、建筑物的图像)将在虚拟物品寻找界面中显示。

3)获取虚拟导航信息。

具体地,虚拟导航信息包括当前位置与放置地点的距离或导航方向中的至少之一。

虚拟导航信息可以由第二终端103通过API接口调用图2所示的云计算服务中的实时位置计算服务来获取。

4)在第二终端显示的第二现实场景图像上叠加虚拟导航信息,得到第二增强现实画面。

类似于地图应用的AR导航功能,获取到虚拟导航信息之后,本申请实施例第二终端可以将该虚拟导航信息通过文字、图标等方式叠加显示在第二现实场景图像上,以辅助寻找者导航到虚拟物品的放置地点。

示例性地,图11在获取到当前位置与虚拟物品的放置地点的距离为1.5KM之后,可以在图11的距离显示区域1101中以文字显示该距离,同时还可以在图11中显示方向箭头来提示导航方向。

S1002、响应于第二终端触发的虚拟物品寻找指令,接收虚拟物品的目标属性信息,其中,目标属性信息包括虚拟物品的放置地点的第一地理位置信息和虚拟物品放置(到第一增强现实画面)时的第一场景特征信息。

虚拟物品寻找指令,可以由用户通过点击、下拉菜单选取等方式触发。虚拟物品寻找指令被触发,表明第二终端的用户需要进行虚拟物品的寻找,此时,第二终端将发送目标属性信息获取请求给服务器、远程监控终端等,并接收服务器、远程监控终端等返回的虚拟物品的目标属性。虚拟物品的目标属性信息可以采用前述第一终端的方法实施例来确定,在此不再赘述。

S1003、获取第二增强现实画面的第二属性信息,其中,第二属性信息包括当前位置的第二地理位置信息和第二增强现实画面的第二场景特征信息。

当前位置的第二地理位置信息,可以通过第二终端103调用百度地图、谷歌、高德地图等应用的位置定位功能,或者调用第二终端102自带的位置定位功能来进行实时定位得到。

第二增强现实画面的第二场景特征信息包括但不限于当前位置的场景缩略图、当前位置拍摄的场景特征点(如SLAM特征点)、当前位置拍摄时的朝向(如第二终端摄像头的拍摄朝向)等。第二场景特征信息的场景特征信息的获取过程与第一场景特征信息的确定过程类似,在此不再赘述。

S1004、当第二属性信息与目标属性信息相匹配时,在第二增强现实画面中显示虚拟物品。

当第二属性信息与目标属性信息相匹配时,表明寻找者已经到达虚拟物品的放置地点以及匹配到对应的放置场景特征,即寻找者已经成功找到该虚拟物品,此时第二增强现实画面会显示虚拟物品的外观(成功之前可不显示)。

示例性地,若虚拟物品为马路旁边放置在树下的宝箱,寻找者已经成功找到该虚拟物品后,可以在图12第二增强现实画面的树下位置将宝箱1201显示出来。

S1005、响应于第二终端触发的虚拟物品领取指令,领取虚拟物品。

虚拟物品领取指令可以通过用户对步骤S1004显示的虚拟物品(如图12中的宝箱1201)进行点击等操作触发,虚拟物品领取指令被触发后该虚拟物品(如现金奖励、优惠券、购物券等)即被成功领取。

步骤S1005可以进一步细分为以下步骤a)-c):

a)、响应于第二终端触发的虚拟物品领取指令,发送虚拟物品领取身份认证请求。

具体地,虚拟物品领取身份认证请求含有第二终端的用户信息,服务器、远程监控终端等可通过将目标属性信息中的领取权限与该用户信息比对来进行身份认证。例如,目标属性信息中,第一终端设置的领取权限为放置者的通讯录好友,服务器、远程监控终端等则将对第二终端的用户是否为放置者的通讯录好友进行身份认证。

本申请实施例服务器、远程监控终端等所提供的身份认证功能属于服务器、远程监控终端等比较成熟的功能,占用的运算资源不高,能提升安全性。

b)、接收返回的身份认证结果。

具体地,身份认证结果包括身份认证成功和身份认证失败。例如,第二终端的用户为放置者的通讯录好友,服务器、远程监控终端等则返回身份认证成功的结果;或者第二终端的用户不为放置者的通讯录好友,服务器、远程监控终端等则返回身份认证失败的结果。

c)、当身份认证结果为认证成功时,领取虚拟物品,并在第二终端显示虚拟物品领取成功的提示信息。

身份认证结果为认证成功时,虚拟物品外包装被拆开,该虚拟物品(如现金奖励、优惠券、购物券等)即可被成功领取,此时可以在第二终端的虚拟物品寻找界面中通过“领取成功”的文字或弹窗等提示虚拟物品领取成功。

在一种可能的实施方式中,基于虚拟物品的交互方法还可以进一步包括以下步骤S1006:

S1006、当当前位置与虚拟物品的放置地点的距离小于预设阈值,在第二终端删除叠加的虚拟物品导航信息,显示虚拟物品的放置地点的第一现实场景图像。

具体地,预设阈值是用于进行虚拟物品寻找模式的切换的衡量指标,预设阈值一般为一个较小的数值,如1米、10米等。当当前位置与虚拟物品的放置地点的距离大于等于预设阈值,第二终端采用巡航显示模式,可在当前位置拍摄的画面上叠加距离和导航方向标示作为虚拟物品导航信息,如图11中的导航箭头以及1101区域的文字所示;当当前位置与虚拟物品的放置地点的距离小于预设阈值,第二终端将切换到场景识别显示模式,此时为了便于进行场景特征识别,将删除巡航显示模式下的虚拟物品导航信息,显示虚拟物品的放置地点的第一现实场景图像作为寻找线索,便于寻找者快速找到匹配的放置场景。示例性地,图13在场景识别显示模式下可显示虚拟物品放置地点的第一现实场景图像(即要寻找的目标场景图像,由第一终端设置)缩略图1301作为寻找线索。

由上述内容可见,本申请实施例的第二终端根据服务器、远程监控终端等提供的目标属性信息以及当前位置的第二属性信息进行地理位置信息和场景特征信息的匹配,当该第二属性信息与该目标属性信息匹配时,第二终端在第二增强现实画面中显示出虚拟物品并根据虚拟物品领取指令实现虚拟物品的领取,通过第二终端的目标属性匹配实现虚拟物品的寻找与领取,服务器、远程监控终端等进行目标属性信息的存储与数据转发即可,减少了服务器、远程监控终端等与终端的交互数据量,减轻了服务器、远程监控终端等的运算负担和压力。

基于上述实施环境和软件架构的描述,本申请实施例提出了一种基于虚拟物品的交互方法,该方法可以应用于图1或图2所示的由第一终端101、服务器102和第二终端103组成的系统,由第一终端101、服务器102和第二终端103交互执行。如图14所示,该基于虚拟物品的交互方法,包括以下步骤S1401-S1410:

S1401、在第一终端显示第一增强现实画面;

S1402、响应于第一终端触发的虚拟物品放置指令,在第一增强现实画面中呈现虚拟物品,并确定虚拟物品的目标属性信息,其中,目标属性信息包括虚拟物品的放置地点的第一地理位置信息和虚拟物品放置(到第一增强现实画面)时的第一场景特征信息;

S1403、通过第一终端将目标属性信息发送给服务器;

S1404、通过服务器接收并存储目标属性信息;

S1405、在第二终端中显示第二增强现实画面;

S1406、响应于第二终端触发的虚拟物品寻找指令,第二终端发送目标属性信息获取请求给服务器;

S1407、第二终端接收服务器返回的目标属性信息;

S1408、第二终端获取第二增强现实画面的第二属性信息,其中,第二属性信息包括当前位置的第二地理位置信息和第二增强现实画面的第二场景特征信息;

S1409、当第二属性信息与目标属性信息相匹配,第二终端在第二增强现实画面中显示虚拟物品;

S1410、响应于第二终端触发的虚拟物品领取指令,领取虚拟物品。

本申请实施例中,步骤S1401-S1403在前述第一终端的方法实施例中已经进行了说明;步骤S1404在前述服务器的方法实施例中已经进行了说明;步骤S1405-S1410在前述第二终端的方法实施例中已经进行了说明,在此不再赘述。

下面以虚拟物品外包装为宝箱,第一终端作为藏宝方的手机,第二终端作为寻宝方的手机为例,应用图14所示的基于虚拟物品的交互方法来进行寻宝游戏的具体实施过程包括图15所示的以下步骤:

1、埋宝藏的一方(可能是普通用户也可能是直播主播)通过点击与图4中虚拟物品放置界面开启控件401类似的控件进入对应的埋宝页面,拿着手机走到自己想藏宝藏的地点。

2、通过摄像头结合AR技术,对欲埋藏宝藏的地点、场景进行识别,例如草丛中某颗树的后边(也可以是某个做促销活动的线下店家)。

3、选择埋入的虚拟物品(可以是商品优惠券、红包、商家广告等),从手机屏幕拖放到摄像头正在拍摄的场景中的任一位置作为目标放置位置。

4、服务器记录此虚拟物品的基本信息,包含但不限于:本物品ID、物品内容、类型、置放者、物品GIS位置(经纬度)、朝向、场景特征点、物品外形3D模型MODEL等、物品的可见权限(例如只有某些用户群体可见)。

5、如果置放的虚拟物品是红包类,还需要跳转电子移动支付服务,要求放置物品的人支付。

6、电子移动支付服务判定用户余额。

7、扣除余额,成功支付,红包金额确认。

8、回传藏宝方的手机,提示用户置放虚拟物品成功。

9、一个或多个用户、直播观众,开始拿着自己寻宝端的手机,通过点击图4中虚拟物品寻找界面开启控件402进入对应的寻宝页面,调用手机的摄像头开始寻宝。

10、根据用户的当前位置信息,服务器回传到用户端该用户位置和一个或多个宝藏的距离信息。例如用户A的用户端在地图上显示,附近有3个宝藏物品(可能来自一个或多个主播、用户),分别为北边300米、南边450米、西南方1.5公里等。

11、寻宝端的手机通过AR技术,在开启摄像头的用户A画面上,将宝藏物品距离和方向叠加在现实场景上方。例如,随着用户A朝其北方走100米,该叠加的宝藏物品信息会随之呈现为尚距该物品200米。

12、走到物品附近预设距离阈值(如10米)后,摄像头拍摄的画面将切换成场景识别为主,寻宝端的手机进入场景识别显示模式。

13、寻宝端会调用云计算服务将实时拍摄到的场景和地理位置信息与埋宝端的相应属性信息进行对比,判定与服务器所保存的宝物相关信息、特征点(即步骤4)是否吻合。

14、寻宝端确认吻合,会呈现虚拟物品于屏幕上(与步骤3的位置相同)。

15、寻宝端的用户可点击屏幕上的虚拟物品,请求打开该虚拟物品。

16、寻宝端向服务器发起身份认证请求,再次确认寻宝端的用户的领取资格、权限,将身份认证的结果返回给寻宝端,当身份认证成功,寻宝端将成功打开该虚拟物品。例如,该虚拟物品的内容为红包,红包打开相当于将金额打入寻宝端用户的帐号。

17、通知电子移动支付服务一方扣款成功。

18、通知找宝藏物品的用户,领取成功。

19、通知埋宝藏物品的用户,被领取成功。

综上所述,本申请实施例的方案通过第一终端实现虚拟物品的放置,通过第二终端的目标属性匹配实现虚拟物品的寻找与领取,服务器进行目标属性信息的存储与数据转发即可,减少了服务器与终端的交互数据量,减轻了服务器的运算负担和压力;结合增强现实技术采用了基于地理位置信息匹配和场景特征信息匹配的线上线下交互方式,提供了更为丰富的用户交互体验。

参照图16,本申请实施例还提供了一种基于虚拟物品的交互装置,应用于第一终端,包括:

第一显示单元1601,用于在第一终端中显示第一增强现实画面;

呈现与信息确定单元1602,用于响应于第一终端触发的虚拟物品放置指令,在第一增强现实画面中呈现虚拟物品,并确定虚拟物品的目标属性信息,其中,目标属性信息包括放置地点的第一地理位置信息和虚拟物品放置(到第一增强现实画面)时的第一场景特征信息;

第一发送单元1603,用于发送目标属性信息。

图3所示的基于虚拟物品的交互方法实施例中的内容均适用于本基于虚拟物品的交互实施例中,本基于虚拟物品的交互装置实施例所具体实现的功能与图3所示的基于虚拟物品的交互方法实施例相同,并且达到的有益效果与图3所示的基于虚拟物品的交互方法实施例所达到的有益效果也相同。

参照图17,本申请实施例还提供了一种基于虚拟物品的交互装置,应用于服务器,一种基于虚拟物品的交互装置,包括:

接收与存储单元1701,用于接收并存储第一终端发送的虚拟物品的目标属性信息;其中目标属性信息包括虚拟物品放置地点的第一地理位置信息和虚拟物品放置(到第一增强现实画面)时的第一场景特征信息;

收发单元1702,用于接收第二终端的目标属性信息获取请求,将目标属性信息发送给第二终端。

图9所示的基于虚拟物品的交互方法实施例中的内容均适用于本基于虚拟物品的交互实施例中,本基于虚拟物品的交互装置实施例所具体实现的功能与图9所示的基于虚拟物品的交互方法实施例相同,并且达到的有益效果与图9所示的基于虚拟物品的交互方法实施例所达到的有益效果也相同。

参照图18,本申请实施例还提供了一种基于虚拟物品的交互装置,应用于第二终端,包括:

第二显示单元1801,用于在第二终端中显示第二增强现实画面;

接收单元1802,用于响应于第二终端触发的虚拟物品寻找指令,接收虚拟物品的目标属性信息,其中,目标属性信息包括虚拟物品的放置地点的第一地理位置信息和虚拟物品放置(到第一增强现实画面)时的第一场景特征信息;

获取单元1803,用于获取第二增强现实画面的第二属性信息,其中,第二属性信息包括当前位置的第二地理位置信息和第二增强现实画面的第二场景特征信息;

第三显示单元1804,用于当第二属性信息与所述目标属性信息相匹配时,在第二增强现实画面中显示虚拟物品;

领取单元1805,用于响应于第二终端触发的虚拟物品领取指令,领取虚拟物品。

图10所示的基于虚拟物品的交互方法实施例中的内容均适用于本基于虚拟物品的交互实施例中,本基于虚拟物品的交互装置实施例所具体实现的功能与图10所示的基于虚拟物品的交互方法实施例相同,并且达到的有益效果与图10所示的基于虚拟物品的交互方法实施例所达到的有益效果也相同。

参照图19,本申请实施例还提供了一种计算机设备,包括:

至少一个处理器1901;

至少一个存储器1902,用于存储至少一个程序;

当至少一个程序被至少一个处理器执行,使得至少一个处理器实现图3、图9、图10和图14中任一图所示的方法。

本申请实施例还提供了一种计算机可读存储介质,其中存储有处理器可执行的程序,处理器可执行的程序在由处理器执行时用于实现图3、图9、图10和图14中任一图所示的方法。

图3、图9、图10和图14中任一图所示的基于虚拟物品的交互方法实施例中的内容均适用于本计算机设备和存储介质实施例中,本计算机设备和存储介质实施例所具体实现的功能与图3、图9、图10和图14中任一图所示的基于虚拟物品的交互方法实施例相同,并且达到的有益效果与图3、图9、图10和图14中任一图所示的基于虚拟物品的交互方法实施例所达到的有益效果也相同。

本申请实施例还公开了一种计算机程序产品或计算机程序,该计算机程序产品或计算机程序包括计算机指令,该计算机指令存储在计算机可读存介质中。计算机设备的处理器可以从计算机可读存储介质读取该计算机指令,处理器执行该计算机指令,使得该计算机设备执行图3、图9、图10或图14所示的方法。

可以理解的是,上文中所公开方法中的全部或某些步骤、系统可以被实施为软件、固件、硬件及其适当的组合。某些物理组件或所有物理组件可以被实施为由处理器,如中央处理器、数字信号处理器或微处理器执行的软件,或者被实施为硬件,或者被实施为集成电路,如专用集成电路。这样的软件可以分布在计算机可读介质上,计算机可读介质可以包括计算机存储介质(或非暂时性介质)和通信介质(或暂时性介质)。如本领域普通技术人员公知的,术语计算机存储介质包括在用于存储信息(诸如计算机可读指令、数据结构、程序模块或其他数据)的任何方法或技术中实施的易失性和非易失性、可移除和不可移除介质。计算机存储介质包括但不限于RAM、ROM、EEPROM、闪存或其他存储器技术、CD-ROM、数字多功能盘(DVD)或其他光盘存储、磁盒、磁带、磁盘存储或其他磁存储装置、或者可以用于存储期望的信息并且可以被计算机访问的任何其他的介质。此外,本领域普通技术人员公知的是,通信介质通常包含计算机可读指令、数据结构、程序模块或者诸如载波或其他传输机制之类的调制数据信号中的其他数据,并且可包括任何信息递送介质。

上面结合附图对本申请实施例作了详细说明,但是本申请不限于上述实施例,在技术领域普通技术人员所具备的知识范围内,还可以在不脱离本申请宗旨的前提下作出各种变化。

- 基于虚拟物品的交互方法、装置及存储介质

- 一种虚拟物品交互方法、装置、设备及存储介质