实时显示试穿效果的服装虚拟试穿系统

文献发布时间:2023-06-19 12:05:39

技术领域

本发明属于智能服装设计制造领域,具体涉及实时显示试穿效果的服装虚拟试穿系统。

背景技术

目前,在网上服装商场进行服装采购时,普通客户只能参照卖家提供的“卖家秀”,即参照身穿服装的模特图来度量想象衣服是否合身,而无法依据自己的身形尺寸来具体考量。很多情况下会造成物流和时间上的浪费以及金钱的损失。在商城购买衣服时,也在频繁的换衣和排队中浪费了大量时间,降低了购物的体验。

现有的采用服装3D模型的虚拟试穿系统,在系统中预先存储服装3D模型,通过调节人体和取相设备之间的距离来间接调节服装的比例,根据服装部位特征将服装与人体图像融合。这种试穿系统在服装款式更替很频繁的情况下很难去及时建立服装的3D模型,且服饰的3D模型在重建的过程中会丢失原有的纹理细节。用户操作流程繁琐,不能起到及时试衣的效果。

公开号为CN111787242A的中国专利“用于虚拟试衣的方法和装置”通过对模特图片和用户照片的人体定位和表面坐标分析,对服饰进行分割,再根据对应的部位进行覆盖。这种方式没有考虑服饰随人体姿势变化后的标志,图案相应变化的问题,导致合成的试穿服装较为生硬。且对人体进行坐标分析进行定位时,会出现定位偏差而产生的贴合错误问题。

申请号为202010477405X的中国专利“虚拟试衣方法及装置、计算机可存储介质”通过将参考人像图、原始服饰图和目标姿态信息,直接通过卷积操作,生成目标人像图。这种方式没有考虑到服装的纹理细节形态生成模糊的缺陷,以及胳膊等躯干在合成过程中的缺失问题。

申请号为2020106155270的中国专利“一种虚拟试衣的方法、装置、系统及电子设备”采用获取的目标对象的第一图像,得到所述目标对象的三维图像以及所述目标对象的运动姿态;根据所述目标对象的运动姿态与多个服装样本之间的匹配关系,确定目标服装样本;将所述目标服装样本和所述三维图像进行合成,显示合成后的试衣图像。这种方式的模型生成过程相对比较困难,且算法相对比较复杂。

发明内容

本发明的目的是针对上述问题,提供一种实时显示试穿效果的服装虚拟试穿系统,采集试穿人的人体图像和试穿服装图像后,对人体图像进行语义分割,并提取人体姿势点,对试穿服装、人体语义分割图结合人体姿势点进行适应人体姿势的扭曲变换,对具姿势变换的目标服装、人体语义分割图像进行融合生成,并利用人体发肤的特征对得到的试穿服装的人体效果图再次进行融合优化,得到最终的试穿服装的人体效果图,使得试穿效果图更逼真,且可得到不同姿势的试穿效果图,便于判断服装试穿效果,提高服装试穿效率。

本发明的技术方案是实时显示试穿效果的服装虚拟试穿系统,包括处理器以及分别与其连接的可变焦距的摄像头、显示器、无线通信模块和人体检测传感器,补光灯经继电器与处理器连接,摄像头设置在显示器的外侧;补光灯用于摄像头拍摄目标物图像时提供辅助光线;人体检测传感器,用于检测有无目标物靠近摄像头;无线通信模块,与手持终端或计算机终端的通讯连接,便于手持终端或计算机终端上选择试穿姿势。

所述服装虚拟试穿系统还包括与处理器连接的距离传感器,用于检测目标物与显示器的距离。

优选地,所述显示器为人体高度的矩形镜面显示器。

所述服装虚拟试穿系统还包括经继电器与处理器连接的条形电阻丝,条形电阻丝用于显示器表面加热、除雾,条形电阻丝布置在显示器四周边缘。

进一步地,所述服装虚拟试穿系统还包括在处理器上运行的图像采集模块、姿势点提取模块、语义分割模块、姿势变换模块、服装融合模块和展示模块。

图像采集模块,利用摄像头拍摄得到试穿人的人体图像和试穿服装的目标服装图像。

姿势点提取模块,利用沙漏型卷积神经网络从人体图像中提取人体姿势点,得到姿势点图。

语义分割模块,利用变分自动编码器对人体图像进行语义分割,得到人体语义分割图。

姿势变换模块,将姿势点图与目标服装、人体语义分割图相结合,采用样条插值算法对目标服装、人体语义分割图进行多个试穿姿势的扭曲变换,得到具姿势变换的目标服装和人体语义分割图。

服装融合模块,采用可编码解码的卷积神经网络将具姿势变换的目标服务、人体语义分割图进行融合,得到试穿服装的人体效果图。

展示模块,将试穿服装的人体效果图通过显示器展示,根据用户的选择展示不同姿态的试穿服装的人体效果图。

优选地,所述沙漏型卷积神经网络采用OpenPose或CPM(Convolutional PoseMachine)或PoseCNN。

优选地,所用可编码解码的卷积神经网络为可采用Unet网络。

上述服装虚拟试穿系统的控制方法,包括以下步骤:

步骤1:分别采集试穿人和准备试穿的服装的图像,得到人体图像和目标服装图像;

步骤2:对人体图像进行语义分割,得到人体语义分割图;

步骤3:提取人体图像中的姿势点,得到姿势点图;

步骤4:将姿势点图与目标服装、人体语义分割图相结合,采用样条插值算法对目标服装、人体语义分割图进行多个试穿姿势的扭曲变换,得到具姿势变换的目标服装和人体语义分割图;

步骤5:将具姿势变换的目标服务、人体语义分割图进行融合,得到试穿服装的人体效果图;

步骤6:将步骤5得到的试穿服装的人体效果图与人体面部、肢体的肤色特征再次进行融合,得到最终的试穿服装的人体效果图。

相比现有技术,本发明的有益效果包括:

(1)本发明提供了可自动检测人体,自动变焦拍摄试穿人的人体图像和试穿服装图像,通过镜面显示器即时展示不同姿态的服装虚拟试穿效果,便于判断服装的穿着效果,代替现场的服装试穿,大大提高人试穿服装的效率,省时省力;

(2)本发明利用可编码解码的卷积神经网络对具姿势变换的目标服装和人体语义分割图进行融合生成后,再次利用人体面部、肢体的肤色特征对得到的试穿效果图进行融合优化,试穿效果图更逼真;

(3)本发明的系统不仅可以应用在线下服装商城中,也可以用于线上商城服装选购中的虚拟试穿;

(4)本发明通过试穿拍摄时提供可控的补光以及采用可变焦的摄像机来采集清晰的人体、试穿服装的图像,避免了黑暗或光线较弱的情况下采集图像模糊的问题,使用变焦摄像头来应对距离设备远近的问题,不需要进行图像增强处理和多摄像头,相比于现有技术,可极大减少计算成本和降低系统复杂性,提高了图像处理效率和实时性;

(5)低温环境下,本发明的系统可对显示器镜面加热、除雾,避免试穿人在观看服装试穿效果时显示器镜面有雾气而影响观看效果。

附图说明

下面结合附图和实施例对本发明作进一步说明。

图1为本发明实施例的服装虚拟试穿系统的结构示意图。

图2为本发明实施例的显示器的示意图。

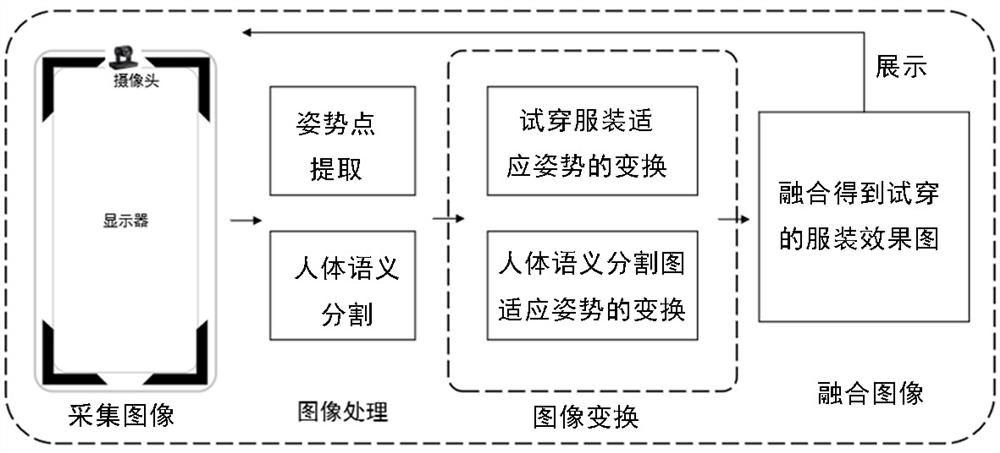

图3为本发明实施例的服装试穿系统的工作原理示意图。

图4为本发明实施例的服装虚拟试穿的流程示意图。

图5为本发明实施例的虚拟试穿的人体姿势变换系统的变分自动编码器的示意图。

图6为本发明实施例的虚拟试穿的人体姿势变换系统的OpenPose网络的示意图。

图7为本发明实施例的虚拟试穿的人体姿势变换系统的Unet网络的示意图。

具体实施方式

如图1和图2所示,实时显示试穿效果的服装虚拟试穿系统,包括处理器1以及分别与其连接的摄像头2、显示器3、无线通信模块5、人体检测传感器6、距离传感器7和光线传感器8,补光灯4经继电器与处理器1连接,摄像头2设置在显示器3的外侧;补光灯4用于摄像头拍摄目标物图像时提供辅助光线;人体检测传感器6,用于检测有无目标物靠近摄像头;无线通信模块5,与手持终端或计算机终端的通讯连接,便于手持终端或计算机终端上选择试穿姿势;距离传感器7,用于检测试穿人与显示器的距离。实施例中,显示器3为成人高度的长条形镜面显示器。显示器7四周边缘上设有条形电阻丝9,条形电阻丝9经继电器与处理器1连接,用于显示器镜面的加热、除雾。

实施例的服装虚拟试穿系统还包括在处理器上运行的图像采集模块、姿势点提取模块、语义分割模块、姿势变换模块、服装融合模块和展示模块。

图像采集模块,利用摄像头拍摄得到试穿人的人体图像和试穿服装的目标服装图像。

姿势点提取模块,利用OpenPose网络从人体图像中提取人体姿势点,得到姿势点图。

语义分割模块,利用变分自动编码器如Unet网络,对人体图像进行语义分割,得到人体语义分割图。

姿势变换模块,将姿势点图与目标服装、人体语义分割图相结合,采用样条插值算法对目标服装、人体语义分割图进行多个试穿姿势的扭曲变换,得到具姿势变换的目标服装和人体语义分割图。

服装融合模块,采用Unet网络将具姿势变换的目标服装、人体语义分割图进行融合,得到试穿服装的人体效果图。

展示模块,将试穿服装的人体效果图通过显示器展示,根据用户的选择展示不同姿态的试穿服装的人体效果图。

姿势点提取模块提取人体姿势点的过程包括:

(1)对采集的人体图像、服装图像进行模糊判断,剔除无效的模糊人体或服装图像,使用拉普拉斯算法计算图像的梯度,当模糊程度大于阈值b,则表示图像严重模糊,自动进行剔除,实施例的阈值b的取值为350;

(2)将采集的人体图像进行预处理,并提取其中的人体m个关节点如腕、肩的坐标值,实施例中m的取值为18;

(3)提取人体的轮廓图,将整个图像转化为灰度图,其中包含人体的部分用白色表示,其余部分用黑色表示;

(4)将人体的m个关节点根据其坐标值绘制到单通道的二值图上。

如图3和图4所示,实施例的服装虚拟试穿系统的控制方法,包括以下步骤:

步骤1:分别采集试穿人和准备试穿的服装的图像,得到人体图像和目标服装图像;

步骤2:对人体图像进行语义分割,人体图像的不同部位分别采用不同的RGB三通道的颜色值或单通道的灰度值区别表示,得到人体语义分割图,

步骤3:提取人体图像中的姿势点,得到姿势点图;

步骤4:将姿势点图与目标服装、人体语义分割图相结合,采用薄板样条插值算法对目标服装、人体语义分割图进行多个试穿姿势的扭曲变换,得到具姿势变换的目标服装和人体语义分割图;

步骤5:将具姿势变换的目标服务、人体语义分割图进行融合,得到试穿服装的人体效果图;

步骤6:将步骤5得到的试穿服装的人体效果图与人体面部、肢体的肤色特征再次进行融合,得到最终的试穿服装的人体效果图。

实施例的薄板样条插值算法参照Duchon等2006年发表的论文“Splinesminimizing rotation-invariant semi-norms in Sobolev spaces”公开的TPS插值算法。

实施例的变分自动编码器的神经网络结构参照Diederik等2014年发表的论文“Splines minimizing rotation-invariant semi-norms in Sobolev spaces”公开的VAE网络架构,如图5所示。

实施例的OpenPose网络的神经网络结构参照Cao等2017年发表的论文“OpenPose: Realtime Multi-Person 2D Pose Estimation Using Part AffinityFields”公开的OpenPose网络架构,如图6所示。

实施例的Unet网络的神经网络结构参照Ronneberger等2015年发表的论文 “U-Net: Convolutional Networks for Biomedical Image Segmentation”公开的Unet网络架构,如图7所示。

实施例的用于人体语义分割的Unet网络也可以是FCN(Fully ConvolutionalNetworks)或DeepLab网络。

实施例的用于提取人体姿势点的OpenPose网络也可以是CPM或PoseCNN。

本发明提供的新型的基于图像的虚拟试衣系统,可以实时准确的进行服装的试穿操作,通过深度学习技术,极大减少了计算量和计算成本,通过高新能网络服务器,可提高实时性,是对目标服装虚拟试穿的最高效的技术方案,具有极大的价值。

本领域的技术人员容易理解,以上所述仅为本发明的较佳实施例而已,并不用以限制本发明,凡在本发明的精神和原则之内所作的任何修改、等同替换和改进等,均应包含在本发明的保护范围之内。

- 实时显示试穿效果的服装虚拟试穿系统

- 用于服装虚拟试穿的人体姿势变换方法及系统