一种模型训练的方法、图像匹配的方法、装置及存储介质

文献发布时间:2023-06-19 13:46:35

技术领域

本申请涉及计算机视觉技术领域,尤其涉及一种模型训练的方法、图像匹配的方法、装置及存储介质。

背景技术

随着互联网技术的快速发展,用户在互图像海洋中寻找自己需要的内容越来越困难。因此,利用计算机提取图像的视觉内容并组织图像,同时提高图像检索和推荐的效率已经成为计算机视觉(Computer Vision,CV)领域的一个研究热点。

目前,通常采用图像匹配模型对两张图像的相似性进行判别。具体而言,可采用自监督学习的方法训练图像匹配模型。在自监督学习的过程中,对同一张图像中随机框选两个图像块作为正样本,从两张不同的图像分别随机框选一个图像块作为负样本。

然而,从图像中随机框选出的图像块,往往不具有较好的代表性。例如,可能会框选到一个核心区域(即,包含文本和图片的区域),另一个是空白区域。又或者,框选出两个空白区域。可见,采用不具有代表性的样本进行训练,会导致模型效果较差。

发明内容

本申请实施例提供了一种模型训练的方法、图像匹配的方法、装置及存储介质。本申请将图像划分为感兴趣区域和背景区域,由此,从图像中随机框选出的图像块时,能够更有针对性地对图像进行框选,取出具有代表性的图像块作为样本图像,从而有利于训练得到更具有鲁棒性的图像匹配模型。

有鉴于此,本申请一方面提供一种模型训练的方法,包括:

获取第一待训练图像;

基于第一待训练图像,通过语义分割模型获取第一区域分割结果,其中,第一区域分割结果用于确定第一待训练图像中的感兴趣区域以及背景区域,感兴趣区域包括文本区域或图片区域中的至少一种;

根据第一区域分割结果,获取来源于第一待训练图像的第一样本图像以及第二样本图像,其中,第一样本图像所包括的感兴趣区域的区域占比大于或等于占比阈值,第二样本图像所包括的感兴趣区域的区域占比大于或等于占比阈值;

根据第一样本图像以及第二样本图像,对待训练图像匹配模型的模型参数进行更新,直至满足模型训练条件,得到图像匹配模型。

本申请另一方面提供一种图像匹配的方法,包括:

获取第一待匹配图像;

获取第二待匹配图像;

基于第一待匹配图像以及第二待匹配图像,通过图像匹配模型确定匹配结果,其中,图像匹配模型为采用上述方面的方法训练得到的。

本申请另一方面提供一种模型训练装置,包括:

获取模块,用于获取第一待训练图像;

获取模块,还用于基于第一待训练图像,通过语义分割模型获取第一区域分割结果,其中,第一区域分割结果用于确定第一待训练图像中的感兴趣区域以及背景区域,感兴趣区域包括文本区域或图片区域中的至少一种;

获取模块,还用于根据第一区域分割结果,获取来源于第一待训练图像的第一样本图像以及第二样本图像,其中,第一样本图像所包括的感兴趣区域的区域占比大于或等于占比阈值,第二样本图像所包括的感兴趣区域的区域占比大于或等于占比阈值;

训练模块,用于根据第一样本图像以及第二样本图像,对待训练图像匹配模型的模型参数进行更新,直至满足模型训练条件,得到图像匹配模型。

在一种可能的设计中,在本申请实施例的另一方面的另一种实现方式中,

获取模块,具体用于从第一待训练图像随机选择第一图像以及第二图像;

根据第一区域分割结果,确定第一图像中感兴趣区域的区域占比,以及,确定第二图像中感兴趣区域的区域占比;

若第一图像中感兴趣区域的区域占比大于或等于占比阈值,则将第一图像作为第一样本图像;

若第二图像中感兴趣区域的区域占比大于或等于占比阈值,则将第二图像作为第二样本图像。

在一种可能的设计中,在本申请实施例的另一方面的另一种实现方式中,

获取模块,具体用于从第一待训练图像随机选择第一待处理图像以及第二待处理图像;

根据第一区域分割结果,确定第一待处理图像中感兴趣区域的区域占比,以及,确定第二待处理图像中感兴趣区域的区域占比;

若第一待处理图像中感兴趣区域的区域占比大于或等于占比阈值,则对第一待处理图像进行数据增广处理,得到第一样本图像;

若第二待处理图像中感兴趣区域的区域占比大于或等于占比阈值,则对第二待处理图像进行数据增广处理,得到第二样本图像。

在一种可能的设计中,在本申请实施例的另一方面的另一种实现方式中,

训练模块,具体用于基于第一样本图像,通过待训练图像匹配模型所包括的编码网络,获取第一特征图;

基于第一特征图,通过待训练图像匹配模型所包括的投影网络,获取第一特征向量;

基于第一特征向量,通过待训练图像匹配模型所包括的预测网络,获取目标特征向量;

基于第二样本图像,通过目标模型所包括的编码网络,获取第二特征图;

基于第二特征图,通过目标模型所包括的投影网络,获取第二特征向量;

根据目标特征向量以及第二特征向量,通过第一损失函数对待训练图像匹配模型的模型参数进行更新。

在一种可能的设计中,在本申请实施例的另一方面的另一种实现方式中,

获取模块,还用于获取第二待训练图像;

获取模块,还用于基于第二待训练图像,通过语义分割模型获取第二区域分割结果,其中,第二区域分割结果用于确定第二待训练图像中的感兴趣区域以及背景区域;

获取模块,还用于根据第二区域分割结果,获取来源于第二待训练图像的第三样本图像,其中,第三样本图像所包括的感兴趣区域占比大于或等于占比阈值;

训练模块,具体用于根据第一样本图像、第二样本图像以及第三样本图像,对待训练图像匹配模型的模型参数进行更新,直至满足模型训练条件,得到图像匹配模型。

在一种可能的设计中,在本申请实施例的另一方面的另一种实现方式中,

训练模块,具体用于基于第一样本图像以及第二样本图像,通过待训练图像匹配模型获取第一样本图像所对应的特征向量以及第二样本图像所对应的特征向量,第一样本图像以及第二样本图像属于正样本图像对,正样本图像对对应于正样本标签;

基于第一样本图像以及第三样本图像,通过待训练图像匹配模型获取第一样本图像所对应的特征向量以及第三样本图像所对应的特征向量,第一样本图像以及第三样本图像属于负样本图像对,负样本图像对对应于负样本标签;

根据第一样本图像所对应的特征向量以及第二样本图像所对应的特征向量,确定第一特征距离;

根据第一样本图像所对应的特征向量以及第三样本图像所对应的特征向量,确定第二特征距离;

根据第一特征距离、第二特征距离、正样本标签以及负样本标签,采用第二损失函数对待训练图像匹配模型的模型参数进行更新。

在一种可能的设计中,在本申请实施例的另一方面的另一种实现方式中,

训练模块,具体用于基于第一样本图像,通过待训练图像匹配模型获取第一样本图像所对应的嵌入向量;

基于第二样本图像,通过待训练图像匹配模型获取第二样本图像所对应的嵌入向量,其中,第二样本图像属于正样本图像;

基于第三样本图像,通过待训练图像匹配模型获取第三样本图像所对应的嵌入向量,其中,第三样本图像属于负样本图像;

根据第一样本图像所对应的嵌入向量以及第二样本图像所对应的嵌入向量,确定第一嵌入距离;

根据第一样本图像所对应的嵌入向量以及第三样本图像所对应的嵌入向量,确定第二嵌入距离;

根据第一嵌入距离以及第二嵌入距离,采用第三损失函数对待训练图像匹配模型的模型参数进行更新。

在一种可能的设计中,在本申请实施例的另一方面的另一种实现方式中,

训练模块,具体用于基于第一样本图像以及第二样本图像,通过待训练图像匹配模型获取预测分类结果,第一样本图像以及第二样本图像对应于标注分类标签;

根据预测分类结果以及标注分类标签,采用第四损失函数对待训练图像匹配模型的模型参数进行更新。

在一种可能的设计中,在本申请实施例的另一方面的另一种实现方式中,

获取模块,还用于获取训练样本图像,其中,训练样本图像包括M个像素点,每个像素点对应于一个类别标注标签,类别标注标签用于指示像素点属于感兴趣区域或背景区域,M为大于1的整数;

获取模块,还用于基于训练样本图像,通过待训练语义分割模型获取每个像素点的类别预测概率;

训练模块,还用于根据每个像素点的类别预测概率以及每个像素点的类别标注标签,采用第五损失函数对待训练语义分割模型的模型参数进行更新,直至满足模型训练条件,得到语义分割模型。

本申请另一方面提供一种图像匹配装置,包括:

获取模块,用于获取第一待匹配图像;

获取模块,还用于获取第二待匹配图像;

确定模块,用于基于第一待匹配图像以及第二待匹配图像,通过图像匹配模型确定匹配结果,其中,图像匹配模型为采用上述方面的方法训练得到的。

在一种可能的设计中,在本申请实施例的另一方面的另一种实现方式中,

确定模块,具体用于基于第一待匹配图像,通过图像匹配模型获取第一待匹配图像所对应的特征向量;

基于第二待匹配图像,通过图像匹配模型获取第二待匹配图像所对应的特征向量;

根据第一待匹配图像所对应的特征向量以及第二待匹配图像所对应的特征向量,确定目标特征距离;

若目标特征距离小于或等于距离阈值,则确定匹配结果为匹配成功;

若目标特征距离大于距离阈值,则确定匹配结果为匹配失败。

在一种可能的设计中,在本申请实施例的另一方面的另一种实现方式中,

确定模块,具体用于基于第一待匹配图像以及第二待匹配图像,通过图像匹配模型获取相似度分值;

若相似度分值大于或等于相似度阈值,则确定匹配结果为匹配成功;

若相似度分值小于相似度阈值,则确定匹配结果为匹配失败。

本申请另一方面提供一种计算机设备,包括:存储器、处理器以及总线系统;

其中,存储器用于存储程序;

处理器用于执行存储器中的程序,处理器用于根据程序代码中的指令执行上述各方面的方法;

总线系统用于连接存储器以及处理器,以使存储器以及处理器进行通信。

本申请的另一方面提供了一种计算机可读存储介质,计算机可读存储介质中存储有指令,当其在计算机上运行时,使得计算机执行上述各方面的方法。

本申请的另一个方面,提供了一种计算机程序产品或计算机程序,该计算机程序产品或计算机程序包括计算机指令,该计算机指令存储在计算机可读存储介质中。计算机设备的处理器从计算机可读存储介质读取该计算机指令,处理器执行该计算机指令,使得该计算机设备执行上述各方面所提供的方法。

从以上技术方案可以看出,本申请实施例具有以下优点:

本申请提供了一种模型训练的方法,首先获取第一待训练图像,然后基于第一待训练图像,通过语义分割模型获取第一区域分割结果,第一区域分割结果用于确定第一待训练图像中的感兴趣区域以及背景区域,根据第一区域分割结果,基于此,获取来源于第一待训练图像的第一样本图像以及第二样本图像,第一样本图像所包括的感兴趣区域的区域占比大于或等于占比阈值,第二样本图像所包括的感兴趣区域的区域占比大于或等于占比阈值。最后,可以根据第一样本图像以及第二样本图像,对待训练图像匹配模型的模型参数进行更新,直至满足模型训练条件,得到图像匹配模型。通过上述方式,将图像划分为感兴趣区域和背景区域,由此,从图像中随机框选出的图像块时,能够更有针对性地对图像进行框选,取出具有代表性的图像块作为样本图像,从而有利于训练得到更具有鲁棒性的图像匹配模型。

附图说明

图1为本申请实施例中图像匹配系统的一个架构示意图;

图2为本申请实施例中模型训练与图像匹配的一个流程示意图;

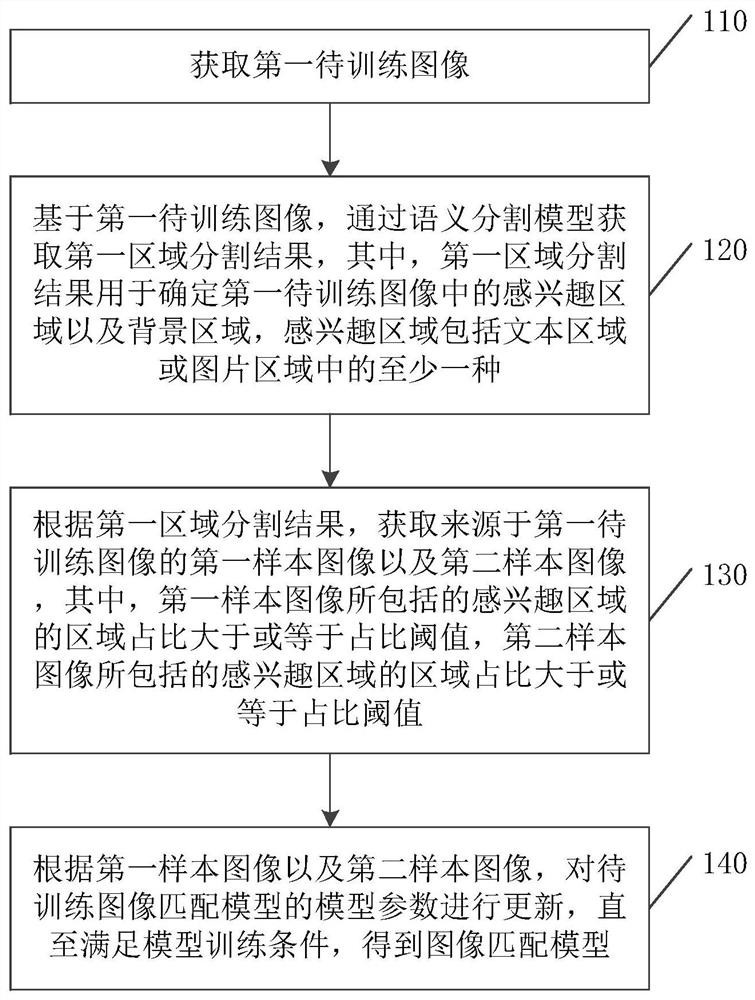

图3为本申请实施例中模型训练方法的一个流程示意图;

图4为本申请实施例中基于语义分割模型进行模型训练的一个示意图;

图5为本申请实施例中随机框选图像块的一个示意图;

图6为本申请实施例中随机框选图像块的另一个示意图;

图7为本申请实施例中待训练图像匹配模型的一个结构示意图;

图8为本申请实施例中随机框选图像块的另一个示意图;

图9为本申请实施例中待训练图像匹配模型的另一个结构示意图;

图10为本申请实施例中待训练图像匹配模型的另一个结构示意图;

图11为本申请实施例中待训练图像匹配模型的另一个结构示意图;

图12为本申请实施例中标注感兴趣区域和背景区域的一个示意图;

图13为本申请实施例中图像匹配方法的一个流程示意图;

图14为本申请实施例中图像匹配模型的一个结构示意图;

图15为本申请实施例中图像匹配模型的另一个结构示意图;

图16为本申请实施例中模型训练装置的一个示意图;

图17为本申请实施例中图像匹配装置的一个示意图;

图18为本申请实施例中服务器的一个结构示意图;

图19为本申请实施例中终端设备的一个结构示意图。

具体实施方式

本申请实施例提供了一种模型训练的方法、图像匹配的方法、装置及存储介质。本申请将图像划分为感兴趣区域和背景区域,由此,从图像中随机框选出的图像块时,能够更有针对性地对图像进行框选,取出具有代表性的图像块作为样本图像,从而有利于训练得到更具有鲁棒性的图像匹配模型。

本申请的说明书和权利要求书及上述附图中的术语“第一”、“第二”、“第三”、“第四”等(如果存在)是用于区别类似的对象,而不必用于描述特定的顺序或先后次序。应该理解这样使用的数据在适当情况下可以互换,以便这里描述的本申请的实施例例如能够以除了在这里图示或描述的那些以外的顺序实施。此外,术语“包括”和“对应于”以及他们的任何变形,意图在于覆盖不排他的包含,例如,包含了一系列步骤或单元的过程、方法、系统、产品或设备不必限于清楚地列出的那些步骤或单元,而是可包括没有清楚地列出的或对于这些过程、方法、产品或设备固有的其它步骤或单元。

近年来,人工智能(Artificial Intelligence,AI)领域得到了社会各界前所未有的关注,机器不断地模拟甚至在一定程度上超越了人类特有的优势和技能。其中,计算机视觉技术(Computer Vision,CV)技术属于AI领域发展的核心之一,CV是一门研究如何使机器“看”的科学,更进一步的说,就是指用摄影机和电脑代替人眼对目标进行识别、跟踪和测量等机器视觉,并进一步做图形处理,使电脑处理成为更适合人眼观察或传送给仪器检测的图像。作为一个科学学科,计算机视觉研究相关的理论和技术,试图建立能够从图像或者多维数据中获取信息的人工智能系统。计算机视觉技术通常包括图像处理、图像识别、图像语义理解、图像检索、光学字符识别(Optical Character Recognition,OCR)、视频处理、视频语义理解、视频内容/行为识别、三维物体重建、3D技术、虚拟现实、增强现实、同步定位与地图构建、自动驾驶、智慧交通等技术,还包括常见的人脸识别、指纹识别等生物特征识别技术。借助CV技术可实现图像匹配,下面将对本申请提供的图像匹配方法的部分应用场景进行介绍。

场景一,以图搜图的应用场景;

(1)电商购物:用户可查找类似商品进行同款比较。即用户上传商品图片A,由服务器调用图像匹配模型对商品图片A与后台存储的其他商品图片进行两两匹配,由此找出相似度较高的商品图片。

(2)娱乐方向:用户可凭借影片截图找到电影或电视剧的名字。即用户上传截图A,由服务器调用图像匹配模型对截图A与后台存储的其他截图进行两两匹配,由此找出相似度最高的截图。

(3)图像检索:在搜图网站中上传图片A,由服务器调用图像匹配模型对图片A与后台存储的其他图片进行两两匹配,由此找出相似度较高的图片作为检索结果。

场景二,识别图文内容的应用场景;

感兴趣内容识别:从网页上截取图文图像,其中,图文图像包括文字图像以及图片中的至少一种,文字图像是指以图像形式呈现的文字。由服务器调用图像匹配模型对文字图像与后台存储的文字图像进行两两匹配,由此找出相似度较高的图文图像。

为了在上述场景减少检索时产生的图像误匹配,需要训练得到鲁棒性更好的图像匹配模型,本申请提出了一种模型训练的方法,该方法应用于图1所示的图像匹配系统,如图所示,图像匹配系统包括服务器和终端设备,且客户端部署于终端设备上,其中,客户端可以通过浏览器的形式运行于终端设备上,也可以通过独立的应用程序(application,APP)的形式运行于终端设备上等,对于客户端的具体展现形式,此处不做限定。本申请涉及的服务器可以是独立的物理服务器,也可以是多个物理服务器构成的服务器集群或者分布式系统,还可以是提供云服务、云数据库、云计算、云函数、云存储、网络服务、云通信、中间件服务、域名服务、安全服务、内容分发网络(Content Delivery Network,CDN)、以及大数据和人工智能平台等基础云计算服务的云服务器。终端设备可以是智能手机、平板电脑、笔记本电脑、掌上电脑、个人电脑、智能电视、智能手表、车载设备、可穿戴设备等,但并不局限于此。终端设备以及服务器可以通过有线或无线通信方式进行直接或间接地连接,本申请在此不做限制。服务器和终端设备的数量也不做限制。本申请提供的方案可以由终端设备独立完成,也可以由服务器独立完成,还可以由终端设备与服务器配合完成,对此,本申请并不做具体限定。

基于此,结合图1所示的图像匹配系统,可实现模型训练和图像匹配。为了便于理解,请参阅图2,图2为本申请实施例中模型训练与图像匹配的一个流程示意图,如图所示,具体地:

在步骤S1中,首先需要收集目标场景下的训练样本图像,其中,目标场景可以是指网页或者公众号等,训练样本图像表示在目标场景下截取的图像。

在步骤S2中,从这些训练样本图像中选取部分的训练样本图像进行人工标注。例如,选择1万张训练样本图像进行标注,即分别标注训练样本图像中的文本区域、图片区域以及背景区域。

在步骤S3中,利用标注图像训练得到语义分割模型,实现对待训练图像中的文本区域、图片区域以及背景区域的分割。使用训练好的语义分割模型对所有待训练图像进行分割,由此得到每个待训练图像的分割区域。

在步骤S4中,在随机采样的时候,检测样本图像的文字区域和图片区域的占比之和是否大于或等于占比阈值,如果大于或等于占比阈值,则占比符合要求,由此,选择符合要求的样本图像训练得到图像匹配模型。

在步骤S5中,使用训练好的图像匹配模型提取两个图像的图像特征值,根据两个图像特征值之间的欧式距离度量两个图像之间的相似度。

结合上述介绍,下面将对本申请中模型训练的方法进行介绍,请参阅图3,本申请实施例中模型训练方法的一个实施例包括:

110、获取第一待训练图像;

在一个或多个实施例中,模型训练装置可从待训练图像集合中选择一个待训练图像作为第一待训练图像,其中,待训练图像集合所包括的待训练图像可以是页面截图,或者,应用截图等,此处不做限定。

需要说明的是,本申请提供的模型训练装置可部署于服务器,或者,可部署于终端设备,又或者,可部署于由服务器和终端设备构成的系统,此处不做限定。

120、基于第一待训练图像,通过语义分割模型获取第一区域分割结果,其中,第一区域分割结果用于确定第一待训练图像中的感兴趣区域以及背景区域,感兴趣区域包括文本区域或图片区域中的至少一种;

在一个或多个实施例中,模型训练装置将第一待训练图像输入至语义分割模型,由语义分割模型输出第一区域分割结果,其中,第一区域分割结果用于将第一待训练图像分割为感兴趣区域以及背景区域。可以理解的是,感兴趣区域包括文本区域或图片区域中的至少一种,文本区域包括以图片形式呈现的文本内容。

130、根据第一区域分割结果,获取来源于第一待训练图像的第一样本图像以及第二样本图像,其中,第一样本图像所包括的感兴趣区域的区域占比大于或等于占比阈值,第二样本图像所包括的感兴趣区域的区域占比大于或等于占比阈值;

在一个或多个实施例中,模型训练装置根据第一区域分割结果,将第一待训练图像划分为感兴趣区域和背景区域,在选择第一样本图像以及第二样本图像的时候,需要令第一样本图像所包括的感兴趣区域的区域占比大于或等于占比阈值,且,令第二样本图像所包括的感兴趣区域的区域占比也大于或等于占比阈值。提取第一样本图像和第二样本图像方式有多种,下面将分别进行介绍。

示例性地,可从第一待训练图像中随机截取一个符合要求(即,感兴趣区域的区域占比大于或等于占比阈值)的第一样本图像,并且,从第一待训练图像中随机截取另一个符合要求的第二样本图像。

示例性地,可从第一待训练图像中随机截取一个符合要求(即,感兴趣区域的区域占比大于或等于占比阈值)的第一样本图像,然而对第一样本图像进行数据增广处理,以此得到第二样本图像。

140、根据第一样本图像以及第二样本图像,对待训练图像匹配模型的模型参数进行更新,直至满足模型训练条件,得到图像匹配模型。

在一个或多个实施例中,模型训练装置将第一样本图像以及第二样本图像输入至待训练图像匹配模型,由待训练图像匹配模型输出预测值。使用损失函数来估计待训练图像匹配模型的预测值和真实值的不一致程度,训练模型的过程通过不断的迭代计算,使用梯度下降的优化算法,使得损失函数越来越小。

可以理解的是,模型训练条件包括“耗尽准则”以及“观察准则”。示例性地,以“耗尽准则”为例,如果模型迭代次数达到迭代次数阈值(例如,10000次),则表示满足模型训练条件,由此,将更新后的模型参数作为图像匹配模型的模型参数。示例性地,以“观察准则”为例,如果损失值已收敛,则表示满足模型训练条件,由此,将更新后的模型参数作为图像匹配模型的模型参数。

基于此,为了便于介绍,请参阅图4,图4为本申请实施例中基于语义分割模型进行模型训练的一个示意图,如图所示,将第一待训练图像输入至语义分割模型,由语义分割模型输出第一区域分割结果。第一区域分割结果包括圈出来的感兴趣区域,感兴趣区域包括A1所指示的图片区域以及A2所指示的文本区域。由此,可从第一待训练图像随机框选两个图像款,即第一样本图像和第二样本图像,其中,第一样本图像和第二样本图像属于一个正样本图像对。基于正样本图像对图像匹配模型进行训练,直至满足模型训练条件,得到图像匹配模型。

本申请提供了一种模型训练的方法,通过上述方式,将图像划分为感兴趣区域和背景区域,由此,从图像中随机框选出的图像块时,能够更有针对性地对图像进行框选,取出具有代表性的图像块作为样本图像,从而有利于训练得到更具有鲁棒性的图像匹配模型。

可选地,在上述图3对应的各个实施例的基础上,本申请实施例提供的另一个可选实施例中,根据第一区域分割结果,获取来源于第一待训练图像的第一样本图像以及第二样本图像,具体可以包括:

从第一待训练图像随机选择第一图像以及第二图像;

根据第一区域分割结果,确定第一图像中感兴趣区域的区域占比,以及,确定第二图像中感兴趣区域的区域占比;

若第一图像中感兴趣区域的区域占比大于或等于占比阈值,则将第一图像作为第一样本图像;

若第二图像中感兴趣区域的区域占比大于或等于占比阈值,则将第二图像作为第二样本图像。

在一个或多个实施例中,介绍了一种直接提取正样本图像对的方式。由前述实施例可知,可直接从待训练图像(例如,第一待训练图像)中取出符合要求的第一样本图像和第二样本图像。

具体地,为了便于理解,请参阅图5,图5为本申请实施例中随机框选图像块的一个示意图,如图所示,第一待训练图像经过语义分割模型之后可得到第一区域分割结果。由此,从第一待训练图像随机选择两个图像块,两个图像块分别为B1所指示的第一图像,以及B2所指示的第二图像。基于此,根据第一区域分割结果,可以确定第一图像中感兴趣区域的区域占比,以及第二图像中感兴趣区域的区域占比。以图5为例,假设第一图像中感兴趣区域的区域占比为100%,第二图像中感兴趣区域的区域占比为80%,假设占比阈值为70%,由此可见,第一图像中感兴趣区域的区域占比大于或等于占比阈值,因此,将第一图像作为第一样本图像。类似地,第二图像中感兴趣区域的区域占比大于或等于占比阈值,因此,将第二图像作为第二样本图像。

其次,本申请实施例中,提供了一种直接提取正样本图像对的方式,通过上述方式,可直接从待训练图像中随机提取符合要求的样本图像,由此,利用这些样本图像能够进行后续的模型训练,从而增加方案的可行性和可操作性。

可选地,在上述图3对应的各个实施例的基础上,本申请实施例提供的另一个可选实施例中,根据第一区域分割结果,获取来源于第一待训练图像的第一样本图像以及第二样本图像,具体可以包括:

从第一待训练图像随机选择第一待处理图像以及第二待处理图像;

根据第一区域分割结果,确定第一待处理图像中感兴趣区域的区域占比,以及,确定第二待处理图像中感兴趣区域的区域占比;

若第一待处理图像中感兴趣区域的区域占比大于或等于占比阈值,则对第一待处理图像进行数据增广处理,得到第一样本图像;

若第二待处理图像中感兴趣区域的区域占比大于或等于占比阈值,则对第二待处理图像进行数据增广处理,得到第二样本图像。

在一个或多个实施例中,介绍了一种基于数据增广提取正样本图像对的方式。由前述实施例可知,可从待训练图像(例如,第一待训练图像)中取出符合要求的第一待处理图像以及第二待处理图像,再分别对待处理图像进行数据增广处理,由此得到第一样本图像和第二样本图像。

具体地,为了便于理解,请参阅图6,图6为本申请实施例中随机框选图像块的另一个示意图,如图所示,第一待训练图像经过语义分割模型之后可得到第一区域分割结果。由此,从第一待训练图像随机选择两个图像块,两个图像块分别为C1所指示的第一待处理图像,以及C2所指示的第二待处理图像。基于此,根据第一区域分割结果,可以确定第一待处理图像中感兴趣区域的区域占比,以及第二待处理图像中感兴趣区域的区域占比。以图6为例,假设第一待处理图像中感兴趣区域的区域占比为100%,第二待处理图像中感兴趣区域的区域占比为80%,假设占比阈值为70%,由此可见,第一待处理图像中感兴趣区域的区域占比大于或等于占比阈值,因此,对第一待处理图像进行数据增广处理,得到第一样本图像,并且对第二待处理图像进行数据增广处理,得到第二样本图像。

需要说明的是,数据增广处理包含但不仅限于高斯模糊,色彩变换,灰度变换以及旋转等,图6以旋转作为数据增广处理的方式,然而,这不应理解为对本申请的限定。

其次,本申请实施例中,提供了一种基于数据增广提取正样本图像对的方式,通过上述方式,可从待训练图像中随机提取符合要求的一个样本图像,然后对该样本图像进行数据增广,得到另一个样本图像,由此,利用这些样本图像能够进行后续的模型训练,从而增加方案的可行性和可操作性。

可选地,在上述图3对应的各个实施例的基础上,本申请实施例提供的另一个可选实施例中,根据第一样本图像以及第二样本图像,对待训练图像匹配模型的模型参数进行更新,具体可以包括:

基于第一样本图像,通过待训练图像匹配模型所包括的编码网络,获取第一特征图;

基于第一特征图,通过待训练图像匹配模型所包括的投影网络,获取第一特征向量;

基于第一特征向量,通过待训练图像匹配模型所包括的预测网络,获取目标特征向量;

基于第二样本图像,通过目标模型所包括的编码网络,获取第二特征图;

基于第二特征图,通过目标模型所包括的投影网络,获取第二特征向量;

根据目标特征向量以及第二特征向量,通过第一损失函数对待训练图像匹配模型的模型参数进行更新。

在一个或多个实施例中,介绍了一种基于引导你自己的潜能(bootstrap yourown latent,BYOL)框架对图像匹配模型进行训练的方式。在BYOL框架中,对于输入图像(例如,第一待训练图像)而言,通过两种随机的图像增强策略可分别得到两个图像(例如,第一样本图像以及第二样本图像)。

具体地,为了便于理解,请参阅图7,图7为本申请实施例中待训练图像匹配模型的一个结构示意图,如图所示,BYOL框架包括在线网络(online network)以及目标网络(target network),其中,图7中所示的待训练图像匹配模型即为在线网络。将第一样本图像输入至待训练图像匹配模型所包括的编码网络(即,编码网络1),由此输出第一特征图。然后将第一特征图输入至待训练图像匹配模型所包括的投影网络(即,投影网络1),由此输出第一特征向量。再将第一特征向量输入至待训练图像匹配模型所包括预测网络,由此输出目标特征向量。

类似地,将第二样本图像输入至待训练图像匹配模型所包括的编码网络(即,编码网络2),由此输出第二特征图。然后将第二特征图输入至待训练图像匹配模型所包括的投影网络(即,投影网络2),由此输出第二特征向量。

基于此,可采用第一损失函数计算目标特征向量与第二特征向量之间的损失值,对待训练图像匹配模型的模型参数进行更新。第一损失函数可以是L2损失函数,具体为:

其中,θ表示在线网络(即,待训练图像匹配模型)的模型参数。ξ表示目标网络的模型参数。z

需要说明的是,编码网络可以为残差网络-50(Residual Network,Resnet-50)。投影网络可包括全连接(fully connected layers,FC)层、批量归一化(BatchNormalization,BN)层以及线性整流函数(Rectified Linear Unit,ReLU)。

模型训练完成后,可将待训练图像匹配模型(即,在线网络)作为图像匹配模型,用于进行后续的图像匹配。

其次,本申请实施例中,提供了一种基于BYOL框架对图像匹配模型进行训练的方式,通过上述方式,依赖于两个网络之间的相互作用以及相互学习,能够在没有负样本对的情况下达到较高的分类准确率,从而提升图像匹配模型的鲁棒性。

可选地,在上述图3对应的各个实施例的基础上,本申请实施例提供的另一个可选实施例中,还可以包括:

获取第二待训练图像;

基于第二待训练图像,通过语义分割模型获取第二区域分割结果,其中,第二区域分割结果用于确定第二待训练图像中的感兴趣区域以及背景区域;

根据第二区域分割结果,获取来源于第二待训练图像的第三样本图像,其中,第三样本图像所包括的感兴趣区域占比大于或等于占比阈值;

根据第一样本图像以及第二样本图像,对待训练图像匹配模型的模型参数进行更新,直至满足模型训练条件,得到图像匹配模型,具体可以包括:

根据第一样本图像、第二样本图像以及第三样本图像,对待训练图像匹配模型的模型参数进行更新,直至满足模型训练条件,得到图像匹配模型。

在一个或多个实施例中,介绍了一种采用正负图像样本对共同进行训练的方式。由前述实施例可知,可从待训练图像(例如,第一待训练图像)中取出符合要求的第一待处理图像以及第二待处理图像,第一待处理图像以及第二待处理图像构成一个正样本图像对。类似地,可分别从两个待训练图像(例如,第一待训练图像以及第二待训练图像)中取出符合要求的第一待处理图像(或,第二待处理图像,或,第四样本图像)以及第三待处理图像,第一待处理图像(或,第二待处理图像,或,第四样本图像)以及第三待处理图像构成一个负样本图像对。可以理解的是,负样本图像对所包括的两个样本图像分别来源于不同的待处理图像。

具体地,为了便于理解,请参阅图8,图8为本申请实施例中随机框选图像块的另一个示意图,如图所示,第一待训练图像经过语义分割模型之后可得到第一区域分割结果。由此,从第一待训练图像随机选择两个符合要求的图像块,例如,两个图像块分别为D1所指示的第一样本图像,以及D2所指示的第二样本图像。第一样本图像以及第二样本图像共同构成一个正样本图像对。类似地,第二待训练图像经过语义分割模型之后可得到第二区域分割结果。由此,从第一待训练图像随机选择一个符合要求的图像块,例如,该图像块为D3所指示的第三样本图像。此外,还可以从一个待训练图像中提取一个符合要求的图像块,以第一待训练图像为例,示例性地,可直接提取第一样本图像,由此,第一样本图像以及第三样本图像共同构成一个负样本图像对。示例性地,可直接提取第二样本图像,由此,第二样本图像以及第三样本图像共同构成一个负样本图像对。示例性地,可直接提取第四样本图像(即,重新提取一个样本图像),由此,第四样本图像以及第三样本图像共同构成一个负样本图像对。

可以理解的是,符合要求的样本图像具体是指图像中的感兴趣区域占比大于或等于占比阈值。

假设由第一样本图像以及第二样本图像共同构成一个正样本图像对,由第一样本图像以及第三样本图像共同构成一个负样本图像对。基于此,结合正样本图像对与负样本图像对,对待训练图像匹配模型的模型参数进行更新,直至满足模型训练条件,得到图像匹配模型。

其次,本申请实施例中,提供了一种采用正负图像样本对共同进行训练的方式,通过上述方式,可从同一个待训练图像中提取正样本图像对,并分别从不同的待训练图像提取负样本图像对,基于此,使用正样本图像对和负样本图像对对共同进行训练,能够提升图像匹配模型的鲁棒性。

可选地,在上述图3对应的各个实施例的基础上,本申请实施例提供的另一个可选实施例中,根据第一样本图像、第二样本图像以及第三样本图像,对待训练图像匹配模型的模型参数进行更新,具体可以包括:

基于第一样本图像以及第二样本图像,通过待训练图像匹配模型获取第一样本图像所对应的特征向量以及第二样本图像所对应的特征向量,第一样本图像以及第二样本图像属于正样本图像对,正样本图像对对应于正样本标签;

基于第一样本图像以及第三样本图像,通过待训练图像匹配模型获取第一样本图像所对应的特征向量以及第三样本图像所对应的特征向量,第一样本图像以及第三样本图像属于负样本图像对,负样本图像对对应于负样本标签;

根据第一样本图像所对应的特征向量以及第二样本图像所对应的特征向量,确定第一特征距离;

根据第一样本图像所对应的特征向量以及第三样本图像所对应的特征向量,确定第二特征距离;

根据第一特征距离、第二特征距离、正样本标签以及负样本标签,采用第二损失函数对待训练图像匹配模型的模型参数进行更新。

在一个或多个实施例中,介绍了一种结合正负图像样本对采用对比损失函数对图像匹配模型进行训练的方式。由前述实施例可知,在自监督网络训练的过程中,对于待训练图像而言,可随机框选出符合要求的第一样本图像、第二样本图像和第三样本图像。可以理解的是,本申请以第一样本图像以及第二样本图像属于正样本图像对,第一样本图像以及第三样本图像属于负样本图像对为例进行说明。

具体地,为了便于理解,请参阅图9,图9为本申请实施例中待训练图像匹配模型的另一个结构示意图,如图所示,待训练图像匹配模型包括子模型1和子模型2。其中,样本图像1和样本图像2为一个样本图像对(例如,由第一样本图像和第二样本图像组成的正样本图像对,或,由第一样本图像和第三样本图像组成的负样本图像对),由此,将样本图像1输入至子模型1,由子模型1输出特征向量1。将样本图像2输入至子模型2,由子模型2输出特征向量2。根据特征向量1和特征向量2,可计算得到两个样本图像之间的欧式距离。在实际应用中,可以分别将N组样本图像对输入至待训练图像匹配模型,由此,根据预测得到的特征向量计算样本图像对之间的欧式距离,进而进行模型参数的更新。

基于此,可采用第二损失函数计算欧式距离与真实标签之间的损失值,对待训练图像匹配模型的模型参数进行更新。第二损失函数可采用对比损失(Contrastive Loss)函数,具体为:

其中,L

可以理解的是,对比损失函数主要是用于特征提取的应用,即,原本相似的样本图像,在经过特征提取后,在特征空间中,两个样本图像仍旧相似;而原本不相似的样本图像,在经过特征提取后,在特征空间中,两个样本图像仍旧不相似。同样,该损失函数也可以很好的表达成对样本图像之间的匹配程度。

需要说明的是,待训练图像匹配模型属于孪生神经网络(siamese neuralnetwork,SNN),因此,待训练图像匹配模型可包括两个分支,即包括两个子模型。两个子模型的网络结构相同,模型参数共享。孪生神经网络每次需要输入两个样本图像作为一个样本图像对。将输入的样本图像映射为一个特征向量,使用两个特征向量之间的样本图像对来表示输入之间在图像语义上的差距。孪生神经网络可以用以判断两个样本图像之间的相似度。

模型训练完成后,可从待训练图像匹配模型中提取任意一个子模型作为图像匹配模型,用于进行后续的图像匹配。

再次,本申请实施例中,提供了一种结合正负图像样本对采用对比损失函数对图像匹配模型进行训练的方式,通过上述方式,将孪生神经网络的网络结构作为图像匹配模型的网络结构,因此,可使用对比损失函数有效地处理孪生神经网络中的成对样本图像的关系,并且很好的表达成对样本图像的匹配程度,从而很好的用于训练提取特征的模型。

可选地,在上述图3对应的各个实施例的基础上,本申请实施例提供的另一个可选实施例中,根据第一样本图像、第二样本图像以及第三样本图像,对待训练图像匹配模型的模型参数进行更新,具体可以包括:

基于第一样本图像,通过待训练图像匹配模型获取第一样本图像所对应的嵌入向量;

基于第二样本图像,通过待训练图像匹配模型获取第二样本图像所对应的嵌入向量,其中,第二样本图像属于正样本图像;

基于第三样本图像,通过待训练图像匹配模型获取第三样本图像所对应的嵌入向量,其中,第三样本图像属于负样本图像;

根据第一样本图像所对应的嵌入向量以及第二样本图像所对应的嵌入向量,确定第一嵌入距离;

根据第一样本图像所对应的嵌入向量以及第三样本图像所对应的嵌入向量,确定第二嵌入距离;

根据第一嵌入距离以及第二嵌入距离,采用第三损失函数对待训练图像匹配模型的模型参数进行更新。

在一个或多个实施例中,介绍了一种结合正负样本图像并采用三重损失函数对孪生网络进行训练的方式。由前述实施例可知,在自监督网络训练的过程中,对于待训练图像而言,可随机框选出符合要求的第一样本图像、第二样本图像和第三样本图像。可以理解的是,本申请以第一样本图像作为基准图像(anchor),第二样本图像作为正样本图像,第三样本图像作为负样本图像为例进行说明。

具体地,为了便于理解,请参阅图10,图10为本申请实施例中待训练图像匹配模型的另一个结构示意图,如图所示,待训练图像匹配模型包括子模型1、子模型2和子模型3。其中,样本图像2为第一样本图像(即,基准图像),样本图像1为第二样本图像(即,正样本图像),样本图像3为第三样本图像(即,负样本图像)。由此,将样本图像1输入至子模型1,由子模型1输出嵌入向量1。将样本图像2输入至子模型2,由子模型2输出嵌入向量2。将样本图像3输入至子模型3,由子模型3输出嵌入向量3。根据嵌入向量1和嵌入向量2,可计算得到两个样本图像之间的嵌入距离。根据嵌入向量2和嵌入向量3,也可计算得到两个样本图像之间的嵌入距离。在实际应用中,可以分别将N个三元组样本图像输入至待训练图像匹配模型,基于此预测得到的嵌入向量计算三元组样本图像之间的欧式距离,进而进行模型参数的更新。

如果需要提升模型的鲁棒性,不仅要将正负样本图像区分开,还需要使得类内更加紧凑,而类间更加疏远。因此,待训练图像匹配模型可以将输入变为三个,训练的时候使用一个正样本图像和两个负样本图像,或者,使用一个负样本图像和两个正样本图像,本申请以使用一个负样本图像和两个正样本图像为例进行介绍,然而这不应理解为对本申请的限定。

基于此,可采用第三损失函数计算嵌入距离之间的损失值,对待训练图像匹配模型的模型参数进行更新。第三损失函数可采用三重损失(Triplet Loss)函数,具体为:

L

其中,L

需要说明的是,待训练图像匹配模型属于孪生神经网络,因此,待训练图像匹配模型可包括三个分支,即包括三个子模型。两个三网络的网络结构相同,模型参数共享。孪生神经网络每次需要输入三个样本图像作为一个三元组样本图像。

模型训练完成后,可从待训练图像匹配模型中提取任意一个子模型作为图像匹配模型,用于进行后续的图像匹配。

再次,本申请实施例中,提供了一种结合正负样本图像并采用三重损失函数对孪生网络进行训练的方式,通过上述方式,将孪生神经网络的网络结构作为图像匹配模型的网络结构,因此,可使用三重损失函数有效地处理孪生神经网络中的三个关联样本图像之间的关系,并且很好的表达三个关联样本图像的匹配程度,从而很好的用于训练提取特征的模型。

可选地,在上述图3对应的各个实施例的基础上,本申请实施例提供的另一个可选实施例中,根据第一样本图像以及第二样本图像,对待训练图像匹配模型的模型参数进行更新,具体可以包括:

基于第一样本图像以及第二样本图像,通过待训练图像匹配模型获取预测分类结果,第一样本图像以及第二样本图像对应于标注分类标签;

根据预测分类结果以及标注分类标签,采用第四损失函数对待训练图像匹配模型的模型参数进行更新。

在一个或多个实施例中,介绍了一种结合正样本并采用损失函数对孪生网络进行训练的方式。由前述实施例可知,在网络训练的过程中,对于待训练图像而言,可随机框选出符合要求的第一样本图像和第二样本图像。可以理解的是,本申请以第一样本图像以及第二样本图像属于正样本图像对为例进行说明。

具体地,为了便于理解,请参阅图11,图11为本申请实施例中待训练图像匹配模型的另一个结构示意图,如图所示,待训练图像匹配模型包括子模型1和子模型2。其中,样本图像1和样本图像2为一个样本图像对(例如,由第一样本图像和第二样本图像组成的正样本图像对,或,由第一样本图像和第三样本图像组成的负样本图像对),由此,将样本图像1输入至子模型1,由子模型1输出特征向量1。将样本图像2输入至子模型2,由子模型2输出特征向量2。将特征向量1和特征向量2共同输入至分类网络,通过分类网络输出预测分类结果。其中,分类网络包括全连接层。预测分类结果可表示为一个大于或等于0,且小于或等于1的相似度分值,相似度分值越大,表示相似程度越高。

在实际应用中,可以分别将N组样本图像对输入至待训练图像匹配模型,由此,根据预测分类结果与标注分类标签之间的距离,进而进行模型参数的更新。

基于此,可采用第四损失函数计算欧式距离与真实标签之间的损失值,对待训练图像匹配模型的模型参数进行更新。在一种情况下,第四损失函数可采用均方误差(meansquared error,MSE)损失函数,具体为:

其中,L

在另一种情况下,第四损失函数可采用平均绝对值误差(mean absolute error,MAE)损失函数,具体为:

其中,L

可以理解的是,第四损失函数还可以是其他类型的损失函数,此处不做限定。

需要说明的是,待训练图像匹配模型属于孪生神经网络,因此,待训练图像匹配模型可包括两个分支以及一个分类网络,即包括两个子模型以及一个分类网络。两个子模型的网络结构相同,模型参数共享。孪生神经网络每次需要输入两个样本图像作为一个样本图像对。将输入的样本图像映射为一个特征向量之后,分别输入至分类网络,由分类网络输出预测分类结果。孪生神经网络可以用以判断两个样本图像之间的相似度。

模型训练完成后,可将待训练图像匹配模型作为图像匹配模型,用于进行后续的图像匹配。

其次,本申请实施例中,提供了一种结合正样本并采用损失函数对孪生网络进行训练的方式,通过上述方式,将孪生神经网络的网络结构作为图像匹配模型的网络结构,因此,可使用交叉熵损失函数有效地处理孪生神经网络中的成对样本图像之间的关系,并且很好的表达成对样本图像的匹配程度,从而很好的用于训练输出图像相似度分值的模型。

可选地,在上述图3对应的各个实施例的基础上,本申请实施例提供的另一个可选实施例中,还可以包括:

获取训练样本图像,其中,训练样本图像包括M个像素点,每个像素点对应于一个类别标注标签,类别标注标签用于指示像素点属于感兴趣区域或背景区域,M为大于1的整数;

基于训练样本图像,通过待训练语义分割模型获取每个像素点的类别预测概率;

根据每个像素点的类别预测概率以及每个像素点的类别标注标签,采用第五损失函数对待训练语义分割模型的模型参数进行更新,直至满足模型训练条件,得到语义分割模型。

在一个或多个实施例中,介绍了一种对语义分割模型进行训练的方式。有前述实施例可知,利用语义分割模型能够将图像划分为感兴趣区域和背景区域,下面将介绍如何训练得到语义分割模型。

具体地,首先需要收集一定数量(例如,大于或等于50000张)的训练样本图像,训练样本图像应尽可能随机选取,尽量覆盖目标场景下的各种案例。为了在自监督学习相似度的过程中,能够更好地框选出具有代表性的图像块,需要在训练过程中预先对训练样本图像的区域进行划分和标注,由此得到感兴趣区域或背景区域,进一步地,如果感兴趣区域包括文本区域和图片区域,则需要标注三类区域,即文本区域、图片区域和背景区域。为了便于理解,请参阅图12,图12为本申请实施例中标注感兴趣区域和背景区域的一个示意图,如图所示,E1所示指示的区域为图片区域,E2所示指示的区域为文本区域,剩余部分即为背景区域。

需要说明的是,对所有训练样本图像进行标注往往需要耗费大量的人力,因此,可考虑只标注部分训练样本图像(例如,10000张),使用这些标注数据训练一个语义分割模型对文本区域、图片区域和背景区域进行学习,然后用该语义分割模型对图像进行分割。

将标注好的训练样本图像作为待训练语义分割模型的输入,将标注结果作为监督信息。文本区域中每个像素点的类别标注标签可设置为“1”,图片区域中每个像素点的类别标注标签可设置为“2”,背景区域中每个像素点的类别标注标签可设置为“0”。基于此,可采用第五损失函数计算每个像素点的类别预测概率与类别标注标签之间的损失值,对待训练语义分割模型的模型参数进行更新。第五损失函数可采用交叉熵(Cross Entropy)损失函数,具体为:

其中,L

需要说明的是,本申请提供的语义分割模型包含但不仅限于全卷积网络(fullyconvolution network,FCN)、分割网络(segmentation network,SegNet)、Deeplab、金字塔场景解析网络(pyramid scene parsing network,PSPNet)以及高资源网络(high-resoultion net,HRNet)等,此处不做限定。

其次,本申请实施例中,提供了一种对语义分割模型进行训练的方式,通过上述方式,可训练得到不仅能够从图像中分割出感兴趣区域以及背景区域,还可以分割出感兴趣区域中的文本区域和图片区域,从而使得随机取样的图像块能够覆盖更多有效内容,由此,能够更有针对性地对图像进行框选,取出具有代表性的图像块作为样本图像,有利于训练得到更具有鲁棒性的图像匹配模型。

结合上述介绍,下面将对本申请中图像匹配的方法进行介绍,请参阅图13,本申请实施例中图像匹配方法的一个实施例包括:

210、获取第一待匹配图像;

在一个或多个实施例中,图像匹配装置获取第一待匹配图像,其中,第一待匹配图像可以是用户上传的图像,或者,第一待匹配图像可以是从网页上截取到的图像,又或者,第一待匹配图像是通过其他途径获取到的图像,此处不做限定。

需要说明的是,本申请提供的图像匹配装置可部署于服务器,或者,可部署于终端设备,又或者,可部署于由服务器和终端设备构成的系统,此处不做限定。

220、获取第二待匹配图像;

在一个或多个实施例中,图像匹配装置获取第二待匹配图像,其中,第二匹配图像可以是用户上传的一个图像,或者,第二待匹配图像可以是后台存储的图像,又或者,第二待匹配图像是通过其他途径获取到的图像,此处不做限定。

230、基于第一待匹配图像以及第二待匹配图像,通过图像匹配模型确定匹配结果,其中,图像匹配模型为采用上述实施例提供的方法训练得到的。

在一个或多个实施例中,图像匹配装置将第一待匹配图像以及第二待匹配图像作为图像匹配模型的输入。在一种情况下,图像匹配模型可同时支持两个输入,即,将第一待匹配图像以及第二待匹配图像共同输入至图像匹配模型。在另一种情况下,图像匹配模型可支持一个输入,即,先将第一待匹配图像输入至图像匹配模型,再将第二待匹配图像输入至图像匹配模型。基于图像匹配模型输出的结果生成两个待匹配图像所对应的匹配结果。

在图像检索场景中,如果用户输入一张图像(即,第一待匹配图像),可检索出与之相似的另一张图像。在图像分类场景中,可利用图像匹配模型对相似度较高的图像进行聚类,从而提升图像分类的效率和准确性。

本申请实施例中,提供了一种图像匹配的方法,通过上述方式,将图像划分为感兴趣区域和背景区域,由此,从图像中随机框选出的图像块时,能够更有针对性地对图像进行框选,取出具有代表性的图像块作为样本图像,从而有利于训练得到更具有鲁棒性的图像匹配模型。基于此,在模型推理过程中,能够减少误匹配的发生。

可选地,在上述图13对应的各个实施例的基础上,本申请实施例提供的另一个可选实施例中,基于第一待匹配图像以及第二待匹配图像,通过图像匹配模型确定匹配结果,具体可以包括:

基于第一待匹配图像,通过图像匹配模型获取第一待匹配图像所对应的特征向量;

基于第二待匹配图像,通过图像匹配模型获取第二待匹配图像所对应的特征向量;

根据第一待匹配图像所对应的特征向量以及第二待匹配图像所对应的特征向量,确定目标特征距离;

若目标特征距离小于或等于距离阈值,则确定匹配结果为匹配成功;

若目标特征距离大于距离阈值,则确定匹配结果为匹配失败。

在一个或多个实施例中,介绍了一种基于特征间距离确定匹配结果的方式。由前述实施例可知,图像匹配模型可以是待训练图像匹配模型中的一个子模型,基于此,需要分别将第一待匹配图像和第二待匹配图像输入至图像匹配模型,由此,输出两个特征向量。于是,可采用欧式距离的计算公式,计算得到两个特征向量之间的目标特征距离。可以理解的是,目标特征距离可以是欧式距离,欧式距离也称欧几里得距离,是常见的距离度量,用于衡量多维空间中两个对象之间的绝对距离。目标特征距离越小,两个待匹配图像的相似度就越大,反之,目标特征距离越大,两个待匹配图像的越小。

具体地,为了便于理解,请参阅图14,图14为本申请实施例中图像匹配模型的一个结构示意图,如图所示,将第一待匹配图像输入至训练好的图像匹配模型,由图像匹配模型输出第一待匹配图像所对应的特征向量。类似地,将第二待匹配图像输入至训练好的图像匹配模型,由图像匹配模型输出第二待匹配图像所对应的特征向量。基于此,可采用欧式距离的计算公式,计算第一待匹配图像所对应的特征向量与第二待匹配图像所对应的特征向量之间的目标特征距离。

如果目标特征距离小于或等于距离阈值,则确定匹配结果为匹配成功。反之,如果目标特征距离大于距离阈值,则确定匹配结果为匹配失败。由于目标特征距离越小,图像越相似,因此,可根据目标特征距离,确定与待匹配图像最接近的另一个待匹配图像。

其次,本申请实施例中,提供了一种基于特征间距离确定匹配结果的方式,通过上述方式,由图像匹配模型直接输出两个待匹配图像的特征向量,再根据两个待匹配图像的特征向量确定特征间距离。由于特征间距离越小,表示相似程度越高,因此,基于图像匹配模型可输出特征向量,以确定两个待匹配图像的匹配结果,从而提升图像匹配的准确性。

可选地,在上述图13对应的各个实施例的基础上,本申请实施例提供的另一个可选实施例中,基于第一待匹配图像以及第二待匹配图像,通过图像匹配模型确定匹配结果,具体可以包括:

基于第一待匹配图像以及第二待匹配图像,通过图像匹配模型获取相似度分值;

若相似度分值大于或等于相似度阈值,则确定匹配结果为匹配成功;

若相似度分值小于相似度阈值,则确定匹配结果为匹配失败。

在一个或多个实施例中,介绍了一种基于相似度分值确定匹配结果的方式。由前述实施例可知,图像匹配模型可以是待训练图像匹配模型,即包括两个子模型,基于此,需要将第一待匹配图像和第二待匹配图像共同输入至图像匹配模型,由此,输出相似度分值。于是,可采用余弦相似度的计算公式,计算得到两个待匹配图像之间的相似度分值。可以理解的是,相似度分值可以是余弦相似度,余弦相似度首先需要将待匹配图像向量化,通过计算两个特征向量的夹角余弦值来评估他们的相似度。余弦相似度通常用于正空间,因此,通常情况下,余弦相似度的取值为0到1之间,其中,0度角的余弦值是1,其他的任何角度的余弦值都不大于1。即相似度分值越大,两个待匹配图像的相似度就越大,反之,相似度分值越小,两个待匹配图像的越小。

具体地,为了便于理解,请参阅图15,图15为本申请实施例中图像匹配模型的另一个结构示意图,如图所示,将第一待匹配图像以及第二待匹配图像共同输入至训练好的图像匹配模型,由图像匹配模型输出第一待匹配图像与第二待匹配图像之间的相似度分值。

如果相似度分值大于或等于相似度阈值,则确定匹配结果为匹配成功。反之,如果相似度分值小于相似度阈值,则确定匹配结果为匹配失败。由于相似度分值越大,图像越相似,因此,可根据相似度分值,确定与待匹配图像最接近的另一个待匹配图像。

其次,本申请实施例中,提供了一种基于相似度分值确定匹配结果的方式,通过上述方式,由图像匹配模型直接输出两个待匹配图像之间的相似度分值,由于相似度分值越大,表示相似程度越高,因此,基于图像匹配模型可直接输出相似度分值,以确定两个待匹配图像的匹配结果,从而提升图像匹配的准确性。

下面对本申请中的模型训练装置进行详细描述,请参阅图16,图16为本申请实施例中模型训练装置的一个实施例示意图,模型训练装置30包括:

获取模块310,用于获取第一待训练图像;

获取模块310,还用于基于第一待训练图像,通过语义分割模型获取第一区域分割结果,其中,第一区域分割结果用于确定第一待训练图像中的感兴趣区域以及背景区域,感兴趣区域包括文本区域或图片区域中的至少一种;

获取模块310,还用于根据第一区域分割结果,获取来源于第一待训练图像的第一样本图像以及第二样本图像,其中,第一样本图像所包括的感兴趣区域的区域占比大于或等于占比阈值,第二样本图像所包括的感兴趣区域的区域占比大于或等于占比阈值;

训练模块320,用于根据第一样本图像以及第二样本图像,对待训练图像匹配模型的模型参数进行更新,直至满足模型训练条件,得到图像匹配模型。

本申请提供了一种模型训练装置,采用上述装置,将图像划分为感兴趣区域和背景区域,由此,从图像中随机框选出的图像块时,能够更有针对性地对图像进行框选,取出具有代表性的图像块作为样本图像,从而有利于训练得到更具有鲁棒性的图像匹配模型。

可选地,在上述图16所对应的实施例的基础上,本申请实施例提供的模型训练装置30的另一实施例中,

获取模块310,具体用于从第一待训练图像随机选择第一图像以及第二图像;

根据第一区域分割结果,确定第一图像中感兴趣区域的区域占比,以及,确定第二图像中感兴趣区域的区域占比;

若第一图像中感兴趣区域的区域占比大于或等于占比阈值,则将第一图像作为第一样本图像;

若第二图像中感兴趣区域的区域占比大于或等于占比阈值,则将第二图像作为第二样本图像。

本申请提供了一种模型训练装置,采用上述装置,可直接从待训练图像中随机提取符合要求的样本图像,由此,利用这些样本图像能够进行后续的模型训练,从而增加方案的可行性和可操作性。

可选地,在上述图16所对应的实施例的基础上,本申请实施例提供的模型训练装置30的另一实施例中,

获取模块310,具体用于从第一待训练图像随机选择第一待处理图像以及第二待处理图像;

根据第一区域分割结果,确定第一待处理图像中感兴趣区域的区域占比,以及,确定第二待处理图像中感兴趣区域的区域占比;

若第一待处理图像中感兴趣区域的区域占比大于或等于占比阈值,则对第一待处理图像进行数据增广处理,得到第一样本图像;

若第二待处理图像中感兴趣区域的区域占比大于或等于占比阈值,则对第二待处理图像进行数据增广处理,得到第二样本图像。

本申请提供了一种模型训练装置,采用上述装置,可从待训练图像中随机提取符合要求的一个样本图像,然后对该样本图像进行数据增广,得到另一个样本图像,由此,利用这些样本图像能够进行后续的模型训练,从而增加方案的可行性和可操作性。

可选地,在上述图16所对应的实施例的基础上,本申请实施例提供的模型训练装置30的另一实施例中,

训练模块320,具体用于基于第一样本图像,通过待训练图像匹配模型所包括的编码网络,获取第一特征图;

基于第一特征图,通过待训练图像匹配模型所包括的投影网络,获取第一特征向量;

基于第一特征向量,通过待训练图像匹配模型所包括的预测网络,获取目标特征向量;

基于第二样本图像,通过目标模型所包括的编码网络,获取第二特征图;

基于第二特征图,通过目标模型所包括的投影网络,获取第二特征向量;

根据目标特征向量以及第二特征向量,通过第一损失函数对待训练图像匹配模型的模型参数进行更新。

本申请提供了一种模型训练装置,采用上述装置,依赖于两个网络之间的相互作用以及相互学习,能够在没有负样本对的情况下达到较高的分类准确率,从而提升图像匹配模型的鲁棒性。

可选地,在上述图16所对应的实施例的基础上,本申请实施例提供的模型训练装置30的另一实施例中,

获取模块310,还用于获取第二待训练图像;

获取模块310,还用于基于第二待训练图像,通过语义分割模型获取第二区域分割结果,其中,第二区域分割结果用于确定第二待训练图像中的感兴趣区域以及背景区域;

获取模块310,还用于根据第二区域分割结果,获取来源于第二待训练图像的第三样本图像,其中,第三样本图像所包括的感兴趣区域占比大于或等于占比阈值;

训练模块320,具体用于根据第一样本图像、第二样本图像以及第三样本图像,对待训练图像匹配模型的模型参数进行更新,直至满足模型训练条件,得到图像匹配模型。

本申请提供了一种模型训练装置,采用上述装置,可从同一个待训练图像中提取正样本图像对,并分别从不同的待训练图像提取负样本图像对,基于此,使用正样本图像对和负样本图像对对共同进行训练,能够提升图像匹配模型的鲁棒性。

可选地,在上述图16所对应的实施例的基础上,本申请实施例提供的模型训练装置30的另一实施例中,

训练模块320,具体用于基于第一样本图像以及第二样本图像,通过待训练图像匹配模型获取第一样本图像所对应的特征向量以及第二样本图像所对应的特征向量,第一样本图像以及第二样本图像属于正样本图像对,正样本图像对对应于正样本标签;

基于第一样本图像以及第三样本图像,通过待训练图像匹配模型获取第一样本图像所对应的特征向量以及第三样本图像所对应的特征向量,第一样本图像以及第三样本图像属于负样本图像对,负样本图像对对应于负样本标签;

根据第一样本图像所对应的特征向量以及第二样本图像所对应的特征向量,确定第一特征距离;

根据第一样本图像所对应的特征向量以及第三样本图像所对应的特征向量,确定第二特征距离;

根据第一特征距离、第二特征距离、正样本标签以及负样本标签,采用第二损失函数对待训练图像匹配模型的模型参数进行更新。

本申请提供了一种模型训练装置,采用上述装置,将孪生神经网络的网络结构作为图像匹配模型的网络结构,因此,可使用对比损失函数有效地处理孪生神经网络中的成对样本图像的关系,并且很好的表达成对样本图像的匹配程度,从而很好的用于训练提取特征的模型。

可选地,在上述图16所对应的实施例的基础上,本申请实施例提供的模型训练装置30的另一实施例中,

训练模块320,具体用于基于第一样本图像,通过待训练图像匹配模型获取第一样本图像所对应的嵌入向量;

基于第二样本图像,通过待训练图像匹配模型获取第二样本图像所对应的嵌入向量,其中,第二样本图像属于正样本图像;

基于第三样本图像,通过待训练图像匹配模型获取第三样本图像所对应的嵌入向量,其中,第三样本图像属于负样本图像;

根据第一样本图像所对应的嵌入向量以及第二样本图像所对应的嵌入向量,确定第一嵌入距离;

根据第一样本图像所对应的嵌入向量以及第三样本图像所对应的嵌入向量,确定第二嵌入距离;

根据第一嵌入距离以及第二嵌入距离,采用第三损失函数对待训练图像匹配模型的模型参数进行更新。

本申请提供了一种模型训练装置,采用上述装置,将孪生神经网络的网络结构作为图像匹配模型的网络结构,因此,可使用三重损失函数有效地处理孪生神经网络中的三个关联样本图像之间的关系,并且很好的表达三个关联样本图像的匹配程度,从而很好的用于训练提取特征的模型。

可选地,在上述图16所对应的实施例的基础上,本申请实施例提供的模型训练装置30的另一实施例中,

训练模块320,具体用于基于第一样本图像以及第二样本图像,通过待训练图像匹配模型获取预测分类结果,第一样本图像以及第二样本图像对应于标注分类标签;

根据预测分类结果以及标注分类标签,采用第四损失函数对待训练图像匹配模型的模型参数进行更新。

本申请提供了一种模型训练装置,采用上述装置,将孪生神经网络的网络结构作为图像匹配模型的网络结构,因此,可使用交叉熵损失函数有效地处理孪生神经网络中的成对样本图像之间的关系,并且很好的表达成对样本图像的匹配程度,从而很好的用于训练输出图像相似度分值的模型。

可选地,在上述图16所对应的实施例的基础上,本申请实施例提供的模型训练装置30的另一实施例中,

获取模块310,还用于获取训练样本图像,其中,训练样本图像包括M个像素点,每个像素点对应于一个类别标注标签,类别标注标签用于指示像素点属于感兴趣区域或背景区域,M为大于1的整数;

获取模块310,还用于基于训练样本图像,通过待训练语义分割模型获取每个像素点的类别预测概率;

训练模块320,还用于根据每个像素点的类别预测概率以及每个像素点的类别标注标签,采用第五损失函数对待训练语义分割模型的模型参数进行更新,直至满足模型训练条件,得到语义分割模型。

本申请提供了一种模型训练装置,采用上述装置,可训练得到不仅能够从图像中分割出感兴趣区域以及背景区域,还可以分割出感兴趣区域中的文本区域和图片区域,从而使得随机取样的图像块能够覆盖更多有效内容,由此,能够更有针对性地对图像进行框选,取出具有代表性的图像块作为样本图像,有利于训练得到更具有鲁棒性的图像匹配模型。

下面对本申请中的图像匹配装置进行详细描述,请参阅图17,图17为本申请实施例中图像匹配装置的一个实施例示意图,图像匹配装置40包括:

获取模块410,用于获取第一待匹配图像;

获取模块410,还用于获取第二待匹配图像;

确定模块420,用于基于第一待匹配图像以及第二待匹配图像,通过图像匹配模型确定匹配结果,其中,图像匹配模型为采用上述实施例提供的方法训练得到的。

本申请提供了一种图像匹配装置,采用上述装置,将图像划分为感兴趣区域和背景区域,由此,从图像中随机框选出的图像块时,能够更有针对性地对图像进行框选,取出具有代表性的图像块作为样本图像,从而有利于训练得到更具有鲁棒性的图像匹配模型。基于此,在模型推理过程中,能够减少误匹配的发生。

可选地,在上述图17所对应的实施例的基础上,本申请实施例提供的图像匹配装置40的另一实施例中,

确定模块420,具体用于基于第一待匹配图像,通过图像匹配模型获取第一待匹配图像所对应的特征向量;

基于第二待匹配图像,通过图像匹配模型获取第二待匹配图像所对应的特征向量;

根据第一待匹配图像所对应的特征向量以及第二待匹配图像所对应的特征向量,确定目标特征距离;

若目标特征距离小于或等于距离阈值,则确定匹配结果为匹配成功;

若目标特征距离大于距离阈值,则确定匹配结果为匹配失败。

本申请提供了一种图像匹配装置,采用上述装置,由图像匹配模型直接输出两个待匹配图像的特征向量,再根据两个待匹配图像的特征向量确定特征间距离。由于特征间距离越小,表示相似程度越高,因此,基于图像匹配模型可输出特征向量,以确定两个待匹配图像的匹配结果,从而提升图像匹配的准确性。

可选地,在上述图17所对应的实施例的基础上,本申请实施例提供的图像匹配装置40的另一实施例中,

确定模块420,具体用于基于第一待匹配图像以及第二待匹配图像,通过图像匹配模型获取相似度分值;

若相似度分值大于或等于相似度阈值,则确定匹配结果为匹配成功;

若相似度分值小于相似度阈值,则确定匹配结果为匹配失败。

本申请提供了一种图像匹配装置,采用上述装置,由图像匹配模型直接输出两个待匹配图像之间的相似度分值,由于相似度分值越大,表示相似程度越高,因此,基于图像匹配模型可直接输出相似度分值,以确定两个待匹配图像的匹配结果,从而提升图像匹配的准确性。

本申请实施例还提供了另一种模型训练装置以及图像匹配装置,模型训练装置以及图像匹配装置可部署于服务器。图18是本申请实施例提供的一种服务器结构示意图,该服务器500可因配置或性能不同而产生比较大的差异,可以包括一个或一个以上中央处理器(central processing units,CPU)522(例如,一个或一个以上处理器)和存储器532,一个或一个以上存储应用程序542或数据544的存储介质530(例如一个或一个以上海量存储设备)。其中,存储器532和存储介质530可以是短暂存储或持久存储。存储在存储介质530的程序可以包括一个或一个以上模块(图示没标出),每个模块可以包括对服务器中的一系列指令操作。更进一步地,中央处理器522可以设置为与存储介质530通信,在服务器500上执行存储介质530中的一系列指令操作。

服务器500还可以包括一个或一个以上电源526,一个或一个以上有线或无线网络接口550,一个或一个以上输入输出接口558,和/或,一个或一个以上操作系统541,例如Windows Server

上述实施例中由服务器所执行的步骤可以基于该图18所示的服务器结构。

本申请实施例还提供了另一种模型训练装置以及图像匹配装置,模型训练装置以及图像匹配装置可部署于终端设备。如图19所示,为了便于说明,仅示出了与本申请实施例相关的部分,具体技术细节未揭示的,请参照本申请实施例方法部分。在本申请实施例中,以终端设备为智能手机为例进行说明:

图19示出的是与本申请实施例提供的终端设备相关的智能手机的部分结构的框图。参考图19,智能手机包括:射频(radio frequency,RF)电路610、存储器620、输入单元630、显示单元640、传感器650、音频电路660、无线保真(wireless fidelity,WiFi)模块670、处理器680、以及电源690等部件。本领域技术人员可以理解,图19中示出的智能手机结构并不构成对智能手机的限定,可以包括比图示更多或更少的部件,或者组合某些部件,或者不同的部件布置。

下面结合图19对智能手机的各个构成部件进行具体的介绍:

RF电路610可用于收发信息或通话过程中,信号的接收和发送,特别地,将基站的下行信息接收后,给处理器680处理;另外,将设计上行的数据发送给基站。通常,RF电路610包括但不限于天线、至少一个放大器、收发信机、耦合器、低噪声放大器(low noiseamplifier,LNA)、双工器等。此外,RF电路610还可以通过无线通信与网络和其他设备通信。上述无线通信可以使用任一通信标准或协议,包括但不限于全球移动通讯系统(globalsystem of mobile communication,GSM)、通用分组无线服务(general packet radioservice,GPRS)、码分多址(code division multiple access,CDMA)、宽带码分多址(wideband code division multiple access,WCDMA)、长期演进(long term evolution,LTE)、电子邮件、短消息服务(short messaging service,SMS)等。

存储器620可用于存储软件程序以及模块,处理器680通过运行存储在存储器620的软件程序以及模块,从而执行智能手机的各种功能应用以及数据处理。存储器620可主要包括存储程序区和存储数据区,其中,存储程序区可存储操作系统、至少一个功能所需的应用程序(比如声音播放功能、图像播放功能等)等;存储数据区可存储根据智能手机的使用所创建的数据(比如音频数据、电话本等)等。此外,存储器620可以包括高速随机存取存储器,还可以包括非易失性存储器,例如至少一个磁盘存储器件、闪存器件、或其他易失性固态存储器件。

输入单元630可用于接收输入的数字或字符信息,以及产生与智能手机的用户设置以及功能控制有关的键信号输入。具体地,输入单元630可包括触控面板631以及其他输入设备632。触控面板631,也称为触摸屏,可收集用户在其上或附近的触摸操作(比如用户使用手指、触笔等任何适合的物体或附件在触控面板631上或在触控面板631附近的操作),并根据预先设定的程式驱动相应的连接装置。可选的,触控面板631可包括触摸检测装置和触摸控制器两个部分。其中,触摸检测装置检测用户的触摸方位,并检测触摸操作带来的信号,将信号传送给触摸控制器;触摸控制器从触摸检测装置上接收触摸信息,并将它转换成触点坐标,再送给处理器680,并能接收处理器680发来的命令并加以执行。此外,可以采用电阻式、电容式、红外线以及表面声波等多种类型实现触控面板631。除了触控面板631,输入单元630还可以包括其他输入设备632。具体地,其他输入设备632可以包括但不限于物理键盘、功能键(比如音量控制按键、开关按键等)、轨迹球、鼠标、操作杆等中的一种或多种。

显示单元640可用于显示由用户输入的信息或提供给用户的信息以及智能手机的各种菜单。显示单元640可包括显示面板641,可选的,可以采用液晶显示器(liquidcrystal display,LCD)、有机发光二极管(organic light-emitting diode,OLED)等形式来配置显示面板641。进一步的,触控面板631可覆盖显示面板641,当触控面板631检测到在其上或附近的触摸操作后,传送给处理器680以确定触摸事件的类型,随后处理器680根据触摸事件的类型在显示面板641上提供相应的视觉输出。虽然在图19中,触控面板631与显示面板641是作为两个独立的部件来实现智能手机的输入和输入功能,但是在某些实施例中,可以将触控面板631与显示面板641集成而实现智能手机的输入和输出功能。

智能手机还可包括至少一种传感器650,比如光传感器、运动传感器以及其他传感器。具体地,光传感器可包括环境光传感器及接近传感器,其中,环境光传感器可根据环境光线的明暗来调节显示面板641的亮度,接近传感器可在智能手机移动到耳边时,关闭显示面板641和/或背光。作为运动传感器的一种,加速计传感器可检测各个方向上(一般为三轴)加速度的大小,静止时可检测出重力的大小及方向,可用于识别智能手机姿态的应用(比如横竖屏切换、相关游戏、磁力计姿态校准)、振动识别相关功能(比如计步器、敲击)等;至于智能手机还可配置的陀螺仪、气压计、湿度计、温度计、红外线传感器等其他传感器,在此不再赘述。

音频电路660、扬声器661,传声器662可提供用户与智能手机之间的音频接口。音频电路660可将接收到的音频数据转换后的电信号,传输到扬声器661,由扬声器661转换为声音信号输出;另一方面,传声器662将收集的声音信号转换为电信号,由音频电路660接收后转换为音频数据,再将音频数据输出处理器680处理后,经RF电路610以发送给比如另一智能手机,或者将音频数据输出至存储器620以便进一步处理。

WiFi属于短距离无线传输技术,智能手机通过WiFi模块670可以帮助用户收发电子邮件、浏览网页和访问流式媒体等,它为用户提供了无线的宽带互联网访问。虽然图19示出了WiFi模块670,但是可以理解的是,其并不属于智能手机的必须构成,完全可以根据需要在不改变发明的本质的范围内而省略。

处理器680是智能手机的控制中心,利用各种接口和线路连接整个智能手机的各个部分,通过运行或执行存储在存储器620内的软件程序和/或模块,以及调用存储在存储器620内的数据,执行智能手机的各种功能和处理数据,从而对智能手机进行整体监控。可选的,处理器680可包括一个或多个处理单元;可选的,处理器680可集成应用处理器和调制解调处理器,其中,应用处理器主要处理操作系统、用户界面和应用程序等,调制解调处理器主要处理无线通信。可以理解的是,上述调制解调处理器也可以不集成到处理器680中。

智能手机还包括给各个部件供电的电源690(比如电池),可选的,电源可以通过电源管理系统与处理器680逻辑相连,从而通过电源管理系统实现管理充电、放电、以及功耗管理等功能。

尽管未示出,智能手机还可以包括摄像头、蓝牙模块等,在此不再赘述。

上述实施例中由终端设备所执行的步骤可以基于该图19所示的终端设备结构。

本申请实施例中还提供一种计算机可读存储介质,该计算机可读存储介质中存储有计算机程序,当其在计算机上运行时,使得计算机执行如前述各个实施例描述的方法。

本申请实施例中还提供一种包括程序的计算机程序产品,当其在计算机上运行时,使得计算机执行前述各个实施例描述的方法。

所属领域的技术人员可以清楚地了解到,为描述的方便和简洁,上述描述的系统,装置和单元的具体工作过程,可以参考前述方法实施例中的对应过程,在此不再赘述。

在本申请所提供的几个实施例中,应该理解到,所揭露的系统,装置和方法,可以通过其它的方式实现。例如,以上所描述的装置实施例仅仅是示意性的,例如,所述单元的划分,仅仅为一种逻辑功能划分,实际实现时可以有另外的划分方式,例如多个单元或组件可以结合或者可以集成到另一个系统,或一些特征可以忽略,或不执行。另一点,所显示或讨论的相互之间的耦合或直接耦合或通信连接可以是通过一些接口,装置或单元的间接耦合或通信连接,可以是电性,机械或其它的形式。

所述作为分离部件说明的单元可以是或者也可以不是物理上分开的,作为单元显示的部件可以是或者也可以不是物理单元,即可以位于一个地方,或者也可以分布到多个网络单元上。可以根据实际的需要选择其中的部分或者全部单元来实现本实施例方案的目的。

另外,在本申请各个实施例中的各功能单元可以集成在一个处理单元中,也可以是各个单元单独物理存在,也可以两个或两个以上单元集成在一个单元中。上述集成的单元既可以采用硬件的形式实现,也可以采用软件功能单元的形式实现。

所述集成的单元如果以软件功能单元的形式实现并作为独立的产品销售或使用时,可以存储在一个计算机可读取存储介质中。基于这样的理解,本申请的技术方案本质上或者说对现有技术做出贡献的部分或者该技术方案的全部或部分可以以软件产品的形式体现出来,该计算机软件产品存储在一个存储介质中,包括若干指令用以使得一台计算机设备(可以是个人计算机,服务器,或者网络设备等)执行本申请各个实施例所述方法的全部或部分步骤。而前述的存储介质包括:U盘、移动硬盘、只读存储器(read-only memory,ROM)、随机存取存储器(random access memory,RAM)、磁碟或者光盘等各种可以存储程序代码的介质。

以上所述,以上实施例仅用以说明本申请的技术方案,而非对其限制;尽管参照前述实施例对本申请进行了详细的说明,本领域的普通技术人员应当理解:其依然可以对前述各实施例所记载的技术方案进行修改,或者对其中部分技术特征进行等同替换;而这些修改或者替换,并不使相应技术方案的本质脱离本申请各实施例技术方案的精神和范围。

- 一种模型训练的方法、图像匹配的方法、装置及存储介质

- 模型训练方法、模型训练装置、终端设备及存储介质