信息处理装置、信息处理方法和信息处理系统

文献发布时间:2023-06-19 18:27:32

技术领域

本公开内容涉及信息处理装置、信息处理方法和信息处理系统。

背景技术

在近年来变得普遍的虚拟现实(VR)应用中,用户可以从任意视点观看其中布置有3D模型的虚拟空间。可以主要通过使用利用显示单元覆盖用户视场的非透射式头戴式显示器(HMD)来提供这样的VR世界。用于更享受虚拟空间中的体验的事件之一是捕获虚拟空间中的照片(显示为虚拟空间的图像的存储)。在当前游戏或运动图像分发内容中,存在获取绘制在整个显示设备上的视频的静止图像的屏幕截图功能。

此外,可以引用以下文献作为用于提供虚拟空间的技术的示例。

以下专利文献1公开了如下技术,在该技术中,当用户操作布置在虚拟空间中的摄像装置对象(虚拟对象)以捕获虚拟空间(在虚拟空间中显影的全景图像)时,通过图像捕获生成的摄影图像显示在监视器对象上。然后,根据用户对监视器对象的滑动操作,将摄影对象布置在虚拟空间中。

此外,以下专利文献2公开了用于从真实世界中的打印机输出由虚拟空间中的化身(用作用户的虚拟自我的角色对象)的操作捕获的摄影图像的技术。

引用列表

专利文献

专利文献1:日本专利申请公开第2019-021122号

专利文献2:日本专利申请公开第2009-176025号

发明内容

发明要解决的问题

然而,在将在虚拟空间中捕获的摄影图像布置在虚拟空间中的情况下,在上述专利文献1中需要诸如图像捕获操作和滑动操作的两个操作,并且所述操作是复杂的。

因此,本公开内容提出了能够进一步增强虚拟空间中的图像捕获体验的娱乐价值的信息处理装置、信息处理方法和信息处理系统。

问题的解决方案

根据本公开内容,提出了一种信息处理装置,该信息处理装置包括控制单元,当检测到用于对虚拟空间中的被摄体进行成像的成像触发时,控制单元生成通过对被摄体进行成像而获得的捕获图像,并且执行将所生成的捕获图像作为虚拟对象布置在虚拟空间中的控制。

根据本公开内容,提出了一种信息处理方法,包括:当处理器检测到用于对虚拟空间中的被摄体进行成像的成像触发时,由处理器生成通过对被摄体进行成像而获得的捕获图像,并且执行将所生成的捕获图像作为虚拟对象布置在虚拟空间中的控制。

根据本公开内容,提出了一种信息处理系统,包括:显示设备;控制器;以及信息处理装置,该信息处理装置包括控制单元,当由控制器检测到用于对显示在显示设备上的虚拟空间中的被摄体进行成像的成像触发时,控制单元生成通过对被摄体进行成像而获得的捕获图像,并且执行将所生成的捕获图像作为虚拟对象布置在虚拟空间中的控制。

附图说明

图1是示出根据本公开内容的实施方式的信息处理系统的配置示例的图。

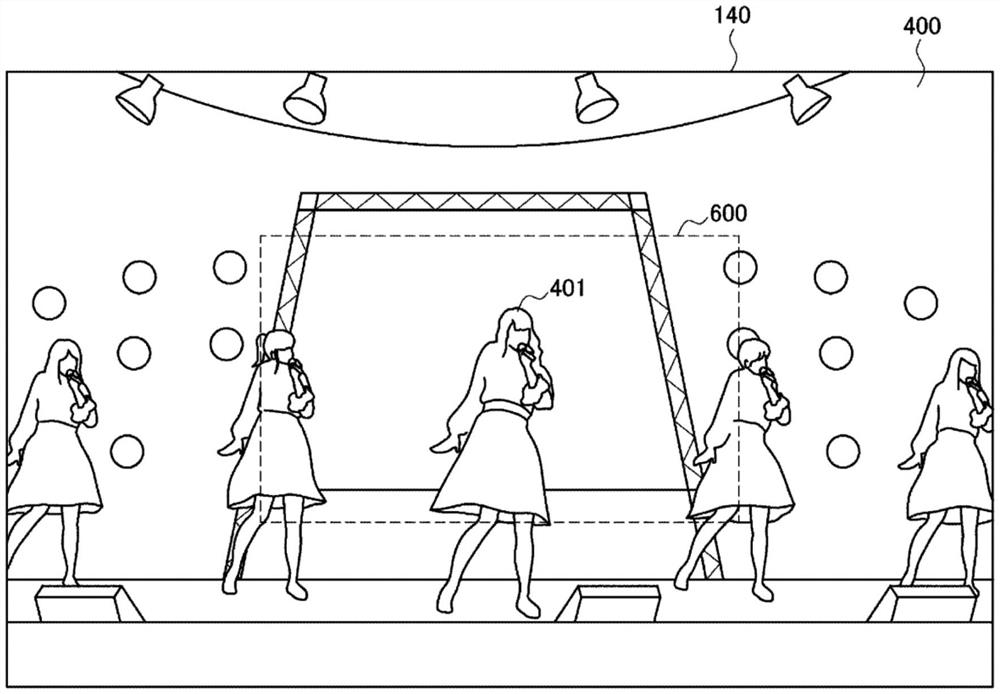

图2是示出根据本实施方式的来自用户视点的虚拟空间视频的示例的图。

图3是示出根据本实施方式的虚拟空间中的捕获图像的布置的图。

图4是示出根据本实施方式的显示设备的配置的示例的框图。

图5是示出根据本实施方式的控制器的配置的示例的框图。

图6是示出根据本实施方式的信息处理装置的配置的示例的框图。

图7是示出根据本实施方式的成像处理的流程的示例的流程图。

图8是用于说明根据本实施方式的根据图像捕获操作的图像获取的图。

图9是示出根据本实施方式的为了防止捕获图像失败而执行的图像的连续获取的图。

图10是示出根据本实施方式的捕获图像的布置处理的流程的示例的流程图。

图11是示出根据本实施方式的捕获图像的布置位置的图。

图12是示出根据本实施方式的绘制到捕获图像的布置位置的移动轨迹的情况的图。

图13是示出根据本实施方式的捕获图像的标签处理的流程的示例的流程图。

图14是示出根据本实施方式的捕获图像的过滤处理的图。

图15是示出根据本实施方式的在成像时的过滤处理的流程的示例的流程图。

图16是示出根据本实施方式的捕获图像的手动重新布置的示例的图。

图17是示出根据本实施方式的自动重新布置(排列布置)的示例的图。

图18是示出根据本实施方式的对捕获图像进行重新布置的处理的流程的示例的流程图。

图19是示出根据本实施方式的共享操作的示例的图。

图20是示出根据本实施方式的捕获图像的共享处理的流程的示例的流程图。

具体实施方式

在下文中,将参照附图详细地描述本公开内容的优选实施方式。注意,在本说明书和附图中,具有基本上相同的功能配置的部件由相同的附图标记表示,并且省略了冗余的描述。

此外,将按以下顺序给出描述。

1.根据本公开内容的一个实施方式的信息处理系统的概述

2.配置示例

3.操作处理

3-1.成像处理

3-2.捕获图像的布置处理

3-3.捕获图像的标签处理

3-4.在成像时的过滤处理

3-5.捕获图像的重新布置处理

3-6.捕获图像的共享处理

4.其他

5.总结

<<1.根据本公开内容的一个实施方式的信息处理系统的概述>>

将参照图1至图3描述根据本公开内容的实施方式的信息处理系统的概述。图1是示出根据本公开内容的实施方式的信息处理系统的配置示例的图。如图1所示,根据本实施方式的信息处理系统包括显示设备10、控制器20和信息处理装置30。

在本实施方式中,提供了虚拟空间(虚拟现实(VR))中更好的娱乐图像捕获体验。使用例如覆盖用户视场的非透射式头戴式显示器(HMD)来呈现虚拟空间。在本实施方式中,作为示例,假设由HMD实现显示设备10的情况。

实现显示设备10的HMD可以安装在用户的头部上,HMD可以包括用于左眼和右眼中的每一个眼睛的图像显示单元,并且HMD可以被配置成能够通过组合使用耳机来控制用户的视觉和听觉。利用阻隔外部世界的配置,可以增加观看时的虚拟现实感觉(虚拟空间中的沉浸感)。此外,HMD还可以在左眼和右眼中显示不同的视频,并且可以通过显示相对于左眼和右眼具有视差的图像来呈现3D图像。

此外,在虚拟空间中,布置(显示)了作为所生成的三维图像(所谓的3D模型)的虚拟对象、基于通过对真实空间进行成像获得的信息而生成的立体图像等。真实空间的成像可以由全向摄像装置执行。此外,真实空间的成像可以由多个摄像装置执行。

这样的虚拟空间视频(在本说明书中,内容也称为VR内容。)可以是全向内容或自由视点内容。注意,当虚拟摄像装置被放置在任意位置时,自由视点内容生成视频,并且使得能够从所有视点观看视频。此外,如本文中所使用的,术语“虚拟空间”(或“VR”)是指具有由一个或更多个处理器模拟的交互规则的真实或虚构环境的表示,实际用户可以经由一个或更多个显示设备感测所述真实或虚构环境并且/或者经由一个或更多个用户接口与所述真实或虚构环境交互。术语“用户接口”是指用户能够从其向虚拟世界发送输入或从虚拟世界接收输出的实际设备。

在虚拟空间中,用户可以由化身表示,或者可以在不将化身显示在显示器上的情况下从化身的视点显示虚拟空间的世界。在本说明书中,虚拟空间中的用户(或化身)的视点(在本说明书中,其也被称为“虚拟空间中的用户视点”)可以被认为是虚拟摄像装置的视场。“虚拟摄像装置”是指虚拟空间中的视点,并且用于将三维虚拟空间作为二维图像绘制在显示器(显示设备)上的计算。

此外,根据本实施方式的VR内容可以是例如音乐会、舞台、各种事件、讲座、课程、节目等的实况分发(实时分发)、可以是记录过去的分发的内容或者可以是用于分发所记录并且生成的内容。此外,VR内容可以是游戏、电影、戏剧、动画等。VR内容的内容不受特别限制。

此外,根据本实施方式的信息处理系统包括用于将用户的意图传达给系统的控制器20。可以存在多个控制器20。此外,控制器20可以由用户的手握持,或者可以佩戴在身体的一部分例如肘、臂、膝、踝或大腿上。用户可以通过控制器20操作虚拟空间中的图像捕获。

此外,可以从信息处理装置30获取由显示设备10提供的虚拟空间的信息(VR内容)。信息处理装置30可以是设置在网络上的服务器,或者可以由布置在与用户的空间相同的空间中的专用终端、智能电话、平板终端、PC等来实现。此外,信息处理装置30可以由多个设备实现。例如,信息处理装置30可以由设置在网络上的服务器和布置在与用户的空间相同的空间中的专用终端来实现。

信息处理装置30具有存储VR内容并且向显示设备10提供基于VR内容构建的虚拟空间的功能。具体地,信息处理装置30根据用户的运动、控制器操作等从VR内容生成自由视点图像,并且将自由视点图像输出至显示设备10。用户的移动是用户的位置和姿态(包括头部的取向)的改变。显示设备10检测用户的位置和姿态,并且将该位置和姿态输出至信息处理装置30。信息处理装置30识别真实世界中的用户视点位置(三维位置),并且基于所识别的用户视点位置计算虚拟空间中的用户视点位置。

注意,上述根据用户的运动、控制器操作等从VR内容生成自由视点图像的处理可以由显示设备10执行。

(背景)

此处,作为用于更享受虚拟空间体验例如留下虚拟空间中的特定场景作为回忆或者与朋友共享的方法,存在虚拟空间中的图像捕获的功能。

当前,作为在智能电话等上观看运动图像分发的情况下的场景保存方法,存在将显示在显示屏幕上的运动图像保存为静止图像的屏幕截图功能。然而,由于它是简单地绘制在显示屏幕上的视频的静止图像,因此不能获得诸如现场捕获的照片的真实感。

另一方面,如果可以从虚拟空间中的用户视点执行图像捕获,则可以获取逼真的现场照片。此外,如果可以与朋友共享以这种方式捕获的照片,则可以更享受VR内容、可以提高VR内容的价值,并且这也可以有助于扩大商业规模。

此外,如果在虚拟空间中捕获的照片可以在虚拟空间中随手观看,则用户可以在继续虚拟空间中的沉浸感的同时欣赏所捕获的照片。此外,在将音乐会作为VR内容观看等的情况下,假设期望在拍摄喜爱场景的图片的同时注视观看目标,并且因此,期望尽可能地减少图像捕获和观看时的麻烦操作。

因此,在根据本公开内容的信息处理系统中,可以通过根据对虚拟空间中的被摄体进行成像的用户操作执行图像捕获到捕获图像的布置来减少操作的麻烦,并且可以通过将捕获图像作为虚拟对象布置在虚拟空间中来进一步增强虚拟空间中的图像捕获体验的娱乐性。

具体地,例如,如图2所示,在虚拟空间的视频400显示在显示设备10的显示单元140上的情况下,假设用户使用控制器20执行对视频400中示出的被摄体401的图像捕获。用户可以通过诸如按下控制器20的预定按钮的图像捕获操作来释放所谓的快门。在本说明书中,“虚拟空间中的被摄体”是作为虚拟世界的信息显示在显示单元140上的图像。“虚拟空间中的被摄体”可以是例如包括在基于实景视频生成的立体图像中的人或对象,或者可以是由CG等生成的3D模型(虚拟对象)。此外,“图像捕获操作”是用于对虚拟空间中的被摄体进行成像的成像触发的示例。

在由控制器20执行诸如按下预定按钮的图像捕获操作的情况下,信息处理装置30认为快门被释放,并且基于虚拟空间中的用户视点获取(生成)具有预定视角600(帧大小)的图像。这样的图像的生成对应于所谓的“图像捕获”。注意,成像处理单元302可以显示虚拟空间中的视角600的显示。因此,用户可以直观地掌握图像捕获时的视角(图像捕获范围)。例如,成像处理单元302可以通过用户对控制器20的预定按钮的半按下操作而使视角600(帧)出现,并且当如原样按下按钮时(通过全按下操作)执行图像捕获。此外,信息处理装置30还能够在图像捕获时操作放大和缩小。

信息处理装置30渲染(生成)具有视角600的2D纹理(二维图像),并且将2D纹理绘制在摄影对象(用作摄影图像的虚拟对象)上。在其上绘制有2D纹理的摄影对象对应于虚拟空间中的“捕获图像”(通过所谓的图像捕获操作获得的照片)。

然后,信息处理装置30将捕获图像布置在虚拟空间中。布置地点可以是例如不干扰用户视场的位置,例如用户的一侧(至少是不覆盖舞台的位置或其他位置)。例如,如图2所示,在用户在观看舞台方向的同时捕获被摄体401的情况下,可以将捕获图像(具有视角600的图像)布置在用户的右侧(视场之外)。在这种情况下,当用户面向右侧(将脸向右侧转)时,虚拟空间中的用户视点改变,并且在右侧方向上的虚拟空间的视频410显示在显示单元140上,如图3所示。然后,可以在视觉上识别布置在用户右侧的捕获图像510(虚拟对象)。

上面已经描述了根据本公开内容的实施方式的信息处理系统的概述。随后,将参照附图描述根据本实施方式的信息处理系统中包括的每个设备的具体配置。

<<2.配置示例>>

<2-1.显示设备10的配置示例>

图4是示出根据本实施方式的显示设备10的配置的示例的框图。如图4所示,显示设备10包括控制单元100、通信单元110、操作输入单元120、传感器单元130、显示单元140、音频输出单元150和存储单元160。

控制单元100用作算术处理设备和控制设备,并且根据各种程序控制显示设备10中的整体操作。控制单元100例如由诸如中央处理单元(CPU)或微处理器的电子电路来实现。此外,控制单元100可以包括存储要使用的程序、操作参数等的只读存储器(ROM)以及临时存储适当变化的参数等的随机存取存储器(RAM)。

根据本实施方式的控制单元100基于经由通信单元110从信息处理装置30接收的信息来控制显示单元140和音频输出单元150,并且执行将虚拟空间的信息呈现给用户的视觉或听觉的控制。此外,控制单元100基于从操作输入单元120输入的用户操作的信息或由传感器单元130感测的数据来执行将用户的位置、姿态等的改变从通信单元110发送至信息处理装置30的控制。此外,控制单元100还执行将从控制器20接收的用户操作的信息发送至信息处理装置30的控制。此外,控制单元100可以根据用户操作的信息以及位置、姿态等的改变来控制显示单元140和音频输出单元150,以改变呈现给用户的视觉或听觉的虚拟空间的信息。

将描述控制单元100基于由传感器单元130感测的感测数据对位置、姿态等的计算。控制单元100基于各种类型的感测数据跟随用户头部的移动(头部跟踪)、跟随视线的移动(眼部跟踪)以及跟随位置和姿态(位置跟踪)。更具体地,例如,可以通过基于由佩戴在用户头部上的显示设备10中设置的传感器单元130检测到的九个轴的检测结果计算头部的姿态信息来执行头部跟踪。此外,可以通过基于由佩戴在用户头部上的显示设备10中设置的传感器单元130检测到的用户眼睛的捕获图像(例如,通过对发射到眼睛的红外光的反射进行成像而获得的红外图像)计算用户的视线(视线方向)来执行眼部跟踪。此外,位置跟踪包括使用安装在外部的传感器的由外而内(outside-in)方法、使用安装在测量目标自身(显示设备10(HMD))上的传感器的由内而外(inside-out)方法以及作为它们的组合的混合方法。

(通信单元110)

通信单元110以有线或无线方式与信息处理装置30和控制器20通信并且连接至信息处理装置30和控制器20,以发送和接收数据。通信单元110可以使用例如有线/无线局域网(LAN)、Wi-Fi(注册商标)、Bluetooth(注册商标)、红外通信、移动通信网络(长期演进(LTE)、第三代移动通信系统(3G)、第四代移动通信系统(4G)和第五代移动通信系统(5G))等来执行通信。

(操作输入单元120)

操作输入单元120接受用户的操作指令,并且将操作内容输出至控制单元100。操作输入单元120可以是例如触摸传感器、压力传感器或接近度传感器。替选地,操作输入单元120可以具有诸如按钮、开关和控制杆的物理配置。

(传感器单元130)

传感器单元130具有感测诸如用户或周围情况的真实空间的功能。具体地,传感器单元130包括位置信息获取单元、摄像装置(向内/向外摄像装置)、麦克风、加速度传感器、角速度传感器、地磁传感器、生物传感器(检测脉搏、心率、出汗、血压、体温、呼吸、肌电值、脑电波等)等。注意,传感器单元130的具体示例不限于此,并且例如,传感器单元130可以包括能够检测三轴陀螺仪传感器、三轴加速度传感器和三轴地磁传感器的总共九个轴的传感器。此外,例如,作为检测用户视线的视线检测传感器,传感器单元130可以包括设置在位于用户的眼睛前方的显示单元140周围的诸如红外传感器的向内摄像装置(红外光发射单元和红外摄像装置)、检测用户的眼睛周围的肌肉移动的肌电传感器、脑电信号传感器等。

(显示单元140)

例如,在显示设备10被配置为HMD的情况下,显示单元140包括分别固定至用户的左眼和右眼的左屏幕和右屏幕,并且显示左眼图像和右眼图像。显示单元140的屏幕包括例如诸如液晶显示器(LCD)或有机电致发光(EL)显示器的显示面板、或者诸如视网膜直接绘图显示器的激光扫描显示器。此外,显示单元140可以包括成像光学系统,该成像光学系统放大并且投影显示屏幕以在用户的瞳孔上形成具有预定视角的经放大的虚拟图像。

(音频输出单元150)

例如,在显示设备10被配置为HMD的情况下,音频输出单元150被配置为佩戴在用户的头部上的头戴式耳机,并且再现音频信号。注意,音频输出单元150不限于头戴式耳机类型,并且可以被配置为入耳式耳机或骨传导扬声器。

(存储单元160)

存储单元160通过存储用于控制单元100的处理的程序、操作参数等的只读存储器(ROM)以及临时存储适当地变化的参数等的随机存取存储器(RAM)实现。

虽然上面已经具体描述了显示设备10的配置,但是根据本公开内容的显示设备10的配置不限于图4所示的示例。例如,显示设备10可以由多个设备实现。具体地,可以包括由HMD等实现的显示设备(对应于至少显示单元140)和由智能电话、平板终端、PC等实现的信息处理终端(对应于至少控制单元100)。此外,上述控制单元100的跟踪处理可以由外部设备执行。

此外,控制单元100的每个功能可以由设置在网络上的服务器(例如,信息处理装置30)来实现,或者可以由布置在与用户的空间相同的空间中的专用终端、智能电话、平板终端、PC等来实现。

此外,显示设备10可以是诸如智能电话或平板终端的不可穿戴设备。

<2-2.控制器20的配置示例>

图5是示出根据本实施方式的控制器20的配置的示例的框图。如图5所示,控制器20包括控制单元200、通信单元210、操作输入单元220、传感器单元230和存储单元240。

控制单元200用作算术处理设备和控制设备,并且根据各种程序控制控制器20中的整体操作。控制单元200例如由诸如中央处理单元(CPU)或微处理器的电子电路来实现。此外,控制单元200可以包括存储要使用的程序、操作参数等的只读存储器(ROM)以及临时存储适当变化的参数等的随机存取存储器(RAM)。

根据本实施方式的控制单元200基于从操作输入单元220输入的用户操作的信息和由传感器单元230感测的数据执行将用户的运动的变化从通信单元210发送至控制器20的控制。例如,控制单元200检测到设置在控制器20中的按钮被按下(图像捕获操作的示例),并且将该按钮输出至显示设备10。

(通信单元210)

通信单元210以有线或无线方式与控制器20通信并且连接至控制器20以发送和接收数据。通信单元210可以使用例如有线/无线局域网(LAN)、Wi-Fi(注册商标)、Bluetooth(注册商标)、红外通信、移动通信网络(长期演进(LTE)、第三代移动通信系统(3G)、第四代移动通信系统(4G)和第五代移动通信系统(5G))等来执行通信。

(操作输入单元220)

操作输入单元220接受用户的操作指令,并且将操作内容输出至控制单元200。操作输入单元220可以是例如触摸传感器、压力传感器或接近度传感器。替选地,操作输入单元220可以具有诸如按钮、开关和控制杆的物理配置。

(传感器单元230)

传感器单元230具有感测诸如用户或周围情况的真实空间的功能。具体地,传感器单元230可以是能够检测三轴陀螺仪传感器、三轴加速度传感器和三轴地磁传感器的总共九个轴的传感器。此外,传感器单元230还可以包括摄像装置、麦克风、生物传感器(检测脉搏、出汗、血压、体温等)等。

(存储单元240)

存储单元240通过存储用于控制单元200的处理的程序、操作参数等的只读存储器(ROM)以及临时存储适当地变化的参数等的随机存取存储器(RAM)实现。

虽然上面已经具体描述了控制器20的配置,但是根据本公开内容的控制器20的配置不限于图5所示的示例。例如,控制器20还可以包括显示单元、振动单元、发光单元等。控制器20可以根据从显示设备10接收到的控制信号执行从显示单元、振动单元、发光单元等到用户的反馈。

此外,控制器20可以是专用于操作VR内容的控制器、或者可以是诸如智能电话、移动电话终端的通用设备、或者诸如智能手表的可穿戴设备。

注意,在本实施方式中,使用包括控制器20的系统配置作为示例,但是本公开内容不限于此。用户还可以在不使用控制器20的情况下通过例如利用手部或整个身体的姿势、语音等将用户的意图传达给系统。姿势输入或语音输入可以由设置在显示设备10(HMD)中的向外摄像装置或麦克风来检测。此外,姿势输入可以由设置在用户周围并且捕获用户的整个身体的摄像装置(未示出)检测,并且可以被发送至显示设备10或信息处理装置30。

<2-3.信息处理装置30的配置示例>

接下来,将参照图6描述信息处理装置30的配置示例。信息处理装置30可以是设置在网络上的服务器,或者可以是布置在与用户的空间相同的空间中的专用终端、智能电话、平板终端、PC等。

图6是示出根据本实施方式的信息处理装置30的配置的示例的框图。如图6所示,信息处理装置30包括控制单元300、通信单元310和存储单元320。

控制单元300用作算术处理设备和控制设备,并且根据各种程序来控制信息处理装置30中的整体操作。控制单元300例如由诸如中央处理单元(CPU)或微处理器的电子电路来实现。此外,控制单元300可以包括存储要使用的程序、操作参数等的只读存储器(ROM)以及临时存储适当变化的参数等的随机存取存储器(RAM)。

此外,根据本实施方式的控制单元300还用作内容观看控制单元301、成像处理单元302、布置控制单元303、标记单元304和共享控制单元305。

内容观看控制单元301具有控制VR内容的观看的功能。具体地,内容观看控制单元301基于存储在存储单元320中的VR内容的信息,生成与由VR内容构建(定义)的虚拟空间(三维虚拟空间)中的用户视点(三维位置坐标)相对应的虚拟空间的视频(自由视点图像)。内容观看控制单元301可以根据例如基于从显示设备10输出的感测数据计算的用户的位置和姿态(包括头部的取向)来识别虚拟空间中的用户视点。此外,内容观看控制单元301将所生成的虚拟空间的视频从通信单元310发送至显示设备10,并且使显示单元140显示视频。此外,内容观看控制单元301基于VR内容的信息生成与上述用户视点对应的虚拟空间的音频信息,并且将该音频信息发送至显示设备10。

通过连续地执行上述处理,当用户在真实世界中前后左右移动(或者通过控制器20输入指示前后左右移动的操作)或改变视点(例如,头部的取向)时,内容观看控制单元301使得即使在虚拟空间中也可以前后左右移动相同的移动量(或者以预定比率移动对应移动量)或改变视点。因此,可以增强虚拟空间中的沉浸感,并且可以提供更逼真的VR体验。

成像处理单元302执行对虚拟空间中的被摄体进行成像的处理。具体地,在由用户执行图像捕获操作(例如,由控制器20按下预定按钮等)的情况下,成像处理单元302基于虚拟空间中的用户视点(在用户的视场中)获取(生成)具有预定视角(垂直和水平指定的帧大小)的图像。所获取的图像可以是二维图像或三维图像。然后,成像处理单元302将具有视角600的所获取图像(例如,2D纹理)绘制在摄影对象上,并且生成虚拟空间中的“捕获图像”(可以在虚拟空间中被处理的虚拟对象)。此外,成像处理单元302可以在成像时适当地执行过滤处理,例如排除与被摄体交叠的附加虚拟对象。

布置控制单元303执行将由成像处理单元302生成的捕获图像布置在虚拟空间中的控制。可以根据预设的布置规则来执行布置。例如,布置控制单元303在相对于观看虚拟空间的用户的位置预先设置的地点处布置虚拟空间。例如,布置控制单元303可以布置在用户的视场之外。此外,布置控制单元303可以布置在用户周围的并且避开观看目标(其可以被预先设置)的地点,观看目标是被观看的内容的主体,例如虚拟空间中的舞台、分发者(表演者等)和行进方向。此外,布置控制单元303根据用户操作将布置在虚拟空间中的捕获图像重新布置在由用户指定的任意位置(手动粘贴位置)。此外,布置控制单元303可以在虚拟空间中的预定空间中自动排列手动布置的捕获图像。

标记单元304执行将关于捕获图像的伴随信息(在本说明书中称为“标签”)添加至由成像处理单元302生成的捕获图像的处理。例如,标记单元304获取关于出现在捕获图像中的被摄体的信息、图像捕获日期和时间、关于所捕获的VR内容的信息、关于在VR内容的再现时间轴上VR内容被捕获的时间(再现开始位置)的信息等,并且将所述信息作为标签添加至捕获图像。当搜索捕获图像、将大量捕获图像成组布置、开始再现等时,可以使用这样的标签。

共享控制单元305执行与诸如另一个人(另一用户的显示设备)或另一系统的外部共享捕获图像的控制。具体地,共享控制单元305执行将由用户选择的捕获图像的副本发送至共享目的地(例如,朋友的显示设备,提供打印诸如T恤衫、马克杯或纸张的真实对象并将该真实对象递送至用户家中的服务的系统,等等)的控制。此外,共享控制单元305执行以下控制:接收由其他人共享的捕获图像并将捕获图像存储在存储单元320中,以及将所接收的捕获图像布置在用户观看的虚拟空间中。

上面已经描述了控制单元300的各种功能。注意,上述各种功能是示例,并且本实施方式不限于此。例如,控制单元300可以通过虚拟空间中的显示或声音、显示设备10或控制器20的振动等对用户执行各种通知和反馈。

(通信单元310)

通信单元310以有线或无线方式向显示设备10发送数据和从显示设备10接收数据。通信单元310通过例如有线/无线局域网(LAN)、Wi-Fi(注册商标)、Bluetooth(注册商标)、移动通信网络(长期演进(LTE)、第三代移动通信系统(3G)、第四代移动通信系统(4G)和第五代移动通信系统(5G))等可通信地连接至显示设备10。

(存储单元320)

存储单元320通过存储用于控制单元300的处理的程序、操作参数等的只读存储器(ROM)以及临时存储适当地变化的参数等的随机存取存储器(RAM)实现。

根据本实施方式,存储单元320存储VR内容。此外,存储单元320可以存储用户信息(用户的姓名、ID、地址等)。

尽管上面已经具体描述了信息处理装置30的配置,但是根据本公开内容的信息处理装置30的配置不限于图6所示的示例。例如,信息处理装置30可以由多个设备实现。具体地,控制单元300可以设置在由智能电话、平板终端、PC等实现的信息处理终端中,或者设置在布置在与用户的空间相同的空间中的专用终端中,并且存储单元320可以设置在网络上的服务器中。此外,控制单元300的功能中的至少一些可以由显示设备10执行。此外,信息处理装置30可以由显示设备10、信息处理终端(智能电话、平板终端、PC等)或专用终端、以及服务器来实现。

<<3.操作处理>>

接下来,将参照附图具体描述根据本实施方式的信息处理系统的操作处理。

<3-1.成像处理>

图7是示出根据本实施方式的成像处理的流程的示例的流程图。如图7所示,首先,显示设备10基于从信息处理装置30获取的信息开始观看VR内容(步骤S103)。具体地,由信息处理装置30的内容观看控制单元301执行VR内容的观看控制,并且生成虚拟空间中的用户视点处的图像和音频并将其发送至显示设备10。

接下来,信息处理装置30的成像处理单元302基于从显示设备10或控制器20获取的用户操作信息来确定是否存在成像操作(旨在执行图像捕获的操作输入)(步骤S106)。例如,成像处理单元302可以将设置在控制器20中的预定按钮被按下识别为成像操作。

接下来,在存在成像操作的情况下(步骤S106/是),如图8所示,成像处理单元302生成具有以目标点T为中心在竖直方向和水平方向上指定的帧大小(即,视角610的大小)的2D纹理(图像),在目标点T处,虚拟摄像装置60(即,用户的视点)的中心轴线S与作为中心的虚拟空间中的对象(此处,被摄体401C)正交(步骤S109)。注意,可以预先设置或者可以由用户任意设置所获取的图像的帧大小(视角610的大小)。以这种方式,成像处理单元302获取观看虚拟空间的用户的视场的一部分(显示单元140的显示范围的一部分)的图像。注意,在图8中,确定目标点T是为了在后面描述的标记处理中使用要被成像的被摄体401的三维位置,但是本实施方式不限于此,并且视角610是以与虚拟摄像装置60的中心轴线S正交的平面中所述中心轴线与所述平面正交的点为中心的竖直-水平指定大小的帧。

接下来,在上述图像获取之后,成像处理单元302以固定的帧周期连续地获取多个图像,并且将图像存储在存储单元320中(步骤S112)。即,如图9所示,从图像捕获开始帧(帧0)以固定的帧周期获取n个连续帧的图像(以相同视角)。获取多个图像是为了在图像捕获失败时保险起见。即,当运动图像被存储为静止图像时,由于图像捕获定时的延迟,可能发生图像捕获错误(被摄体闭上眼睛、被摄体的衣服翻折、摄像装置抖动等)。因此,通过获取多个图像捕获,即使当发生图像捕获错误时也可以留下成功的图像。可以预设连续获取的图像的数目。

具体地,成像处理单元302从第一获取图像依次地确定图像捕获成功还是失败(步骤S115)。例如,检测被摄体的眼睛闭合、面部取向、面部表情、衣服翻折等,并且确定是否出现预设的图像捕获失败状态。

接下来,在没有确定图像捕获失败的情况下(步骤S118),可以说该图像是已经做出了图像捕获成功确定的图像。因此,成像处理单元302利用已经做出了图像捕获成功确定的图像作为确认图像来生成摄影对象(可以在虚拟空间中被处理的虚拟对象),并且布置控制单元303将摄影对象布置在虚拟空间中(步骤S121)。可以由成像处理单元302执行将摄影对象布置在虚拟空间中。此外,可以在预设地点处布置虚拟空间中的布置。接下来将参照图10描述布置处理。

可以重复上述步骤S106至S121中所示的处理,直到VR内容的观看结束(步骤S124)。如上所述,在本实施方式中,根据用户的图像捕获操作执行从捕获图像的获取到虚拟空间中的布置的一系列处理,并且因此,可以减少麻烦操作并且进一步增强虚拟空间中的图像捕获体验的娱乐性。

注意,可以仅在VR内容的再现时间内的允许成像的预定时区中执行上述成像处理。此外,成像处理单元302可以被配置成能够仅对虚拟空间中的预定地点或目标(仅允许的地点或目标)成像。

上面已经描述了根据本实施方式的成像处理。注意,图7所示的操作处理是示例,并且本公开内容不限于图7所示的示例。例如,本公开内容不限于图7所示的步骤的顺序。可以并行地处理或者可以以相反的顺序处理步骤中的至少一个步骤。此外,可以不必执行图7所示的所有处理。例如,可以连续地获取图像并且可以执行图像捕获成功或失败的确定,并且可以连续地获取图像直到图像捕获成功。

此外,可以不必由单个设备执行图7所示的所有处理。例如,在上述描述中,假设图7所示的所有处理都由信息处理装置30执行,但是本公开内容不限于此。例如,图7所示的所有处理可以由显示设备10执行,或者可以由显示设备10和信息处理装置30执行。

<3-2.捕获图像的布置处理>

接下来,将描述在上述步骤S121中说明的捕获图像(摄影对象)在虚拟空间中的布置。虚拟空间中的布置可以围绕用户的视点来随机地执行或者可以在预设地点处执行。假设预设地点是例如不干扰VR内容的观看的位置,即,不与作为VR内容中的主体的观看目标(例如,舞台、行进方向等)交叠的地点,例如用户的视场之外。在下文中,将参照图10至图12给出具体描述。

图10是示出根据本实施方式的捕获图像的布置处理的流程的示例的流程图。图11是示出根据本实施方式的捕获图像的布置位置的图。

如图10和图11所示,首先,布置控制单元303将最终布置位置Q设置在从虚拟空间中的观看位置P(用户的视点)相对于VR内容的观看目标(例如舞台方向等。替选地,观看目标可以是在VR内容中限定的前方方向。)的约110°的水平视角之外(步骤S203)。此处,考虑到人的识别视角,“约110°的水平视角”是“视场”的范围的示例,但是本实施方式的“视场”的范围(角度)不限于此。此外,“视场”的定义不限于考虑识别视角的定义。此外,布置控制单元303可以将最终布置位置Q设置在用户的视场之外并且在用户的手可到达的范围内的距离处。

接下来,布置控制单元303绘制捕获图像的直到最终布置位置Q的移动轨迹(步骤S206)。此处,将绘制到捕获图像的最终布置位置的移动轨迹的情况描述为示例,但是本公开内容不限于此,并且可以在不绘制移动轨迹的情况下将捕获图像布置在最终布置位置。

图12是用于描述根据本实施方式的绘制到捕获图像的布置位置的移动轨迹的情况的图。如图12所示,例如,在显示设备10的显示单元140上显示的虚拟空间的视频430中,当用户执行图像捕获操作时,具有视角600的区域从视频430出现,并且捕获图像510朝向设置在用户的视场之外(显示单元140上显示的虚拟空间的视频430之外)的最终布置位置Q移动。例如,在最终布置位置Q在用户的右侧的情况下,可以呈现其中捕获图像510淡出到视频430的右侧同时大小逐渐减小的动画。因此,用户可以直观地掌握捕获图像被布置在哪个方向上。

注意,可以将诸如简易曲线的速度表现(例如,在移动开始时、在移动期间、在曲线处时、在即将到达之前等的加速度或减速度)或诸如轨迹的曲线设计的表现给予捕获图像的移动轨迹。

接下来,当捕获图像到达最终布置位置Q时(步骤S209/是),布置控制单元303将捕获图像固定至最终布置位置Q,并且通过声音效果向用户通知布置位置的方向(步骤S212)。例如,在最终布置位置Q位于用户的右侧的情况下,可以从右侧方向听到声音效果,使得用户可以直观地掌握捕获图像被布置在右侧,尽管在视场中看不到该图像。注意,布置控制单元303可以执行对以下的控制:在不显示上述移动过程的动画的情况下根据图像捕获操作将捕获图像510(摄影对象)立即布置在最终布置位置Q处,并且通过声音输出声音效果(快门声音等)以从布置方向听到。此处,例示了通过声音的通知,但是本公开内容不限于此,并且可以通过显示、振动等来提供捕获图像被布置在视场之外的事实、布置方向、布置位置等的通知。显示的示例包括指示布置方向的箭头的显示。

此外,“固定捕获图像”可以是相对于虚拟空间中的用户位置的相对位置关系的固定,或者可以是虚拟空间中的绝对位置的固定。在固定相对位置关系的情况下,当用户在虚拟空间中移动时,布置在用户旁边等的捕获图像也随着用户的移动而移动。

此外,用户可以选中布置在虚拟空间中的最终布置位置Q处的捕获图像510(参加图3),并且将捕获图像移动至另一地点或者放大或缩小捕获图像。可以通过控制器20的操作或姿势来执行与捕获图像510(摄影对象)的交互。具体地,例如,内容观看控制单元301可以在虚拟空间中显示反映用户的操作、手的形状、手的位置、手的移动等的虚拟手(手的形状的虚拟对象),使得可以由虚拟手抓握捕获图像510。在这种情况下,可以通过例如利用虚拟手相对于捕获图像510撑开/捏合、利用虚拟手握住捕获图像510的两端以扩展或收缩捕获图像510、或者在捕获图像510上握住或打开虚拟手来执行捕获图像510的放大/缩小。此外,用户还可以通过将每个捕获图像重新布置(手动布置)在期望位置处来创建原始观看空间。后面将描述捕获图像的重新布置。

此外,布置控制单元303可以将通过多次图像捕获操作获得的多个捕获图像叠加并且显示在最终布置位置Q上。例如,在图3所示的示例中,可以理解,最新捕获的捕获图像510被布置在最前面。此外,布置控制单元303可以将一定数目的捕获图像彼此稍微偏移地显示在捕获图像510的后面,使得用户直观地知道多个捕获图像存在于最终布置位置Q处。

上面已经描述了根据本实施方式的布置处理。注意,图10所示的操作处理是示例,并且本公开内容不限于图10所示的示例。例如,本公开内容不限于图10所示的步骤的顺序。可以并行地处理或者可以以相反的顺序处理步骤中的至少一个步骤。此外,可以不必执行图10所示的所有处理。

此外,可以不必由单个设备执行图10所示的所有处理。例如,在上述描述中,假设图10所示的所有处理都由信息处理装置30执行,但是本公开内容不限于此。例如,图10所示的所有处理可以由显示设备10执行,或者可以由显示设备10和信息处理装置30执行。

<3-3.捕获图像的标签处理>

接下来,将描述将标签添加至在上述步骤S121中生成的捕获图像(摄影对象)以及标签的使用。图13是示出根据本实施方式的捕获图像的标签处理的流程的示例的流程图。

如图13所示,首先,标记单元304基于捕获图像中示出的被摄体位置信息或面部识别结果来估计被摄体信息,并且将被摄体信息作为标签(伴随信息)添加至捕获图像(步骤S223)。被摄体的位置信息例如是虚拟空间中的三维位置坐标。例如,在以图8所示的视角610执行成像的情况下,标记单元304获取接近目标点T的被摄体401C的站立位置Pc(Xc,Yc,Zc)作为被摄体的位置信息。在音乐会、舞台等情况下,可以预先确定表演者的站立位置。标记单元304可以基于预先生成的关于站立位置的信息以及被摄体的成像时间和站立位置来获取诸如出现在捕获图像中的被摄体是谁以及被摄体的姓名的信息(被摄体信息)。此外,标记单元304可以分析被摄体的面部图像并且基于面部识别来估计被摄体是谁。可以预先准备用于VR内容中的表演者等的面部识别的信息。

注意,标记单元304基本上对出现在捕获图像的中心的被摄体的信息进行标记,但是本公开内容不限于此。例如,标记单元304可以对出现在捕获图像中的所有被摄体的信息进行标记。此外,标记单元304可以对关于捕获图像中示出的被摄体之中处于焦点的被摄体的信息进行标记。此外,标记单元304可以对出现在捕获图像中的被摄体之中看起来最大的被摄体的信息进行标记。

接下来,标记单元304将关于被成像的VR内容的信息和图像捕获时间信息(再现开始位置信息)作为标签添加至捕获图像(步骤S226)。图像捕获时间信息是关于已经捕获了图像的VR内容的再现时间轴上的图像捕获时间的信息,并且被视为再现开始位置。

上面已经描述了对捕获图像的标签添加处理。接下来,将描述添加至捕获图像的标签的使用。

例如,在由用户执行了捕获图像的分组布置操作的情况下(步骤S229/是),例如,布置控制单元303基于对每个捕获图像赋予的被摄体信息,针对每个被摄体(例如,针对被摄体401A、被摄体401C和被摄体401D中的每一个)执行布置捕获图像的控制(步骤S232)。布置控制单元303可以针对每个组竖直地或水平地布置多个捕获图像,或者可以以交叠的方式布置多个捕获图像。此外,虚拟空间中的分组布置的地点不受特别限制,并且所述地点的示例包括不与作为VR内容的主体的观看目标(舞台、行进方向等)交叠的地点。更具体地,所述地点可以是稍微远离用户、用户的背面、用户的手、用户的上侧(天花板、天空等)等的地点。

此处,作为示例,已经描述了针对每个被摄体执行分组的情况,但是本实施方式不限于此。布置控制单元303可以通过基于附加至每个捕获图像的标签通过其他要素对捕获图像进行分组来布置捕获图像。例如,布置控制单元303可以通过对针对每个场景(场景变化)、每种类型的被摄体、每种类型的衣服、每组站立位置等的图像进行分组来布置图像。即,也可以将成像时的场景、被摄体的类型、站立位置等作为标签添加至每个捕获图像。

此外,在已经对捕获图像执行了作为捕获图像的获取源的VR内容的再现操作的情况下(步骤S235/是),内容观看控制单元301基于所选择的捕获图像的标签(再现开始位置信息)执行开始VR内容的再现的控制(步骤S238)。因此,用户可以从执行图像捕获的时间起在虚拟空间中再现VR内容。

上面已经描述了根据本实施方式的标签处理。注意,图13所示的操作处理是示例,并且本公开内容不限于图13所示的示例。例如,本公开内容不限于图13所示的步骤的顺序。可以并行地处理或者可以以相反的顺序处理步骤中的至少一个步骤。此外,可以不必执行图13所示的所有处理。

此外,可以不必由单个设备执行图13所示的所有处理。例如,在上述描述中,假设图13所示的所有处理都由信息处理装置30执行,但是本公开内容不限于此。例如,图13所示的所有处理可以由显示设备10执行,或者可以由显示设备10和信息处理装置30执行。

<3-4.成像时的过滤处理>

在上述步骤S121中,根据本实施方式的成像处理单元302可以执行去除妨碍生成捕获图像的效果、除了表演者之外的被摄体(例如,另一用户的化身)等的过滤处理。

图14是示出根据本实施方式的捕获图像的过滤处理的图。例如,如图14所示,作为目标(接近目标点T)的被摄体401C和另一被摄体401B的至少一部分可能被效果图像403(403A、403B)或另一用户的化身405(405A至405C)隐藏在捕获图像520中。因此,在本实施方式中,可以仅捕获作为VR内容中的主观看目标的被摄体(演员、游戏角色等)。

图15是示出根据本实施方式的在成像时的过滤处理的流程的示例的流程图。如图15所示,在被设置成仅对表演者成像的情况下(步骤S243/是),成像处理单元302通过排除除了表演者之外的CG对象(效果、其他用户的化身等)生成2D纹理(获取捕获图像)(在视角600的范围内)(步骤S245)。此处,诸如虚拟对象是表演者、效果还是另一用户的化身的信息被给予虚拟空间中的每个虚拟对象。成像处理单元302识别反映在视角600中的每个虚拟对象、去除除了表演者之外的虚拟对象、并且然后获取图像。注意,即使在被摄体是从实景视频生成的立体图像的一部分的情况下,通过执行去除效果或去除包括另一用户的化身的虚拟对象的处理,也能够消除成为障碍的反映。注意,尽管此处已经描述了术语“表演者”,但是在本实施方式中,可以在不受用于制作的附加虚拟对象的干扰的情况下可靠地捕获VR内容中的主观看目标的图像。

此外,成像处理单元302可以仅在附加虚拟对象位于被摄体(表演者等)的前方(前面)的情况下去除用于表演的附加虚拟对象,或者可以仅在附加虚拟对象与被摄体(表演者等)交叠的情况下去除附加虚拟对象。

上面已经描述了根据本实施方式的过滤处理。注意,图15所示的操作处理是示例,并且本公开内容不限于图15所示的示例。

此外,可以不必由单个设备执行图15所示的所有处理。例如,在上述描述中,假设图15所示的所有处理都由信息处理装置30执行,但是本公开内容不限于此。例如,图15所示的所有处理可以由显示设备10执行,或者可以由显示设备10和信息处理装置30执行。

<3-5.捕获图像的重新布置处理>

此外,在本实施方式中,用户可以通过在期望位置处重新布置(手动重新布置)每个捕获图像来创建原始观看空间。

更具体地,例如,如图3所示,用户可以根据利用虚拟手等的图像捕获操作来选择布置在预定位置处的捕获图像510,并且将捕获图像移动至另一可容易观看的地点或诸如用户的前方(舞台方向等)的喜爱地点。此处,图16示出了用户手动地重新布置多个捕获图像的情况的示例。如图16所示,用户可以以任何布局(喜爱的位置和姿态)将捕获图像510a至510g布置在他/她自己可容易观看的地点(例如,前方(舞台)的方向上)。即,信息处理装置30的布置控制单元303基于由控制器20检测到的用户操作等执行将由用户选择的捕获图像以任意姿态布置在由用户指定的任意位置处的控制。

用户可以在观看舞台的同时体验被他自己/她自己捕获的他/她喜爱的照片包围的他/她自己的空间的创建。这样的体验对于每个观看者或每个分发是不同的,并且可以是激励VR内容的重复体验动机的新VR体验价值。此外,通过布置大量的照片,使得自己创建的原始空间可以被成像(例如,整个视场被存储为静止图像或运动图像)并且显示给其他用户,可以激活粉丝之间的竞争的动机,并且可以期待对商业规模的扩展的贡献。

注意,手动布置的捕获图像可以固定为虚拟空间中的绝对布置位置,或者可以固定为相对于用户位置的相对布置位置。在相对布置的情况下,当用户在虚拟空间中移动时,布置在用户周围的捕获图像510a至510g也随着用户的移动而移动。

此外,在本实施方式中,在用户周围手动重新布置的捕获图像的数目超过上限的情况下、在捕获图像的占用面积超过预定值的情况下、或者在其他情况下,也可以自动排列(自动重新布置)在稍微远离用户的地点处手动布置的多个捕获图像。排列布置可以是在虚拟空间中在竖直方向或水平方向上的排列,或者在深度方向上的排列。这样排列的这样的组在下文中被称为“排列架(alignment shelf)”。在满足预定条件的情况下,例如在手动重新布置的捕获图像的数目超过预定数目的情况下,可以自动地执行自动重新布置(排列布置),或者用户可以给出执行自动重新布置(排列布置)的指令。

图17是用于描述根据本实施方式的自动重新布置(排列布置)的示例的图。如图17所示,布置控制单元303将手动布置在用户周围的多个捕获图像竖直地布置(排列)在例如相对于舞台方向离开用户的左侧一定程度的位置处,并且创建排列架710a。排列架710a是通过将手动布置在用户周围的捕获图像510a至510f进行竖直排列而形成的。

可以创建多个排列架710。例如,布置控制单元303可以在每次执行自动重新布置(排列布置)时新生成排列架710。在图17所示的示例中,创建n个排列架710。此外,可以针对每个分类组准备排列架710。分类组例如是基于上述标签的组。例如,布置控制单元303可以针对出现在捕获图像中的每个被摄体将捕获图像存储在每个排列架710(被摄体A的排列架、被摄体B的排列架等)中。

此外,可以预先设置排列架710的面积(大小),并且在捕获图像不能容纳在所有排列架的情况下,布置控制单元303可以减小并且排列(存储)每个捕获图像。替选地,在捕获图像不能在所有排列架的情况下,布置控制单元303可以新生成下一个排列架并且排列(存储)捕获图像。

此外,排列架的布置位置不受特别限制,但是例如优选的是,排列架710不覆盖舞台,并且被布置在尽管稍微远离用户但能够确保每个捕获图像的可见性的距离处。用户还可以从排列架710中取出任何捕获图像并且手动地布置捕获图像。在排列架710被布置在用户不能到达的距离处的情况下,用户可以执行诸如从排列架710取出任意捕获图像或者通过使用诸如虚拟空间中的激光指示器的操作项移动排列架710的操作。

此外,当将手动布置的一个或更多个捕获图像自动排列在排列架上时,布置控制单元303可以显示其中每个捕获图像移动到排列架的轨迹(移动动画)。可以将诸如简易曲线的速度表现或诸如轨迹的曲线设计的表现赋予轨迹。

此外,布置控制单元303还可以存储手动布置时的每个捕获图像的位置和姿态,并且将在排列架上排列的多个捕获图像再次返回至手动布置状态。

下面将参照图18描述与上述捕获图像的每个重新布置相关的操作处理。

图18是示出根据本实施方式的捕获图像的重新布置处理的流程的示例的流程图。如图18所示,首先,在用户已经执行了手动布置操作的情况下(步骤S303/是),布置控制单元303将所选择的捕获图像移动到用户指定的手动粘贴位置(步骤S306)。例如,用户在使用控制器20进行图像捕获之后立即执行握住(选择)布置在预定位置处的捕获图像510(参见图3)的操作,并且在真实世界中移动握住控制器20的手,以在虚拟空间中在握住捕获图像510的状态下将捕获图像510移动到任意位置。布置控制单元303根据由控制器20检测到的用户操作(诸如按钮操作和加速度的感测数据)来控制捕获图像510的位置和姿态。

可以重复上述步骤S303至步骤S306中所示的处理,直到超过手动布置的上限值(步骤S309)。即,用户可以执行将多个捕获图像依次粘贴(移动)到任意位置的操作。

接下来,在已经超过手动布置的上限值的情况下(步骤S309/是),布置控制单元303将所有手动布置的捕获图像的手动布置坐标存储在存储单元320中(步骤S312)。为每个捕获图像分配图像ID,并且布置控制单元303将手动布置坐标与图像ID相关联地存储。此外,手动布置的上限值可以是张数的上限数目或上限占用率(手动布置的捕获图像与用户的外围区域的比率等)。此外,手动布置坐标不仅包括虚拟空间中的三维位置,而且包括每个捕获图像的布置姿态(倾斜、角度)。此外,布置控制单元303还可以存储每个捕获图像的放大和缩小状态。以这种方式,布置控制单元303可以将多个捕获图像的手动布置状态与图像ID相关联地存储。注意,布置控制单元303可以通过分配存储日期和时间(手动布置的日期和时间)或调用编号来存储包括各个捕获图像的图像ID的图像ID组。

接下来,布置控制单元303确定每个图像的自动排列布置坐标并且执行自动排列(步骤S315)。每个图像的自动排列坐标是指示图像的排列目的地的信息。具体地,例如,地址对应于排列架的地址。布置控制单元303将排列架的地址分配给每个捕获图像。例如,布置控制单元303从排列架A的头地址(在竖直布置的排列架的情况下是最上面的布置地点)开始依次分配地址,并且当所有地址被填充时,类似地从下一个排列架B的头地址开始依次分配地址。注意,在针对每个分类组准备了多个排列架的情况下,布置控制单元303基于每个捕获图像的标签分配对应排列架的空地址。布置控制单元303将每个捕获图像移动到所分配的地址(执行自动排列)。此外,与图像ID相关联地存储每个自动排列布置坐标。

上面已经描述了手动布置的捕获图像到排列架的自动排列。因此自动排列的捕获图像可以基于上述存储的信息在任何时间返回至手动布置位置。

具体地,当存在用户的手动布置调用操作时(步骤S318/是),布置控制单元303基于目标捕获图像组的手动布置坐标来执行将每个捕获图像从排列架移动至手动粘贴位置的控制(步骤S321)。可以通过指定上述调用编号或手动布置的日期和时间来执行手动布置的调用。用户可以从例如手动布置的调用编号列表显示等中指定编号。

上面已经描述了根据本实施方式的重新布置捕获图像的处理。注意,图18所示的操作处理是示例,并且本公开内容不限于图18所示的示例。

此外,可以不必由单个设备执行图18所示的所有处理。例如,在上述描述中,假设图18所示的所有处理都由信息处理装置30执行,但是本公开内容不限于此。例如,图18所示的所有处理可以由显示设备10执行,或者可以由显示设备10和信息处理装置30执行。

<3-6.捕获图像的共享处理>

此外,在本实施方式中,可以与外部共享捕获图像。例如,通过选择任意捕获图像并且执行预定的共享操作,用户可以将捕获图像共享(发送捕获图像的副本)给一起观看VR内容的其他用户。用户可以任意选择共享目的地。作为示例,共享目的地可以是正在一起观看VR内容的另一用户,或者可以是注册为朋友的另一用户。在VR内容是实时分发等的情况下,还假设与朋友一起观看VR内容。在这种情况下,朋友的化身布置在虚拟空间中,并且用户可以与朋友进行对话(语音或聊天)、共享捕获图像等。

例如,如图19所示,共享操作可以是利用虚拟手820握住要共享的捕获图像510g并且滑动、触摸、插入捕获图像到设置在预定共享对象810(虚拟对象)中的切口的操作等。在执行这样的操作的情况下,共享控制单元305可以显示用于选择共享目的地的画面并且使用户选择共享目的地。替选地,共享控制单元305可以自动确定一起参与的朋友(正在同时观看相同VR内容的注册为朋友的其他用户)作为共享目的地。共享控制单元305在共享目的地用户的虚拟空间中的预定位置处布置并且呈现共享的捕获图像。可以通过声音或显示将共享的捕获图像的呈现的通知提供给共享目的地用户。注意,一起参与的朋友不限于类似地在HMD上观看相同VR内容的朋友,并且可以是在智能电话、平板终端等上观看相同VR内容的朋友。

此外,可以与具有向用户提供使用捕获图像的各种服务的系统(另一服务器(未示出))的外部共享捕获图像。例如,存在使用捕获图像创建软或硬商品例如从捕获图像创建相册或者创建其上印有捕获图像的马克杯、T恤、纸张等的服务。可以对使用这样的服务收费。

此外,与外部共享捕获图像的“外部”意指显示设备10的外部,并且除了显示设备10之外的所有设备可以是目标。因此,在本系统中,例如,可以将捕获图像共享(传送)到用户的智能电话、平板终端等。此外,当从外部进行共享时,还可以从用户的智能电话或平板终端或者用户使用的云来获取图像(以将图像布置在虚拟空间中)。

可以提供其中将虚拟空间中的体验扩展到真实世界中的体验的下一代体验(例如将自己在虚拟空间中捕获的图像共享(传送)到外部的体验),并且创建VR体验的新价值。

下面将参照图20描述上述捕获图像的共享处理。

图20是示出根据本实施方式的捕获图像的共享处理的流程的示例的流程图。如图20所示,首先,在存在到外部的共享操作的情况下(步骤S403),共享控制单元305将用户在共享操作中选择的捕获图像发送至预定共享目的地(步骤S406)。更具体地,通过由内容观看控制单元301将要共享的捕获图像布置在共享目的地用户的虚拟空间中,捕获图像可以基本上被发送至共享目的地用户的显示设备。替选地,共享控制单元305将捕获图像发送至共享目的地用户的显示设备,并且共享目的地用户的显示设备执行将捕获图像布置在虚拟空间中的控制。此外,共享目的地可以是使用捕获图像提供各种服务的系统的服务器。此外,预定共享目的地可以是用户任意选择的共享目的地,或者可以是预设的共享目的地。此外,可以准备用于共享操作的多个共享对象810(虚拟对象),并且可以将预先与所使用的共享对象810相关联的共享目的地设置为预定共享目的地。

另一方面,在从外部共享捕获图像的情况下(步骤S409/是),共享控制单元305将共享的捕获图像布置在用户的虚拟空间中的预定位置处(步骤S412)。显示设备10可以通过声音或显示来向用户通知捕获图像的呈现。此外,共享的捕获图像的预定布置位置可以例如在虚拟空间中的用户视场之外。即,例如,由用户捕获的捕获图像可以布置在用户视场之外的右侧,并且共享的捕获图像可以布置在视场之外的左侧。此外,共享控制单元305可以通过图标等清楚地指示从谁(从哪里)共享了捕获图像。

上面已经描述了根据本实施方式的捕获图像的共享处理。注意,图20所示的操作处理是示例,并且本公开内容不限于图20所示的示例。

此外,可以不必由单个设备执行图20所示的所有处理。例如,在上述描述中,假设图20所示的所有处理都由信息处理装置30执行,但是本公开内容不限于此。例如,图20所示的所有处理可以由显示设备10执行,或者可以由显示设备10和信息处理装置30执行。

<<4.其他>>

下面将补充根据本实施方式的信息处理系统。

成像不限于获取静止图像,并且可以获取运动图像。具体地,例如,成像处理单元302可以获取具有更逼真感觉的照片,例如移动了诸如几秒的时间的照片。用户可以预设运动时间(例如秒数)。此外,这样的运动图片(运动图像)还可以包括声音。

此外,当在虚拟空间中的成像中获取运动图像时,也可以针对每一帧执行参照图7和图8描述的图像捕获成功或失败的确定。成像处理单元302可以执行对已经作出诸如眼睛闭合或衣服翻折的失败确定的帧进行切割或变暗的处理。可以在内容分发者侧预先设置哪个帧被认为是失败确定。

此外,信息处理装置30可以在对被摄体进行成像时对被摄体的面部大小设置上限。即,通过限制放大处理,可以禁止太靠近被摄体的面部的图片的图像捕获。这样的设置可以由内容分发者侧适当地设置。

此外,内容观看控制单元301可以执行控制使得如图16所示粘贴至空间的捕获图像与虚拟空间中的内容的分发者(例如,内容的主观看目标,诸如舞台上的表演者或游戏角色)的移动共同颤动(移动)。此外,内容观看控制单元301可以获取表演者等的骨骼信息等,并且可以当表演者和粘贴至空间的捕获图像彼此冲突时(例如,当舞台上的表演者将他/她的手朝向用户侧延伸并且接近用户侧时等)给出诸如使捕获图像振动的行为。以这种方式,通过根据表演者等的移动来移动粘贴至空间的捕获图像,可以给予用户虚拟空间的逼真感。

此外,布置控制单元303可以具有以下功能:识别虚拟空间中表演者等的位置,并且支持布置使得捕获图像被布置成不与表演者等交叠。

此外,除了通过虚拟空间中的图像捕获而获取的捕获图像之外,通过调用已经存储在存储单元320或另一终端中的各种图像,可以对要布置在虚拟空间中的图像进行布局并且布置在虚拟空间中的任何位置。

此外,要获取的捕获图像不限于2D图像(2D纹理),并且可以是3D图像(3D静止图像或运动图像)。

此外,内容观看控制单元301可以显示同时观看虚拟空间中的相同内容的另一用户的化身。此外,内容观看控制单元301可以向用户呈现指示用户的朋友(注册为朋友的另一用户)的化身的位置的信息。此外,信息处理装置306还可以从用户共享的捕获图像指定虚拟空间中捕获该捕获图像的地点,并且将指定的图像捕获地点呈现给用户。

此外,已经假设VR内容作为示例描述了上述实施方式,但是本公开内容也可以应用于增强现实(AR)或混合现实(MR)。例如,在AR的情况下,信息处理装置30获取包括以叠加方式显示在真实世界(真实空间)中的虚拟空间中的被摄体(作为与真实世界融合的虚拟世界的信息显示的图像,例如虚拟对象)的显示范围的一部分作为图像(在本说明书中,将其视为“成像”),并且将捕获图像作为摄影对象布置在以叠加方式显示在真实空间中的虚拟空间中。此外,显示设备10可以是透射式HMD、智能电话、平板终端等。

此外,信息处理装置30可以将上述各种功能(捕获图像的获取、捕获图像的手动布置、捕获图像的排列布置、捕获图像的共享机器等)中的每一个设置为计费目标功能。

此外,在上述实施方式中,已经描述了在排列架上自动排列手动布置的捕获图像,但是本公开内容不限于此。例如,布置控制单元303可以执行将如图3所示的成像之后布置的捕获图像自动排列到排列架上的控制。这样的自动排列控制可以利用用户操作作为触发来执行,或者可以当所布置的捕获图像的数目达到张数的上限时执行。

<<5.总结>>

如上所述,在根据本公开内容的实施方式的信息处理系统中,可以进一步增强虚拟空间中的图像捕获体验的娱乐性。

上面已经参照附图详细描述了本公开内容的优选实施方式,但是本技术不限于这样的示例。明显的是,具有本公开内容的技术领域中的普通知识的人员可以在权利要求中描述的技术思想的范围内想到各种改变示例或修改示例,并且自然地理解,这些改变示例和修改示例也属于本公开内容的技术范围。

例如,还可以创建用于使内置在上述显示设备10、控制器20或信息处理装置30中的诸如CPU、ROM和RAM的硬件表现出显示设备10、控制器20或信息处理装置30的功能的计算机程序。此外,还提供了存储计算机程序的计算机可读存储介质。

此外,本说明书中描述的效果仅是说明性或示例性的,而不是限制性的。即,与上述效果一起或代替上述效果,根据本公开内容的技术可以呈现根据本说明书的描述对本领域技术人员而言明显的其他效果。

注意,本技术也可以具有以下配置。

(1)

一种信息处理装置,包括控制单元,当检测到用于对虚拟空间中的被摄体进行成像的成像触发时,所述控制单元生成通过对所述被摄体进行成像而获得的捕获图像,并且执行将所生成的捕获图像作为虚拟对象布置在所述虚拟空间中的控制。

(2)

根据上述(1)所述的信息处理装置,其中,所述控制单元根据预设的布置规则将所述捕获图像布置在所述虚拟空间中。

(3)

根据上述(2)所述的信息处理装置,其中,所述控制单元在相对于观看所述虚拟空间的用户的位置预先设置的地点处布置所述虚拟空间。

(4)

根据上述(3)所述的信息处理装置,其中,所述控制单元执行布置在所述用户的视场之外的控制。

(5)

根据上述(3)或(4)所述的信息处理装置,其中,所述控制单元执行布置在避开与所述虚拟空间中的预定观看目标交叠的位置的地点处的控制。

(6)

根据上述(1)至(5)中任一项所述的信息处理装置,其中,所述控制单元对观看所述虚拟空间的用户的视场的一部分进行成像。

(7)

根据上述(6)所述的信息处理装置,其中,

观看所述虚拟空间的用户的视场包括其中显示有所述虚拟空间的显示单元的显示范围,并且

所述控制单元获取所述显示单元的显示范围的一部分作为捕获图像。

(8)

根据上述(1)至(7)中任一项所述的信息处理装置,其中,当检测到所述成像触发时,所述控制单元连续地获取多个所述捕获图像,并且确定是否已经成功地捕获了每一个所述捕获图像。

(9)

根据上述(8)所述的信息处理装置,其中,所述控制单元将连续地获取的捕获图像中的确定为成功捕获的捕获图像作为所述虚拟对象布置在所述虚拟空间中。

(10)

根据上述(1)至(9)中任一项所述的信息处理装置,其中,所述控制单元执行向用户通知已经布置了所述捕获图像的通知。

(11)

根据上述(1)至(10)中任一项所述的信息处理装置,其中,所述控制单元将关于所述捕获图像的伴随信息添加至所述捕获图像。

(12)

根据上述(11)所述的信息处理装置,其中,所述伴随信息至少包括:关于出现在所述捕获图像中的所述被摄体的信息,或者关于在所述虚拟空间中提供的内容的再现时间轴上的执行所述成像的时间的信息。

(13)

根据上述(1)至(12)中任一项所述的信息处理装置,其中,所述控制单元获取至少排除了与所述被摄体交叠的附加虚拟对象的捕获图像。

(14)

根据上述(1)至(13)中任一项所述的信息处理装置,其中,所述控制单元根据用户操作在所述虚拟空间中以任意位置和姿态重新布置所布置的捕获图像。

(15)

根据上述(1)至(14)中任一项所述的信息处理装置,其中,所述控制单元将布置在预定位置处的多个所述捕获图像移动到所述虚拟空间中的其他地点并且排列。

(16)

根据上述(15)所述的信息处理装置,其中,所述控制单元存储多个所述捕获图像在被排列之前的布置状态,并且执行将被移动到所述其他地点并且排列的多个所述捕获图像返回至所述排列之前的状态的控制。

(17)

根据上述(1)至(16)中任一项所述的信息处理装置,其中,所述控制单元执行将布置在所述虚拟空间中的所述捕获图像共享至外部的控制。

(18)

根据上述(1)至(17)中任一项所述的信息处理装置,其中,所述控制单元在显示所述虚拟空间的显示单元上执行指示所述成像的范围的显示。

(19)

一种信息处理方法,包括:当处理器检测到用于对虚拟空间中的被摄体进行成像的成像触发时,由处理器生成通过对所述被摄体进行成像而获得的捕获图像,并且执行将所生成的捕获图像作为虚拟对象布置在所述虚拟空间中的控制。

(20)

一种信息处理系统,包括:

显示设备;

控制器;以及

信息处理装置,所述信息处理装置包括控制单元,当由所述控制器检测到用于对显示在所述显示设备上的虚拟空间中的被摄体进行成像的成像触发时,所述控制单元生成通过对所述被摄体进行成像而获得的捕获图像,并且执行将所生成的捕获图像作为虚拟对象布置在所述虚拟空间中的控制。

附图标记列表

10显示设备

140显示单元

20控制器

30信息处理装置

300控制单元

301内容观看控制单元

302成像处理单元

303布置控制单元

304标记单元

305共享控制单元

- 信息处理装置、信息处理方法和信息处理系统

- 信息处理装置、信息处理方法以及信息处理系统

- 一种信息处理方法、信息处理系统及计算机装置

- 信息处理系统以及信息处理方法

- 信息处理装置和信息处理系统

- 细胞观察信息处理系统、细胞观察信息处理方法、细胞观察信息处理程序、细胞观察信息处理系统具有的记录部和细胞观察信息处理系统具有的装置

- 细胞观察信息处理系统、细胞观察信息处理方法、细胞观察信息处理程序、细胞观察信息处理系统具有的记录部、细胞观察信息处理系统具有的装置