一种基于多任务学习和注意力机制的英文语法纠正技术

文献发布时间:2024-01-17 01:27:33

技术领域

本发明涉及一种英文语法纠正技术,属于自然语言处理技术领域。

背景技术

随着互联网、移动设备等技术的普及,英文的使用范围越来越广泛,英文语法纠正技术也越来越受到重视。正确的英语语法对于有效沟通至关重要。在写作或口语交流中,语法错误会混淆原本的意思,导致混淆或误解。通过纠正语法错误,我们可以确保我们传达的信息清晰准确。良好的语法也提高了书面文本的可读性。当读者遇到语法错误时,可能需要更多的努力来理解文本,这可能会疲劳和分散注意力。通过纠正语法错误,我们可以使文本更易于阅读并更有吸引力。语法纠错对于语言学习也非常重要。通过识别和纠正错误,学习者可以更好地理解语法规则,并改进自己的写作和口语能力。此外,自动语法纠错工具可以提供即时反馈给学习者,让他们更快地有效地纠正自己的错误。然而目前的英文语法纠错技术仍存在提升空间,本发明提出的多任务学习和注意力机制的英文语法纠正技术着重解决以下问题:

一、英文语法纠正领域内定义的语法错误较为复杂,为适应训练难度,本发明提出一种多任务学习联合约束的训练方式:语法纠正的前序工作是语法检查,训练的第一个任务即检测句子中的单词是否出现错误;训练的第二个任务为预测句中单词对应的编辑标签;训练的第三个任务为一个基于对比学习的margin损失,期望模型提高分类置信度,较为确信地给出正确分类结果;

二、英文语法纠正在建模层面依赖模型对英文句子的句法信息和语义信息。为进一步编码输入句子的句法信息和语义信息,本发明提出的一种注意力建模隐层输出的方式,首先对预训练编码器的最后三层输出做平均操作,得到更完整的语义表示,再通过注意力层,使整个句子的各个子词关注到含有句法关系的部分,从而获取融合了句法信息和语义信息的更优的上下文表示。

发明内容

本发明为解决现有英文语法纠正技术适应能力较差,对一些复杂语句的语法纠正不准确的问题,进而提出一种基于多任务学习和注意力机制的英文语法纠正技术。

本发明为解决上述问题采取的技术方案是:本发明的步骤为:

步骤1、对于输入的句子,从数据库中读取英文分词词表及编辑标签词表;

步骤2、将句子输入预训练编码模型,获取整个句子的上下文表示;

步骤3、将得到的上下文特征向量经过自注意力层,通过自注意力机制,使句子中各个字的语义向量做进一步交互;

步骤4、使用二分类分类器,判别输入子词是否需要进行编辑操作,使用词表大小的分类器对输入的子词进行编辑标签分类,选择得分最高的分类结果作为对应子词的编辑标签;

步骤5、根据模型预测的纠正标签对应的意义对输入句子中的单词进行后处理,得到的后处理结果再输入模型进行多次迭代得到最终结果。

进一步的,步骤2中采用的预训练英文编码模型包括RoBERTa,XLNet和DeBERTa,三个预训练模型均是BERT的改进版,使用了更多的预训练语料,更合理的预训练任务及建模机制训练完成的,在多个英文语义建模领域都有不错的效果。具体过程包括以下步骤:

步骤2.1对于输入的英文句子,加载英文分词工具,将英文句子的逐个单词切分为子词形式;

步骤2.2将英文句子的子词序列通过预训练英文编码模型的词嵌入层,映射为768维的向量;

步骤2.3将映射向量经过12层预训练英文编码模型,并将模型最后三层输出的隐藏层向量沿着最后一维拼接并取平均,从而获得包含更多语义信息的隐层向量。

进一步的,步骤3中的自注意力层对步骤2输出的包含语义信息的编码表示做self-attention操作,使得整个句子中的语义表示做进一步交互,

Attn(x)=(W

公式(1)中x表示步骤2中获取的句子的语义表示,W

进一步的,步骤4中在训练阶段使用多任务学习的方式进一步约束模型的优化方向,

在训练阶段提出了三个约束帮助模型达到更优;

Loss=Loss

公式(2)为第一个损失约束公式,其中P

公式(3)为第二个损失约束公式,其中P

公式(4)为第三个损失约束公式,其中y为一个全1的向量,决定优化方向;

进一步的,步骤4的训练过程中采用多阶段训练以逐步提升训练难度;

在语法错误纠正领域,句子中只有小部分是存在语法错误的,即大多数成分是需要保持不变的,这需要模型在训练过程中应当见到不含语法错误的句子;本发明在训练阶段采用多阶段训练,逐步提升训练难度,保证模型纠正的准确性;模型的训练具体分为三阶段:

第一阶段:采用人工生成的伪数据进行训练,这些数据使用动词时态表,以及随即删除、插入英文词形成,共计900万条数据;这些数据全部包含错误,通过足够量的数据作为预训练,初步提升模型对语法错误句子的纠正能力;

第二阶段:采用来源于非英语母语者的大学论文和写作中出现的错误数据。相较于伪数据,该数据更贴近真实情况,数据质量也相对更高,此阶段训练有助于模型建模真实世界中的英文句子;

第三阶段:训练采用来源于英语母语者的英语水平证书考试和论文中的错误数据。此阶段训练数据也包含没有语法错误的句子,从而进一步加大训练难度,需要模型辨别真个句子是否含语法错误,防止模型在测试阶段过度纠正,影响纠正效果;英语母语者的数据更具难度,可以进一步提高模型的训练难度,提升英语语法纠正能力。

进一步的,步骤5中使用迭代纠正的方式最大限度地找出句子中出现的语法错误。

本发明的有益效果是:本发明所涉及的基于多任务学习和注意力机制的英文语法纠正技术,使用对英文语义信息建模更强的预训练模型,引入语义信息的注意力机制,获取更好地融合句法信息和语义信息的上下文表示,在训练过程中引入三个任务从不同方面约束模型训练,从而得到更具准确性和置信度的英文语法错误纠正系统。由于英语语法错误的类型繁多,修改跨度过大,本发明方法可以让使用者较快地找到文本中出现的语法错误类型,并给出正确句子的修改意见,提高校正效率及可解释性。本发明也可以应用于搜索技术中,用以对用户输入的查询信息作校正,更好地帮助检索系统识别用户意图和查询目标,提升搜索质量并优化用户体验;或是用于非英语母语者的英语学习中,对各类型语法错误进行针对性改进,帮助使用者快速提升英语语法水平;或是用于英文文章的校验系统中,给出适当的句子修改建议,提升文章准确性和可读性。

附图说明

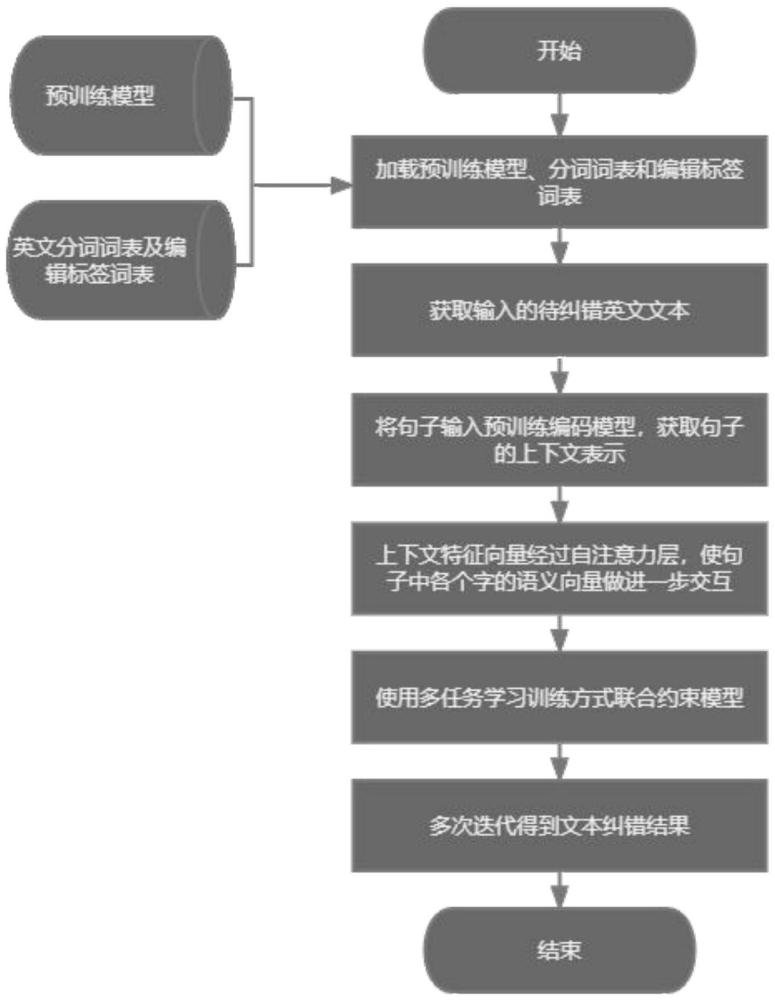

图1是本发明的流程图;

图2为本发明中基于多任务学习和注意力机制的英文语法纠正模型的模型结构图;

图3为本发明实施例中的文本纠正效果。

具体实施方式

具体实施方式一:结合图1至图3说明本实施方式,本实施方式所述一种基于多任务学习和注意力机制的英文语法纠正技术是通过如下步骤实现的:

步骤1、对于输入的句子,从数据库中读取英文分词词表及编辑标签词表;

步骤2、将句子输入预训练编码模型,获取整个句子的上下文表示;

步骤3、将得到的上下文特征向量经过自注意力层,通过自注意力机制,使句子中各个字的语义向量做进一步交互;

步骤4、使用二分类分类器,判别输入子词是否需要进行编辑操作,使用词表大小的分类器对输入的子词进行编辑标签分类,选择得分最高的分类结果作为对应子词的编辑标签;

步骤5、根据模型预测的纠正标签对应的意义对输入句子中的单词进行后处理,得到的后处理结果再输入模型进行多次迭代得到最终结果。

本实施方式中步骤1是前置步骤,在英文语法纠正领域,错误类型包含主谓不一致,动词时态错误、冠词缺失、介词误用等;领域中较为普遍的实现方式是对英文句子中的逐个单词给出修正意见,再根据修正意见做后处理形成最终纠正结果;因此,英文语法纠正技术的第一步是对英文句子分词,相比于中文纠正技术中按字分词,英文分词技术会将一些单词分成多个部分的子词,如英文单词“transformers”会被切分为“transform”和“ers”两部分,因此首先需要加载英文分词词表指导对输入句子做分词;将句子分成字词后,英文语法纠正技术会针对每个子词预测其对应的编辑操作,如句子“Go to home now.”中的子词“to”对应的编辑标签为“$DELETE”,意为将当前子词删除,这样,通过对整个句子的所有子词进行预测,可以得到一个编辑标签序列,在针对这些编辑标签的类型做后处理,即可得到语法纠正后的句子。

步骤2是是将输入的英文句子转化为数字构成的向量。通过BERT的编码表示,从而获得表征了输入句子上下文句法信息、语义信息的特征向量。

步骤3将步骤2中预训练编码模型输出的上下文特征向量经过自注意力层,通过字注意力机制,使不同字的表示向量做交互,对于含有句法依赖的字,对应的注意力要高于句中其他字,进而使得模型明白哪些部分的字是存在句法依赖的,进一步整合输入句子中的句法信息和语义信息。

步骤4是将步骤3中获取的三个表示输入门控层做加权融合,对多个模态表示融合,获取中文字的最终表示。

步骤5是将步骤4中输出的编辑标签序列与输入句子序列进行后处理,根据编辑标签的含义,对句子中的逐个单词做后处理,形成语法纠正结果;由于出现英文语法错误的句子通常存在多种错误叠加的情况,所以需要对句子进行迭代纠错来尽可能纠正出句中存在的所有错误,形成最终的纠正结果。

具体实施方式二:结合图1至图3说明本实施方式,本实施方式所述一种基于多任务学习和注意力机制的英文语法纠正技术的步骤2中采用的预训练英文编码模型包括RoBERTa,XLNet和DeBERTa,三个预训练模型均是BERT的改进版,使用了更多的预训练语料,更合理的预训练任务及建模机制训练完成的,在多个英文语义建模领域都有不错的效果。具体过程包括以下步骤:

步骤2.1对于输入的英文句子,加载英文分词工具,将英文句子的逐个单词切分为子词形式;

步骤2.2将英文句子的子词序列通过预训练英文编码模型的词嵌入层,映射为768维的向量;

步骤2.3将映射向量经过12层预训练英文编码模型,并将模型最后三层输出的隐藏层向量沿着最后一维拼接并取平均,从而获得包含更多语义信息的隐层向量。

具体实施方式三:结合图1至图3说明本实施方式,本实施方式所述一种基于多任务学习和注意力机制的英文语法纠正技术的步骤3中的自注意力层对步骤2输出的包含语义信息的编码表示做self-attention操作,使得整个句子中的语义表示做进一步交互,

Attn(x)=(W

公式(1)中x表示步骤2中获取的句子的语义表示,W

具体实施方式四:结合图1至图3说明本实施方式,本实施方式所述一种基于多任务学习和注意力机制的英文语法纠正技术的步骤4中在训练阶段使用多任务学习的方式进一步约束模型的优化方向,

在训练阶段提出了三个约束帮助模型达到更优;

Loss=Loss

公式(2)为第一个损失约束公式,其中P

公式(3)为第二个损失约束公式,其中P

公式(4)为第三个损失约束公式,其中y为一个全1的向量,决定优化方向;

具体实施方式五:结合图1至图3说明本实施方式,本实施方式所述一种基于多任务学习和注意力机制的英文语法纠正技术的步骤4的训练过程中采用多阶段训练以逐步提升训练难度;

在语法错误纠正领域,句子中只有小部分是存在语法错误的,即大多数成分是需要保持不变的,这需要模型在训练过程中应当见到不含语法错误的句子;本发明在训练阶段采用多阶段训练,逐步提升训练难度,保证模型纠正的准确性;模型的训练具体分为三阶段:

第一阶段:采用人工生成的伪数据进行训练,这些数据使用动词时态表,以及随即删除、插入英文词形成,共计900万条数据;这些数据全部包含错误,通过足够量的数据作为预训练,初步提升模型对语法错误句子的纠正能力;

第二阶段:采用来源于非英语母语者的大学论文和写作中出现的错误数据。相较于伪数据,该数据更贴近真实情况,数据质量也相对更高,此阶段训练有助于模型建模真实世界中的英文句子;

第三阶段:训练采用来源于英语母语者的英语水平证书考试和论文中的错误数据。此阶段训练数据也包含没有语法错误的句子,从而进一步加大训练难度,需要模型辨别真个句子是否含语法错误,防止模型在测试阶段过度纠正,影响纠正效果;英语母语者的数据更具难度,可以进一步提高模型的训练难度,提升英语语法纠正能力。

具体实施方式六:结合图1至图3说明本实施方式,本实施方式所述一种基于多任务学习和注意力机制的英文语法纠正技术的步骤5中使用迭代纠正的方式最大限度地找出句子中出现的语法错误。

部分英文句子中的语法错误是具有蕴含性的,即有些错误是需要前序错误的纠正才可被模型发现;根据本发明给出的编辑标签预测的纠正方式,先将名词的单复数做纠正,再使用连字符将单词连接起来完成最终纠错,这就需要多步骤的纠错;此外,模型会对出现较多语法错误的句子的语义建模出现偏差,这也需要使用迭代的方式让模型逐步理解;使用多轮迭代纠错能够让模型更进一步发现句子中的隐含语法错误。

实施例

本发明中按照上述步骤可实现一个简单的自动化英文语法纠正模块,该模块可以嵌入到任何现存的系统中,达到即插即用的效果,具体验证发明有益效果如下:

本实施例按照如图1所示流程进行,搭建一个基于多模态预训练融合的中文拼写纠正系统。本发明所实现的系统启动之后,首先从数据库中取出输入的待纠错英文文本并分为子词,然后将子词序列输入预训练英文编码模型。模型输出的上下文特征经过自注意力层,完成进一步交互,使用蕴含句法信息和语义信息的表示得到最终语法纠正结果。

本发明节选非英语母语者书写文章中的一段内容,发明所搭建的系统的纠正结果如图3所示。根据图中给出的纠正结果和纠正意见可以看到,本发明使用的基于多任务学习和注意力机制的英文语法纠正技术,可以实现对冠词缺失错误的纠正:“with certain”-“with acertain”;也可以实现对介词误用错误的纠正:“diagnosed out”-“diagnosed”;同时,对于学习者易犯的动词时态错误也可以进行纠正:“suppose”-“supposed”。通过本发明方法,使用者可以直观的看到文章中出现的英语语法错误,并作快速改正。

以上所述,仅是本发明的较佳实施例而已,并非对本发明作任何形式上的限制,虽然本发明已以较佳实施例揭露如上,然而并非用以限定本发明,任何熟悉本专业的技术人员,在不脱离本发明技术方案范围内,当可利用上述揭示的技术内容做出些许更动或修饰为等同变化的等效实施例,但凡是未脱离本发明技术方案内容,依据本发明的技术实质,在本发明的精神和原则之内,对以上实施例所作的任何简单的修改、等同替换与改进等,均仍属于本发明技术方案的保护范围之内。

- 一种基于语法分析树上注意力机制的深度学习视频问答方法及系统

- 一种基于多任务学习的混合注意力机制文本标题匹配方法